نماذج اللغة هي طرق إحصائية تتنبأ بتعاقب الرموز في تسلسل باستخدام نص طبيعي. نماذج اللغات الكبيرة (LLMs) هي نماذج لغة قائمة على الشبكة العصبية بمئات الملايين (بيرت) لأكثر من تريليون معلمة (ميكس) ، وحجمها يجعل التدريب أحادي GPU غير عملي. تجعلها القدرات التوليدية لـ LLMs شائعة في تركيب النص والتلخيص والترجمة الآلية والمزيد.

يعد حجم LLM وبيانات التدريب الخاصة به بمثابة سيف ذو حدين: فهو يجلب جودة النمذجة ، ولكنه ينطوي على تحديات البنية التحتية. غالبًا ما يكون النموذج نفسه كبيرًا جدًا بحيث لا يتناسب مع ذاكرة جهاز GPU واحد أو على أجهزة متعددة لمثيل GPU متعدد. تتطلب هذه العوامل تدريب LLM على مجموعات كبيرة من مثيلات التعلم الآلي المتسارع (ML). في السنوات القليلة الماضية ، استخدم العديد من العملاء سحابة AWS لتدريب LLM.

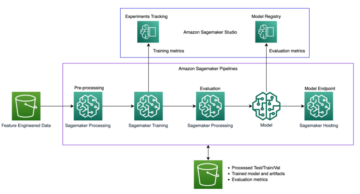

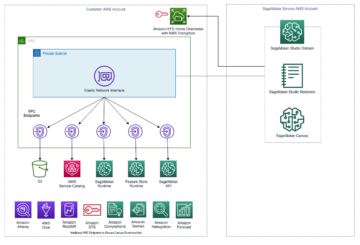

في هذا المنشور ، نتعمق في النصائح وأفضل الممارسات لتدريب LLM ناجح تدريب Amazon SageMaker. تدريب SageMaker عبارة عن خدمة حوسبة مجمعة مُدارة تعمل على تقليل الوقت والتكلفة لتدريب النماذج وضبطها على نطاق واسع دون الحاجة إلى إدارة البنية التحتية. ضمن أمر إطلاق واحد ، الأمازون SageMaker تطلق مجموعة حوسبة سريعة الزوال تعمل بكامل طاقتها وتدير المهمة التي تختارها ، ومع ميزات ML المحسّنة مثل metastore ، والإدخال / الإخراج المُدار ، والتوزيع. يغطي المنشور جميع مراحل عبء عمل تدريب LLM ويصف ميزات البنية التحتية المرتبطة وأفضل الممارسات. تشير بعض أفضل الممارسات في هذا المنشور تحديدًا إلى مثيلات ml.p4d.24xlarge ، ولكن معظمها قابل للتطبيق على أي نوع مثيل. تسمح لك أفضل الممارسات بتدريب LLMs على SageMaker بمقياس من عشرات إلى مئات الملايين من المعلمات.

فيما يتعلق بنطاق هذا المنشور ، لاحظ ما يلي:

- نحن لا نغطي التصميم العلمي للشبكة العصبية والتحسينات المرتبطة بها. الأمازون يتميز بالعديد من المنشورات العلمية ، بما في ذلك على سبيل المثال لا الحصر ماجستير.

- على الرغم من أن هذا المنشور يركز على LLMs ، إلا أن معظم أفضل ممارساته ذات صلة بأي نوع من التدريب على النماذج الكبيرة ، بما في ذلك رؤية الكمبيوتر والنماذج متعددة الوسائط ، مثل Stable Diffusion.

أفضل الممارسات

نناقش أفضل الممارسات التالية في هذا المنشور:

- إحصاء - SageMaker Training هي واجهة برمجة تطبيقات رائعة لإطلاق وظائف إعداد مجموعة بيانات وحدة المعالجة المركزية وألف وظيفة GPU.

- الخزائن - نرى تحميل البيانات ونقاط التفتيش يتم بطريقتين ، اعتمادًا على المهارات والتفضيلات: باستخدام ملف أمازون FSx بريق نظام الملفات ، أو خدمة تخزين أمازون البسيطة (Amazon S3) فقط.

- تماثل - يعد اختيارك لمكتبة التدريب الموزعة أمرًا بالغ الأهمية للاستخدام المناسب لوحدات معالجة الرسومات. نوصي باستخدام مكتبة مُحسّنة على السحابة ، مثل توازي البيانات المُقسمة من SageMaker ، ولكن يمكن أيضًا أن تعمل المكتبات ذاتية الإدارة والمفتوحة المصدر.

- الشبكات - تأكد من تمكين EFA و NVIDIA GPUDirectRDMA للاتصال السريع بين الأجهزة.

- مرونة - على نطاق واسع ، يمكن أن تحدث أعطال في الأجهزة. نوصي نقاط التفتيش بانتظام. كل بضع ساعات أمر شائع.

اختيار المنطقة

يعد نوع المثيل والسعة المرغوبة عاملاً محددًا لاختيار المنطقة. بالنسبة للمناطق التي يدعمها SageMaker و الأمازون الحوسبة المرنة السحابية أنواع مثيلات (Amazon EC2) المتوفرة في كل منطقة ، راجع الأمازون SageMaker التسعير. في هذا المنشور ، نفترض أن نوع المثيل التدريبي هو ml.p4d.24xlarge الذي تديره SageMaker.

نوصي بالعمل مع فريق حساب AWS الخاص بك أو الاتصال مبيعات AWS لتحديد المنطقة المناسبة لأعباء عمل LLM الخاصة بك.

إعداد البيانات

يقوم مطورو LLM بتدريب نماذجهم على مجموعات بيانات كبيرة من النص الطبيعي. تشمل الأمثلة الشائعة لمصادر البيانات هذه الزحف المشترك و كومة. قد يحتوي النص الطبيعي على تحيزات وعدم دقة وأخطاء نحوية وتنوعات في بناء الجملة. تعتمد الجودة النهائية لـ LLM بشكل كبير على اختيار بيانات التدريب وتنظيمها. يعد إعداد بيانات تدريب LLM مجالًا نشطًا للبحث والابتكار في صناعة LLM. يزخر إعداد مجموعة بيانات معالجة اللغة الطبيعية (NLP) بفرص التوازي التي لا تشارك أي شيء. بمعنى آخر ، هناك خطوات يمكن تطبيقها على وحدات العمل - ملفات المصدر ، الفقرات ، الجمل ، الكلمات - دون الحاجة إلى التزامن بين العاملين.

تتفوق واجهات برمجة تطبيقات وظائف SageMaker ، وهي SageMaker Training و SageMaker Processing ، في هذا النوع من المهام. إنها تمكن المطورين من تشغيل حاوية Docker عشوائية على أسطول من أجهزة متعددة. في حالة SageMaker Training API ، يمكن أن يكون أسطول الحوسبة غير متجانسة. تم استخدام العديد من أطر الحوسبة الموزعة على SageMaker ، بما في ذلك داسك, شعاع، و أيضا بايسبارك، والتي لديها ملف حاوية تديرها AWS و SDK في معالجة SageMaker.

عند بدء عمل باستخدام أجهزة متعددة ، يقوم SageMaker Training and Processing بتشغيل الكود الخاص بك مرة واحدة لكل جهاز. لا تحتاج إلى استخدام إطار عمل خاص للحوسبة الموزعة لكتابة تطبيق موزع: يمكنك كتابة الكود الذي تختاره ، والذي سيتم تشغيله مرة واحدة لكل جهاز ، لتحقيق التوازي بدون مشاركة. يمكنك أيضًا كتابة أو تثبيت منطق الاتصال بين العقد الذي تختاره.

تحميل البيانات

هناك طرق متعددة لتخزين بيانات التدريب ونقلها من تخزينها إلى عقد الحوسبة المتسارعة. في هذا القسم ، نناقش الخيارات وأفضل الممارسات لتحميل البيانات.

خيارات تخزين وتحميل SageMaker

يبلغ حجم مجموعة بيانات LLM النموذجي مئات الملايين من الرموز النصية ، والتي تمثل بضع مئات من الجيجابايت. تقترح مجموعات مثيلات ml.p4d.24xlarge التي يديرها SageMaker عدة خيارات لتخزين مجموعة البيانات وتحميلها:

- على عقدة NVMe SSD - مثيلات ml.P4d.24xlarge مجهزة بـ 8 تيرابايت NVMe ، متاح تحت

/opt/ml/input/data/<channel>كما ترى وضع ملف SageMakerوعلى/tmp. إذا كنت تبحث عن بساطة وأداء قراءة محلية ، فيمكنك نسخ بياناتك إلى NVMe SSD. يمكن إجراء النسخة إما عن طريق وضع ملف SageMaker ، أو عن طريق الكود الخاص بك ، على سبيل المثال باستخدام المعالجة المتعددة بوتو 3 or S5cmd. - FSx للبريق - محركات أقراص الحالة الصلبة NVMe SSD على العقدة محدودة الحجم وتتطلب استيعابها من Amazon S3 في كل وظيفة أو إنشاء مجموعة دافئة. إذا كنت تتطلع إلى التوسع في مجموعات البيانات الأكبر مع الحفاظ على الوصول العشوائي بزمن انتقال منخفض ، فيمكنك استخدام FSx لـ Luster. Amazon FSx هو نظام ملفات متوازي مفتوح المصدر ، شائع في الحوسبة عالية الأداء (HPC). FSx لاستخدامات Luster تخزين الملفات الموزعة (تجريد) وفصل البيانات الوصفية للملف عن محتوى الملف لتحقيق أداء قراءة / كتابة عالي الأداء.

- وضع SageMaker FastFile - وضع FastFile (بعثة تقصي الحقائق) هي ميزة خاصة بـ SageMaker فقط تقدم كائنات S3 بعيدة في مثيلات الحوسبة التي يديرها SageMaker ضمن واجهة متوافقة مع POSIX ، وتدفقها فقط عند القراءة ، باستخدام FUSE. تقرأ FFM النتائج في مكالمات S3 التي تقوم بدفق الملفات البعيدة كتلة تلو الأخرى. كأفضل ممارسة لتجنب الأخطاء المتعلقة بحركة مرور Amazon S3 ، يجب أن يهدف مطورو FFM إلى الحفاظ على العدد الأساسي لمكالمات S3 معقولًا ، على سبيل المثال عن طريق قراءة الملفات بشكل متسلسل مع قدر متحكم من التوازي.

- تحميل البيانات المدارة ذاتيا - بالطبع ، قد تقرر أيضًا تنفيذ منطق تحميل البيانات المخصص بالكامل الخاص بك ، وذلك باستخدام شفرة الملكية أو مفتوحة المصدر. تتمثل بعض أسباب استخدام تحميل البيانات المدارة ذاتيًا في تسهيل الترحيل عن طريق إعادة استخدام التعليمات البرمجية المطورة بالفعل ، أو لتنفيذ منطق معالجة الخطأ المخصص ، أو للحصول على مزيد من التحكم في الأداء الأساسي والتجزئة. تتضمن أمثلة المكتبات التي قد تستخدمها لتحميل البيانات المدارة ذاتيًا torchdata.datapipes (سابقا البرنامج المساعد AWS PyTorch S3) و مجموعة بيانات الويب. حزمة AWS Python SDK بوتو 3 يمكن أيضًا دمجها مع مجموعة بيانات الشعلة فئات لإنشاء كود تحميل بيانات مخصص. تتيح فئات تحميل البيانات المخصصة أيضًا الاستخدام الإبداعي لمجموعات SageMaker Training غير المتجانسة ، لتكييف توازن وحدة المعالجة المركزية (CPU) ووحدة معالجة الرسومات (GPU) بدقة مع حمل عمل معين.

لمزيد من المعلومات حول هذه الخيارات وكيفية اختيارها ، يرجى الرجوع إلى اختر أفضل مصدر بيانات لوظيفة تدريب Amazon SageMaker.

أفضل الممارسات للتفاعل واسع النطاق مع Amazon S3

Amazon S3 قادر على التعامل مع أعباء عمل LLM ، لقراءة البيانات ونقاط الفحص. وهو يدعم أ معدل الطلب من 3,500 طلب PUT / COPY / POST / DELETE أو 5,500 طلب GET / HEAD في الثانية لكل بادئة في مجموعة. ومع ذلك ، فإن هذا المعدل ليس بالضرورة متاحًا بشكل افتراضي. بدلاً من ذلك ، مع نمو معدل طلب البادئة ، يتوسع Amazon S3 تلقائيًا للتعامل مع المعدل المتزايد. لمزيد من المعلومات ، يرجى الرجوع إلى لماذا أتلقى 503 أخطاء إبطاء من Amazon S3 عندما تكون الطلبات ضمن معدل الطلب المدعوم لكل بادئة.

إذا كنت تتوقع تفاعل Amazon S3 عالي التردد ، فإننا نوصي بأفضل الممارسات التالية:

- حاول القراءة والكتابة من عدة حاويات S3 و البادئات. على سبيل المثال ، يمكنك تقسيم بيانات التدريب ونقاط التحقق عبر بادئات مختلفة.

- تحقق من مقاييس Amazon S3 بتنسيق الأمازون CloudWatch لتتبع معدلات الطلب.

- حاول تقليل مقدار PUT / GET المتزامن:

- احصل على عمليات أقل باستخدام Amazon S3 في نفس الوقت. على سبيل المثال ، إذا احتاجت ثماني عمليات لكل عقد إلى نقطة تفتيش على Amazon S3 ، فيمكنك تقليل حركة مرور PUT بمعامل 8 عن طريق تحديد نقاط التحقق بشكل هرمي: أولاً داخل العقدة ، ثم من العقدة إلى Amazon S3.

- اقرأ سجلات تدريب متعددة من ملف واحد أو S3 GET ، بدلاً من استخدام S3 GET لكل سجل تدريب.

- إذا كنت تستخدم Amazon S3 عبر SageMaker FFM ، فإن SageMaker FFM تجري مكالمات S3 لجلب الملفات مقسمة إلى أجزاء. للحد من حركة مرور Amazon S3 الناتجة عن FFM ، نشجعك على قراءة الملفات بالتسلسل والحد من عدد الملفات المفتوحة بالتوازي.

إذا كان لديك خطة دعم المطور أو الأعمال أو المؤسسة، يمكنك فتح حالة دعم فني حول أخطاء S3 503 Slow Down. لكن تأكد أولاً من اتباعك أفضل الممارسات ، و الحصول على معرفات الطلب للطلبات الفاشلة.

التوازي التدريب

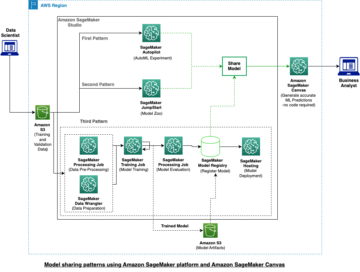

عادةً ما تحتوي LLM على عشرات إلى مئات المليارات من المعلمات ، مما يجعلها أكبر من أن تتناسب مع بطاقة NVIDIA GPU واحدة. طور ممارسو LLM العديد من المكتبات مفتوحة المصدر لتسهيل الحساب الموزع لتدريب LLM ، بما في ذلك FSDP, السرعة العميقة و ميجاترون. يمكنك تشغيل هذه المكتبات في تدريب SageMaker ، ولكن يمكنك أيضًا استخدام مكتبات التدريب الموزعة من SageMaker ، والتي تم تحسينها من أجل سحابة AWS وتوفر تجربة مطور أبسط. للمطورين خياران للتدريب الموزع على LLM على SageMaker: المكتبات الموزعة أو المدارة ذاتيًا.

قامت SageMaker بتوزيع مكتبات

لتزويدك بأداء التدريب الموزع المحسن وسهولة الاستخدام ، يقترح تدريب SageMaker العديد من الامتدادات الخاصة لتوسيع نطاق كود التدريب TensorFlow و PyTorch. غالبًا ما يتم إجراء تدريب LLM بطريقة التوازي ثلاثي الأبعاد:

- توازي البيانات يقسم ويغذي مجموعات التدريب الصغيرة إلى نسخ متماثلة متعددة من النموذج ، لزيادة سرعة المعالجة

- موازاة خطوط الأنابيب يعزو طبقات مختلفة من النموذج إلى وحدات معالجة رسومات مختلفة أو حتى مثيلات ، من أجل قياس حجم النموذج بما يتجاوز وحدة معالجة رسومات واحدة وخادم واحد

- التوازي الموتر يقسم طبقة واحدة إلى عدة وحدات معالجة رسومات (GPU) ، عادةً داخل نفس الخادم ، لتوسيع نطاق الطبقات الفردية إلى أحجام تتجاوز وحدة معالجة رسومات واحدة

في المثال التالي ، يتم تدريب نموذج من 6 طبقات على مجموعة من خوادم k * 3 مع 8 * k * 3 GPUs (8 وحدات معالجة رسومات لكل خادم). درجة توازي البيانات هي k ، وتوازي خط الأنابيب 6 ، وتوازي الموتر 4. تحتوي كل وحدة معالجة رسومات في المجموعة على ربع طبقة النموذج ، ويتم تقسيم النموذج الكامل على ثلاثة خوادم (إجمالي 24 وحدة معالجة رسومات).

ما يلي ذو صلة خاصة بـ LLMs:

- نموذج SageMaker الموزع بالتوازي - تستخدم هذه المكتبة تقسيم الرسم البياني لإنتاج نموذج تقسيم ذكي محسّن للسرعة أو الذاكرة. يعرض نموذج SageMaker الموزع المتوازي أحدث وأكبر تحسين للتدريب على النموذج الكبير ، بما في ذلك توازي البيانات ، وتوازي خطوط الأنابيب ، وتوازي الموتر ، وتقسيم حالة المحسن ، ونقاط فحص التنشيط ، والتفريغ. من خلال مكتبة SageMaker الموزعة للنماذج المتوازية ، قمنا بتوثيق 175 مليار نموذج تدريب على 920 NVIDIA A100 GPUs. لمزيد من المعلومات ، يرجى الرجوع إلى قم بتدريب 175+ مليار من نماذج البرمجة اللغوية العصبية مع إضافات نموذجية متوازية و Hugging Face على Amazon SageMaker.

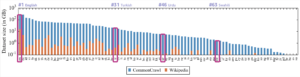

- SageMaker تجزئة البيانات بالتوازي - في MiCS: التحجيم شبه الخطي لتدريب النموذج العملاق على السحابة العامة، تشانغ وآخرون. تقديم إستراتيجية موازية لنموذج الاتصال المنخفض تقسم النماذج على مجموعة موازية للبيانات فقط ، بدلاً من المجموعة بأكملها. باستخدام MiCS ، تمكن علماء AWS من تحقيق 176 تيرافلوب لكل GPU (56.4٪ من الذروة النظرية) لتدريب نموذج 210 طبقة 1.06 تريليون متغير على مثيلات EC2 P4de. MiCS متاح الآن لعملاء SageMaker Training مثل SageMaker تجزئة البيانات بالتوازي.

توفر مكتبات التدريب الموزعة من SageMaker أداءً عاليًا وتجربة أبسط للمطورين. على وجه الخصوص ، لا يحتاج المطورون إلى كتابة مشغّل عمليات متوازي مخصص والاحتفاظ به أو استخدام أداة إطلاق خاصة بإطار العمل ، لأن المشغل المتوازي مدمج في SDK لإطلاق المهمة.

الإدارة الذاتية

مع SageMaker Training ، لديك الحرية في استخدام الإطار والنموذج العلمي الذي تختاره. على وجه الخصوص ، إذا كنت ترغب في إدارة التدريب الموزع بنفسك ، فلديك خياران لكتابة التعليمات البرمجية المخصصة الخاصة بك:

- استخدم حاوية التعلم العميق AWS (DLC) - تقوم AWS بتطويرها وصيانتها DLCs، مما يوفر بيئات قائمة على Docker مُحسّنة من AWS لأطر عمل ML مفتوحة المصدر. يتمتع SageMaker Training بتكامل فريد يسمح لك بسحب AWS DLC وتشغيلها باستخدام نقطة دخول خارجية يحددها المستخدم. بالنسبة لتدريب LLM على وجه الخصوص ، تعد AWS DLCs لـ TensorFlow و PyTorch و Hugging Face و MXNet ذات صلة بشكل خاص. يتيح لك استخدام DLC لإطار العمل استخدام التوازي الأصلي للإطار ، مثل PyTorch Distributed ، دون الحاجة إلى تطوير وإدارة صور Docker الخاصة بك. بالإضافة إلى ذلك ، تتميز DLCs الخاصة بنا بامتداد تكامل MPI، والذي يسمح لك بتشغيل الكود المتوازي بسهولة.

- اكتب صورة Docker مخصصة متوافقة مع SageMaker - يمكنك إحضار صورتك الخاصة (BYO) (انظر استخدم خوارزميات التدريب الخاصة بك و حاويات تدريب Amazon SageMaker المخصصة) ، إما البدء من نقطة الصفر أو توسيع صورة DLC موجودة. عند استخدام صورة مخصصة لتدريب LLM على SageMaker ، من المهم بشكل خاص التحقق مما يلي:

- تحتوي صورتك على EFA مع الإعدادات المناسبة (تمت مناقشتها أكثر لاحقًا في هذا المنشور)

- تحتوي صورتك على مكتبة اتصالات NVIDIA NCCL ، مُمكَّنة باستخدام GPUDirectRDMA

تمكن العملاء من استخدام عدد من مكتبات التدريب الموزعة المدارة ذاتيًا ، بما في ذلك DeepSpeed.

مجال الاتصالات

نظرًا للطبيعة الموزعة لوظيفة تدريب LLM ، فإن الاتصال بين الأجهزة أمر بالغ الأهمية لجدوى وأداء وتكاليف عبء العمل. في هذا القسم ، نقدم الميزات الرئيسية للاتصال بين الأجهزة ونختتم بنصائح حول التثبيت والضبط.

محول النسيج المرن

من أجل تسريع تطبيقات ML وتحسين الأداء من خلال تحقيق المرونة وقابلية التوسع والمرونة التي توفرها السحابة ، يمكنك الاستفادة من محول النسيج المرن (EFA) مع SageMaker. في تجربتنا ، يعد استخدام EFA مطلبًا للحصول على أداء تدريب LLM مُرضٍ متعدد العقد.

جهاز EFA هو واجهة شبكة متصلة بمثيلات EC2 التي يديرها SageMaker أثناء تشغيل وظائف التدريب. التعليم للجميع متاح على عائلات محددة من الحالات ، بما في ذلك P4d. شبكات EFA قادرة على تحقيق عدة مئات من الجيجابت في الثانية من الإنتاجية.

المرتبطة بـ EFA ، قدمت AWS ملف مخطط بيانات موثوق قابل للتطوير (SRD) ، وسيلة نقل قائمة على الإيثرنت مستوحاة من مخطط بيانات موثوق به من InfiniBand، تم تطويره باستخدام قيود ترتيب الحزمة المريحة. لمزيد من المعلومات حول EFA و SRD ، يرجى الرجوع إلى في البحث عن الأداء ، هناك أكثر من طريقة لبناء شبكة، الفيديو كيف يعمل برنامج التعليم للجميع ولماذا لا نستخدم نطاق infiniband في السحابةوورقة البحث بروتوكول نقل مُحسَّن على السحابة من أجل HPC المرن والقابل للتطوير من شاليف وآخرون.

يمكنك إضافة تكامل EFA على مثيلات متوافقة إلى حاويات Docker الحالية من SageMaker ، أو الحاويات المخصصة التي يمكن استخدامها لتدريب نماذج ML باستخدام وظائف SageMaker. لمزيد من المعلومات ، يرجى الرجوع إلى قم بتشغيل التدريب باستخدام EFA. يتم الكشف عن EFA عبر المصدر المفتوح ليبفابريك حزمة الاتصالات. ومع ذلك ، نادرًا ما يقوم مطورو LLM ببرمجتها مباشرةً باستخدام Libfabric ، وعادةً ما يعتمدون بدلاً من ذلك على مكتبة اتصالات NVIDIA الجماعية (NCCL).

المكون الإضافي AWS-OFI-NCCL

في ML الموزع ، يتم استخدام EFA غالبًا مع مكتبة الاتصالات الجماعية NVIDIA (NCCL). NCCL هي مكتبة مفتوحة المصدر طورتها NVIDIA وتنفذ خوارزميات الاتصال بين وحدات معالجة الرسومات. يعد الاتصال بين وحدات معالجة الرسومات حجر الزاوية في تدريب LLM الذي يحفز قابلية التوسع والأداء. من الأهمية بمكان بالنسبة لتدريب DL أن NCCL غالبًا ما يتم دمجه بشكل مباشر كواجهة خلفية للاتصال في مكتبات تدريب التعلم العميق ، بحيث يستخدمه مطورو LLM - أحيانًا دون ملاحظة - من إطار عمل تطوير Python DL المفضل لديهم. لاستخدام NCCL في EFA ، يستخدم مطورو LLM برنامج AWS المطور البرنامج المساعد AWS OFI NCCL، والتي تقوم بتعيين مكالمات NCCL إلى واجهة Libfabric المستخدمة بواسطة EFA. نوصي باستخدام أحدث إصدار من AWS OFI NCCL للاستفادة من التحسينات الأخيرة.

للتحقق من أن NCCL يستخدم EFA ، يجب عليك تعيين متغير البيئة NCCL_DEBUG إلى INFO، وتحقق من السجلات التي تم تحميل EFA بواسطة NCCL:

لمزيد من المعلومات حول تكوين NCCL و EFA ، يرجى الرجوع إلى اختبر تكوين EFA و NCCL. يمكنك تخصيص المزيد من NCCL مع عدة متغيرات البيئة. لاحظ أنه فعال في NCCL 2.12 وما فوق ، ساهمت AWS بمنطق اختيار خوارزمية الاتصال الآلي لشبكات EFA (NCCL_ALGO يمكن تركها بدون ضبط).

NVIDIA GPUDirect RDMA عبر EFA

مع نوع المثيل P4d ، نحن أدخلت GPUDirect RDMA (GDR) على قماش EFA. إنه يمكّن بطاقات واجهة الشبكة (NIC) من الوصول مباشرةً إلى ذاكرة وحدة معالجة الرسومات ، مما يجعل الاتصال عن بُعد من وحدة معالجة الرسومات إلى وحدة معالجة الرسومات عبر مثيلات EC2 المستندة إلى وحدة معالجة الرسومات NVIDIA أسرع ، مما يقلل من عبء التنسيق على وحدات المعالجة المركزية وتطبيقات المستخدم. يتم استخدام GDR تحت الغطاء بواسطة NCCL ، عندما يكون ذلك ممكنًا.

يظهر استخدام GDR في الاتصال بين GPU عند تعيين مستوى السجل على INFO ، كما في الكود التالي:

استخدام التعليم للجميع في حاويات التعلم العميق في AWS

تحتفظ AWS بحاويات التعلم العميق (DLC) ، والتي يأتي الكثير منها مع ملفات Dockerfiles المدارة من AWS والتي تحتوي على EFA و AWS OFI NCCL و NCCL. تقدم مستودعات جيثب التالية أمثلة مع ملفات PyTorch و TensorFlow. لست بحاجة إلى تثبيت هذه المكتبات بنفسك.

استخدام EFA في حاوية تدريب SageMaker الخاصة بك

إذا قمت بإنشاء حاوية تدريب SageMaker الخاصة بك وترغب في استخدام NCCL عبر EFA للاتصال السريع بين العقد ، فأنت بحاجة إلى تثبيت EFA و NCCL و AWS OFI NCCL. لمزيد من المعلومات ، يرجى الرجوع إلى قم بتشغيل التدريب باستخدام EFA. بالإضافة إلى ذلك ، يجب عليك تعيين متغيرات البيئة التالية في الحاوية الخاصة بك أو في رمز نقطة الدخول الخاصة بك:

FI_PROVIDER="efa"يحدد مزود واجهة النسيجNCCL_PROTO=simpleيوجه NCCL لاستخدام بروتوكول بسيط للاتصال (حاليًا ، لا يدعم موفر EFA بروتوكولات LL ؛ تمكينها قد يؤدي إلى تلف البيانات)FI_EFA_USE_DEVICE_RDMA=1يستخدم وظيفة RDMA للجهاز للنقل من جانب واحد وعلى الوجهينNCCL_LAUNCH_MODE="PARALLEL"NCCL_NET_SHARED_COMMS="0"

تزامن

تتطلب إدارة دورة الحياة وعبء العمل من عشرات إلى مئات من مثيلات الحوسبة برنامج التزامن. في هذا القسم ، نقدم أفضل الممارسات لتنسيق LLM

التنسيق داخل العمل

يجب على المطورين كتابة كود التدريب من جانب الخادم وكود المشغل من جانب العميل في معظم الأطر الموزعة. يعمل كود التدريب على أجهزة التدريب ، بينما يطلق كود المشغل من جانب العميل حمل العمل الموزع من جهاز العميل. هناك القليل من التوحيد القياسي اليوم ، على سبيل المثال:

- في PyTorch ، يمكن للمطورين تشغيل مهام متعددة الأجهزة باستخدام

torchrun,torchx,torch.distributed.launch(مسار الإهمال) ، أوtorch.multiprocessing.spawn - تقترح DeepSpeed أداة إطلاق CLI ذات السرعة العميقة الخاصة بها وتدعم أيضًا إطلاق MPI

- MPI هو إطار عمل حوسبة موازية شائع يتمتع بميزة كونه حيادي ML ومثبت بشكل معقول ، وبالتالي مستقر وموثق ، ويتزايد رؤيته في أعباء عمل ML الموزعة

في مجموعة تدريب SageMaker ، يتم تشغيل حاوية التدريب مرة واحدة على كل جهاز. وبالتالي ، لديك ثلاثة خيارات:

- قاذفة أصلية - يمكنك استخدام المشغل الأصلي لإطار عمل DL معين كنقطة دخول ، على سبيل المثال a

torchruncall ، والتي ستؤدي بحد ذاتها إلى إنتاج عمليات محلية متعددة وإنشاء اتصالات عبر المثيلات. - تكامل برنامج SageMaker MPI - يمكنك استخدام تكامل SageMaker MPI ، المتاح في AWS DLC ، أو قابل للتثبيت الذاتي عبر sagemaker-مجموعة أدوات التدريب، لتشغيل رمز نقطة الدخول N مرة لكل جهاز مباشرة. هذا له فائدة في تجنب استخدام البرامج النصية الوسيطة والمشغل الخاصة بإطار العمل في التعليمات البرمجية الخاصة بك.

- قامت SageMaker بتوزيع مكتبات - إذا كنت تستخدم مكتبات SageMaker الموزعة ، فيمكنك التركيز على كود التدريب وليس عليك كتابة رمز المشغل على الإطلاق! تم تضمين كود قاذفة SageMaker الموزع في SageMaker SDK.

تنسيق بين الوظائف

غالبًا ما تتكون مشاريع LLM من وظائف متعددة: البحث عن المعلمات ، وتجارب القياس ، والتعافي من الأخطاء ، والمزيد. من أجل بدء مهام التدريب وإيقافها وموازنتها ، من المهم استخدام منسق الوظائف. SageMaker Training هو منسق وظائف ML بدون خادم يوفر مثيلات حسابية عابرة فور الطلب. أنت تدفع فقط مقابل ما تستخدمه ، ويتم إيقاف تشغيل المجموعات بمجرد انتهاء التعليمات البرمجية الخاصة بك. مع حمامات SageMaker الدافئة، لديك خيار تحديد مدة البقاء على مجموعات التدريب ، من أجل إعادة استخدام نفس البنية التحتية عبر الوظائف. هذا يقلل من وقت التكرار وتغير التنسيب بين الوظائف. يمكن إطلاق وظائف SageMaker من مجموعة متنوعة من لغات البرمجة ، بما في ذلك بايثون و CLI.

هناك حزمة Python SDK الخاصة بـ SageMaker تسمى ملف SageMaker بيثون SDK ونفذت عبر sagemaker مكتبة Python ، لكن استخدامها اختياري.

زيادة حصص الوظائف التدريبية مع مجموعة تدريب كبيرة وطويلة

يحتوي SageMaker على حصص افتراضية على الموارد ، مصممة لمنع الاستخدام غير المقصود والتكاليف. لتدريب LLM باستخدام مجموعة كبيرة من المثيلات المتطورة التي تعمل لفترة طويلة ، ستحتاج على الأرجح إلى زيادة الحصص في الجدول التالي.

| اسم الحصة | القيمة الافتراضية |

| أطول وقت تشغيل لوظيفة تدريبية | 432,000 ثانية |

| عدد الحالات في جميع وظائف التدريب | 4 |

| الحد الأقصى لعدد الحالات لكل وظيفة تدريبية | 20 |

| ml.p4d.24xlarge لاستخدام وظيفة التدريب | 0 |

| ml.p4d.24xlarge لتدريب استخدام حمام السباحة الدافئ | 0 |

يرى حصص خدمة AWS كيفية عرض قيم الحصص الخاصة بك وطلب زيادة الحصص. يتم تتبع وتعديل حصص التجمعات عند الطلب والمثيلات الفورية والتدريب بشكل منفصل.

إذا قررت الإبقاء على SageMaker Profiler نشطًا ، فاحذر من أن كل وظيفة تدريبية تطلق مهمة معالجة SageMaker ، كل منها يستهلك مثيل ml.m5.2xlarge. تأكد من أن حصص معالجة SageMaker لديك مرتفعة بما يكفي لاستيعاب تزامن وظيفة التدريب المتوقعة. على سبيل المثال ، إذا كنت ترغب في تشغيل 50 مهمة تدريب ممكّنة لملف التعريف بشكل متزامن ، فستحتاج إلى زيادة ml.m5.2xlarge لمعالجة حد استخدام المهمة إلى 50.

بالإضافة إلى ذلك ، لبدء تشغيل وظيفة طويلة الأمد ، ستحتاج إلى تعيين ملف مقدر max_run إلى الحد الأقصى للمدة المطلوبة لوظيفة التدريب بالثواني ، حتى قيمة الحصة لأطول وقت تشغيل لوظيفة تدريبية.

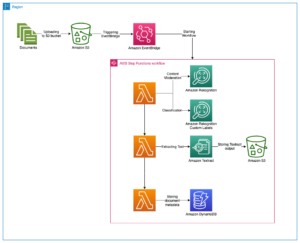

المراقبة والمرونة

يعد فشل الأجهزة نادرًا جدًا على نطاق مثيل واحد ويصبح أكثر تكرارًا مع زيادة عدد المثيلات المستخدمة في وقت واحد. بمقياس LLM النموذجي - المئات إلى الآلاف من وحدات معالجة الرسومات المستخدمة على مدار الساعة طوال أيام الأسبوع لأسابيع إلى شهور - من شبه المؤكد حدوث أعطال في الأجهزة. لذلك ، يجب أن يقوم عبء عمل LLM بتنفيذ آليات المراقبة والمرونة المناسبة. أولاً ، من المهم مراقبة البنية التحتية لـ LLM عن كثب ، للحد من تأثير الفشل وتحسين استخدام موارد الحوسبة. يقترح تدريب SageMaker العديد من الميزات لهذا الغرض:

- يتم إرسال السجلات تلقائيًا إلى سجلات CloudWatch. تتضمن السجلات البرنامج النصي للتدريب الخاص بك

stdoutوstderr. في التدريب الموزع المستند إلى MPI ، يرسل جميع العاملين في MPI سجلاتهم إلى عملية القائد. - يتم إرسال مقاييس استخدام موارد النظام مثل الذاكرة واستخدام وحدة المعالجة المركزية واستخدام وحدة معالجة الرسومات تلقائيًا إلى CloudWatch.

- اطلع على تحديد مقاييس التدريب المخصصة التي سيتم إرسالها إلى CloudWatch. يتم التقاط المقاييس من السجلات بناءً على التعبيرات العادية التي تحددها. حزم تجارب الجهات الخارجية مثل شريك AWS يمكن استخدام عرض الأوزان والتحيزات مع تدريب SageMaker (على سبيل المثال ، انظر تحسين المعلمات الفائقة CIFAR-10 باستخدام W & B و SageMaker).

- ملف التعريف SageMaker يسمح لك بفحص استخدام البنية التحتية والحصول على توصيات التحسين.

- أمازون إيفينت بريدج و AWS لامدا يسمح لك بإنشاء منطق عميل آلي يتفاعل مع أحداث مثل فشل الوظائف والنجاحات وتحميلات ملفات S3 والمزيد.

- مساعد SageMaker SSH هي مكتبة مفتوحة المصدر يديرها المجتمع تتيح لك الاتصال بمضيفي وظائف التدريب من خلال SSH. قد يكون من المفيد فحص واستكشاف أخطاء التعليمات البرمجية التي يتم تشغيلها على عقد محددة.

بالإضافة إلى المراقبة ، تقدم SageMaker أيضًا معدات لمرونة العمل:

- الفحوصات الصحية العنقودية - قبل بدء عملك ، يقوم SageMaker بإجراء فحوصات صحية لوحدة معالجة الرسومات والتحقق من اتصال NCCL في مثيلات GPU ، واستبدال أي حالات معيبة إذا لزم الأمر لضمان بدء تشغيل البرنامج النصي للتدريب على مجموعة صحية من الحالات. تم تمكين عمليات التحقق من الصحة حاليًا لأنواع المثيلات المستندة إلى وحدة معالجة الرسومات P و G.

- عمليات إعادة المحاولة المضمنة وتحديث الكتلة - يمكنك تكوين SageMaker تلقائيًا إعادة المحاولة مهام التدريب التي تفشل بسبب خطأ خادم داخلي (ISE) في SageMaker. كجزء من إعادة محاولة مهمة ما ، سيستبدل SageMaker أي مثيلات واجهت أخطاء GPU غير قابلة للاسترداد بمثيلات جديدة ، ويعيد تشغيل جميع الحالات السليمة ، ويبدأ المهمة مرة أخرى. ينتج عن هذا إعادة تشغيل أسرع وإكمال عبء العمل. تم تمكين تحديث الكتلة حاليًا لأنواع المثيلات المستندة إلى وحدة معالجة الرسومات P و G. يمكنك أن تضيف بنفسك آلية إعادة المحاولة التطبيقية حول رمز العميل الذي يرسل الوظيفة ، للتعامل مع أنواع أخرى من أخطاء التشغيل ، مثل تجاوز حصة حسابك.

- الآلي نقطة تفتيش إلى Amazon S3 - يساعدك ذلك نقطة تفتيش تقدمك وأعد تحميل حالة سابقة على وظائف جديدة.

للاستفادة من الاستبدال على مستوى العقدة ، يجب أن يكون رمزك خطأ. قد تتعطل المجموعات ، بدلاً من الخطأ ، عندما تفشل العقدة. لذلك ، للحصول على علاج سريع ، قم بتعيين مهلة على مجموعاتك بشكل صحيح واجعل الكود يخطئ عند الوصول إليه.

يقوم بعض العملاء بإعداد عميل مراقبة للمراقبة والتصرف في حالة توقف الوظيفة أو إيقاف التقارب التطبيقي ، من خلال مراقبة سجلات ومقاييس CloudWatch للأنماط غير الطبيعية مثل عدم وجود سجلات مكتوبة أو استخدام 0٪ من GPU للتلميح للتعليق وإيقاف التقارب والتلقائية توقف / أعد المحاولة.

الغوص العميق في نقاط التفتيش

• نقطة تفتيش SageMaker ميزة نسخ كل ما تكتب عليه /opt/ml/checkpoints العودة إلى Amazon S3 باعتباره URI المحدد في ملف checkpoint_s3_uri معلمة SDK. عند بدء العمل أو إعادة تشغيله ، يتم إرسال كل شيء مكتوب في URI هذا إلى جميع الأجهزة ، على /opt/ml/checkpoints. يعد هذا مناسبًا إذا كنت تريد أن تتمكن جميع العقد من الوصول إلى جميع نقاط التفتيش ، ولكن على نطاق واسع - عندما يكون لديك العديد من الأجهزة أو العديد من نقاط التفتيش التاريخية ، فقد يؤدي ذلك إلى أوقات تنزيل طويلة وحركة مرور عالية جدًا على Amazon S3. بالإضافة إلى ذلك ، في موازاة الموتر وخطوط الأنابيب ، يحتاج العمال فقط إلى جزء بسيط من نموذج نقاط التفتيش ، وليس كلها. إذا واجهت هذه القيود ، فإننا نوصي بالخيارات التالية:

- نقاط التفتيش إلى FSx من أجل Luster - بفضل الإدخال / الإخراج العشوائي عالي الأداء ، يمكنك تحديد مخطط التوزيع وإحالة الملف الذي تختاره

- نقاط تفتيش Amazon S3 المدارة ذاتيًا - للحصول على أمثلة لوظائف Python التي يمكن استخدامها لحفظ نقاط التحقق وقراءتها بطريقة غير محظورة ، يرجى الرجوع إلى حفظ نقاط التفتيش

نقترح بشدة فحص النموذج الخاص بك كل بضع ساعات ، على سبيل المثال من ساعة إلى ثلاث ساعات ، اعتمادًا على النفقات العامة والتكاليف المرتبطة.

الواجهة الأمامية وإدارة المستخدم

إدارة المستخدم هي قوة قابلية الاستخدام الرئيسية لـ SageMaker مقارنة بالبنية التحتية HPC المشتركة القديمة. أذونات تدريب SageMaker تحكمها عدة أذونات إدارة الهوية والوصول AWS (IAM) التجريدات:

- يُمنح المديرون - المستخدمون والأنظمة - الإذن لبدء تشغيل الموارد

- وظائف التدريب لها أدوار نفسها ، والتي تسمح لهم بالحصول على أذونات خاصة بهم ، على سبيل المثال فيما يتعلق بالوصول إلى البيانات واستدعاء الخدمة

بالإضافة إلى ذلك ، أضفنا في عام 2022 مدير دور SageMaker لتسهيل إنشاء أذونات مدفوعة بالشخصية.

وفي الختام

باستخدام SageMaker Training ، يمكنك تقليل التكاليف وزيادة سرعة التكرار في أعباء العمل التدريبية ذات النموذج الكبير. لقد وثقنا قصص النجاح في العديد من المنشورات ودراسات الحالة ، بما في ذلك:

إذا كنت تتطلع إلى تحسين LLM من الوقت إلى السوق مع تقليل التكاليف ، فقم بإلقاء نظرة على SageMaker Training API وأخبرنا بما تقوم ببنائه!

شكر خاص لعمرو رجب ، راشيكا خيريا ، زمناكو أورحمان ، أرون ناجاراجان ، غال أوشري على تعليقاتهم وتعاليمهم المفيدة.

حول المؤلف

أناستاسيا تسيفيليكا هو مهندس حلول التعلم الآلي والذكاء الاصطناعي في AWS. تعمل مع العملاء في أوروبا والشرق الأوسط وإفريقيا وتساعدهم في تصميم حلول التعلم الآلي على نطاق واسع باستخدام خدمات AWS. عملت في مشاريع في مجالات مختلفة بما في ذلك معالجة اللغة الطبيعية (NLP) و MLOps وأدوات Low Code No Code.

أناستاسيا تسيفيليكا هو مهندس حلول التعلم الآلي والذكاء الاصطناعي في AWS. تعمل مع العملاء في أوروبا والشرق الأوسط وإفريقيا وتساعدهم في تصميم حلول التعلم الآلي على نطاق واسع باستخدام خدمات AWS. عملت في مشاريع في مجالات مختلفة بما في ذلك معالجة اللغة الطبيعية (NLP) و MLOps وأدوات Low Code No Code.

جيلي ناحوم هو مهندس حلول متخصص في الذكاء الاصطناعي / التعلم الآلي يعمل كجزء من فريق التعلم الآلي في منطقة أوروبا والشرق الأوسط وإفريقيا أمازون. جيلي شغوف بتحديات تدريب نماذج التعلم العميق ، وكيف يغير التعلم الآلي العالم كما نعرفه. في أوقات فراغه ، يستمتع جيلي بلعب تنس الطاولة.

جيلي ناحوم هو مهندس حلول متخصص في الذكاء الاصطناعي / التعلم الآلي يعمل كجزء من فريق التعلم الآلي في منطقة أوروبا والشرق الأوسط وإفريقيا أمازون. جيلي شغوف بتحديات تدريب نماذج التعلم العميق ، وكيف يغير التعلم الآلي العالم كما نعرفه. في أوقات فراغه ، يستمتع جيلي بلعب تنس الطاولة.

أوليفييه كروشانت هو مهندس حلول رئيسي متخصص في التعلم الآلي في AWS ، ومقرها في فرنسا. يساعد Olivier عملاء AWS - من الشركات الناشئة الصغيرة إلى المؤسسات الكبيرة - في تطوير ونشر تطبيقات التعلم الآلي على مستوى الإنتاج. في أوقات فراغه ، يستمتع بقراءة الأوراق البحثية واستكشاف الحياة البرية مع الأصدقاء والعائلة.

أوليفييه كروشانت هو مهندس حلول رئيسي متخصص في التعلم الآلي في AWS ، ومقرها في فرنسا. يساعد Olivier عملاء AWS - من الشركات الناشئة الصغيرة إلى المؤسسات الكبيرة - في تطوير ونشر تطبيقات التعلم الآلي على مستوى الإنتاج. في أوقات فراغه ، يستمتع بقراءة الأوراق البحثية واستكشاف الحياة البرية مع الأصدقاء والعائلة.

برونو بيستون هو مهندس حلول متخصص في الذكاء الاصطناعي / التعلم الآلي لدى AWS ومقره في ميلانو. إنه يعمل مع العملاء من أي حجم لمساعدتهم على فهم احتياجاتهم التقنية بعمق وتصميم حلول الذكاء الاصطناعي والتعلم الآلي التي تحقق أفضل استخدام لسحابة AWS ومكدس Amazon Machine Learning. مجال خبرته هو التعلم الآلي من البداية إلى النهاية ، وتصنيع التعلم الآلي ، و MLOps. يستمتع بقضاء الوقت مع أصدقائه واستكشاف أماكن جديدة وكذلك السفر إلى وجهات جديدة.

برونو بيستون هو مهندس حلول متخصص في الذكاء الاصطناعي / التعلم الآلي لدى AWS ومقره في ميلانو. إنه يعمل مع العملاء من أي حجم لمساعدتهم على فهم احتياجاتهم التقنية بعمق وتصميم حلول الذكاء الاصطناعي والتعلم الآلي التي تحقق أفضل استخدام لسحابة AWS ومكدس Amazon Machine Learning. مجال خبرته هو التعلم الآلي من البداية إلى النهاية ، وتصنيع التعلم الآلي ، و MLOps. يستمتع بقضاء الوقت مع أصدقائه واستكشاف أماكن جديدة وكذلك السفر إلى وجهات جديدة.

- محتوى مدعوم من تحسين محركات البحث وتوزيع العلاقات العامة. تضخيم اليوم.

- بلاتوبلوكشين. Web3 Metaverse Intelligence. تضخيم المعرفة. الوصول هنا.

- المصدر https://aws.amazon.com/blogs/machine-learning/training-large-language-models-on-amazon-sagemaker-best-practices/

- :يكون

- ] [ص

- $ UP

- 000

- 1

- 100

- 2022

- 7

- 8

- a

- A100

- القدرات

- ماهرون

- من نحن

- فوق

- تسريع

- معجل

- الوصول

- استيعاب

- حسابي

- التأهيل

- تحقيق

- في

- عمل

- تفعيل

- نشط

- تكيف

- وأضاف

- إضافة

- وبالإضافة إلى ذلك

- إضافات

- مميزات

- AI

- AI / ML

- AL

- خوارزمية

- خوارزميات

- الكل

- السماح

- يسمح

- أمازون

- Amazon EC2

- أمازون FSx

- آلة التعلم الأمازون

- الأمازون SageMaker

- كمية

- و

- API

- واجهات برمجة التطبيقات

- ذو صلة

- تطبيق

- التطبيقات

- تطبيقي

- مناسب

- هي

- المنطقة

- حول

- AS

- أسوشيتد

- At

- تعلق

- سمات

- السيارات

- الآلي

- تلقائيا

- متاح

- تجنب

- تجنب

- AWS

- الى الخلف

- الخلفية

- الرصيد

- على أساس

- BE

- لان

- يصبح

- قبل

- يجري

- تستفيد

- أفضل

- أفضل الممارسات

- Beyond

- كبير

- مليار

- المليارات

- حظر

- جلب

- يجلب

- نساعدك في بناء

- بنيت

- الأعمال

- by

- دعوة

- تسمى

- دعوات

- CAN

- قادر على

- الطاقة الإنتاجية

- فيزا وماستركارد

- بطاقات

- حمل

- حقيبة

- دراسة الحالات

- يحفز

- التحديات

- متغير

- قناة

- التحقق

- الشيكات

- خيار

- الخيارات

- اختار

- فصول

- زبون

- عن كثب

- سحابة

- كتلة

- الكود

- جماعي

- الجمع بين

- تأتي

- مشترك

- عادة

- Communication

- مجال الاتصالات

- مقارنة

- متوافق

- إكمال

- حساب

- إحصاء

- الكمبيوتر

- رؤية الكمبيوتر

- الحوسبة

- يخلص

- أجرت

- الاعداد

- أكد

- التواصل

- بناء على ذلك

- وعاء

- حاويات

- يحتوي

- محتوى

- ساهمت

- مراقبة

- ذو شاهد

- مناسب

- التقاء

- فساد

- التكلفة

- التكاليف

- استطاع

- الدورة

- بهيكل

- ويغطي

- وحدة المعالجة المركزية:

- خلق

- خلق

- الإبداع

- حرج

- حاسم

- كرأيشن

- حاليا

- على

- العملاء

- تصميم

- البيانات

- الوصول إلى البيانات

- تحضير البيانات

- قواعد البيانات

- تقرر

- مخصصة

- عميق

- التعلم العميق

- الترتيب

- الدرجة العلمية

- اعتمادا

- يعتمد

- نشر

- تصميم

- تصميم

- لأفضل الأماكن السياحية

- حدد

- تحديد

- تطوير

- المتقدمة

- المطور

- المطورين

- التطوير التجاري

- يطور

- جهاز

- الأجهزة

- مختلف

- التوزيع

- مباشرة

- بحث

- ناقش

- وزعت

- الحوسبة الموزعة

- التدريب الموزع

- توزيع

- عامل في حوض السفن

- حاوية عامل الميناء

- لا

- المجالات

- لا

- إلى أسفل

- بإمكانك تحميله

- عشرات

- أثناء

- كل

- بسهولة

- الطُرق الفعّالة

- إما

- EMEA

- تمكين

- تمكين

- تمكن

- تمكين

- شجع

- ينتهي

- تعزيز

- استمتع

- كاف

- ضمان

- مشروع

- الشركات

- دخول

- البيئة

- البيئات

- معدات

- مسلح

- خطأ

- أخطاء

- إنشاء

- الأثير (ETH)

- حتى

- أحداث

- نهائي

- كل

- كل شىء

- تطورت

- مثال

- أمثلة

- Excel

- القائمة

- توقع

- متوقع

- الخبره في مجال الغطس

- تجربة

- استكشاف

- مكشوف

- التعبيرات

- إطالة

- اضافات المتصفح

- خارجي

- جدا

- قماش

- الوجه

- تسهيل

- تيسير

- العوامل

- فشل

- فشل

- فشل

- الأسر

- للعائلات

- الأزياء

- FAST

- أسرع

- خاطئ

- قابليه

- الميزات

- المميزات

- قليل

- حقل

- قم بتقديم

- ملفات

- الاسم الأول

- تناسب

- سريع

- مرونة

- تركز

- ويركز

- يتبع

- متابعيك

- في حالة

- جزء

- الإطار

- الأطر

- فرنسا

- حرية

- متكرر

- جديد

- الاصدقاء

- تبدأ من

- بالإضافة إلى

- تماما

- وظيفي

- وظيفة

- وظائف

- إضافي

- فتاه

- ولدت

- توليدي

- دولار فقط واحصل على خصم XNUMX% على جميع

- الحصول على

- GitHub جيثب:

- معطى

- وحدة معالجة الرسوميات:

- وحدات معالجة الرسومات

- رسم بياني

- عظيم

- أعظم

- تجمع

- ينمو

- مقبض

- معالجة

- تعليق

- يحدث

- أجهزة التبخير

- يملك

- وجود

- صحة الإنسان

- صحي

- مفيد

- مساعدة

- يساعد

- مرتفع

- تردد عالي

- أداء عالي

- تاريخي

- غطاء محرك السيارة

- المضيفين

- ساعات العمل

- كيفية

- كيفية

- لكن

- HPC

- HTML

- HTTP

- HTTPS

- مئات

- مئات الملايين

- i

- IAM

- مطابق

- هوية

- صورة

- صور

- فورا

- التأثير

- تنفيذ

- نفذت

- تحقيق

- أهمية

- تحسن

- تحسن

- تحسينات

- in

- في أخرى

- تتضمن

- بما فيه

- القيمة الاسمية

- زيادة

- الزيادات

- على نحو متزايد

- فرد

- العالمية

- info

- معلومات

- البنية التحتية

- الابتكار

- موحى

- تثبيت

- مثل

- بدلًا من ذلك

- المتكاملة

- التكامل

- ذكي

- تفاعل

- السطح البيني

- وسيط

- داخلي

- تقديم

- أدخلت

- IT

- تكرير

- انها

- نفسها

- وظيفة

- المشــاريــع

- JPG

- احتفظ

- القفل

- نوع

- علم

- لغة

- اللغات

- كبير

- على نطاق واسع

- أكبر

- آخر

- إطلاق

- أطلقت

- تطلق

- طبقة

- طبقات

- قيادة

- زعيم

- تعلم

- إرث

- مستوى

- المكتبات

- المكتبة

- دورة حياة

- مثل

- على الأرجح

- مما سيحدث

- القيود

- محدود

- القليل

- جار التحميل

- محلي

- طويل

- وقت طويل

- بحث

- أبحث

- منخفض

- آلة

- آلة التعلم

- الترجمة الآلية

- الآلات

- المحافظة

- تحتفظ

- جعل

- يصنع

- القيام ب

- إدارة

- تمكن

- إدارة

- كثير

- برنامج Maps

- أقصى

- مكبر الصوت : يدعم، مع دعم ميكروفون مدمج لمنع الضوضاء

- البيانات الوصفية

- طرق

- المقاييس

- هجرة

- ميلانو

- ملايين

- تقليل

- ML

- MLOps

- موضة

- نموذج

- تصميم

- عارضات ازياء

- تم التعديل

- مراقبة

- مراقبة

- الأكثر من ذلك

- أكثر

- خطوة

- متعدد

- أي

- محلي

- طبيعي

- اللغة الطبيعية

- معالجة اللغات الطبيعية

- طبعا

- الطبيعة

- بالضرورة

- ضروري

- حاجة

- إحتياجات

- شبكة

- القائم على الشبكة

- الشبكات

- عصبي

- الشبكة العصبية

- جديد

- البرمجة اللغوية العصبية

- العقدة

- العقد

- عدد

- كثير

- NVIDIA

- الأجسام

- of

- عرض

- الوهب

- أوليفييه

- on

- على الطلب

- ONE

- جاكيت

- المصدر المفتوح

- كود مفتوح المصدر

- افتتح

- الفرص

- التحسين

- الأمثل

- الأمثل

- خيار

- مزيد من الخيارات

- تزامن

- طلب

- أخرى

- الخاصة

- صفقة

- حزم

- ورق

- أوراق

- نموذج

- موازية

- المعلمة

- المعلمات

- جزء

- خاص

- خاصة

- عاطفي

- الماضي

- مسار

- أنماط

- قمة

- أداء

- العروض

- إذن

- أذونات

- جسديا

- خط أنابيب

- وجهات

- أفلاطون

- الذكاء افلاطون البيانات

- أفلاطون داتا

- لعب

- البوينت

- تجمع

- حمامات

- أكثر الاستفسارات

- منشور

- المنشورات

- ممارسة

- الممارسات

- توقع

- التفضيلات

- المفضل

- يقدم

- الهدايا

- منع

- سابقا

- رئيسي

- عملية المعالجة

- العمليات

- معالجة

- إنتاج

- البرنامج

- برمجة وتطوير

- لغات البرمجة

- التقدّم

- مشروع ناجح

- بصورة صحيحة

- اقترح

- يقترح

- الملكية

- بروتوكول

- البروتوكولات

- تزود

- المقدمة

- مزود

- توفير

- جمهور

- المنشورات

- غرض

- وضع

- بايثون

- pytorch

- جودة

- رفع

- عشوائية

- نادر

- معدل

- الأجور

- التي تم الوصول إليها

- عرض

- نادي القراءة

- أدرك

- معقول

- الأسباب

- تسلم

- الأخيرة

- نوصي

- ساندي خ. ميليك

- سجل

- تسجيل

- استرجاع

- تخفيض

- يقلل

- تقليص

- بخصوص

- منطقة

- المناطق

- منتظم

- بانتظام

- ذات صلة

- ذات الصلة

- الخدمة الموثوقة

- اعتمد

- عن بعد

- يحل محل

- تمثل

- طلب

- طلبات

- تطلب

- المتطلبات

- يتطلب

- بحث

- البحث والابتكار

- مورد

- الموارد

- النتائج

- التقييمات

- النوع

- الأدوار

- يجري

- تشغيل

- sagemaker

- نفسه

- حفظ

- التدرجية

- تحجيم

- حجم

- النطاقات

- التحجيم

- مخطط

- العلماء

- نطاق

- مخطوطات

- الإستراحة

- بحث

- الثاني

- ثواني

- القسم

- تسعى

- مختار

- اختيار

- كبير

- على حدة

- Serverless

- خوادم

- الخدمة

- خدمات

- طقم

- إعدادات

- عدة

- مجزأ

- عملية التجزئة

- شاركت

- ينبغي

- بشكل ملحوظ

- الاشارات

- بساطة

- متزامنة

- معا

- عزباء

- مقاس

- الأحجام

- مهارات

- بطيء

- صغير

- So

- تطبيقات الكمبيوتر

- الحلول

- بعض

- قريبا

- مصدر

- مصادر

- نسل

- متخصص

- محدد

- على وجه التحديد

- محدد

- سرعة

- الإنفاق

- الإنشقاقات

- بقعة

- مستقر

- كومة

- بداية

- ابتداء

- يبدأ

- البدء

- الولايه او المحافظه

- إحصائي

- خطوات

- قلة النوم

- وقف

- تخزين

- متجر

- قصص

- الإستراتيجيات

- مجرى

- تيارات

- قوة

- تعرية

- بقوة

- دراسات

- تحقيق النجاح

- قصص نجاح

- ناجح

- هذه

- الدعم

- مدعومة

- الدعم

- تزامن

- بناء الجملة

- نظام

- جدول

- أخذ

- مهمة

- المهام

- فريق

- تقني

- دعم فني

- كرة المضرب

- tensorflow

- أن

- •

- العالم

- من مشاركة

- منهم

- أنفسهم

- نظري

- وبالتالي

- تشبه

- طرف ثالث

- الآلاف

- ثلاثة

- عبر

- الإنتاجية

- الوقت

- مرات

- نصائح

- إلى

- اليوم

- الرموز

- جدا

- أداة

- أدوات

- تيشرت

- الإجمالي

- مسار

- حركة المرور

- قطار

- متدرب

- قادة الإيمان

- خدمات ترجمة

- نقل

- تريليون

- أنواع

- نموذجي

- مع

- التي تقوم عليها

- فهم

- فريد من نوعه

- الوحدات

- تحديث

- URI

- us

- قابليتها للاستخدام

- الأستعمال

- تستخدم

- مستخدم

- عادة

- قيمنا

- القيم

- المتغيرات

- تشكيلة

- مختلف

- تحقق من

- الإصدار

- بواسطة

- فيديو

- المزيد

- رؤيتنا

- دافئ

- طريق..

- طرق

- أسابيع

- حسن

- ابحث عن

- التي

- في حين

- من الذى

- سوف

- مع

- في غضون

- بدون

- كلمات

- للعمل

- عمل

- العمال

- عامل

- أعمال

- العالم

- اكتب

- مكتوب

- سنوات

- حل متجر العقارات الشامل الخاص بك في جورجيا

- نفسك

- موقع YouTube

- زفيرنت