আজ আমরা ঘোষণা করতে পেরে আনন্দিত যে টুগেদার কম্পিউটারের GPT-NeoXT-Chat-Base-20B ভাষা ফাউন্ডেশন মডেল গ্রাহকদের জন্য উপলব্ধ আমাজন সেজমেকার জাম্পস্টার্ট. GPT-NeoXT-Chat-Base-20B হল কথোপকথনমূলক বট তৈরির জন্য একটি ওপেন সোর্স মডেল। আপনি সহজেই এই মডেলটি ব্যবহার করে দেখতে পারেন এবং এটি জাম্পস্টার্টের সাথে ব্যবহার করতে পারেন। জাম্পস্টার্ট হল এর মেশিন লার্নিং (ML) হাব আমাজন সেজমেকার যেটি বিল্ট-ইন অ্যালগরিদম এবং এন্ড-টু-এন্ড সলিউশন টেমপ্লেট ছাড়াও ফাউন্ডেশন মডেলগুলিতে অ্যাক্সেস প্রদান করে যাতে আপনাকে দ্রুত ML-এর সাথে শুরু করতে সহায়তা করে।

এই পোস্টে, আমরা কিভাবে মোতায়েন করা যায় তার মধ্য দিয়ে হেঁটে GPT-NeoXT-Chat-Base-20B মডেল এবং একটি মধ্যে মডেল আহ্বান OpenChatKit ইন্টারেক্টিভ শেল। এই প্রদর্শনটি আপনার অ্যাপ্লিকেশনের মধ্যে ব্যবহারের জন্য একটি ওপেন সোর্স ফাউন্ডেশন মডেল চ্যাটবট প্রদান করে।

জাম্পস্টার্ট মডেলগুলি ডিপ জাভা সার্ভিং ব্যবহার করে যা ডিপ জাভা লাইব্রেরি (ডিজেএল) ডিপ স্পিড লাইব্রেরি সহ মডেলগুলিকে অপ্টিমাইজ করতে এবং অনুমানের জন্য বিলম্ব কমাতে ব্যবহার করে। জাম্পস্টার্টের অন্তর্নিহিত বাস্তবায়ন নিম্নলিখিতগুলির অনুরূপ একটি বাস্তবায়নকে অনুসরণ করে নোটবই. জাম্পস্টার্ট মডেল হাব গ্রাহক হিসাবে, আপনি SageMaker SDK-এর বাইরে মডেল স্ক্রিপ্ট বজায় না রেখেই উন্নত কর্মক্ষমতা পান। জাম্পস্টার্ট মডেলগুলি এন্ডপয়েন্টগুলির সাথে উন্নত সুরক্ষা ভঙ্গিও অর্জন করে যা নেটওয়ার্ক বিচ্ছিন্নতা সক্ষম করে।

সেজমেকারে ফাউন্ডেশন মডেল

Hugging Face, PyTorch Hub, এবং TensorFlow Hub সহ জনপ্রিয় মডেল হাব থেকে জাম্পস্টার্ট বিভিন্ন মডেলে অ্যাক্সেস প্রদান করে, যা আপনি সেজমেকারে আপনার এমএল ডেভেলপমেন্ট ওয়ার্কফ্লোতে ব্যবহার করতে পারেন। ML-এর সাম্প্রতিক অগ্রগতিগুলি একটি নতুন শ্রেণীর মডেলের জন্ম দিয়েছে যা নামে পরিচিত ভিত্তি মডেল, যা সাধারণত কোটি কোটি প্যারামিটারের উপর প্রশিক্ষিত হয় এবং টেক্সট সংক্ষিপ্তকরণ, ডিজিটাল শিল্প তৈরি করা এবং ভাষা অনুবাদের মতো বিস্তৃত ব্যবহারের ক্ষেত্রে অভিযোজিত হয়। যেহেতু এই মডেলগুলি প্রশিক্ষণের জন্য ব্যয়বহুল, গ্রাহকরা এই মডেলগুলিকে নিজেরাই প্রশিক্ষিত করার পরিবর্তে বিদ্যমান প্রাক-প্রশিক্ষিত ফাউন্ডেশন মডেলগুলি ব্যবহার করতে চান এবং প্রয়োজন অনুসারে সেগুলিকে সূক্ষ্ম সুর করতে চান৷ সেজমেকার মডেলগুলির একটি কিউরেটেড তালিকা সরবরাহ করে যা আপনি সেজমেকার কনসোলে বেছে নিতে পারেন।

আপনি এখন জাম্পস্টার্টের মধ্যে বিভিন্ন মডেল প্রদানকারীর কাছ থেকে ফাউন্ডেশন মডেলগুলি খুঁজে পেতে পারেন, যা আপনাকে দ্রুত ফাউন্ডেশন মডেলগুলির সাথে শুরু করতে সক্ষম করে৷ আপনি বিভিন্ন কাজ বা মডেল প্রদানকারীদের উপর ভিত্তি করে ভিত্তি মডেল খুঁজে পেতে পারেন এবং সহজেই মডেলের বৈশিষ্ট্য এবং ব্যবহারের শর্তাবলী পর্যালোচনা করতে পারেন। আপনি একটি পরীক্ষা UI উইজেট ব্যবহার করে এই মডেলগুলি ব্যবহার করে দেখতে পারেন। আপনি যখন স্কেলে একটি ফাউন্ডেশন মডেল ব্যবহার করতে চান, আপনি মডেল প্রদানকারীদের থেকে পূর্ব-নির্মিত নোটবুকগুলি ব্যবহার করে SageMaker ত্যাগ না করে সহজেই করতে পারেন। যেহেতু মডেলগুলি হোস্ট করা হয়েছে এবং AWS-এ স্থাপন করা হয়েছে, আপনি নিশ্চিন্ত থাকতে পারেন যে আপনার ডেটা, মডেলটিকে মূল্যায়নের জন্য ব্যবহার করা হোক বা স্কেলে ব্যবহার করা হোক না কেন, তৃতীয় পক্ষের সাথে ভাগ করা হয় না।

GPT-NeoXT-Chat-Base-20B ভিত্তি মডেল

একসাথে কম্পিউটার GPT-NeoXT-Chat-Base-20B, একটি 20-বিলিয়ন-প্যারামিটার ল্যাঙ্গুয়েজ মডেল, ElutherAI-এর GPT-NeoX মডেল থেকে 40 মিলিয়নেরও বেশি নির্দেশ সহ সূক্ষ্ম-টিউন করা হয়েছে, ডায়ালগ-স্টাইল ইন্টারঅ্যাকশনের উপর ফোকাস করেছে। অতিরিক্তভাবে, মডেলটি বেশ কয়েকটি কাজের উপর টিউন করা হয়েছে, যেমন প্রশ্নের উত্তর, শ্রেণিবিন্যাস, নিষ্কাশন এবং সংক্ষিপ্তকরণ। মডেলটি OIG-43M ডেটাসেটের উপর ভিত্তি করে যা LAION এবং Ontocord-এর সহযোগিতায় তৈরি করা হয়েছিল।

উপরে উল্লিখিত ফাইন-টিউনিং ছাড়াও, GPT-NeoXT-Chat-Base-20B-v0.16 আরও সূক্ষ্ম-টিউনিং করা হয়েছে অল্প পরিমাণ প্রতিক্রিয়া ডেটার মাধ্যমে। এটি মডেলটিকে কথোপকথনে মানুষের পছন্দের সাথে আরও ভালভাবে মানিয়ে নিতে দেয়। GPT-NeoXT-Chat-Base-20B চ্যাটবট অ্যাপ্লিকেশানগুলিতে ব্যবহারের জন্য ডিজাইন করা হয়েছে এবং এটির উদ্দিষ্ট সুযোগের বাইরে অন্যান্য ব্যবহারের ক্ষেত্রে ভাল পারফর্ম নাও করতে পারে৷ একসাথে, Ontocord এবং LAION ওপেনচ্যাটকিট রিলিজ করতে সহযোগিতা করেছে, ChatGPT-এর একটি ওপেন-সোর্স বিকল্প ক্ষমতার সমষ্টির সাথে। OpenChatKit একটি Apache-2.0 লাইসেন্সের অধীনে চালু করা হয়েছিল, সোর্স কোড, মডেল ওজন এবং প্রশিক্ষণ ডেটাসেটের সম্পূর্ণ অ্যাক্সেস প্রদান করে। ওপেনচ্যাটকিট বাক্সের বাইরে বেশ কিছু কাজ আছে। এর মধ্যে রয়েছে সংক্ষিপ্তকরণের কাজ, নিষ্কাশন কাজ যা অসংগঠিত নথি থেকে কাঠামোগত তথ্য বের করার অনুমতি দেয় এবং একটি বাক্য বা অনুচ্ছেদকে বিভিন্ন বিভাগে শ্রেণীবদ্ধ করার জন্য শ্রেণীবিভাগের কাজগুলি অন্তর্ভুক্ত করে।

আসুন আমরা কীভাবে জাম্পস্টার্টে GPT-NeoXT-Chat-Base-20B মডেলটি ব্যবহার করতে পারি তা অন্বেষণ করি।

সমাধান ওভারভিউ

আপনি SageMaker-এ GPT-NeoXT-Chat-Base-20B-এর স্থাপনা দেখানো কোড এবং নিম্নলিখিত কমান্ড শেল ব্যবহার করে কথোপকথনমূলক পদ্ধতিতে কীভাবে স্থাপন করা মডেলটি ব্যবহার করবেন তার একটি উদাহরণ খুঁজে পেতে পারেন GitHub নোটবুক.

নিম্নলিখিত বিভাগে, আমরা মডেলটি স্থাপন করার জন্য প্রতিটি ধাপ বিশদভাবে প্রসারিত করি এবং তারপর বিভিন্ন কাজ সমাধান করতে এটি ব্যবহার করি:

- পূর্বশর্ত সেট আপ করুন।

- একটি প্রাক-প্রশিক্ষিত মডেল নির্বাচন করুন।

- শিল্পকর্ম পুনরুদ্ধার করুন এবং একটি শেষ পয়েন্ট স্থাপন করুন।

- সমাপ্তি বিন্দু ক্যোয়ারী এবং একটি প্রতিক্রিয়া পার্স.

- আপনার নিয়োজিত এন্ডপয়েন্টের সাথে ইন্টারঅ্যাক্ট করতে একটি OpenChatKit শেল ব্যবহার করুন।

পূর্বশর্ত সেট আপ করুন

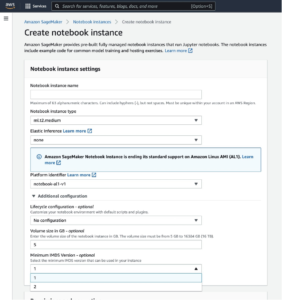

এই নোটবুকটি একটি ml.t3.medium ইনস্ট্যান্সে পরীক্ষা করা হয়েছিল৷ অ্যামাজন সেজমেকার স্টুডিও পাইথন 3 (ডেটা সায়েন্স) কার্নেলের সাথে এবং একটি সেজমেকার নোটবুক উদাহরণে conda_python3 কার্নেলের সাথে।

আপনি নোটবুক চালানোর আগে, সেটআপের জন্য প্রয়োজনীয় কিছু প্রাথমিক পদক্ষেপগুলি সম্পূর্ণ করতে নিম্নলিখিত কমান্ডটি ব্যবহার করুন:

একটি প্রাক-প্রশিক্ষিত মডেল নির্বাচন করুন

আমরা Boto3 ব্যবহার করে স্বাভাবিকের মতো একটি সেজমেকার সেশন সেট আপ করি এবং তারপরে আমরা যে মডেল আইডি স্থাপন করতে চাই সেটি নির্বাচন করুন:

শিল্পকর্ম পুনরুদ্ধার করুন এবং একটি শেষ পয়েন্ট স্থাপন করুন

সেজমেকারের সাহায্যে, আমরা একটি নতুন ডেটাসেটে প্রথমে ফাইন-টিউনিং না করেও প্রাক-প্রশিক্ষিত মডেলের উপর অনুমান করতে পারি। আমরা পুনরুদ্ধার দ্বারা শুরু instance_type, image_uri, এবং model_uri প্রাক-প্রশিক্ষিত মডেলের জন্য। প্রাক-প্রশিক্ষিত মডেল হোস্ট করতে, আমরা এর একটি উদাহরণ তৈরি করি sagemaker.model.Model এবং এটি স্থাপন। নিম্নোক্ত কোডটি অনুমানের শেষ বিন্দুর জন্য ml.g5.24xlarge ব্যবহার করে। স্থাপন পদ্ধতিতে কয়েক মিনিট সময় লাগতে পারে।

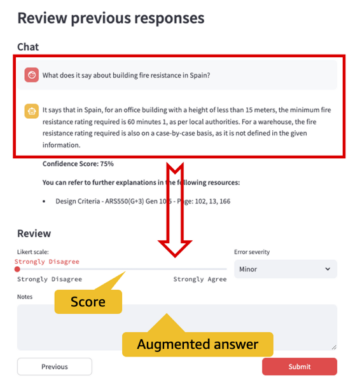

সমাপ্তি বিন্দু ক্যোয়ারী এবং প্রতিক্রিয়া পার্স

এর পরে, আমরা আপনাকে হাইপারপ্যারামিটারের একটি উপসেট সহ একটি এন্ডপয়েন্ট কীভাবে আহ্বান করতে হয় তার একটি উদাহরণ দেখাই:

নিম্নলিখিত প্রতিক্রিয়া যা আমরা পাই:

এখানে, আমরা পেলোড যুক্তি প্রদান করেছি "stopping_criteria": ["<human>"], যার ফলে মডেল প্রতিক্রিয়া শব্দের ক্রম প্রজন্মের সাথে শেষ হয়েছে <human>. জাম্পস্টার্ট মডেল স্ক্রিপ্ট পছন্দসই স্টপ শব্দ হিসাবে স্ট্রিংগুলির যে কোনও তালিকা গ্রহণ করবে, এই তালিকাটিকে একটি বৈধ হিসাবে রূপান্তর করুন stopping_criteria কীওয়ার্ড আর্গুমেন্ট ট্রান্সফরমার এপিআই জেনারেট করে এবং আউটপুট সিকোয়েন্সে কোনো নির্দিষ্ট স্টপ শব্দ থাকলে টেক্সট জেনারেশন বন্ধ করে। এটি দুটি কারণে কার্যকর: প্রথমত, অনুমানের সময় হ্রাস করা হয়েছে কারণ এন্ডপয়েন্টটি স্টপ শব্দের বাইরে অবাঞ্ছিত পাঠ্য তৈরি করা চালিয়ে যায় না এবং দ্বিতীয়ত, এটি ওপেনচ্যাটকিট মডেলটিকে অন্যান্য স্টপ মানদণ্ড পূরণ না হওয়া পর্যন্ত অতিরিক্ত মানব এবং বট প্রতিক্রিয়াগুলিকে হ্যালুসিনেটিং থেকে বাধা দেয়। .

আপনার নিয়োজিত এন্ডপয়েন্টের সাথে ইন্টারঅ্যাক্ট করতে একটি OpenChatKit শেল ব্যবহার করুন

OpenChatKit চ্যাটবটের সাথে ইন্টারঅ্যাক্ট করার জন্য একটি কমান্ড লাইন শেল প্রদান করে। এই ধাপে, আপনি এই শেলটির একটি সংস্করণ তৈরি করুন যা আপনার স্থাপন করা শেষ পয়েন্টের সাথে ইন্টারঅ্যাক্ট করতে পারে। আমরা এই ওপেনচ্যাটকিট রিপোজিটরিতে ইনফারেন্স স্ক্রিপ্টগুলির একটি বেয়ার-বোন সরলীকরণ প্রদান করি যা আমাদের স্থাপন করা সেজমেকার এন্ডপয়েন্টের সাথে যোগাযোগ করতে পারে।

এর জন্য দুটি প্রধান উপাদান রয়েছে:

- একটি শেল দোভাষী (

JumpStartOpenChatKitShell) যা মডেল এন্ডপয়েন্টের পুনরাবৃত্তিমূলক অনুমান আহ্বানের জন্য অনুমতি দেয় - একটি কথোপকথন বস্তু (

Conversation) যা পূর্ববর্তী মানব/চ্যাটবট ইন্টারঅ্যাকশনগুলিকে স্থানীয়ভাবে ইন্টারেক্টিভ শেলের মধ্যে সঞ্চয় করে এবং ভবিষ্যতের অনুমান প্রসঙ্গের জন্য অতীতের কথোপকথনগুলি যথাযথভাবে ফর্ম্যাট করে

সার্জারির Conversation অবজেক্টটি ওপেনচ্যাটকিট সংগ্রহস্থল থেকে আমদানি করা হয়। নিম্নলিখিত কোডটি একটি কাস্টম শেল দোভাষী তৈরি করে যা আপনার এন্ডপয়েন্টের সাথে ইন্টারঅ্যাক্ট করতে পারে। এটি OpenChatKit বাস্তবায়নের একটি সরলীকৃত সংস্করণ। আমরা আপনাকে এই প্রসঙ্গের মধ্যে টোকেন স্ট্রিমিং, মডারেশন মডেল এবং পুনরুদ্ধার বর্ধিত প্রজন্মের মতো আরও গভীর বৈশিষ্ট্যগুলি কীভাবে ব্যবহার করতে পারেন তা দেখতে OpenChatKit সংগ্রহস্থলটি অন্বেষণ করতে উত্সাহিত করি৷ এই নোটবুকের প্রেক্ষাপটটি একটি জাম্পস্টার্ট এন্ডপয়েন্ট সহ একটি ন্যূনতম কার্যকর চ্যাটবট প্রদর্শনের উপর দৃষ্টি নিবদ্ধ করে; আপনি এখান থেকে প্রয়োজনীয় জটিলতা যোগ করতে পারেন।

একটি ছোট ডেমো প্রদর্শনের জন্য JumpStartOpenChatKitShell নিম্নলিখিত ভিডিওতে দেখানো হয়েছে।

নিম্নলিখিত স্নিপেট দেখায় কিভাবে কোড কাজ করে:

আপনি এখন এই শেলটিকে কমান্ড লুপ হিসাবে চালু করতে পারেন। এটি বারবার একটি প্রম্পট জারি করবে, ইনপুট গ্রহণ করবে, ইনপুট কমান্ড পার্স করবে এবং ক্রিয়া প্রেরণ করবে। যেহেতু ফলস্বরূপ শেলটি একটি অসীম লুপে ব্যবহার করা যেতে পারে, এই নোটবুকটি একটি ডিফল্ট কমান্ড সারি প্রদান করে (cmdqueue) ইনপুট লাইনের সারিবদ্ধ তালিকা হিসাবে। কারণ শেষ ইনপুট হল কমান্ড /quit, সারির ক্লান্তির পরে শেলটি প্রস্থান করবে। এই চ্যাটবটের সাথে গতিশীলভাবে ইন্টারঅ্যাক্ট করতে, সরান cmdqueue.

উদাহরণ 1: কথোপকথনের প্রসঙ্গ বজায় রাখা হয়েছে

নিম্নলিখিত প্রম্পট দেখায় যে চ্যাটবট ফলো-আপ প্রশ্নের উত্তর দেওয়ার জন্য কথোপকথনের প্রসঙ্গ ধরে রাখতে সক্ষম:

উদাহরণ 2: অনুভূতির শ্রেণীবিভাগ

নিম্নলিখিত উদাহরণে, চ্যাটবট বাক্যটির অনুভূতি সনাক্ত করে একটি শ্রেণীবিভাগের কাজ সম্পাদন করেছে। আপনি দেখতে পাচ্ছেন, চ্যাটবট সফলভাবে ইতিবাচক এবং নেতিবাচক অনুভূতি শ্রেণীবদ্ধ করতে সক্ষম হয়েছে।

উদাহরণ 3: সংক্ষিপ্তকরণ কাজ

এর পরে, আমরা চ্যাটবট শেল দিয়ে সংক্ষিপ্তকরণের কাজগুলি চেষ্টা করেছি। নিম্নলিখিত উদাহরণ দেখায় কিভাবে দীর্ঘ টেক্সট সম্পর্কে অ্যামাজন সমঝোতা একটি বাক্যে সংক্ষিপ্ত করা হয়েছিল এবং চ্যাটবট পাঠ্যের ফলো-আপ প্রশ্নের উত্তর দিতে সক্ষম হয়েছিল:

উদাহরণ 4: কাঠামোবিহীন পাঠ্য থেকে কাঠামোগত তথ্য বের করুন

নিম্নোক্ত উদাহরণে, আমরা চ্যাটবট ব্যবহার করে শিরোনাম, সারি এবং কলাম সহ একটি মার্কডাউন টেবিল তৈরি করেছিলাম যা ফ্রি-ফর্ম ভাষায় দেওয়া তথ্য ব্যবহার করে একটি প্রকল্প পরিকল্পনা তৈরি করতে পারে:

উদাহরণ 5: চ্যাটবটে ইনপুট হিসাবে কমান্ড

আমরা যেমন কমান্ড হিসাবে ইনপুট প্রদান করতে পারেন /hyperparameters হাইপারপ্যারামিটারের মান দেখতে এবং /quit কমান্ড শেল প্রস্থান করতে:

এই উদাহরণগুলি ওপেনচ্যাটকিটের উৎকর্ষের কিছু কাজ দেখায়। আমরা আপনাকে বিভিন্ন প্রম্পট চেষ্টা করার জন্য এবং আপনার ব্যবহারের ক্ষেত্রে কোনটি সবচেয়ে ভাল কাজ করে তা দেখতে উত্সাহিত করি।

পরিষ্কার কর

আপনি এন্ডপয়েন্ট পরীক্ষা করার পরে, চার্জ এড়াতে সেজমেকার ইনফারেন্স এন্ডপয়েন্ট এবং মডেলটি মুছে ফেলেছেন তা নিশ্চিত করুন।

উপসংহার

এই পোস্টে, আমরা আপনাকে দেখিয়েছি কিভাবে সেজমেকার ব্যবহার করে GPT-NeoXT-Chat-Base-20B মডেলটি পরীক্ষা এবং ব্যবহার করতে হয় এবং আকর্ষণীয় চ্যাটবট অ্যাপ্লিকেশন তৈরি করতে হয়। আজই সেজমেকারে ফাউন্ডেশন মডেল ব্যবহার করে দেখুন এবং আপনার প্রতিক্রিয়া আমাদের জানান!

এই নির্দেশিকা শুধুমাত্র তথ্যের উদ্দেশ্যে। আপনি এখনও আপনার নিজের স্বাধীন মূল্যায়ন করতে হবে, এবং আপনার নিজের নির্দিষ্ট মান নিয়ন্ত্রণ অনুশীলন এবং মান এবং স্থানীয় নিয়ম, আইন, প্রবিধান, লাইসেন্স এবং ব্যবহারের শর্তাবলী যা আপনার জন্য প্রযোজ্য, আপনার সামগ্রী এবং এই নির্দেশিকাতে উল্লেখ করা তৃতীয় পক্ষের মডেল। এই নির্দেশিকায় উল্লেখ করা তৃতীয়-পক্ষের মডেলের উপর AWS-এর কোনো নিয়ন্ত্রণ বা কর্তৃত্ব নেই, এবং তৃতীয় পক্ষের মডেল নিরাপদ, ভাইরাস-মুক্ত, কর্মক্ষম, বা আপনার উৎপাদন পরিবেশ এবং মানগুলির সাথে সামঞ্জস্যপূর্ণ এমন কোনো উপস্থাপনা বা ওয়ারেন্টি দেয় না। AWS কোনো উপস্থাপনা, ওয়ারেন্টি বা গ্যারান্টি দেয় না যে এই নির্দেশিকাতে থাকা কোনো তথ্য একটি নির্দিষ্ট ফলাফল বা ফলাফলে পরিণত হবে।

লেখক সম্পর্কে

রচনা চাদা AWS এ স্ট্র্যাটেজিক অ্যাকাউন্টে একজন প্রিন্সিপাল সলিউশন আর্কিটেক্ট এআই/এমএল। রচনা একজন আশাবাদী যিনি বিশ্বাস করেন যে AI এর নৈতিক ও দায়িত্বশীল ব্যবহার ভবিষ্যতে সমাজের উন্নতি করতে পারে এবং অর্থনৈতিক ও সামাজিক সমৃদ্ধি আনতে পারে। অবসর সময়ে, রচনা তার পরিবারের সাথে সময় কাটাতে, হাইকিং করতে এবং গান শুনতে পছন্দ করে।

রচনা চাদা AWS এ স্ট্র্যাটেজিক অ্যাকাউন্টে একজন প্রিন্সিপাল সলিউশন আর্কিটেক্ট এআই/এমএল। রচনা একজন আশাবাদী যিনি বিশ্বাস করেন যে AI এর নৈতিক ও দায়িত্বশীল ব্যবহার ভবিষ্যতে সমাজের উন্নতি করতে পারে এবং অর্থনৈতিক ও সামাজিক সমৃদ্ধি আনতে পারে। অবসর সময়ে, রচনা তার পরিবারের সাথে সময় কাটাতে, হাইকিং করতে এবং গান শুনতে পছন্দ করে।

ডাঃ কাইল উলরিচ সঙ্গে একজন ফলিত বিজ্ঞানী Amazon SageMaker বিল্ট-ইন অ্যালগরিদম টীম. তার গবেষণার আগ্রহের মধ্যে রয়েছে স্কেলযোগ্য মেশিন লার্নিং অ্যালগরিদম, কম্পিউটার ভিশন, টাইম সিরিজ, বায়েসিয়ান নন-প্যারামেট্রিক্স এবং গাউসিয়ান প্রক্রিয়া। তার পিএইচডি ডিউক বিশ্ববিদ্যালয় থেকে এবং তিনি নিউরিআইপিএস, সেল এবং নিউরনে গবেষণাপত্র প্রকাশ করেছেন।

ডাঃ কাইল উলরিচ সঙ্গে একজন ফলিত বিজ্ঞানী Amazon SageMaker বিল্ট-ইন অ্যালগরিদম টীম. তার গবেষণার আগ্রহের মধ্যে রয়েছে স্কেলযোগ্য মেশিন লার্নিং অ্যালগরিদম, কম্পিউটার ভিশন, টাইম সিরিজ, বায়েসিয়ান নন-প্যারামেট্রিক্স এবং গাউসিয়ান প্রক্রিয়া। তার পিএইচডি ডিউক বিশ্ববিদ্যালয় থেকে এবং তিনি নিউরিআইপিএস, সেল এবং নিউরনে গবেষণাপত্র প্রকাশ করেছেন।

আশিস খেতান ড অ্যামাজন সেজমেকার বিল্ট-ইন অ্যালগরিদম সহ একজন সিনিয়র ফলিত বিজ্ঞানী এবং মেশিন লার্নিং অ্যালগরিদম বিকাশে সহায়তা করে। তিনি ইউনিভার্সিটি অফ ইলিনয় আরবানা-চ্যাম্পেইন থেকে পিএইচডি লাভ করেন। তিনি মেশিন লার্নিং এবং পরিসংখ্যানগত অনুমানে একজন সক্রিয় গবেষক এবং নিউরিআইপিএস, আইসিএমএল, আইসিএলআর, জেএমএলআর, এসিএল এবং ইএমএনএলপি সম্মেলনে অনেক গবেষণাপত্র প্রকাশ করেছেন।

আশিস খেতান ড অ্যামাজন সেজমেকার বিল্ট-ইন অ্যালগরিদম সহ একজন সিনিয়র ফলিত বিজ্ঞানী এবং মেশিন লার্নিং অ্যালগরিদম বিকাশে সহায়তা করে। তিনি ইউনিভার্সিটি অফ ইলিনয় আরবানা-চ্যাম্পেইন থেকে পিএইচডি লাভ করেন। তিনি মেশিন লার্নিং এবং পরিসংখ্যানগত অনুমানে একজন সক্রিয় গবেষক এবং নিউরিআইপিএস, আইসিএমএল, আইসিএলআর, জেএমএলআর, এসিএল এবং ইএমএনএলপি সম্মেলনে অনেক গবেষণাপত্র প্রকাশ করেছেন।

- এসইও চালিত বিষয়বস্তু এবং পিআর বিতরণ। আজই পরিবর্ধিত পান।

- প্লেটোএআইস্ট্রিম। Web3 ডেটা ইন্টেলিজেন্স। জ্ঞান প্রসারিত. এখানে প্রবেশ করুন.

- অ্যাড্রিয়েন অ্যাশলির সাথে ভবিষ্যত মিন্টিং। এখানে প্রবেশ করুন.

- PREIPO® এর সাথে PRE-IPO কোম্পানিতে শেয়ার কিনুন এবং বিক্রি করুন। এখানে প্রবেশ করুন.

- উত্স: https://aws.amazon.com/blogs/machine-learning/gpt-neoxt-chat-base-20b-foundation-model-for-chatbot-applications-is-now-available-on-amazon-sagemaker/

- : আছে

- : হয়

- :না

- $ ইউপি

- 1

- 100

- 12

- 13

- 15%

- 20

- 23

- 30

- 40

- 50

- 500

- 7

- 9

- a

- সক্ষম

- সম্পর্কে

- সমর্থন দিন

- প্রবেশ

- অনুযায়ী

- অ্যাকাউন্টস

- অর্জন করা

- স্টক

- সক্রিয়

- খাপ খাওয়ানো

- যোগ

- যোগ

- অতিরিক্ত

- উপরন্তু

- অগ্রসর

- অগ্রগতি

- AI

- এআই / এমএল

- আলগোরিদিম

- অনুমতি

- অনুমতি

- এছাড়াও

- বিকল্প

- am

- মর্দানী স্ত্রীলোক

- অ্যামাজন সমঝোতা

- আমাজন সেজমেকার

- অ্যামাজন ওয়েব সার্ভিসেস

- পরিমাণ

- an

- বিশ্লেষণ

- বিশ্লেষণ করা

- এবং

- ঘোষণা করা

- উত্তর

- কোন

- API

- API গুলি

- অ্যাপ্লিকেশন

- আবেদন

- অ্যাপ্লিকেশন

- ফলিত

- প্রয়োগ করা

- উপযুক্তভাবে

- আন্দাজ

- রয়েছি

- যুক্তি

- শিল্প

- AS

- মূল্যায়ন

- নিশ্চিত

- At

- উদ্দীপিত

- কর্তৃত্ব

- সহজলভ্য

- এড়াতে

- ডেস্কটপ AWS

- ভিত্তি

- বায়েসিয়ান

- BE

- কারণ

- আগে

- বিশ্বাস

- সর্বোত্তম

- উত্তম

- তার পরেও

- কোটি কোটি

- বট

- বট

- বক্স

- আনা

- নির্মাণ করা

- বিল্ট-ইন

- by

- CAN

- ক্ষমতা

- রাজধানী

- কেস

- মামলা

- বিভাগ

- বিভাগ

- বৈশিষ্ট্য

- চার্জ

- chatbot

- চ্যাটজিপিটি

- বেছে নিন

- শহর

- শ্রেণী

- শ্রেণীবিন্যাস

- শ্রেণীভুক্ত করা

- কোড

- সহযোগিতা

- সহযোগিতা

- কলাম

- সাধারণ

- তুলনীয়

- উপযুক্ত

- সম্পূর্ণ

- জটিলতা

- উপাদান

- বোঝা

- কম্পিউটার

- কম্পিউটার ভিশন

- উদ্বেগ

- সম্মেলন

- কনসোল

- আধার

- ধারণ

- বিষয়বস্তু

- প্রসঙ্গ

- অবিরত

- নিয়ন্ত্রণ

- কথোপকথন

- কথ্য

- কথোপকথন

- রূপান্তর

- শীতল

- সৃষ্টি

- নির্মিত

- সৃষ্টি

- তৈরি করা হচ্ছে

- নির্ণায়ক

- প্লেলিস্টে যোগ করা

- প্রথা

- ক্রেতা

- গ্রাহকদের

- ডিসি

- উপাত্ত

- তথ্য বিজ্ঞান

- ডেটাসেট

- গভীর

- গভীর জ্ঞানার্জন

- ডিফল্ট

- ডেমো

- প্রদর্শক

- নির্ভর করে

- স্থাপন

- মোতায়েন

- বিস্তৃতি

- বিবরণ

- পরিকল্পিত

- আকাঙ্ক্ষিত

- বিস্তারিত

- নির্ধারণ

- বিকাশ

- উন্নত

- ডেভেলপারদের

- উন্নয়ন

- বিকাশ

- বিভিন্ন

- ডিজিটাল

- ডিজিটাল আর্ট

- প্রাণবধ

- do

- ডকশ্রমিক

- ডকার কনটেইনার

- দলিল

- কাগজপত্র

- না

- না

- প্রভাবশালী

- সর্দার

- ডিউক বিশ্ববিদ্যালয়

- স্থিতিকাল

- পরিবর্তনশীল

- প্রতি

- সহজে

- অর্থনৈতিক

- উপাদান

- আর

- ইমেইল

- সক্ষম করা

- সক্রিয়

- উত্সাহিত করা

- সর্বশেষ সীমা

- শেষপ্রান্ত

- নিশ্চিত করা

- সমগ্র

- সত্ত্বা

- সত্তা

- পরিবেশ

- থার (eth)

- নৈতিক

- মূল্যায়নের

- এমন কি

- পরীক্ষক

- উদাহরণ

- উদাহরণ

- উত্তেজিত

- বিদ্যমান

- প্রস্থান

- বিস্তৃত করা

- ব্যয়বহুল

- অন্বেষণ করুণ

- নির্যাস

- নিষ্কাশন

- মুখ

- পরিবার

- এ পর্যন্ত

- প্রিয়

- ভয়

- বৈশিষ্ট্য

- বৈশিষ্ট্য

- প্রতিক্রিয়া

- কয়েক

- নথি পত্র

- আবিষ্কার

- প্রথম

- গুরুত্ত্ব

- মনোযোগ

- অনুসরণ

- অনুসরণ

- জন্য

- ভিত

- থেকে

- অধিকতর

- ভবিষ্যৎ

- উত্পাদন করা

- উৎপাদিত

- প্রজন্ম

- পাওয়া

- প্রদত্ত

- চালু

- ভাল

- মঞ্জুর হলেই

- গ্যারান্টী

- পথপ্রদর্শন

- আছে

- জমিদারি

- he

- হেডার

- সাহায্য

- সাহায্য

- তার

- এখানে

- হাইকিং

- তার

- নিমন্ত্রণকর্তা

- হোস্ট

- কিভাবে

- কিভাবে

- এইচটিএমএল

- HTTPS দ্বারা

- নাভি

- মানবীয়

- i

- আইসিএলআর

- ID

- চিহ্নিতকরণের

- if

- ইলিনয়

- ভাবমূর্তি

- বাস্তবায়ন

- উন্নত করা

- উন্নত

- in

- গভীর

- অন্তর্ভুক্ত করা

- অন্তর্ভুক্ত

- সুদ্ধ

- স্বাধীন

- তথ্য

- তথ্যমূলক

- প্রারম্ভিক

- ইনপুট

- ইনপুট

- অর্ন্তদৃষ্টি

- ইনস্টল

- উদাহরণ

- নির্দেশাবলী

- অভিপ্রেত

- গর্ভনাটিকা

- পারস্পরিক ক্রিয়ার

- ইন্টারেক্টিভ

- মজাদার

- মধ্যে রয়েছে

- মধ্যে

- বিচ্ছিন্নতা

- সমস্যা

- IT

- এর

- জাভা

- জবস

- JPG

- মাত্র

- চাবি

- রকম

- জানা

- পরিচিত

- ভাষা

- ভাষাসমূহ

- বড়

- গত

- অদৃশ্যতা

- শুরু করা

- চালু

- আইন

- শিক্ষা

- ছোড়

- লাইব্রেরি

- লাইব্রেরি

- লাইসেন্স

- লাইসেন্স

- মত

- লাইন

- লাইন

- তালিকা

- শ্রবণ

- স্থানীয়

- স্থানীয়ভাবে

- দীর্ঘ

- অনেক

- মেশিন

- মেশিন লার্নিং

- প্রধান

- বজায় রাখা

- করা

- পদ্ধতি

- অনেক

- মে..

- পরিমাপ

- মধ্যম

- উল্লেখ

- পদ্ধতি

- মিলিয়ন

- যত্সামান্য

- কমান

- মিনিট

- ML

- মডেল

- মডেল

- সংযম

- পরিবর্তিত

- অধিক

- সকাল

- সঙ্গীত

- প্রাকৃতিক

- স্বভাবিক ভাষা

- স্বাভাবিক ভাষা প্রক্রিয়াকরণ

- প্রয়োজন

- প্রয়োজন

- নেতিবাচক

- নেটওয়ার্ক

- নেটওয়ার্কিং

- নিউরপ্স

- না

- নতুন

- নতুন পণ্য

- সংবাদ

- NLP

- না।

- নোটবই

- নোটবুক

- এখন

- লক্ষ্য

- of

- জলপাই

- on

- ONE

- কেবল

- ওপেন সোর্স

- কর্মক্ষম

- অপ্টিমিজ

- অপশন সমূহ

- or

- অন্যান্য

- আমাদের

- বাইরে

- ফলাফল

- রূপরেখা

- আউটপুট

- বাহিরে

- শেষ

- নিজের

- কাগজপত্র

- পরামিতি

- বিশেষ

- দলগুলোর

- গত

- পিডিএফ

- সম্পাদন করা

- কর্মক্ষমতা

- বাক্যাংশ

- পিজা

- পরিকল্পনা

- Plato

- প্লেটো ডেটা ইন্টেলিজেন্স

- প্লেটোডাটা

- খেলা

- জনপ্রিয়

- ধনাত্মক

- পোস্ট

- চর্চা

- Predictor

- পছন্দগুলি

- পূর্বশর্ত

- প্রতিরোধ

- আগে

- অধ্যক্ষ

- অগ্রাধিকার

- প্রসেস

- প্রক্রিয়াজাতকরণ

- উত্পাদনের

- পণ্য

- প্রকল্প

- সমৃদ্ধি

- প্রদান

- প্রদত্ত

- প্রদানকারীর

- উপলব্ধ

- প্রকাশিত

- উদ্দেশ্য

- পাইথন

- পাইটার্চ

- গুণ

- প্রশ্ন

- প্রশ্ন

- দ্রুত

- পরিসর

- বরং

- প্রকৃত সময়

- কারণে

- সাম্প্রতিক

- প্রণালী

- স্বীকার

- স্বীকৃতি

- হ্রাসপ্রাপ্ত

- রিফ্যাক্টর

- আইন

- মুক্তি

- অপসারণ

- পুনঃপুনঃ

- সংগ্রহস্থলের

- প্রয়োজনীয়

- গবেষণা

- গবেষক

- প্রতিক্রিয়া

- প্রতিক্রিয়া

- দায়ী

- বিশ্রাম

- ফল

- ফলে এবং

- রাখা

- প্রত্যাবর্তন

- এখানে ক্লিক করুন

- ওঠা

- নিয়ম

- চালান

- s

- ঋষি নির্মাতা

- সেজমেকার ইনফারেন্স

- বলা

- মাপযোগ্য

- স্কেল

- স্ক্যান

- বিজ্ঞান

- বিজ্ঞানী

- সুযোগ

- স্ক্রিপ্ট

- SDK

- সার্চ

- দ্বিতীয়

- বিভাগে

- নিরাপদ

- নিরাপত্তা

- দেখ

- নির্বাচন

- আত্ম

- জ্যেষ্ঠ

- বাক্য

- অনুভূতি

- ক্রম

- ক্রম

- সেবা

- সেবা

- ভজনা

- সেশন

- সেট

- সেট

- সেটআপ

- বিভিন্ন

- ভাগ

- খোল

- সংক্ষিপ্ত

- উচিত

- প্রদর্শনী

- গ্লাসকেস

- শোকেস

- দেখিয়েছেন

- প্রদর্শিত

- শো

- অনুরূপ

- সরলীকৃত

- ছয়

- ছোট

- So

- সামাজিক

- সামাজিক যোগাযোগ

- সমাজ

- সমাধান

- সলিউশন

- সমাধান

- কিছু

- উৎস

- সোর্স কোড

- নির্দিষ্ট

- নিদিষ্ট

- স্পীড

- খরচ

- বিস্তার

- মান

- শুরু

- শুরু

- পরিসংখ্যানসংক্রান্ত

- ধাপ

- প্রারম্ভিক ব্যবহারের নির্দেশাবলী

- এখনো

- থামুন

- দোকান

- কৌশলগত

- স্ট্রিমিং

- গঠন

- কাঠামোবদ্ধ

- সফলভাবে

- এমন

- সংক্ষিপ্তসার

- সমর্থিত

- নিশ্চিত

- টেবিল

- গ্রহণ করা

- কার্য

- কাজ

- টীম

- প্রযুক্তি

- বলা

- টেমপ্লেট

- tensorflow

- শর্তাবলী

- পরীক্ষা

- পরীক্ষকগণ

- পাঠ্য প্রজন্ম

- চেয়ে

- যে

- সার্জারির

- রাজধানী

- ভবিষ্যৎ

- তথ্য

- উৎস

- তাহাদিগকে

- নিজেদের

- তারপর

- সেখানে।

- এইগুলো

- তৃতীয়

- তৃতীয় পক্ষগুলি

- তৃতীয় পক্ষের

- এই

- দ্বারা

- সময়

- সময় সিরিজ

- থেকে

- আজ

- একসঙ্গে

- টোকেন

- রেলগাড়ি

- প্রশিক্ষিত

- প্রশিক্ষণ

- ট্রান্সফরমার

- অনুবাদ

- চেষ্টা

- সত্য

- চেষ্টা

- দুই

- আদর্শ

- সাধারণত

- ui

- অধীনে

- নিম্নাবস্থিত

- বোধশক্তি

- বিশ্ববিদ্যালয়

- পর্যন্ত

- উপরে

- কোনো URI

- us

- ব্যবহার

- ব্যবহার

- ব্যবহার ক্ষেত্রে

- ব্যবহৃত

- ব্যবহার

- ব্যবহার

- মানগুলি

- বৈচিত্র্য

- বিভিন্ন

- সংস্করণ

- মাধ্যমে

- টেকসই

- ভিডিও

- দৃষ্টি

- প্রয়োজন

- উষ্ণ

- ছিল

- ওয়াশিংটন

- we

- আবহাওয়া

- ওয়েব

- ওয়েব সার্ভিস

- সপ্তাহ

- স্বাগত

- আমরা একটি

- কি

- কখন

- কিনা

- যে

- হু

- ব্যাপক

- ব্যাপকতর

- ইচ্ছা

- সঙ্গে

- মধ্যে

- ছাড়া

- শব্দ

- শব্দ

- কর্মপ্রবাহ

- কাজ

- লেখা

- আপনি

- আপনার

- zephyrnet