আজ, হাজার হাজার গ্রাহক ব্যবহার করে মেশিন লার্নিং (ML) মডেল তৈরি, প্রশিক্ষণ এবং স্থাপন করছে আমাজন সেজমেকার তাদের ব্যবসা এবং গ্রাহক অভিজ্ঞতা পুনরায় উদ্ভাবন করার সম্ভাবনা আছে যে অ্যাপ্লিকেশন ক্ষমতা. এই ML মডেলগুলি গত কয়েক বছর ধরে আকার এবং জটিলতায় ক্রমবর্ধমান হয়েছে, যার ফলে বিভিন্ন কাজের পরিসরে অত্যাধুনিক নির্ভুলতার দিকে পরিচালিত হয়েছে এবং দিন থেকে সপ্তাহে প্রশিক্ষণের সময়কে ঠেলে দিচ্ছে। ফলস্বরূপ, গ্রাহকদের অবশ্যই তাদের মডেলগুলিকে কয়েকশ থেকে হাজার হাজার এক্সিলারেটর জুড়ে স্কেল করতে হবে, যা তাদের প্রশিক্ষণের জন্য আরও ব্যয়বহুল করে তোলে।

SageMaker হল একটি সম্পূর্ণরূপে পরিচালিত ML পরিষেবা যা ডেভেলপার এবং ডেটা বিজ্ঞানীদের সহজেই ML মডেল তৈরি, প্রশিক্ষণ এবং স্থাপন করতে সাহায্য করে৷ সেজমেকার ইতিমধ্যেই এমএল প্রশিক্ষণের জন্য হার্ডওয়্যার এক্সিলারেটর সমন্বিত কম্পিউট অফারগুলির বিস্তৃত এবং গভীরতম পছন্দ প্রদান করে, সহ G5 (Nvidia A10G) উদাহরণস্বরূপ এবং P4d (Nvidia A100) উদাহরণস্বরূপ।

ক্রমবর্ধমান গণনা প্রয়োজনীয়তা দ্রুত এবং আরো ব্যয়-কার্যকর প্রক্রিয়াকরণ শক্তির জন্য কল করে। মডেল প্রশিক্ষণের সময় আরও কমাতে এবং এমএল অনুশীলনকারীদের দ্রুত পুনরাবৃত্তি করতে সক্ষম করতে, AWS চিপস, সার্ভার এবং ডেটা সেন্টার সংযোগ জুড়ে উদ্ভাবন করছে। নতুন Trn1 দৃষ্টান্ত দ্বারা চালিত এডব্লিউএস ট্রেনিয়াম চিপগুলি AWS-এ সর্বোত্তম মূল্য-কর্মক্ষমতা এবং দ্রুততম ML মডেল প্রশিক্ষণ প্রদান করে, 50% পর্যন্ত কম খরচে তুলনীয় GPU-ভিত্তিক দৃষ্টান্তগুলির উপর গভীর শিক্ষার মডেলগুলিকে প্রশিক্ষিত করার জন্য নির্ভুলতার কোন হ্রাস ছাড়াই৷

এই পোস্টে, আমরা দেখাই কিভাবে আপনি SageMaker-এর সাথে Trn1 দৃষ্টান্ত ব্যবহার করে আপনার কর্মক্ষমতা সর্বাধিক করতে এবং খরচ কমাতে পারেন।

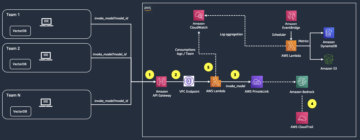

সমাধান ওভারভিউ

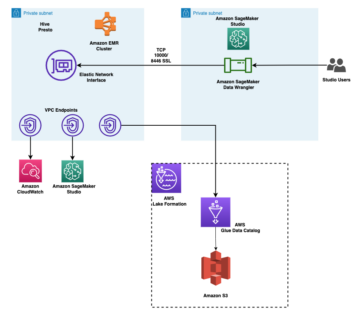

সেজমেকার ট্রেনিং জব ml.trn1 দৃষ্টান্ত সমর্থন করে, ট্রেনিয়াম চিপ দ্বারা চালিত, যা ক্লাউডে উচ্চ-পারফরম্যান্স এমএল প্রশিক্ষণ অ্যাপ্লিকেশনের জন্য নির্মিত। আপনি প্রাকৃতিক ভাষা প্রক্রিয়াকরণ (এনএলপি), কম্পিউটার ভিশন এবং সুপারিশকারী মডেলগুলিকে প্রশিক্ষণ দিতে সেজমেকারে ml.trn1 উদাহরণ ব্যবহার করতে পারেন অ্যাপ্লিকেশনের বিস্তৃত সেট, যেমন বক্তৃতা স্বীকৃতি, সুপারিশ, জালিয়াতি সনাক্তকরণ, চিত্র এবং ভিডিও শ্রেণীবিভাগ, এবং পূর্বাভাস। ml.trn1 দৃষ্টান্তে 16টি ট্রেনিয়াম চিপ পর্যন্ত বৈশিষ্ট্য রয়েছে, যা পরবর্তীতে AWS দ্বারা নির্মিত একটি দ্বিতীয় প্রজন্মের ML চিপ। এডাব্লুএস ইনফেরেন্টিয়া. ml.trn1 উদাহরণ প্রথম অ্যামাজন ইলাস্টিক কম্পিউট ক্লাউড (Amazon EC2) 800 Gbps পর্যন্ত ইলাস্টিক ফ্যাব্রিক অ্যাডাপ্টার (EFA) নেটওয়ার্ক ব্যান্ডউইথ সহ উদাহরণ। দক্ষ ডেটা এবং মডেলের সমান্তরালতার জন্য, প্রতিটি ml.trn1.32xl ইন্সট্যান্সে 512 GB উচ্চ-ব্যান্ডউইথ মেমরি রয়েছে, FP3.4/BF16 কম্পিউট পাওয়ারের 16 পেটাফ্লপ পর্যন্ত সরবরাহ করে এবং নিউরনলিংক, একটি ইন্ট্রা-ইনস্ট্যান্স, উচ্চ-ব্যান্ডউইথ, নন-ব্লকিং ইন্টারকনক্টের বৈশিষ্ট্য রয়েছে। .

ট্রেনিয়াম দুটি কনফিগারেশনে পাওয়া যায় এবং ইউএস ইস্ট (এন. ভার্জিনিয়া) এবং ইউএস পশ্চিম (ওরেগন) অঞ্চলে ব্যবহার করা যেতে পারে।

নিম্নলিখিত টেবিলটি Trn1 দৃষ্টান্তগুলির বৈশিষ্ট্যগুলিকে সংক্ষিপ্ত করে।

| উদাহরণের আকার | ট্রেনিয়াম accelerators |

বেগবর্ধক ব্যক্তি স্মৃতি (জিবি) |

vCPUs | দৃষ্টান্ত স্মৃতি (GiB) |

নেটওয়ার্ক ব্যান্ডউইথ (জিবিপিএস) |

ইএফএ এবং আরডিএমএ সহায়তা |

| trn1.2x বড় | 1 | 32 | 8 | 32 | 12.5 পর্যন্ত | না |

| trn1.32x বড় | 16 | 512 | 128 | 512 | 800 | হাঁ |

| trn1n.32xlarge (শীঘ্রই আসছে) | 16 | 512 | 128 | 512 | 1600 | হাঁ |

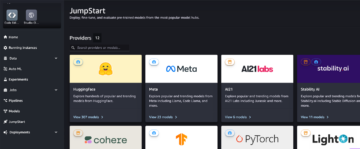

আসুন একটি সহজ উদাহরণ দিয়ে সেজমেকারের সাথে ট্রেনিয়াম কীভাবে ব্যবহার করবেন তা বুঝুন। আমরা হাগিং ফেস ট্রান্সফরমার লাইব্রেরি ব্যবহার করে সেজমেকার প্রশিক্ষণ এবং পাইটর্চ সহ একটি পাঠ্য শ্রেণিবিন্যাস মডেল প্রশিক্ষণ দেব।

আমরা অ্যামাজন রিভিউ ডেটাসেট ব্যবহার করি, যা amazon.com থেকে রিভিউ নিয়ে গঠিত। তথ্যটি 18 বছর ধরে বিস্তৃত, মার্চ 35 পর্যন্ত প্রায় 2013 মিলিয়ন পর্যালোচনা সমন্বিত। পর্যালোচনাগুলির মধ্যে পণ্য এবং ব্যবহারকারীর তথ্য, রেটিং এবং একটি প্লেইনটেক্সট পর্যালোচনা অন্তর্ভুক্ত রয়েছে। নিম্নলিখিত কোড থেকে একটি উদাহরণ AmazonPolarity পরীক্ষার সেট:

এই পোস্টের জন্য, আমরা শুধুমাত্র বিষয়বস্তু এবং লেবেল ক্ষেত্র ব্যবহার করি। বিষয়বস্তু ক্ষেত্রটি একটি বিনামূল্যের পাঠ্য পর্যালোচনা, এবং লেবেল ক্ষেত্র হল একটি বাইনারি মান যাতে ইতিবাচক বা নেতিবাচক পর্যালোচনার জন্য যথাক্রমে 1 বা 0 থাকে।

আমাদের অ্যালগরিদমের জন্য, আমরা BERT ব্যবহার করি, একটি ট্রান্সফরমার মডেল যা একটি স্ব-তত্ত্বাবধানে ইংরেজি ডেটার একটি বৃহৎ কর্পাসের উপর প্রাক-প্রশিক্ষিত। এই মডেলটি প্রাথমিকভাবে এমন কাজগুলির উপর সূক্ষ্ম টিউন করার লক্ষ্যে তৈরি করা হয়েছে যা সিদ্ধান্ত নেওয়ার জন্য পুরো বাক্যটি (সম্ভাব্যভাবে মুখোশযুক্ত) ব্যবহার করে, যেমন সিকোয়েন্স শ্রেণীবিভাগ, টোকেন শ্রেণীবিভাগ বা প্রশ্নের উত্তর দেওয়া।

বাস্তবায়নের বিবরণ

আসুন মডেলটি প্রশিক্ষণের সাথে জড়িত বিভিন্ন উপাদানগুলিকে ঘনিষ্ঠভাবে দেখে শুরু করি:

- এডব্লিউএস ট্রেনিয়াম - এর মূলে, প্রতিটি ট্রেনিয়ামের উদাহরণ এতে অন্তর্নির্মিত ট্রেনিয়াম ডিভাইস রয়েছে। Trn1.2xlarge এর 1টি Trainium ডিভাইস রয়েছে এবং Trn1.32xlarge এর 16টি ট্রেনিয়াম ডিভাইস রয়েছে। প্রতিটি ট্রেনিয়াম ডিভাইসে কম্পিউট (2 NeuronCore-v2), 32 GB HBM ডিভাইস মেমরি এবং দ্রুত আন্তঃ-ডিভাইস যোগাযোগের জন্য NeuronLink থাকে। প্রতিটি নিউরনকোর-v2 পৃথক ইঞ্জিন (টেনসর/ভেক্টর/স্ক্যালার/জিপিএসআইএমডি) সহ একটি সম্পূর্ণ স্বাধীন ভিন্ন ভিন্ন গণনা ইউনিট গঠিত। GPSIMD হল সম্পূর্ণরূপে প্রোগ্রামেবল সাধারণ-উদ্দেশ্যের প্রসেসর যা আপনি কাস্টম অপারেটর বাস্তবায়ন করতে এবং নিউরনকোর ইঞ্জিনগুলিতে সরাসরি চালাতে ব্যবহার করতে পারেন।

- আমাজন সেজমেকার প্রশিক্ষণ - সেজমেকার পরিকাঠামো নিয়ে চিন্তা না করেই মডেলগুলিকে সহজে প্রশিক্ষণ দেওয়ার জন্য সম্পূর্ণরূপে পরিচালিত প্রশিক্ষণের অভিজ্ঞতা প্রদান করে৷ আপনি যখন সেজমেকার ট্রেনিং ব্যবহার করেন, তখন এটি একটি প্রশিক্ষণের কাজের জন্য প্রয়োজনীয় সমস্ত কিছু চালায়, যেমন কোড, কন্টেইনার এবং ডেটা, আমন্ত্রণ পরিবেশ থেকে আলাদা একটি গণনা পরিকাঠামোতে। এটি আমাদের সমান্তরালভাবে পরীক্ষা চালানো এবং দ্রুত পুনরাবৃত্তি করতে দেয়। সেজমেকার একটি প্রদান করে পাইথন এসডিকে প্রশিক্ষণের কাজ শুরু করতে। এই পোস্টের উদাহরণটি Trainium ব্যবহার করে প্রশিক্ষণের কাজটি ট্রিগার করতে SageMaker Python SDK ব্যবহার করে।

- AWS নিউরন - যেহেতু Trainium NeuronCore এর নিজস্ব কম্পিউট ইঞ্জিন আছে, তাই আমাদের ট্রেনিং কোড কম্পাইল করার জন্য আমাদের একটি মেকানিজম দরকার। দ্য AWS নিউরন কম্পাইলার Pytorch/XLA-তে লেখা কোড নেয় এবং নিউরন ডিভাইসে চালানোর জন্য এটি অপ্টিমাইজ করে। নিউরন কম্পাইলারটি ডিপ লার্নিং কন্টেইনারের অংশ হিসাবে একীভূত করা হয়েছে যা আমরা আমাদের মডেলকে প্রশিক্ষণের জন্য ব্যবহার করব।

- পাইটর্চ/এক্সএলএ - এই পাইথন প্যাকেজ PyTorch ডিপ লার্নিং ফ্রেমওয়ার্ক এবং Trainium এর মত ক্লাউড এক্সিলারেটর সংযোগ করতে XLA ডিপ লার্নিং কম্পাইলার ব্যবহার করে। একটি নতুন PyTorch নেটওয়ার্ক তৈরি করতে বা XLA ডিভাইসে চালানোর জন্য বিদ্যমান একটিকে রূপান্তর করতে শুধুমাত্র XLA-নির্দিষ্ট কোডের কয়েকটি লাইন প্রয়োজন। আমরা আমাদের ব্যবহারের ক্ষেত্রে দেখব কী কী পরিবর্তন করতে হবে।

- বিতরণ প্রশিক্ষণ - একাধিক নিউরনকোরে প্রশিক্ষণটি দক্ষতার সাথে চালানোর জন্য, আমাদের উপলব্ধ নিউরনকোরগুলিতে প্রশিক্ষণ বিতরণ করার জন্য একটি ব্যবস্থা প্রয়োজন। সেজমেকার ট্রেনিয়াম দৃষ্টান্তগুলির সাথে টর্চরান সমর্থন করে, যা ক্লাস্টারে নিউরনকোরের সংখ্যার সমতুল্য একাধিক প্রক্রিয়া চালানোর জন্য ব্যবহার করা যেতে পারে। এটি নিম্নরূপ সেজমেকার অনুমানকারীকে বিতরণ পরামিতি পাস করে করা হয়, যা একটি ডেটা সমান্তরাল বিতরণ প্রশিক্ষণ শুরু করে যেখানে একই মডেলটি বিভিন্ন নিউরনকোরে লোড করা হয় যা পৃথক ডেটা ব্যাচ প্রক্রিয়া করে:

Trainium চালানোর জন্য স্ক্রিপ্ট পরিবর্তন প্রয়োজন

আসুন ট্রেনিয়ামে চালানোর জন্য একটি নিয়মিত GPU-ভিত্তিক PyTorch স্ক্রিপ্ট গ্রহণ করার জন্য প্রয়োজনীয় কোড পরিবর্তনগুলি দেখুন। উচ্চ স্তরে, আমাদের নিম্নলিখিত পরিবর্তনগুলি করতে হবে:

- Pytorch/XLA ডিভাইস দিয়ে GPU ডিভাইস প্রতিস্থাপন করুন। যেহেতু আমরা টর্চ ডিস্ট্রিবিউশন ব্যবহার করি, তাই আমাদেরকে XLA-এর সাহায্যে ট্রেনিং শুরু করতে হবে নিম্নরূপ ডিভাইস হিসেবে:

- আমরা PyTorch/XLA ডিস্ট্রিবিউটেড ব্যাকএন্ড ব্যবহার করি PyTorch ডিস্ট্রিবিউটেড এপিআইগুলিকে XLA কমিউনিকেশন শব্দার্থবিদ্যায় ব্রিজ করতে।

- আমরা ডেটা ইনজেশন পাইপলাইনের জন্য PyTorch/XLA MpDeviceLoader ব্যবহার করি। MpDeviceLoader তিনটি ধাপকে ওভারল্যাপ করে কর্মক্ষমতা উন্নত করতে সাহায্য করে: ডিভাইসে ট্রেসিং, সংকলন এবং ডেটা ব্যাচ লোড করা। আমাদের নিম্নরূপ MpDeviceDataLoader এর সাথে PyTorch ডেটালোডার মোড়ানো দরকার:

- নিম্নলিখিত কোডে দেখানো হিসাবে XLA-প্রদত্ত API ব্যবহার করে অপ্টিমাইজেশান ধাপটি চালান। এটি কোরগুলির মধ্যে গ্রেডিয়েন্টগুলিকে একত্রিত করে এবং XLA ডিভাইসের ধাপ গণনা করে।

- জেনেরিক PyTorch API-তে CUDA API (যদি থাকে) ম্যাপ করুন।

- CUDA ফিউজড অপ্টিমাইজার (যদি থাকে) জেনেরিক PyTorch বিকল্প দিয়ে প্রতিস্থাপন করুন।

সম্পূর্ণ উদাহরণ, যা সেজমেকার এবং ট্রেনিয়াম ব্যবহার করে একটি পাঠ্য শ্রেণিবিন্যাস মডেলকে প্রশিক্ষণ দেয়, নিম্নলিখিতটিতে উপলব্ধ গিটহুব রেপো. নোটবুক ফাইল SageMaker এবং Trainium.ipynb ব্যবহার করে শ্রেণিবিন্যাস মডেল তৈরির জন্য ফাইন টিউন ট্রান্সফরমার হল এন্ট্রিপয়েন্ট এবং প্রশিক্ষণ চালানোর জন্য ধাপে ধাপে নির্দেশাবলী রয়েছে।

বেঞ্চমার্ক পরীক্ষা

পরীক্ষায়, আমরা দুটি প্রশিক্ষণের কাজ চালিয়েছি: একটি ml.trn1.32xlarge-এ এবং একটি ml.p4d.24xlarge-এ একই ব্যাচের আকার, প্রশিক্ষণের ডেটা এবং অন্যান্য হাইপারপ্যারামিটার। প্রশিক্ষণের কাজ চলাকালীন, আমরা সেজমেকার প্রশিক্ষণের কাজের বিলযোগ্য সময় পরিমাপ করেছি, এবং উদাহরণের প্রকারের জন্য প্রতি ঘন্টায় প্রশিক্ষণের কাজগুলি চালানোর জন্য প্রয়োজনীয় সময়কে গুণ করে মূল্য-কর্মক্ষমতা গণনা করেছি। আমরা একাধিক কাজের রানের মধ্যে থেকে প্রতিটি উদাহরণের জন্য সেরা ফলাফল নির্বাচন করেছি।

নিম্নলিখিত সারণীটি আমাদের বেঞ্চমার্ক ফলাফলগুলিকে সংক্ষিপ্ত করে।

| মডেল | ইনস্ট্যান্স টাইপ | মূল্য (নোড প্রতি * ঘন্টা) | থ্রুপুট (পুনরাবৃত্তি/সেকেন্ড) | বৈধতা নির্ভুলতা | বিলযোগ্য সময় (সেকেন্ড) | $ এ প্রশিক্ষণ খরচ |

| BERT বেস শ্রেণীবিভাগ | ml.trn1.32x বড় | 24.725 | 6.64 | 0.984 | 6033 | 41.47 |

| BERT বেস শ্রেণীবিভাগ | ml.p4d.24x বড় | 37.69 | 5.44 | 0.984 | 6553 | 68.6 |

ফলাফলগুলি দেখায় যে ট্রেনিয়াম দৃষ্টান্তের জন্য P4d উদাহরণের চেয়ে কম খরচ হয়, একই মডেলকে একই ইনপুট ডেটা এবং প্রশিক্ষণের পরামিতিগুলির সাথে প্রশিক্ষণের সময় একই থ্রুপুট এবং নির্ভুলতা প্রদান করে। এর মানে হল যে ট্রেনিয়াম দৃষ্টান্ত GPU-ভিত্তিক P4D দৃষ্টান্তগুলির তুলনায় ভাল মূল্য-কর্মক্ষমতা প্রদান করে। এইরকম একটি সাধারণ উদাহরণ দিয়ে, আমরা দেখতে পাচ্ছি ট্রেনিয়াম প্রশিক্ষণের জন্য প্রায় 22% দ্রুত সময় এবং P50d দৃষ্টান্তের তুলনায় 4% পর্যন্ত কম খরচের অফার করে।

প্রশিক্ষিত মডেল স্থাপন

আমরা মডেলটি প্রশিক্ষণ দেওয়ার পরে, আমরা এটিকে বিভিন্ন ধরনের উদাহরণ যেমন CPU, GPU, বা AWS Inferentia-এ স্থাপন করতে পারি। লক্ষ্য করার মূল বিষয় হল প্রশিক্ষিত মডেলটি স্থাপন এবং অনুমান করার জন্য বিশেষ হার্ডওয়্যারের উপর নির্ভরশীল নয়। সেজমেকার রিয়েল-টাইম বা ব্যাচ মেকানিজম উভয় ব্যবহার করে একটি প্রশিক্ষিত মডেল স্থাপন করার প্রক্রিয়া সরবরাহ করে। GitHub রেপোর নোটবুকের উদাহরণে একটি ml.c5.xlarge (CPU-ভিত্তিক) উদাহরণ ব্যবহার করে প্রশিক্ষিত মডেলটিকে একটি রিয়েল-টাইম এন্ডপয়েন্ট হিসাবে স্থাপন করার জন্য কোড রয়েছে।

উপসংহার

এই পোস্টে, আমরা দেখেছি কিভাবে Trainium এবং SageMaker ব্যবহার করতে হয় একটি শ্রেণীবিভাগ মডেল দ্রুত সেট আপ করতে এবং প্রশিক্ষণ দিতে যা সঠিকতার সাথে আপস না করে 50% পর্যন্ত খরচ সাশ্রয় করে। আপনি প্রি-ট্রেনিং বা ফাইন-টিউনিং ট্রান্সফরমার-ভিত্তিক মডেলের বিস্তৃত ব্যবহারের ক্ষেত্রে ট্রেনিয়াম ব্যবহার করতে পারেন। বিভিন্ন মডেল আর্কিটেকচারের সমর্থন সম্পর্কে আরও তথ্যের জন্য, পড়ুন মডেল আর্কিটেকচার ফিট নির্দেশিকা.

লেখক সম্পর্কে

অরুণ কুমার লোকনাথ অ্যামাজন সেজমেকার সার্ভিস টিমের সাথে একজন সিনিয়র এমএল সলিউশন আর্কিটেক্ট। তিনি গ্রাহকদের এমএল উৎপাদন কাজের লোড তৈরি, প্রশিক্ষণ এবং স্কেলে SageMaker-এ স্থানান্তরিত করতে সহায়তা করার দিকে মনোনিবেশ করেন। তিনি বিশেষ করে এনএলপি এবং সিভির ক্ষেত্রে ডিপ লার্নিংয়ে বিশেষজ্ঞ। কাজের বাইরে, তিনি দৌড়ানো এবং হাইকিং উপভোগ করেন।

অরুণ কুমার লোকনাথ অ্যামাজন সেজমেকার সার্ভিস টিমের সাথে একজন সিনিয়র এমএল সলিউশন আর্কিটেক্ট। তিনি গ্রাহকদের এমএল উৎপাদন কাজের লোড তৈরি, প্রশিক্ষণ এবং স্কেলে SageMaker-এ স্থানান্তরিত করতে সহায়তা করার দিকে মনোনিবেশ করেন। তিনি বিশেষ করে এনএলপি এবং সিভির ক্ষেত্রে ডিপ লার্নিংয়ে বিশেষজ্ঞ। কাজের বাইরে, তিনি দৌড়ানো এবং হাইকিং উপভোগ করেন।

মার্ক ইউ AWS SageMaker-এর একজন সফটওয়্যার ইঞ্জিনিয়ার। তিনি বৃহৎ মাপের বিতরণকৃত প্রশিক্ষণ ব্যবস্থা নির্মাণ, প্রশিক্ষণ কর্মক্ষমতা অপ্টিমাইজ করা এবং সেজমেকার ট্রেনিয়াম সহ উচ্চ-পারফরম্যান্স এমএল ট্রেনিং হার্ডওয়্যার বিকাশের উপর দৃষ্টি নিবদ্ধ করেন। মেশিন লার্নিং ইনফ্রাস্ট্রাকচার অপটিমাইজেশন সম্পর্কেও মার্কের গভীর জ্ঞান রয়েছে। তার অবসর সময়ে, তিনি হাইকিং এবং দৌড় উপভোগ করেন।

মার্ক ইউ AWS SageMaker-এর একজন সফটওয়্যার ইঞ্জিনিয়ার। তিনি বৃহৎ মাপের বিতরণকৃত প্রশিক্ষণ ব্যবস্থা নির্মাণ, প্রশিক্ষণ কর্মক্ষমতা অপ্টিমাইজ করা এবং সেজমেকার ট্রেনিয়াম সহ উচ্চ-পারফরম্যান্স এমএল ট্রেনিং হার্ডওয়্যার বিকাশের উপর দৃষ্টি নিবদ্ধ করেন। মেশিন লার্নিং ইনফ্রাস্ট্রাকচার অপটিমাইজেশন সম্পর্কেও মার্কের গভীর জ্ঞান রয়েছে। তার অবসর সময়ে, তিনি হাইকিং এবং দৌড় উপভোগ করেন।

ওমরি ফুচস AWS SageMaker-এর একজন সফটওয়্যার ডেভেলপমেন্ট ম্যানেজার। তিনি সেজমেকার প্রশিক্ষণ কাজের প্ল্যাটফর্মের জন্য দায়ী প্রযুক্তিগত নেতা, সেজমেকার প্রশিক্ষণ কর্মক্ষমতা অপ্টিমাইজ করা এবং প্রশিক্ষণের অভিজ্ঞতার উন্নতিতে মনোনিবেশ করেন। অত্যাধুনিক এমএল এবং এআই প্রযুক্তির প্রতি তার আবেগ রয়েছে। তার অবসর সময়ে, তিনি সাইক্লিং এবং হাইকিং পছন্দ করেন।

ওমরি ফুচস AWS SageMaker-এর একজন সফটওয়্যার ডেভেলপমেন্ট ম্যানেজার। তিনি সেজমেকার প্রশিক্ষণ কাজের প্ল্যাটফর্মের জন্য দায়ী প্রযুক্তিগত নেতা, সেজমেকার প্রশিক্ষণ কর্মক্ষমতা অপ্টিমাইজ করা এবং প্রশিক্ষণের অভিজ্ঞতার উন্নতিতে মনোনিবেশ করেন। অত্যাধুনিক এমএল এবং এআই প্রযুক্তির প্রতি তার আবেগ রয়েছে। তার অবসর সময়ে, তিনি সাইক্লিং এবং হাইকিং পছন্দ করেন।

গাল ওশ্রী অ্যামাজন সেজমেকার দলের একজন সিনিয়র প্রোডাক্ট ম্যানেজার। মেশিন লার্নিং টুল, ফ্রেমওয়ার্ক এবং পরিষেবাগুলিতে কাজ করার 7 বছরের অভিজ্ঞতা রয়েছে৷

গাল ওশ্রী অ্যামাজন সেজমেকার দলের একজন সিনিয়র প্রোডাক্ট ম্যানেজার। মেশিন লার্নিং টুল, ফ্রেমওয়ার্ক এবং পরিষেবাগুলিতে কাজ করার 7 বছরের অভিজ্ঞতা রয়েছে৷

- এসইও চালিত বিষয়বস্তু এবং পিআর বিতরণ। আজই পরিবর্ধিত পান।

- প্লেটোব্লকচেন। Web3 মেটাভার্স ইন্টেলিজেন্স। জ্ঞান প্রসারিত. এখানে প্রবেশ করুন.

- উত্স: https://aws.amazon.com/blogs/machine-learning/maximize-performance-and-reduce-your-deep-learning-training-cost-with-aws-trainium-and-amazon-sagemaker/

- : হয়

- $ ইউপি

- 1

- 100

- 7

- 8

- a

- A100

- সম্পর্কে

- ত্বক

- সঠিকতা

- দিয়ে

- পোষ্যপুত্র গ্রহণ করা

- পর

- AI

- অ্যালগরিদম

- অনুমতি

- ইতিমধ্যে

- বিকল্প

- মর্দানী স্ত্রীলোক

- আমাজন EC2

- আমাজন সেজমেকার

- Amazon.com

- এবং

- API

- API গুলি

- অ্যাপ্লিকেশন

- আন্দাজ

- স্থাপত্য

- রয়েছি

- এলাকায়

- AS

- At

- সহজলভ্য

- ডেস্কটপ AWS

- এডাব্লুএস ইনফেরেন্টিয়া

- ব্যাক-এন্ড

- খারাপ

- ব্যান্ডউইথ

- ভিত্তি

- BE

- কারণ

- শুরু করা

- হচ্ছে

- উচ্চতার চিহ্ন

- সর্বোত্তম

- উত্তম

- মধ্যে

- তার পরেও

- বিশাল

- কালো

- বই

- ব্রিজ

- নির্মাণ করা

- ভবন

- নির্মিত

- ব্যবসা

- by

- গণিত

- কল

- CAN

- কেস

- মামলা

- CD

- কেন্দ্র

- পরিবর্তন

- চিপ

- চিপস

- পছন্দ

- শ্রেণীবিন্যাস

- কাছাকাছি

- মেঘ

- গুচ্ছ

- কোড

- এর COM

- আসছে

- শীঘ্রই আসছে

- যোগাযোগ

- তুলনীয়

- জটিলতা

- উপাদান

- সন্দেহজনক

- গণনা

- গনা

- কম্পিউটার

- কম্পিউটার ভিশন

- কনফিগারেশনের

- সংযোগ করা

- কানেক্টিভিটি

- consolidates

- আধার

- ধারণ

- বিষয়বস্তু

- মূল

- মূল্য

- খরচ বাঁচানো

- সাশ্রয়ের

- খরচ

- সিপিইউ

- প্রথা

- ক্রেতা

- গ্রাহকদের

- কাটিং-এজ

- উপাত্ত

- তথ্য কেন্দ্র

- দিন

- সিদ্ধান্ত

- গভীর

- গভীর জ্ঞানার্জন

- গভীরতম

- বিতরণ

- নির্ভরশীল

- স্থাপন

- মোতায়েন

- মরুভূমি

- সনাক্তকরণ

- ডেভেলপারদের

- উন্নয়নশীল

- উন্নয়ন

- যন্ত্র

- ডিভাইস

- বিভিন্ন

- সরাসরি

- বিতরণ করা

- বণ্টিত

- বিতরণ করা প্রশিক্ষণ

- বিতরণ

- ড্রপ

- সময়

- প্রতি

- সহজে

- পূর্ব

- দক্ষ

- দক্ষতার

- সক্ষম করা

- সক্ষম করা

- শেষপ্রান্ত

- ইঞ্জিন

- প্রকৌশলী

- ইঞ্জিন

- ইংরেজি

- সমগ্র

- পরিবেশ

- সমতুল্য

- বিশেষত

- থার (eth)

- সব

- উদাহরণ

- বিদ্যমান

- ব্যয়বহুল

- অভিজ্ঞতা

- অভিজ্ঞতা

- ফ্যাব্রিক

- মুখ

- ফ্যাশন

- দ্রুত

- দ্রুত

- দ্রুততম

- বৈশিষ্ট্য

- বৈশিষ্ট্য

- সমন্বিত

- মহিলা

- কয়েক

- ক্ষেত্র

- ক্ষেত্রসমূহ

- ফাইল

- প্রথম

- ফিট

- গুরুত্ত্ব

- মনোযোগ

- অনুসরণ

- অনুসরণ

- জন্য

- ফ্রেমওয়ার্ক

- অবকাঠামো

- প্রতারণা

- জালিয়াতি সনাক্তকরণ

- বিনামূল্যে

- থেকে

- সম্পূর্ণরূপে

- অধিকতর

- সাধারন ক্ষেত্রে

- প্রজন্ম

- GitHub

- দেয়

- ভাল

- জিপিইউ

- গ্রেডিয়েন্টস

- মহান

- হার্ডওয়্যারের

- আছে

- জমিদারি

- সাহায্য

- সাহায্য

- গোপন

- উচ্চ

- উচ্চ পারদর্শিতা

- হাইকিং

- ঘন্টার

- কিভাবে

- কিভাবে

- এইচটিএমএল

- HTTP

- HTTPS দ্বারা

- শত শত

- i

- ভাবমূর্তি

- বাস্তবায়ন

- উন্নত করা

- উন্নতি

- in

- গভীর

- অন্তর্ভুক্ত করা

- সুদ্ধ

- ক্রমবর্ধমান

- স্বাধীন

- তথ্য

- পরিকাঠামো

- উদ্ভাবনী

- ইনপুট

- উদাহরণ

- নির্দেশাবলী

- সংহত

- জড়িত করা

- জড়িত

- সমস্যা

- IT

- এর

- কাজ

- জবস

- JPG

- চাবি

- বধ

- জ্ঞান

- লেবেল

- ভাষা

- বড়

- বড় আকারের

- গত

- শুরু করা

- নেতা

- শিক্ষা

- বরফ

- উচ্চতা

- লাইব্রেরি

- জীবন

- মত

- লাইন

- বোঝাই

- দেখুন

- তাকিয়ে

- ভালবাসা

- মেশিন

- মেশিন লার্নিং

- প্রণীত

- করা

- তৈরি করে

- পরিচালিত

- পরিচালক

- মার্চ

- ছাপ

- ব্যাপার

- চরমে তোলা

- মানে

- পদ্ধতি

- স্মৃতি

- মাইগ্রেট

- মিলিয়ন

- ML

- মডেল

- মডেল

- মেজাজ

- অধিক

- বহু

- গুণমান

- প্রাকৃতিক

- স্বভাবিক ভাষা

- স্বাভাবিক ভাষা প্রক্রিয়াকরণ

- প্রয়োজন

- প্রয়োজন

- নেতিবাচক

- নেটওয়ার্ক

- নতুন

- NLP

- নোড

- নোটবই

- সংখ্যা

- এনভিডিয়া

- of

- অর্পণ

- অর্ঘ

- অফার

- পুরাতন

- on

- ONE

- অপারেটরদের

- অপ্টিমাইজেশান

- সেরা অনুকূল রূপ

- সর্বোচ্চকরন

- অরেগন

- অন্যান্য

- বাহিরে

- নিজের

- সমান্তরাল

- স্থিতিমাপ

- পরামিতি

- অংশ

- পাসিং

- আবেগ

- কর্মক্ষমতা

- কাল

- বাদ্য

- মাচা

- Plato

- প্লেটো ডেটা ইন্টেলিজেন্স

- প্লেটোডাটা

- খেলা

- বিন্দু

- ধনাত্মক

- পোস্ট

- সম্ভাব্য

- সম্ভাব্য

- ক্ষমতা

- চালিত

- মূল্য

- প্রাথমিকভাবে

- প্রক্রিয়া

- প্রসেস

- প্রক্রিয়াজাতকরণ

- প্রসেসিং শক্তি

- প্রসেসর

- পণ্য

- পণ্য ব্যবস্থাপক

- উত্পাদনের

- উপলব্ধ

- প্রদানের

- উদ্দেশ্য

- ঠেলাঠেলি

- পাইথন

- পাইটার্চ

- প্রশ্ন

- দ্রুত

- বৃষ্টিতেই

- পরিসর

- সৈনিকগণ

- প্রকৃত সময়

- স্বীকার

- সুপারিশ

- হ্রাস করা

- অঞ্চল

- নিয়মিত

- প্রয়োজনীয়

- আবশ্যকতা

- প্রয়োজন

- দায়ী

- ফল

- ফলাফল

- এখানে ক্লিক করুন

- পর্যালোচনা

- চালান

- দৌড়

- s

- ঋষি নির্মাতা

- একই

- জমা

- বলেছেন

- স্কেল

- বিজ্ঞানীরা

- SDK

- এসইসি

- নির্বাচিত

- শব্দার্থবিদ্যা

- জ্যেষ্ঠ

- বাক্য

- আলাদা

- ক্রম

- সার্ভারের

- সেবা

- সেবা

- সেট

- প্রদর্শনী

- প্রদর্শিত

- অনুরূপ

- সহজ

- আয়তন

- সফটওয়্যার

- সফটওয়্যার উন্নয়ন

- সফটওয়্যার ইঞ্জিনিয়ার

- সলিউশন

- শীঘ্রই

- ঘটনাকাল

- বিশেষজ্ঞ

- বিশেষ

- বক্তৃতা

- কন্ঠ সনান্তকরণ

- শুরু

- রাষ্ট্র-এর-শিল্প

- ধাপ

- প্রারম্ভিক ব্যবহারের নির্দেশাবলী

- এখনো

- এমন

- সমর্থন

- সমর্থন

- সিস্টেম

- টেবিল

- লাগে

- গ্রহণ

- কাজ

- টীম

- কারিগরী

- প্রযুক্তিঃ

- পরীক্ষা

- পাঠ্য শ্রেণিবিন্যাস

- যে

- সার্জারির

- ক্ষেত্র

- তাদের

- তাহাদিগকে

- এইগুলো

- জিনিস

- হাজার হাজার

- তিন

- থ্রুপুট

- সময়

- বার

- শিরনাম

- থেকে

- টোকেন

- সরঞ্জাম

- মশাল

- রচনা

- রেলগাড়ি

- প্রশিক্ষিত

- প্রশিক্ষণ

- ট্রেন

- ট্রান্সফরমার

- ট্রিগার

- ধরনের

- বোঝা

- একক

- us

- ব্যবহার

- ব্যবহার ক্ষেত্রে

- ব্যবহারকারী

- মূল্য

- বিভিন্ন

- ভিডিও

- ভার্জিনিয়া

- দৃষ্টি

- ভয়েস

- সপ্তাহ

- পশ্চিম

- কি

- যে

- সাদা

- হু

- ব্যাপক

- প্রশস্ত পরিসর

- ইচ্ছা

- সঙ্গে

- ছাড়া

- হয়া যাই ?

- কাজ

- মোড়ানো

- লিখিত

- বছর

- তরুণ

- আপনার

- zephyrnet