ভাষা মডেল হল পরিসংখ্যানগত পদ্ধতি যা প্রাকৃতিক পাঠ্য ব্যবহার করে ক্রমানুসারে টোকেনের উত্তরাধিকারের পূর্বাভাস দেয়। লার্জ ল্যাঙ্গুয়েজ মডেল (LLMs) হল নিউরাল নেটওয়ার্ক-ভিত্তিক ল্যাঙ্গুয়েজ মডেল যার সাথে কয়েক মিলিয়ন (বার্ট) থেকে এক ট্রিলিয়ন পরামিতি (এমআইসিএস), এবং যার আকার একক-GPU প্রশিক্ষণকে অব্যবহারিক করে তোলে। LLM-এর উৎপাদক ক্ষমতা তাদের পাঠ্য সংশ্লেষণ, সংক্ষিপ্তকরণ, মেশিন অনুবাদ এবং আরও অনেক কিছুর জন্য জনপ্রিয় করে তোলে।

একটি LLM এর আকার এবং এর প্রশিক্ষণের ডেটা একটি দ্বি-ধারী তলোয়ার: এটি মডেলিং গুণমান নিয়ে আসে, কিন্তু অবকাঠামোগত চ্যালেঞ্জগুলিকে অন্তর্ভুক্ত করে। মডেলটি প্রায়শই একটি একক GPU ডিভাইসের মেমরিতে বা একাধিক-GPU দৃষ্টান্তের একাধিক ডিভাইসে মাপসই করার জন্য অনেক বড়। এই কারণগুলির জন্য ত্বরিত মেশিন লার্নিং (এমএল) দৃষ্টান্তগুলির বড় ক্লাস্টারগুলিতে একটি এলএলএম প্রশিক্ষণের প্রয়োজন। বিগত কয়েক বছরে, অসংখ্য গ্রাহক এলএলএম প্রশিক্ষণের জন্য AWS ক্লাউড ব্যবহার করছেন।

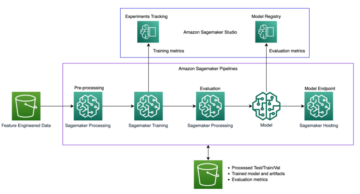

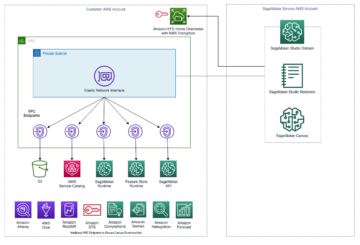

এই পোস্টে, আমরা সফল এলএলএম প্রশিক্ষণের জন্য টিপস এবং সর্বোত্তম অনুশীলনের মধ্যে ডুব দিয়েছি আমাজন সেজমেকার প্রশিক্ষণ. সেজমেকার ট্রেনিং হল একটি পরিচালিত ব্যাচ এমএল কম্পিউট পরিষেবা যা পরিকাঠামো পরিচালনার প্রয়োজন ছাড়াই স্কেলে মডেলগুলিকে প্রশিক্ষণ এবং টিউন করার সময় এবং খরচ কমায়৷ একটি লঞ্চ কমান্ডের মধ্যে, আমাজন সেজমেকার একটি সম্পূর্ণ কার্যকরী, ক্ষণস্থায়ী কম্পিউট ক্লাস্টার চালু করে যা আপনার পছন্দের কাজটি চালায়, এবং উন্নত ML বৈশিষ্ট্য যেমন মেটাস্টোর, পরিচালিত I/O এবং বিতরণ সহ। পোস্টটি একটি LLM প্রশিক্ষণের কাজের চাপের সমস্ত পর্যায় কভার করে এবং সংশ্লিষ্ট অবকাঠামো বৈশিষ্ট্য এবং সর্বোত্তম অনুশীলনগুলি বর্ণনা করে। এই পোস্টের কিছু সর্বোত্তম অনুশীলন বিশেষভাবে ml.p4d.24xlarge দৃষ্টান্তগুলির জন্য উল্লেখ করে, তবে বেশিরভাগই যে কোনও উদাহরণের জন্য প্রযোজ্য। এই সর্বোত্তম অনুশীলনগুলি আপনাকে সেজমেকারে কয়েক ডজন থেকে কয়েক মিলিয়ন প্যারামিটারের স্কেলে এলএলএম প্রশিক্ষণের অনুমতি দেয়।

এই পোস্টের সুযোগ সম্পর্কে, নিম্নলিখিত নোট করুন:

- আমরা নিউরাল নেটওয়ার্ক সায়েন্টিফিক ডিজাইন এবং সংশ্লিষ্ট অপ্টিমাইজেশন কভার করি না। Amazon.Science অনেক বৈজ্ঞানিক প্রকাশনা বৈশিষ্ট্য সহ এবং এর মধ্যে সীমাবদ্ধ নয় এলএলএম.

- যদিও এই পোস্টটি এলএলএম-এর উপর ফোকাস করে, তবে এর বেশিরভাগ সেরা অনুশীলনগুলি কম্পিউটার ভিশন এবং মাল্টি-মডেল মডেল, যেমন স্টেবল ডিফিউশন সহ যেকোনো ধরনের বড়-মডেল প্রশিক্ষণের জন্য প্রাসঙ্গিক।

সেরা অনুশীলন

আমরা এই পোস্টে নিম্নলিখিত সেরা অনুশীলনগুলি নিয়ে আলোচনা করব:

- গনা – সেজমেকার ট্রেনিং হল CPU ডেটাসেট প্রস্তুতির কাজ এবং হাজার-স্কেল GPU জব চালু করার জন্য একটি দুর্দান্ত API।

- সংগ্রহস্থল - আমরা দক্ষতা এবং পছন্দের উপর নির্ভর করে ডেটা লোডিং এবং চেকপয়েন্টিং দুটি উপায়ে সম্পন্ন দেখতে পাই: একটি অ্যামাজন এফএসএক্স লাস্টার ফাইল সিস্টেম, বা আমাজন সিম্পল স্টোরেজ সার্ভিস (Amazon S3) শুধুমাত্র।

- উপমা - আপনার ডিস্ট্রিবিউটেড ট্রেনিং লাইব্রেরির পছন্দ জিপিইউগুলির যথাযথ ব্যবহারের জন্য অত্যন্ত গুরুত্বপূর্ণ৷ আমরা একটি ক্লাউড-অপ্টিমাইজ করা লাইব্রেরি ব্যবহার করার পরামর্শ দিই, যেমন সেজমেকার শার্ডেড ডেটা প্যারালেলিজম, তবে স্ব-পরিচালিত এবং ওপেন-সোর্স লাইব্রেরিগুলিও কাজ করতে পারে।

- নেটওয়ার্কিং - দ্রুত আন্তঃমেশিন যোগাযোগের জন্য EFA এবং NVIDIA GPUDirectRDMA সক্রিয় আছে তা নিশ্চিত করুন।

- স্থিতিস্থাপকতা - স্কেলে, হার্ডওয়্যার ব্যর্থতা ঘটতে পারে। আমরা নিয়মিত চেকপয়েন্ট করার পরামর্শ দিই। প্রতি কয়েক ঘন্টা সাধারণ।

অঞ্চল নির্বাচন

দৃষ্টান্তের ধরন এবং পছন্দসই ক্ষমতা অঞ্চল নির্বাচনের জন্য একটি নির্ধারক ফ্যাক্টর। SageMaker এবং দ্বারা সমর্থিত অঞ্চলের জন্য অ্যামাজন ইলাস্টিক কম্পিউট ক্লাউড (Amazon EC2) উদাহরণের ধরন যা প্রতিটি অঞ্চলে পাওয়া যায়, দেখুন অ্যামাজন সেজমেকার প্রাইসিং. এই পোস্টে, আমরা প্রশিক্ষণের উদাহরণের ধরনটিকে SageMaker-পরিচালিত ml.p4d.24xlarge বলে ধরে নিই।

আমরা আপনার AWS অ্যাকাউন্ট টিমের সাথে কাজ করার বা যোগাযোগ করার পরামর্শ দিই AWS বিক্রয় আপনার এলএলএম কাজের চাপের জন্য উপযুক্ত অঞ্চল নির্ধারণ করতে।

ডেটা প্রস্তুতি

LLM বিকাশকারীরা তাদের মডেলগুলিকে প্রাকৃতিকভাবে ঘটতে থাকা পাঠ্যের বড় ডেটাসেটে প্রশিক্ষণ দেয়। এই ধরনের তথ্য উৎসের জনপ্রিয় উদাহরণ অন্তর্ভুক্ত সাধারণ ক্রল এবং গাদা. স্বাভাবিকভাবে ঘটে যাওয়া টেক্সটে পক্ষপাত, ভুল, ব্যাকরণগত ত্রুটি এবং বাক্য গঠনের ভিন্নতা থাকতে পারে। একটি LLM এর শেষ গুণমান উল্লেখযোগ্যভাবে প্রশিক্ষণের ডেটা নির্বাচন এবং কিউরেশনের উপর নির্ভর করে। এলএলএম প্রশিক্ষণ তথ্য প্রস্তুতি এলএলএম শিল্পে গবেষণা এবং উদ্ভাবনের একটি সক্রিয় ক্ষেত্র। একটি প্রাকৃতিক ভাষা প্রক্রিয়াকরণ (NLP) ডেটাসেটের প্রস্তুতি ভাগ-কিছুই সমান্তরালতার সুযোগের সাথে প্রচুর। অন্য কথায়, এমন কিছু পদক্ষেপ রয়েছে যা কাজের এককগুলিতে প্রয়োগ করা যেতে পারে—উৎস ফাইল, অনুচ্ছেদ, বাক্য, শব্দ—আন্তঃ-কর্মী সিঙ্ক্রোনাইজেশনের প্রয়োজন ছাড়াই।

SageMaker জব APIs, যথা SageMaker প্রশিক্ষণ এবং SageMaker প্রক্রিয়াকরণ, এই ধরনের কাজের জন্য এক্সেল। তারা ডেভেলপারদের একাধিক মেশিনের বহরে একটি নির্বিচারে ডকার কন্টেইনার চালাতে সক্ষম করে। SageMaker Training API এর ক্ষেত্রে কম্পিউটিং ফ্লিট হতে পারে নানাধর্মী. সেজমেকার সহ অসংখ্য বিতরণকৃত কম্পিউটিং ফ্রেমওয়ার্ক ব্যবহার করা হয়েছে দাস্ক, রশ্মি, এবং আরো পাইস্পার্ক, যা একটি উত্সর্গীকৃত আছে AWS-পরিচালিত ধারক এবং SDK এর সেজমেকার প্রসেসিং-এ।

আপনি যখন একাধিক মেশিনের সাথে একটি কাজ চালু করেন, তখন সেজমেকার ট্রেনিং এবং প্রসেসিং আপনার কোড প্রতি মেশিনে একবার চালায়। একটি বিতরণ করা অ্যাপ্লিকেশন লেখার জন্য আপনাকে একটি নির্দিষ্ট বিতরণকৃত কম্পিউটিং কাঠামো ব্যবহার করার প্রয়োজন নেই: শেয়ার-কিছুই সমান্তরালতা উপলব্ধি করতে আপনি আপনার পছন্দের কোড লিখতে পারেন, যা প্রতি মেশিনে একবার চলবে। এছাড়াও আপনি আপনার পছন্দের ইন্টার-নোড কমিউনিকেশন লজিক লিখতে বা ইনস্টল করতে পারেন।

ডেটা লোড হচ্ছে

প্রশিক্ষণের ডেটা সঞ্চয় করার এবং এটির স্টোরেজ থেকে ত্বরিত কম্পিউট নোডে স্থানান্তর করার একাধিক উপায় রয়েছে। এই বিভাগে, আমরা ডেটা লোড করার বিকল্পগুলি এবং সেরা অনুশীলনগুলি নিয়ে আলোচনা করি৷

সেজমেকার স্টোরেজ এবং লোডিং বিকল্প

একটি সাধারণ LLM ডেটাসেটের আকার কয়েকশো মিলিয়ন টেক্সট টোকেনের মধ্যে থাকে, যা কয়েকশ গিগাবাইটের প্রতিনিধিত্ব করে। ml.p4d.24x বৃহৎ দৃষ্টান্তের সেজমেকার-পরিচালিত ক্লাস্টারগুলি ডেটাসেট স্টোরেজ এবং লোড করার জন্য বিভিন্ন বিকল্প প্রস্তাব করে:

- অন-নোড NVMe SSD - ml.P4d.24x বড় উদাহরণ 8TB NVMe দিয়ে সজ্জিত, এর অধীনে উপলব্ধ

/opt/ml/input/data/<channel>যদি আপনি ব্যবহার সেজমেকার ফাইল মোড, এবং এ/tmp. আপনি যদি স্থানীয় পাঠের সরলতা এবং কার্যকারিতা খুঁজছেন, আপনি NVMe SSD-তে আপনার ডেটা অনুলিপি করতে পারেন। অনুলিপিটি সেজমেকার ফাইল মোড দ্বারা বা আপনার নিজের কোড দ্বারা করা যেতে পারে, উদাহরণস্বরূপ মাল্টি-প্রসেসড ব্যবহার করে বোটো৩ or S5cmd. - দীপ্তি জন্য FSx - অন-নোড এনভিএমই এসএসডি আকারে সীমিত, এবং প্রতিটি কাজ বা উষ্ণ ক্লাস্টার তৈরিতে Amazon S3 থেকে ইনজেশন প্রয়োজন। আপনি যদি কম লেটেন্সি র্যান্ডম অ্যাক্সেস বজায় রেখে বড় ডেটাসেটে স্কেল করতে চান তবে আপনি Lustre-এর জন্য FSx ব্যবহার করতে পারেন। Amazon FSx হল একটি ওপেন-সোর্স সমান্তরাল ফাইল সিস্টেম, হাই-পারফরম্যান্স কম্পিউটিং (HPC) এ জনপ্রিয়। দীপ্তি ব্যবহারের জন্য FSx বিতরণ করা ফাইল স্টোরেজ (স্ট্রিপিং) এবং উচ্চ-কর্মক্ষমতা পঠন/লেখা অর্জনের জন্য ফাইল সামগ্রী থেকে ফাইল মেটাডেটাকে শারীরিকভাবে আলাদা করে।

- সেজমেকার ফাস্টফাইল মোড - ফাস্টফাইল মোড (ব্লজব) হল একটি SageMaker-শুধুমাত্র বৈশিষ্ট্য যা একটি POSIX-compliant ইন্টারফেসের অধীনে SageMaker-পরিচালিত কম্পিউট ইনস্ট্যান্সে দূরবর্তী S3 অবজেক্টগুলি উপস্থাপন করে এবং FUSE ব্যবহার করে শুধুমাত্র পড়ার পরেই স্ট্রিম করে। FFM S3 কলের ফলাফলগুলি পড়ে যা দূরবর্তী ফাইলগুলিকে ব্লক করে ব্লক করে। Amazon S3 ট্র্যাফিক সম্পর্কিত ত্রুটিগুলি এড়াতে একটি সর্বোত্তম অভ্যাস হিসাবে, FFM বিকাশকারীদের লক্ষ্য হওয়া উচিত S3 কলগুলির অন্তর্নিহিত সংখ্যা যুক্তিসঙ্গত রাখা, উদাহরণস্বরূপ ফাইলগুলিকে ক্রমানুসারে পড়া এবং একটি নিয়ন্ত্রিত পরিমাণ সমান্তরালতার সাথে।

- স্ব-পরিচালিত ডেটা লোড হচ্ছে - অবশ্যই, আপনি মালিকানা বা ওপেন-সোর্স কোড ব্যবহার করে আপনার নিজস্ব, সম্পূর্ণ কাস্টম ডেটা লোডিং যুক্তি প্রয়োগ করার সিদ্ধান্ত নিতে পারেন। স্ব-পরিচালিত ডেটা লোডিং ব্যবহার করার কিছু কারণ হল ইতিমধ্যে-বিকশিত কোড পুনঃব্যবহারের মাধ্যমে একটি স্থানান্তরকে সহজতর করা, কাস্টম ত্রুটি পরিচালনার যুক্তি প্রয়োগ করা, বা অন্তর্নিহিত কর্মক্ষমতা এবং শার্ডিংয়ের উপর আরও নিয়ন্ত্রণ করা। স্ব-পরিচালিত ডেটা লোডিংয়ের জন্য আপনি যে লাইব্রেরিগুলি ব্যবহার করতে পারেন তার উদাহরণ অন্তর্ভুক্ত torchdata.datapipes (আগের AWS PyTorch S3 প্লাগইন) এবং ওয়েবডেটাসেট. AWS পাইথন SDK বোটো৩ এর সাথেও মিলিত হতে পারে টর্চ ডেটাসেট কাস্টম ডেটা লোডিং কোড তৈরি করার জন্য ক্লাস। কাস্টম ডেটা লোডিং ক্লাসগুলি সেজমেকার ট্রেনিং ভিন্নধর্মী ক্লাস্টারগুলির সৃজনশীল ব্যবহারকেও সক্ষম করে, একটি প্রদত্ত কাজের চাপে CPU এবং GPU ব্যালেন্সকে সূক্ষ্মভাবে মানিয়ে নিতে।

সেই বিকল্পগুলি এবং কীভাবে সেগুলি বেছে নেবেন সে সম্পর্কে আরও তথ্যের জন্য, পড়ুন আপনার Amazon SageMaker প্রশিক্ষণ কাজের জন্য সেরা ডেটা উত্স চয়ন করুন.

Amazon S3 এর সাথে বড় আকারের মিথস্ক্রিয়া জন্য সর্বোত্তম অনুশীলন

Amazon S3 ডাটা রিডিং এবং চেকপয়েন্টিং উভয়ের জন্য এলএলএম ওয়ার্কলোড পরিচালনা করতে সক্ষম। এটি একটি সমর্থন করে অনুরোধের হার একটি বালতিতে প্রতি সেকেন্ডে 3,500টি PUT/COPY/POST/DELETE বা 5,500টি GET/HEAD অনুরোধ। যাইহোক, এই হার অগত্যা ডিফল্টরূপে উপলব্ধ নয়. পরিবর্তে, একটি উপসর্গের জন্য অনুরোধের হার বাড়ার সাথে সাথে, Amazon S3 স্বয়ংক্রিয়ভাবে বর্ধিত হার পরিচালনা করতে স্কেল করে। আরো তথ্যের জন্য, পড়ুন কেন আমি Amazon S503 থেকে 3 স্লো ডাউন ত্রুটি পাচ্ছি যখন অনুরোধগুলি প্রতি উপসর্গে সমর্থিত অনুরোধের হারের মধ্যে থাকে.

আপনি যদি উচ্চ-ফ্রিকোয়েন্সি Amazon S3 ইন্টারঅ্যাকশন আশা করেন, আমরা নিম্নলিখিত সেরা অনুশীলনগুলি সুপারিশ করি:

- একাধিক S3 বালতি থেকে পড়তে এবং লিখতে চেষ্টা করুন এবং উপসর্গ. উদাহরণস্বরূপ, আপনি বিভিন্ন উপসর্গ জুড়ে প্রশিক্ষণ ডেটা এবং চেকপয়েন্টগুলিকে বিভাজন করতে পারেন।

- Amazon S3 মেট্রিক্স পরীক্ষা করুন অ্যামাজন ক্লাউডওয়াচ অনুরোধের হার ট্র্যাক করতে।

- একযোগে PUT/GET এর পরিমাণ কমানোর চেষ্টা করুন:

- একই সময়ে Amazon S3 ব্যবহার করে কম প্রসেস আছে। উদাহরণ স্বরূপ, যদি প্রতি নোডের আটটি প্রসেস অ্যামাজন S3-এ চেকপয়েন্ট করতে হয়, তাহলে আপনি 8-এর ফ্যাক্টর দ্বারা PUT ট্র্যাফিক কমাতে পারেন ক্রমানুসারে চেকপয়েন্ট করে: প্রথমে নোডের মধ্যে, তারপর নোড থেকে অ্যামাজন S3-তে।

- প্রতিটি প্রশিক্ষণ রেকর্ডের জন্য একটি S3 GET ব্যবহার না করে একটি একক ফাইল বা S3 GET থেকে একাধিক প্রশিক্ষণের রেকর্ড পড়ুন।

- আপনি SageMaker FFM এর মাধ্যমে Amazon S3 ব্যবহার করলে, SageMaker FFM ফাইলগুলি খণ্ড খণ্ড করে আনতে S3 কল করে৷ FFM দ্বারা উত্পন্ন Amazon S3 ট্র্যাফিক সীমিত করতে, আমরা আপনাকে অনুক্রমিকভাবে ফাইলগুলি পড়তে এবং সমান্তরালভাবে খোলা ফাইলগুলিকে সীমাবদ্ধ করতে উত্সাহিত করি৷

একটি আপনি যদি বিকাশকারী, ব্যবসা, বা এন্টারপ্রাইজ সমর্থন পরিকল্পনা, আপনি S3 503 স্লো ডাউন ত্রুটি সম্পর্কে একটি প্রযুক্তিগত সহায়তা কেস খুলতে পারেন। তবে প্রথমে নিশ্চিত করুন যে আপনি সর্বোত্তম অনুশীলনগুলি অনুসরণ করেছেন এবং অনুরোধ আইডি পান ব্যর্থ অনুরোধের জন্য।

প্রশিক্ষণ সমান্তরাল

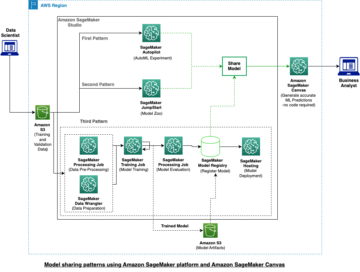

LLM-তে সাধারণত কয়েক ডজন থেকে কয়েক বিলিয়ন প্যারামিটার থাকে, যা একটি একক NVIDIA GPU কার্ডের মধ্যে ফিট করার জন্য তাদের অনেক বড় করে তোলে। এলএলএম অনুশীলনকারীরা এলএলএম প্রশিক্ষণের বিতরণ করা গণনার সুবিধার্থে বেশ কয়েকটি ওপেন-সোর্স লাইব্রেরি তৈরি করেছে, যার মধ্যে রয়েছে এফএসডিপি, ডিপস্পিড এবং Megatron. আপনি সেজমেকার প্রশিক্ষণে সেই লাইব্রেরিগুলি চালাতে পারেন, তবে আপনি সেজমেকার বিতরণকৃত প্রশিক্ষণ লাইব্রেরিগুলিও ব্যবহার করতে পারেন, যেগুলি AWS ক্লাউডের জন্য অপ্টিমাইজ করা হয়েছে এবং একটি সহজ বিকাশকারী অভিজ্ঞতা প্রদান করে৷ SageMaker-এ তাদের LLM-এর বিতরণকৃত প্রশিক্ষণের জন্য ডেভেলপারদের দুটি বিকল্প রয়েছে: বিতরণ করা লাইব্রেরি বা স্ব-পরিচালিত।

সেজমেকার লাইব্রেরি বিতরণ করেছে

আপনাকে উন্নত বিতরণকৃত প্রশিক্ষণ কর্মক্ষমতা এবং ব্যবহারযোগ্যতা প্রদান করতে, সেজমেকার ট্রেনিং TensorFlow এবং PyTorch প্রশিক্ষণ কোড স্কেল করার জন্য বেশ কয়েকটি মালিকানাধীন এক্সটেনশনের প্রস্তাব করেছে। এলএলএম প্রশিক্ষণ প্রায়শই একটি 3D-সমান্তরাল ফ্যাশনে পরিচালিত হয়:

- ডেটা সমান্তরালতা প্রক্রিয়াকরণের গতি বাড়ানোর জন্য মডেলের একাধিক অভিন্ন প্রতিলিপিতে প্রশিক্ষণ মিনি-ব্যাচগুলিকে বিভক্ত করে এবং ফিড করে

- পাইপলাইন সমান্তরালতা একটি একক GPU এবং একটি একক সার্ভারের বাইরে মডেলের আকার স্কেল করার জন্য মডেলের বিভিন্ন স্তরকে বিভিন্ন GPU বা এমনকি দৃষ্টান্তগুলিতে বৈশিষ্ট্যযুক্ত করে

- টেনসর সমান্তরালতা একটি একক স্তরকে একাধিক GPU-তে বিভক্ত করে, সাধারণত একই সার্ভারের মধ্যে, পৃথক স্তরগুলিকে একটি একক GPU-এর বেশি আকারে স্কেল করতে

নিম্নলিখিত উদাহরণে, 6*k*3 GPUs (প্রতি সার্ভারে 8 GPU) সহ k*3 সার্ভারের একটি ক্লাস্টারে একটি 8-স্তর মডেল প্রশিক্ষিত হয়। ডেটা সমান্তরালতার ডিগ্রি হল k, পাইপলাইন সমান্তরালতা 6, এবং টেনসর সমান্তরালতা 4। ক্লাস্টারের প্রতিটি GPU-এ একটি মডেল স্তরের এক-চতুর্থাংশ থাকে এবং একটি সম্পূর্ণ মডেল তিনটি সার্ভারে বিভাজিত হয় (মোট 24 GPU)।

নিম্নলিখিতগুলি এলএলএম-এর জন্য বিশেষভাবে প্রাসঙ্গিক:

- SageMaker মডেল সমান্তরাল বিতরণ – এই লাইব্রেরি গতি বা মেমরির জন্য অপ্টিমাইজ করা বুদ্ধিমান মডেল পার্টিশন তৈরি করতে গ্রাফ পার্টিশনিং ব্যবহার করে। SageMaker বিতরণকৃত মডেল সমান্তরাল সর্বশেষ এবং সর্বশ্রেষ্ঠ বৃহৎ-মডেল প্রশিক্ষণ অপ্টিমাইজেশান উন্মোচন করে, যার মধ্যে ডেটা সমান্তরালতা, পাইপলাইন সমান্তরালতা, টেনসর সমান্তরালতা, অপ্টিমাইজার স্টেট শার্ডিং, অ্যাক্টিভেশন চেকপয়েন্টিং এবং অফলোডিং সহ। SageMaker বিতরণ করা মডেল সমান্তরাল লাইব্রেরির সাথে, আমরা 175 NVIDIA A920 GPU-এর উপর একটি 100-বিলিয়ন প্যারামিটার মডেল প্রশিক্ষণ নথিভুক্ত করেছি। আরো তথ্যের জন্য, পড়ুন Amazon SageMaker-এ মডেলের সমান্তরাল সংযোজন এবং Hugging Face সহ 175+ বিলিয়ন প্যারামিটার NLP মডেলকে প্রশিক্ষণ দিন.

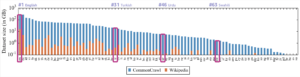

- সেজমেকার ডেটা সমান্তরালভাবে শার্ড করেছে - ইন MiCS: পাবলিক ক্লাউডে বিশাল মডেলের প্রশিক্ষণের জন্য কাছাকাছি-রৈখিক স্কেলিং, ঝাং এট আল। একটি নিম্ন-যোগাযোগ মডেল সমান্তরাল কৌশল প্রবর্তন করে যা সম্পূর্ণ ক্লাস্টারের পরিবর্তে শুধুমাত্র ডেটা সমান্তরাল গোষ্ঠীতে মডেলগুলিকে পার্টিশন করে। MiCS-এর সাহায্যে, AWS বিজ্ঞানীরা EC176 P56.4de দৃষ্টান্তে 210-স্তর 1.06-ট্রিলিয়ন-প্যারামিটার মডেলের প্রশিক্ষণের জন্য GPU প্রতি 2 টেরাফ্লপ (তাত্ত্বিক শিখরের 4%) অর্জন করতে সক্ষম হয়েছেন। এমআইসিএস এখন সেজমেকার প্রশিক্ষণ গ্রাহকদের জন্য উপলব্ধ সেজমেকার ডেটা সমান্তরালভাবে শার্ড করেছে.

সেজমেকার বিতরণ করা প্রশিক্ষণ লাইব্রেরিগুলি উচ্চ কার্যকারিতা এবং একটি সহজ বিকাশকারী অভিজ্ঞতা প্রদান করে। বিশেষ করে, ডেভেলপারদের একটি কাস্টম সমান্তরাল প্রসেস লঞ্চার লিখতে বা বজায় রাখতে হবে না বা ফ্রেমওয়ার্ক-নির্দিষ্ট লঞ্চ টুল ব্যবহার করতে হবে না, কারণ সমান্তরাল লঞ্চারটি জব লঞ্চ SDK-তে তৈরি করা হয়েছে।

স্ব-পরিচালিত

সেজমেকার প্রশিক্ষণের সাথে, আপনার পছন্দের কাঠামো এবং বৈজ্ঞানিক দৃষ্টান্ত ব্যবহার করার স্বাধীনতা রয়েছে। বিশেষ করে, আপনি যদি বিতরণকৃত প্রশিক্ষণ নিজেই পরিচালনা করতে চান, আপনার কাস্টম কোড লেখার জন্য আপনার কাছে দুটি বিকল্প রয়েছে:

- একটি AWS ডিপ লার্নিং কন্টেইনার (DLC) ব্যবহার করুন - AWS বিকাশ এবং রক্ষণাবেক্ষণ করে DLCs, শীর্ষ ওপেন-সোর্স ML ফ্রেমওয়ার্কের জন্য AWS-অপ্টিমাইজড ডকার-ভিত্তিক পরিবেশ প্রদান করে। সেজমেকার ট্রেনিং-এর একটি অনন্য ইন্টিগ্রেশন রয়েছে যা আপনাকে বাহ্যিক, ব্যবহারকারী-সংজ্ঞায়িত এন্ট্রি পয়েন্ট সহ AWS DLCs টানতে এবং চালাতে দেয়। বিশেষ করে LLM প্রশিক্ষণের জন্য, TensorFlow, PyTorch, Hugging Face এবং MXNet-এর জন্য AWS DLC বিশেষভাবে প্রাসঙ্গিক। একটি ফ্রেমওয়ার্ক DLC ব্যবহার করা আপনাকে আপনার নিজস্ব ডকার ইমেজগুলি বিকাশ ও পরিচালনা না করেই PyTorch Distributed-এর মতো ফ্রেমওয়ার্ক-নেটিভ প্যারালেলিজম ব্যবহার করতে দেয়। উপরন্তু, আমাদের DLCs একটি বৈশিষ্ট্য এমপিআই ইন্টিগ্রেশন, যা আপনাকে সহজে সমান্তরাল কোড চালু করতে দেয়।

- একটি কাস্টম সেজমেকার-সামঞ্জস্যপূর্ণ ডকার চিত্র লিখুন - আপনি আপনার নিজস্ব (BYO) চিত্র আনতে পারেন (দেখুন আপনার নিজস্ব প্রশিক্ষণ অ্যালগরিদম ব্যবহার করুন এবং Amazon SageMaker কাস্টম প্রশিক্ষণ পাত্রে), হয় স্ক্র্যাচ থেকে শুরু করে অথবা একটি বিদ্যমান DLC চিত্র প্রসারিত করে। সেজমেকারে এলএলএম প্রশিক্ষণের জন্য একটি কাস্টম চিত্র ব্যবহার করার সময়, নিম্নলিখিতগুলি যাচাই করা বিশেষভাবে গুরুত্বপূর্ণ:

- আপনার ছবিতে উপযুক্ত সেটিংস সহ EFA রয়েছে (এই পোস্টে পরে আরও আলোচনা করা হয়েছে)

- আপনার ছবিতে একটি NVIDIA NCCL যোগাযোগ লাইব্রেরি রয়েছে, যা GPUDirectRDMA এর সাথে সক্ষম

গ্রাহকরা ডিপস্পিড সহ বেশ কয়েকটি স্ব-পরিচালিত বিতরণ প্রশিক্ষণ লাইব্রেরি ব্যবহার করতে সক্ষম হয়েছে।

যোগাযোগমন্ত্রী

একটি LLM প্রশিক্ষণ কাজের বিতরণ প্রকৃতির প্রেক্ষিতে, আন্তঃমেশিন যোগাযোগ সম্ভাব্যতা, কর্মক্ষমতা এবং কাজের চাপের খরচের জন্য গুরুত্বপূর্ণ। এই বিভাগে, আমরা আন্তঃ-মেশিন যোগাযোগের মূল বৈশিষ্ট্যগুলি উপস্থাপন করি এবং ইনস্টলেশন এবং টিউনিংয়ের জন্য টিপস দিয়ে শেষ করি।

ইলাস্টিক ফ্যাব্রিক অ্যাডাপ্টার

এমএল অ্যাপ্লিকেশনগুলিকে ত্বরান্বিত করার জন্য, এবং ক্লাউড দ্বারা প্রদত্ত নমনীয়তা, স্কেলেবিলিটি এবং স্থিতিস্থাপকতা অর্জনের মাধ্যমে পারফরম্যান্স উন্নত করতে, আপনি এর সুবিধা নিতে পারেন ইলাস্টিক ফ্যাব্রিক অ্যাডাপ্টার (EFA) SageMaker এর সাথে। আমাদের অভিজ্ঞতায়, সন্তোষজনক মাল্টি-নোড এলএলএম প্রশিক্ষণ কর্মক্ষমতা পেতে ইএফএ ব্যবহার করা একটি প্রয়োজনীয়তা।

একটি EFA ডিভাইস হল একটি নেটওয়ার্ক ইন্টারফেস যা EC2 দৃষ্টান্তগুলির সাথে সংযুক্ত যা প্রশিক্ষণের কাজ চলাকালীন সেজমেকার দ্বারা পরিচালিত হয়। P4d সহ নির্দিষ্ট পরিবারের ক্ষেত্রে EFA উপলব্ধ। EFA নেটওয়ার্কগুলি কয়েকশ Gbps থ্রুপুট অর্জন করতে সক্ষম।

EFA এর সাথে যুক্ত, AWS চালু করেছে মাপযোগ্য নির্ভরযোগ্য ডেটাগ্রাম (SRD), একটি ইথারনেট-ভিত্তিক পরিবহন দ্বারা অনুপ্রাণিত InfiniBand নির্ভরযোগ্য ডেটাগ্রাম, শিথিল প্যাকেট অর্ডার সীমাবদ্ধতা সঙ্গে বিকশিত. EFA এবং SRD সম্পর্কে আরও তথ্যের জন্য, পড়ুন পারফরম্যান্সের অনুসন্ধানে, একটি নেটওয়ার্ক তৈরি করার একাধিক উপায় রয়েছে৷, ভিডিও কিভাবে EFA কাজ করে এবং কেন আমরা ক্লাউডে ইনফিনিব্যান্ড ব্যবহার করি না, এবং গবেষণাপত্র ইলাস্টিক এবং স্কেলেবল এইচপিসির জন্য একটি ক্লাউড-অপ্টিমাইজড ট্রান্সপোর্ট প্রোটোকল শালেভ এট আল থেকে।

আপনি SageMaker বিদ্যমান ডকার পাত্রে সামঞ্জস্যপূর্ণ দৃষ্টান্তগুলিতে EFA ইন্টিগ্রেশন যোগ করতে পারেন, বা কাস্টম পাত্রে যেগুলি SageMaker কাজগুলি ব্যবহার করে ML মডেল প্রশিক্ষণের জন্য ব্যবহার করা যেতে পারে। আরো তথ্যের জন্য, পড়ুন EFA এর সাথে ট্রেনিং চালান. EFA ওপেন সোর্সের মাধ্যমে প্রকাশ করা হয় লিবফ্যাব্রিক যোগাযোগ প্যাকেজ। যাইহোক, এলএলএম ডেভেলপাররা খুব কমই সরাসরি এটিকে লিবফ্যাব্রিকের সাথে প্রোগ্রাম করে এবং সাধারণত এর পরিবর্তে এনভিআইডিএ কালেক্টিভ কমিউনিকেশনস লাইব্রেরির (এনসিসিএল) উপর নির্ভর করে।

AWS-OFI-NCCL প্লাগইন

বিতরণকৃত ML-এ, EFA প্রায়শই NVIDIA কালেক্টিভ কমিউনিকেশন লাইব্রেরি (NCCL) এর সাথে ব্যবহৃত হয়। NCCL হল একটি NVIDIA-উন্নত ওপেন সোর্স লাইব্রেরি যা আন্তঃ-GPU কমিউনিকেশন অ্যালগরিদম বাস্তবায়ন করে। ইন্টার-জিপিইউ কমিউনিকেশন হল এলএলএম প্রশিক্ষণের একটি ভিত্তি যা স্কেলেবিলিটি এবং কর্মক্ষমতাকে অনুঘটক করে। এটি DL প্রশিক্ষণের জন্য এতই গুরুত্বপূর্ণ যে NCCL প্রায়শই গভীর শিক্ষার প্রশিক্ষণ লাইব্রেরিতে যোগাযোগ ব্যাকএন্ড হিসাবে সরাসরি একত্রিত হয়, যাতে এলএলএম বিকাশকারীরা তাদের পছন্দের পাইথন ডিএল উন্নয়ন কাঠামো থেকে - কখনও কখনও লক্ষ্য না করেই এটি ব্যবহার করে৷ EFA-তে NCCL ব্যবহার করতে, LLM ডেভেলপাররা AWS-বিকশিত ব্যবহার করে AWS OFI NCCL প্লাগইন, যা EFA দ্বারা ব্যবহৃত Libfabric ইন্টারফেসে NCCL কলের মানচিত্র তৈরি করে। সাম্প্রতিক উন্নতিগুলি থেকে উপকৃত হতে আমরা AWS OFI NCCL এর সর্বশেষ সংস্করণ ব্যবহার করার পরামর্শ দিই৷

NCCL EFA ব্যবহার করে তা যাচাই করতে, আপনাকে পরিবেশ পরিবর্তনশীল সেট করতে হবে NCCL_DEBUG থেকে INFO, এবং লগ ইন চেক করুন যে EFA NCCL দ্বারা লোড করা হয়েছে:

NCCL এবং EFA কনফিগারেশন সম্পর্কে আরও তথ্যের জন্য, পড়ুন আপনার EFA এবং NCCL কনফিগারেশন পরীক্ষা করুন. আপনি NCCL-কে আরও কয়েকটির সাথে কাস্টমাইজ করতে পারেন পরিবেশের পরিবর্তনশীল. মনে রাখবেন যে NCCL 2.12 এবং তার উপরে কার্যকরী, AWS EFA নেটওয়ার্কগুলির জন্য একটি স্বয়ংক্রিয় যোগাযোগ অ্যালগরিদম নির্বাচন যুক্তি প্রদান করেছে (NCCL_ALGO সেট না করে ছেড়ে দেওয়া যেতে পারে)।

EFA এর উপর NVIDIA GPUDirect RDMA

P4d উদাহরণ টাইপ দিয়ে, আমরা উপস্থাপিত EFA ফ্যাব্রিকের উপর GPUDirect RDMA (GDR)। এটি নেটওয়ার্ক ইন্টারফেস কার্ডগুলিকে (NICs) সরাসরি GPU মেমরি অ্যাক্সেস করতে সক্ষম করে, যা NVIDIA GPU-ভিত্তিক EC2 দৃষ্টান্তগুলি জুড়ে দূরবর্তী GPU- থেকে-GPU যোগাযোগ দ্রুততর করে, CPU এবং ব্যবহারকারী অ্যাপ্লিকেশনগুলিতে অর্কেস্ট্রেশন ওভারহেড হ্রাস করে৷ জিডিআর NCCL দ্বারা হুডের অধীনে ব্যবহার করা হয়, যখন সম্ভব হয়।

যখন লগ লেভেল INFO তে সেট করা থাকে তখন আন্তঃ-GPU কমিউনিকেশনে GDR ব্যবহার দেখা যায়, যেমনটি নিম্নলিখিত কোডে আছে:

AWS গভীর শিক্ষার পাত্রে EFA ব্যবহার করা

AWS ডিপ লার্নিং কন্টেইনার (DLCs) রক্ষণাবেক্ষণ করে, যার মধ্যে অনেকগুলি AWS-পরিচালিত ডকারফাইলগুলির সাথে আসে এবং EFA, AWS OFI NCCL এবং NCCL সম্বলিত নির্মিত৷ নিম্নলিখিত GitHub repos সঙ্গে উদাহরণ অফার পাইটর্চ এবং TensorFlow. আপনার নিজের সেই লাইব্রেরিগুলি ইনস্টল করার দরকার নেই।

আপনার নিজের সেজমেকার প্রশিক্ষণ পাত্রে EFA ব্যবহার করা

আপনি যদি নিজের সেজমেকার ট্রেনিং কন্টেনার তৈরি করেন এবং ত্বরিত আন্তঃ-নোড যোগাযোগের জন্য EFA এর উপর NCCL ব্যবহার করতে চান, তাহলে আপনাকে EFA, NCCL এবং AWS OFI NCCL ইনস্টল করতে হবে। আরো তথ্যের জন্য, পড়ুন EFA এর সাথে ট্রেনিং চালান। অতিরিক্তভাবে, আপনার কন্টেইনারে বা আপনার এন্ট্রি পয়েন্ট কোডে নিম্নলিখিত পরিবেশের ভেরিয়েবলগুলি সেট করা উচিত:

FI_PROVIDER="efa"ফ্যাব্রিক ইন্টারফেস প্রদানকারী নির্দিষ্ট করেNCCL_PROTO=simpleযোগাযোগের জন্য NCCL-কে একটি সাধারণ প্রোটোকল ব্যবহার করার নির্দেশ দেয় (বর্তমানে, EFA প্রদানকারী LL প্রোটোকল সমর্থন করে না; তাদের সক্ষম করলে ডেটা দুর্নীতি হতে পারে)FI_EFA_USE_DEVICE_RDMA=1একতরফা এবং দ্বিমুখী স্থানান্তরের জন্য ডিভাইসের RDMA কার্যকারিতা ব্যবহার করেNCCL_LAUNCH_MODE="PARALLEL"NCCL_NET_SHARED_COMMS="0"

অর্কেস্ট্রারচনা

জীবনচক্র এবং কয়েক ডজন থেকে শত শত কম্পিউট দৃষ্টান্তের কাজের চাপ পরিচালনা করতে অর্কেস্ট্রেশন সফ্টওয়্যার প্রয়োজন। এই বিভাগে, আমরা এলএলএম অর্কেস্ট্রেশনের জন্য সেরা অনুশীলনগুলি অফার করি

কাজের মধ্যে অর্কেস্ট্রেশন

ডেভেলপারদের সার্ভার-সাইড ট্রেনিং কোড এবং ক্লায়েন্ট-সাইড লঞ্চার কোড উভয়ই বেশিরভাগ বিতরণ করা ফ্রেমওয়ার্কগুলিতে লিখতে হবে। ট্রেনিং কোড ট্রেনিং মেশিনে চলে, যেখানে ক্লায়েন্ট-সাইড লঞ্চার কোড একটি ক্লায়েন্ট মেশিন থেকে বিতরণ করা কাজের চাপ চালু করে। আজকে সামান্য প্রমিতকরণ আছে, উদাহরণস্বরূপ:

- PyTorch-এ, বিকাশকারীরা ব্যবহার করে মাল্টি-মেশিন টাস্ক চালু করতে পারে

torchrun,torchx,torch.distributed.launch(অবচন পথ), অথবাtorch.multiprocessing.spawn - ডিপস্পীড তার নিজস্ব ডিপস্পিড সিএলআই লঞ্চার প্রস্তাব করে এবং এমপিআই লঞ্চকে সমর্থন করে

- MPI হল একটি জনপ্রিয় সমান্তরাল কম্পিউটিং ফ্রেমওয়ার্ক যা ML-অজ্ঞেয়বাদী এবং যুক্তিসঙ্গতভাবে মেয়াদী হওয়ার সুবিধা রয়েছে, এবং তাই স্থিতিশীল এবং নথিভুক্ত, এবং ক্রমবর্ধমানভাবে বিতরণ করা ML কাজের চাপে দেখা যাচ্ছে

একটি সেজমেকার ট্রেনিং ক্লাস্টারে, প্রতিটি মেশিনে প্রশিক্ষণের ধারকটি একবার চালু করা হয়। ফলস্বরূপ, আপনার কাছে তিনটি বিকল্প রয়েছে:

- নেটিভ লঞ্চার - আপনি একটি এন্ট্রি পয়েন্ট হিসাবে একটি নির্দিষ্ট DL ফ্রেমওয়ার্কের নেটিভ লঞ্চার ব্যবহার করতে পারেন, উদাহরণস্বরূপ a

torchrunকল, যা নিজেই একাধিক স্থানীয় প্রক্রিয়া তৈরি করবে এবং বিভিন্ন দৃষ্টান্ত জুড়ে যোগাযোগ স্থাপন করবে। - সেজমেকার এমপিআই ইন্টিগ্রেশন - আপনি SageMaker MPI ইন্টিগ্রেশন ব্যবহার করতে পারেন, আমাদের AWS DLC-তে উপলব্ধ, অথবা এর মাধ্যমে স্ব-ইনস্টলযোগ্য সেজমেকার-ট্রেনিং-টুলকিট, প্রতি মেশিনে আপনার এন্ট্রি পয়েন্ট কোড N বার সরাসরি চালানোর জন্য। আপনার নিজের কোডে মধ্যস্থতাকারী, ফ্রেমওয়ার্ক-নির্দিষ্ট লঞ্চার স্ক্রিপ্টের ব্যবহার এড়ানোর সুবিধা রয়েছে।

- সেজমেকার লাইব্রেরি বিতরণ করেছে - আপনি যদি সেজমেকার বিতরণকৃত লাইব্রেরি ব্যবহার করেন, আপনি প্রশিক্ষণ কোডের উপর ফোকাস করতে পারেন এবং লঞ্চার কোড লিখতে হবে না! SageMaker বিতরণ করা লঞ্চার কোড SageMaker SDK-এ অন্তর্নির্মিত।

ইন্টার-জব অর্কেস্ট্রেশন

এলএলএম প্রকল্পে প্রায়ই একাধিক কাজ থাকে: প্যারামিটার অনুসন্ধান, স্কেলিং পরীক্ষা, ত্রুটি থেকে পুনরুদ্ধার এবং আরও অনেক কিছু। প্রশিক্ষণের কাজগুলি শুরু করতে, থামাতে এবং সমান্তরাল করার জন্য, একজন জব অর্কেস্ট্রেটর ব্যবহার করা গুরুত্বপূর্ণ। সেজমেকার ট্রেনিং হল একটি সার্ভারবিহীন এমএল জব অর্কেস্ট্রেটর যা অনুরোধের সাথে সাথেই ক্ষণস্থায়ী গণনা দৃষ্টান্তের ব্যবস্থা করে। আপনি যা ব্যবহার করেন তার জন্যই আপনি অর্থ প্রদান করেন এবং আপনার কোড শেষ হওয়ার সাথে সাথে ক্লাস্টারগুলি বাতিল হয়ে যায়। সঙ্গে SageMaker প্রশিক্ষণ উষ্ণ পুল, আপনার কাছে প্রশিক্ষণ ক্লাস্টারগুলিতে একটি সময়-টু-লাইভ সংজ্ঞায়িত করার বিকল্প রয়েছে, যাতে চাকরি জুড়ে একই পরিকাঠামো পুনরায় ব্যবহার করা যায়। এটি পুনরাবৃত্তির সময় এবং আন্তঃ-চাকরীর স্থান নির্ধারণের পরিবর্তনশীলতা হ্রাস করে। সেজমেকার কাজগুলি বিভিন্ন প্রোগ্রামিং ভাষা থেকে শুরু করা যেতে পারে, সহ পাইথন এবং CLI.

একটি SageMaker-নির্দিষ্ট Python SDK বলা হয় সেজমেকার পাইথন এসডিকে এবং এর মাধ্যমে বাস্তবায়িত হয় ঋষি নির্মাতা পাইথন লাইব্রেরি, তবে এর ব্যবহার ঐচ্ছিক।

একটি বড় এবং দীর্ঘ প্রশিক্ষণ ক্লাস্টার সহ প্রশিক্ষণের চাকরির জন্য কোটা বৃদ্ধি করা

সেজমেকারের সম্পদের উপর ডিফল্ট কোটা রয়েছে, যা অনিচ্ছাকৃত ব্যবহার এবং খরচ প্রতিরোধ করার জন্য ডিজাইন করা হয়েছে। দীর্ঘ সময় ধরে চলমান হাই-এন্ড উদাহরণগুলির একটি বড় ক্লাস্টার ব্যবহার করে একটি LLM প্রশিক্ষণের জন্য, আপনাকে সম্ভবত নিম্নলিখিত সারণীতে কোটা বাড়াতে হবে।

| কোটার নাম | ডিফল্ট মান |

| একটি প্রশিক্ষণ কাজের জন্য দীর্ঘতম রান সময় | 432,000 সেকেন্ড |

| সমস্ত প্রশিক্ষণের কাজ জুড়ে উদাহরণের সংখ্যা | 4 |

| প্রশিক্ষণ কাজের প্রতি সর্বাধিক দৃষ্টান্ত | 20 |

| প্রশিক্ষণ কাজের ব্যবহারের জন্য ml.p4d.24xlarge | 0 |

| উষ্ণ পুল ব্যবহার প্রশিক্ষণের জন্য ml.p4d.24xlarge | 0 |

দেখ AWS পরিষেবা কোটা কিভাবে আপনার কোটার মান দেখুন এবং একটি কোটা বৃদ্ধির অনুরোধ করবেন। অন-ডিমান্ড, স্পট ইনস্ট্যান্স, এবং প্রশিক্ষণের উষ্ণ পুল কোটাগুলি আলাদাভাবে ট্র্যাক এবং পরিবর্তিত হয়।

আপনি যদি সেজমেকার প্রোফাইলার সক্রিয় রাখার সিদ্ধান্ত নেন, তবে সচেতন থাকুন যে প্রতিটি প্রশিক্ষণের কাজ একটি সেজমেকার প্রসেসিং কাজ চালু করে, প্রতিটি একটি ml.m5.2x বড় উদাহরণ ব্যবহার করে। নিশ্চিত করুন যে আপনার সেজমেকার প্রসেসিং কোটা প্রত্যাশিত প্রশিক্ষণের চাকরির সঙ্গতি মিটমাট করার জন্য যথেষ্ট বেশি। উদাহরণ স্বরূপ, আপনি যদি একযোগে চলমান 50টি প্রোফাইলার-সক্ষম প্রশিক্ষণের কাজ চালু করতে চান, তাহলে কাজের ব্যবহারের সীমা প্রক্রিয়াকরণের জন্য আপনাকে ml.m5.2xlarge বাড়াতে হবে।

উপরন্তু, একটি দীর্ঘ-চলমান কাজ চালু করতে, আপনাকে স্পষ্টভাবে সেট করতে হবে মূল্নির্ধারক max_run সেকেন্ডের মধ্যে প্রশিক্ষণ কাজের জন্য কাঙ্ক্ষিত সর্বোচ্চ সময়কালের প্যারামিটার, একটি প্রশিক্ষণ কাজের জন্য দীর্ঘতম রানটাইমের কোটা মান পর্যন্ত।

পর্যবেক্ষণ এবং স্থিতিস্থাপকতা

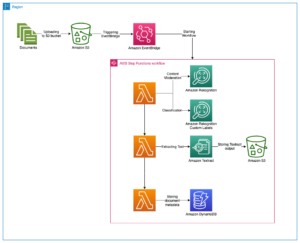

হার্ডওয়্যার ব্যর্থতা একটি একক দৃষ্টান্তের স্কেলে অত্যন্ত বিরল এবং একই সাথে ব্যবহৃত দৃষ্টান্তের সংখ্যা বৃদ্ধির সাথে সাথে এটি আরও ঘন ঘন হয়ে ওঠে। সাধারণ LLM স্কেলে - কয়েক সপ্তাহ থেকে কয়েক মাস ধরে 24/7 ব্যবহার করা হয়েছে - হার্ডওয়্যার ব্যর্থতা প্রায় নিশ্চিত। অতএব, একটি LLM কাজের চাপকে অবশ্যই যথাযথ পর্যবেক্ষণ এবং স্থিতিস্থাপকতা প্রক্রিয়া বাস্তবায়ন করতে হবে। প্রথমত, LLM পরিকাঠামো নিবিড়ভাবে পর্যবেক্ষণ করা, ব্যর্থতার প্রভাব সীমিত করতে এবং গণনা সংস্থানগুলির ব্যবহারকে অপ্টিমাইজ করা গুরুত্বপূর্ণ। সেজমেকার ট্রেনিং এই উদ্দেশ্যে বেশ কয়েকটি বৈশিষ্ট্য প্রস্তাব করে:

- লগগুলি স্বয়ংক্রিয়ভাবে CloudWatch লগগুলিতে পাঠানো হয়৷ লগ আপনার প্রশিক্ষণ স্ক্রিপ্ট অন্তর্ভুক্ত

stdoutএবংstderr. MPI-ভিত্তিক বিতরণকৃত প্রশিক্ষণে, সমস্ত MPI কর্মী তাদের লগ লিডার প্রক্রিয়ায় পাঠায়। - সিস্টেম রিসোর্স ইউটিলাইজেশন মেট্রিক্স যেমন মেমরি, CPU ব্যবহার এবং GPU ব্যবহার, স্বয়ংক্রিয়ভাবে CloudWatch-এ পাঠানো হয়।

- আপনি কাস্টম প্রশিক্ষণ মেট্রিক্স সংজ্ঞায়িত করুন যে CloudWatch পাঠানো হবে. আপনার সেট করা রেগুলার এক্সপ্রেশনের উপর ভিত্তি করে লগ থেকে মেট্রিক্স ক্যাপচার করা হয়। থার্ড-পার্টি এক্সপেরিমেন্ট প্যাকেজ যেমন AWS অংশীদার অফার করা ওজন এবং পক্ষপাতগুলি সেজমেকার প্রশিক্ষণের সাথে ব্যবহার করা যেতে পারে (উদাহরণস্বরূপ, দেখুন W&B এবং SageMaker-এর সাথে CIFAR-10 হাইপারপ্যারামিটার অপ্টিমাইজ করা).

- সেজমেকার প্রোফাইলার আপনাকে অবকাঠামো ব্যবহার পরিদর্শন করতে এবং অপ্টিমাইজেশান সুপারিশ পেতে অনুমতি দেয়।

- অ্যামাজন ইভেন্টব্রিজ এবং এডাব্লুএস ল্যাম্বদা কাজের ব্যর্থতা, সাফল্য, S3 ফাইল আপলোড এবং আরও অনেক কিছুর মতো ইভেন্টগুলিতে প্রতিক্রিয়া করে স্বয়ংক্রিয় ক্লায়েন্ট লজিক তৈরি করার অনুমতি দেয়।

- সেজমেকার এসএসএইচ হেল্পার একটি সম্প্রদায়-রক্ষণাবেক্ষণ করা ওপেন-সোর্স লাইব্রেরি যা আপনাকে SSH-এর মাধ্যমে প্রশিক্ষণ কাজের হোস্টদের সাথে সংযোগ করার অনুমতি দেয়। নির্দিষ্ট নোডগুলিতে কোড চালানো পরিদর্শন এবং সমস্যা সমাধানের জন্য এটি সহায়ক হতে পারে।

মনিটরিং ছাড়াও, SageMaker কাজের স্থিতিস্থাপকতার জন্য সরঞ্জামও নিয়ে আসে:

- ক্লাস্টার স্বাস্থ্য পরীক্ষা - আপনার কাজ শুরু করার আগে, SageMaker GPU স্বাস্থ্য পরীক্ষা চালায় এবং GPU দৃষ্টান্তে NCCL যোগাযোগ যাচাই করে, আপনার প্রশিক্ষণের স্ক্রিপ্টটি দৃষ্টান্তের একটি সুস্থ ক্লাস্টারে চলতে শুরু করে তা নিশ্চিত করার জন্য প্রয়োজনে কোনো ত্রুটিপূর্ণ ঘটনা প্রতিস্থাপন করে। স্বাস্থ্য পরীক্ষা বর্তমানে P এবং G GPU-ভিত্তিক দৃষ্টান্ত প্রকারের জন্য সক্ষম।

- অন্তর্নির্মিত পুনরায় চেষ্টা এবং ক্লাস্টার আপডেট - আপনি সেজমেকারকে স্বয়ংক্রিয়ভাবে কনফিগার করতে পারেন পুনরায় চেষ্টা করা সেজমেকার অভ্যন্তরীণ সার্ভার ত্রুটি (ISE) এর সাথে ব্যর্থ হওয়া প্রশিক্ষণের কাজ। একটি কাজের পুনঃপ্রচেষ্টার অংশ হিসাবে, SageMaker যেকোন দৃষ্টান্তগুলিকে প্রতিস্থাপন করবে যা পুনরুদ্ধারযোগ্য GPU ত্রুটির সম্মুখীন হয়েছে তা নতুন দৃষ্টান্তের সাথে, সমস্ত সুস্থ দৃষ্টান্ত পুনরায় বুট করবে এবং আবার কাজ শুরু করবে। এর ফলে দ্রুত রিস্টার্ট হয় এবং কাজের চাপ শেষ হয়। ক্লাস্টার আপডেট বর্তমানে P এবং G GPU-ভিত্তিক দৃষ্টান্ত প্রকারের জন্য সক্ষম। আপনি আপনার নিজের মধ্যে যোগ করতে পারেন প্রয়োগমূলক পুনঃপ্রচেষ্টা প্রক্রিয়া ক্লায়েন্ট কোডের আশেপাশে যে কাজটি জমা দেয়, অন্য ধরনের লঞ্চ ত্রুটিগুলি পরিচালনা করতে, যেমন আপনার অ্যাকাউন্টের কোটা অতিক্রম করা।

- অটোমেটেড Amazon S3-এ চেকপয়েন্ট - এটি আপনাকে সাহায্য করে চেক্পইণ্ট আপনার অগ্রগতি এবং নতুন চাকরিতে অতীতের অবস্থা পুনরায় লোড করুন।

নোড-স্তরের প্রতিস্থাপন থেকে উপকৃত হতে, আপনার কোড অবশ্যই ত্রুটি। একটি নোড ব্যর্থ হলে সমষ্টিগুলি ত্রুটির পরিবর্তে হ্যাং হতে পারে। অতএব, প্রম্পট রিমেডিয়েশনের জন্য, আপনার সমষ্টিতে সঠিকভাবে একটি টাইমআউট সেট করুন এবং কোডটি পৌঁছে গেলে একটি ত্রুটি ছুঁড়তে দিন।

কিছু গ্রাহক কাজ হ্যাং বা অ্যাপ্লিকেটিভ কনভারজেন্স বন্ধের ক্ষেত্রে নিরীক্ষণ এবং কাজ করার জন্য একটি মনিটরিং ক্লায়েন্ট সেট আপ করে, ক্লাউডওয়াচ লগ এবং অস্বাভাবিক প্যাটার্নগুলির জন্য মেট্রিক্স পর্যবেক্ষণ করে যেমন কোনও লগ লেখা নেই বা হ্যাং, কনভারজেন্স স্টপিং এবং স্বয়ংক্রিয়তার জন্য ইঙ্গিত দেওয়ার জন্য 0% GPU ব্যবহার। কাজ বন্ধ করুন/পুনরায় চেষ্টা করুন।

চেকপয়েন্টিং উপর গভীর ডুব

সার্জারির সেজমেকার চেকপয়েন্ট বৈশিষ্ট্য আপনি লিখুন সবকিছু অনুলিপি /opt/ml/checkpoints Amazon S3-এ ফিরে যান যেমন URI-তে উল্লেখ করা হয়েছে checkpoint_s3_uri SDK প্যারামিটার। যখন একটি কাজ শুরু হয় বা পুনঃসূচনা হয়, তখন সেই URI-তে লেখা সবকিছুই সমস্ত মেশিনে ফেরত পাঠানো হয়, এ /opt/ml/checkpoints. এটি সুবিধাজনক যদি আপনি সমস্ত নোডের সমস্ত চেকপয়েন্টগুলিতে অ্যাক্সেস পেতে চান তবে স্কেলে — যখন আপনার কাছে অনেকগুলি মেশিন বা অনেক ঐতিহাসিক চেকপয়েন্ট থাকে, এটি অ্যামাজন S3-এ দীর্ঘ ডাউনলোড সময় এবং খুব বেশি ট্রাফিকের দিকে পরিচালিত করতে পারে। অতিরিক্তভাবে, টেনসর এবং পাইপলাইন সমান্তরালে, কর্মীদের চেকপয়েন্টেড মডেলের শুধুমাত্র একটি ভগ্নাংশ প্রয়োজন, পুরোটাই নয়। আপনি যদি এই সীমাবদ্ধতার মুখোমুখি হন, আমরা নিম্নলিখিত বিকল্পগুলি সুপারিশ করি:

- দীপ্তির জন্য FSx-এ চেকপয়েন্টিং - হাই-পারফরম্যান্স র্যান্ডম I/O এর জন্য ধন্যবাদ, আপনি আপনার পছন্দের শার্ডিং এবং ফাইল অ্যাট্রিবিউশন স্কিম সংজ্ঞায়িত করতে পারেন

- স্ব-পরিচালিত Amazon S3 চেকপয়েন্টিং - পাইথন ফাংশনগুলির উদাহরণের জন্য যা একটি নন-ব্লকিং ফ্যাশনে চেকপয়েন্টগুলি সংরক্ষণ এবং পড়তে ব্যবহার করা যেতে পারে, পড়ুন চেকপয়েন্ট সংরক্ষণ

আমরা দৃঢ়ভাবে প্রতি কয়েক ঘন্টা আপনার মডেল চেকপয়েন্ট করার পরামর্শ দিই, উদাহরণস্বরূপ 1-3 ঘন্টা, সংশ্লিষ্ট ওভারহেড এবং খরচের উপর নির্ভর করে।

ফ্রন্ট এন্ড এবং ইউজার ম্যানেজমেন্ট

লিগ্যাসি শেয়ার্ড এইচপিসি অবকাঠামোর তুলনায় ইউজার ম্যানেজমেন্ট সেজমেকারের একটি মূল ব্যবহারযোগ্যতা শক্তি। সেজমেকার প্রশিক্ষণের অনুমতিগুলি বেশ কয়েকটি দ্বারা শাসিত হয় এডাব্লুএস আইডেন্টিটি এবং অ্যাক্সেস ম্যানেজমেন্ট (IAM) বিমূর্ততা:

- প্রিন্সিপাল-ব্যবহারকারী এবং সিস্টেম-কে সংস্থান চালু করার অনুমতি দেওয়া হয়

- প্রশিক্ষণের কাজগুলি নিজেরাই ভূমিকা পালন করে, যা তাদের নিজস্ব অনুমতির অনুমতি দেয়, উদাহরণস্বরূপ ডেটা অ্যাক্সেস এবং পরিষেবা আহ্বান সংক্রান্ত

উপরন্তু, 2022 সালে আমরা যোগ করেছি সেজমেকার রোল ম্যানেজার ব্যক্তি-চালিত অনুমতি তৈরির সুবিধার্থে।

উপসংহার

সেজমেকার প্রশিক্ষণের মাধ্যমে, আপনি খরচ কমাতে পারেন এবং আপনার বড়-মডেল প্রশিক্ষণ কাজের চাপে পুনরাবৃত্তির গতি বাড়াতে পারেন। আমরা অসংখ্য পোস্ট এবং কেস স্টাডিতে সাফল্যের গল্প নথিভুক্ত করেছি, যার মধ্যে রয়েছে:

আপনি যদি আপনার খরচ কমানোর সাথে সাথে আপনার এলএলএম টাইম-টু-মার্কেট উন্নত করতে চান, তাহলে সেজমেকার ট্রেনিং এপিআই দেখুন এবং আপনি কী তৈরি করছেন তা আমাদের জানান!

আমর রাগব, রাশিকা খেরিয়া, ঝমনাকো আওরাহমান, অরুণ নাগরাজন, গাল ওশ্রীকে তাদের সহায়ক পর্যালোচনা এবং শিক্ষার জন্য বিশেষ ধন্যবাদ।

লেখক সম্পর্কে

আনাস্তাসিয়া জেভেলেকা AWS-এর একজন মেশিন লার্নিং এবং এআই স্পেশালিস্ট সলিউশন আর্কিটেক্ট। তিনি EMEA-তে গ্রাহকদের সাথে কাজ করেন এবং AWS পরিষেবাগুলি ব্যবহার করে স্কেলে মেশিন লার্নিং সমাধানগুলিকে আর্কিটেক্ট করতে সাহায্য করেন৷ তিনি ন্যাচারাল ল্যাঙ্গুয়েজ প্রসেসিং (NLP), MLOps এবং লো কোড নো কোড টুল সহ বিভিন্ন ডোমেনে প্রকল্পে কাজ করেছেন।

আনাস্তাসিয়া জেভেলেকা AWS-এর একজন মেশিন লার্নিং এবং এআই স্পেশালিস্ট সলিউশন আর্কিটেক্ট। তিনি EMEA-তে গ্রাহকদের সাথে কাজ করেন এবং AWS পরিষেবাগুলি ব্যবহার করে স্কেলে মেশিন লার্নিং সমাধানগুলিকে আর্কিটেক্ট করতে সাহায্য করেন৷ তিনি ন্যাচারাল ল্যাঙ্গুয়েজ প্রসেসিং (NLP), MLOps এবং লো কোড নো কোড টুল সহ বিভিন্ন ডোমেনে প্রকল্পে কাজ করেছেন।

গিলি নাছুম একজন সিনিয়র AI/ML স্পেশালিস্ট সলিউশন আর্কিটেক্ট যিনি EMEA Amazon Machine Learning দলের অংশ হিসেবে কাজ করেন। গিলি গভীর শিক্ষার মডেল প্রশিক্ষণের চ্যালেঞ্জগুলি এবং আমরা জানি যে কীভাবে মেশিন লার্নিং বিশ্বকে পরিবর্তন করছে সে সম্পর্কে উত্সাহী। অবসর সময়ে, গিলি টেবিল টেনিস খেলা উপভোগ করেন।

গিলি নাছুম একজন সিনিয়র AI/ML স্পেশালিস্ট সলিউশন আর্কিটেক্ট যিনি EMEA Amazon Machine Learning দলের অংশ হিসেবে কাজ করেন। গিলি গভীর শিক্ষার মডেল প্রশিক্ষণের চ্যালেঞ্জগুলি এবং আমরা জানি যে কীভাবে মেশিন লার্নিং বিশ্বকে পরিবর্তন করছে সে সম্পর্কে উত্সাহী। অবসর সময়ে, গিলি টেবিল টেনিস খেলা উপভোগ করেন।

অলিভিয়ার ক্রুচ্যান্ট ফ্রান্সে অবস্থিত AWS-এর একজন প্রধান মেশিন লার্নিং স্পেশালিস্ট সলিউশন আর্কিটেক্ট। অলিভিয়ার AWS গ্রাহকদের সাহায্য করে - ছোট স্টার্টআপ থেকে শুরু করে বড় উদ্যোগ পর্যন্ত - প্রোডাকশন-গ্রেড মেশিন লার্নিং অ্যাপ্লিকেশনগুলি বিকাশ এবং স্থাপন করতে। তার অবসর সময়ে, তিনি গবেষণাপত্র পড়তে এবং বন্ধু এবং পরিবারের সাথে মরুভূমি অন্বেষণ উপভোগ করেন।

অলিভিয়ার ক্রুচ্যান্ট ফ্রান্সে অবস্থিত AWS-এর একজন প্রধান মেশিন লার্নিং স্পেশালিস্ট সলিউশন আর্কিটেক্ট। অলিভিয়ার AWS গ্রাহকদের সাহায্য করে - ছোট স্টার্টআপ থেকে শুরু করে বড় উদ্যোগ পর্যন্ত - প্রোডাকশন-গ্রেড মেশিন লার্নিং অ্যাপ্লিকেশনগুলি বিকাশ এবং স্থাপন করতে। তার অবসর সময়ে, তিনি গবেষণাপত্র পড়তে এবং বন্ধু এবং পরিবারের সাথে মরুভূমি অন্বেষণ উপভোগ করেন।

ব্রুনো পিস্টোন মিলান ভিত্তিক AWS-এর জন্য একজন AI/ML বিশেষজ্ঞ সমাধান স্থপতি৷ তিনি যেকোন আকারের গ্রাহকদের সাথে তাদের প্রযুক্তিগত চাহিদাগুলি গভীরভাবে বুঝতে এবং AI এবং মেশিন লার্নিং সমাধানগুলি ডিজাইন করতে সাহায্য করার জন্য কাজ করেন যা AWS ক্লাউড এবং Amazon মেশিন লার্নিং স্ট্যাকের সর্বোত্তম ব্যবহার করে৷ তার দক্ষতার ক্ষেত্র হল মেশিন লার্নিং এন্ড টু এন্ড, মেশিন লার্নিং ইন্ডাস্ট্রিয়ালাইজেশন এবং MLOps। তিনি তার বন্ধুদের সাথে সময় কাটাতে এবং নতুন জায়গা অন্বেষণের পাশাপাশি নতুন গন্তব্যে ভ্রমণ উপভোগ করেন।

ব্রুনো পিস্টোন মিলান ভিত্তিক AWS-এর জন্য একজন AI/ML বিশেষজ্ঞ সমাধান স্থপতি৷ তিনি যেকোন আকারের গ্রাহকদের সাথে তাদের প্রযুক্তিগত চাহিদাগুলি গভীরভাবে বুঝতে এবং AI এবং মেশিন লার্নিং সমাধানগুলি ডিজাইন করতে সাহায্য করার জন্য কাজ করেন যা AWS ক্লাউড এবং Amazon মেশিন লার্নিং স্ট্যাকের সর্বোত্তম ব্যবহার করে৷ তার দক্ষতার ক্ষেত্র হল মেশিন লার্নিং এন্ড টু এন্ড, মেশিন লার্নিং ইন্ডাস্ট্রিয়ালাইজেশন এবং MLOps। তিনি তার বন্ধুদের সাথে সময় কাটাতে এবং নতুন জায়গা অন্বেষণের পাশাপাশি নতুন গন্তব্যে ভ্রমণ উপভোগ করেন।

- এসইও চালিত বিষয়বস্তু এবং পিআর বিতরণ। আজই পরিবর্ধিত পান।

- প্লেটোব্লকচেন। Web3 মেটাভার্স ইন্টেলিজেন্স। জ্ঞান প্রসারিত. এখানে প্রবেশ করুন.

- উত্স: https://aws.amazon.com/blogs/machine-learning/training-large-language-models-on-amazon-sagemaker-best-practices/

- : হয়

- [পৃ

- $ ইউপি

- 000

- 1

- 100

- 2022

- 7

- 8

- a

- A100

- ক্ষমতার

- সক্ষম

- সম্পর্কে

- উপরে

- দ্রুততর করা

- দ্রুততর

- প্রবেশ

- মিটমাট করা

- হিসাব

- অর্জন করা

- অর্জনের

- দিয়ে

- আইন

- সক্রিয়করণ

- সক্রিয়

- খাপ খাওয়ানো

- যোগ

- যোগ

- উপরন্তু

- সংযোজন

- সুবিধা

- AI

- এআই / এমএল

- AL

- অ্যালগরিদম

- আলগোরিদিম

- সব

- অনুমতি

- অনুমতি

- মর্দানী স্ত্রীলোক

- আমাজন EC2

- অ্যামাজন এফএসএক্স

- অ্যামাজন মেশিন লার্নিং

- আমাজন সেজমেকার

- পরিমাণ

- এবং

- API

- API গুলি

- প্রাসঙ্গিক

- আবেদন

- অ্যাপ্লিকেশন

- ফলিত

- যথাযথ

- রয়েছি

- এলাকায়

- কাছাকাছি

- AS

- যুক্ত

- At

- সংযুক্ত

- বৈশিষ্ট্যাবলী

- গাড়ী

- অটোমেটেড

- স্বয়ংক্রিয়ভাবে

- সহজলভ্য

- এড়াতে

- এড়ানো

- ডেস্কটপ AWS

- পিছনে

- ব্যাক-এন্ড

- ভারসাম্য

- ভিত্তি

- BE

- কারণ

- হয়ে

- আগে

- হচ্ছে

- সুবিধা

- সর্বোত্তম

- সেরা অভ্যাস

- তার পরেও

- বিশাল

- বিলিয়ন

- কোটি কোটি

- বাধা

- আনা

- আনে

- নির্মাণ করা

- নির্মিত

- ব্যবসায়

- by

- কল

- নামক

- কল

- CAN

- সক্ষম

- ধারণক্ষমতা

- কার্ড

- কার্ড

- বহন

- কেস

- কেস স্টাডিজ

- অনুঘটক

- চ্যালেঞ্জ

- পরিবর্তন

- চ্যানেল

- চেক

- চেক

- পছন্দ

- পছন্দ

- বেছে নিন

- ক্লাস

- মক্কেল

- ঘনিষ্ঠভাবে

- মেঘ

- গুচ্ছ

- কোড

- সমষ্টিগত

- মিলিত

- আসা

- সাধারণ

- সাধারণভাবে

- যোগাযোগ

- যোগাযোগমন্ত্রী

- তুলনা

- উপযুক্ত

- পরিপূরণ

- গণনা

- গনা

- কম্পিউটার

- কম্পিউটার ভিশন

- কম্পিউটিং

- শেষ করা

- পরিচালিত

- কনফিগারেশন

- নিশ্চিত করা

- সংযোগ করা

- অতএব

- আধার

- কন্টেনারগুলি

- ধারণ

- বিষয়বস্তু

- অবদান রেখেছে

- নিয়ন্ত্রণ

- নিয়ন্ত্রিত

- সুবিধাজনক

- অভিসৃতি

- দুর্নীতি

- মূল্য

- খরচ

- পারা

- পথ

- আবরণ

- কভার

- সিপিইউ

- সৃষ্টি

- সৃষ্টি

- সৃজনী

- সংকটপূর্ণ

- কঠোর

- কিউরেশন

- এখন

- প্রথা

- গ্রাহকদের

- কাস্টমাইজ

- উপাত্ত

- তথ্য এক্সেস

- ডেটা প্রস্তুতি

- ডেটাসেট

- সিদ্ধান্ত নেন

- নিবেদিত

- গভীর

- গভীর জ্ঞানার্জন

- ডিফল্ট

- ডিগ্রী

- নির্ভর করে

- নির্ভর করে

- স্থাপন

- নকশা

- পরিকল্পিত

- গন্তব্যস্থল

- নির্ধারণ

- নির্ণয়

- বিকাশ

- উন্নত

- বিকাশকারী

- ডেভেলপারদের

- উন্নয়ন

- বিকাশ

- যন্ত্র

- ডিভাইস

- বিভিন্ন

- আশ্লেষ

- সরাসরি

- আলোচনা করা

- আলোচনা

- বণ্টিত

- ডিস্ট্রিবিউটেড কম্পিউটিং

- বিতরণ করা প্রশিক্ষণ

- বিতরণ

- ডকশ্রমিক

- ডকার কনটেইনার

- না

- ডোমেইনের

- Dont

- নিচে

- ডাউনলোড

- ডজন

- সময়

- প্রতি

- সহজে

- কার্যকর

- পারেন

- EMEA

- সক্ষম করা

- সক্ষম করা

- সম্ভব

- সক্রিয়

- উত্সাহিত করা

- প্রান্ত

- উন্নত

- ভোগ

- যথেষ্ট

- নিশ্চিত করা

- উদ্যোগ

- উদ্যোগ

- প্রবেশ

- পরিবেশ

- পরিবেশের

- উপকরণ

- সজ্জিত

- ভুল

- ত্রুটি

- স্থাপন করা

- থার (eth)

- এমন কি

- ঘটনাবলী

- চূড়ান্ত

- প্রতি

- সব

- বিবর্তিত

- উদাহরণ

- উদাহরণ

- সীমা অতিক্রম করা

- বিদ্যমান

- আশা করা

- প্রত্যাশিত

- অভিজ্ঞতা

- পরীক্ষা

- এক্সপ্লোরিং

- উদ্ভাসিত

- এক্সপ্রেশন

- ব্যাপ্ত

- এক্সটেনশন

- বহিরাগত

- অত্যন্ত

- ফ্যাব্রিক

- মুখ

- সহজতর করা

- সুবিধা

- কারণের

- ব্যর্থ

- ব্যর্থ

- ব্যর্থতা

- পরিবারের

- পরিবার

- ফ্যাশন

- দ্রুত

- দ্রুত

- ত্রুটিপূর্ণ

- সাধ্য

- বৈশিষ্ট্য

- বৈশিষ্ট্য

- কয়েক

- ক্ষেত্র

- ফাইল

- নথি পত্র

- প্রথম

- ফিট

- ফ্লিট

- নমনীয়তা

- কেন্দ্রবিন্দু

- গুরুত্ত্ব

- অনুসৃত

- অনুসরণ

- জন্য

- ভগ্নাংশ

- ফ্রেমওয়ার্ক

- অবকাঠামো

- ফ্রান্স

- স্বাধীনতা

- ঘন

- তাজা

- বন্ধুদের

- থেকে

- সম্পূর্ণ

- সম্পূর্ণরূপে

- কার্মিক

- কার্যকারিতা

- ক্রিয়াকলাপ

- অধিকতর

- গালা

- উত্পন্ন

- সৃজক

- পাওয়া

- পেয়ে

- GitHub

- প্রদত্ত

- জিপিইউ

- জিপিইউ

- চিত্রলেখ

- মহান

- সর্বাধিক

- গ্রুপ

- বৃদ্ধি

- হাতল

- হ্যান্ডলিং

- খাটান

- ঘটা

- হার্ডওয়্যারের

- আছে

- জমিদারি

- স্বাস্থ্য

- সুস্থ

- সহায়ক

- সাহায্য

- সাহায্য

- উচ্চ

- উচ্চ তরঙ্গ

- উচ্চ পারদর্শিতা

- ঐতিহাসিক

- ঘোমটা

- হোস্ট

- ঘন্টার

- কিভাবে

- কিভাবে

- যাহোক

- এইচপিসি

- এইচটিএমএল

- HTTP

- HTTPS দ্বারা

- শত শত

- শত মিলিয়ন

- i

- আমি

- অভিন্ন

- পরিচয়

- ভাবমূর্তি

- চিত্র

- অবিলম্বে

- প্রভাব

- বাস্তবায়ন

- বাস্তবায়িত

- বাস্তবায়ন

- গুরুত্বপূর্ণ

- উন্নত করা

- উন্নত

- উন্নতি

- in

- অন্যান্য

- অন্তর্ভুক্ত করা

- সুদ্ধ

- বৃদ্ধি

- বর্ধিত

- বৃদ্ধি

- ক্রমবর্ধমানভাবে

- স্বতন্ত্র

- শিল্প

- তথ্য

- তথ্য

- পরিকাঠামো

- ইনোভেশন

- অনুপ্রাণিত

- ইনস্টল

- উদাহরণ

- পরিবর্তে

- সংহত

- ইন্টিগ্রেশন

- বুদ্ধিমান

- মিথষ্ক্রিয়া

- ইন্টারফেস

- মধ্যবর্তী

- অভ্যন্তরীণ

- প্রবর্তন করা

- উপস্থাপিত

- IT

- পুনরাবৃত্তির

- এর

- নিজেই

- কাজ

- জবস

- JPG

- রাখা

- চাবি

- রকম

- জানা

- ভাষা

- ভাষাসমূহ

- বড়

- বড় আকারের

- বৃহত্তর

- সর্বশেষ

- শুরু করা

- চালু

- লঞ্চ

- স্তর

- স্তর

- নেতৃত্ব

- নেতা

- শিক্ষা

- উত্তরাধিকার

- উচ্চতা

- লাইব্রেরি

- লাইব্রেরি

- জীবনচক্র

- মত

- সম্ভবত

- LIMIT টি

- সীমাবদ্ধতা

- সীমিত

- সামান্য

- বোঝাই

- স্থানীয়

- দীর্ঘ

- অনেকক্ষণ

- দেখুন

- খুঁজছি

- কম

- মেশিন

- মেশিন লার্নিং

- যন্ত্রানুবাদ

- মেশিন

- বজায় রাখা

- রক্ষণাবেক্ষণ

- করা

- তৈরি করে

- মেকিং

- পরিচালনা করা

- পরিচালিত

- ব্যবস্থাপনা

- অনেক

- মানচিত্র

- সর্বাধিক

- স্মৃতি

- মেটাডাটা

- পদ্ধতি

- ছন্দোবিজ্ঞান

- অভিপ্রয়াণ

- MILAN

- লক্ষ লক্ষ

- কমান

- ML

- এমএলওএস

- মোড

- মডেল

- মূর্তিনির্মাণ

- মডেল

- পরিবর্তিত

- মনিটর

- পর্যবেক্ষণ

- অধিক

- সেতু

- পদক্ষেপ

- বহু

- যথা

- স্থানীয়

- প্রাকৃতিক

- স্বভাবিক ভাষা

- স্বাভাবিক ভাষা প্রক্রিয়াকরণ

- স্বাভাবিকভাবে

- প্রকৃতি

- অগত্যা

- প্রয়োজনীয়

- প্রয়োজন

- চাহিদা

- নেটওয়ার্ক

- নেটওয়ার্ক ভিত্তিক

- নেটওয়ার্ক

- নিউরাল

- স্নায়বিক নেটওয়ার্ক

- নতুন

- NLP

- নোড

- নোড

- সংখ্যা

- অনেক

- এনভিডিয়া

- বস্তু

- of

- অর্পণ

- নৈবেদ্য

- অলিভিয়ের

- on

- চাহিদা সাপেক্ষে

- ONE

- খোলা

- ওপেন সোর্স

- ওপেন সোর্স কোড

- খোলা

- সুযোগ

- অপ্টিমাইজেশান

- অপ্টিমিজ

- অপ্টিমাইজ

- পছন্দ

- অপশন সমূহ

- অর্কেস্ট্রারচনা

- ক্রম

- অন্যান্য

- নিজের

- প্যাকেজ

- প্যাকেজ

- কাগজ

- কাগজপত্র

- দৃষ্টান্ত

- সমান্তরাল

- স্থিতিমাপ

- পরামিতি

- অংশ

- বিশেষ

- বিশেষত

- কামুক

- গত

- পথ

- নিদর্শন

- বেতন

- পিডিএফ

- শিখর

- কর্মক্ষমতা

- ক্রিয়াকাণ্ড

- অনুমতি

- অনুমতি

- শারীরিক

- পাইপলাইন

- জায়গা

- Plato

- প্লেটো ডেটা ইন্টেলিজেন্স

- প্লেটোডাটা

- কেলি

- বিন্দু

- পুকুর

- পুল

- জনপ্রিয়

- পোস্ট

- পোস্ট

- অনুশীলন

- চর্চা

- পূর্বাভাসের

- পছন্দগুলি

- পছন্দের

- বর্তমান

- উপস্থাপন

- প্রতিরোধ

- পূর্বে

- অধ্যক্ষ

- প্রক্রিয়া

- প্রসেস

- প্রক্রিয়াজাতকরণ

- উৎপাদন করা

- কার্যক্রম

- প্রোগ্রামিং

- প্রোগ্রামিং ভাষা

- উন্নতি

- প্রকল্প

- সঠিকভাবে

- উত্থাপন করা

- প্রস্তাব

- মালিকানা

- প্রোটোকল

- প্রোটোকল

- প্রদান

- প্রদত্ত

- প্রদানকারী

- প্রদানের

- প্রকাশ্য

- প্রকাশনা

- উদ্দেশ্য

- করা

- পাইথন

- পাইটার্চ

- গুণ

- বৃদ্ধি

- এলোমেলো

- বিরল

- হার

- হার

- পৌঁছেছে

- পড়া

- পড়া

- সাধা

- ন্যায্য

- কারণে

- গ্রহণ করা

- সাম্প্রতিক

- সুপারিশ করা

- সুপারিশ

- নথি

- রেকর্ড

- আরোগ্য

- হ্রাস করা

- হ্রাস

- হ্রাস

- সংক্রান্ত

- এলাকা

- অঞ্চল

- নিয়মিত

- নিয়মিতভাবে

- সংশ্লিষ্ট

- প্রাসঙ্গিক

- বিশ্বাসযোগ্য

- নির্ভর করা

- দূরবর্তী

- প্রতিস্থাপন করা

- প্রতিনিধিত্বমূলক

- অনুরোধ

- অনুরোধ

- প্রয়োজন

- প্রয়োজন

- প্রয়োজন

- গবেষণা

- গবেষণা এবং উদ্ভাবন

- সংস্থান

- Resources

- ফলাফল

- পর্যালোচনা

- ভূমিকা

- ভূমিকা

- চালান

- দৌড়

- ঋষি নির্মাতা

- একই

- সংরক্ষণ করুন

- স্কেলেবিলিটি

- মাপযোগ্য

- স্কেল

- দাঁড়িপাল্লা

- আরোহী

- পরিকল্পনা

- বিজ্ঞানীরা

- সুযোগ

- স্ক্রিপ্ট

- SDK

- সার্চ

- দ্বিতীয়

- সেকেন্ড

- অধ্যায়

- সচেষ্ট

- নির্বাচিত

- নির্বাচন

- জ্যেষ্ঠ

- আলাদাভাবে

- Serverless

- সার্ভারের

- সেবা

- সেবা

- সেট

- সেটিংস

- বিভিন্ন

- তীক্ষ্ণ

- শারডিং

- ভাগ

- উচিত

- উল্লেখযোগ্যভাবে

- সহজ

- সরলতা

- যুগপত

- এককালে

- একক

- আয়তন

- মাপ

- দক্ষতা

- ধীর

- ছোট

- So

- সফটওয়্যার

- সলিউশন

- কিছু

- শীঘ্রই

- উৎস

- সোর্স

- ডিম

- বিশেষজ্ঞ

- নির্দিষ্ট

- বিশেষভাবে

- নিদিষ্ট

- স্পীড

- খরচ

- টুকরা

- অকুস্থল

- স্থিতিশীল

- গাদা

- শুরু

- শুরু হচ্ছে

- শুরু

- প্রারম্ভ

- রাষ্ট্র

- পরিসংখ্যানসংক্রান্ত

- প্রারম্ভিক ব্যবহারের নির্দেশাবলী

- থামুন

- বাঁধন

- স্টোরেজ

- দোকান

- খবর

- কৌশল

- প্রবাহ

- স্ট্রিম

- শক্তি

- stripping

- প্রবলভাবে

- গবেষণায়

- সাফল্য

- সাফল্যের গল্প

- সফল

- এমন

- সমর্থন

- সমর্থিত

- সমর্থন

- সিঙ্ক্রোনাইজেশন

- বাক্য গঠন

- পদ্ধতি

- টেবিল

- গ্রহণ করা

- কার্য

- কাজ

- টীম

- কারিগরী

- কারিগরি সহযোগিতা

- টেনিস

- tensorflow

- যে

- সার্জারির

- বিশ্ব

- তাদের

- তাহাদিগকে

- নিজেদের

- তত্ত্বীয়

- অতএব

- এইগুলো

- তৃতীয় পক্ষের

- হাজার হাজার

- তিন

- দ্বারা

- থ্রুপুট

- সময়

- বার

- পরামর্শ

- থেকে

- আজ

- টোকেন

- অত্যধিক

- টুল

- সরঞ্জাম

- শীর্ষ

- মোট

- পথ

- ট্রাফিক

- রেলগাড়ি

- প্রশিক্ষিত

- প্রশিক্ষণ

- অনুবাদ

- পরিবহন

- দশ সহস্রের ত্রিঘাত

- ধরনের

- টিপিক্যাল

- অধীনে

- নিম্নাবস্থিত

- বোঝা

- অনন্য

- ইউনিট

- আপডেট

- কোনো URI

- us

- ব্যবহারযোগ্যতা

- ব্যবহার

- ব্যবহার

- ব্যবহারকারী

- সাধারণত

- মূল্য

- মানগুলি

- ভেরিয়েবল

- বৈচিত্র্য

- বিভিন্ন

- যাচাই

- সংস্করণ

- মাধ্যমে

- ভিডিও

- চেক

- দৃষ্টি

- উষ্ণ

- উপায়..

- উপায়

- সপ্তাহ

- আমরা একটি

- কি

- যে

- যখন

- হু

- ইচ্ছা

- সঙ্গে

- মধ্যে

- ছাড়া

- শব্দ

- হয়া যাই ?

- কাজ করছে

- শ্রমিকদের

- কাজ

- কাজ

- বিশ্ব

- লেখা

- লিখিত

- বছর

- আপনার

- নিজেকে

- ইউটিউব

- zephyrnet