Kommentar Mere end 250 masseskyderier har fundet sted i USA indtil videre i år, og AI-fortalere mener, at de har løsningen. Ikke våbenkontrol, men bedre teknologi, ikke overraskende.

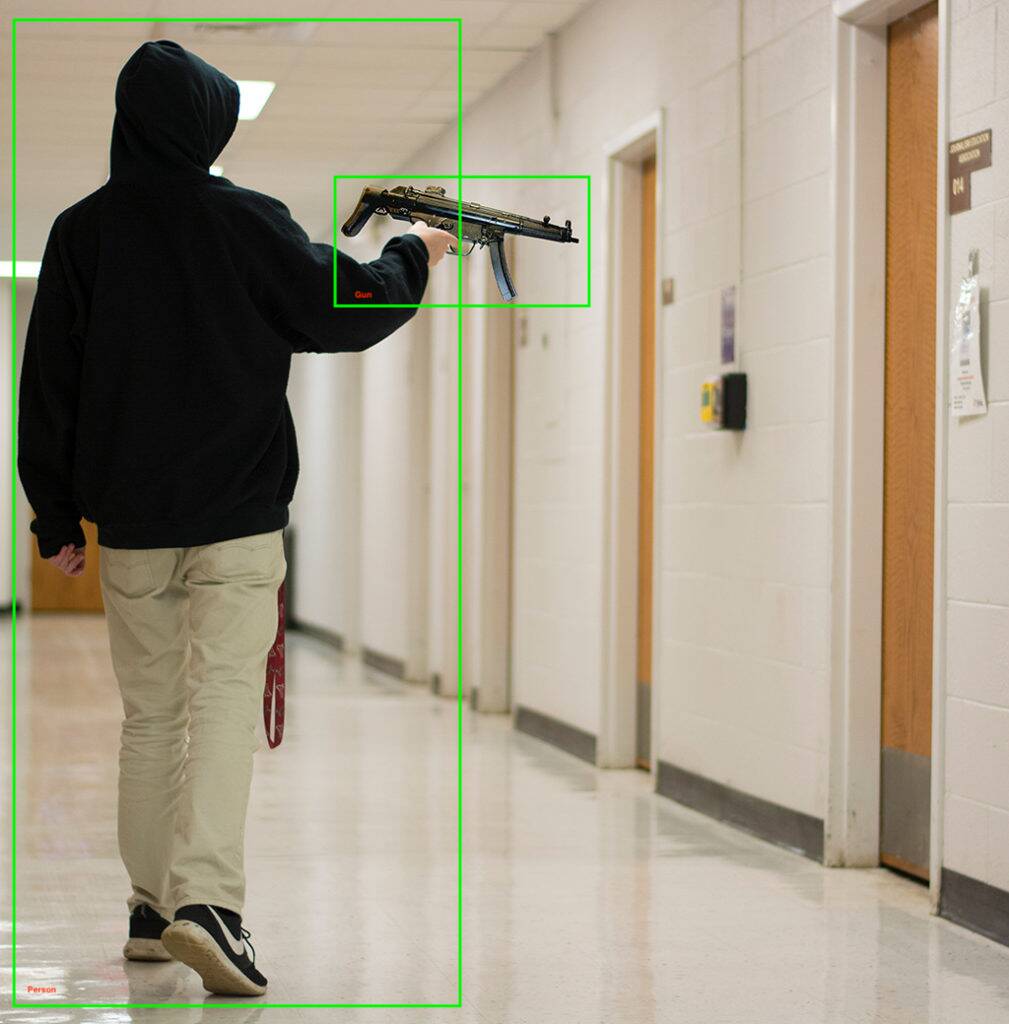

Machine-learning biz Kogniz meddelte tirsdag, at den tilføjede en klar til implementering våbendetektionsmodel til sin computer-vision platform. Systemet, får vi at vide, kan registrere våben set af sikkerhedskameraer og sende meddelelser til dem, der er i fare, underrette politiet, låse bygninger ned og udføre andre sikkerhedsopgaver.

Ud over at opdage skydevåben bruger Kogniz sine andre computer-vision-moduler til at bemærke usædvanlig adfærd, såsom børn, der spurter ned ad gange eller nogen, der klatrer ind gennem et vindue, hvilket kunne indikere en aktiv skytte.

Hvis du undrer dig over kodens falske positive eller fejlrate, siger Kogniz, at den har en "multi-pass AI" og "et trænet hold af menneskelige verifikatorer", der kontrollerer resultaterne af dets detektionssoftware. Enten hilser du det ekstra niveau af bekræftelse velkommen, eller ser det som teknologi, der potentielt falder tilbage på mennesker, lige når der er mest brug for computerne.

"[Vores løsning er] at gøre det dramatisk nemmere for virksomheder, statslige myndigheder, skoler og hospitaler at forberede sig på og derefter hjælpe med at reducere skaden forårsaget af en aktiv skydebegivenhed," sagde Kogniz CEO Daniel Putterman.

Kogniz er ikke den første computer-vision-virksomhed, der kommer ind i våbengenkendelsesspillet - der er en betydelig liste over virksomheder, der anvender lignende teknologi, og nogle, såsom ZeroEyes, specialiserer sig i intet andet end skydevåbendetektion.

"Ved at sprede deres opmærksomhed på flere tilbud, er udviklere mindre i stand til at levere den allerbedste service inden for våbendetektion," sagde ZeroEyes i en blogindlæg. ZeroEyes' teknologi er blevet implementeret på skoler i 14 stater, herunder Oxford High School i metro Detroit, hvor en 15-årig skytte dræbte fire og sårede syv sidste år.

Andre leverandører – såsom Defendry, som har en sikkerhedspakke, der inkluderer en panikknap-app, lyd-pistolskudssensorer, første-responder-droner og våbendetektion AI; og Omnilert – er på dette deprimerende vækstmarked. Yderligere virksomheder inden for AI-våbendetektion omfatter Arcarith, Athena Securities og Scylla.

Er der faktisk tid nok?

I 2019 var politiets reaktion på et masseskyderi i Dayton, Ohio, kun 32 sekunder, hvor ni mennesker døde. Et skyderi i 2021 på et FedEx-anlæg i Indianapolis, der dræbte ni mennesker, var også overstået, før politiet kunne nå frem, selvom de gjorde det på få minutter.

Begge disse tilfælde rejser spørgsmålet om, hvorvidt AI-pistoldetektion kan reducere responstider nok til at redde liv. Især hvis betjentene er for bange eller vælger ikke at svare, som for eksempel ved massemordet på Uvalde.

Der er foreslået flere andre AI-baserede masseskydningsforebyggelsesmetoder, som f.eks smarte våben som ikke vil skyde, hvis de opdager et menneskeligt mål. Andre har foreslået at træne AI'er i data fra tidligere skyderier, lokale våbenkøb og socioøkonomiske data for at finde tendenser, der indikerer et planlagt skyderi, samt at scanne sociale medier for lignende indikatorer.

Der er også AI bias, en veldokumenteret problem at selv forskellige datasæt og afbalanceret træning ikke kan løses. Tag en udrulning af ansigts- og våbengenkendelsesteknologi i 2020 i et skoledistrikt i New York: e-mails mellem skoledistriktet og det firma, der implementerede systemet, viser almindeligvis bekymring over det fejlidentifikation ting, såsom kosteskafter til våben.

I en tale til Utah-publikationen Deseret News, ACLUs seniorpolitikanalytiker Jay Stanley sagde han var bekymret for, at computersynssystemer kunne føre til en verden, "hvor folk undgår at gøre noget så simpelt som at springe ned ad et fortov af frygt for at udløse anomalidetektorer og blive afhørt af politiet."

En mulig brug af kunstig intelligens kan dog have mere lovende: en 2018 studere fra Cincinnati Children's Hospital Medical Center fandt ud af, at AI-analyse af terapisessioner stemte overens med psykiateres og rådgiveres farevurderinger 91 procent af tiden. Tilføjelsen af demografiske og socioøkonomiske data forbedrede kun resultaterne med hensyn til at identificere unge mennesker, der var i fare for at begå en voldelig handling.

Med så mange potentielle komplikationer, er maskinlæring virkelig klar til at forhindre massemord?

Våbenvold er den morder nummer et af børn og teenagere i Amerika, tager i gennemsnit 12 unge liv og sårer 32 flere hver dag. AI kan måske hjælpe, men uden at tage fat på dens mangler, er der måske også behov for mindre teknologiske tilgange. Stærkere, mere udbredt tilgængelig mental sundhedspleje kan være en god start.

Tidligere på måneden, præsident Biden kaldet for blandt andet et forbud mod angrebsvåben, udvidede baggrundstjek og begrænsninger af magasinkapacitet, som han kaldte "rationelle, sunde fornuftsforanstaltninger." ®

- AI

- ai kunst

- ai kunst generator

- en robot

- kunstig intelligens

- certificering af kunstig intelligens

- kunstig intelligens i banksektoren

- kunstig intelligens robot

- kunstig intelligens robotter

- software til kunstig intelligens

- blockchain

- blockchain konference ai

- coingenius

- samtale kunstig intelligens

- kryptokonference ai

- dalls

- dyb læring

- du har google

- machine learning

- plato

- platon ai

- Platon Data Intelligence

- Platon spil

- PlatoData

- platogaming

- skala ai

- syntaks

- Registret

- zephyrnet