Med fremkomsten af generativ AI kan nutidens grundmodeller (FM'er), såsom de store sprogmodeller (LLM'er) Claude 2 og Llama 2, udføre en række generative opgaver såsom besvarelse af spørgsmål, opsummering og skabelse af indhold på tekstdata. Imidlertid eksisterer data fra den virkelige verden i flere modaliteter, såsom tekst, billeder, video og lyd. Tag for eksempel et PowerPoint-diasdæk. Det kunne indeholde information i form af tekst eller indlejret i grafer, tabeller og billeder.

I dette indlæg præsenterer vi en løsning, der bruger multimodale FM'er som f.eks Amazon Titan Multimodal Embeddings model og LLaVA 1.5 og AWS-tjenester, herunder Amazonas grundfjeld , Amazon SageMaker at udføre lignende generative opgaver på multimodale data.

Løsningsoversigt

Løsningen giver en implementering til besvarelse af spørgsmål ved hjælp af information indeholdt i teksten og visuelle elementer i et diasspil. Designet bygger på konceptet Retrieval Augmented Generation (RAG). Traditionelt har RAG været forbundet med tekstdata, der kan behandles af LLM'er. I dette indlæg udvider vi RAG til også at inkludere billeder. Dette giver en kraftfuld søgefunktion til at udtrække kontekstuelt relevant indhold fra visuelle elementer som tabeller og grafer sammen med tekst.

Der er forskellige måder at designe en RAG-løsning, der inkluderer billeder. Vi har præsenteret en tilgang her og vil følge op med en alternativ tilgang i det andet indlæg i denne tredelte serie.

Denne løsning indeholder følgende komponenter:

- Amazon Titan Multimodal Embeddings model – Denne FM bruges til at generere indlejringer til indholdet i slide-dækket, der bruges i dette indlæg. Som en multimodal model kan denne Titan-model behandle tekst, billeder eller en kombination som input og generere indlejringer. Titan Multimodal Embeddings-modellen genererer vektorer (indlejringer) med 1,024 dimensioner og tilgås via Amazon Bedrock.

- Stor sprog- og synsassistent (LLaVA) – LLaVA er en open source multimodal model til visuel og sproglig forståelse og bruges til at fortolke dataene i slides, herunder visuelle elementer som grafer og tabeller. Vi bruger 7-milliarder parameterversionen LLaVA 1.5-7b i denne løsning.

- Amazon SageMaker – LLaVA-modellen er implementeret på et SageMaker-slutpunkt ved hjælp af SageMaker-hostingtjenester, og vi bruger det resulterende slutpunkt til at køre slutninger mod LLaVA-modellen. Vi bruger også SageMaker-notebooks til at orkestrere og demonstrere denne løsning fra ende til anden.

- Amazon OpenSearch Serverløs – OpenSearch Serverless er en on-demand serverløs konfiguration til Amazon OpenSearch Service. Vi bruger OpenSearch Serverless som en vektordatabase til lagring af indlejringer genereret af Titan Multimodal Embeddings-modellen. Et indeks oprettet i OpenSearch Serverless-samlingen fungerer som vektorlageret for vores RAG-løsning.

- Amazon OpenSearch Ingestion (OSI) – OSI er en fuldt administreret, serverløs dataindsamler, der leverer data til OpenSearch Service-domæner og OpenSearch Serverless-samlinger. I dette indlæg bruger vi en OSI-pipeline til at levere data til OpenSearch Serverless vektorlager.

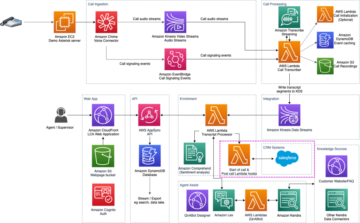

Løsningsarkitektur

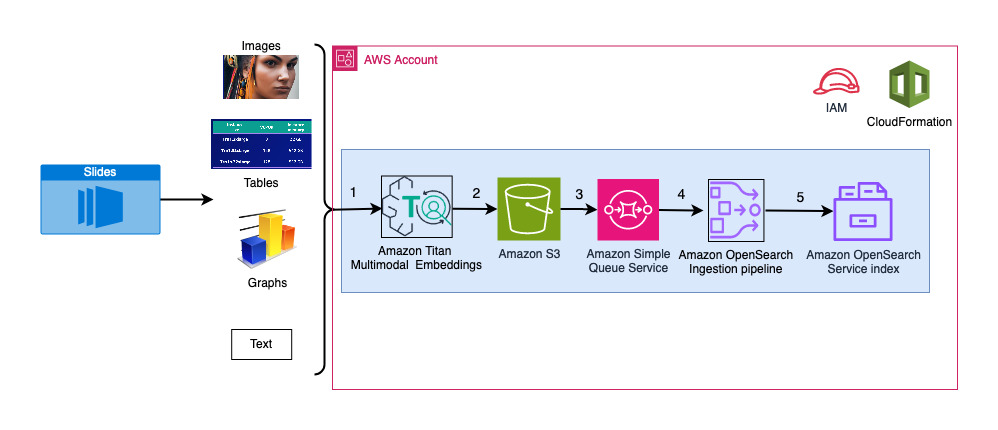

Løsningsdesignet består af to dele: indtagelse og brugerinteraktion. Under indtagelse behandler vi input-dias-dækket ved at konvertere hvert dias til et billede, genererer indlejringer til disse billeder og udfylder derefter vektordatalageret. Disse trin udføres før brugerinteraktionstrinene.

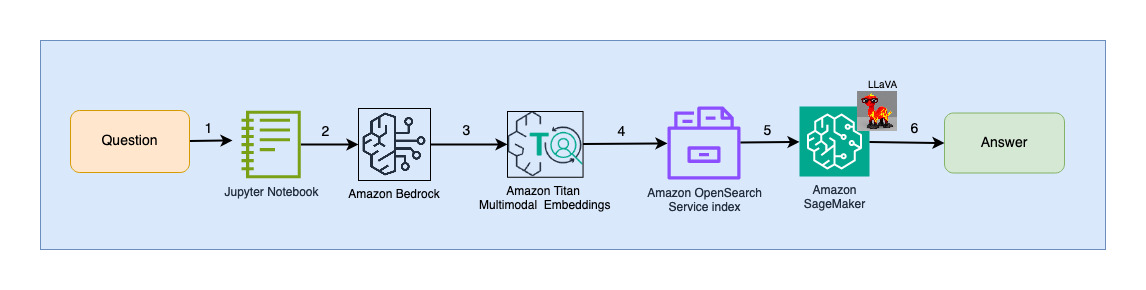

I brugerinteraktionsfasen konverteres et spørgsmål fra brugeren til indlejringer, og der køres en lighedssøgning på vektordatabasen for at finde et slide, der potentielt kan indeholde svar på brugerspørgsmål. Vi leverer derefter dette dias (i form af en billedfil) til LLaVA-modellen og brugerspørgsmålet som en prompt for at generere et svar på forespørgslen. Al koden til dette indlæg er tilgængelig i GitHub hvile.

Følgende diagram illustrerer indtagelsesarkitekturen.

Workflow-trinene er som følger:

- Slides konverteres til billedfiler (én pr. slide) i JPG-format og overføres til Titan Multimodal Embeddings-modellen for at generere indlejringer. I dette indlæg bruger vi slide-dækket med titlen Træn og implementer stabil diffusion ved hjælp af AWS Trainium & AWS Inferentia fra AWS-topmødet i Toronto, juni 2023, for at demonstrere løsningen. Prøvedækket har 31 dias, så vi genererer 31 sæt vektorindlejringer, hver med 1,024 dimensioner. Vi tilføjer yderligere metadatafelter til disse genererede vektorindlejringer og opretter en JSON-fil. Disse ekstra metadatafelter kan bruges til at udføre omfattende søgeforespørgsler ved hjælp af OpenSearchs kraftfulde søgefunktioner.

- De genererede indlejringer sættes sammen i en enkelt JSON-fil, der uploades til Amazon Simple Storage Service (Amazon S3).

- Via Amazon S3-begivenhedsmeddelelser, sættes en begivenhed i en Amazon Simple Queue Service (Amazon SQS) kø.

- Denne hændelse i SQS-køen fungerer som en trigger til at køre OSI-pipelinen, som igen indtager dataene (JSON-filen) som dokumenter i OpenSearch Serverless-indekset. Bemærk, at OpenSearch Serverless-indekset er konfigureret som sink for denne pipeline og oprettes som en del af OpenSearch Serverless-samlingen.

Følgende diagram illustrerer brugerinteraktionsarkitekturen.

Workflow-trinene er som følger:

- En bruger indsender et spørgsmål, der er relateret til den diasserie, der er blevet indtaget.

- Brugerinputtet konverteres til indlejringer ved hjælp af Titan Multimodal Embeddings-modellen, der tilgås via Amazon Bedrock. En OpenSearch-vektorsøgning udføres ved hjælp af disse indlejringer. Vi udfører en k-nærmeste nabo (k=1) søgning for at hente den mest relevante indlejring, der matcher brugerforespørgslen. Indstilling k=1 henter det mest relevante slide til brugerspørgsmålet.

- Metadataene for svaret fra OpenSearch Serverless indeholder en sti til billedet, der svarer til det mest relevante slide.

- En prompt oprettes ved at kombinere brugerspørgsmålet og billedstien og leveres til LLaVA hostet på SageMaker. LLaVA-modellen er i stand til at forstå brugerspørgsmålet og besvare det ved at undersøge dataene i billedet.

- Resultatet af denne slutning returneres til brugeren.

Disse trin diskuteres detaljeret i de følgende afsnit. Se den Resultater sektion for skærmbilleder og detaljer om output.

Forudsætninger

For at implementere løsningen i dette indlæg, bør du have en AWS-konto og kendskab til FM'er, Amazon Bedrock, SageMaker og OpenSearch Service.

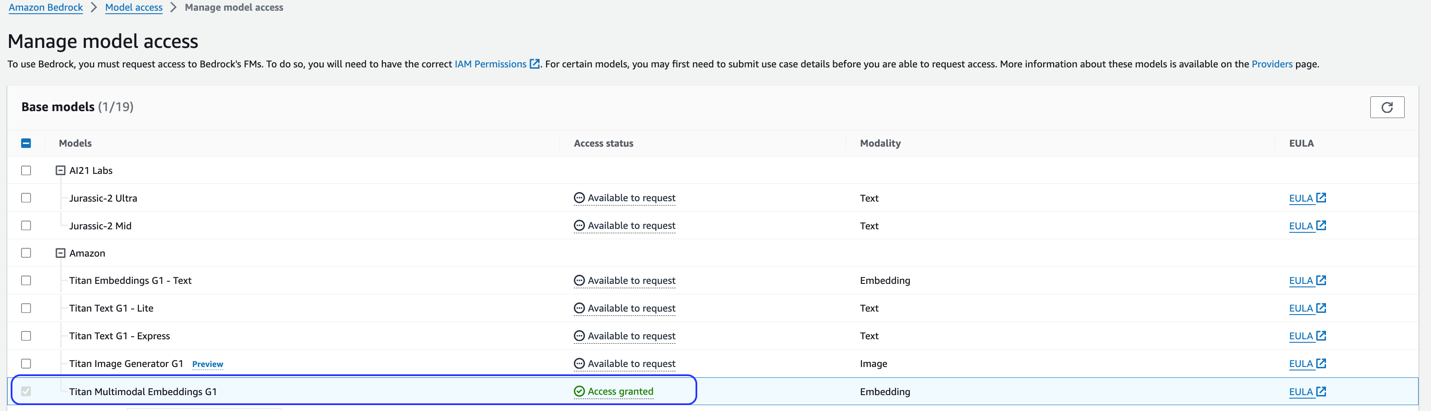

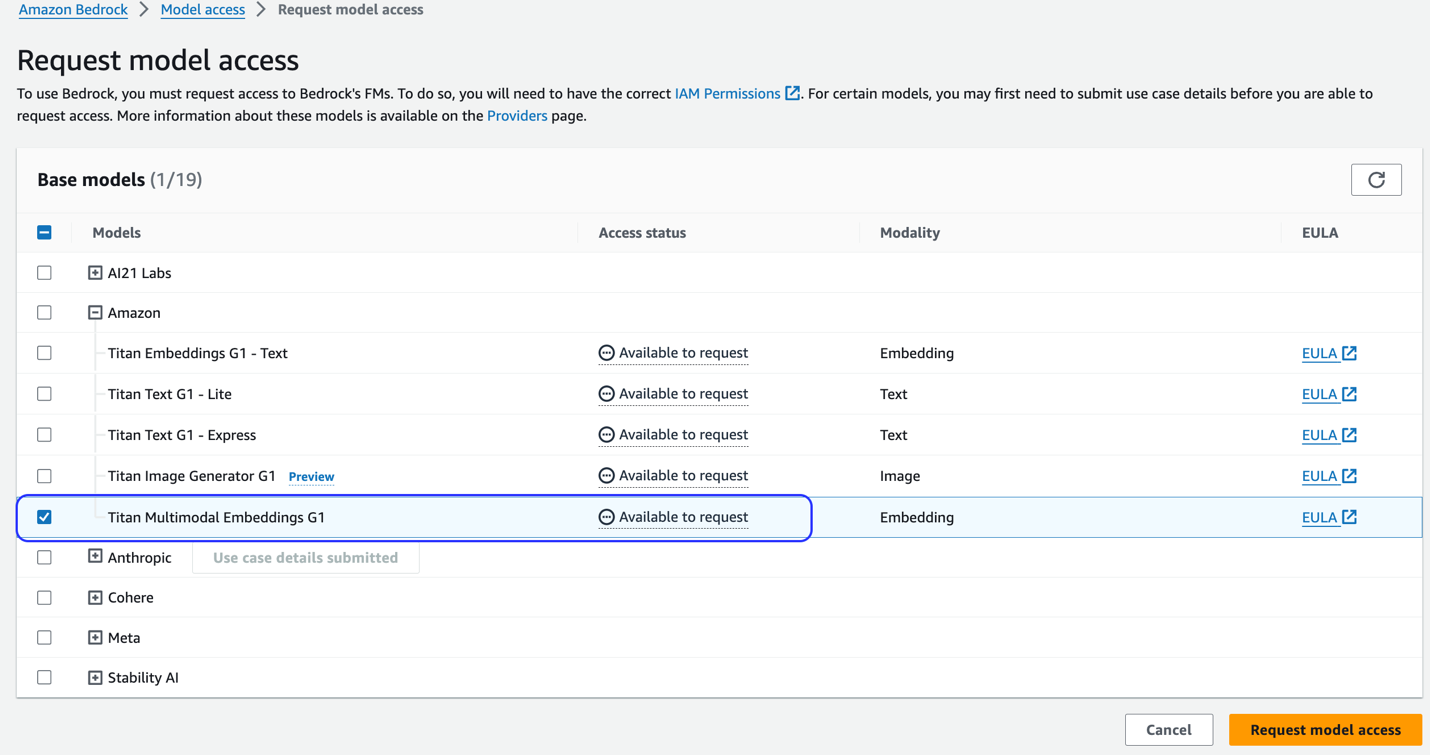

Denne løsning bruger Titan Multimodal Embeddings-modellen. Sørg for, at denne model er aktiveret til brug i Amazon Bedrock. Vælg på Amazon Bedrock-konsollen Modeladgang i navigationsruden. Hvis Titan Multimodal Embeddings er aktiveret, vil adgangsstatus angives Adgang tildelt.

Hvis modellen ikke er tilgængelig, skal du aktivere adgang til modellen ved at vælge Administrer modeladgang, vælge Titan Multimodal Embeddings G1, og vælge Anmod om modeladgang. Modellen er aktiveret til brug med det samme.

Brug en AWS CloudFormation-skabelon til at oprette løsningsstakken

Brug en af følgende AWS CloudFormation skabeloner (afhængigt af din region) for at starte løsningsressourcerne.

| AWS-regionen | Link |

|---|---|

us-east-1 |

|

us-west-2 |

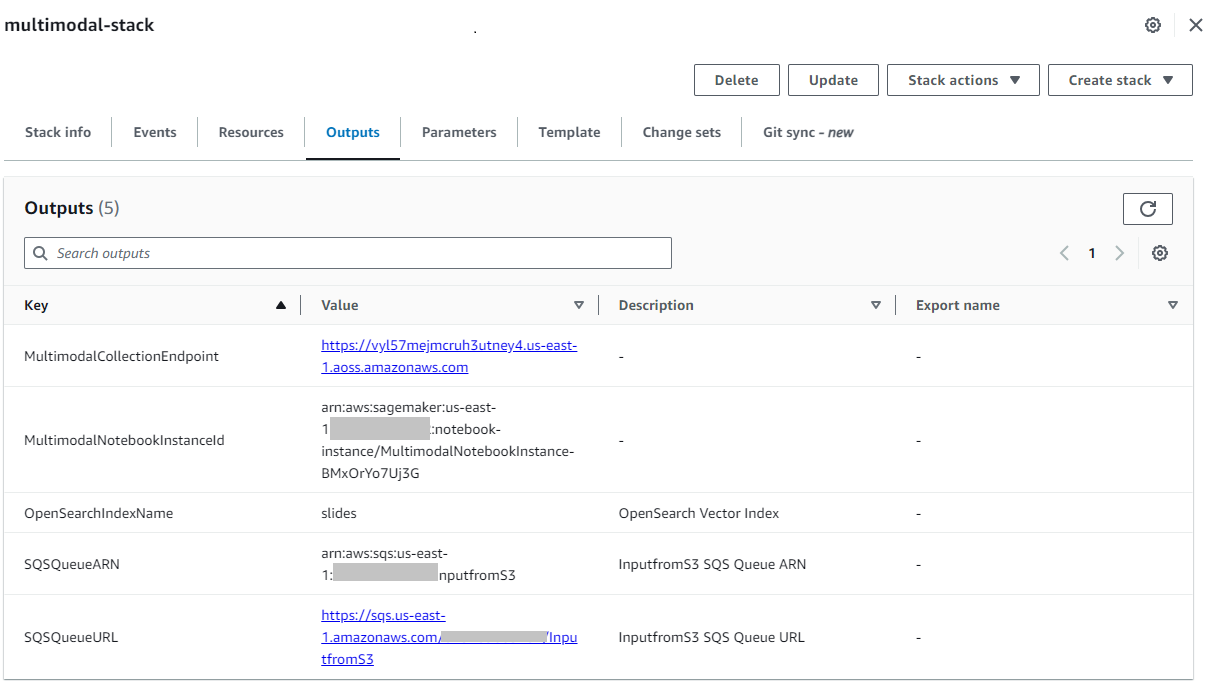

Når stakken er oprettet, skal du navigere til stakkens Udgange fanen på AWS CloudFormation-konsollen og noter værdien for MultimodalCollectionEndpoint, som vi bruger i de efterfølgende trin.

CloudFormation-skabelonen opretter følgende ressourcer:

- IAM roller - Det følgende AWS identitets- og adgangsstyring (IAM) roller oprettes. Opdater disse roller for at anvende mindst privilegerede tilladelser.

SMExecutionRolemed Amazon S3, SageMaker, OpenSearch Service og Bedrock fuld adgang.OSPipelineExecutionRolemed adgang til specifikke Amazon SQS- og OSI-handlinger.

- SageMaker notesbog – Al koden til dette indlæg køres via denne notesbog.

- OpenSearch Serverløs samling – Dette er vektordatabasen til lagring og hentning af indlejringer.

- OSI pipeline – Dette er pipelinen til indlæsning af data i OpenSearch Serverless.

- S3 spand – Alle data for dette indlæg er gemt i denne bøtte.

- SQS-kø – Hændelserne for udløsning af OSI-pipeline-kørslen sættes i denne kø.

CloudFormation-skabelonen konfigurerer OSI-pipelinen med Amazon S3- og Amazon SQS-behandling som kilde og et OpenSearch Serverless-indeks som sink. Alle objekter, der er oprettet i den angivne S3-bøtte og præfiks (multimodal/osi-embeddings-json) vil udløse SQS-meddelelser, som bruges af OSI-pipelinen til at indlæse data i OpenSearch Serverless.

CloudFormation-skabelonen opretter også netværk, krypteringog dataadgang politikker, der kræves for OpenSearch Serverless-samlingen. Opdater disse politikker for at anvende de mindste privilegerede tilladelser.

Bemærk, at der refereres til CloudFormations skabelonnavn i SageMaker-notesbøger. Hvis standardskabelonnavnet ændres, skal du sørge for at opdatere det samme i globals.py

Test løsningen

Når de nødvendige trin er gennemført, og CloudFormation-stakken er blevet oprettet, er du nu klar til at teste løsningen:

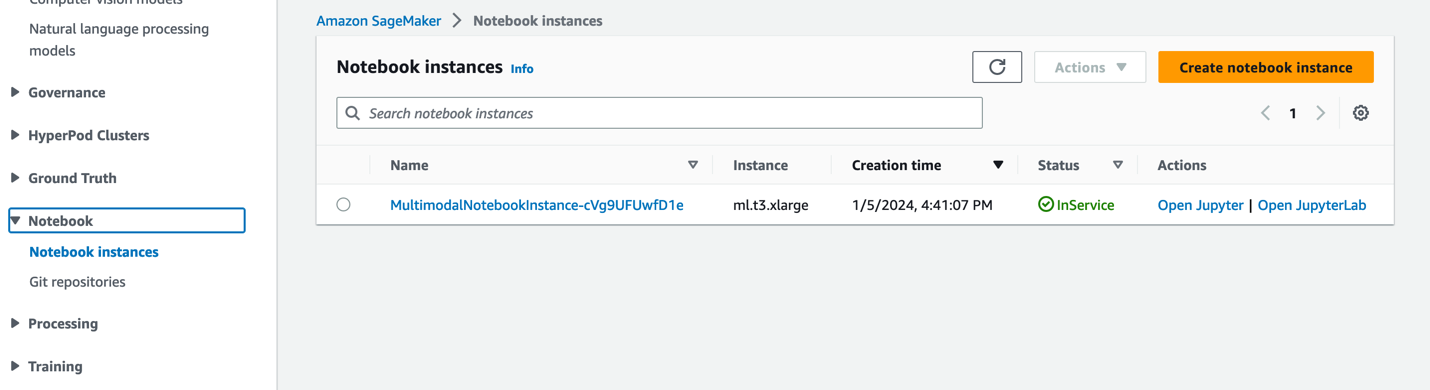

- Vælg på SageMaker-konsollen Notebooks i navigationsruden.

- Vælg

MultimodalNotebookInstancenotesbog forekomst og vælg Åbn JupyterLab.

- In Filbrowser, gå til mappen notesbøger for at se notesbøgerne og understøttende filer.

Notesbøgerne er nummereret i den rækkefølge, de køres i. Instruktioner og kommentarer i hver notesbog beskriver de handlinger, der udføres af den pågældende notesbog. Vi kører disse notesbøger én efter én.

- Vælg 0_deploy_llava.ipynb for at åbne den i JupyterLab.

- På Kør menu, vælg Kør alle celler for at køre koden i denne notesbog.

Denne notebook implementerer LLaVA-v1.5-7B-modellen til et SageMaker-slutpunkt. I denne notesbog downloader vi LLaVA-v1.5-7B-modellen fra HuggingFace Hub, erstatter inference.py-scriptet med llava_inference.py, og opret en model.tar.gz-fil for denne model. Model.tar.gz-filen uploades til Amazon S3 og bruges til at implementere modellen på SageMaker-slutpunktet. Det llava_inference.py scriptet har ekstra kode, der gør det muligt at læse en billedfil fra Amazon S3 og køre konklusioner på den.

- Vælg 1_data_prep.ipynb for at åbne den i JupyterLab.

- På Kør menu, vælg Kør alle celler for at køre koden i denne notesbog.

Denne notesbog downloader glidedæk, konverterer hvert dias til JPG-filformat og uploader disse til S3-bøtten, der bruges til dette indlæg.

- Vælg 2_data_ingestion.ipynb for at åbne den i JupyterLab.

- På Kør menu, vælg Kør alle celler for at køre koden i denne notesbog.

Vi gør følgende i denne notesbog:

- Vi opretter et indeks i OpenSearch Serverless-samlingen. Dette indeks gemmer indlejringsdata for diasdækket. Se følgende kode:

- Vi bruger Titan Multimodal Embeddings-modellen til at konvertere JPG-billeder oprettet i den forrige notesbog til vektorindlejringer. Disse indlejringer og yderligere metadata (såsom S3-stien til billedfilen) gemmes i en JSON-fil og uploades til Amazon S3. Bemærk, at der oprettes en enkelt JSON-fil, som indeholder dokumenter til alle dias (billeder), der er konverteret til indlejringer. Følgende kodestykke viser, hvordan et billede (i form af en Base64-kodet streng) konverteres til indlejringer:

- Denne handling udløser OpenSearch Ingestion-pipeline, som behandler filen og indsætter den i OpenSearch Serverless-indekset. Det følgende er et eksempel på den oprettede JSON-fil. (En vektor med fire dimensioner er vist i eksempelkoden. Titan Multimodal Embeddings-modellen genererer 1,024 dimensioner.)

- Vælg 3_rag_inference.ipynb for at åbne den i JupyterLab.

- På Kør menu, vælg Kør alle celler for at køre koden i denne notesbog.

Denne notesbog implementerer RAG-løsningen: Vi konverterer brugerspørgsmålet til indlejringer, finder et lignende billede (slide) fra vektordatabasen og leverer det hentede billede til LLaVA for at generere et svar på brugerspørgsmålet. Vi bruger følgende promptskabelon:

Følgende kodestykke giver RAG-arbejdsgangen:

Resultater

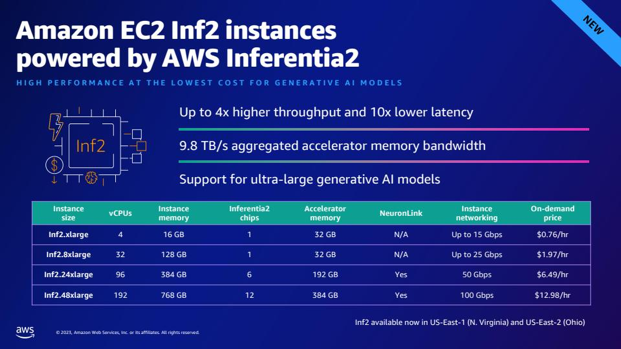

Det følgende er en samling af nogle brugerspørgsmål og -svar genereret af vores implementering. Det Spørgsmål kolonne fanger brugerspørgsmålet, og Svar kolonne er det tekstmæssige svar genereret af LLaVA. Billede er det k-nærmeste (k=1) slidematch, der returneres af OpenSearch Serverless vektorsøgning. Dette slide er fortolket af LLaVA for at give svaret.

Multimodale RAG resultater

| Spørgsmål | Svar | Billede |

|---|---|---|

| Hvordan sammenligner Inf2 sig i ydeevne med sammenlignelige EC2-instanser? Jeg har brug for tal. | Ifølge slide-dækket tilbyder Inf2-instanser af AWS Inferentia2 op til 4x højere gennemløb og 10x lavere latenstid sammenlignet med sammenlignelige EC2-instanser. |  |

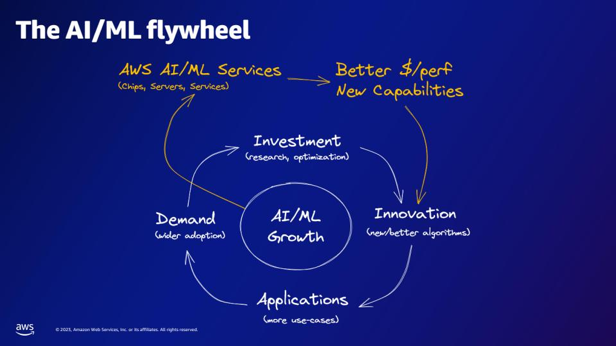

| Hvad giver AWS AI/ML-tjenesterne i henhold til AI/ML-svinghjulet? | AWS AI/ML-tjenesterne giver bedre $/perfer-kapaciteter, nye muligheder og investering i innovation. |  |

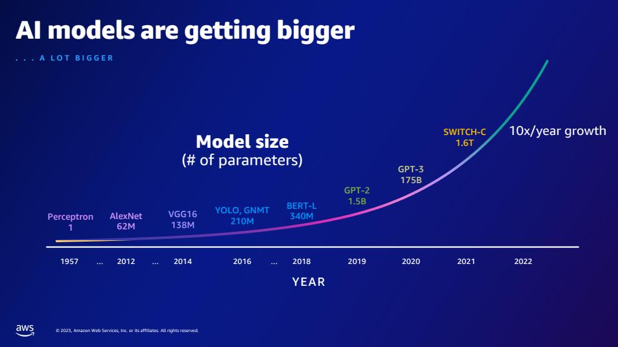

| Hvor mange flere parametre har GPT-2 i forhold til GPT-3? Hvad er den numeriske forskel mellem parameterstørrelsen for GPT-2 og GPT-3? | Ifølge sliden har GPT-3 175 milliarder parametre, mens GPT-2 har 1.5 milliarder parametre. Den numeriske forskel mellem parameterstørrelsen på GPT-2 og GPT-3 er 173.5 mia. |  |

| Hvad er kvarker i partikelfysik? | Jeg fandt ikke svaret på dette spørgsmål i slide-dækket. |  |

Du er velkommen til at udvide denne løsning til dine rutsjebane. Du skal blot opdatere SLIDE_DECK-variablen i globals.py med en URL til dit slide-dæk og køre indlæsningstrinnene beskrevet i det foregående afsnit.

Tip

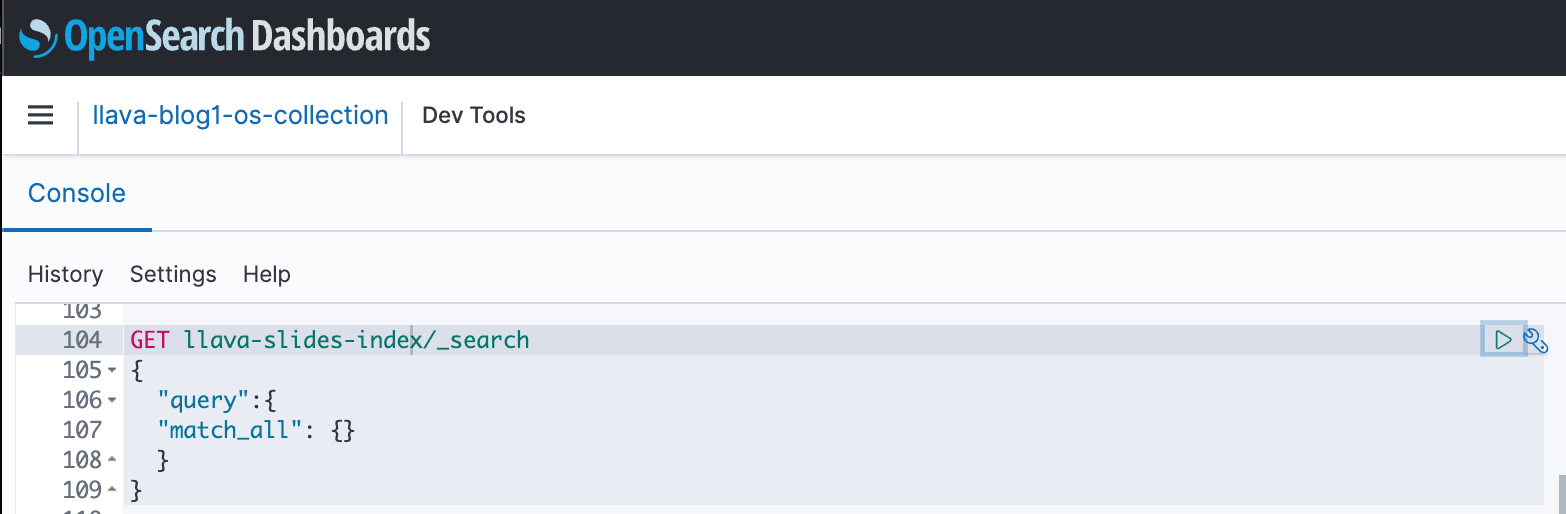

Du kan bruge OpenSearch Dashboards til at interagere med OpenSearch API for at køre hurtige test på dit indeks og indlæste data. Følgende skærmbillede viser et OpenSearch-dashboard GET-eksempel.

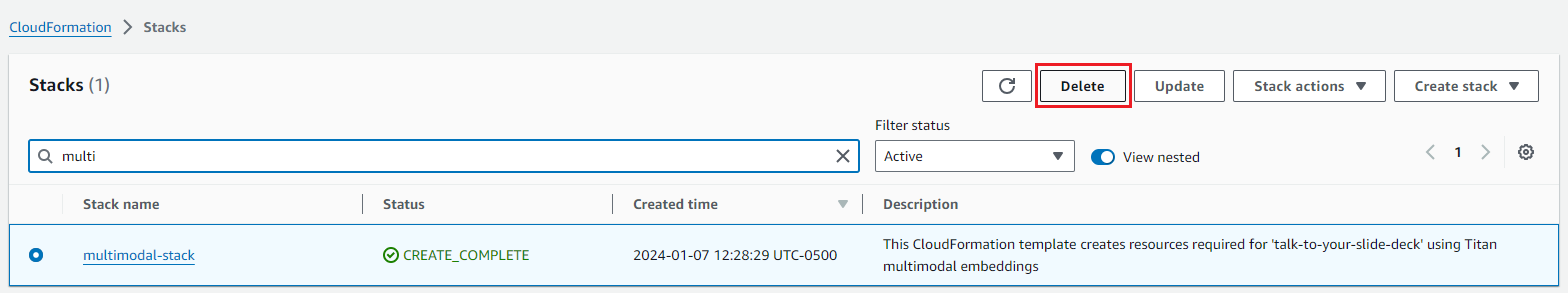

Ryd op

Slet de ressourcer, du har oprettet, for at undgå fremtidige gebyrer. Du kan gøre dette ved at slette stakken via CloudFormation-konsollen.

Derudover skal du slette SageMaker-slutningsendepunktet, der er oprettet til LLaVA-inferencing. Du kan gøre dette ved at fjerne kommentarer til oprydningstrinnet 3_rag_inference.ipynb og køre cellen, eller ved at slette slutpunktet via SageMaker-konsollen: vælg Inferens , Endpoints i navigationsruden, vælg derefter slutpunktet og slet det.

Konklusion

Virksomheder genererer nyt indhold hele tiden, og slide decks er en almindelig mekanisme, der bruges til at dele og formidle information internt med organisationen og eksternt med kunder eller ved konferencer. Over tid kan rig information forblive begravet og skjult i ikke-tekstmæssige modaliteter som grafer og tabeller i disse dias-dæk. Du kan bruge denne løsning og kraften i multimodale FM'er såsom Titan Multimodal Embeddings-modellen og LLaVA til at opdage ny information eller afdække nye perspektiver på indhold i dias-dæk.

Vi opfordrer dig til at lære mere ved at udforske Amazon SageMaker JumpStart, Amazon Titan modeller, Amazon Bedrock og OpenSearch Service, og opbygning af en løsning ved hjælp af eksempelimplementeringen i dette indlæg.

Hold øje med to yderligere indlæg som en del af denne serie. Del 2 dækker en anden tilgang, du kan tage for at tale med dit slide-dæk. Denne tilgang genererer og gemmer LLaVA-slutninger og bruger disse lagrede slutninger til at svare på brugerforespørgsler. Del 3 sammenligner de to tilgange.

Om forfatterne

Amit Arora er en AI og ML Specialist Architect hos Amazon Web Services, der hjælper virksomhedskunder med at bruge cloud-baserede maskinlæringstjenester til hurtigt at skalere deres innovationer. Han er også adjungeret lektor i MS data science and analytics-programmet ved Georgetown University i Washington DC

Amit Arora er en AI og ML Specialist Architect hos Amazon Web Services, der hjælper virksomhedskunder med at bruge cloud-baserede maskinlæringstjenester til hurtigt at skalere deres innovationer. Han er også adjungeret lektor i MS data science and analytics-programmet ved Georgetown University i Washington DC

Manju Prasad er Senior Solutions Architect indenfor Strategic Accounts hos Amazon Web Services. Hun fokuserer på at levere teknisk vejledning inden for en række forskellige domæner, herunder AI/ML til en M&E-kunde. Før hun kom til AWS, designede og byggede hun løsninger til virksomheder i den finansielle sektor og også til en startup.

Manju Prasad er Senior Solutions Architect indenfor Strategic Accounts hos Amazon Web Services. Hun fokuserer på at levere teknisk vejledning inden for en række forskellige domæner, herunder AI/ML til en M&E-kunde. Før hun kom til AWS, designede og byggede hun løsninger til virksomheder i den finansielle sektor og også til en startup.

Archana Inapudi er Senior Solutions Architect hos AWS, der støtter strategiske kunder. Hun har over ti års erfaring med at hjælpe kunder med at designe og bygge dataanalyse og databaseløsninger. Hun brænder for at bruge teknologi til at give værdi til kunderne og opnå forretningsresultater.

Archana Inapudi er Senior Solutions Architect hos AWS, der støtter strategiske kunder. Hun har over ti års erfaring med at hjælpe kunder med at designe og bygge dataanalyse og databaseløsninger. Hun brænder for at bruge teknologi til at give værdi til kunderne og opnå forretningsresultater.

Antara Raisa er en AI og ML Solutions Architect hos Amazon Web Services, der understøtter strategiske kunder baseret i Dallas, Texas. Hun har også tidligere erfaring med at arbejde med store virksomhedspartnere hos AWS, hvor hun arbejdede som Partner Success Solutions Architect for digital native kunder.

Antara Raisa er en AI og ML Solutions Architect hos Amazon Web Services, der understøtter strategiske kunder baseret i Dallas, Texas. Hun har også tidligere erfaring med at arbejde med store virksomhedspartnere hos AWS, hvor hun arbejdede som Partner Success Solutions Architect for digital native kunder.

- SEO Powered Content & PR Distribution. Bliv forstærket i dag.

- PlatoData.Network Vertical Generative Ai. Styrk dig selv. Adgang her.

- PlatoAiStream. Web3 intelligens. Viden forstærket. Adgang her.

- PlatoESG. Kulstof, CleanTech, Energi, Miljø, Solenergi, Affaldshåndtering. Adgang her.

- PlatoHealth. Bioteknologiske og kliniske forsøgs intelligens. Adgang her.

- Kilde: https://aws.amazon.com/blogs/machine-learning/talk-to-your-slide-deck-using-multimodal-foundation-models-hosted-on-amazon-bedrock-and-amazon-sagemaker-part-1/

- :har

- :er

- :ikke

- :hvor

- $OP

- 1

- 10

- 100

- 13

- 15 %

- 16

- 173

- 20

- 2023

- 26

- 29

- 31

- 8

- 9

- a

- I stand

- Om

- adgang

- af udleverede

- Konti

- opnå

- Handling

- aktioner

- handlinger

- tilføje

- Yderligere

- tillæg

- advent

- mod

- AI

- AI / ML

- Alle

- tillade

- sammen

- også

- Amazon

- Amazon SageMaker

- Amazon Web Services

- an

- analytics

- ,

- En anden

- besvare

- besvarelse

- svar

- enhver

- api

- Indløs

- tilgang

- tilgange

- arkitektur

- ER

- AS

- spørg

- Assistant

- forbundet

- At

- lyd

- augmented

- Auth

- til rådighed

- undgå

- AWS

- AWS CloudFormation

- baseret

- BE

- været

- Bedre

- mellem

- Billion

- krop

- bygge

- Bygning

- bygget

- virksomhed

- by

- CAN

- kapaciteter

- kapacitet

- fanger

- celle

- ændret

- afgifter

- Vælg

- vælge

- kunde

- kode

- samling

- samlinger

- solfanger

- Kolonne

- kombination

- kombinerer

- kommentarer

- Fælles

- Virksomheder

- sammenlignelig

- sammenligne

- sammenlignet

- fuldføre

- Afsluttet

- komponenter

- Konceptet

- konferencer

- Konfiguration

- konfigureret

- består

- Konsol

- indeholder

- indeholdt

- indeholder

- indhold

- indholdsskabelse

- konvertere

- konverteret

- konvertering af

- Tilsvarende

- kunne

- dækker

- skabe

- oprettet

- skaber

- Oprettelse af

- skabelse

- Legitimationsoplysninger

- kunde

- Kunder

- Dallas

- instrumentbræt

- dashboards

- data

- Dataanalyse

- datalogi

- Database

- årti

- dæk

- dæk

- Standard

- levere

- leverer

- demonstrere

- Afhængigt

- indsætte

- indsat

- implementering

- udruller

- beskrive

- Design

- konstrueret

- detail

- detaljeret

- detaljer

- DICT

- DID

- forskel

- forskellige

- Broadcasting

- digital

- Dimension

- størrelse

- opdage

- drøftet

- Skærm

- do

- dokumenter

- gør

- Domæner

- downloade

- downloads

- i løbet af

- e

- hver

- elementer

- indlejret

- indlejring

- muliggøre

- aktiveret

- tilskynde

- ende

- Endpoint

- Engine (Motor)

- sikre

- Enterprise

- virksomhedskunder

- fejl

- Ether (ETH)

- begivenhed

- begivenheder

- Undersøgelse

- eksempel

- Undtagen

- undtagelse

- eksisterer

- erfaring

- Udforskning

- udvide

- eksternt

- ekstrakt

- Kendskab

- Fields

- File (Felt)

- Filer

- finansielle

- finansielle tjenesteydelser

- Finde

- fokuserer

- følger

- efter

- følger

- Til

- formular

- format

- Foundation

- fire

- Gratis

- fra

- fuld

- fuldt ud

- fremtiden

- generere

- genereret

- genererer

- generation

- generative

- Generativ AI

- Georgetown

- få

- GitHub

- gå

- grafer

- vejledning

- Have

- he

- hjælpsom

- hjælpe

- link.

- Skjult

- højere

- Hits

- host

- hostede

- Hosting

- værter

- Hvordan

- Men

- HTML

- http

- HTTPS

- Hub

- KrammerFace

- i

- IAM

- Identity

- if

- illustrerer

- billede

- billeder

- straks

- gennemføre

- implementering

- redskaber

- in

- omfatter

- omfatter

- Herunder

- indeks

- Indeks

- oplysninger

- Innovation

- innovationer

- indgang

- instans

- forekomster

- anvisninger

- interagere

- interaktion

- internt

- ind

- investering

- IT

- sammenføjning

- jpg

- json

- juni

- Sprog

- stor

- Latency

- lancere

- LÆR

- læring

- foredragsholder

- ligesom

- LINK

- Llama

- lokale

- lavere

- maskine

- machine learning

- lave

- administrere

- lykkedes

- mange

- Match

- matchende

- mekanisme

- Menu

- Metadata

- metode

- ML

- modaliteter

- model

- modeller

- mere

- mest

- MS

- flere

- navn

- indfødte

- Naviger

- Navigation

- Behov

- Ny

- Ingen

- Bemærk

- notesbog

- notesbøger

- meddelelser

- nu

- nummererede

- numre

- numerisk

- objekter

- of

- tilbyde

- on

- On-Demand

- ONE

- kun

- åbent

- open source

- or

- organisation

- OS

- vores

- ud

- udfald

- output

- i løbet af

- brød

- parameter

- parametre

- del

- partikel

- partner

- partnere

- dele

- Bestået

- lidenskabelige

- sti

- per

- udføre

- ydeevne

- udføres

- Tilladelser

- perspektiver

- fase

- Fysik

- Billeder

- pipeline

- plato

- Platon Data Intelligence

- PlatoData

- politikker

- Indlæg

- Indlæg

- potentielt

- magt

- vigtigste

- Predictor

- præsentere

- forelagt

- tidligere

- Forud

- behandle

- bearbejdet

- Processer

- forarbejdning

- Program

- egenskaber

- give

- forudsat

- giver

- leverer

- sætte

- kvarker

- forespørgsler

- spørgsmål

- Spørgsmål

- Hurtig

- klud

- rækkevidde

- hurtigt

- Læsning

- klar

- virkelige verden

- modtaget

- refereres

- region

- relaterede

- relevant

- forblive

- erstatte

- anmode

- påkrævet

- Ressourcer

- Svar

- svar

- reaktioner

- resultere

- resulterer

- Resultater

- hentning

- afkast

- Rich

- roller

- Kør

- kører

- sagemaker

- SageMaker Inference

- samme

- siger

- Scale

- Videnskab

- screenshots

- script

- Søg

- Anden

- Sektion

- sektioner

- sektor

- se

- Vælg

- udvælgelse

- senior

- Sequence

- Series

- Serverless

- tjener

- tjeneste

- Tjenester

- Session

- sæt

- indstilling

- indstillinger

- Del

- hun

- bør

- vist

- Shows

- lignende

- Simpelt

- ganske enkelt

- enkelt

- Størrelse

- Skub

- Slides

- uddrag

- So

- løsninger

- Løsninger

- nogle

- Kilde

- specialist

- specifikke

- specificeret

- stabil

- stable

- opstart

- Tilstand

- Status

- Trin

- Steps

- opbevaring

- butik

- opbevaret

- forhandler

- Strategisk

- String

- efterfølgende

- succes

- Succesfuld

- sådan

- Summit

- Støtte

- sikker

- bord

- Tag

- Tal

- opgaver

- Teknisk

- Teknologier

- skabelon

- skabeloner

- prøve

- tests

- Texas

- tekst

- tekstmæssige

- at

- oplysninger

- deres

- derefter

- Disse

- denne

- dem

- kapacitet

- tid

- titan

- titlen

- til

- nutidens

- sammen

- toronto

- traditionelt

- krydse

- udløse

- udløsning

- sand

- prøv

- TUR

- to

- typen

- afdække

- forstå

- forståelse

- universitet

- Opdatering

- uploadet

- URL

- brug

- anvendte

- Bruger

- bruger

- ved brug af

- værdi

- variabel

- række

- udgave

- via

- video

- Specifikation

- vision

- visuel

- washington

- måder

- we

- web

- webservices

- GODT

- Hvad

- Hvad er

- som

- mens

- vilje

- med

- inden for

- arbejdede

- workflow

- arbejder

- dig

- Din

- zephyrnet