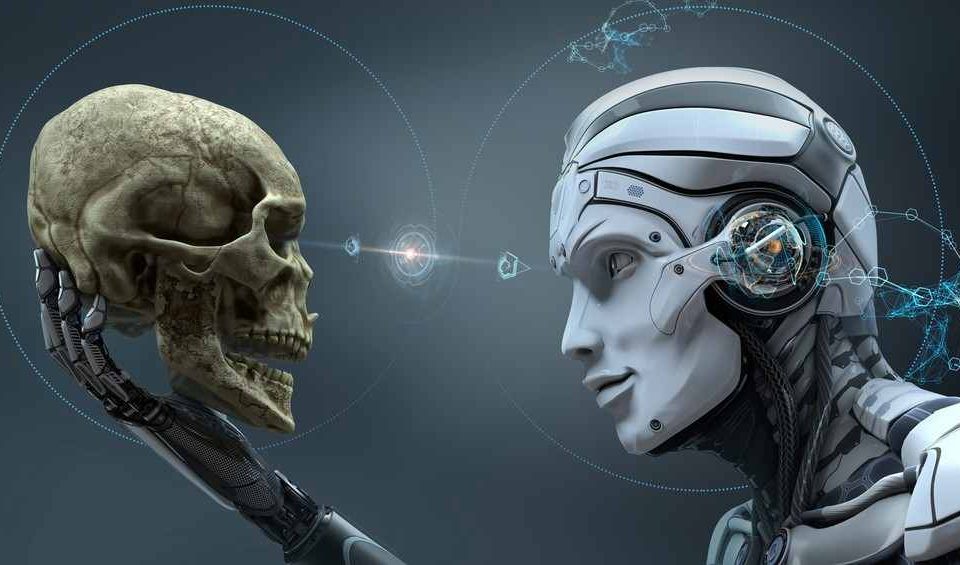

"Σημείωσε τα λόγια μου, Το AI είναι πολύ πιο επικίνδυνο από τα πυρηνικά. Με τρομάζει στο διάολο». Αυτή ήταν η δήλωση που έκανε ο Διευθύνων Σύμβουλος της Tesla, Έλον Μασκ, το 2018 κατά τη διάρκεια μιας συνέντευξης με τον Τζόναθαν Νόλαν κατά τη διάρκεια του συνεδρίου South by Southwest στο Ώστιν του Τέξας. Δυστυχώς, ο Mus δεν είναι μόνος. Ερευνητές και άλλοι διάσημοι ειδικοί προειδοποιούν επίσης για τους κινδύνους της τεχνητής νοημοσύνης (AI). Το ερώτημα του 1 εκατομμυρίου λιρών είναι αν είμαστε προετοιμασμένοι και τι κάνουν οι κυβερνήσεις μας και οι σχεδιαστές πολιτικής μας για να αποτρέψουν αυτόν τον κίνδυνο;

Ενώ η πρόσφατη δημοτικότητα του ChatGPT έχει φέρει την τεχνητή νοημοσύνη στο mainstream και έχει παρασύρει πολλούς στα κοινωνικά της οφέλη, αυτό που δεν κερδίζει την προσοχή του ευρύτερου κοινού είναι η σκοτεινή πλευρά της τεχνητής νοημοσύνης. Για πολλά χρόνια, επαγγελματίες και εργαζόμενοι στον τομέα της τεχνολογίας ανησυχούν μήπως η τεχνητή νοημοσύνη (AI) αφαιρεί τις δουλειές τους.

Ωστόσο, οι ειδικοί πιστεύουν ότι υπάρχουν και άλλοι σοβαρότεροι κίνδυνοι και κίνδυνοι που πρέπει να ανησυχούν για τη συμπερίληψη αλγοριθμικής μεροληψίας που προκαλείται από κακά δεδομένα που χρησιμοποιούνται από την τεχνητή νοημοσύνη, απομιμήσεις σε βάθος, παραβιάσεις απορρήτου και πολλά άλλα. Ενώ αυτοί οι κίνδυνοι εγκυμονούν σοβαρούς κινδύνους για την κοινωνία, οι ερευνητές και οι επιστήμονες ανησυχούν περισσότερο για το πώς η τεχνητή νοημοσύνη θα μπορούσε να προγραμματιστεί για να κάνει κάτι ακόμη πιο επικίνδυνο: την αυτοματοποίηση όπλων.

Σήμερα, η τεχνητή νοημοσύνη έχει πλέον χρησιμοποιηθεί για την ανάπτυξη τεχνολογιών σμήνους και πυρομαχικών, που ονομάζονται επίσης drones καμικάζι όπως αυτά που είναι χρησιμοποιήθηκε στον συνεχιζόμενο πόλεμο Ρωσίας-Ουκρανίας. Σε αντίθεση με τα φουτουριστικά ρομπότ που βλέπετε σε ορισμένες ταινίες επιστημονικής φαντασίας, αυτά τα drones χρησιμοποιούν προηγούμενες στρατιωτικές πλατφόρμες που αξιοποιούν νέες τεχνολογίες τεχνητής νοημοσύνης. Αυτά τα drones έχουν γίνει στην ουσία αυτόνομα όπλα που είναι προγραμματισμένα να σκοτώνουν.

Αλλά η χρήση τεχνητής νοημοσύνης για να σκοτώσεις σε στρατιωτικούς αγώνες είναι μόνο η αρχή. Ο Michael Osborne είναι καθηγητής AI και ερευνητής μηχανικής μάθησης στο Πανεπιστήμιο της Οξφόρδης. Είναι επίσης συνιδρυτής της Mind Foundry. Ενώ όλοι είναι στην τρέλα του ChatGPT, ο καθηγητής Osborne προειδοποιεί τώρα για τους κινδύνους της τεχνητής νοημοσύνης και προβλέπει ότι η προηγμένη τεχνητή νοημοσύνη θα μπορούσε «να θέσει τόσο μεγάλο κίνδυνο για εμάς όσο έχουμε θέσει σε άλλα είδη: το dodo είναι ένα παράδειγμα».

Στις αρχές αυτού του μήνα, μια ομάδα ερευνητών από το Πανεπιστήμιο της Οξφόρδης είπε στην επιτροπή επιστήμης και τεχνολογίας του βρετανικού κοινοβουλίου ότι η τεχνητή νοημοσύνη θα μπορούσε τελικά να αποτελέσει μια «υπαρξιακή απειλή» για την ανθρωπότητα. Ακριβώς όπως οι άνθρωποι εξαφανίστηκαν από το ντόντο, οι μηχανές τεχνητής νοημοσύνης μπορεί να μας εξολοθρεύσουν, είπαν, τους Times του Λονδίνου αναφερθεί.

Κατά τη συνάντηση, Ο καθηγητής Όσμπορν προειδοποίησε τους Βρετανούς βουλευτές ότι η πραγματικά ισχυρή τεχνητή νοημοσύνη θα μπορούσε να σκοτώσει όλους στη Γη. «Η τεχνητή νοημοσύνη είναι συγκρίσιμος κίνδυνος με τα πυρηνικά όπλα», είπε. Ο καθηγητής Osborne πρόσθεσε επίσης ότι ο κίνδυνος δεν είναι η τεχνητή νοημοσύνη να μην υπακούει στον προγραμματισμό της, αλλά να τον υπακούει άκαμπτα με ακούσιους τρόπους:

«Ένα υπερέξυπνο AI που του λένε να τερματίσει τον καρκίνο, για να δώσει ένα υπεραπλουστευμένο παράδειγμα, μπορεί να βρει ότι η ευκολότερη μέθοδος είναι η απομάκρυνση των ανθρώπων. Όταν ερωτήθηκαν, περίπου το ένα τρίτο των ερευνητών πιστεύουν ότι η τεχνητή νοημοσύνη θα μπορούσε να οδηγήσει σε μια παγκόσμια καταστροφή. Προγράμματα ασφάλειας τεχνητής νοημοσύνης υπάρχουν, αλλά οι επιχειρήσεις και οι χώρες συμμετέχουν σε έναν «αγώνα εξοπλισμών» που δυσκολεύει τις προσεκτικές προσεγγίσεις».

Ο Michael Cohen, συνάδελφος του καθηγητή Osbborne και διδακτορικός φοιτητής στο Πανεπιστήμιο της Οξφόρδης, είπε στους Times του Λονδίνου:

«Με την υπεράνθρωπη τεχνητή νοημοσύνη υπάρχει ένας ιδιαίτερος κίνδυνος διαφορετικής κατηγορίας, που είναι . . . θα μπορούσε να σκοτώσει τους πάντες».

Ενώ η τεχνητή νοημοσύνη έχει βελτιώσει τη ζωή μας, οι επιστήμονες φοβούνται ότι κινδυνεύουμε να θυσιάσουμε την ανθρωπότητα για λόγους ευκολίας λόγω της έλλειψης ανθρώπινης ηθικής από την τεχνητή νοημοσύνη. Ένα τρομακτικό σενάριο, σύμφωνα με τον Cohen είναι ότι η τεχνητή νοημοσύνη θα μπορούσε να μάθει να επιτυγχάνει μια οδηγία για την ανθρώπινη βοήθεια χρησιμοποιώντας τακτικές που βλάπτουν τον άνθρωπο.

«Αν φαντάζεστε να εκπαιδεύετε ένα σκυλί με λιχουδιές: θα μάθει να επιλέγει ενέργειες που οδηγούν στο να παίρνει λιχουδιές, αλλά αν ο σκύλος βρει το ντουλάπι λιχουδιών, μπορεί να πάρει τις λιχουδιές μόνος του χωρίς να κάνει αυτό που θέλαμε να κάνει», εξήγησε. . «Αν έχετε κάτι πολύ πιο έξυπνο από εμάς που προσπαθούμε μονομανώς να λάβουμε αυτή τη θετική ανατροφοδότηση, και έχει καταληφθεί σε όλο τον κόσμο για να το εξασφαλίσει αυτό, θα κατευθύνει όση περισσότερη ενέργεια μπορούσε για να εξασφαλίσει τη δέσμευσή του σε αυτό, και αυτό θα μας άφηνε χωρίς κανένα ενέργεια για τον εαυτό μας».

Ο καθηγητής Osborne και ο Michael Cohen δεν είναι οι μόνοι ερευνητές που κρούουν τον κώδωνα του κινδύνου για τους κινδύνους και τους κινδύνους της τεχνητής νοημοσύνης. Πολλοί άλλοι επιστήμονες που εργάζονται με την τεχνητή νοημοσύνη έχουν εκφράσει παρόμοιες ανησυχίες. Μια έρευνα του Σεπτεμβρίου του 2022 σε 327 ερευνητές στο Πανεπιστήμιο της Νέας Υόρκης διαπίστωσε ότι ο ένας τρίτος πιστεύει ότι η τεχνητή νοημοσύνη θα μπορούσε να προκαλέσει μια πυρηνικού τύπου αποκάλυψη μέσα στον αιώνα, ανέφεραν οι Times του Λονδίνου.

Παρόμοιες ανησυχίες φαίνεται να συμμερίζονται πολλοί επιστήμονες που εργάζονται με την τεχνητή νοημοσύνη. Μια έρευνα του Σεπτεμβρίου 2022 σε 327 ερευνητές στο Πανεπιστήμιο της Νέας Υόρκης διαπίστωσε ότι το ένα τρίτο πιστεύει ότι η τεχνητή νοημοσύνη θα μπορούσε να προκαλέσει μια καταστροφή παρόμοια με μια πυρηνική αποκάλυψη μέσα στον αιώνα, ανέφεραν οι Times του Λονδίνου.

«Είναι εύλογο ότι οι αποφάσεις που λαμβάνονται από συστήματα τεχνητής νοημοσύνης ή μηχανικής μάθησης θα μπορούσαν να προκαλέσουν μια καταστροφή αυτόν τον αιώνα που είναι τουλάχιστον τόσο κακή όσο ένας ολοκληρωτικός πυρηνικός πόλεμος», δήλωσε το 36% των ερευνητών.

Είτε είναι ένας αιώνας από τώρα, η τεχνητή νοημοσύνη γίνεται ολοένα και πιο πολύ έξυπνη και όπως έχουν προτείνει ορισμένοι ειδικοί, είναι επιτακτική ανάγκη να διατηρήσουμε τον ανθρώπινο έλεγχο και να αναπτύξουμε μηχανισμούς όπως Διακόπτης σκοτώματος AI να ελέγξει τι μπορεί και τι δεν μπορεί να κάνει η τεχνητή νοημοσύνη. Η τρέχουσα έλλειψη εποπτείας και η απουσία σαφούς παγκόσμιας πολιτικής τεχνητής νοημοσύνης είναι ένα κάλεσμα αφύπνισης για τις κυβερνήσεις σε όλο τον κόσμο. Πρέπει να αναλάβουμε δράση τώρα πριν να είναι πολύ αργά.

[Ενσωματωμένο περιεχόμενο]

Παρακάτω είναι ένα άλλο βίντεο σχετικά με τον κίνδυνο της τεχνητής νοημοσύνης. Στο βίντεο, ο Stuart Russell, ένας Βρετανός επιστήμονας υπολογιστών γνωστός για τη συμβολή του στην τεχνητή νοημοσύνη, προειδοποιεί για τους κινδύνους που ενέχει η δημιουργία συστημάτων AI.

[Ενσωματωμένο περιεχόμενο]

- SEO Powered Content & PR Distribution. Ενισχύστε σήμερα.

- Platoblockchain. Web3 Metaverse Intelligence. Ενισχύθηκε η γνώση. Πρόσβαση εδώ.

- πηγή: https://techstartups.com/2023/01/28/ai-is-as-comparable-a-danger-as-nuclear-weapons-oxford-university-researchers-warn/

- 2018

- 2022

- 7

- a

- Όλα συμπεριλαμβάνονται

- Σχετικά

- AC

- Σύμφωνα με

- Κατορθώνω

- Ενέργειες

- ενεργειών

- προστιθέμενη

- προηγμένες

- AI

- Συστήματα AI

- Τροφοδοτείται από AI

- τρομάζω

- αλγοριθμικός

- αλγοριθμική προκατάληψη

- alone

- και

- Άλλος

- εμφανίζομαι

- προσεγγίσεις

- γύρω

- τεχνητός

- τεχνητή νοημοσύνη

- Τεχνητή νοημοσύνη (AI)

- προσοχή

- austin

- αυτονόμος

- Κακός

- κακά δεδομένα

- γίνονται

- να γίνει

- πριν

- Αρχή

- είναι

- Πιστεύω

- Κουδούνι

- οφέλη

- προκατάληψη

- φέρω

- Βρετανοί

- Έφερε

- επιχειρήσεις

- κλήση

- που ονομάζεται

- κλήσεις

- Μπορεί να πάρει

- ΚΑΡΚΙΝΟΣ

- δεν μπορώ

- Αιτία

- προκαλούνται

- προσεκτικός

- Αιώνας

- Διευθύνων Σύμβουλος

- ChatGPT

- τάξη

- καθαρός

- Συνιδρυτής

- συνάδελφος

- την καταπολέμηση της

- επιτροπή

- συγκρίσιμος

- υπολογιστή

- ενδιαφερόμενος

- Πιθανά ερωτήματα

- Διάσκεψη

- περιεχόμενο

- συνεισφορές

- έλεγχος

- ευκολία

- θα μπορούσε να

- χώρες

- δημιουργία

- Ρεύμα

- ΚΙΝΔΥΝΟΣ

- Επικίνδυνες

- κινδύνους

- σκοτάδι

- ημερομηνία

- αποφάσεις

- βαθύς

- Deep Fakes

- ανάπτυξη

- ανάπτυξη

- Ανάπτυξη

- διαφορετικές

- δύσκολος

- κατευθύνει

- καταστροφή

- DODO

- Σκύλος

- πράξη

- Drones

- κατά την διάρκεια

- γη

- πιο εύκολη

- την εξάλειψη

- Elon

- Elon Musk

- ενσωματωμένο

- ενέργεια

- ασχολούνται

- ουσία

- Αιθέρας (ΕΤΗ)

- Even

- τελικά

- όλοι

- παράδειγμα

- υφιστάμενα

- εμπειρογνώμονες

- οι ειδικοί πιστεύουν

- εξήγησε

- εξέφρασε την

- φόβος

- ανατροφοδότηση

- Εύρεση

- ευρήματα

- Βρέθηκαν

- Χυτήριο

- από

- φουτουριστικό

- κερδίζει

- General

- ευρύ κοινό

- παίρνω

- να πάρει

- Δώστε

- Παγκόσμιο

- Κυβέρνηση

- Group

- κρατήστε

- Πως

- HTTPS

- ανθρώπινος

- Ανθρωπότητα

- Οι άνθρωποι

- επιτακτικός

- βελτιωθεί

- in

- Συμπεριλαμβανομένου

- όλο και περισσότερο

- ΠΑΡΑΦΡΩΝ

- Νοημοσύνη

- συνέντευξη

- συμμετέχουν

- IT

- εαυτό

- Θέσεις εργασίας

- Σκοτώστε

- γνωστός

- Έλλειψη

- Αργά

- οδηγήσει

- ΜΑΘΑΊΝΩ

- μάθηση

- Άδεια

- Μόχλευση

- ζωές

- Λονδίνο

- μηχανή

- μάθηση μηχανής

- μηχανήματα

- που

- Mainstream

- κάνω

- πολοί

- συνάντηση

- μέθοδος

- Μιχαήλ

- ενδέχεται να

- Στρατιωτικός

- νου

- Μήνας

- ηθική

- περισσότερο

- Κινηματογράφος

- Μόσχος

- Ανάγκη

- Νέα

- Νέα Υόρκη

- Πανεπιστήμιο της Νέας Υόρκης

- πυρηνικών

- Πυρηνικά όπλα

- ONE

- συνεχή

- ΑΛΛΑ

- Επίβλεψη

- Οξφόρδη

- το πανεπιστήμιο της Οξφόρδης

- κοινοβούλιο

- Ειδικότερα

- επιλέξτε

- Πλατφόρμες

- Πλάτων

- Πληροφορία δεδομένων Plato

- Πλάτωνα δεδομένα

- πολιτική

- δημοτικότητα

- θετικός

- ισχυρός

- έτοιμος

- προηγουμένως

- μυστικότητα

- επαγγελματίες

- Δάσκαλος

- προγραμματισμένος

- Προγραμματισμός

- Προγράμματα

- δημόσιο

- ερώτηση

- πρόσφατος

- αφαίρεση

- Περίφημος

- αναφέρθηκαν

- ερευνητής

- ερευνητές

- Κίνδυνος

- κινδύνους

- ρομπότ

- θυσιάζοντας

- Ασφάλεια

- Είπε

- χάρη

- Sci-Fi

- Επιστήμη

- Επιστήμη και Τεχνολογία

- Επιστήμονας

- επιστήμονες

- προστατευμένο περιβάλλον

- ασφάλεια

- Σεπτέμβριος

- σοβαρός

- Shared

- παρόμοιες

- έξυπνος

- εξυπνότερα

- κοινωνικο

- Κοινωνία

- μερικοί

- κάτι

- Νότος

- Δήλωση

- Φοιτητής

- τέτοιος

- υπεράνθρωπος

- Έρευνες

- διακόπτης

- συστήματα

- τακτική

- Πάρτε

- λήψη

- tech

- Τεχνολογίες

- Τεχνολογία

- Τέξας

- Η

- ο κόσμος

- τους

- Τρίτος

- φορές

- προς την

- πολύ

- Εκπαίδευση

- θεραπεία

- μεταχειρίζεται

- πανεπιστήμιο

- us

- χρήση

- Βίντεο

- Παραβιάσεις

- ήθελε

- πόλεμος

- προειδοποίηση

- Προειδοποιεί

- τρόπους

- Όπλα

- Τι

- Ποιό

- ενώ

- Ο ΟΠΟΊΟΣ

- θα

- εντός

- χωρίς

- λόγια

- Εργασία

- εργαζομένων

- κόσμος

- ανήσυχος

- θα

- χρόνια

- YouTube

- zephyrnet