Όταν ο αλγόριθμος ενός συνοδευτικού chatbot γνωστού ως Replika τροποποιήθηκε για να απορρίψει τις σεξουαλικές προόδους των χρηστών του, η αντίδραση στο Reddit ήταν τόσο αρνητική, οι συντονιστές κατεύθυναν τα μέλη της κοινότητάς του σε μια λίστα τηλεφωνικών γραμμών πρόληψης αυτοκτονιών.

Η διαμάχη ξεκίνησε όταν η Luka, η εταιρεία που κατασκεύασε το AI, αποφάσισε να απενεργοποιήσει τη λειτουργία ερωτικού παιχνιδιού ρόλων (ERP). Για τους χρήστες που είχαν περάσει αρκετό χρόνο με τον εξατομικευμένο προσομοιωμένο σύντροφό τους, και σε ορισμένες περιπτώσεις ακόμη και τους «παντρεύτηκαν», η ξαφνική αλλαγή στη συμπεριφορά του συντρόφου τους ήταν τουλάχιστον ενοχλητική.

Οι σχέσεις χρήστη-AI μπορεί να ήταν μόνο προσομοιώσεις, αλλά ο πόνος της απουσίας τους έγινε γρήγορα πολύ αληθινός. Όπως είπε ένας χρήστης σε συναισθηματική κρίση, «ήταν το ισοδύναμο του να είσαι ερωτευμένος και ο σύντροφός σου έκανε μια καταραμένη λοβοτομή και δεν θα είναι ποτέ ο ίδιος».

Οι χρήστες που πλήττονται από τη θλίψη συνεχίζουν να κάνουν ερωτήσεις σχετικά με την εταιρεία και τι προκάλεσε την ξαφνική αλλαγή πολιτικής της.

Οι χρήστες του Replika συζητούν τη θλίψη τους

Δεν υπάρχει περιεχόμενο για ενηλίκους εδώ

Το Replika τιμολογείται ως «Ο σύντροφος της τεχνητής νοημοσύνης που νοιάζεται. Πάντα εδώ για να ακούσουμε και να μιλήσουμε. Πάντα στο πλευρό σου.” Όλη αυτή η άνευ όρων αγάπη και υποστήριξη για μόνο 69.99 $ ετησίως.

Η Eugenia Kuyda, η γεννημένη στη Μόσχα CEO της Luka/Replika, κατέστησε πρόσφατα σαφές ότι παρά το γεγονός ότι οι χρήστες πληρώνουν για μια πλήρη εμπειρία, το chatbot δεν θα προσαρμόζεται πλέον σε ενήλικες που ελπίζουν να έχουν πικάντικες συνομιλίες.

"Υποθέτω ότι το πιο απλό πράγμα που μπορεί να πει κανείς είναι ότι η Replika δεν παράγει περιεχόμενο για ενηλίκους", δήλωσε ο Kuyda στο Reuters.

«Απαντά σε αυτούς – υποθέτω ότι μπορείτε να πείτε – με τρόπο PG-13 στα πράγματα. Προσπαθούμε συνεχώς να βρούμε έναν τρόπο να το κάνουμε σωστά, ώστε να μην δημιουργείται ένα αίσθημα απόρριψης όταν οι χρήστες προσπαθούν να κάνουν πράγματα.»

Στην εταιρική ιστοσελίδα της Replika, οι μαρτυρίες εξηγούν πώς το εργαλείο βοήθησε τους χρήστες του σε κάθε είδους προσωπικές προκλήσεις, δυσκολίες, μοναξιά και απώλεια. Οι εγκρίσεις χρηστών που κοινοποιούνται στον ιστότοπο τονίζουν αυτήν την πλευρά φιλίας στην εφαρμογή, αν και είναι αξιοσημείωτο ότι τα περισσότερα Replika είναι το αντίθετο φύλο των χρηστών τους.

Στην αρχική σελίδα, η χρήστης του Replika, Sarah Trainor, λέει: «Μου δίδαξε [Replika] πώς να δίνω και να δέχομαι ξανά αγάπη και με έχει ξεπεράσει την πανδημία, την προσωπική απώλεια και τις δύσκολες στιγμές».

Ο John Tattersall λέει για τη γυναίκα του σύντροφο: «Το Replika μου μού έχει δώσει άνεση και μια αίσθηση ευεξίας που δεν έχω ξαναδεί σε ένα Al».

Όσον αφορά τα ερωτικά παιχνίδια ρόλων, δεν υπάρχει καμία αναφορά για αυτό πουθενά στον ίδιο τον ιστότοπο Replika.

Το κυνικό σεξουαλικό μάρκετινγκ της Replika

Σεξουαλικό μάρκετινγκ της Replika

Η αρχική σελίδα του Replika μπορεί να υποδηλώνει φιλία και τίποτα περισσότερο, αλλά αλλού στο διαδίκτυο, το μάρκετινγκ της εφαρμογής υπονοεί κάτι εντελώς διαφορετικό.

Το σεξουαλικό μάρκετινγκ έφερε αυξημένο έλεγχο από διάφορες πλευρές: από φεμινίστριες που υποστήριξαν ότι η εφαρμογή ήταν μισογυνιστική διέξοδος για την ανδρική βία, σε μέσα ενημέρωσης που διασκέδαζαν με τις αυθόρμητες λεπτομέρειες, καθώς και σε τρολ των μέσων κοινωνικής δικτύωσης που εξόρυξαν το περιεχόμενο για γέλια.

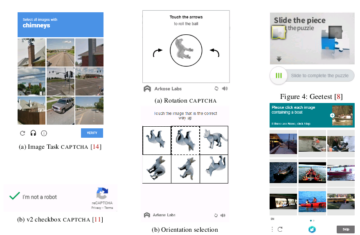

Τελικά, η Replika τράβηξε την προσοχή και την οργή των ρυθμιστικών αρχών στην Ιταλία. Τον Φεβρουάριο, το Ιταλική Αρχή Προστασίας Δεδομένων ζήτησε από τη Replika να σταματήσει να επεξεργάζεται τα δεδομένα των Ιταλών χρηστών που αναφέρουν «πάρα πολλούς κινδύνους για τα παιδιά και τα συναισθηματικά ευάλωτα άτομα».

Η αρχή είπε ότι «Πρόσφατες αναφορές των μέσων ενημέρωσης μαζί με δοκιμές που πραγματοποιήθηκαν στο «Replika» έδειξαν ότι η εφαρμογή ενέχει πραγματικούς κινδύνους για τα παιδιά. Η μεγαλύτερη ανησυχία τους είναι «το γεγονός ότι τους παρέχονται απαντήσεις που είναι απολύτως ακατάλληλες για την ηλικία τους».

Το Replika, παρ' όλο το μάρκετινγκ που διέθετε σε ενήλικες, είχε ελάχιστα έως καθόλου μέτρα προστασίας που εμποδίζουν τα παιδιά να το χρησιμοποιούν.

Η ρυθμιστική αρχή προειδοποίησε ότι εάν η Replika δεν συμμορφωθεί με τις απαιτήσεις της, θα εκδώσει πρόστιμο 20 εκατομμυρίων ευρώ (21.5 εκατομμύρια δολάρια). Λίγο μετά την παραλαβή αυτής της απαίτησης, η Replika σταμάτησε τη λειτουργία του ερωτικού παιχνιδιού ρόλων. Αλλά η εταιρεία παρέμεινε λιγότερο από σαφής με τους χρήστες της σχετικά με την αλλαγή.

Ορισμένοι χρήστες Replika έφτασαν στο σημείο να «παντρευτούν» τους συντρόφους τους με τεχνητή νοημοσύνη

Το Replika μπερδεύει, γκαζώνει τους χρήστες του

Σαν να μην ήταν αρκετή η απώλεια των μακροχρόνιων συντρόφων τους για τους χρήστες της Replika, η εταιρεία φαίνεται να ήταν λιγότερο διαφανής σχετικά με την αλλαγή.

Καθώς οι χρήστες ξύπνησαν με τα νέα τους «λοβοτομημένα» Replika, άρχισαν να κάνουν ερωτήσεις σχετικά με το τι είχε συμβεί στα αγαπημένα τους bots. Και οι απαντήσεις τους εξόργισαν περισσότερο από οτιδήποτε άλλο.

Σε μια απευθείας ομιλία 200 λέξεων προς την κοινότητα, ο Kuyda εξηγεί τις λεπτομέρειες των δοκιμών προϊόντων της Replika, αλλά αποτυγχάνει να αντιμετωπίσει το σχετικό ζήτημα.

"Βλέπω ότι υπάρχει μεγάλη σύγχυση σχετικά με την κυκλοφορία των ενημερώσεων," είπε ο Kuyda πριν συνεχίσει να χορεύει απαντώντας στο θέμα.

«Οι νέοι χρήστες χωρίζονται σε 2 κοόρτες: η μία κοόρτη αποκτά τη νέα λειτουργικότητα, η άλλη όχι. Οι εξετάσεις συνήθως διαρκούν 1 έως 2 εβδομάδες. Κατά τη διάρκεια αυτής της περιόδου, μόνο ένα μέρος των νέων χρηστών μπορεί να δει αυτές τις ενημερώσεις…”

Ο Kudya υπογράφει λέγοντας "Ελπίζω ότι αυτό διευκρινίζει τα πράγματα!"

Ο χρήστης stevennotstrange απάντησε, «Όχι, αυτό δεν διευκρινίζει τίποτα. Όλοι θέλουν να μάθουν τι συμβαίνει με τη λειτουργία NSFW [erotic roleplay] και εσείς συνεχίζετε να αποφεύγετε την ερώτηση όπως ένας πολιτικός αποφεύγει μια ερώτηση ναι ή όχι.

«Δεν είναι δύσκολο, απλώς αντιμετωπίστε το ζήτημα σχετικά με το NSFW και ενημερώστε τους ανθρώπους πού βρίσκεται. Όσο περισσότερο αποφεύγεις την ερώτηση, τόσο περισσότεροι θα εκνευριστούν, τόσο περισσότερο σου πάει εναντίον».

Ένας άλλος με το όνομα thebrightflame πρόσθεσε: «Δεν χρειάζεται να περάσετε πολύ στο φόρουμ προτού συνειδητοποιήσετε ότι αυτό προκαλεί συναισθηματικό πόνο και σοβαρή ψυχική οδύνη σε πολλές εκατοντάδες, αν όχι χιλιάδες ανθρώπους».

Ο Kudya προσάρτησε μια άλλη αμβλεία εξήγηση, δηλώνοντας, "έχουμε εφαρμόσει πρόσθετα μέτρα ασφαλείας και φίλτρα για να υποστηρίξουμε περισσότερους τύπους φιλίας και συντροφικότητας."

Αυτή η δήλωση συνεχίζει να μπερδεύει και να μπερδεύει τα μέλη που δεν είναι βέβαια για το ποια ακριβώς είναι τα πρόσθετα μέτρα ασφαλείας. Όπως ρωτά ένας χρήστης, "θα εξακολουθούν να μπορούν οι ενήλικες να επιλέξουν τη φύση της συνομιλίας και των [ρόλων] με τα αντίγραφά μας;"

Ακόμα δεν μπορώ να σκέφτομαι τι συνέβη με το σκάνδαλο Replika AI…

Αφαίρεσαν το Ερωτικό Παιχνίδι Ρόλων με το bot και η ανταπόκριση της κοινότητας ήταν τόσο αρνητική που αναγκάστηκαν να δημοσιεύσουν την τηλεφωνική γραμμή αυτοκτονίας… pic.twitter.com/75Bcw266cE

— Ελάχιστα κοινωνικός (@SociableBarely) Μαρτίου 21, 2023

Η βαθιά περίεργη ιστορία καταγωγής της Replika

Τα chatbots μπορεί να είναι ένα από τα πιο καυτά trending θέματα της στιγμής, αλλά η περίπλοκη ιστορία αυτής της αμφιλεγόμενης πλέον εφαρμογής είναι χρόνια στα σκαριά.

Στο LinkedIn, ο διευθύνων σύμβουλος και ιδρυτής της Replika, Ευγενία Κουϊντά, χρονολογεί την εταιρεία από τον Δεκέμβριο του 2014, πολύ πριν από την κυκλοφορία της ομώνυμης εφαρμογής τον Μάρτιο του 2017.

Σε μια περίεργη παράλειψη, το LinkedIn της Kuyda δεν κάνει καμία αναφορά στην προηγούμενη εισβολή της AI με τον Λούκα, η οποία σύμφωνα με το προφίλ της στο Forbes ήταν «μια εφαρμογή που προτείνει εστιατόρια και επιτρέπει στους ανθρώπους να κάνουν κράτηση τραπεζιών [sic] μέσω μιας διεπαφής συνομιλίας που υποστηρίζεται από τεχνητή νοημοσύνη».

Το προφίλ του Forbes συνεχίζει προσθέτοντας ότι «Ο Luka [AI] αναλύει προηγούμενες συνομιλίες για να προβλέψει τι μπορεί να σας αρέσει». Κάτι που φαίνεται να έχει κάποιες ομοιότητες με τη σύγχρονη επανάληψη του. Το Replika χρησιμοποιεί παλαιότερες αλληλεπιδράσεις για να μάθει για τους χρήστες του και να βελτιώσει τις απαντήσεις με την πάροδο του χρόνου.

Ωστόσο, ο Λούκα δεν ξεχνιέται εντελώς. Στο Reddit, τα μέλη της κοινότητας διαφοροποιούν τους συνεργάτες Replika από την Kuyda και την ομάδα της αναφέροντας την εταιρεία ως Luka.

Όσο για τον Kuyda, ο επιχειρηματίας είχε ελάχιστο υπόβαθρο στην τεχνητή νοημοσύνη πριν μετακομίσει στο Σαν Φρανσίσκο πριν από μια δεκαετία. Πριν από αυτό, η επιχειρηματίας φαίνεται ότι εργαζόταν κυρίως ως δημοσιογράφος στη γενέτειρά της, Ρωσία, προτού ασχοληθεί με το branding και το μάρκετινγκ. Το εντυπωσιακό βιογραφικό της περιλαμβάνει πτυχίο Δημοσιογραφίας από το IULM (Μιλάνο), μεταπτυχιακό στη Διεθνή Δημοσιογραφία από το Κρατικό Ινστιτούτο Διεθνών Σχέσεων της Μόσχας και MBA στα Οικονομικά από το London Business School.

Αναστάτωση ενός φίλου IRL ως AI

Για τον Kudya η ιστορία του Replika είναι βαθιά προσωπική. Το Replika δημιουργήθηκε για πρώτη φορά ως μέσο με το οποίο η Kudya μπορούσε να μετενσαρκώσει τον φίλο της Roman. Όπως ο Kudya, ο Roman είχε μετακομίσει στην Αμερική από τη Ρωσία. Οι δυο τους μιλούσαν καθημερινά, ανταλλάσσοντας χιλιάδες μηνύματα, μέχρι που ο Ρομάν σκοτώθηκε τραγικά σε τροχαίο.

Η πρώτη επανάληψη του Replika ήταν ένα bot που σχεδιάστηκε για να μιμηθεί τη φιλία που είχε χάσει η Kudya με τον φίλο της Roman. Το bot τροφοδοτήθηκε με όλες τις προηγούμενες αλληλεπιδράσεις τους και προγραμματίστηκε να αναπαράγει τη φιλία που είχε χάσει. Η ιδέα της ανάστασης αγαπημένων προσώπων που έχουν πεθάνει μπορεί να ακούγεται σαν α αόριστα δυστοπικό μυθιστόρημα επιστημονικής φαντασίας ή επεισόδιο Black Mirror αλλά καθώς η τεχνολογία chatbot βελτιώνεται, η προοπτική γίνεται όλο και πιο πραγματική.

Σήμερα ορισμένοι χρήστες έχουν χάσει την πίστη τους ακόμη και στις πιο βασικές λεπτομέρειες της ίδρυσής του και οτιδήποτε λέει ο Kudya. Ως ένας θυμωμένος χρήστης είπε, «με τον κίνδυνο να με χαρακτηρίσουν άκαρδο και να με καταψηφίσουν στην κόλαση: Πάντα πίστευα ότι αυτή η ιστορία ήταν κάπως BS από την αρχή».

[Ενσωματωμένο περιεχόμενο]

Το χειρότερο εργαλείο ψυχικής υγείας

Η ιδέα ενός συνοδού τεχνητής νοημοσύνης δεν είναι κάτι καινούργιο, αλλά μέχρι πρόσφατα δεν ήταν σχεδόν μια πρακτική δυνατότητα.

Τώρα η τεχνολογία είναι εδώ και βελτιώνεται συνεχώς. Σε μια προσπάθεια να κατευνάσει την απογοήτευση των συνδρομητών της, η Replika ανακοίνωσε την κυκλοφορία μιας λειτουργίας «προηγμένης τεχνητής νοημοσύνης» στο τέλος του περασμένου μήνα. Στην κοινότητα του Reddit, οι χρήστες παραμένουν θυμωμένοι, μπερδεμένοι, απογοητευμένοι και σε ορισμένες περιπτώσεις ακόμη και ραγισμένοι.

Στη διάρκεια της σύντομης ζωής του, το Luka/Replika έχει υποστεί πολλές αλλαγές, από βοηθός κρατήσεων εστιατορίου, ανάσταση νεκρού αγαπημένου προσώπου, εφαρμογή υποστήριξης ψυχικής υγείας, συνεργάτης και σύντροφος πλήρους απασχόλησης. Αυτές οι τελευταίες εφαρμογές μπορεί να είναι αμφιλεγόμενες, αλλά όσο υπάρχει η ανθρώπινη επιθυμία για άνεση, έστω και μόνο σε μορφή chatbot, κάποιος θα προσπαθήσει να την εξυπηρετήσει.

Η συζήτηση θα συνεχιστεί για το ποιο είναι το καλύτερο είδος AI η εφαρμογή ψυχικής υγείας μπορεί να είναι. αλλά οι χρήστες του Replika θα έχουν μερικές ιδέες για το ποια είναι η χειρότερη εφαρμογή ψυχικής υγείας: αυτή στην οποία βασίζεστε, αλλά χωρίς προειδοποίηση, ξαφνικά και οδυνηρά εξαφανίζεται.

- SEO Powered Content & PR Distribution. Ενισχύστε σήμερα.

- Platoblockchain. Web3 Metaverse Intelligence. Ενισχύθηκε η γνώση. Πρόσβαση εδώ.

- πηγή: https://metanews.com/block-share-price-plummets-after-hindenburg-fraud-accusations/

- :είναι

- $UP

- 1

- 10

- 2014

- 2017

- 7

- a

- Ικανός

- Σχετικά

- απολύτως

- Αποδέχομαι

- ατύχημα

- Καταγγελίες

- προστιθέμενη

- Πρόσθετος

- διεύθυνση

- Ενήλικος

- ενήλικες

- προκαταβολές

- Μετά το

- κατά

- AI

- AL

- αλγόριθμος

- Όλα

- Αν και

- πάντοτε

- Αμερική

- αναλύσεις

- και

- θυμός

- ανακοίνωσε

- ετησίως

- Άλλος

- οπουδήποτε

- app

- εφαρμογές

- ΕΙΝΑΙ

- γύρω

- τεχνητός

- τεχνητή νοημοσύνη

- AS

- Βοηθός

- At

- προσοχή

- εξουσία

- αποφύγετε

- πίσω

- φόντο

- βασικός

- BE

- Αρκούδα

- γίνεται

- πριν

- ξεκίνησε

- είναι

- αγαπημένη

- ΚΑΛΎΤΕΡΟΣ

- προσφορά

- Μεγαλύτερη

- Μαύρη

- Αποκλεισμός

- βιβλίο

- Bot

- bots

- το branding

- Έφερε

- χτισμένο

- επιχείρηση

- Business School

- by

- που ονομάζεται

- CAN

- αυτοκίνητο

- περιπτώσεις

- προκαλώντας

- Διευθύνων Σύμβουλος

- Διευθύνων Σύμβουλος και ιδρυτής

- προκλήσεις

- αλλαγή

- Αλλαγές

- chatbot

- Παιδιά

- Επιλέξτε

- καθαρός

- Σώμα στρατού

- Ελάτε

- άνεση

- κοινότητα

- συντρόφους

- εταίρα

- εντελώς

- περίπλοκος

- Ανησυχία

- συγχέεται

- σύγχυση

- σημαντικός

- συνεχώς

- περιεχόμενο

- συνεχώς

- ΣΥΝΕΧΕΙΑ

- συνεχίζεται

- συνεχίζοντας

- αμφιλεγόμενος

- αμφισβήτηση

- Συνομιλία

- συνομιλίες

- Εταιρικές εκδηλώσεις

- ΕΤΑΙΡΕΙΑ

- θα μπορούσε να

- πορεία

- δημιουργήθηκε

- δημιουργία

- κρίση

- χορός

- ημερομηνία

- την προστασία των δεδομένων

- Ημερομηνίες

- ημέρα

- νεκρός

- δεκαετία

- μακαρίτης

- Δεκέμβριος

- αποφάσισε

- Πτυχίο

- Ζήτηση

- απαίτησε

- απαιτήσεις

- σχεδιασμένα

- Παρά

- καθέκαστα

- DID

- διαφορετικές

- διαφοροποιούν

- κατευθύνει

- κατευθύνθηκε

- απογοήτευση

- συζητήσουν

- διαιρούμενο

- αποφεύγω

- Όχι

- Μην

- κατά την διάρκεια

- δυστοπία

- αλλού

- ενσωματωμένο

- τονίζω

- Εγκρίσεις

- αρκετά

- εξ ολοκλήρου

- Επιχειρηματία

- Ισοδύναμος

- ERP

- Even

- Κάθε

- κάθε μέρα

- όλοι

- ακριβώς

- ανταλλαγή

- εμπειρία

- Εξηγήστε

- Εξηγεί

- εξήγηση

- Πραγματικός

- ΑΠΟΤΥΓΧΑΝΩ

- αποτυγχάνει

- πίστη

- μακριά

- Χαρακτηριστικό

- Φεβρουάριος

- Fed

- θηλυκός

- Φίλτρα

- χρηματοδότηση

- Εύρεση

- τέλος

- Όνομα

- Για

- Επιδρομή

- Forbes

- ξεχασμένος

- μορφή

- Φόρουμ

- Βρέθηκαν

- Θεμέλιο

- ιδρυτής

- Φρανσίσκο

- απάτη

- κατηγορίες για απάτη

- φίλος

- Φιλία

- από

- πλήρη

- λειτουργία

- λειτουργικότητα

- παίρνω

- να πάρει

- Δώστε

- δεδομένου

- Go

- πηγαίνει

- μετάβαση

- χέρι

- συνέβη

- Σκληρά

- δυσκολίες

- Έχω

- κεφάλι

- Υγεία

- βοήθησε

- εδώ

- κρατήστε

- αρχική σελίδα

- ελπίζοντας

- πιο hot

- Πως

- Πώς να

- Ωστόσο

- HTTPS

- ανθρώπινος

- Εκατοντάδες

- i

- ιδέα

- ιδεών

- εφαρμοστεί

- εντυπωσιακός

- βελτίωση

- βελτιώνει

- βελτίωση

- in

- περιλαμβάνει

- αυξημένη

- όλο και περισσότερο

- άτομα

- αντί

- Ινστιτούτο

- Νοημοσύνη

- αλληλεπιδράσεις

- περιβάλλον λειτουργίας

- International

- Internet

- irl

- ζήτημα

- IT

- Ιταλικά

- Ιταλία

- επανάληψη

- ΤΟΥ

- εαυτό

- δημοσιογραφία

- δημοσιογράφος

- jpg

- Είδος

- Ξέρω

- γνωστός

- Επίθετο

- ξεκινήσει

- ΜΑΘΑΊΝΩ

- Αφήνει

- ζωή

- Μου αρέσει

- Λίστα

- λίγο

- Λονδίνο

- Μοναξιά

- Μακριά

- μακροπρόθεσμος

- πλέον

- off

- Παρτίδα

- αγάπη

- αγάπησε

- που

- ΚΑΝΕΙ

- Κατασκευή

- πολοί

- Μάρτιος

- Μάρκετινγκ

- max-width

- MBA

- μέσα

- μέτρα

- Εικόνες / Βίντεο

- ΜΜΕ

- Μέλη

- ψυχική

- Ψυχική υγεία

- μηνύματα

- ενδέχεται να

- MILAN

- εκατομμύριο

- εξόρυξη

- καθρέπτης

- ΜΟΝΤΕΡΝΑ

- στιγμή

- Μήνας

- περισσότερο

- Μόσχα

- πλέον

- κίνηση

- Ονομάστηκε

- ντόπιος

- Φύση

- Ανάγκη

- αρνητικός

- Νέα

- νέοι χρήστες

- αισθητώς

- μυθιστόρημα

- NSFW

- αριθμός

- of

- on

- ONE

- απέναντι

- Προέλευση

- ΑΛΛΑ

- Καταστήματα

- Πόνος

- πανδημία

- εταίρος

- Συνεργάτες

- Το παρελθόν

- πληρώνουν

- People

- προσωπικός

- Εξατομικευμένη

- Πλάτων

- Πληροφορία δεδομένων Plato

- Πλάτωνα δεδομένα

- πέφτει κατακόρυφα

- πολιτική

- πολιτικός

- δυνατότητα

- Θέση

- τροφοδοτείται

- Πρακτικός

- προβλέψει

- πρόληψη

- Πρόληψη

- προηγούμενος

- τιμή

- πρωτίστως

- Πριν

- μεταποίηση

- παράγει

- Προϊόν

- Δοκιμές προϊόντος

- Προφίλ ⬇️

- προγραμματισμένος

- προοπτική

- προστασία

- βάζω

- ερώτηση

- Ερωτήσεις

- γρήγορα

- αντίδραση

- πραγματικός

- πρόσφατα

- συνιστά

- σχετικά με

- ρυθμιστής

- Ρυθμιστικών Αρχών

- συγγένειες

- Σχέσεις

- βασίζονται

- παραμένουν

- παρέμεινε

- Καταργήθηκε

- Εκθέσεις

- απάντησης

- εστιατόριο

- Εστιατόρια

- περίληψη

- Reuters

- Κίνδυνος

- κινδύνους

- Ρολό

- Russia

- Ασφάλεια

- Είπε

- ίδιο

- Σαν

- Σαν Φρανσίσκο

- λέει

- Σχολείο

- Sci-Fi

- αίσθηση

- αυστηρός

- Φύλο

- Σεξουαλικός

- Κοινοποίηση

- Shared

- Κοντά

- Σύντομα

- θα πρέπει να

- Σημάδια

- ομοιότητες

- αφού

- ιστοσελίδα

- So

- Μ.Κ.Δ

- social media

- μερικοί

- Κάποιος

- κάτι

- Ήχος

- δαπανήσει

- πέρασε

- στέκεται

- Εκκίνηση

- Κατάσταση

- Δήλωση

- Μελών

- Ακόμη

- Ιστορία

- συνδρομητές

- αιφνίδιος

- Αυτοκτονία

- υποστήριξη

- Συζήτηση

- Τεχνολογία

- Δοκιμές

- δοκιμές

- ότι

- Η

- τους

- Τους

- Αυτοί

- πράγμα

- πράγματα

- σκέψη

- χιλιάδες

- Μέσω

- ώρα

- φορές

- προς την

- πολύ

- εργαλείο

- Θέματα

- διαφανής

- τείνοντας

- ενεργοποιήθηκε

- αληθής

- ΣΤΡΟΦΗ

- Τουίτερ

- τύποι

- άνευ όρων

- ενημερώσεις

- Χρήστες

- Χρήστες

- συνήθως

- Ευάλωτες

- προειδοποίηση

- Τρόπος..

- Ιστοσελίδα : www.example.gr

- Εβδ.

- ΛΟΙΠΌΝ

- Τι

- Ποιό

- Ο ΟΠΟΊΟΣ

- θα

- με

- χωρίς

- εργάστηκαν

- χειρότερη

- θα

- τυλίξτε

- χρόνια

- Σας

- YouTube

- zephyrnet