Σχόλιο Περισσότεροι από 250 μαζικοί πυροβολισμοί έχουν σημειωθεί στις ΗΠΑ μέχρι στιγμής φέτος και οι υποστηρικτές της τεχνητής νοημοσύνης πιστεύουν ότι έχουν τη λύση. Όχι έλεγχος όπλων, αλλά καλύτερη τεχνολογία, αναπάντεχα.

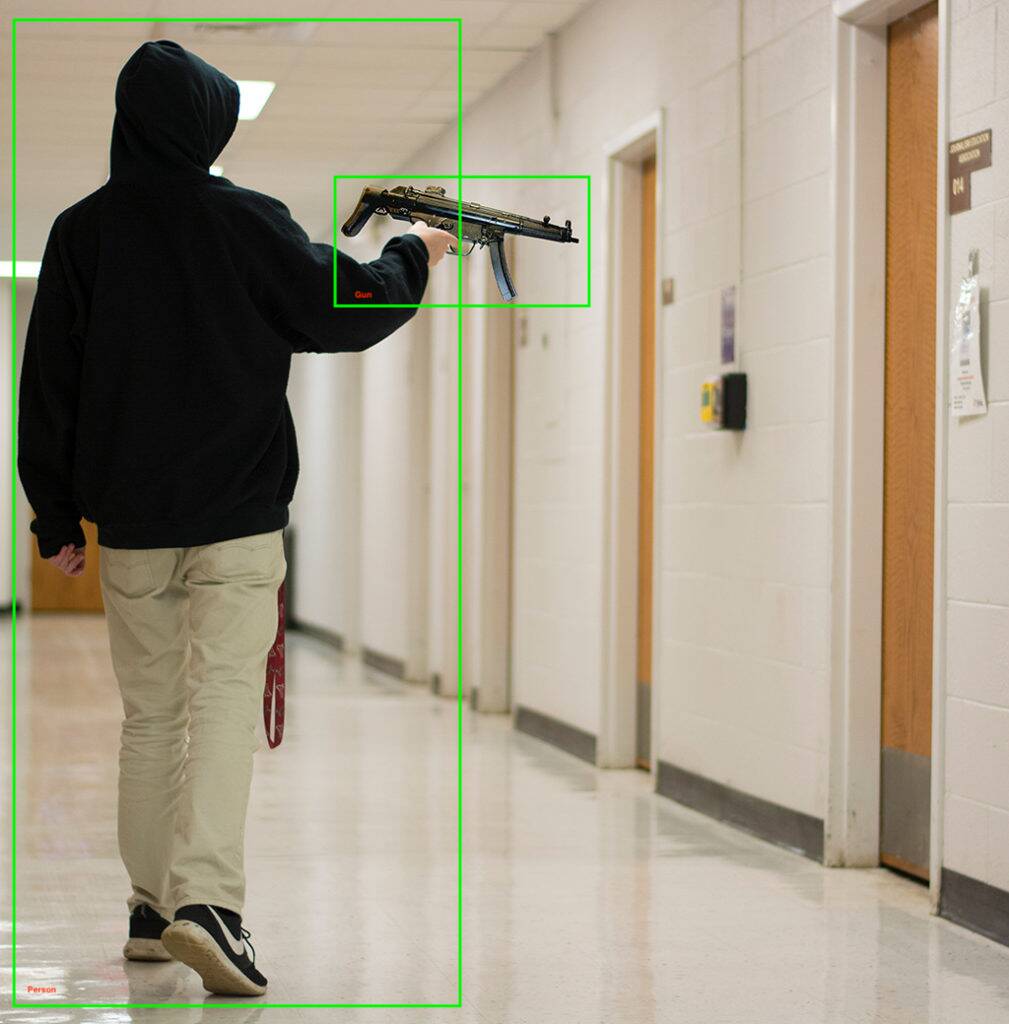

Η biz μηχανικής μάθησης Kogniz ανακοίνωσε την Τρίτη ότι προσθέτει ένα έτοιμο για ανάπτυξη μοντέλο ανίχνευσης όπλου στην πλατφόρμα υπολογιστικής όρασής του. Το σύστημα, όπως μας είπαν, μπορεί να ανιχνεύσει όπλα που φαίνονται από κάμερες ασφαλείας και να στέλνει ειδοποιήσεις σε όσους κινδυνεύουν, να ειδοποιούν την αστυνομία, να κλειδώνουν τα κτίρια και να εκτελούν άλλες εργασίες ασφαλείας.

Εκτός από τον εντοπισμό πυροβόλων όπλων, η Kogniz χρησιμοποιεί τις υπόλοιπες μονάδες όρασης υπολογιστή για να παρατηρήσει ασυνήθιστη συμπεριφορά, όπως παιδιά που κάνουν σπριντ στους διαδρόμους ή κάποιος που σκαρφαλώνει μέσα από ένα παράθυρο, κάτι που θα μπορούσε να υποδηλώνει ενεργό σκοπευτή.

Αν αναρωτιέστε για το ψευδώς θετικό ή το ποσοστό σφάλματος του κώδικα, η Kogniz λέει ότι διαθέτει «τεχνητή νοημοσύνη πολλαπλών περασμάτων» και «μια εκπαιδευμένη ομάδα ανθρώπινων επαληθευτών» που ελέγχει τα αποτελέσματα του λογισμικού ανίχνευσης. Είτε καλωσορίζετε αυτό το επιπλέον επίπεδο επιβεβαίωσης, είτε το βλέπετε ως τεχνολογία που δυνητικά υποχωρεί στους ανθρώπους ακριβώς όταν οι υπολογιστές χρειάζονται περισσότερο.

«[Η λύση μας είναι] να διευκολύνουμε δραματικά τις εταιρείες, τις κυβερνητικές υπηρεσίες, τα σχολεία και τα νοσοκομεία να προετοιμαστούν και στη συνέχεια να συμβάλουν στη μείωση της ζημιάς που προκαλείται από μια εκδήλωση ενεργού σκοπευτή», δήλωσε ο CEO της Kogniz, Daniel Putterman.

Η Kogniz δεν είναι η πρώτη εταιρεία υπολογιστικής όρασης που μπήκε στο παιχνίδι αναγνώρισης όπλων – υπάρχει μια σημαντική λίστα εταιρειών που αναπτύσσουν παρόμοια τεχνολογία και ορισμένες, όπως η ZeroEyes, δεν ειδικεύονται σε τίποτα άλλο εκτός από την ανίχνευση πυροβόλων όπλων.

«Απλώνοντας την προσοχή τους σε πολλαπλές προσφορές, οι προγραμματιστές είναι λιγότερο ικανοί να παρέχουν την καλύτερη υπηρεσία στον εντοπισμό όπλων», δήλωσε η ZeroEyes σε μια ανάρτηση. Η τεχνολογία του ZeroEyes έχει αναπτυχθεί σε σχολεία σε 14 πολιτείες, μεταξύ των οποίων Γυμνάσιο της Οξφόρδης στο μετρό του Ντιτρόιτ, όπου ένας 15χρονος πυροβολητής σκότωσε τέσσερις και τραυμάτισε επτά πέρυσι.

Άλλοι προμηθευτές – όπως το Defendry, το οποίο διαθέτει μια σουίτα ασφαλείας που περιλαμβάνει μια εφαρμογή κουμπιών πανικού, αισθητήρες ήχου πυροβολισμών, drones πρώτης απάντησης και τεχνητή νοημοσύνη ανίχνευσης όπλων. και Omnilert – βρίσκονται σε αυτή την καταθλιπτική αναπτυσσόμενη αγορά. Πρόσθετες εταιρείες στον τομέα ανίχνευσης όπλων AI περιλαμβάνουν τις Arcarith, Athena Securities και Scylla.

Υπάρχει πραγματικά αρκετός χρόνος;

Το 2019, η απάντηση της αστυνομίας σε έναν μαζικό πυροβολισμό στο Ντέιτον του Οχάιο ήταν μόλις 32 δευτερόλεπτα, κατά τη διάρκεια των οποίων έχασαν τη ζωή τους εννέα άνθρωποι. Ένας πυροβολισμός το 2021 σε εγκαταστάσεις της FedEx της Indianapolis που σκότωσε εννέα άτομα τελείωσε επίσης πριν προλάβουν να φτάσουν οι αστυνομικοί, παρόλο που το έκαναν μέσα σε λίγα λεπτά.

Και οι δύο αυτές περιπτώσεις εγείρουν το ερώτημα εάν η ανίχνευση όπλου τεχνητής νοημοσύνης μπορεί να μειώσει αρκετά τους χρόνους απόκρισης για να σώσει ζωές. Ειδικά αν οι αστυνομικοί φοβούνται πολύ ή επιλέξουν να μην απαντήσουν πραγματικά, όπως στη μαζική δολοφονία στο Uvalde.

Έχουν προταθεί αρκετές άλλες μέθοδοι πρόληψης μαζικών πυροβολισμών που βασίζονται σε τεχνητή νοημοσύνη, όπως π.χ έξυπνα όπλα που δεν θα πυροβολήσει αν εντοπίσουν ανθρώπινο στόχο. Άλλοι έχουν προτείνει την εκπαίδευση AI σε δεδομένα από προηγούμενες πυροβολισμούς, τοπικές αγορές όπλων και κοινωνικοοικονομικά δεδομένα για να βρουν τάσεις ενδεικτικές ενός προγραμματισμένου πυροβολισμού, καθώς και σάρωση των μέσων κοινωνικής δικτύωσης για παρόμοιους δείκτες.

Υπάρχει επίσης AI προκατάληψη, μια καλά τεκμηριωμένο πρόβλημα ότι ακόμη και διαφορετικά σύνολα δεδομένων και ισορροπημένη εκπαίδευση δεν φαίνεται να λύνεται. Δείτε μια ανάπτυξη τεχνολογίας αναγνώρισης προσώπου και όπλων το 2020 σε μια σχολική περιφέρεια της Νέας Υόρκης: τα μηνύματα ηλεκτρονικού ταχυδρομείου μεταξύ της σχολικής περιφέρειας και της εταιρείας που ανέπτυξε το σύστημα δείχνουν συνήθως ανησυχίες σχετικά με αυτό λανθασμένη ταυτοποίηση πράγματα, όπως λαβές σκούπας για όπλα.

Μιλώντας στο δημοσίευμα της Γιούτα Deseret News, ο ανώτερος αναλυτής πολιτικής της ACLU, Jay Stanley είπε Ανησυχούσε ότι τα συστήματα υπολογιστικής όρασης θα μπορούσαν να οδηγήσουν σε έναν κόσμο «όπου οι άνθρωποι αποφεύγουν να κάνουν κάτι τόσο απλό όπως να παρακάμπτουν ένα πεζοδρόμιο από φόβο μήπως ενεργοποιήσουν ανιχνευτές ανωμαλιών και ανακρίνονται από την αστυνομία».

Ωστόσο, μια πιθανή χρήση της τεχνητής νοημοσύνης μπορεί να έχει περισσότερες υποσχέσεις: το 2018 μελέτη από το Cincinnati Children's Hospital Medical Center διαπίστωσε ότι η ανάλυση AI των θεραπευτικών συνεδριών συμφωνούσε με τις εκτιμήσεις κινδύνου των ψυχιάτρων και των συμβούλων στο 91 τοις εκατό των περιπτώσεων. Η προσθήκη δημογραφικών και κοινωνικοοικονομικών δεδομένων βελτίωσε μόνο τα αποτελέσματα στον εντοπισμό των νέων που κινδύνευαν να διαπράξουν μια βίαιη πράξη.

Με τόσες πολλές πιθανές επιπλοκές, είναι πραγματικά έτοιμη η μηχανική μάθηση να αποτρέψει τη μαζική δολοφονία;

Η βία με όπλα είναι η νούμερο ένα δολοφόνος παιδιών και εφήβων στην Αμερική, αφαιρώντας κατά μέσο όρο 12 ζωές νέων και τραυματίζοντας άλλους 32, κάθε μέρα. Η τεχνητή νοημοσύνη μπορεί να βοηθήσει, αλλά χωρίς να αντιμετωπιστούν οι ελλείψεις της, χρειάζονται ίσως και λιγότερες τεχνολογικές προσεγγίσεις. Η ισχυρότερη, πιο ευρέως διαθέσιμη φροντίδα ψυχικής υγείας μπορεί να είναι μια καλή αρχή.

Νωρίτερα αυτό το μήνα, ο Πρόεδρος Μπάιντεν που ονομάζεται για, μεταξύ άλλων, απαγόρευση όπλων επίθεσης, διευρυμένους ελέγχους ιστορικού και περιορισμούς στη χωρητικότητα των γεμιστήρα, τα οποία ονόμασε «λογικά μέτρα κοινής λογικής». ®

- AI

- αι τέχνη

- ι γεννήτρια τέχνης

- ρομπότ ai

- τεχνητή νοημοσύνη

- πιστοποίηση τεχνητής νοημοσύνης

- τεχνητή νοημοσύνη στον τραπεζικό τομέα

- ρομπότ τεχνητής νοημοσύνης

- ρομπότ τεχνητής νοημοσύνης

- λογισμικό τεχνητής νοημοσύνης

- blockchain

- συνέδριο blockchain ai

- Coingenius

- συνομιλητική τεχνητή νοημοσύνη

- κρυπτοσυνεδριο αι

- του νταλ

- βαθιά μάθηση

- έχεις google

- μάθηση μηχανής

- Πλάτων

- πλάτων αι

- Πληροφορία δεδομένων Plato

- Παιχνίδι Πλάτωνας

- Πλάτωνα δεδομένα

- platogaming

- κλίμακα αι

- σύνταξη

- Το μητρώο

- zephyrnet