Análisis de datos con Scala

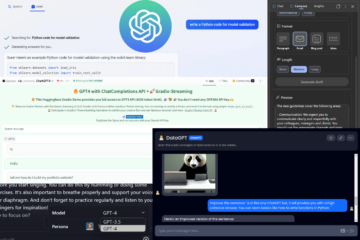

Es muy importante elegir la herramienta adecuada para el análisis de datos. En los foros de Kaggle, donde se llevan a cabo concursos internacionales de ciencia de datos, la gente suele preguntar qué herramienta es mejor. R y Python están en la parte superior de la lista. En este artículo, le informaremos sobre una pila alternativa de tecnologías de análisis de datos, basada en Scala.

By Roman Zykov, Fundador / Científico de datos @ TopDataLab

Es muy importante elegir la herramienta adecuada para el análisis de datos. Sobre el Kaggle.com En los foros, donde se llevan a cabo concursos internacionales de ciencia de datos, la gente suele preguntar qué herramienta es mejor. R y Python están en la parte superior de la lista. En este artículo, le informaremos sobre una pila alternativa de tecnologías de análisis de datos, basadas en el lenguaje de programación Scala y Spark plataforma informática distribuida.

¿Cómo se nos ocurrió? En Retail Rocket hacemos mucho aprendizaje automático en conjuntos de datos muy grandes. Solíamos usar un montón de IPython + Pyhs2 (controlador de colmena para Python) + Pandas + Sklearn para desarrollar prototipos. A finales del verano de 2014, tomamos la decisión fundamental de cambiarnos a Spark, ya que los experimentos han demostrado que obtendremos de 3 a 4 veces la mejora del rendimiento en el mismo parque de servidores.

Otra ventaja es que podemos usar un lenguaje de programación para modelar y código que se ejecutará en servidores de producción. Esto fue un gran beneficio para nosotros, ya que antes usábamos 4 lenguajes simultáneamente: Hive, Pig, Java, Python. Es un problema para un pequeño equipo de ingenieros.

Spark admite trabajar con Python / Scala / Java a través de API. Decidimos elegir Scala porque es el lenguaje en el que está escrito Spark, lo que significa que podemos analizar su código fuente y corregir errores si es necesario. También es la JVM en la que se ejecuta Hadoop.

Debo decir que la elección no fue fácil, ya que nadie en el equipo conocía a Scala en ese momento.

Es un hecho bien conocido que para aprender a comunicarse bien en un idioma, es necesario sumergirse en el idioma y usarlo tanto como sea posible. Así que abandonamos la pila de Python a favor de Scala para el modelado y el análisis rápido de datos.

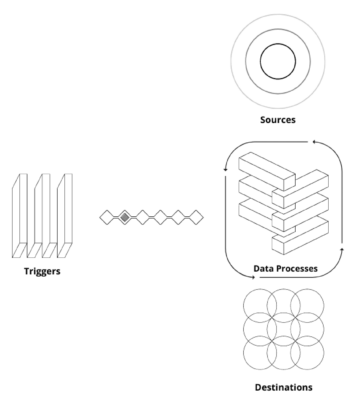

El primer paso fue encontrar un reemplazo para los portátiles IPython. Las opciones fueron las siguientes:

- Zeppelin - un cuaderno similar a IPython para Spark;

- ISparque;

- Cuaderno Spark;

- Cuaderno Spark IPython de IBM.

- apache toree

Hasta ahora, la elección ha sido ISpark porque es simple: es IPython para Scala / Spark. Ha sido relativamente fácil incorporar HighCharts y gráficos R. Y no tuvimos ningún problema para conectarlo al clúster de Yarn.

Tarea

Intentemos responder la pregunta: ¿el monto promedio de compra (AOV) en su tienda en línea depende de los parámetros estáticos del cliente, que incluyen la liquidación, el tipo de navegador (móvil / escritorio), el sistema operativo y la versión del navegador? Puedes hacer esto con Información mutua.

Usamos mucho la entropía para nuestros algoritmos de recomendación y análisis: la fórmula clásica de Shannon, la divergencia de Kullback-Leibler, la información mutua. Incluso presentamos un documento sobre este tema. Hay una sección separada, aunque pequeña, dedicada a estas medidas en el famoso libro de texto de Murphy sobre aprendizaje automático.

Analicémoslo en datos reales de Retail Rocket. De antemano, copié la muestra de nuestro clúster a mi computadora como un archivo csv.

Datos

Aquí usamos ISpark y Spark ejecutándose en modo local, lo que significa que todos los cálculos se realizan localmente y se distribuyen entre los núcleos del procesador. Todo se describe en comentarios al código. Lo más importante es que en la salida obtenemos RDD (estructura de datos Spark), que es una colección de clases de casos de tipo Row, que se define en el código. Esto le permitirá hacer referencia a los campos a través de ".", Por ejemplo _.categoryId.

La línea anterior usa el nuevo tipo de datos DataFrame agregado a Spark en la versión 1.3.0, es muy similar a la estructura similar en la biblioteca de pandas en Python. toDf recoge nuestra clase de caso Row, por lo que podemos referirnos al campo por su nombre.

Para un análisis más detallado, debemos seleccionar una sola categoría, preferiblemente con muchos datos. Para hacer esto, necesitamos obtener una lista de las categorías más populares.

Teóricamente, puede usar cualquier gráfico de HighCharts siempre que sea compatible con Wisp. Todos los gráficos son interactivos.

Intentemos hacer lo mismo, pero con R.

Ejecute el cliente R y grafique un carácter:

Información mutua

Los gráficos muestran que existe una relación, pero ¿nos confirmarán las métricas esta conclusión? Hay muchas maneras de hacer esto. En nuestro caso, utilizamos información mutua entre los valores de la tabla. Mide la dependencia mutua entre distribuciones de dos variables aleatorias (discretas).

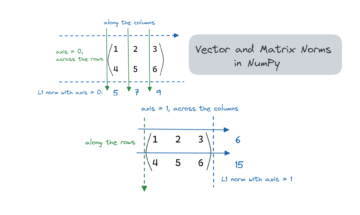

Para distribuciones discretas, se calcula mediante la fórmula:

Pero estamos interesados en una métrica más práctica: la Coeficiente de información máximo (MIC) que requiere algunos cálculos complicados para variables continuas. Así suena la definición de este parámetro.

Sea D = (x, y) un conjunto de n pares ordenados de elementos de variables aleatorias X e Y. Este espacio bidimensional está dividido por cuadrículas X e Y, agrupando los valores xey en particiones X e Y, respectivamente ( recuerda histogramas!).

donde B (n) es el tamaño de la malla, I ∗ (D, X, Y) es la información mutua de las particiones X e Y. El denominador especifica el logaritmo, que sirve para normalizar el MIC a los valores del segmento [0, 1]. MIC toma valores continuos en el intervalo [0,1]: para valores extremos es 1 si hay dependencia, 0 si no. Qué más se puede leer sobre este tema se enumera al final del artículo, en la lista de referencias.

El primer libro (Machine Learning: a Probabilistic Perspective) llama a MIC (información mutua) una correlación del siglo XXI. ¡Y aquí está el por qué! El siguiente gráfico muestra 21 dependencias (gráficos C a H). Se han calculado la correlación de Pearson y el MIC para ellos, y están marcados con las letras correspondientes en la tabla de la izquierda. Como podemos ver, la correlación de Pearson es casi nula, mientras que la MIC muestra una correlación (gráficos F, G, E).

Fuente: Reshef, DN, YA Reshef, HK Finucane, SR Grossman, G. McVean, PJ Turnbaugh, ES Lander, M. Mitzenmacher y PC Sabeti. "Detección de nuevas asociaciones en grandes conjuntos de datos".

Fuente: Reshef, DN, YA Reshef, HK Finucane, SR Grossman, G. McVean, PJ Turnbaugh, ES Lander, M. Mitzenmacher y PC Sabeti. "Detección de nuevas asociaciones en grandes conjuntos de datos".La siguiente tabla muestra una serie de métricas que se han calculado sobre diferentes dependencias: aleatorias, lineales, cúbicas, etc. La tabla muestra que el MIC se comporta muy bien, detectando dependencias no lineales.

Fuente: Reshef, DN, YA Reshef, HK Finucane, SR Grossman, G. McVean, PJ Turnbaugh, ES Lander, M. Mitzenmacher y PC Sabeti. "Detección de nuevas asociaciones en grandes conjuntos de datos".

Fuente: Reshef, DN, YA Reshef, HK Finucane, SR Grossman, G. McVean, PJ Turnbaugh, ES Lander, M. Mitzenmacher y PC Sabeti. "Detección de nuevas asociaciones en grandes conjuntos de datos".En nuestro caso, estamos ante un cálculo de MIC donde tenemos una variable continua Aov y todas las demás son discretas con valores desordenados, como el tipo de navegador. Para calcular el MIC correctamente necesitamos discretizar la variable Aov. Usaremos una solución preparada de explorardata.net. Hay un problema con esta solución: supone que ambas variables son continuas y se expresan en valores flotantes. Así que tendremos que engañar al código codificando los valores de las variables discretas en Float y cambiando aleatoriamente el orden de estas variables. Para hacer esto, tendremos que hacer muchas iteraciones con orden aleatorio (100), y tomaremos el valor máximo de MIC como resultado.

Para el experimento, agregué una variable aleatoria con una distribución uniforme y el AOV (Valor de compra promedio) en sí. Como podemos ver, casi todos los CIM estaban por debajo del CMI aleatorio, que puede considerarse un umbral de decisión "condicional". El Aov MIC es casi la unidad, lo cual es natural, porque la correlación consigo misma es igual a 1.

Surge una pregunta interesante: ¿por qué vemos una correlación en los gráficos, pero el MIC es cero? Podemos proponer muchas hipótesis, pero lo más probable es que en el caso de os Family sea bastante simple: la cantidad de máquinas con Windows es mucho mayor que la de otras:

Conclusión

Espero que Scala obtenga su popularidad entre los analistas de datos (científicos de datos). Es muy conveniente porque es posible trabajar con un portátil IPython estándar + obtener todas las características de Spark. Este código puede funcionar de forma segura con terabytes de datos, solo necesita cambiar la línea de configuración en ISpark, especificando el URI de su clúster.

Referencias

[ 1 ] Reshef, DN, YA Reshef, HK Finucane, SR Grossman, G. McVean, PJ Turnbaugh, ES Lander, M. Mitzenmacher y PC Sabeti. "Detección de nuevas asociaciones en grandes conjuntos de datos".

[ 2 ] MINE: Software de exploración no paramétrica de información máxima utilizando MIC

[ 3 ] Minepy: exploración máxima basada en información no parám (Python, C ++, MATLAB, Octave)) etric Exploration.

[ 4 ] Biblioteca Java con conjuntos de datos para MIC

[ 5 ] "Aprendizaje automático: una perspectiva probabilística" Kevin Patrick Murphy

[ 6 ] Resumen del código anterior

Bio: Roman Zykov es fundador y científico de datos en TopDataLab, y tiene 20 años de experiencia en análisis de datos, con una maestría en física y matemáticas aplicadas. Roman también escribió el libro “Ciencia de datos de Roman: cómo monetizar sus datos”, disponible en Amazon.

Original. Publicado de nuevo con permiso.

Relacionado:

Fuente: https://www.kdnuggets.com/2021/09/data-analysis-scala.html

- "

- &

- 100

- Ventaja

- algoritmos

- Todos

- Amazon

- entre

- análisis

- APACHE

- API

- aplicaciones

- artículo

- Bolt

- cada navegador

- loco

- build

- Manojo

- el cambio

- Gráficas

- código

- comentarios

- Competiciones

- informática

- datos

- análisis de los datos

- Ciencia de los datos

- científico de datos

- tratar

- deep learning

- desarrollar

- HIZO

- Computación distribuída

- conductor

- Ingeniería

- certificados

- etc.

- Excel

- experience

- experimento

- exploración

- Cara

- familia

- RÁPIDO

- Caracteristicas

- Terrenos

- Nombre

- Fijar

- fundador

- Marco conceptual

- GitHub

- Hadoop

- esta página

- Colmena

- Cómo

- Como Hacer

- HTTPS

- enorme

- información

- interactivo

- Internacionales

- IT

- Java

- idioma

- Idiomas

- large

- APRENDE:

- aprendizaje

- Biblioteca

- línea

- Etiqueta LinkedIn

- Lista

- local

- localmente

- Largo

- máquina de aprendizaje

- Máquinas

- matemáticas

- Métrica

- Microsoft

- modelado

- Más popular

- ordenadores portátiles

- en línea

- tienda en línea

- habiertos

- de código abierto

- funcionamiento

- sistema operativo

- Opciones

- solicite

- Otros

- Papel

- Personas

- actuación

- la perspectiva

- Física

- plataforma

- Popular

- portafolio

- Producción

- Programación

- proyecto

- comprar

- Python

- el comercio minorista

- Ejecutar

- correr

- Scala

- Ciencia:

- los científicos

- set

- establecimiento

- sencillos

- Tamaño

- habilidades

- chica

- So

- Software

- Espacio

- tienda

- Nuestras Historias

- Subido

- verano

- Soportado

- soportes

- Switch

- te

- Tecnologías

- Pruebas

- La gráfica

- equipo

- parte superior

- unidad

- URI

- us

- propuesta de

- web

- Wikipedia

- ventanas

- Actividades:

- X

- años

- cero