تصویر توسط نویسنده

اخیراً همه ما برای رسیدن به آخرین نسخههای منتشر شده در فضای LLM با مشکل مواجه بودهایم. در چند هفته گذشته، چندین جایگزین متن باز ChatGPT محبوب شده اند.

و در این مقاله با آن آشنا خواهیم شد ChatGLM سری و ChatGLM-6B، یک جایگزین متن باز و سبک ChatGPT.

بیا بریم!

محققان دانشگاه Tsinghua در چین روی توسعه سری مدلهای ChatGLM کار کردهاند که عملکردی قابل مقایسه با مدلهای دیگر مانند GPT-3 و BLOOM دارند.

ChatGLM یک مدل زبان بزرگ دوزبانه است که به دو زبان چینی و انگلیسی آموزش داده شده است. در حال حاضر مدل های زیر موجود است:

- ChatGLM-130B: یک LLM منبع باز

- ChatGLM-100B: منبع باز نیست، اما از طریق دسترسی فقط دعوت شده در دسترس است

- ChatGLM-6B: یک جایگزین متن باز سبک وزن

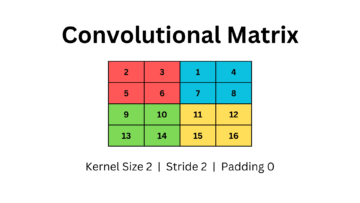

اگرچه این مدلها ممکن است شبیه به گروه مدلهای زبان بزرگ ترانسفورماتور پیشآموزشی (GPT) به نظر برسند، چارچوب پیشآموزشی مدل زبان عمومی (GLM). چیزی است که آنها را متفاوت می کند. در بخش بعدی در مورد این موضوع بیشتر خواهیم آموخت.

در یادگیری ماشین، GLM را به عنوان می شناسید مدل های خطی تعمیم یافته، اما GLM در ChatGLM مخفف آن است مدل زبان عمومی.

چارچوب پیشآموزشی GLM

آموزش پیش از LLM به طور گسترده مورد مطالعه قرار گرفته است و هنوز منطقه ای از تحقیقات فعال است. بیایید سعی کنیم تفاوت های کلیدی بین پیش آموزش GLM و مدل های سبک GPT را درک کنیم.

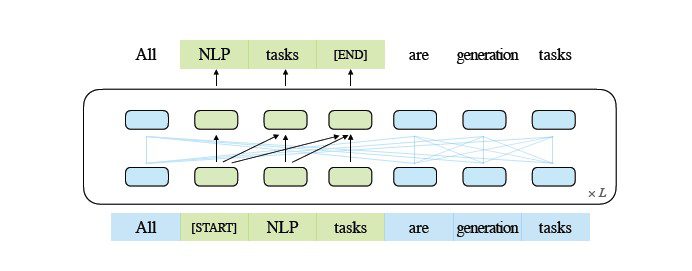

خانواده مدلهای GPT-3 از مدلسازی زبان رگرسیون خودکار فقط با رمزگشا استفاده میکنند. از سوی دیگر، در GLM، بهینه سازی هدف به صورت فرموله شده است مشکل پر کردن خالی با رگرسیون خودکار.

GLM | منبع تصویر

به زبان ساده، پر کردن خالی رگرسیون خودکار شامل خالی کردن یک گستره پیوسته از متن، و سپس بازسازی متوالی متن این خالی شدن است. علاوه بر ماسکهای کوتاهتر، یک ماسک طولانیتر نیز وجود دارد که بهطور تصادفی خالیهای طولانی متن را از انتهای جملات حذف میکند. این کار به گونه ای انجام می شود که مدل در درک زبان طبیعی و همچنین وظایف تولید به خوبی عمل کند.

تفاوت دیگر در نوع توجه مورد استفاده است. گروه GPT از مدل های زبان بزرگ از توجه یک جهته استفاده می کنند، در حالی که گروه GLM از LLM ها از توجه استفاده می کنند. توجه دو طرفه. استفاده از توجه دو طرفه بر روی زمینههای بدون نقاب میتواند وابستگیها را بهتر دریافت کند و میتواند عملکرد در وظایف درک زبان طبیعی را بهبود بخشد.

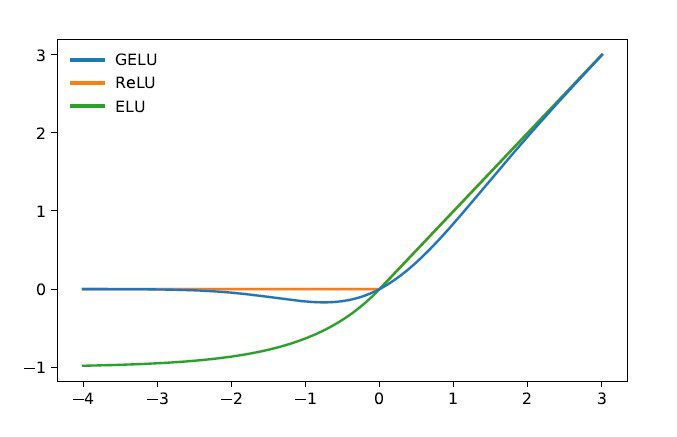

فعال سازی GELU

در GLM، فعال سازی GELU (واحد خطی خطای گاوسی) به جای فعال سازی ReLU [1] استفاده می شود.

GELU، ReLU، و ELU فعال سازی | منبع تصویر

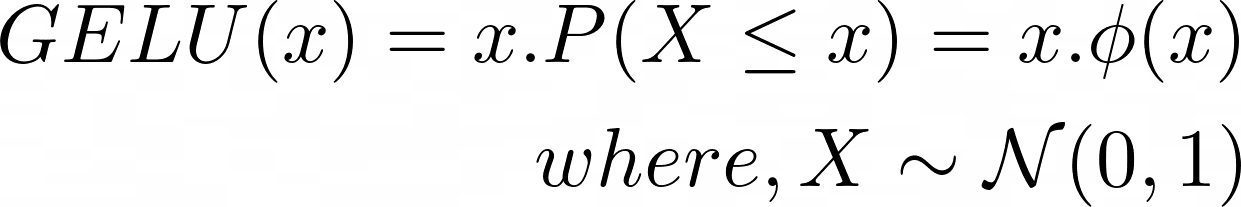

فعال سازی GELU و دارای مقادیر غیر صفر برای همه ورودی ها است و به شکل زیر است [3]:

مشخص شده است که فعالسازی GELU عملکرد را در مقایسه با فعالسازیهای ReLU بهبود میبخشد، اگرچه از نظر محاسباتی فشردهتر از ReLU است.

در سری GLM از LLM ها، ChatGLM-130B که منبع باز است و به خوبی مدل Da-Vinci GPT-3 عمل می کند. همانطور که گفته شد، در زمان نوشتن این مقاله، یک نسخه ChatGLM-100B وجود دارد که به دسترسی فقط دعوتشده محدود شده است.

ChatGLM-6B

جزئیات زیر در مورد ChatGLM-6B برای دسترسی بیشتر به کاربران نهایی:

- حدود 6.2 میلیارد پارامتر دارد.

- این مدل روی 1 تریلیون توکن از قبل آموزش داده شده است - به طور مساوی از انگلیسی و چینی.

- متعاقباً از تکنیک هایی مانند تنظیم دقیق نظارت شده و یادگیری تقویتی با بازخورد انسانی استفاده می شود.

بیایید بحث خود را با بررسی مزایا و محدودیتهای ChatGLM به پایان برسانیم:

مزایای

ChatGLM-6B از یک مدل دو زبانه تا یک مدل منبع باز که می توانید به صورت محلی اجرا کنید، مزایای زیر را دارد:

- بیشتر مدلهای اصلی زبان بزرگ بر روی مجموعههای بزرگ متن انگلیسی آموزش داده میشوند و مدلهای زبان بزرگ برای سایر زبانها چندان رایج نیستند. سری ChatGLM از LLM ها دو زبانه هستند و برای چینی ها یک انتخاب عالی هستند. این مدل در هر دو زبان انگلیسی و چینی عملکرد خوبی دارد.

- ChatGLM-6B برای دستگاه های کاربر بهینه شده است. کاربران نهایی اغلب منابع محاسباتی محدودی بر روی دستگاه های خود دارند، بنابراین اجرای LLM به صورت محلی - بدون دسترسی به GPU های با کارایی بالا، تقریبا غیرممکن می شود. با کوانتیزاسیون INT4، ChatGLM-6B می تواند با نیاز به حافظه کم تا 6 گیگابایت اجرا شود.

- در انواع وظایف از جمله خلاصه سازی و چت های تک و چند پرس و جو به خوبی عمل می کند.

- علیرغم تعداد بسیار کمتر پارامترها در مقایسه با سایر LLMهای اصلی، ChatGLM-6B از طول زمینه تا 2048 پشتیبانی می کند.

محدودیت ها

در مرحله بعد، اجازه دهید چند محدودیت ChatGLM-6B را فهرست کنیم:

- اگرچه ChatGLM یک مدل دو زبانه است، عملکرد آن در انگلیسی احتمالاً کمتر از حد مطلوب است. این را می توان به دستورالعمل های استفاده شده در آموزش بیشتر به زبان چینی نسبت داد.

- زیرا ChatGLM-6B بطور قابل ملاحظه ای دارد پارامترهای کمتر در مقایسه با سایر LLM ها مانند BLOOM، GPT-3، و ChatGLM-130B، زمانی که زمینه خیلی طولانی باشد، ممکن است عملکرد بدتر شود. در نتیجه، ChatGLM-6B ممکن است اطلاعات نادرست را بیشتر از مدل هایی با تعداد پارامترهای بیشتر ارائه دهد.

- مدل های زبان کوچک دارند ظرفیت حافظه محدود. بنابراین، در چت های چند نوبتی، عملکرد مدل ممکن است اندکی کاهش یابد.

- سوگیری، اطلاعات نادرست و سمیت محدودیتهای همه LLMها هستند و ChatGLM نیز مستعد این موارد است.

به عنوان گام بعدی، ChatGLM-6B را به صورت محلی اجرا کنید یا نسخه آزمایشی را در فضاهای HuggingFace امتحان کنید. اگر می خواهید عمیق تر در کار LLM ها تحقیق کنید، در اینجا لیستی از آنها وجود دارد دوره های رایگان در مورد مدل های زبان بزرگ.

[1] Z Du، Y Qian و همکاران، GLM: پیشآموزشی مدل زبان عمومی با پر کردن خالی خود رگرسیون، ACL 2022

[2] A Zheng، X Liu و همکاران، GLM-130B - یک مدل پیش آموزش دوزبانه باز، ICML 2023

[3] دی هندریکس، کی گیمپل، واحدهای خطی خطای گاوسی (GELUs)، arXiv، 2016

[4] ChatGLM-6B: نسخه نمایشی در HuggingFace Spaces

[5] GitHub Repo

بالا پریا سی یک نویسنده فنی است که از ایجاد محتوای طولانی لذت می برد. زمینه های مورد علاقه او شامل ریاضیات، برنامه نویسی و علوم داده است. او با نوشتن آموزشها، راهنماهای نحوه انجام و غیره، آموختههای خود را با جامعه توسعهدهندگان به اشتراک میگذارد.

- محتوای مبتنی بر SEO و توزیع روابط عمومی. امروز تقویت شوید.

- PlatoAiStream. Web3 Data Intelligence دانش تقویت شده دسترسی به اینجا.

- ضرب کردن آینده با آدرین اشلی. دسترسی به اینجا.

- منبع: https://www.kdnuggets.com/2023/04/chatglm6b-lightweight-opensource-chatgpt-alternative.html?utm_source=rss&utm_medium=rss&utm_campaign=chatglm-6b-a-lightweight-open-source-chatgpt-alternative

- : دارد

- :است

- :نه

- $UP

- 1

- a

- درباره ما

- دسترسی

- در دسترس

- فعال سازی

- فعال سازی ها

- فعال

- اضافه

- مزایای

- AL

- معرفی

- جایگزین

- جایگزین

- an

- و

- هستند

- محدوده

- مناطق

- مقاله

- AS

- At

- توجه

- تالیف

- خودکار

- در دسترس

- BE

- شدن

- شود

- بوده

- بودن

- بهتر

- میان

- بیلیون

- شکوفه

- هر دو

- اما

- by

- CAN

- گرفتن

- GPT چت

- چین

- چینی

- انتخاب

- مشترک

- انجمن

- قابل مقایسه

- مقایسه

- محاسبه

- محتوا

- زمینه

- زمینه ها

- مداوم

- دوره

- ایجاد

- در حال حاضر

- داده ها

- علم اطلاعات

- عمیق تر

- نسخه ی نمایشی

- جزئیات

- توسعه دهنده

- در حال توسعه

- دستگاه ها

- تفاوت

- تفاوت

- مختلف

- گفتگو

- انجام شده

- E&T

- پایان

- انگلیسی

- خطا

- خانواده

- باز خورد

- کمی از

- کمتر

- پیروی

- برای

- فرم

- یافت

- از جانب

- سوالات عمومی

- نسل

- مولد

- دریافت کنید

- دادن

- رفتن

- خوب

- GPU ها

- بزرگ

- گروه

- راهنما

- دست

- سخت

- آیا

- داشتن

- او

- اینجا کلیک نمایید

- عملکرد بالا

- HTML

- HTTPS

- صورت در آغوش گرفته

- انسان

- if

- غیر ممکن

- بهبود

- in

- نادرست

- شامل

- از جمله

- اطلاعات

- در عوض

- دستورالعمل

- علاقه

- به

- شامل

- IT

- ITS

- JPG

- kdnuggets

- کلید

- دانستن

- زبان

- زبان ها

- بزرگ

- بزرگتر

- نام

- آخرین

- یاد گرفتن

- یادگیری

- طول

- سبک وزن

- پسندیدن

- احتمالا

- محدودیت

- محدود شده

- لینک

- فهرست

- به صورت محلی

- طولانی

- دیگر

- کم

- دستگاه

- فراگیری ماشین

- مسیر اصلی

- ساخت

- باعث می شود

- ماسک

- ماسک

- ریاضی

- ممکن است..

- حافظه

- ذکر شده

- اطلاعات غلط

- مدل

- مدل سازی

- مدل

- بیش

- طبیعی

- زبان طبیعی

- درک زبان طبیعی

- بعد

- عدد

- کارت گرافیک Nvidia

- هدف

- of

- غالبا

- on

- باز کن

- منبع باز

- بهینه سازی

- بهینه

- or

- دیگر

- ما

- خارج

- روی

- پارامترهای

- کارایی

- انجام می دهد

- افلاطون

- هوش داده افلاطون

- PlatoData

- محبوب

- پیش

- برنامه نويسي

- تقویت یادگیری

- منتشر شده

- نیاز

- تحقیق

- منابع

- منحصر

- نتیجه

- دویدن

- s

- علم

- بخش

- سلسله

- چند

- سهام

- او

- مشابه

- ساده

- تنها

- کوچکتر

- So

- فضا

- فضاها

- محدوده

- می ایستد

- گام

- هنوز

- مورد مطالعه قرار

- چنین

- فوق العاده

- پشتیبانی از

- مناسب

- وظایف

- فنی

- تکنیک

- قوانین و مقررات

- نسبت به

- که

- La

- شان

- آنها

- سپس

- آنجا.

- از این رو

- اینها

- این

- از طریق

- زمان

- به

- هم

- آموزش دیده

- آموزش

- تریلیون

- Tsinghua دانشگاه

- آموزش

- نوع

- فهمیدن

- درک

- واحد

- دانشگاه

- استفاده کنید

- استفاده

- کاربر

- کاربران

- با استفاده از

- ارزشها

- تنوع

- نسخه

- هفته

- خوب

- چی

- چه زمانی

- که

- WHO

- با

- مشغول به کار

- کارگر

- بدتر

- بسته بندی کردن

- نویسنده

- نوشته

- X

- شما

- زفیرنت