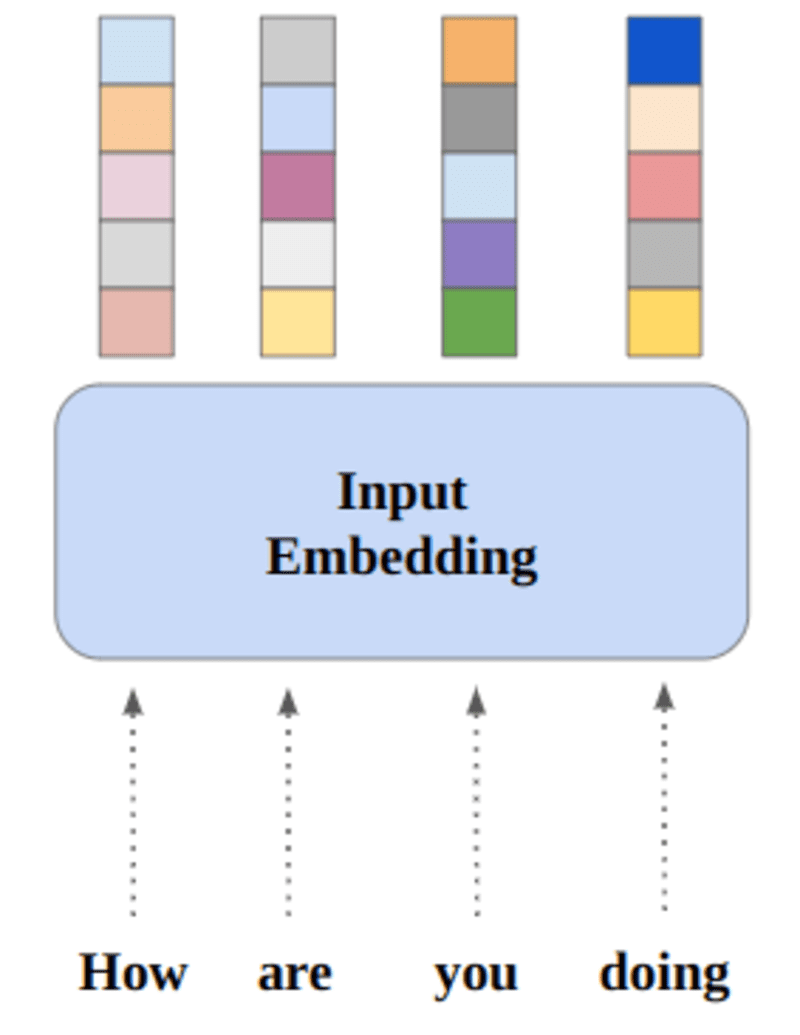

شبکه های عصبی از طریق اعداد یاد می گیرند، بنابراین هر کلمه به بردارها نگاشت می شود تا یک کلمه خاص را نشان دهد. لایه embedding را می توان به عنوان یک جدول جستجو در نظر گرفت که جاسازی های کلمه را ذخیره می کند و آنها را با استفاده از شاخص ها بازیابی می کند.

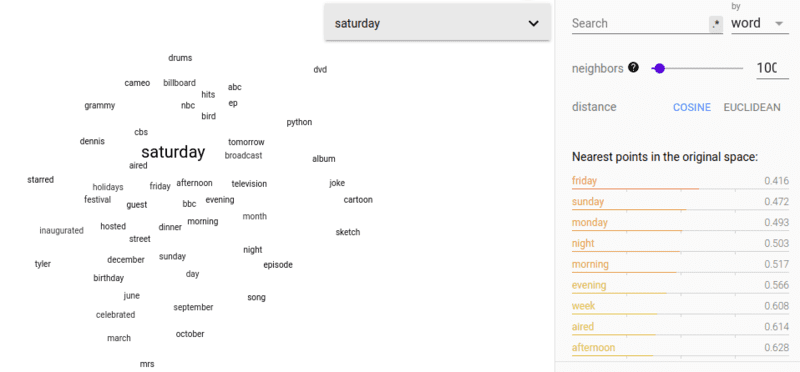

کلماتی که معنی یکسانی دارند از نظر فاصله اقلیدینی/ شباهت کسینوس نزدیک خواهند بود. برای مثال، در نمایش کلمه زیر، "شنبه"، "یکشنبه" و "دوشنبه" با یک مفهوم مرتبط است، بنابراین میتوانیم ببینیم که کلمات مشابه هستند.

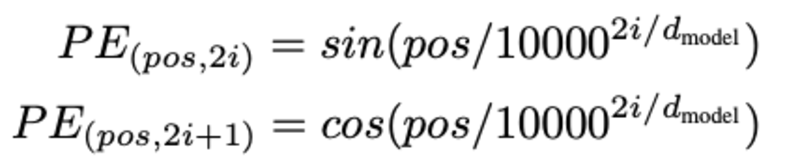

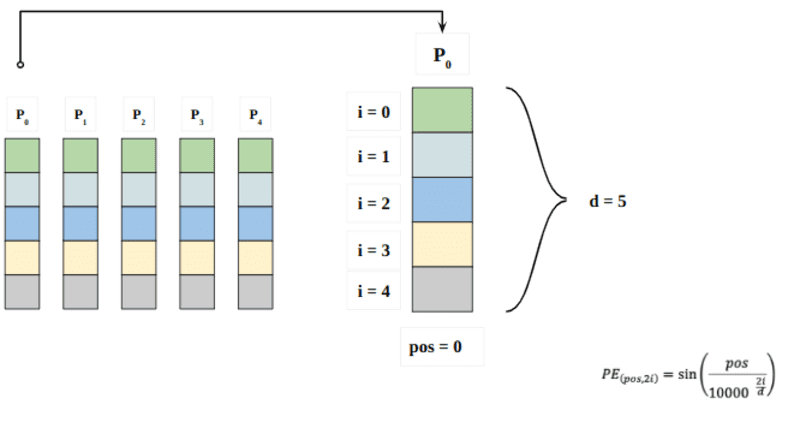

تعیین جایگاه کلمه، چرا باید جایگاه کلمه را تعیین کنیم؟ از آنجایی که رمزگذار ترانسفورماتور مانند شبکه های عصبی بازگشتی تکراری ندارد، باید اطلاعاتی در مورد موقعیت ها به جاسازی های ورودی اضافه کنیم. این کار با استفاده از رمزگذاری موقعیتی انجام می شود. نویسندگان مقاله از توابع زیر برای مدلسازی موقعیت یک کلمه استفاده کردند.

ما سعی خواهیم کرد رمزگذاری موقعیتی را توضیح دهیم.

در اینجا "pos" به موقعیت "کلمه" در دنباله اشاره دارد. P0 به جاسازی موقعیت کلمه اول اشاره دارد. "d" به معنای اندازه کلمه / نشانه است. در این مثال d=5. در نهایت، "i" به هر یک از 5 بعد جداگانه تعبیه (یعنی 0، 1,2,3,4،XNUMX،XNUMX،XNUMX) اشاره دارد.

اگر "i" در معادله بالا متفاوت باشد، دسته ای از منحنی ها با فرکانس های متفاوت دریافت خواهید کرد. خواندن مقادیر جاسازی موقعیت در برابر فرکانس های مختلف، دادن مقادیر مختلف در ابعاد مختلف جاسازی برای P0 و P4.

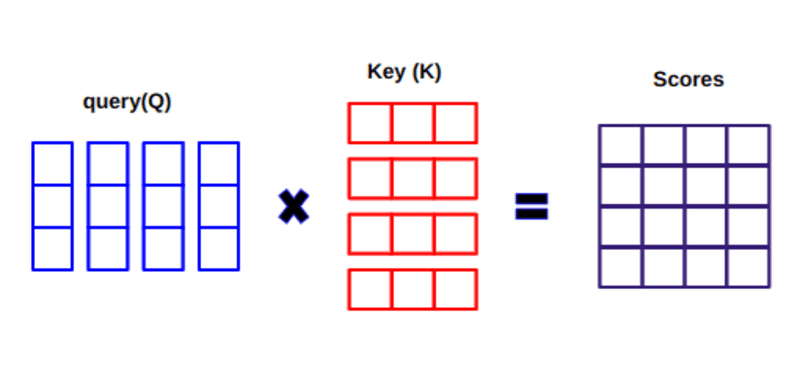

در این پرس و جو، س نشان دهنده یک کلمه برداری است کلیدهای K همه کلمات دیگر در جمله هستند، و ارزش V نشان دهنده بردار کلمه است.

هدف از توجه، محاسبه اهمیت عبارت کلیدی در مقایسه با عبارت پرس و جو مربوط به همان شخص/شیء یا مفهوم است.

در مورد ما V برابر است با Q.

مکانیسم توجه اهمیت کلمه را در یک جمله به ما می دهد.

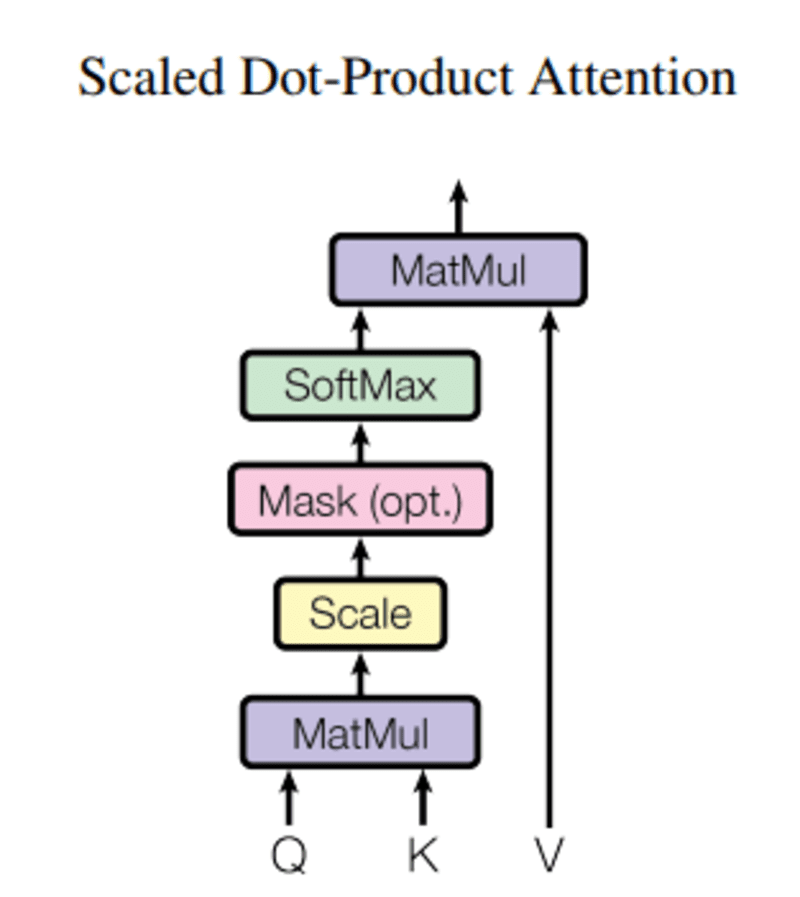

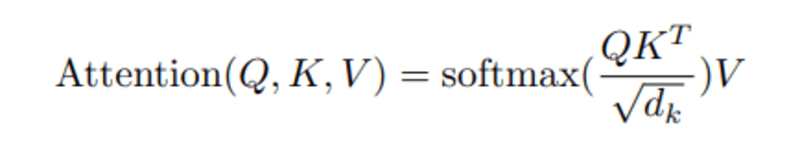

هنگامی که حاصل ضرب نقطه نرمال شده را بین پرس و جو و کلیدها محاسبه می کنیم، یک تانسور به دست می آوریم که نشان دهنده اهمیت نسبی یک کلمه دیگر برای پرس و جو است.

هنگام محاسبه حاصل ضرب نقطه ای بین Q و KT، ما سعی می کنیم نحوه تراز شدن بردارها (یعنی کلمات بین پرس و جو و کلیدها) را تخمین بزنیم و برای هر کلمه در جمله وزنی برمی گردانیم.

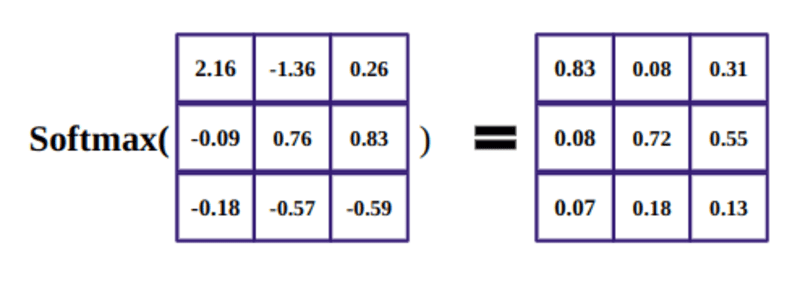

سپس، نتیجه مجذور d_k را نرمال می کنیم و تابع softmax عبارت ها را منظم می کند و آنها را بین 0 و 1 تغییر مقیاس می دهد.

در نهایت، ما نتیجه (یعنی وزن ها) را در مقدار (یعنی همه کلمات) ضرب می کنیم تا از اهمیت کلمات غیر مرتبط کاسته شود و فقط روی مهم ترین کلمات تمرکز کنیم.

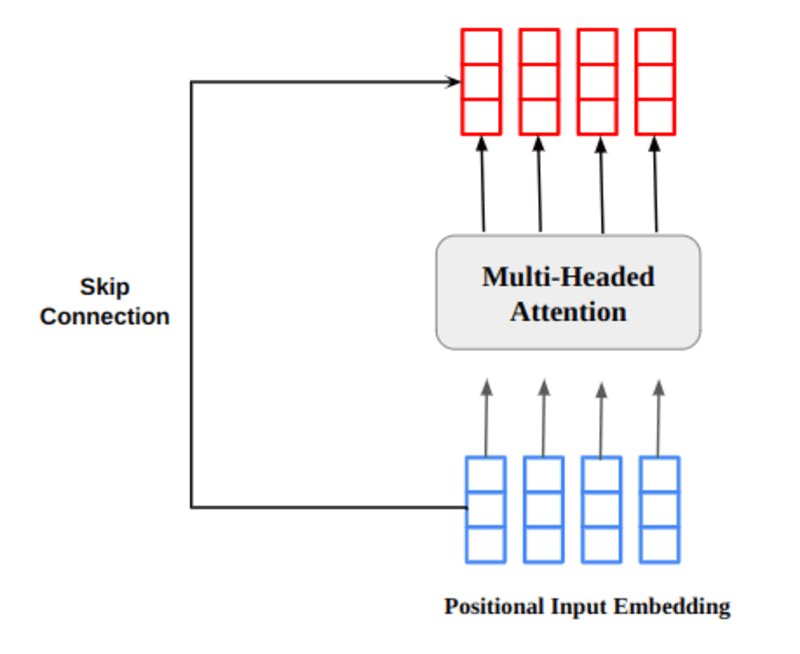

بردار خروجی توجه چند سر به تعبیه ورودی موقعیتی اصلی اضافه شده است. این یک اتصال باقیمانده / اتصال پرش نامیده می شود. خروجی اتصال باقیمانده از طریق نرمال سازی لایه می رود. خروجی باقیمانده نرمال شده برای پردازش بیشتر از طریق یک شبکه پیشخور نقطهای منتقل میشود.

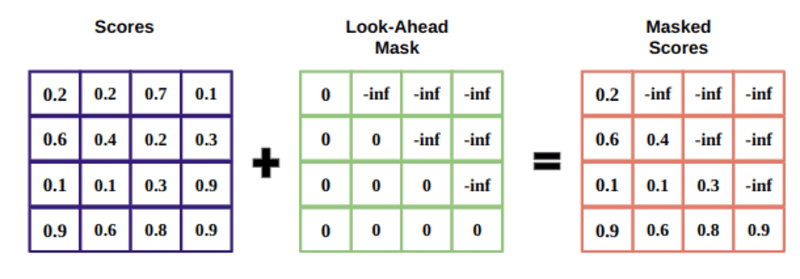

ماسک ماتریسی است که به اندازه امتیازهای توجه پر شده با مقادیر 0 و بی نهایت منفی است.

دلیل این ماسک این است که وقتی softmax امتیازهای ماسکشده را بگیرید، بینهایتهای منفی صفر میشوند و امتیاز توجه صفر برای توکنهای آینده باقی میماند.

این به مدل می گوید که روی آن کلمات تمرکزی نداشته باشد.

هدف از تابع softmax گرفتن اعداد واقعی (مثبت و منفی) و تبدیل آنها به اعداد مثبت است که مجموع آنها 1 است.

راویکومار نادوین در ساخت و درک وظایف NLP با استفاده از PyTorch مشغول است.

اصلی. مجدداً با اجازه دوباره ارسال شد.

- محتوای مبتنی بر SEO و توزیع روابط عمومی. امروز تقویت شوید.

- پلاتوبلاک چین. Web3 Metaverse Intelligence. دانش تقویت شده دسترسی به اینجا.

- منبع: https://www.kdnuggets.com/2023/01/concepts-know-getting-transformer.html?utm_source=rss&utm_medium=rss&utm_campaign=concepts-you-should-know-before-getting-into-transformer

- 1

- a

- درباره ما

- بالاتر

- اضافه

- در برابر

- هم راستا

- معرفی

- و

- مرتبط است

- توجه

- نویسندگان

- زیرا

- قبل از

- در زیر

- میان

- بنا

- دسته

- نام

- مورد

- نزدیک

- مقایسه

- محاسبه

- محاسبه

- مفهوم

- مفاهیم

- ارتباط

- مشخص کردن

- تعیین

- مختلف

- ابعاد

- DOT

- هر

- تخمین زدن

- مثال

- توضیح دهید

- پر شده

- سرانجام

- نام خانوادگی

- تمرکز

- پیروی

- تابع

- توابع

- بیشتر

- آینده

- دریافت کنید

- گرفتن

- GitHub

- می دهد

- دادن

- می رود

- گرفتن

- چگونه

- HTTPS

- اهمیت

- مهم

- in

- Indices

- فرد

- اطلاعات

- ورودی

- kdnuggets

- کلید

- کلید

- دانستن

- لایه

- یاد گرفتن

- ترک

- لینک

- مراجعه

- ماسک

- ماتریس

- معنی

- به معنی

- مکانیزم

- مدل

- اکثر

- نیاز

- منفی

- شبکه

- شبکه

- عصبی

- شبکه های عصبی

- nlp

- تعداد

- اصلی

- دیگر

- مقاله

- ویژه

- گذشت

- اجازه

- افلاطون

- هوش داده افلاطون

- PlatoData

- موقعیت

- موقعیت

- مثبت

- در حال پردازش

- محصول

- هدف

- قرار دادن

- مارماهی

- مطالعه

- واقعی

- دلیل

- عود

- كاهش دادن

- اشاره دارد

- مربوط

- نشان دادن

- نمایندگی

- نشان دهنده

- نتیجه

- نتیجه

- برگشت

- همان

- جمله

- دنباله

- باید

- مشابه

- اندازه

- So

- برخی از

- مربع

- پرده

- جدول

- گرفتن

- وظایف

- می گوید

- قوانین و مقررات

- La

- فکر

- از طریق

- به

- نشانه

- ترانسفورماتور

- دور زدن

- درک

- us

- ارزش

- ارزشها

- وزن

- که

- اراده

- کلمه

- کلمات

- زفیرنت

- صفر