اظهار نظر در سال جاری تاکنون بیش از 250 تیراندازی جمعی در ایالات متحده رخ داده است و طرفداران هوش مصنوعی فکر می کنند که راه حل آن را دارند. نه کنترل اسلحه، بلکه فناوری بهتر، جای تعجب نیست.

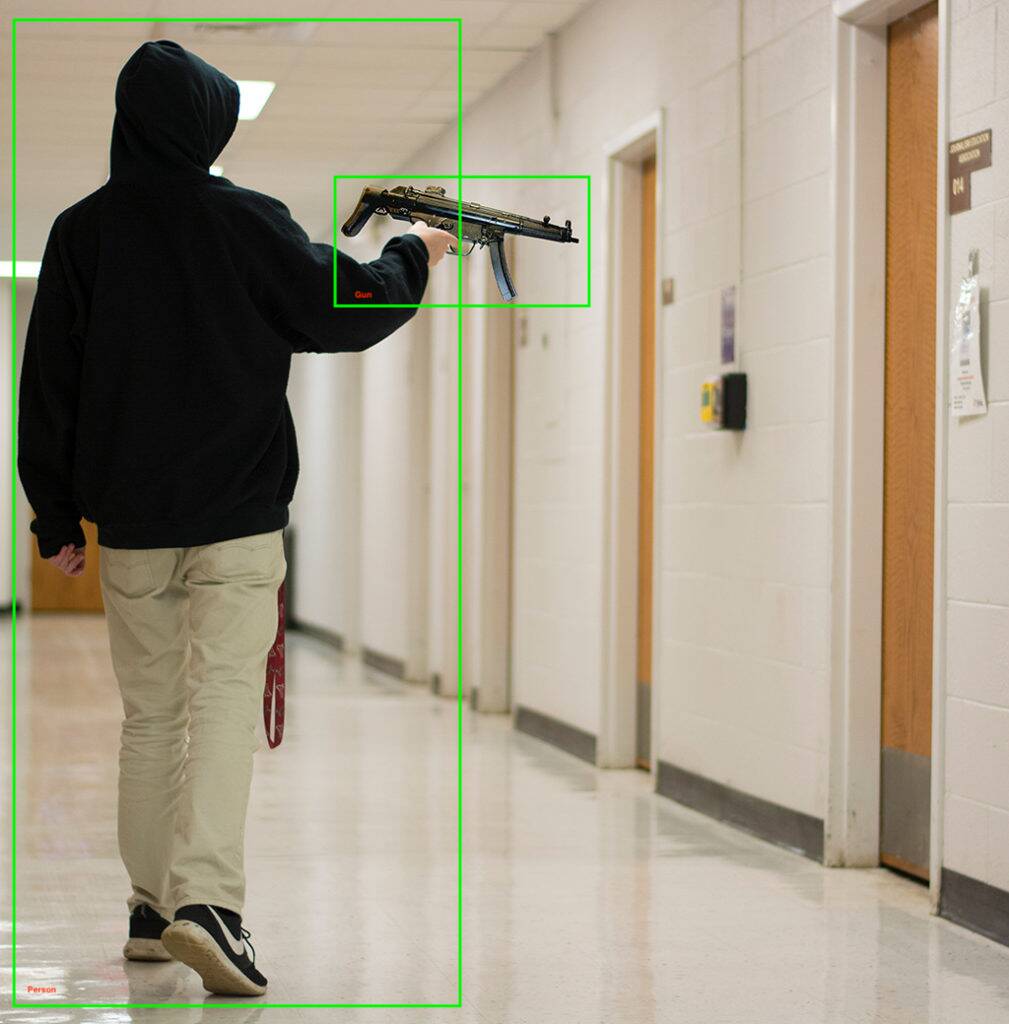

Biz یادگیری ماشینی Kogniz روز سه شنبه اعلام کرد که در حال اضافه کردن یک ابزار آماده برای استقرار است مدل تشخیص اسلحه به پلتفرم بینایی کامپیوتری خود. به ما گفته میشود که این سیستم میتواند اسلحههایی را که توسط دوربینهای امنیتی دیده میشود شناسایی کند و اعلانهایی را برای افراد در معرض خطر ارسال کند، پلیس را مطلع کند، ساختمانها را قفل کند و سایر وظایف امنیتی را انجام دهد.

کوگنیز علاوه بر شناسایی سلاح گرم، از سایر ماژول های بینایی کامپیوتری خود برای مشاهده رفتارهای غیرعادی مانند سرعت دویدن کودکان در راهروها یا بالا رفتن شخصی از طریق پنجره استفاده می کند که می تواند نشان دهنده تیراندازی فعال باشد.

اگر در مورد نرخ خطا یا مثبت کاذب کد تعجب می کنید، Kogniz می گوید که دارای یک "هوش مصنوعی چند گذر" و "یک تیم آموزش دیده از تایید کننده های انسانی" است که نتایج نرم افزار تشخیص آن را بررسی می کنند. یا از این سطح اضافی تأیید استقبال می کنید، یا آن را به عنوان فناوری به طور بالقوه در حال سقوط در انسان درست زمانی که رایانه ها بیشتر مورد نیاز هستند، می بینید.

دانیل پوترمن، مدیرعامل Kogniz، گفت: «[راهحل ما] این است که آمادگی شرکتها، سازمانهای دولتی، مدارس و بیمارستانها و سپس کمک به کاهش آسیبهای ناشی از یک رویداد تیراندازی فعال را بهطور چشمگیری آسانتر کنیم.»

Kogniz اولین شرکت بینایی رایانه ای نیست که وارد بازی تشخیص اسلحه می شود - لیست قابل توجهی از شرکت هایی وجود دارد که فناوری مشابهی را به کار می گیرند و برخی مانند ZeroEyes در چیزی جز تشخیص سلاح گرم تخصص ندارند.

ZeroEyes در یک گزارش گفت: توسعه دهندگان با گسترش توجه خود در چندین پیشنهاد، کمتر قادر به ارائه بهترین خدمات در تشخیص اسلحه هستند. پست های وبلاگ. فناوری ZeroEyes در مدارس 14 ایالت از جمله به کار گرفته شده است دبیرستان آکسفورد در مترو دیترویت، جایی که یک تیرانداز 15 ساله سال گذشته چهار نفر را کشت و هفت نفر را مجروح کرد.

سایر فروشندگان - مانند Defendry که مجموعه ای امنیتی شامل برنامه دکمه وحشت، حسگرهای گلوله صوتی، هواپیماهای بدون سرنشین اولین پاسخ دهنده و هوش مصنوعی تشخیص اسلحه دارد. و Omnilert - در این بازار رشد افسرده هستند. شرکت های دیگری در زمینه تشخیص تفنگ هوش مصنوعی عبارتند از Arcarith، Athena Securities و Scylla.

آیا واقعا زمان کافی وجود دارد؟

در سال 2019، واکنش پلیس به تیراندازی دسته جمعی در دیتون، اوهایو، تنها 32 ثانیه بود که در این مدت 2021 نفر کشته شدند. تیراندازی در سال XNUMX در یکی از تأسیسات فدرال اکسپرس ایندیاناپولیس که منجر به کشته شدن XNUMX نفر شد نیز قبل از رسیدن پلیس به پایان رسید، حتی اگر آنها فقط در عرض چند دقیقه این کار را انجام دادند.

هر دوی این موارد این سوال را مطرح میکنند که آیا تشخیص تفنگ هوش مصنوعی میتواند زمان پاسخگویی را به اندازه کافی برای نجات جان افراد کاهش دهد. به خصوص اگر افسران خیلی ترسیده باشند یا تصمیم بگیرند که واقعاً پاسخ ندهند، مانند قتل عام در Uvalde.

چندین روش دیگر برای پیشگیری از تیراندازی دسته جمعی مبتنی بر هوش مصنوعی پیشنهاد شده است، مانند اسلحه های هوشمند که اگر هدف انسانی را شناسایی کنند شلیک نمی کنند. دیگران آموزش هوش مصنوعی را در مورد دادههای تیراندازیهای گذشته، خریدهای محلی اسلحه و دادههای اقتصادی-اجتماعی برای یافتن روندهایی که نشاندهنده تیراندازی برنامهریزیشده است، و همچنین اسکن رسانههای اجتماعی برای شاخصهای مشابه پیشنهاد کردهاند.

همچنین وجود دارد سوگیری هوش مصنوعی، یک مشکل مستند که حتی مجموعه داده های متنوع و آموزش متعادل به نظر نمی رسد حل شود. استقرار فناوری تشخیص چهره و اسلحه در سال 2020 را در یکی از مدارس نیویورک در نظر بگیرید: ایمیلهای بین ناحیه مدرسه و شرکتی که این سیستم را مستقر کرده است نشان میدهد که معمولاً نگرانیهایی درباره آن وجود دارد. شناسایی اشتباه چیزهایی مانند دسته جارو برای تفنگ.

جی استنلی، تحلیلگر ارشد سیاست ACLU در گفتگو با نشریه یوتا Deseret News گفت: او نگران بود که سیستمهای بینایی کامپیوتری میتوانند به جهانی منجر شوند «که در آن مردم از ترس راهاندازی آشکارسازهای ناهنجاری و بازجویی توسط پلیس، از انجام کاری به سادگی پرش از پیادهرو اجتناب میکنند».

با این حال، یکی از استفادههای احتمالی از هوش مصنوعی ممکن است نوید بیشتری داشته باشد: سال 2018 مطالعه از مرکز پزشکی بیمارستان کودکان سینسیناتی دریافت که تجزیه و تحلیل هوش مصنوعی جلسات درمانی با ارزیابی خطر روانپزشکان و مشاوران در 91 درصد موارد مطابقت دارد. افزودن دادههای جمعیتی و اجتماعی-اقتصادی تنها نتایج را در شناسایی جوانانی که در معرض خطر ارتکاب یک عمل خشونتآمیز بودند، بهبود بخشید.

با این همه پیچیدگی بالقوه، آیا یادگیری ماشین واقعاً برای جلوگیری از قتل عام آماده است؟

خشونت اسلحه است قاتل شماره یک از کودکان و نوجوانان در آمریکا، هر روز به طور متوسط 12 جوان جان خود را از دست می دهند و 32 نفر دیگر را مجروح می کنند. هوش مصنوعی ممکن است کمک کند، اما بدون پرداختن به کاستی های آن، شاید به رویکردهای کمتر تکنولوژیکی نیز نیاز باشد. مراقبتهای سلامت روان قویتر و گستردهتر ممکن است شروع خوبی باشد.

در اوایل این ماه، رئیس جمهور بایدن نام برای، از جمله، ممنوعیت سلاح تهاجمی، بررسی پیشینه گسترده، و محدودیت در ظرفیت مجله، که او آن را «اقدامات عقلانی و عقلانی» نامید. ®

- AI

- آی هنر

- مولد هنر ai

- ربات ai

- هوش مصنوعی

- گواهی هوش مصنوعی

- هوش مصنوعی در بانکداری

- ربات هوش مصنوعی

- ربات های هوش مصنوعی

- نرم افزار هوش مصنوعی

- بلاکچین

- کنفرانس بلاک چین ai

- coingenius

- هوش مصنوعی محاوره ای

- کنفرانس کریپتو ai

- دل-ه

- یادگیری عمیق

- گوگل ai

- فراگیری ماشین

- افلاطون

- افلاطون آی

- هوش داده افلاطون

- بازی افلاطون

- PlatoData

- بازی پلاتو

- مقیاس Ai

- نحو

- ثبت نام

- زفیرنت