همانطور که مدل های هوش مصنوعی بزرگتر می شوند، مقدار پول و انرژی مورد نیاز برای آموزش آنها به یک موضوع داغ تبدیل شده است. یک رویکرد جدید که یکی از اجزای اساسی این رشته را بازنویسی میکند، میتواند راهحلی بالقوه ارائه دهد.

از زمان GPT-3 جهش های قابل توجهی در عملکرد قابل دستیابی به سادگی با افزایش نشان داداندازه مدل بخوان، رهبران صنعت هوش مصنوعی منابع را برای آموزش انباشته کرده اند شبکه های عصبی عظیم.

اما این هزینههای هنگفتی را در بر میگیرد، به منابع محاسباتی انبوه نیاز دارد، و از مقادیر زیادی نیرو استفاده میکند. این به طور فزاینده ای به عنوان یک مشکل تلقی می شود، نه تنها به دلیل پیامدهای زیست محیطی، بلکه همچنین به این دلیل که رقابت را برای لباس های کوچکتر هوش مصنوعی دشوار می کند و در نتیجه تمرکز قدرت در دستان رهبران صنعت است.

با این حال، اکنون محققان دانشگاه آکسفورد رویکرد جدیدی را ارائه کرده اند که می تواند بالقوه باشدly زمان تمرین را به نصف کاهش دهید. آنها این کار را با بازنویسی یکی از اساسی ترین اجزای سیستم های هوش مصنوعی مبتنی بر شبکه عصبی امروزی انجام می دهند: انتشار پس زمینه.

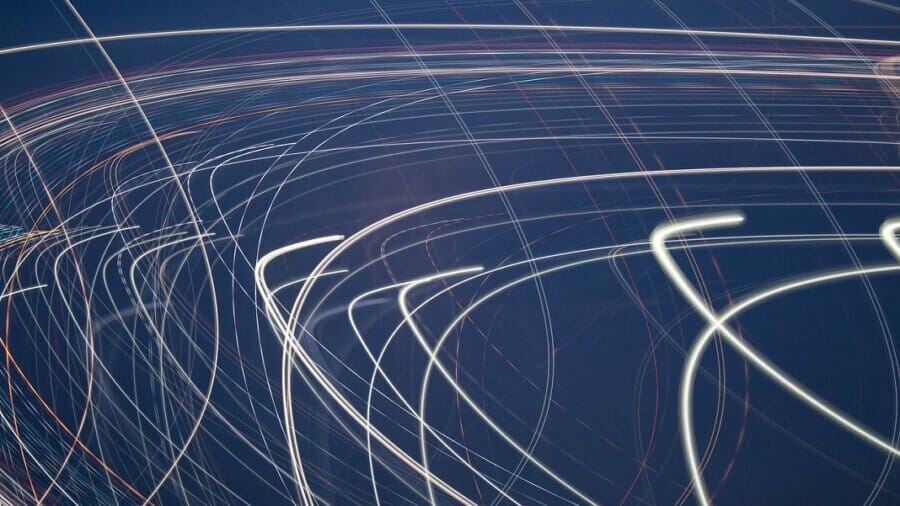

نحوه پردازش داده ها توسط یک شبکه عصبی توسط قدرت اتصالات بین نورون های مختلف آن کنترل می شود. بنابراین برای اینکه آنها را وادار به انجام کارهای مفید کنید، ابتدا باید این اتصالات را تنظیم کنید تا زمانی که داده ها را آنطور که می خواهید پردازش کنند. شما این کار را با آموزش شبکه بر روی داده های مربوط به مشکل با استفاده از فرآیندی به نام پس انتشار انجام می دهید که به دو فاز تقسیم می شود.

اجرای رو به جلو شامل تغذیه داده ها از طریق شبکه و گرفتن آن برای پیش بینی است. در گذر به عقب، از اندازهگیری دقت این پیشبینیها برای بازگشت به شبکه و بررسی نحوه تنظیم قدرت اتصالات مختلف برای بهبود عملکرد استفاده میشود. با تکرار چندین بار این فرآیند با استفاده از داده های زیاد، شبکه به تدریج به سمت یک پیکربندی بهینه از اتصالات کار می کند که مشکل موجود را حل می کند.

این فرآیند تکراری به همین دلیل است که آموزش هوش مصنوعی بسیار طول میکشد، اما محققان آکسفورد ممکن است راهی برای سادهسازی کارها پیدا کرده باشند. مننا پیش چاپ ارسال شده در مانند: arXiv, آنها دیک رویکرد آموزشی جدید بنویسید که پاس عقب را به طور کامل حذف می کند. درعوض، الگوریتم آنها تخمینهایی از میزان نیاز وزنها انجام میدهد be در پاس رو به جلو تغییر میکند، و معلوم میشود که این تقریبها به اندازه کافی نزدیک هستند تا عملکردی قابل مقایسه با انتشار پسانداز داشته باشند.

محققان نشان دادند که این رویکرد میتواند برای آموزش انواع مختلف الگوریتمهای یادگیری ماشینی مورد استفاده قرار گیرد، اما از آنجایی که فقط شامل یک پاس رو به جلو است، میتوان زمان تمرین را تا نصف کاهش داد.

اندرو کوربت از دانشگاه اکستر در بریتانیا یک ترفند ساده ریاضی است. گفته شده دانشمند جدید, اما شرکتمی تواند به مقابله با یکی از مهم ترین چالش های امروزی هوش مصنوعی کمک کند. او گفت: «این یک چیز بسیار، بسیار مهم برای حل است، زیرا گلوگاه الگوریتمهای یادگیری ماشین است.

با این حال باید دید که این رویکرد چقدر کاربردی است. در مقاله خود، محققان نشان میدهند که تفاوت در هزینههای زمان اجرا با افزایش تعداد لایههای یک شبکه عصبی کاهش مییابد، که نشان میدهد این تکنیک ممکن است بازدهی کاهشی با مدلهای بزرگتر داشته باشد.

با این حال، محققان همچنین خاطرنشان میکنند که آنها تعدادی فرصت را برای تغییر روش عملکرد الگوریتمهای یادگیری ماشین استاندارد شناسایی کردهاند تا با روش آنها مطابقت بیشتری داشته باشند، که میتواند منجر به افزایش عملکرد شود.

این تحقیق همچنین می تواند به طور بالقوه به یک رمز و راز مداوم در هوش انسان کمک کند. شبکههای عصبی مصنوعی یکی از بهترین ابزارهای ما برای بررسی نحوه یادگیری مغز باقی میماند، اما این کار را انجام میدهد haمدتهاست که شناخته شده است که انتشار پس از آن از نظر بیولوژیکی قابل قبول نیست زیرا هیچ گونه اتصال معکوس بین نورون ها وجود ندارد. یک رویکرد یادگیری که فقط به پاس رو به جلو نیاز دارد ممکن است به روشن کردن چگونگی حل مشکل یادگیری توسط مغز ما کمک کند.

تصویر های اعتباری: Pexels / 9144 عکس

- "

- AI

- الگوریتم

- الگوریتم

- مقدار

- مقدار

- مربوط

- روش

- مصنوعی

- شدن

- بهترین

- بنا

- چالش ها

- محاسبه

- پیکر بندی

- اتصالات

- اتصال

- کمک

- هزینه

- میتوانست

- اعتبار

- داده ها

- نشان

- مختلف

- عظیم

- محیطی

- تخمین می زند

- نما

- FAST

- سریعتر

- نام خانوادگی

- به جلو

- یافت

- گرفتن

- کمک

- چگونه

- HTTPS

- بزرگ

- انسان

- مهم

- بهبود

- صنعت

- اطلاعات

- موضوع

- IT

- شناخته شده

- بزرگتر

- رهبری

- یادگیری

- سبک

- طولانی

- دستگاه

- فراگیری ماشین

- باعث می شود

- ساخت

- عظیم

- مدل

- مدل

- پول

- اکثر

- شبکه

- مبتنی بر شبکه

- شبکه

- عدد

- فرصت ها

- اکسفورد

- دانشگاه آکسفورد

- مقاله

- کارایی

- پتانسیل

- قدرت

- پیش بینی

- مشکل

- روند

- فرآیندهای

- ارائه

- مربوط

- ضروری

- تحقیق

- محققان

- منابع

- بازده

- دویدن

- سعید

- قابل توجه

- ساده

- اندازه

- So

- حل

- سرعت

- انشعاب

- سیستم های

- از طریق

- امروز

- امروز

- ابزار

- آموزش

- Uk

- دانشگاه

- مختلف

- مهاجرت کاری

- کار کردن

- با این نسخهها کار