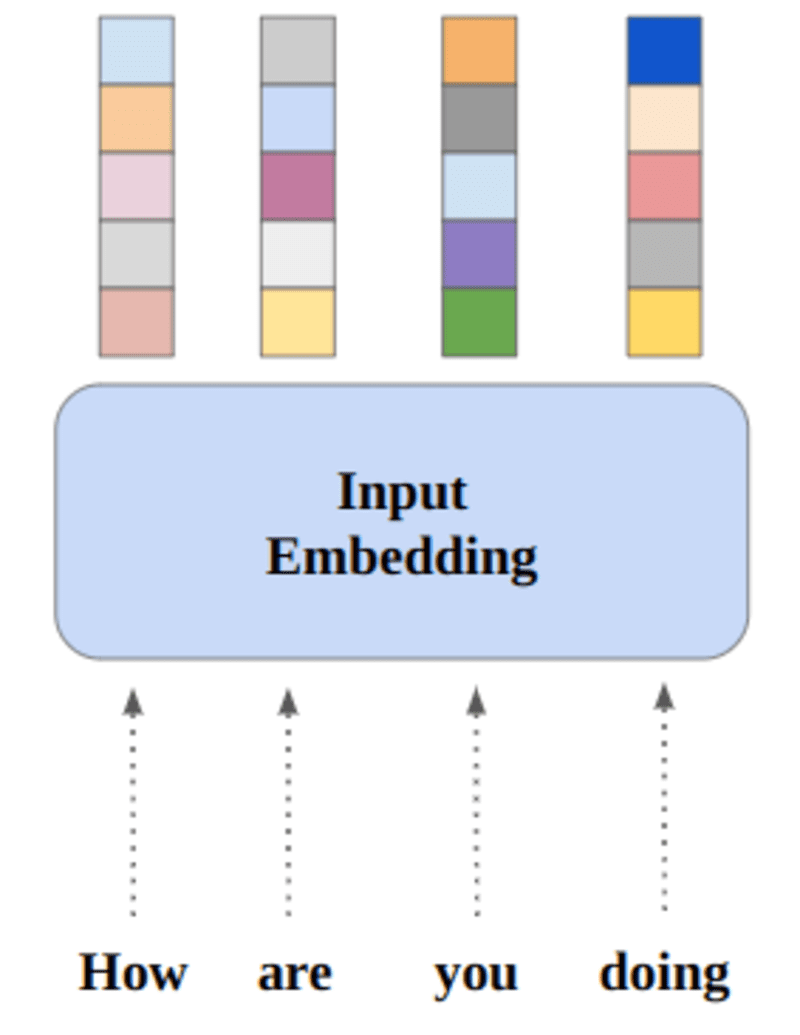

Neuroverkot oppivat numeroiden kautta, joten jokainen sana kartoitetaan vektoreihin edustamaan tiettyä sanaa. Upotuskerrosta voidaan pitää hakutaulukona, joka tallentaa sanan upotukset ja hakee ne indeksien avulla.

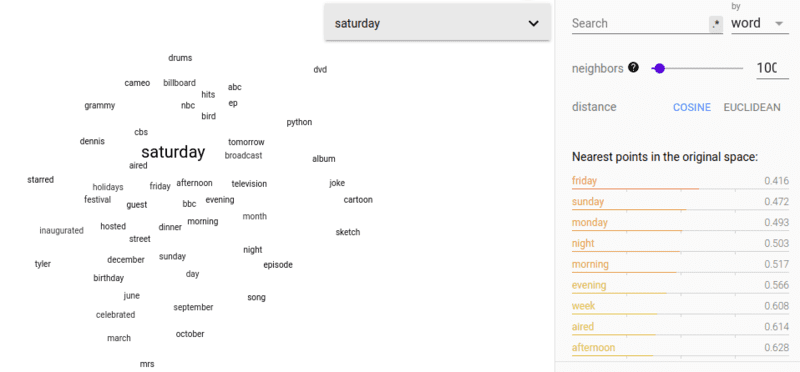

Sanat, joilla on sama merkitys, ovat läheisiä euklidisen etäisyyden/kosinin samankaltaisuuden suhteen. esimerkiksi alla olevassa sanamuodossa "lauantai", "sunnuntai" ja "maanantai" liittyvät samaan käsitteeseen, joten voimme nähdä, että sanat ovat samanlaisia.

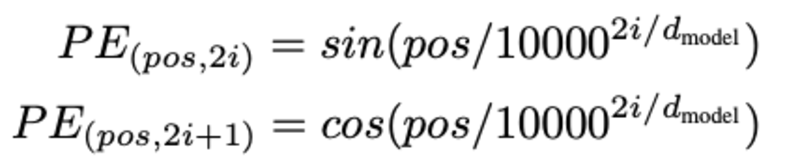

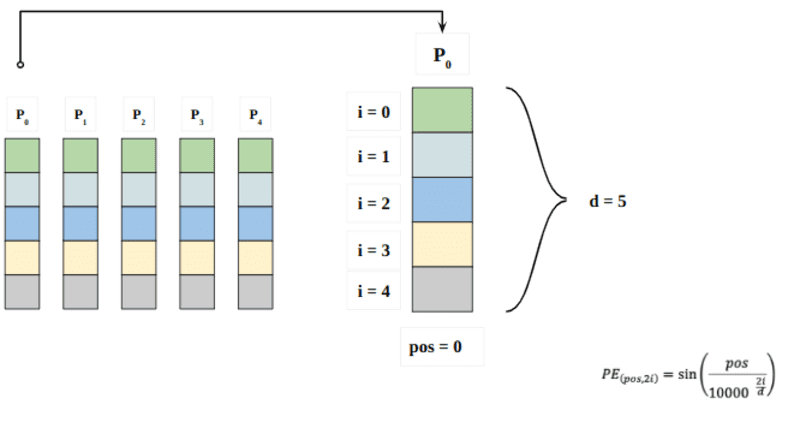

Sanan sijainnin määrittäminen, Miksi meidän on määritettävä sanan sijainti? koska muuntajakooderilla ei ole toistumista, kuten toistuvilla hermoverkoilla, meidän on lisättävä jonkin verran tietoa paikoista sisääntulon upotuksiin. Tämä tehdään paikkakoodauksella. Paperin kirjoittajat käyttivät seuraavia funktioita mallintaakseen sanan sijainnin.

Yritämme selittää sijaintikoodauksen.

Tässä "pos" tarkoittaa "sanan" paikkaa sekvenssissä. P0 viittaa ensimmäisen sanan paikan upottamiseen; "d" tarkoittaa sanan/tunnisteen upotuksen kokoa. Tässä esimerkissä d=5. Lopuksi "i" viittaa jokaiseen upotuksen viidestä yksittäisestä ulottuvuudesta (eli 5, 0, 1,2,3,4, XNUMX, XNUMX)

jos "i" vaihtelee yllä olevassa yhtälössä, saat joukon käyriä, joiden taajuudet vaihtelevat. Lukea sijainnin upotusarvot eri taajuuksia vastaan, antaa eri arvot eri upotusmitoilla P0:lle ja P4:lle.

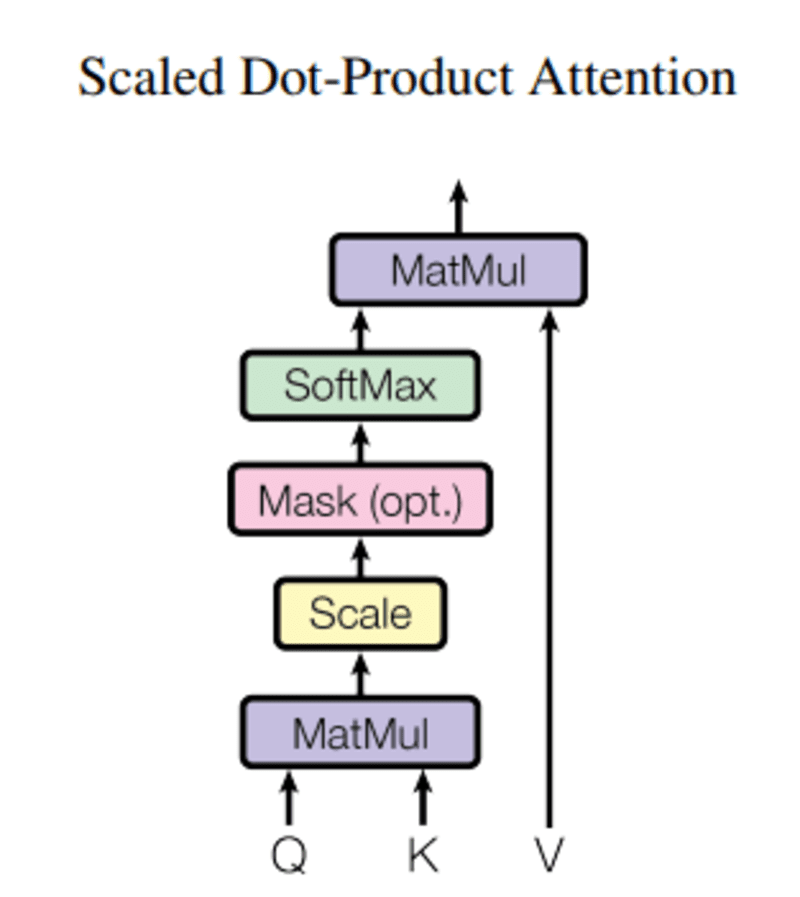

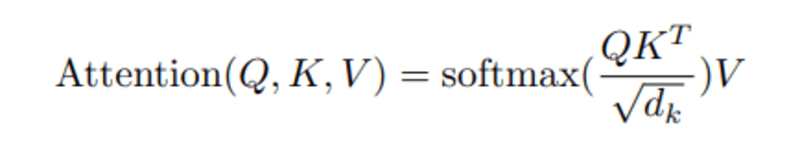

Tässä kysely, Q edustaa vektorisanaa, the avaimet K ovat kaikki muut sanat lauseessa ja arvo V edustaa sanan vektoria.

Huomion tarkoituksena on laskea avaintermin tärkeys verrattuna samaan henkilöön/asiaan tai käsitteeseen liittyvään kyselytermiin.

Meidän tapauksessamme V on yhtä suuri kuin Q.

Huomiomekanismi antaa meille sanan merkityksen lauseessa.

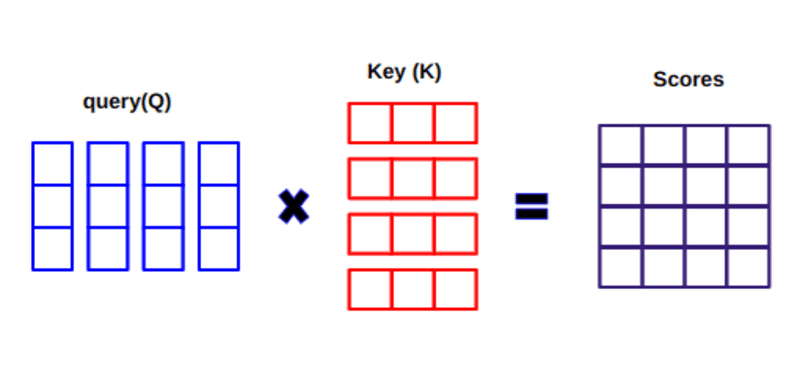

Kun laskemme normalisoidun pistetulon kyselyn ja avainten välillä, saamme tensorin, joka edustaa toistensa sanojen suhteellista merkitystä kyselylle.

Kun lasketaan pistetuloa Q:n ja KT:n välillä, yritämme arvioida, kuinka vektorit (eli kyselyn ja avainten väliset sanat) on kohdistettu, ja palauttaa painotuksen jokaiselle lauseen sanalle.

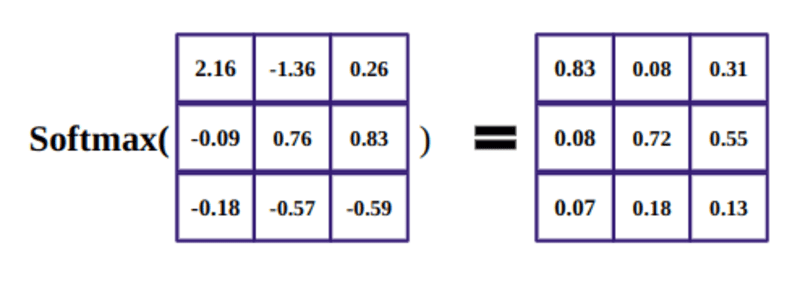

Sitten normalisoimme tuloksen d_k:n neliöllä ja softmax-funktio normalisoi termit ja skaalaa ne uudelleen 0:n ja 1:n välille.

Lopuksi kerromme tuloksen (eli painot) arvolla (eli kaikilla sanoilla) vähentääksemme ei-olennaisten sanojen merkitystä ja keskittyäksemme vain tärkeimpiin sanoihin.

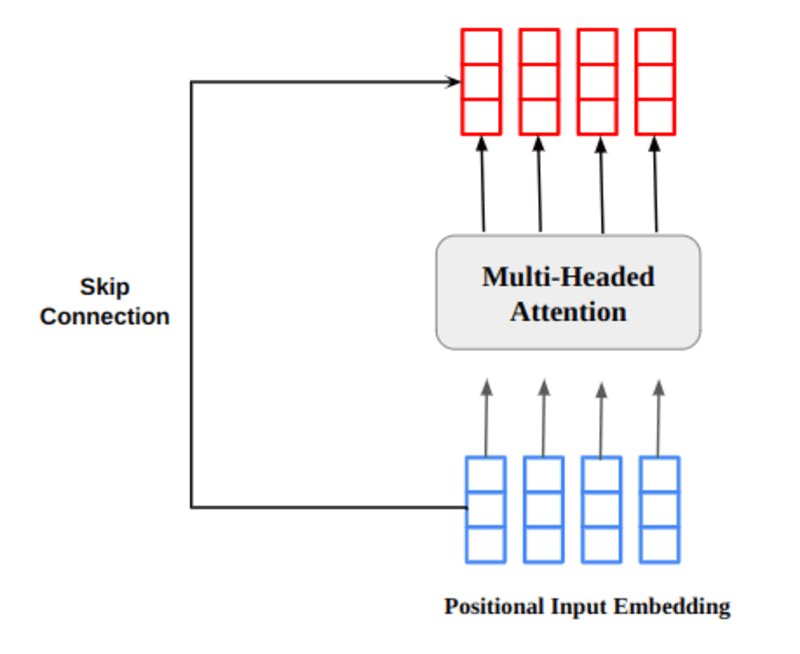

Monipäinen huomion lähtövektori lisätään alkuperäiseen sijaintisyötteen upotukseen. Tätä kutsutaan jäännösyhteydeksi/ohitusyhteydeksi. Jäännösyhteyden lähtö käy läpi kerroksen normalisoinnin. Normalisoitu jäännöslähtö johdetaan pistesuuntaisen syöttöverkon läpi jatkokäsittelyä varten.

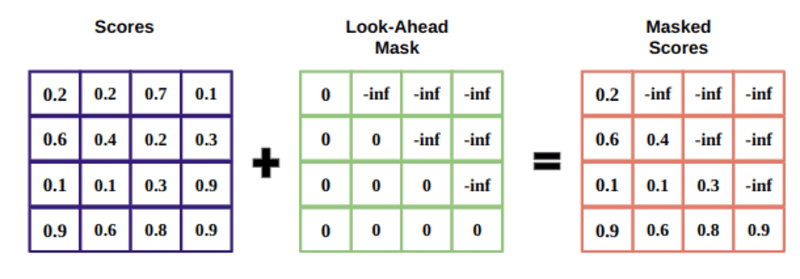

Maski on matriisi, joka on samankokoinen kuin huomiopisteet, jotka on täytetty arvoilla nollia ja negatiivisia äärettömiä.

Syy maskiin on se, että kun otat maskattujen pisteiden softmaxin, negatiiviset äärettömyydet nollaantuvat, jolloin tuleville tokeneille ei jää huomiopisteitä.

Tämä kehottaa mallia olemaan keskittymättä näihin sanoihin.

Softmax-funktion tarkoitus on tarttua reaalilukuihin (positiiviset ja negatiiviset) ja muuntaa ne positiivisiksi luvuiksi, joiden summa on 1.

Ravikumar Naduvin on kiireinen rakentamaan ja ymmärtämään NLP-tehtäviä PyTorchin avulla.

Alkuperäinen. Postitettu luvalla.

- SEO-pohjainen sisällön ja PR-jakelu. Vahvista jo tänään.

- Platoblockchain. Web3 Metaverse Intelligence. Tietoa laajennettu. Pääsy tästä.

- Lähde: https://www.kdnuggets.com/2023/01/concepts-know-getting-transformer.html?utm_source=rss&utm_medium=rss&utm_campaign=concepts-you-should-know-before-getting-into-transformer

- 1

- a

- Meistä

- edellä

- lisä-

- vastaan

- linjassa

- Kaikki

- ja

- liittyvä

- huomio

- Tekijät

- koska

- ennen

- alle

- välillä

- Rakentaminen

- Nippu

- nimeltään

- tapaus

- lähellä

- verrattuna

- Laskea

- tietojenkäsittely

- käsite

- käsitteet

- liitäntä

- Määrittää

- määritetään

- eri

- mitat

- DOT

- kukin

- arvio

- esimerkki

- Selittää

- täynnä

- Vihdoin

- Etunimi

- Keskittää

- jälkeen

- toiminto

- tehtävät

- edelleen

- tulevaisuutta

- saada

- saada

- GitHub

- antaa

- Antaminen

- Goes

- napata

- Miten

- HTTPS

- merkitys

- tärkeä

- in

- Indeksit

- henkilökohtainen

- tiedot

- panos

- KDnuggets

- avain

- avaimet

- Tietää

- kerros

- OPPIA

- jättäen

- Katso ylös

- naamio

- Matriisi

- merkitys

- välineet

- mekanismi

- malli

- eniten

- Tarve

- negatiivinen

- verkko

- verkot

- hermo-

- hermoverkkoihin

- NLP

- numerot

- alkuperäinen

- Muut

- Paperi

- erityinen

- Hyväksytty

- lupa

- Platon

- Platonin tietotieto

- PlatonData

- sijainti

- kantoja

- positiivinen

- käsittely

- Tuotteet

- tarkoitus

- laittaa

- pytorch

- Lukeminen

- todellinen

- reason

- toistuminen

- vähentää

- viittaa

- liittyvä

- edustaa

- edustus

- edustaa

- johtua

- Saatu ja

- palata

- sama

- tuomita

- Järjestys

- shouldnt

- samankaltainen

- Koko

- So

- jonkin verran

- Squared

- varastot

- taulukko

- ottaa

- tehtävät

- kertoo

- ehdot

- -

- ajatus

- Kautta

- että

- tokens

- muuntajat

- VUORO

- ymmärtäminen

- us

- arvo

- arvot

- paino

- joka

- tulee

- sana

- sanoja

- zephyrnet

- nolla-