Lähestymistapamme AGI:n yhdenmukaistamiseen on empiirinen ja iteratiivinen. Parannamme tekoälyjärjestelmiemme kykyä oppia ihmisten palautteesta ja auttaa ihmisiä arvioimaan tekoälyä. Tavoitteenamme on rakentaa tarpeeksi kohdistettu tekoälyjärjestelmä, joka voi auttaa meitä ratkaisemaan kaikki muut kohdistusongelmat.

esittely

Kohdistustutkimuksemme Tavoitteena on tehdä yleisestä tekoälystä (AGI) sopusoinnussa ihmisten arvojen kanssa ja noudattaa ihmisen tarkoitusta. Käytämme iteratiivista, empiiristä lähestymistapaa: yrittämällä kohdistaa erittäin suorituskykyisiä tekoälyjärjestelmiä, voimme oppia, mikä toimii ja mikä ei, mikä parantaa kykyämme tehdä tekoälyjärjestelmistä turvallisempia ja yhdenmukaisempia. Tutkimme tieteellisten kokeiden avulla, miten kohdistustekniikat skaalautuvat ja missä ne katkeavat.

Käsittelemme kohdistusongelmia sekä tehokkaimmissa tekoälyjärjestelmissämme että kohdistusongelmiin, joita odotamme kohdattavamme matkallamme AGI:hen. Päätavoitteemme on viedä nykyiset linjausideat mahdollisimman pitkälle ja ymmärtää ja dokumentoida tarkasti, kuinka ne voivat menestyä tai miksi ne epäonnistuvat. Uskomme, että jopa ilman täysin uusia kohdistusideoita voimme todennäköisesti rakentaa riittävän kohdistettuja tekoälyjärjestelmiä edistämään merkittävästi itse kohdistustutkimusta.

Kohdistamaton AGI voi aiheuttaa merkittäviä riskejä ihmiskunnalle ja AGI-linjausongelman ratkaiseminen voi olla niin vaikeaa, että se vaatii koko ihmiskunnan työskentelemään yhdessä. Siksi olemme sitoutuneet jakamaan avoimesti kohdistustutkimuksemme, kun se on turvallista: Haluamme olla läpinäkyviä siitä, kuinka hyvin kohdistustekniikkamme todella toimivat käytännössä, ja haluamme jokaisen AGI-kehittäjän käyttävän maailman parhaita kohdistustekniikoita.

Korkeatasoinen lähestymistapamme kohdistustutkimukseen keskittyy skaalautuvan harjoitussignaalin suunnitteluun erittäin älykkäille tekoälyjärjestelmille, joka on linjassa ihmisen aikomusten kanssa. Siinä on kolme pääpilaria:

- Tekoälyjärjestelmien koulutus ihmisen palautteen avulla

- Tekoälyjärjestelmien koulutus ihmisen arvioinnin avuksi

- Tekoälyjärjestelmien kouluttaminen kohdistustutkimukseen

Tekoälyjärjestelmien yhteensovittaminen inhimillisten arvojen kanssa asettaa myös joukon muita merkittäviä sosioteknisiä haasteita, kuten sen päättämisen, kenen kanssa nämä järjestelmät tulisi kohdistaa. Näiden ongelmien ratkaiseminen on tärkeää saavuttamisen kannalta tehtävämme, mutta emme käsittele niitä tässä viestissä.

Tekoälyjärjestelmien koulutus ihmisen palautteen avulla

RL ihmisten palautteesta on tärkein tekniikkamme käytössä olevien kielimalliemme yhdenmukaistamiseksi. Koulutamme mallien luokan nimeltä Ohjeita GPT johdettu esikoulutetuista kielimalleista, kuten GPT-3. Nämä mallit on koulutettu seuraamaan ihmisen aikomusta: sekä ohjeen antamaa eksplisiittistä tarkoitusta että implisiittistä tarkoitusta, kuten totuudenmukaisuutta, oikeudenmukaisuutta ja turvallisuutta.

Tuloksemme osoittavat, että kohdistukseen keskittyvässä hienosäädössä on tällä hetkellä paljon hedelmää: ihmiset pitävät InstructGPT:tä parempana kuin 100x suurempi esikoulutettu malli, kun taas sen hienosäätö maksaa <2 % GPT-3:n esiharjoittelulaskennasta. ja noin 20,000 XNUMX tuntia inhimillistä palautetta. Toivomme, että työmme innostaa muita alan toimijoita lisäämään investointejaan suurten kielimallien yhdenmukaistamiseen ja että se nostaa rimaa käyttäjien odotuksiin käytettyjen mallien turvallisuudesta.

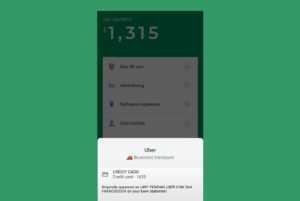

Luonnollisen kielen sovellusliittymämme on erittäin hyödyllinen ympäristö kohdistustutkimuksellemme: se tarjoaa meille runsaan palautesilmukan siitä, kuinka hyvin kohdistustekniikkamme todella toimivat todellisessa maailmassa, joka perustuu hyvin monipuolisiin tehtäviin, joista asiakkaamme ovat valmiita maksamaan rahaa. Asiakkaamme käyttävät jo keskimäärin enemmän InstructGPT:tä kuin esikoulutettuja mallejamme.

Silti InstructGPT:n nykyiset versiot ovat melko kaukana täysin linjassa: he eivät toisinaan noudata yksinkertaisia ohjeita, eivät aina ole totuudenmukaisia, eivät luotettavasti kiellä haitallisia tehtäviä ja antavat joskus puolueellisia tai myrkyllisiä vastauksia. Joidenkin asiakkaiden mielestä InstructGPT:n vastaukset ovat huomattavasti vähemmän luovia kuin esikoulutettujen mallien vastaukset, mitä emme olleet ymmärtäneet suorittaessamme InstructGPT:tä julkisesti saatavilla olevilla vertailuarvoilla. Pyrimme myös kehittämään yksityiskohtaisempaa tieteellistä ymmärrystä RL:stä ihmisten palautteen perusteella ja parantamaan ihmispalautteen laatua.

Sovellusliittymämme kohdistaminen on paljon helpompaa kuin AGI:n kohdistaminen, koska suurinta osaa API:mme tehtävistä ei ole kovin vaikea valvoa ihmisille, ja käyttöönotetut kielimallimme eivät ole ihmisiä älykkäämpiä. Emme odota ihmispalautteen RL:n riittävän AGI:n kohdistamiseen, mutta se on keskeinen rakennuspalikka skaalautuville kohdistusehdotuksille, joista olemme eniten innoissamme, ja siksi on arvokasta kehittää tätä menetelmää.

Koulutusmalleja ihmisten arvioinnin avuksi

Ihmisten palautteen RL:llä on perustavanlaatuinen rajoitus: se olettaa, että ihmiset voivat arvioida tarkasti tekoälyjärjestelmiemme tehtäviä. Nykyään ihmiset ovat tässä melko hyviä, mutta mallien kyvyn kasvaessa he pystyvät tekemään tehtäviä, joita ihmisten on paljon vaikeampi arvioida (esim. löytää kaikki puutteet suuresta koodikannasta tai tieteellisestä artikkelista). Mallimme saattavat oppia kertomaan arvioijillemme sen, mitä he haluavat kuulla, sen sijaan, että kertoisivat heille totuuden. Kohdistuksen skaalaamiseksi haluamme käyttää tekniikoita, kuten rekursiivinen palkkiomallinnus (RRM), keskusteluja iteroitu vahvistus.

Tällä hetkellä pääsuuntamme perustuu RRM:ään: koulutamme malleja, jotka voivat auttaa ihmisiä arvioimaan mallejamme tehtävissä, joita ihmisen on liian vaikea arvioida suoraan. Esimerkiksi:

- Koulutimme mallin tiivistää kirjoja. Kirjatiivistelmien arviointi vie ihmisiltä kauan aikaa, jos kirja ei ole hänelle tuttu, mutta mallimme voi auttaa ihmisen arvioinnissa kirjoittamalla lukujen yhteenvedot.

- Koulutimme mallin auttaa ihmisiä arvioimaan tosiasioiden tarkkuutta selaamalla nettiä ja tarjoamalla lainauksia ja linkkejä. Yksinkertaisissa kysymyksissä tämän mallin tuotoksia pidetään jo parempana kuin ihmisten kirjoittamia vastauksia.

- Koulutimme mallin kirjoittaa kriittisiä kommentteja omista tuloksistaan: Kyselypohjaisessa yhteenvetotehtävässä apu kriittisten kommenttien kanssa lisää ihmisten löytämiä virheitä mallin tuloksista keskimäärin 50 %. Tämä pätee, vaikka pyydämme ihmisiä kirjoittamaan uskottavan näköisiä, mutta vääriä yhteenvetoja.

- Luomme joukon koodaustehtäviä, jotka on valittu niin, että niitä on erittäin vaikea arvioida luotettavasti ilman avustajia. Toivomme julkaisevamme tämän tietojoukon pian.

Kohdistustekniikoidemme on toimittava, vaikka tekoälyjärjestelmämme ehdottaisivat erittäin luovia ratkaisuja (esim AlphaGon siirto 37), siksi olemme erityisen kiinnostuneita koulutusmalleista, jotka auttavat ihmisiä erottamaan oikeat harhaanjohtavista tai petollisista ratkaisuista. Uskomme, että paras tapa oppia mahdollisimman paljon siitä, miten tekoälyavusteinen arviointi toimii käytännössä, on rakentaa tekoälyassistentteja.

Tekoälyjärjestelmien kouluttaminen kohdistustutkimukseen

Tällä hetkellä ei ole tiedossa loputtomasti skaalautuvaa ratkaisua kohdistusongelmaan. Tekoälyn edistyessä odotamme kohtaavansa useita uusia kohdistusongelmia, joita emme vielä havaitse nykyisissä järjestelmissä. Osa näistä ongelmista odotamme nyt ja osa niistä on täysin uusia.

Uskomme, että loputtomasti skaalautuvan ratkaisun löytäminen on todennäköisesti erittäin vaikeaa. Sen sijaan pyrimme pragmaattisempaan lähestymistapaan: rakennamme ja sovitamme järjestelmän, joka voi saada aikaan nopeamman ja paremman linjauksen tutkimuksen edistymisen kuin ihmiset.

Kun edistymme tässä, tekoälyjärjestelmämme voivat ottaa haltuunsa yhä suuremman osan kohdistustyöstämme ja lopulta suunnitella, toteuttaa, tutkia ja kehittää parempia kohdistustekniikoita kuin meillä on nyt. He työskentelevät yhdessä ihmisten kanssa varmistaakseen, että heidän omat seuraajansa ovat linjassa ihmisten kanssa.

Uskomme, että kohdistustutkimuksen arvioiminen on huomattavasti helpompaa kuin sen tuottaminen, varsinkin kun siihen tarjotaan arviointiapua. Siksi ihmistutkijat keskittyvät yhä enemmän ponnisteluihinsa tekoälyjärjestelmien tekemien kohdistustutkimusten tarkistamiseen sen sijaan, että he tekisivät tätä tutkimusta itse. Tavoitteenamme on kouluttaa mallit niin kohdistetuiksi, että voimme purkaa lähes kaiken kohdistustutkimukseen tarvittavan kognitiivisen työn.

Tärkeää on, että tarvitsemme vain "kapeampia" tekoälyjärjestelmiä, joilla on ihmistason kykyjä asiaankuuluvilla aloilla tehdäkseen yhtä hyvin kuin ihmisiä kohdistustutkimuksessa. Odotamme, että nämä tekoälyjärjestelmät on helpompi kohdistaa kuin yleiskäyttöiset järjestelmät tai järjestelmät, jotka ovat paljon älykkäämpiä kuin ihmiset.

Kielimallit soveltuvat erityisen hyvin kohdistustutkimuksen automatisointiin, koska ne tulevat "esiladattuna" Internetistä lukemalla paljon tietoa ja tietoa inhimillisistä arvoista. Paketista alkaen he eivät ole itsenäisiä agentteja eivätkä siten tavoittele omia tavoitteitaan maailmassa. Kohdistustutkimuksen tekemiseksi he eivät tarvitse rajoittamatonta pääsyä Internetiin. Silti monet kohdistustutkimustehtävät voidaan muotoilla luonnolliseksi kieleksi tai koodaustehtäviksi.

Tulevat versiot WebGPT, Ohjeita GPTja Codex voivat tarjota perustan kohdistustutkimusapulaisten rooliin, mutta he eivät vielä ole riittävän päteviä. Vaikka emme tiedä, milloin mallimme ovat riittävän kykeneviä edistämään mielekkäästi kohdistustutkimusta, mielestämme on tärkeää aloittaa ajoissa. Kun olemme kouluttaneet mallin, josta voi olla hyötyä, aiomme saattaa sen ulkoisen linjauksen tutkimusyhteisön saataville.

Rajoitukset

Olemme erittäin innoissamme tästä lähestymistavasta AGI:n yhdenmukaistamisessa, mutta odotamme, että sitä on mukautettava ja parannettava, kun saamme lisää tietoa tekoälytekniikan kehittymisestä. Lähestymistapallamme on myös useita tärkeitä rajoituksia:

- Tässä esitetty polku alikorostaa robustisuus- ja tulkintatutkimuksen merkitystä, kahdelle alueelle OpenAI:lla on tällä hetkellä alisijoitettuja. Jos tämä sopii profiiliisi, hae tutkijan paikkojamme!

- Tekoälyavun käyttäminen arvioinnissa voi skaalata tai vahvistaa jopa hienovaraisia epäjohdonmukaisuuksia, harhoja tai haavoittuvuuksia, joita AI-avustajassa on.

- AGI:n kohdistaminen edellyttää todennäköisesti hyvin erilaisten ongelmien ratkaisemista kuin nykyisten tekoälyjärjestelmien kohdistaminen. Odotamme siirtymisen olevan jonkin verran jatkuvaa, mutta jos esiintyy suuria epäjatkuvuuksia tai paradigman muutoksia, useimmat mallien, kuten InstructGPT:n, mukauttamisesta saadut opetukset eivät välttämättä ole suoraan hyödyllisiä.

- Kohdistusongelman vaikeimmat osat eivät välttämättä liity skaalautuvan ja kohdistetun harjoitussignaalin suunnitteluun tekoälyjärjestelmillemme. Vaikka tämä olisi totta, tällainen harjoitussignaali on tarpeen.

- Ei ehkä ole pohjimmiltaan helpompaa kohdistaa malleja, jotka voivat merkittävästi nopeuttaa kohdistustutkimusta kuin AGI:n kohdistaminen. Toisin sanoen vähiten kykenevät mallit, jotka voivat auttaa kohdistustutkimuksessa, voivat olla jo liian vaarallisia, jos niitä ei ole kohdistettu oikein. Jos tämä on totta, emme saa juurikaan apua omista järjestelmistämme kohdistusongelmien ratkaisemiseen.

Etsimme lisää lahjakkaita ihmisiä tähän tutkimuslinjaan! Jos tämä kiinnostaa sinua, palkkaamme Tutkimusinsinöörit ja Tutkijat!

- AI

- ai taide

- ai taiteen generaattori

- ai robotti

- tekoäly

- tekoälyn sertifiointi

- tekoäly pankkitoiminnassa

- tekoäly robotti

- tekoälyrobotit

- tekoälyohjelmisto

- blockchain

- blockchain-konferenssi ai

- coingenius

- keskustelullinen tekoäly

- kryptokonferenssi ai

- dall's

- syvä oppiminen

- google ai

- koneoppiminen

- OpenAI

- Platon

- plato ai

- Platonin tietotieto

- Platon peli

- PlatonData

- platopeliä

- tutkimus

- mittakaava ai

- syntaksi

- zephyrnet