esittely

Päätöspuut ovat yksi koneoppimisen yleisimmin käytetyistä algoritmeista, jotka tarjoavat tarkkoja ja luotettavia tuloksia, joita voidaan käyttää luokittelu- ja regressioongelmiin. Datatieteen haastatteluissa kysytään enimmäkseen päätöspuihin liittyviä kysymyksiä. On tärkeää vastata näihin kysymyksiin tehokkaasti, koska se on yksi hyödyllisimmistä, tarpeellisimmista ja perusalgoritmeista.

Tässä artikkelissa käsitellään tärkeimmät kysymykset liittyvät sisään koneoppimishaastattelut ja niiden oikeat ratkaisut. Tämä auttaa vastaamaan näihin kysymyksiin tehokkaasti ja asianmukaisesti.

Oppimistavoitteet

Kun olet käynyt tämän artikkelin läpi, opit:

- CART- ja ID3-algoritmit.

- Entropian ja tiedonsaannin ymmärtäminen.

- Päätöspuiden ominaisuudet.

- Yli- ja alasovitusta.

- Oikea tapa vastata päätöspuuhun liittyviin haastattelukysymyksiin.

- Suunnitella ja toimittaa haastattelukysymyksiin sopiva vastaus tehokkaasti.

Tämä artikkeli julkaistiin osana Data Science Blogathon.

Sisällysluettelo

- Mitä ovat CART-algoritmit koneoppimisessa?

- Mitä ovat ID3-algoritmit päätöspuissa?

- Mitä on entropia päätöspuissa?

- Mitä päätöspuussa hankittu tieto on?

- Mikä on gini-entropia päätöspuissa?

- Mitä juuri- ja lehtisolmut ovat päätöspuissa?

- Mitä ovat matalat ja syvät päätöspuut?

- Miten ali- ja ylisovitus tapahtuu?

- Miksi päätöspuut ovat epävakaita?

- Miksi ominaisuuksien skaalausta ei vaadita päätöspuissa?

- Yhteenveto

Q1. Mitä ovat CART-algoritmit koneoppimisessa?

OSTOSKORIIN tarkoittaa Classification and Regression Trees -algoritmia, joka jakaa tiedot ylhäältä alimmalle tasolle tiedon vahvistuksen ja entropian perusteella. Tämä algoritmi laskee epäpuhtauden jokaiselle mahdolliselle jaottelulle ja tekee sitten päätöksen minimihäviön mukaan.

Q2. Mitä ovat ID3-algoritmit päätöspuissa?

ID3-algoritmit ovat eräänlainen algoritmi, joka toimii epäpuhtauden ja jaon informaatiovahvistuksen periaatteella, algoritmi laskee entropian ja informaatiovahvistuksen kaikille spliteille ja jakaa tiedot sen mukaan.

Huomaa, että CART-algoritmia käytetään binääripuille, esimerkiksi kyllä tai ei. Samanaikaisesti ID3-algoritmia käytetään useille luokkasolmuille, joissa puussa on enemmän kuin kaksi lehtisolmua.

Q3. Mitä on entropia päätöspuissa?

Entropia on tietyn splitin tai solmun epävarmuuden tai epäpuhtauden mitta. Tässä tiedot on jaettu useisiin osiin, joissa se voi sisältää epäpuhtauksia. Jos data jaetaan kokonaan homogeenisesti, entropia on nolla.

Entropia = -yi(log(yi))

Q4. Mitä tiedon saanti on?

Kuten nimestä voi päätellä, missä tahansa päätöspuun solmussa tai splitissä saadut tiedot ovat tietoja, jotka tietty split tarjoaa lopulliselle mallille. Splitistä saadun tiedon mukaan viimeinen split on päätös tietystä solmusta. Mitä enemmän tietoa saadaan, sitä suurempi on mahdollisuus toteuttaa tietty jako.Tietojen vahvistus = E (yläsolmu) – painotettu entropia (lapsisolmu)

Q5. Mikä on Gini Entropy?

Gini-entropia on myös eräänlainen entropia, jota käytetään jaettaessa tietojoukkoa ja sen solmuja. Tässä gini-entropia on hieman erilainen kuin klassinen entropia, ja sen laskeminen on vähemmän monimutkaista kuin klassinen entropia.Gini-entropia – 1 – ((P1)^2 – (P2)^2)

Kuten kaavasta näemme, vahvistusentropian laskeminen mille tahansa roiskeelle on erittäin helppoa, koska meidän on laskettava luokan neliöt ja sitten korvattava se, kun taas klassisessa entropiassa luokkien logarin laskeminen tekee laskemisesta monimutkaisempaa. Tästä syystä gini-entropiaa suositaan eniten päätöspuun algoritmissa.

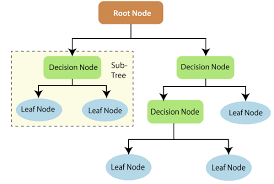

Q6. Mitä juuri- ja lehtisolmut ovat päätöspuissa?

Päätöspuiden juurisolmut ovat solmuja tai pisteitä, joista puu alkaa tai josta tietojoukko jakautuu. Se on puun ylin taso.

lehtien solmut ovat niitä, jotka ovat halkeamien alaosia; Yksinkertaisesti sanottuna, jos juurisolmu jaetaan kahteen osaan, silloin kyseiset kaksi osaa tunnetaan tietyn juurisolmun johtosolmuina.

Q7. Mitä ovat matalat ja syvät päätöspuut?

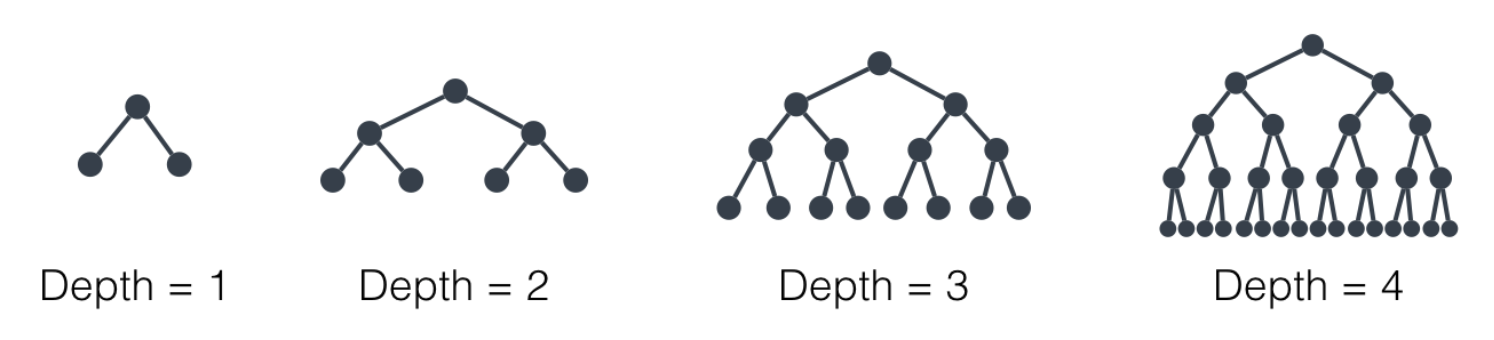

Kuten nimestä voi päätellä, matalat päätöspuut ovat päätöspuita, joita ei kasvateta kovin korkealle syvyydelle ja joissa on huomattavasti vähemmän jakoja tiedosta. Esimerkiksi päätöspuussa on vain kolme jakoa. Syvät päätöspuut on kasvatettu enimmäissyvyyksiinsä ja niissä on monia roiskeita tietojoukossa. Esimerkiksi päätöspuu kasvaa enimmäissyvyyteen, jossa on 15 tai 25 jakoa.

Q8. Kuinka yli- ja aliasovitus tapahtuu?

Hyvin matalissa puissa puussa on vain 2 tai 3 jakoa tiedoissa, mikä tarkoittaa, että algoritmit eivät opi tiedosta jotain arvokasta, koska tiedoissa ei ole riittävästi roiskeita. Algoritmi johtaa huonosti toimivaan malliin koulutuksessa ja molempien tietojen testauksessa, mikä lopulta johtaa mallin alisovitukseen.

Jos taas tarkastelemme puuta, joka on kasvanut sen maksimisyvyyteen, puu tuntee jokaisen datan kuvion ja puu muistaa tiedoista saadut tiedot, mikä ei yritä oppia tiedoista ja antaa 100% tarkkuuden datassa. harjoitussarja ja huono suorituskyky testaussarjassa, mikä lopulta johti liikaa mallin.

Q9. Miksi päätöspuut ovat epävakaita algoritmeja?

Päätöspuut tunnetaan epävakaina algoritmeina, sillä kun lisäämme uuden datapisteen tai uuden tietohavainnon olemassa olevaan dataan, yksilöllisen datapisteen vuoksi mallin on harjoitettava uudelleen ja lisättävä uusin tietopiste tietojoukkoon, tässä koko puurakenteesta ei ole nyt hyötyä ja uuden puun on sisällytettävä tämä tietopiste malliin. Tämän algoritmin ominaisuuden vuoksi ne tunnetaan epävakaina malleina.

Q10. Miksi toimintojen skaalaus ei vaadi päätöspuita?

Päätöspuut työskentelevät jakamalla dataa jakamisesta saadun tiedon vahvistuksen ja entropian mukaan. Tässä datan mittakaava eroaa muista määritteistä; se ei vaikuta jaon entropiaan ja informaation saantiin. Näin ollen dataa ei tarvitse skaalata ennen mainitun algoritmin soveltamista.

Yhteenveto

Tässä artikkelissa keskustelimme haastattelun tärkeimmistä kysymyksistä, jotka voidaan esittää datatieteen kysymyksissä asianmukaisine vastauksineen. Tämä artikkeli auttaa vastaamaan näihin kysymyksiin tehokkaasti haastatteluissa ja oppimaan paremman lähestymistavan tarkan ja tarkan vastauksen suunnitteluun ja toimittamiseen.

Jotkut Keskeiset ostokset tästä artikkelista ovat:

-

Päätöspuut ovat puupohjaisia malleja, jotka jakavat datan ja tulostuotannon.

-

CART-algoritmit ovat binäärisolmualgoritmeja, kun taas ID3 ovat useiden solmujen algoritmeja, joita voidaan käyttää solmuissa, joissa on enemmän kuin kaksi jakoa.

-

Erittäin matalat puut johtavat aliistutukseen ja voimakkaat puut ylisovitukseen.

-

Päätöspuut ovat epävakaita algoritmeja, jotka harjoittelevat, kun uusi havainto lisätään.

-

Ominaisuuksien skaalaus ei ole pakollinen päätöspuille, koska se ei vaikuta jaon tiedon vahvistukseen ja entropiaan.

Tässä artikkelissa näkyvä media ei ole Analytics Vidhyan omistuksessa, ja sitä käytetään tekijän harkinnan mukaan.

liittyvä

- SEO-pohjainen sisällön ja PR-jakelu. Vahvista jo tänään.

- Platoblockchain. Web3 Metaverse Intelligence. Tietoa laajennettu. Pääsy tästä.

- Lähde: https://www.analyticsvidhya.com/blog/2023/02/top-10-must-read-interview-questions-on-decision-trees/

- 1

- 10

- a

- Mukaan

- sen mukaisesti

- tarkkuus

- tarkka

- lisä-

- vaikuttaa

- algoritmi

- algoritmit

- Kaikki

- Analytics

- Analyysi Vidhya

- ja

- vastaus

- vastauksia

- Hakeminen

- lähestymistapa

- sopiva

- asianmukaisesti

- artikkeli

- attribuutteja

- perustua

- perustiedot

- ennen

- Paremmin

- pohja

- laskee

- laskettaessa

- tapaus

- mahdollisuus

- lapsi

- luokka

- luokat

- luokittelu

- täydellinen

- monimutkainen

- Harkita

- tiedot

- tietojenkäsittely

- datapiste

- päätös

- päätöspuu

- syvä

- toimittaa

- tuottaa

- syvyys

- Malli

- suunnittelu

- eri

- harkinnan

- pohtia

- keskusteltiin

- jaettu

- kukin

- tehokkaasti

- olennainen

- Joka

- esimerkki

- olemassa

- Ominaisuus

- lopullinen

- Vihdoin

- kaava

- alkaen

- Saada

- Gini

- Antaa

- menee

- täysikasvuinen

- kasvaa

- ottaa

- auttaa

- tätä

- Korkea

- Miten

- HTTPS

- täytäntöönpanosta

- in

- sisältää

- tiedot

- Haastatella

- haastattelu kysymykset

- Haastattelut

- IT

- Tietää

- tuntemus

- tunnettu

- Sukunimi

- uusin

- johtaa

- OPPIA

- oppiminen

- Taso

- pois

- kone

- koneoppiminen

- TEE

- monet

- max

- maksimi

- merkitys

- mitata

- Media

- minimi

- malli

- mallit

- lisää

- eniten

- moninkertainen

- Täytyy lukea

- nimi

- välttämätön

- Tarve

- Uusi

- solmu

- solmut

- ONE

- Muut

- omistuksessa

- osa

- erityinen

- osat

- Kuvio

- suorituskyky

- esittävä

- Platon

- Platonin tietotieto

- PlatonData

- Kohta

- pistettä

- kehno

- mahdollinen

- Suositut

- esitys

- periaate

- ongelmia

- asianmukainen

- ominaisuudet

- omaisuus

- toimittaa

- tarjoaa

- julkaistu

- kysymys

- kysymykset

- Lue

- regressio

- liittyvä

- luotettava

- tarvitaan

- vastaus

- johtua

- Saatu ja

- tulokset

- juuri

- Said

- sama

- Asteikko

- skaalaus

- tiede

- setti

- matala

- esitetty

- merkittävästi

- Yksinkertainen

- hieman eri

- Ratkaisumme

- jonkin verran

- jotain

- erityinen

- jakaa

- splits

- neliöitä

- seisoo

- alkaa

- rakenne

- riittävä

- Ehdottaa

- Testaus

- -

- tiedot

- heidän

- kolmella

- Kautta

- aika

- että

- ylin

- Top 10

- ylin

- koulutus

- junat

- Puut

- Epävarmuus

- unique

- käyttää

- arvokas

- Mitä

- Mikä on

- joka

- vaikka

- kokonaan

- laajalti

- tulee

- sanoja

- Referenssit

- toimii

- zephyrnet

- nolla-