Image par auteur

Récemment, nous avons tous eu beaucoup de mal à rattraper les dernières versions de l'espace LLM. Au cours des dernières semaines, plusieurs alternatives open-source ChatGPT sont devenues populaires.

Et dans cet article, nous allons en apprendre davantage sur le ChatGLM série et ChatGLM-6B, une alternative open-source et légère à ChatGPT.

Allons-y!

Des chercheurs de l'Université Tsinghua en Chine ont travaillé sur le développement de la série de modèles ChatGLM qui ont des performances comparables à d'autres modèles tels que GPT-3 et BLOOM.

ChatGLM est un modèle de grande langue bilingue formé à la fois en chinois et en anglais. Actuellement, les modèles suivants sont disponibles :

- ChatGLM-130B : un LLM open source

- ChatGLM-100B : non open source, mais disponible via un accès sur invitation uniquement

- ChatGLM-6B : une alternative open source légère

Bien que ces modèles puissent sembler similaires au groupe GPT (Generative Pretrained Transformer) de grands modèles de langage, le Cadre de préformation du modèle de langage général (GLM) est ce qui les rend différents. Nous en apprendrons plus à ce sujet dans la section suivante.

Dans l'apprentissage automatique, vous connaissez les GLM comme modèles linéaires généralisés, mais le GLM dans ChatGLM signifie Modèle de langage général.

Cadre de préformation GLM

La pré-formation LLM a été largement étudiée et est toujours un domaine de recherche actif. Essayons de comprendre les principales différences entre la préformation GLM et les modèles de style GPT.

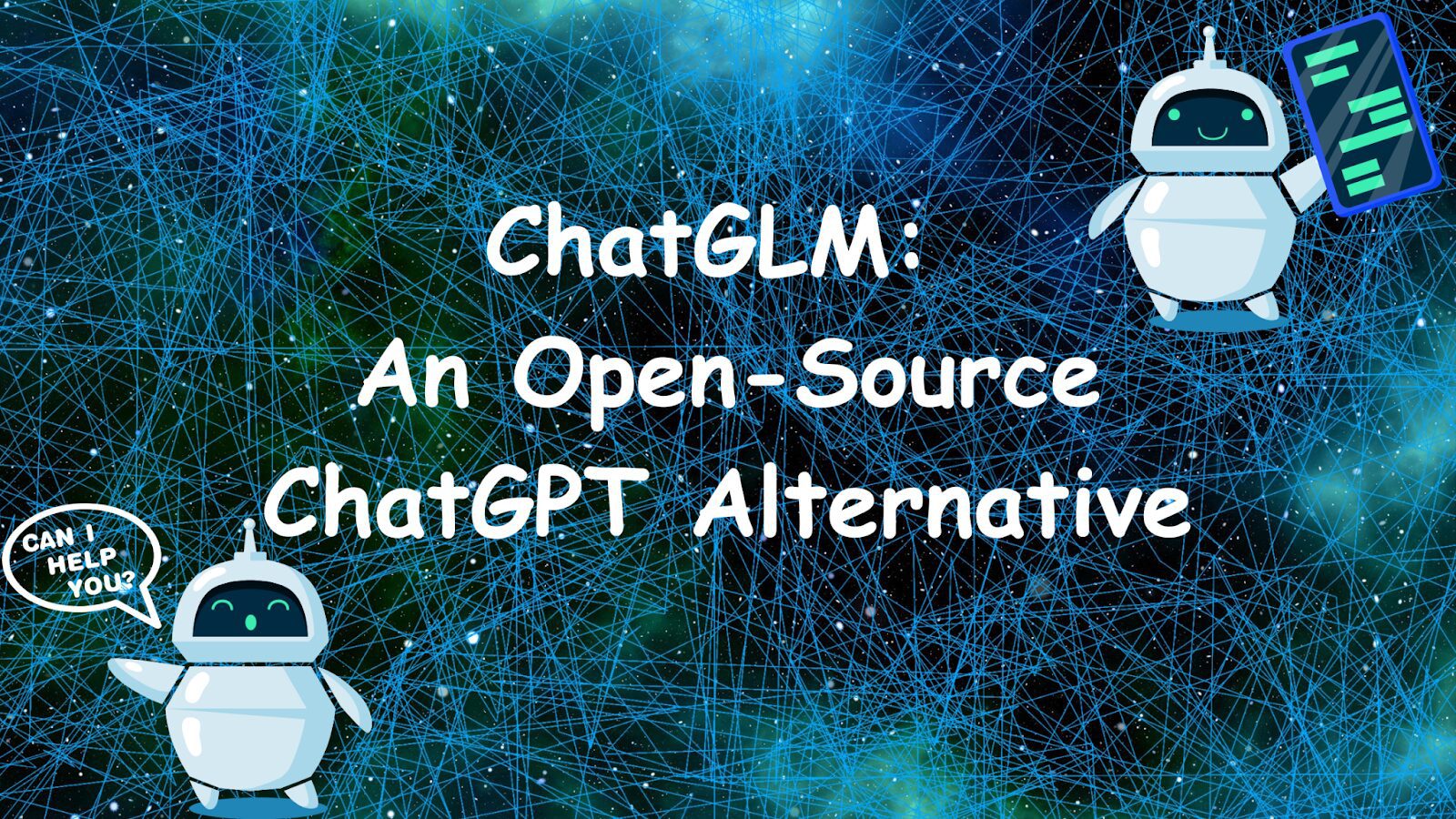

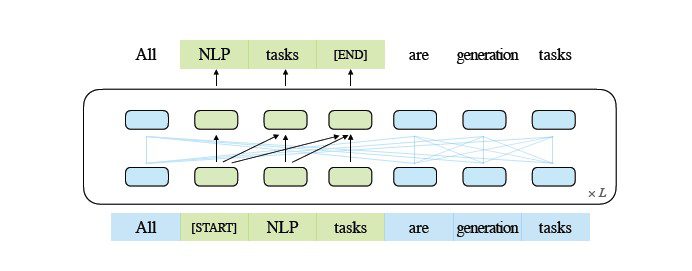

La famille de modèles GPT-3 utilise une modélisation de langage auto-régressive uniquement avec décodeur. En GLM, en revanche, l'optimisation de l'objectif est formulée comme une problème de remplissage de blanc auto régressif.

GLM | Image Source

En termes simples, remplissage de blanc auto régressif implique de masquer une étendue continue de texte, puis de reconstruire séquentiellement le texte de cette suppression. En plus des masques plus courts, il existe un masque plus long qui supprime de manière aléatoire les longs blancs de texte à la fin des phrases. Ceci est fait pour que le modèle fonctionne raisonnablement bien dans la compréhension du langage naturel ainsi que dans les tâches de génération.

Une autre différence réside dans le type d'attention utilisé. Le groupe GPT de grands modèles de langage utilise l'attention unidirectionnelle, tandis que le groupe GLM de LLM utilise attention bidirectionnelle. L'utilisation de l'attention bidirectionnelle sur des contextes non masqués peut mieux capturer les dépendances et améliorer les performances des tâches de compréhension du langage naturel.

Activation GELU

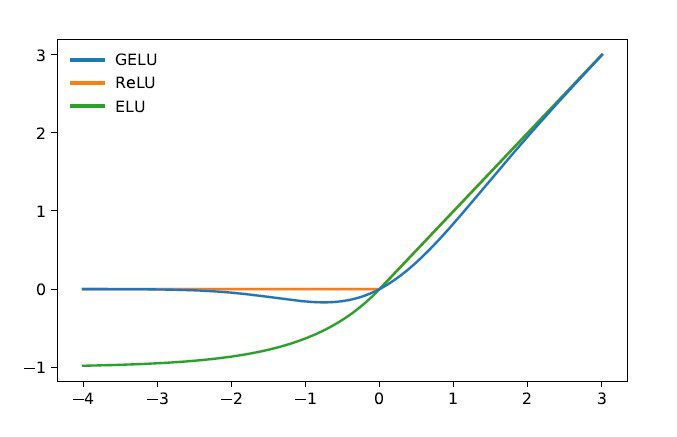

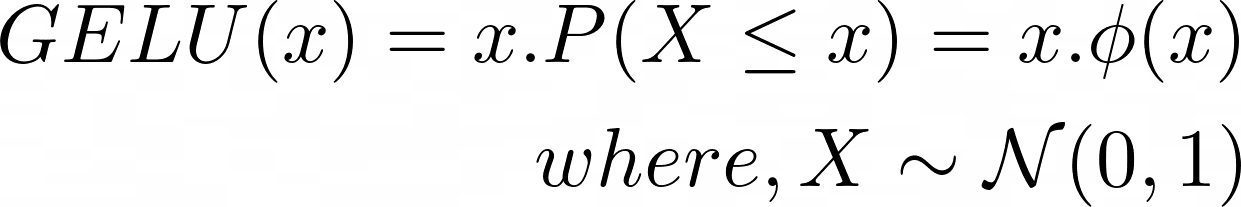

Dans GLM, l'activation GELU (Gaussian Error Linear Units) est utilisée à la place de l'activation ReLU [1].

Activations GELU, ReLU et ELU | Image Source

L'activation GELU et a des valeurs non nulles pour toutes les entrées et a la forme suivante [3] :

L'activation GELU s'avère améliorer les performances par rapport aux activations ReLU, bien que plus intensive en calcul que ReLU.

Dans la série GLM de LLM, ChatGLM-130B qui est open source et fonctionne aussi bien que le modèle Da-Vinci de GPT-3. Comme mentionné, au moment de la rédaction de cet article, il existe une version ChatGLM-100B, qui est limitée à un accès sur invitation uniquement.

ChatGLM-6B

Les détails suivants sur ChatGLM-6B pour le rendre plus accessible aux utilisateurs finaux :

- A environ 6.2 milliards de paramètres.

- Le modèle est pré-formé sur 1 XNUMX milliards de jetons, à parts égales en anglais et en chinois.

- Par la suite, des techniques telles que l'ajustement supervisé et l'apprentissage par renforcement avec rétroaction humaine sont utilisées.

Terminons notre discussion en passant en revue les avantages et les limites de ChatGLM :

Avantages

D'un modèle bilingue à un modèle open source que vous pouvez exécuter localement, ChatGLM-6B présente les avantages suivants :

- La plupart des grands modèles de langue courants sont formés sur de grands corpus de texte anglais, et les grands modèles de langue pour d'autres langues ne sont pas aussi courants. La série ChatGLM de LLM est bilingue et constitue un excellent choix pour le chinois. Le modèle a de bonnes performances en anglais et en chinois.

- ChatGLM-6B est optimisé pour les appareils des utilisateurs. Les utilisateurs finaux disposent souvent de ressources informatiques limitées sur leurs appareils, il devient donc presque impossible d'exécuter des LLM localement, sans accès à des GPU hautes performances. Avec Quantification INT4, ChatGLM-6B peut fonctionner avec une exigence de mémoire modeste de seulement 6 Go.

- Fonctionne bien sur une variété de tâches, y compris la synthèse et les discussions à une ou plusieurs requêtes.

- Malgré le nombre considérablement plus petit de paramètres par rapport aux autres LLM traditionnels, ChatGLM-6B prend en charge une longueur de contexte allant jusqu'à 2048.

Limites

Ensuite, énumérons quelques limitations de ChatGLM-6B :

- Bien que ChatGLM soit un modèle bilingue, ses performances en anglais sont probablement sous-optimales. Cela peut être attribué au fait que les instructions utilisées dans la formation sont principalement en chinois.

- Parce que ChatGLM-6B a considérablement moins de paramètres par rapport à d'autres LLM tels que BLOOM, GPT-3 et ChatGLM-130B, les performances peuvent être moins bonnes lorsque le contexte est trop long. Par conséquent, ChatGLM-6B peut donner des informations inexactes plus souvent que les modèles avec un plus grand nombre de paramètres.

- Les petits modèles de langage ont capacité de mémoire limitée. Par conséquent, dans les discussions à plusieurs tours, les performances du modèle peuvent se dégrader légèrement.

- Les biais, la désinformation et la toxicité sont les limites de tous les LLM, et ChatGLM y est également sensible.

Dans une prochaine étape, exécutez ChatGLM-6B localement ou essayez la démo sur les espaces HuggingFace. Si vous souhaitez approfondir le fonctionnement des LLM, voici une liste de cours gratuits sur les grands modèles de langage.

[1] Z Du, Y Qian et al., GLM : pré-entraînement au modèle de langage général avec remplissage de vides autorégressif, LCA 2022

[2] A Zheng, X Liu et al., GLM-130B - Un modèle pré-entraîné bilingue ouvert, CIML 2023

[3] D Hendryks, K Gimpel, Unités linéaires d'erreur gaussiennes (GELU), arXiv, 2016

ChatGLM-6B : Démo sur les espaces HuggingFace

Repo GitHub

Bala Priya C est un rédacteur technique qui aime créer du contenu long. Ses domaines d'intérêt incluent les mathématiques, la programmation et la science des données. Elle partage son apprentissage avec la communauté des développeurs en créant des didacticiels, des guides pratiques, etc.

- Contenu propulsé par le référencement et distribution de relations publiques. Soyez amplifié aujourd'hui.

- PlatoAiStream. Intelligence des données Web3. Connaissance Amplifiée. Accéder ici.

- Frapper l'avenir avec Adryenn Ashley. Accéder ici.

- La source: https://www.kdnuggets.com/2023/04/chatglm6b-lightweight-opensource-chatgpt-alternative.html?utm_source=rss&utm_medium=rss&utm_campaign=chatglm-6b-a-lightweight-open-source-chatgpt-alternative

- :possède

- :est

- :ne pas

- $UP

- 1

- a

- À propos

- accès

- accessible

- Activation

- activations

- infection

- ajout

- avantages

- AL

- Tous

- alternative

- des alternatives

- an

- ainsi que

- SONT

- Réservé

- domaines

- article

- AS

- At

- précaution

- création

- auto

- disponibles

- BE

- devenez

- devient

- était

- va

- Améliorée

- jusqu'à XNUMX fois

- Milliards

- Bloom

- tous les deux

- mais

- by

- CAN

- capturer

- ChatGPT

- Chine

- chinois

- le choix

- Commun

- Communautés

- comparable

- par rapport

- informatique

- contenu

- contexte

- contextes

- continu

- cours

- La création

- Lecture

- données

- science des données

- profond

- Démo

- détails

- Développeur

- développement

- Compatibles

- différence

- différences

- différent

- spirituelle

- fait

- E & T

- fin

- Anglais

- erreur

- famille

- Réactions

- few

- moins

- Abonnement

- Pour

- formulaire

- trouvé

- de

- Général

- génération

- génératif

- obtenez

- Donner

- aller

- Bien

- GPU

- l'

- Réservation de groupe

- Guides

- main

- Dur

- Vous avez

- ayant

- ici

- ici

- haute performance

- HTML

- HTTPS

- Étreindre

- humain

- if

- impossible

- améliorer

- in

- inexacte

- comprendre

- Y compris

- d'information

- plutôt ;

- Des instructions

- intérêt

- développement

- implique

- IT

- SES

- jpg

- KDnuggetsGenericName

- clés / KEY :

- Savoir

- langue

- Langues

- gros

- plus importantes

- Nom de famille

- Nouveautés

- APPRENTISSAGE

- apprentissage

- Longueur

- léger

- comme

- Probable

- limites

- limité

- Liste

- localement

- Location

- plus long

- Faible

- click

- machine learning

- Courant dominant

- faire

- FAIT DU

- masque

- Masques

- math

- Mai..

- Mémoire

- mentionné

- Désinformation

- modèle

- modélisation statistique

- numériques jumeaux (digital twin models)

- PLUS

- Nature

- Langage naturel

- Compréhension du langage naturel

- next

- nombre

- Nvidia

- objectif

- of

- souvent

- on

- ouvert

- open source

- à mettre en œuvre pour gérer une entreprise rentable. Ce guide est basé sur trois décennies d'expérience

- optimisé

- or

- Autre

- nos

- ande

- plus de

- paramètres

- performant

- effectue

- Platon

- Intelligence des données Platon

- PlatonDonnées

- Populaire

- pré

- Programmation

- apprentissage par renforcement

- de Presse

- exigence

- un article

- Ressources

- limité

- résultat

- Courir

- s

- Sciences

- Section

- Série

- plusieurs

- Partages

- elle

- similaires

- étapes

- unique

- faibles

- So

- Space

- espaces

- envergure

- peuplements

- étapes

- Encore

- étudié

- tel

- Super

- Les soutiens

- sensible

- tâches

- Technique

- techniques

- conditions

- que

- qui

- La

- leur

- Les

- puis

- Là.

- donc

- Ces

- this

- Avec

- fiable

- à

- trop

- qualifié

- Formation

- Billion

- Tsinghua

- tutoriels

- type

- comprendre

- compréhension

- unités

- université

- utilisé

- d'utiliser

- Utilisateur

- utilisateurs

- en utilisant

- Valeurs

- variété

- version

- Semaines

- WELL

- Quoi

- quand

- qui

- WHO

- avec

- travaillé

- de travail

- pire

- envelopper

- écrivain

- écriture

- X

- you

- zéphyrnet