Analyse de données à l'aide de Scala

Il est très important de choisir le bon outil pour l'analyse des données. Sur les forums Kaggle, où se déroulent les compétitions internationales de Data Science, les gens demandent souvent quel outil est le meilleur. R et Python sont en tête de liste. Dans cet article, nous vous parlerons d'une pile alternative de technologies d'analyse de données, basée sur Scala.

By Roman Zykov, Fondateur/Data Scientist @ TopDataLab

Il est très important de choisir le bon outil pour l'analyse des données. Sur le Kaggle.com forums, où se déroulent des compétitions internationales de Data Science, les gens demandent souvent quel outil est le meilleur. R et Python sont en tête de liste. Dans cet article, nous vous parlerons d'une pile alternative de technologies d'analyse de données, basée sur le langage de programmation Scala et Spark plate-forme informatique distribuée.

Comment en sommes-nous arrivés là ? Chez Retail Rocket, nous faisons beaucoup d'apprentissage automatique sur de très grands ensembles de données. Nous avions l'habitude d'utiliser un tas d'IPython + Pyhs2 (pilote ruche pour Python) + Pandas + Sklearn pour développer des prototypes. À la fin de l'été 2014, nous avons pris la décision fondamentale de passer à Spark, car les expériences ont montré que nous obtiendrons 3 à 4 fois plus de performances sur le même parc de serveurs.

Un autre avantage est que nous pouvons utiliser un langage de programmation pour la modélisation et le code qui s'exécutera sur les serveurs de production. C'était un énorme avantage pour nous, car avant nous utilisions 4 langages simultanément : Hive, Pig, Java, Python. C'est un problème pour une petite équipe d'ingénieurs.

Spark prend également en charge le travail avec Python/Scala/Java via des API. Nous avons décidé de choisir Scala car c'est le langage dans lequel Spark est écrit, ce qui signifie que nous pouvons analyser son code source et corriger les bugs si nécessaire. C'est aussi la JVM sur laquelle s'exécute Hadoop.

Je dois dire que le choix n'a pas été facile, puisque personne dans l'équipe ne connaissait Scala à l'époque.

C'est un fait bien connu que pour apprendre à bien communiquer dans une langue, vous devez vous immerger dans la langue et l'utiliser autant que possible. Nous avons donc abandonné la pile Python au profit de Scala pour la modélisation et l'analyse rapide des données.

La première étape consistait à trouver un remplaçant pour les notebooks IPython. Les options étaient les suivantes :

- Zeppelin – un bloc-notes de type IPython pour Spark ;

- ISpark;

- Carnet d'étincelles ;

- Bloc-notes Spark IPython d'IBM.

- Apache Torée

Jusqu'à présent, le choix s'est porté sur ISpark parce que c'est simple – c'est IPython pour Scala/Spark. Il a été relativement facile de visser les graphiques HighCharts et R. Et nous n'avons eu aucun problème à le connecter au cluster Yarn.

Tâche

Essayons de répondre à la question : le montant moyen des achats (AOV) dans votre boutique en ligne dépend-il de paramètres client statiques, qui incluent le règlement, le type de navigateur (mobile/Desktop), le système d'exploitation et la version du navigateur ? Vous pouvez le faire avec Information mutuelle.

Nous utilisons beaucoup l'entropie pour nos algorithmes de recommandation et d'analyse : la formule classique de Shannon, la divergence de Kullback-Leibler, l'Information Mutuelle. Nous avons même soumis un article sur ce sujet. Il y a une section séparée, bien que petite, consacrée à ces mesures dans le célèbre manuel de Murphy sur l'apprentissage automatique.

Analysons-le sur des données réelles de Retail Rocket. Auparavant, j'ai copié l'échantillon de notre cluster sur mon ordinateur sous forme de fichier csv.

Données

Ici, nous utilisons ISpark et Spark exécutés en mode local, ce qui signifie que tous les calculs sont effectués localement et sont répartis entre les cœurs de processeur. Tout est décrit dans les commentaires du code. La chose la plus importante est qu'en sortie nous obtenons RDD (Spark data structure), qui est une collection de classes de cas de type Row, qui est définie dans le code. Cela vous permettra de vous référer aux champs via ".", par exemple _.categoryId.

La ligne ci-dessus utilise le nouveau type de données DataFrame ajouté à Spark dans la version 1.3.0, il est très similaire à la structure similaire de la bibliothèque pandas en Python. toDf récupère notre classe de cas Row, nous pouvons donc faire référence au champ par son nom.

Pour une analyse plus approfondie, nous devons sélectionner une seule catégorie, de préférence avec beaucoup de données. Pour ce faire, nous devons obtenir une liste des catégories les plus populaires.

Théoriquement, vous pouvez utiliser n'importe quel graphique HighCharts tant qu'il est pris en charge dans Wisp. Tous les graphiques sont interactifs.

Essayons de faire la même chose, mais avec R.

Exécutez le client R et tracez un caractère :

Information mutuelle

Les graphiques montrent qu'il existe une relation, mais les métriques confirmeront-elles cette conclusion pour nous ? Il existe de nombreuses façons de le faire. Dans notre cas, nous utilisons des informations mutuelles entre les valeurs du tableau. Il mesure la dépendance mutuelle entre les distributions de deux variables aléatoires (discrètes).

Pour les distributions discrètes, il est calculé à l'aide de la formule :

Mais nous sommes intéressés par une métrique plus pratique - la Coefficient d'information maximal (MIC) qui nécessite des calculs délicats pour les variables continues. Voici comment sonne la définition de ce paramètre.

Soit D = (x, y) un ensemble de n paires ordonnées d'éléments de variables aléatoires X et Y. Cet espace bidimensionnel est partitionné par des grilles X et Y, regroupant les valeurs x et y en partitions X et Y, respectivement ( rappelez-vous les histogrammes !).

où B(n) est la taille du maillage, I∗(D, X, Y ) est l'information mutuelle des partitions X et Y. Le dénominateur spécifie le logarithme, qui sert à normaliser le MIC aux valeurs du segment [0, 1]. MIC prend des valeurs continues dans l'intervalle [0,1] : pour les valeurs extrêmes c'est 1 s'il y a dépendance, 0 s'il n'y en a pas. Quoi d'autre peut être lu sur ce sujet est répertorié à la fin de l'article, dans la liste des références.

La livre (Machine Learning: a Probabilistic Perspective) appelle MIC (mutual information) une corrélation du 21e siècle. Et voici pourquoi ! Le graphique ci-dessous montre 6 dépendances (graphiques C à H). La corrélation de Pearson et le MIC ont été calculés pour eux, et ils sont marqués des lettres correspondantes sur le graphique à gauche. Comme on peut le voir, la corrélation de Pearson est presque nulle, tandis que le MIC montre une corrélation (graphiques F, G, E).

Source : Reshef, DN, YA Reshef, HK Finucane, SR Grossman, G. McVean, PJ Turnbaugh, ES Lander, M. Mitzenmacher et PC Sabeti. « Détection de nouvelles associations dans de grands ensembles de données. »

Source : Reshef, DN, YA Reshef, HK Finucane, SR Grossman, G. McVean, PJ Turnbaugh, ES Lander, M. Mitzenmacher et PC Sabeti. « Détection de nouvelles associations dans de grands ensembles de données. »Le tableau ci-dessous montre un certain nombre de métriques qui ont été calculées sur différentes dépendances : aléatoire, linéaire, cubique, etc. Le tableau montre que le MIC se comporte très bien, détectant les dépendances non linéaires.

Source : Reshef, DN, YA Reshef, HK Finucane, SR Grossman, G. McVean, PJ Turnbaugh, ES Lander, M. Mitzenmacher et PC Sabeti. « Détection de nouvelles associations dans de grands ensembles de données. »

Source : Reshef, DN, YA Reshef, HK Finucane, SR Grossman, G. McVean, PJ Turnbaugh, ES Lander, M. Mitzenmacher et PC Sabeti. « Détection de nouvelles associations dans de grands ensembles de données. »Dans notre cas, nous avons affaire à un calcul MIC où nous avons une variable continue Aov et toutes les autres sont discrètes avec des valeurs non ordonnées, comme le type de navigateur. Afin de calculer correctement le MIC, nous devons discrétiser la variable Aov. Nous utiliserons une solution prête à l'emploi de exploredata.net. Il y a un problème avec cette solution : elle suppose que les deux variables sont continues et exprimées en valeurs flottantes. Nous devrons donc tromper le code en encodant les valeurs des variables discrètes dans Float et en changeant aléatoirement l'ordre de ces variables. Pour ce faire, nous devrons faire de nombreuses itérations avec un ordre aléatoire (100), et nous prendrons comme résultat la valeur MIC maximale.

Pour l'expérience, j'ai ajouté une variable aléatoire avec une distribution uniforme et l'AOV (Average Purchase Value) lui-même. Comme nous pouvons le voir, presque tous les CMI étaient inférieurs au CMI aléatoire, qui peut être considéré comme un seuil de décision « conditionnel ». L'Aov MIC est presque l'unité, ce qui est naturel, car la corrélation avec elle-même est égale à 1.

Une question intéressante se pose : pourquoi voit-on une corrélation sur les graphiques, mais le MIC est nul ? Nous pouvons proposer beaucoup d'hypothèses, mais très probablement pour le cas d'os Family, c'est assez simple - le nombre de machines Windows est beaucoup plus élevé que le nombre d'autres :

Conclusion

J'espère que Scala gagnera en popularité parmi les analystes de données (Data Scientists). C'est très pratique car il est possible de travailler avec un notebook IPython standard + d'obtenir toutes les fonctionnalités de Spark. Ce code peut fonctionner en toute sécurité avec des téraoctets de données, il vous suffit de modifier la ligne de configuration dans ISpark, en spécifiant l'URI de votre cluster.

Bibliographie

Reshef, DN, YA Reshef, HK Finucane, SR Grossman, G. McVean, PJ Turnbaugh, ES Lander, M. Mitzenmacher et PC Sabeti. « Détection de nouvelles associations dans de grands ensembles de données. »

MINE : logiciel d'exploration non paramétrique de l'information maximale utilisant MIC

Minepy - Exploration non-param basée sur l'information maximale (Python, C++, MATLAB, Octave))étrique.

Bibliothèque Java avec ensembles de données pour MIC

« Apprentissage automatique : une perspective probabiliste » Kevin Patrick Murphy

L'essentiel du code ci-dessus

Bio: Roman Zykov est Fondateur et Data Scientist chez TopDataLab, et a 20 ans d'expérience dans l'analyse de données, titulaire d'une maîtrise en mathématiques appliquées et physique. Roman a également écrit le livre "Roman's Data Science: How to monetize your data", disponible sur Amazon.

ORIGINALE. Republié avec permission.

Connexe:

Source : https://www.kdnuggets.com/2021/09/data-analysis-scala.html

- "

- &

- 100

- Avantage

- algorithmes

- Tous

- Amazon

- parmi

- selon une analyse de l’Université de Princeton

- Apache

- Apis

- applications

- article

- Volt (Bolt)

- navigateur

- bogues

- construire

- Bouquet

- Change

- Charts

- code

- commentaires

- Compétitions

- informatique

- données

- l'analyse des données

- science des données

- Data Scientist

- traitement

- l'apprentissage en profondeur

- développer

- DID

- informatique distribuée

- driver

- ENGINEERING

- Les ingénieurs

- etc

- Excel

- Découvrez

- expérience

- exploration

- Visage

- famille

- RAPIDE

- Fonctionnalités:

- Des champs

- Prénom

- Fixer

- fondateur

- Framework

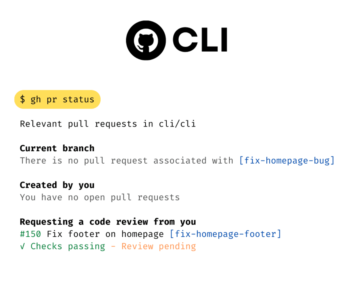

- GitHub

- Hadoop

- ici

- Ruche

- Comment

- How To

- HTTPS

- majeur

- d'information

- Interactif

- International

- IT

- Java

- langue

- Langues

- gros

- APPRENTISSAGE

- apprentissage

- Bibliothèque

- Gamme

- Liste

- locales

- localement

- Location

- machine learning

- Les machines

- mathématiques

- Métrique

- Microsoft

- modélisation statistique

- Le Plus Populaire

- ordinateurs portables

- en ligne

- boutique en ligne

- ouvert

- open source

- d'exploitation

- le système d'exploitation

- Options

- de commander

- Autres

- Papier

- Personnes

- performant

- objectifs

- Physique

- plateforme

- Populaire

- portefeuille

- Vidéo

- Programmation

- Projet

- achat

- Python

- détail

- Courir

- pour le running

- Scala

- Sciences

- scientifiques

- set

- règlement

- étapes

- Taille

- compétences

- petit

- So

- Logiciels

- Space

- Boutique

- Stories

- soumis

- été

- Appareils

- Les soutiens

- Interrupteur

- combustion propre

- Les technologies

- Essais

- Le graphique

- fiable

- top

- unité

- URI

- us

- Plus-value

- web

- Wikipédia

- fenêtres

- Activités principales

- X

- années

- zéro