Les germes d'un changement de paradigme d'apprentissage automatique (ML) existent depuis des décennies, mais avec la disponibilité immédiate d'une capacité de calcul pratiquement infinie, une prolifération massive de données et l'avancement rapide des technologies ML, les clients de tous les secteurs adoptent et utilisent rapidement ML technologies pour transformer leurs entreprises.

Tout récemment, les applications d'IA génératives ont capté l'attention et l'imagination de tous. Nous sommes vraiment à un point d'inflexion passionnant dans l'adoption généralisée du ML, et nous pensons que chaque expérience client et chaque application seront réinventées avec l'IA générative.

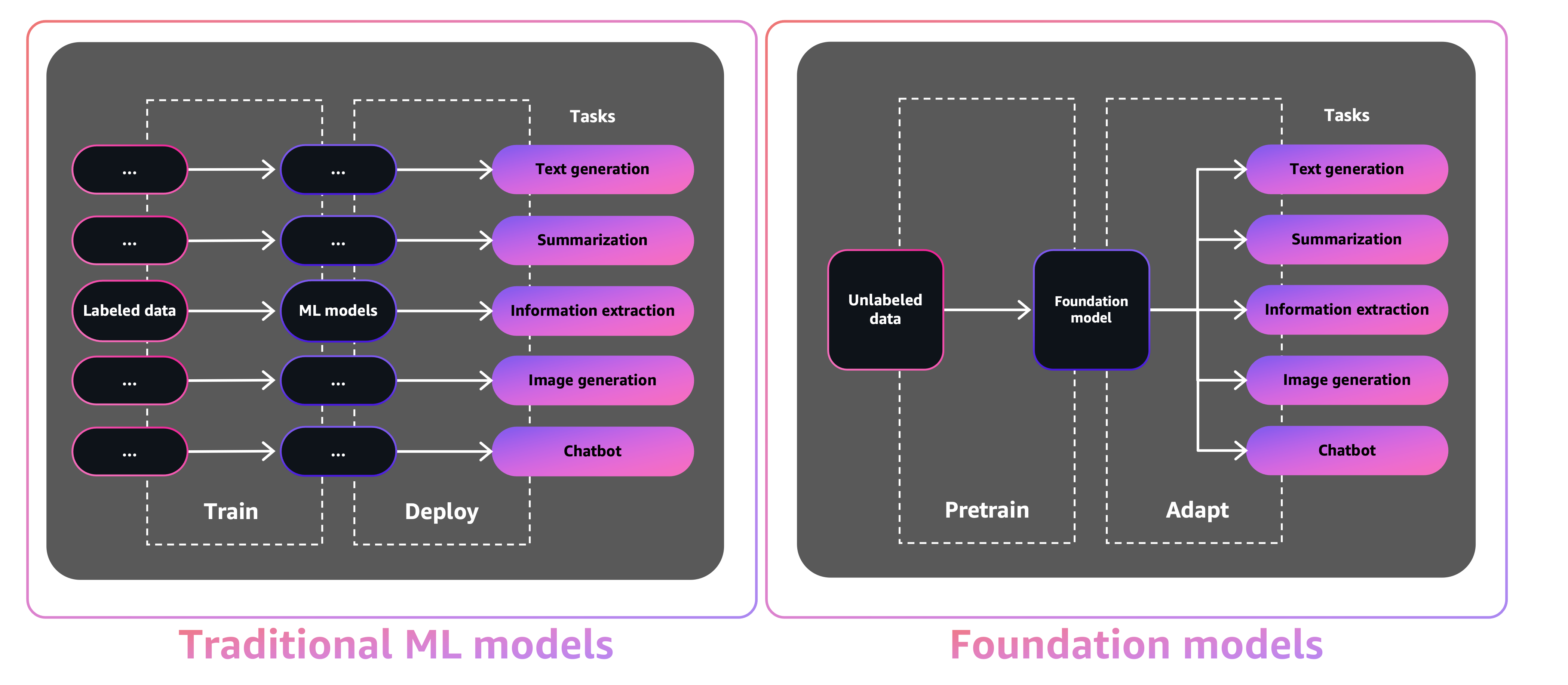

L'IA générative est un type d'IA qui peut créer de nouveaux contenus et idées, notamment des conversations, des histoires, des images, des vidéos et de la musique. Comme toute IA, l'IA générative est alimentée par des modèles ML, de très grands modèles pré-formés sur de vastes corpus de données et communément appelés modèles de base (FM).

La taille et la nature polyvalente des FM les différencient des modèles ML traditionnels, qui effectuent généralement des tâches spécifiques, telles que l'analyse du texte pour le sentiment, la classification des images et la prévision des tendances.

Avec les modèles ML traditionnels, pour accomplir chaque tâche spécifique, vous devez collecter des données étiquetées, former un modèle et déployer ce modèle. Avec les modèles de base, au lieu de collecter des données étiquetées pour chaque modèle et de former plusieurs modèles, vous pouvez utiliser le même FM pré-formé pour adapter diverses tâches. Vous pouvez également personnaliser les FM pour exécuter des fonctions spécifiques à un domaine qui se différencient de vos entreprises, en utilisant seulement une petite fraction des données et des calculs nécessaires pour former un modèle à partir de zéro.

L'IA générative a le potentiel de perturber de nombreuses industries en révolutionnant la façon dont le contenu est créé et consommé. La production de contenu original, la génération de code, l'amélioration du service client et la synthèse de documents sont des cas d'utilisation typiques de l'IA générative.

Amazon SageMaker JumpStart fournit des modèles open source préformés pour un large éventail de types de problèmes pour vous aider à démarrer avec le ML. Vous pouvez former et régler ces modèles de manière incrémentielle avant le déploiement. JumpStart fournit également des modèles de solution qui configurent l'infrastructure pour les cas d'utilisation courants, et des exemples de blocs-notes exécutables pour ML avec Amazon Sage Maker.

Avec plus de 600 modèles pré-formés disponibles et en croissance chaque jour, JumpStart permet aux développeurs d'intégrer rapidement et facilement des techniques ML de pointe dans leurs flux de travail de production. Vous pouvez accéder aux modèles préformés, aux modèles de solution et aux exemples via la page d'accueil JumpStart dans Amazon SageMakerStudio. Vous pouvez également accéder aux modèles JumpStart à l'aide du SDK SageMaker Python. Pour plus d'informations sur l'utilisation des modèles JumpStart par programmation, consultez Utiliser les algorithmes SageMaker JumpStart avec des modèles pré-entraînés.

En avril 2023, AWS a dévoilé Socle amazonien, qui permet de créer des applications génératives basées sur l'IA via des modèles pré-formés de startups, notamment Laboratoires AI21, Anthropiqueet IA de stabilité. Amazon Bedrock offre également un accès aux modèles de fondation Titan, une famille de modèles formés en interne par AWS. Avec l'expérience sans serveur d'Amazon Bedrock, vous pouvez facilement trouver le bon modèle pour vos besoins, démarrer rapidement, personnaliser en privé les FM avec vos propres données, et les intégrer et les déployer facilement dans vos applications à l'aide des outils et des capacités AWS que vous connaissez. avec (y compris les intégrations avec les fonctionnalités de SageMaker ML telles que Expériences Amazon SageMaker tester différents modèles et Pipelines Amazon SageMaker pour gérer vos FM à grande échelle) sans avoir à gérer d'infrastructure.

Dans cet article, nous montrons comment déployer des modèles d'IA génératifs d'image et de texte à partir de JumpStart à l'aide de Kit de développement AWS Cloud (AWSCDK). AWS CDK est une infrastructure de développement logiciel open source permettant de définir les ressources de votre application cloud à l'aide de langages de programmation familiers tels que Python.

Nous utilisons le modèle Stable Diffusion pour la génération d'images et le modèle FLAN-T5-XL pour compréhension du langage naturel (NLU) et génération de texte à partir de Étreindre le visage dans JumpStart.

Vue d'ensemble de la solution

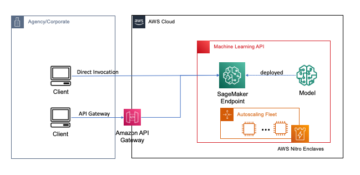

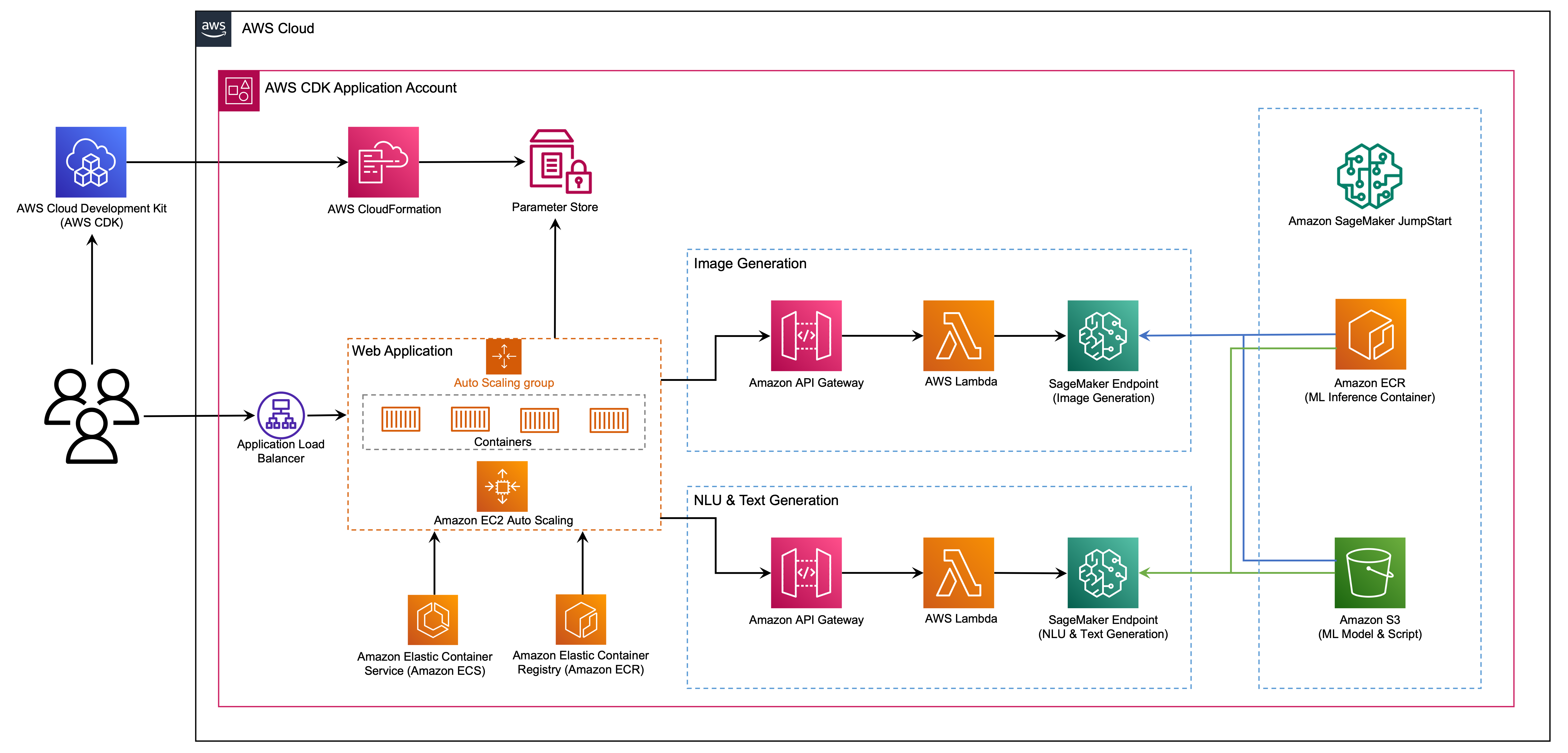

L'application Web est basée sur Rationalisé, une bibliothèque Python open source qui facilite la création et le partage de superbes applications Web personnalisées pour le ML et la science des données. Nous hébergeons l'application Web en utilisant Service de conteneur élastique Amazon (Amazon ECS) avec AWSFargate et il est accessible via un équilibreur de charge d'application. Fargate est une technologie que vous pouvez utiliser avec Amazon ECS pour exécuter conteneurs sans avoir à gérer des serveurs ou des clusters ou des machines virtuelles. Les points de terminaison du modèle IA génératif sont lancés à partir d'images JumpStart dans Registre des conteneurs élastiques Amazon (Amazon ECR). Les données du modèle sont stockées sur Service de stockage simple Amazon (Amazon S3) dans le compte JumpStart. L'application web interagit avec les modèles via Passerelle d'API Amazon ainsi que AWS Lambda fonctionne comme indiqué dans le schéma suivant.

API Gateway fournit à l'application Web et aux autres clients une interface RESTful standard, tout en protégeant les fonctions Lambda qui s'interfacent avec le modèle. Cela simplifie le code de l'application cliente qui utilise les modèles. Les points de terminaison API Gateway sont accessibles publiquement dans cet exemple, ce qui permet d'étendre cette architecture pour implémenter différents Contrôles d'accès aux API et s'intègre à d'autres applications.

Dans cet article, nous vous expliquons les étapes suivantes :

- Installez l' Interface de ligne de commande AWS (AWS CLI) et AWSCDK v2 sur votre machine locale.

- Clonez et configurez l'application AWS CDK.

- Déployez l'application AWS CDK.

- Utilisez le modèle d'IA de génération d'images.

- Utilisez le modèle d'IA de génération de texte.

- Afficher les ressources déployées sur le Console de gestion AWS.

Nous fournissons un aperçu du code de ce projet dans l'annexe à la fin de cet article.

Pré-requis

Vous devez avoir les prérequis suivants :

Vous pouvez déployer l'infrastructure de ce didacticiel à partir de votre ordinateur local ou vous pouvez utiliser AWSCloud9 comme poste de travail de déploiement. AWS Cloud9 est livré préchargé avec AWS CLI, AWS CDK et Docker. Si vous optez pour AWS Cloud9, créer l'environnement du Console AWS.

Le coût estimé pour terminer ce message est de 50 $, en supposant que vous laissez les ressources fonctionner pendant 8 heures. Assurez-vous de supprimer les ressources que vous créez dans cet article pour éviter les frais courants.

Installez l'AWS CLI et AWS CDK sur votre machine locale

Si vous n'avez pas déjà l'AWS CLI sur votre ordinateur local, reportez-vous à Installation ou mise à jour de la dernière version de l'AWS CLI ainsi que Configuration de l'AWS CLI.

Installez le kit d'outils AWS CDK globalement à l'aide de la commande de gestionnaire de package de nœud suivante :

Exécutez la commande suivante pour vérifier l'installation correcte et imprimer le numéro de version d'AWS CDK :

Assurez-vous que Docker est installé sur votre ordinateur local. Exécutez la commande suivante pour vérifier la version :

Cloner et configurer l'application AWS CDK

Sur votre machine locale, clonez l'application AWS CDK avec la commande suivante :

Accédez au dossier du projet :

Avant de déployer l'application, examinons la structure du répertoire :

Les stack Le dossier contient le code de chaque pile dans l'application AWS CDK. Le code dossier contient le code des fonctions Lambda. Le référentiel contient également l'application Web située sous le dossier web-app.

Les cdk.json indique à AWS CDK Toolkit comment exécuter votre application.

Cette application a été testée dans le us-east-1 Région, mais cela devrait fonctionner dans n'importe quelle région disposant des services et du type d'instance d'inférence requis ml.g4dn.4xlarge spécifié dans app.py.

Mettre en place un environnement virtuel

Ce projet est configuré comme un projet Python standard. Créez un environnement virtuel Python à l'aide du code suivant :

Utilisez la commande suivante pour activer l'environnement virtuel :

Si vous êtes sur une plate-forme Windows, activez l'environnement virtuel comme suit :

Une fois l'environnement virtuel activé, mettez à niveau pip vers la dernière version :

Installez les dépendances requises :

Avant de déployer une application AWS CDK, vous devez amorcer un espace dans votre compte et la région dans laquelle vous effectuez le déploiement. Pour démarrer dans votre région par défaut, exécutez la commande suivante :

Si vous souhaitez déployer dans un compte et une région spécifiques, exécutez la commande suivante :

Pour plus d'informations sur cette configuration, visitez Premiers pas avec AWS CDK.

Structure de la pile d'applications AWS CDK

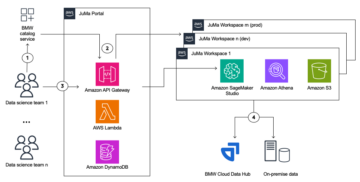

L'application AWS CDK contient plusieurs piles, comme illustré dans le schéma suivant.

Vous pouvez répertorier les piles dans votre application AWS CDK avec la commande suivante :

Voici d'autres commandes AWS CDK utiles :

- cdkls - Répertorie toutes les piles dans l'application

- synthé cdk – Émet le synthétisé AWS CloudFormation modèle

- cdk déployer – Déploie cette pile sur votre compte et votre région AWS par défaut

- différence cdk – Compare la pile déployée avec l'état actuel

- documents cdk – Ouvre la documentation AWS CDK

La section suivante vous montre comment déployer l'application AWS CDK.

Déployer l'application AWS CDK

L'application AWS CDK sera déployée dans la région par défaut en fonction de la configuration de votre poste de travail. Si vous souhaitez forcer le déploiement dans une région spécifique, définissez votre AWS_DEFAULT_REGION variable d'environnement en conséquence.

À ce stade, vous pouvez déployer l'application AWS CDK. Commencez par lancer la pile réseau VPC :

Si vous y êtes invité, entrez y procéder au déploiement. Vous devriez voir une liste des ressources AWS qui sont provisionnées dans la pile. Cette étape prend environ 3 minutes.

Ensuite, vous lancez la pile d'applications Web :

Après avoir analysé la pile, l'AWS CDK affichera la liste des ressources dans la pile. Entrez y pour poursuivre le déploiement. Cette étape prend environ 5 minutes.

Notez le WebApplicationServiceURL de la sortie pour une utilisation ultérieure. Vous pouvez également le récupérer sur la console AWS CloudFormation, sous le GenerativeAiDemoWebStack sorties de pile.

Maintenant, lancez la pile de points de terminaison du modèle d'IA de génération d'image :

Cette étape prend environ 8 minutes. Le point de terminaison du modèle de génération d'image est déployé, nous pouvons maintenant l'utiliser.

Utiliser le modèle d'IA de génération d'images

Le premier exemple montre comment utiliser Stable Diffusion, une puissante technique de modélisation générative qui permet la création d'images de haute qualité à partir d'invites de texte.

- Accédez à l'application Web à l'aide du

WebApplicationServiceURLde la sortie deGenerativeAiDemoWebStackdans votre navigateur.

- Dans le volet de navigation, choisissez Génération d'image.

- Les Nom du point de terminaison SageMaker ainsi que URL API GW les champs seront pré-remplis, mais vous pouvez modifier l'invite de description de l'image si vous le souhaitez.

- Selectionnez Générer une image.

- L'application effectuera un appel au point de terminaison SageMaker. Cela prend quelques secondes. Une image avec les caractéristiques de votre description d'image s'affichera.

Utiliser le modèle d'IA de génération de texte

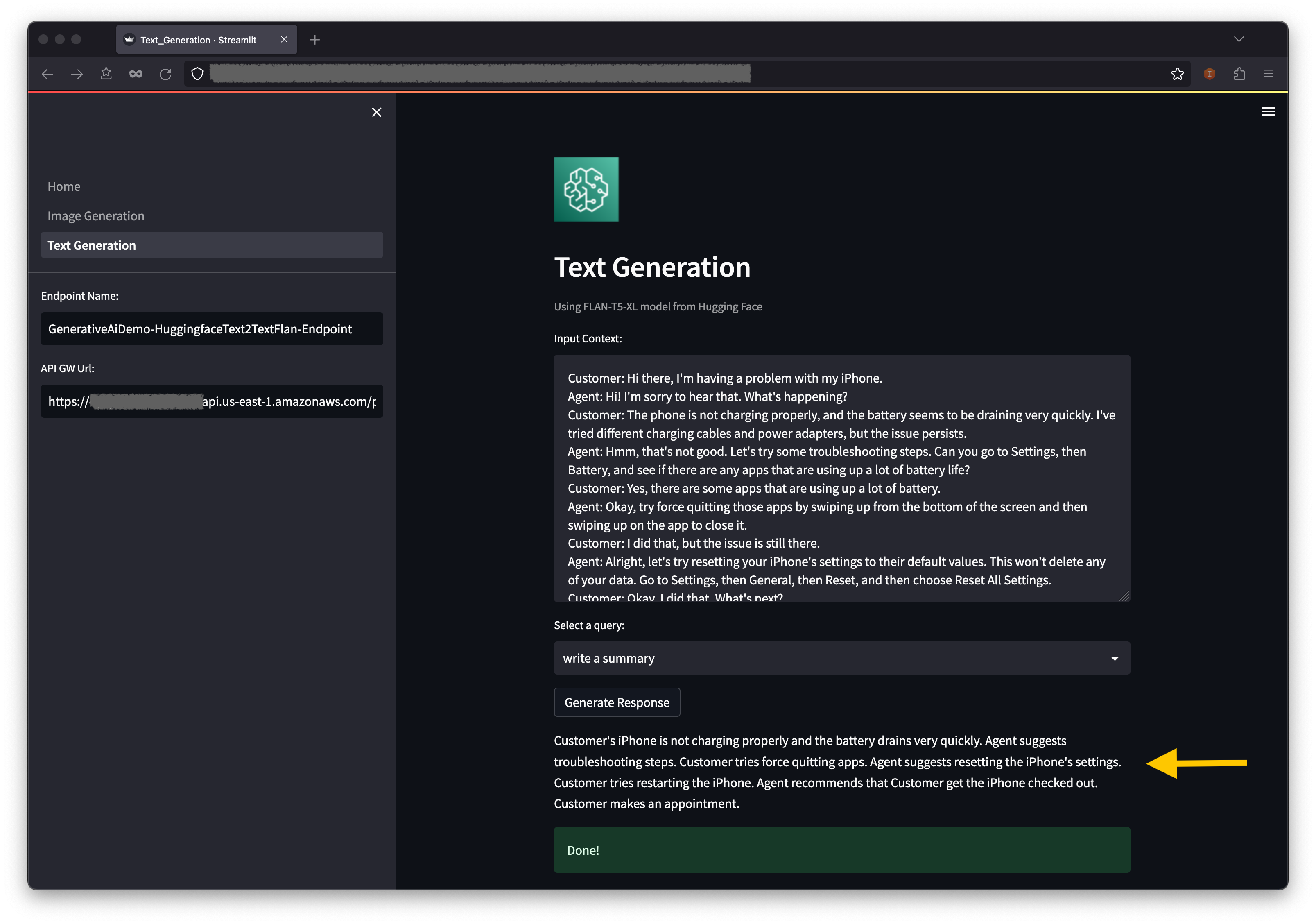

Le deuxième exemple s'articule autour de l'utilisation du modèle FLAN-T5-XL, qui est un modèle de base ou grand langage (LLM), pour réaliser un apprentissage en contexte pour la génération de texte tout en abordant également un large éventail de compréhension du langage naturel (NLU) et naturel. tâches de génération de langage (NLG).

Certains environnements peuvent limiter le nombre de points de terminaison que vous pouvez lancer à la fois. Si tel est le cas, vous pouvez lancer un terminal SageMaker à la fois. Pour arrêter un point de terminaison SageMaker dans l'application AWS CDK, vous devez détruire la pile de points de terminaison déployée et avant de lancer l'autre pile de points de terminaison. Pour désactiver le point de terminaison du modèle d'IA de génération d'image, exécutez la commande suivante :

Lancez ensuite la pile de points de terminaison du modèle d'IA de génération de texte :

Entrez y aux invites.

Une fois la pile de points de terminaison du modèle de génération de texte lancée, procédez comme suit :

- Revenez à l'application Web et choisissez Génération de texte dans le volet de navigation.

- Les Contexte d'entrée Le champ est pré-rempli avec une conversation entre un client et un agent concernant un problème avec le téléphone du client, mais vous pouvez entrer votre propre contexte si vous le souhaitez.

- Sous le contexte, vous trouverez des requêtes préremplies dans le menu déroulant. Choisissez une requête et choisissez Générer une réponse.

- Vous pouvez également entrer votre propre requête dans le Requête d'entrée champ puis choisissez Générer une réponse.

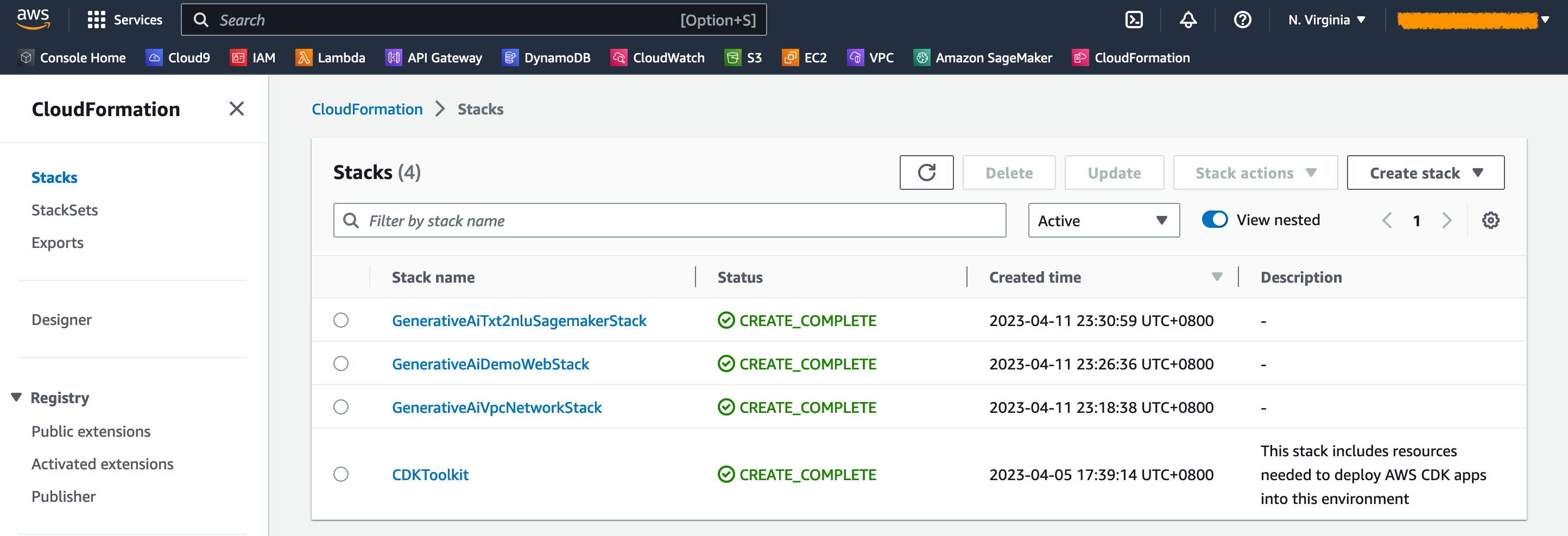

Afficher les ressources déployées sur la console

Sur la console AWS CloudFormation, choisissez Combos dans le volet de navigation pour afficher les piles déployées.

Sur la console Amazon ECS, vous pouvez voir les clusters sur le Clusters .

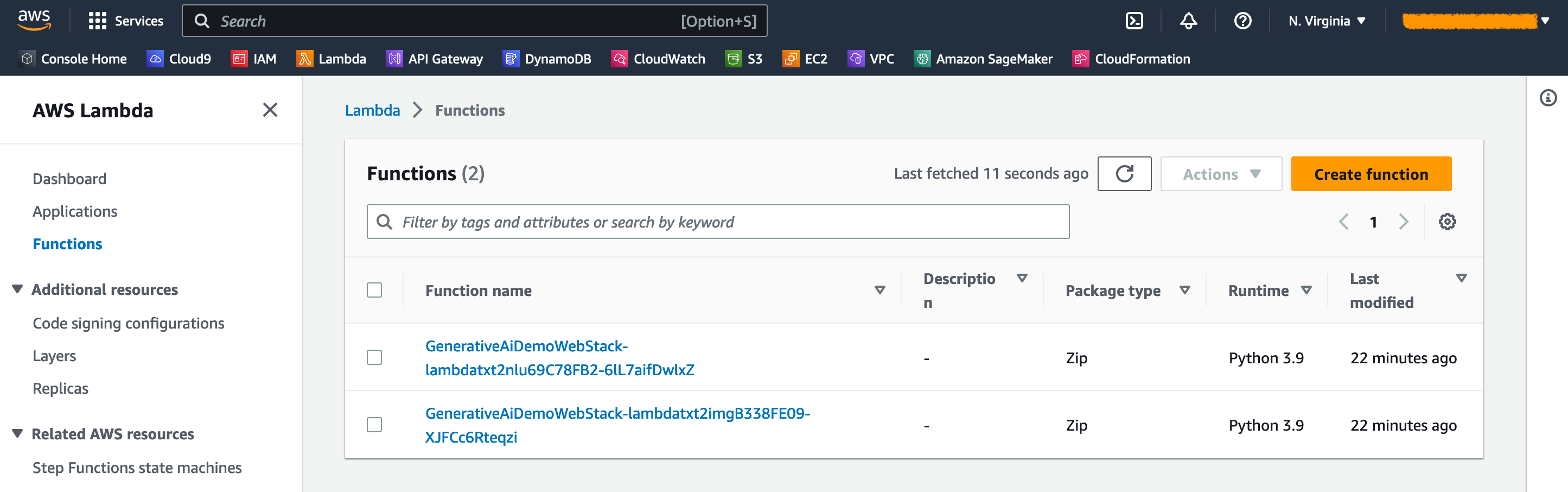

Sur la console AWS Lambda, vous pouvez voir les fonctions sur le Les fonctions .

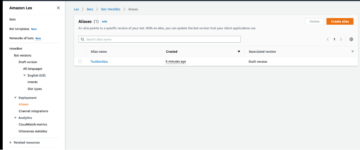

Sur la console API Gateway, vous pouvez voir les points de terminaison API Gateway sur le Apis .

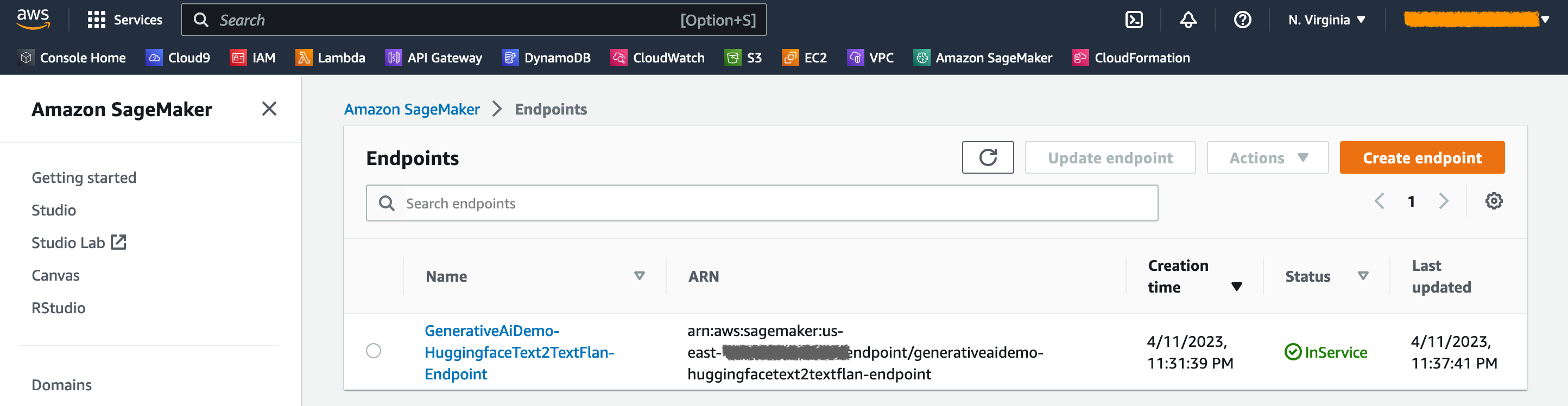

Sur la console SageMaker, vous pouvez voir les points de terminaison du modèle déployé sur le Endpoints .

Lorsque les piles sont lancées, certains paramètres sont générés. Ceux-ci sont stockés dans le Magasin de paramètres AWS Systems Manager. Pour les visualiser, choisissez Magasin de paramètres dans le volet de navigation sur le Gestionnaire de systèmes AWS console.

Nettoyer

Pour éviter des frais inutiles, nettoyez toute l'infrastructure créée avec la commande suivante sur votre poste :

Entrer y à l'invite. Cette étape prend environ 10 minutes. Vérifiez si toutes les ressources sont supprimées sur la console. Supprimez également les compartiments S3 d'actifs créés par AWS CDK sur la console Amazon S3 ainsi que les référentiels d'actifs sur Amazon ECR.

Conclusion

Comme démontré dans cet article, vous pouvez utiliser AWS CDK pour déployer des modèles d'IA générative dans JumpStart. Nous avons montré un exemple de génération d'image et un exemple de génération de texte à l'aide d'une interface utilisateur optimisée par Streamlit, Lambda et API Gateway.

Vous pouvez désormais créer vos projets d'IA générative à l'aide de modèles d'IA pré-formés dans JumpStart. Vous pouvez également étendre ce projet pour affiner les modèles de base de votre cas d'utilisation et contrôler l'accès aux points de terminaison API Gateway.

Nous vous invitons à tester la solution et à contribuer au projet sur GitHub. Partagez vos impressions sur ce tutoriel dans les commentaires !

Résumé de la licence

Cet exemple de code est mis à disposition sous une licence MIT modifiée. Voir le LICENCE fichier pour plus d'informations. Vérifiez également les licences respectives des diffusion stable ainsi que flan-t5-xl modèles sur Hugging Face.

À propos des auteurs

Hantzley Tauckoor est un leader de l'architecture des solutions partenaires APJ basé à Singapour. Il a 20 ans d'expérience dans l'industrie des TIC couvrant plusieurs domaines fonctionnels, y compris l'architecture de solutions, le développement commercial, la stratégie de vente, le conseil et le leadership. Il dirige une équipe d'architectes de solutions seniors qui permettent aux partenaires de développer des solutions communes, de créer des capacités techniques et de les guider tout au long de la phase de mise en œuvre lorsque les clients migrent et modernisent leurs applications vers AWS.

Hantzley Tauckoor est un leader de l'architecture des solutions partenaires APJ basé à Singapour. Il a 20 ans d'expérience dans l'industrie des TIC couvrant plusieurs domaines fonctionnels, y compris l'architecture de solutions, le développement commercial, la stratégie de vente, le conseil et le leadership. Il dirige une équipe d'architectes de solutions seniors qui permettent aux partenaires de développer des solutions communes, de créer des capacités techniques et de les guider tout au long de la phase de mise en œuvre lorsque les clients migrent et modernisent leurs applications vers AWS.

Kwonyul Choi est CTO chez BABITALK, une startup coréenne de plateforme de soins de beauté, basée à Séoul. Avant d'occuper ce poste, Kownyul a travaillé comme ingénieur en développement logiciel chez AWS avec un accent sur AWS CDK et Amazon SageMaker.

Kwonyul Choi est CTO chez BABITALK, une startup coréenne de plateforme de soins de beauté, basée à Séoul. Avant d'occuper ce poste, Kownyul a travaillé comme ingénieur en développement logiciel chez AWS avec un accent sur AWS CDK et Amazon SageMaker.

Arunprasath Shankar est architecte principal de solutions spécialisées en IA/ML chez AWS, aidant les clients mondiaux à faire évoluer leurs solutions d'IA de manière efficace et efficiente dans le cloud. Dans ses temps libres, Arun aime regarder des films de science-fiction et écouter de la musique classique.

Arunprasath Shankar est architecte principal de solutions spécialisées en IA/ML chez AWS, aidant les clients mondiaux à faire évoluer leurs solutions d'IA de manière efficace et efficiente dans le cloud. Dans ses temps libres, Arun aime regarder des films de science-fiction et écouter de la musique classique.

Satish Upreti est un responsable de la migration PSA et une PME de sécurité dans l'organisation partenaire de l'APJ. Satish a 20 ans d'expérience dans les technologies de cloud privé sur site et de cloud public. Depuis qu'il a rejoint AWS en août 2020 en tant que spécialiste de la migration, il fournit des conseils et une assistance techniques étendus aux partenaires AWS pour planifier et mettre en œuvre des migrations complexes.

Satish Upreti est un responsable de la migration PSA et une PME de sécurité dans l'organisation partenaire de l'APJ. Satish a 20 ans d'expérience dans les technologies de cloud privé sur site et de cloud public. Depuis qu'il a rejoint AWS en août 2020 en tant que spécialiste de la migration, il fournit des conseils et une assistance techniques étendus aux partenaires AWS pour planifier et mettre en œuvre des migrations complexes.

Annexe : Procédure pas à pas pour le code

Dans cette section, nous fournissons un aperçu du code de ce projet.

Application AWS CDK

L'application AWS CDK principale est contenue dans le app.py fichier dans le répertoire racine. Le projet se compose de plusieurs piles, nous devons donc importer les piles :

Nous définissons nos modèles d'IA génératifs et obtenons les URI associés de SageMaker :

La fonction get_sagemaker_uris récupère toutes les informations du modèle à partir de JumpStart. Voir script/sagemaker_uri.py.

Ensuite, nous instancions les piles :

La première pile à lancer est la pile VPC, GenerativeAiVpcNetworkStack. La pile d'applications Web, GenerativeAiDemoWebStack, dépend de la pile VPC. La dépendance se fait via le paramètre passant vpc=network_stack.vpc.

See app.py pour le code complet.

Pile réseau VPC

Dans la pile GenerativeAiVpcNetworkStack, nous créons un VPC avec un sous-réseau public et un sous-réseau privé s'étendant sur deux zones de disponibilité :

See /stack/generative_ai_vpc_network_stack.py pour le code complet.

Pile d'applications Web de démonstration

Dans la pile GenerativeAiDemoWebStack, nous lançons les fonctions Lambda et les points de terminaison API Gateway respectifs via lesquels l'application Web interagit avec les points de terminaison du modèle SageMaker. Voir l'extrait de code suivant :

L'application Web est conteneurisée et hébergée sur Amazon ECS avec Fargate. Voir l'extrait de code suivant :

See /stack/generative_ai_demo_web_stack.py pour le code complet.

Pile de points de terminaison du modèle SageMaker de génération d'images

La pile GenerativeAiTxt2imgSagemakerStack crée le point de terminaison du modèle de génération d'image à partir de JumpStart et stocke le nom du point de terminaison dans Systems Manager Parameter Store. Ce paramètre sera utilisé par l'application Web. Voir le code suivant :

See /stack/generative_ai_txt2img_sagemaker_stack.py pour le code complet.

NLU et génération de texte pile de points de terminaison de modèle SageMaker

La pile GenerativeAiTxt2nluSagemakerStack crée le point de terminaison du modèle de génération de NLU et de texte à partir de JumpStart et stocke le nom du point de terminaison dans Systems Manager Parameter Store. Ce paramètre sera également utilisé par l'application Web. Voir le code suivant :

See /stack/generative_ai_txt2nlu_sagemaker_stack.py pour le code complet.

application Web

L'application Web se trouve dans le /web-app annuaire. Il s'agit d'une application Streamlit qui est conteneurisée conformément à la Dockerfile:

Pour en savoir plus sur Streamlit, voir Documentation simplifiée.

- Contenu propulsé par le référencement et distribution de relations publiques. Soyez amplifié aujourd'hui.

- PlatoAiStream. Intelligence des données Web3. Connaissance Amplifiée. Accéder ici.

- Frapper l'avenir avec Adryenn Ashley. Accéder ici.

- Achetez et vendez des actions de sociétés PRE-IPO avec PREIPO®. Accéder ici.

- La source: https://aws.amazon.com/blogs/machine-learning/deploy-generative-ai-models-from-amazon-sagemaker-jumpstart-using-the-aws-cdk/

- :possède

- :est

- $UP

- 1

- 10

- 100

- 20

- 20 ans

- 2020

- 2023

- 7

- 8

- 9

- a

- Qui sommes-nous

- accès

- accédé

- accessible

- en conséquence

- Compte

- atteindre

- à travers

- adapter

- adresser

- L'adoption d'

- Adoption

- avancement

- conseils

- Agent

- AI

- Alimenté par l'IA

- AI / ML

- algorithmes

- Tous

- Permettre

- déjà

- aussi

- Amazon

- Passerelle d'API Amazon

- Amazon Sage Maker

- Amazon SageMaker JumpStart

- Amazon Web Services

- an

- l'analyse

- ainsi que

- tous

- api

- appli

- Application

- applications

- applications

- Avril

- architecture

- SONT

- domaines

- autour

- AS

- Outils

- At

- précaution

- Août

- disponibilité

- disponibles

- éviter

- AWS

- AWSCloud9

- AWS CloudFormation

- AWS Lambda

- RETOUR

- balancier

- basé

- MTD

- BE

- pour créer les plus

- Beauté

- before

- va

- CROYONS

- jusqu'à XNUMX fois

- Bootstrap

- vaste

- navigateur

- construire

- construit

- la performance des entreprises

- Développement des affaires

- entreprises

- mais

- by

- Appelez-nous

- CAN

- capacités

- Compétences

- capturé

- les soins

- maisons

- cas

- CD

- Centres

- Change

- caractéristiques

- des charges

- vérifier

- Selectionnez

- client

- CLIENTS

- le cloud

- Cloud9

- code

- vient

- Commun

- communément

- complet

- complexe

- calcul

- ordinateur

- configuration

- Console

- construire

- consulting

- consommées

- contenu

- Contenant

- contient

- contenu

- contexte

- contribuer

- des bactéries

- Conversation

- conversations

- correct

- Prix

- engendrent

- créée

- crée des

- création

- CTO

- Courant

- Customiser

- des clients

- expérience client

- Service à la clientèle

- Clients

- personnaliser

- En investissant dans une technologie de pointe, les restaurants peuvent non seulement rester compétitifs dans un marché en constante évolution, mais aussi améliorer significativement l'expérience de leurs clients.

- données

- science des données

- journée

- décennies

- Réglage par défaut

- Définit

- démontré

- démontre

- Dépendance

- dépendant

- déployer

- déployé

- déployer

- déploiement

- déploie

- la description

- détruire

- développer

- mobiles

- Développement

- différent

- La diffusion

- Commande

- Perturber

- Docker

- document

- fait

- Ne pas

- down

- chacun

- même

- Easy

- de manière efficace

- efficacement

- permettre

- permet

- fin

- Endpoint

- ingénieur

- Entrer

- Environment

- environnements

- estimé

- Ether (ETH)

- Chaque

- tous les jours

- tout le monde est

- exemple

- exemples

- passionnant

- existait

- Découvrez

- étendre

- les

- Visage

- non

- familier

- famille

- Fonctionnalités:

- few

- champ

- Des champs

- Déposez votre dernière attestation

- Trouvez

- Prénom

- Focus

- Abonnement

- suit

- Pour

- Force

- Fondation

- fraction

- Framework

- de

- plein

- fonction

- fonctionnel

- fonctions

- porte

- recueillir

- rassemblement

- à usage général

- généré

- génération

- génératif

- IA générative

- obtenez

- Git

- Global

- À l'échelle mondiale

- Croissance

- Vous avez

- ayant

- he

- aider

- aider

- de haute qualité

- sa

- Accueil

- hôte

- organisé

- HEURES

- Comment

- How To

- HTML

- http

- HTTPS

- TIC

- et idées cadeaux

- if

- image

- génération d'image

- satellite

- imagination

- Mettre en oeuvre

- la mise en oeuvre

- importer

- in

- Y compris

- intégrer

- secteurs

- industrie

- Point d'inflexion

- d'information

- Infrastructure

- installer

- installation

- Installé

- instance

- plutôt ;

- intégrer

- intégrations

- interagit

- Interfaces

- développement

- nous invitons les riders XCO et DH à rouler sur nos pistes haute performance, et leurs supporters à profiter du spectacle. Pour le XNUMXe anniversaire, nous visons GRAND ! Vous allez vouloir être là ! Nous accueillerons la légendaire traversée de l'étant avec de la musique en direct ! Nous aurons également des divertissements pour les jeunes et les jeunes de cœur pendant l'après-midi. Vous ne voudrez pas manquer ça !

- aide

- IT

- joindre

- joint

- jpg

- json

- Coréen

- atterrissage

- page de destination

- langue

- Langues

- gros

- plus tard

- Nouveautés

- lancer

- lancé

- lancement

- conduire

- leader

- Leadership

- Conduit

- APPRENTISSAGE

- apprentissage

- Laisser

- Bibliothèque

- Licence

- licences

- comme

- LIMIT

- Gamme

- Liste

- Écoute

- Liste

- charge

- locales

- situé

- click

- machine learning

- Les machines

- LES PLANTES

- Entrée

- faire

- FAIT DU

- gérer

- gestion

- manager

- de nombreuses

- massif

- Menu

- pourrait

- émigrer

- migration

- minutes

- MIT

- ML

- Techniques de ML

- modèle

- modélisation statistique

- numériques jumeaux (digital twin models)

- moderniser

- modifié

- PLUS

- Films

- plusieurs

- Musique

- must

- prénom

- Nature

- Langage naturel

- Génération de Langage Naturel

- Compréhension du langage naturel

- Nature

- Navigation

- Besoin

- Besoins

- réseau et

- Nouveauté

- next

- NLG

- nlu

- nœud

- ordinateurs portables

- maintenant

- nombre

- of

- Offres Speciales

- on

- ONE

- en cours

- uniquement

- open source

- Logiciels open source

- ouvre

- or

- de commander

- organisation

- original

- Autre

- nos

- sortie

- plus de

- vue d'ensemble

- propre

- paquet

- page

- pain

- paradigme

- paramètre

- paramètres

- les partenaires

- partenaires,

- En passant

- effectuer

- phase

- Téléphone

- image

- plan

- plateforme

- Platon

- Intelligence des données Platon

- PlatonDonnées

- Point

- possibilité

- Post

- défaillances

- alimenté

- solide

- conditions préalables

- Imprimé

- Avant

- Privé

- Problème

- Vidéo

- Programmation

- langages de programmation

- Projet

- projets

- fournir

- fournit

- public

- cloud public

- publiquement

- Python

- requêtes

- vite.

- gamme

- Nos tests de diagnostic produisent des résultats rapides et précis sans nécessiter d'équipement de laboratoire complexe et coûteux,

- rapidement

- solutions

- récemment

- visée

- en ce qui concerne

- région

- en relation

- dépôt

- conditions

- Exigences

- ressource

- Ressources

- ceux

- Avis

- Révolutionnement

- bon

- Rôle

- racine

- Courir

- pour le running

- sagemaker

- vente

- même

- Escaliers intérieurs

- science-fiction

- Sciences

- gratter

- Sdk

- Deuxièmement

- secondes

- Section

- sécurité

- sur le lien

- graines

- AUTO

- supérieur

- sentiment

- Séoul

- Sans serveur

- Serveurs

- service

- Services

- set

- installation

- Partager

- décalage

- devrait

- montrer

- montré

- montré

- Spectacles

- étapes

- depuis

- Singapour

- Taille

- petit

- PME

- So

- Logiciels

- développement de logiciels

- sur mesure

- Solutions

- quelques

- Identifier

- Space

- spécialiste

- groupe de neurones

- spécifié

- stable

- empiler

- Combos

- Standard

- j'ai commencé

- Commencez

- Startups

- étapes

- Étapes

- Arrêter

- storage

- Boutique

- stockée

- STORES

- Stories

- de Marketing

- structure

- sous-réseau

- Support

- sûr

- Système

- prend

- Tâche

- tâches

- équipe

- Technique

- techniques

- Les technologies

- Technologie

- raconte

- modèles

- tester

- tests

- génération de texte

- qui

- Les

- leur

- Les

- puis

- Ces

- this

- Avec

- fiable

- Titan

- à

- Boîte à outils

- les outils

- traditionnel

- traditionnel

- Train

- qualifié

- Formation

- Transformer

- Trends

- oui

- vraiment

- TOUR

- tutoriel

- deux

- type

- types

- débutante

- typiquement

- sous

- compréhension

- dévoilé

- la mise à jour

- améliorer

- utilisé

- cas d'utilisation

- d'utiliser

- Utilisateur

- Interface utilisateur

- en utilisant

- utiliser

- divers

- Vaste

- vérifier

- version

- via

- Vidéos

- Voir

- Salle de conférence virtuelle

- pratiquement

- Visiter

- souhaitez

- était

- personne(s) regarde(nt) cette fiche produit

- Façon..

- we

- web

- application Web

- services Web

- WELL

- qui

- tout en

- large

- Large gamme

- répandu

- Wikipédia

- sera

- fenêtres

- comprenant

- sans

- Activités principales

- travaillé

- workflows

- poste de travail

- années

- you

- Votre

- zéphyrnet

- zones