Il y a un an et demi, Netflix sortait Le dilemme social, un docu-drame qui a creusé les conséquences néfastes des médias sociaux. Pensez à la polarisation politique, à la propagation de désinformation, et des augmentations de l'anxiété et de la dépression dans plusieurs groupes démographiques. tristan harris, ancien éthicien du design de Google et co-fondateur du Centre de technologie humaine, est un personnage central du film. Lors d'une séance à Sud par sud-ouest cette semaine, Harris a parlé des mesures que nous devrions prendre pour amener cette technologie et notre relation avec elle dans un endroit sain, ou comme il l'a dit, la sagesse dont nous avons besoin pour orienter la technologie et notre avenir.

Harris a ouvert avec un Devis du biologiste Edward O. Wilson, qui a dit : « Le vrai problème de l'humanité est le suivant : nous avons des émotions paléolithiques, des institutions médiévales et une technologie divine. Et c'est terriblement dangereux, et il approche maintenant d'un point de crise global.

En d'autres termes, la technologie progresse beaucoup trop vite pour que nos cerveaux puissent suivre et interagir sainement avec elle, ou pour que nos institutions la comprennent et la réglementent judicieusement.

Wilson a prononcé ces mots lors d'un débat au Harvard Museum of Natural History en 2009; c'est-à-dire avant l'adoption généralisée de plateformes comme Instagram et Tiktok, ou de technologies comme les deepfakes, les générateurs de texte, CRISPR, et d'autres innovations qui ont le potentiel de transformer l'humanité (pour le meilleur ou pour le pire).

Nous avons maintenant des algorithmes qui peuvent générer des images réalistes basées sur du texte, de n'importe quoi, des couchers de soleil sur les montagnes aux bâtiments bombardés en Ukraine. Nous avons GPT-3, qui pourrait rédiger un article convaincant affirmant que les vaccins à ARNm ne sont pas sûrs, citant des faits réels qui sont simplement présentés hors contexte. "C'est comme une bombe à neutrons pour la confiance sur Internet", a déclaré Harris. "Et la complexité du monde augmente chaque jour." Cependant, notre capacité à réagir n'est pas à la hauteur.

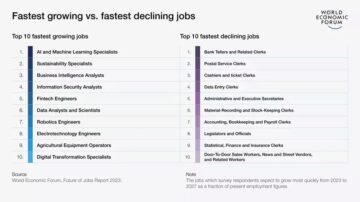

Des problèmes qui auraient été considérés comme distincts les uns des autres dans le passé (ou qui n'existaient pas dans le passé) sont désormais étroitement liés ; tenir compte de l'impact que la désinformation et médias synthétiques pourraient avoir sur l'escalade nucléaire (et l'impact qu'ils ont déjà eu sur les élections et la démocratie), ou le lien entre intelligence artificielle et global risque financier.

Notre réflexion antérieure sur la façon de gérer la technologie n'est pas assez bonne face à cette nouvelle complexité ; Comment gérons-nous des questions telles que la confidentialité ou la liberté d'expression lorsque plusieurs acteurs sont impliqués, que la responsabilité est faible et que la définition de ce qui est « juste » est différente pour chacun ? "La technologie a miné la capacité de sagesse de l'humanité", a déclaré Harris. "Pas seulement individuellement, mais notre capacité collective à fonctionner avec la sagesse dont nous avons besoin."

La sagesse, a-t-il dit, signifie connaître les limites de la façon dont nous travaillons réellement, avoir la conscience de soi et l'humilité d'enquêter, et être capable de penser en termes de systèmes et de causes profondes. Harris a fait référence au livre Penser dans les systèmes par la scientifique environnementale Donella Meadows, dans laquelle elle détaille 12 points de levier pour intervenir dans un système, c'est-à-dire changer la façon dont un système fonctionne de son état actuel à autre chose. De l'avis de Harris, le plus pertinent des points de Meadows dans la conversation technologique est le pouvoir de transcender les paradigmes.

Chacun des paradigmes de la pensée dans l'industrie technologique qui nous a menés là où nous en sommes devrait être révisé par une approche centrée sur l'humain. Plutôt que d'ignorer les méfaits de la technologie en affirmant qu'il y a toujours des coûts et des avantages, nous devrions nous concentrer sur la minimisation des externalités néfastes. Plutôt que de donner aux utilisateurs ce qu'ils veulent, nous devons respecter les faiblesses et les vulnérabilités humaines (par exemple, la façon dont les plateformes de médias sociaux exploitent la réponse dopaminergique du cerveau). Plutôt que de maximiser la personnalisation pour offrir aux utilisateurs une expérience satisfaisante (également connue sous le nom de création de nos propres petites chambres d'écho uniques), nous devrions nous efforcer de créer une compréhension partagée.

La question est de savoir comment amener plus de gens à passer du statut d'utilisateurs typiques des médias sociaux et d'autres technologies à ce que Harris appelle des technologues humains ?

Cela commence par nous sensibiliser et nous éduquer. Harris et son équipe du Center for Humane Technology ont créé un Cours en ligne appelé Foundations of Humane Technology, qui guide les inscrits à travers six principes centrés sur les valeurs qui, si nous les priorisons lors de la conception de nouvelles technologies (ou de la modification de la conception de technologies existantes), peuvent améliorer notre expérience à la fois individuellement et en tant que communauté interconnectée.

"Nous aimerions avoir 100,000 XNUMX technologues humains formés à ce nouveau paradigme", a déclaré Harris. "C'est difficile de penser à ces choses quand on a l'impression d'être le seul à poser ces questions."

Nous sommes à un point d'inflexion où il est crucial pour ceux qui travaillent sur la technologie d'aider à créer une compréhension partagée ; le monde n'est pas sur le point de devenir moins complexe ou volatil. Au contraire, Harris prédit que nous nous dirigeons vers une période de catastrophes mondiales croissantes alimentées par le changement climatique, les inégalités et les régimes politiques instables, entre autres facteurs.

C'est beaucoup à assumer, même beaucoup à contempler. Mais, a déclaré Harris, il a de l'espoir car il a vu le système changer beaucoup plus rapidement au cours des dernières années que jamais auparavant. Des personnes de l'industrie technologique ont parlé des risques et des méfaits des produits qu'elles ont aidé à créer, d'un ancien ingénieur YouTube Guillaume Chalot au co-fondateur de Facebook Chris Hughes à l'ancien data scientist de Facebook Françoise Haugen, et beaucoup plus. "Les technologues se réveillent en fait et disent:" Je ne veux pas participer à la partie toxique de l'industrie, je veux aider à construire une meilleure partie "", a déclaré Harris.

Revenant à la citation de Wilson, Harris a proposé ce qui suit : nous devons embrasser nos émotions paléolithiques, améliorer nos institutions médiévales et avoir la sagesse de manier notre technologie divine. Nous devons être capables de donner un sens au monde et de faire en sorte que des personnes de différents horizons se réunissent et s'entendent sur les actions que nous devrions entreprendre, puis de les entreprendre. Il ne devrait pas y avoir de place pour les modèles commerciaux qui dépendent de la division des personnes. "Nous avons besoin que tout le monde travaille pour nous aider à combler cet écart", a déclaré Harris.

Crédit image: Rodion Koutsaïev on Unsplash

Vous cherchez des moyens de garder une longueur d'avance sur le rythme du changement ? Repensez ce qui est possible. Rejoignez une cohorte exclusive et hautement organisée de 80 cadres pour le programme phare Executive Program (EP) de Singularity, un programme de transformation du leadership entièrement immersif de cinq jours qui perturbe les modes de pensée existants. Découvrez un nouvel état d'esprit, un nouvel ensemble d'outils et un réseau de collègues futuristes déterminés à trouver des solutions au rythme rapide des changements dans le monde. Cliquez ici pour en savoir plus et postulez dès aujourd'hui !

- "

- 000

- 100

- Qui sommes-nous ?

- la reddition de comptes

- à travers

- actes

- Adoption

- algorithmes

- déjà

- parmi

- Une autre

- Anxiété, Stress

- autour

- va

- avantages.

- bombe

- construire

- la performance des entreprises

- Compétences

- Change

- Changement climatique

- Co-fondateur

- Communautés

- complexe

- connexion

- Conversation

- Costs

- pourriez

- La création

- crédit

- crise

- crucial

- organisée

- Courant

- État actuel

- données

- Data Scientist

- journée

- débat

- La démocratie

- Démographie

- Dépression

- Conception

- conception

- différent

- echo

- l'éducation

- Élections

- émotions

- ingénieur

- environnementales

- tout le monde

- exemple

- Exclusive

- exécutif

- cadres

- Découvrez

- Exploiter

- Visage

- facteurs

- RAPIDE

- plus rapide

- Figure

- Film

- Focus

- Abonnement

- spirituelle

- avenir

- écart

- générer

- Don

- Global

- Bien

- harvard

- ayant

- aider

- ici

- très

- Histoire

- Comment

- How To

- HTTPS

- Humanité

- immersive

- Impact

- améliorer

- industrie

- les établissements privés

- Internet

- impliqué

- vous aider à faire face aux problèmes qui vous perturbent

- IT

- connu

- Leadership

- APPRENTISSAGE

- Levier

- peu

- assorti

- Médias

- médiéval

- numériques jumeaux (digital twin models)

- (en fait, presque toutes)

- Musée

- Nature

- Netflix

- réseau et

- Nouvelle technologie

- Opinion

- Autre

- Papier

- paradigme

- participer

- Personnes

- Personnalisation

- Plateformes

- politique

- possible

- power

- la confidentialité

- Problème

- Produits

- Programme

- question

- relation amoureuse

- réponse

- risques

- des

- Saïd

- Scientifique

- sens

- commun

- SIX

- Réseaux sociaux

- réseaux sociaux

- plateformes de médias sociaux

- Solutions

- quelque chose

- propagation

- départs

- Région

- rester

- combustion propre

- Système

- équipe

- technologie

- industrie technologique

- technologues

- Technologie

- le monde

- En pensant

- Avec

- TikTok

- ensemble

- Transformer

- De La Carrosserie

- La confiance

- Ukraine

- comprendre

- unique

- us

- utilisateurs

- vulnérabilités

- semaine

- Quoi

- WHO

- répandu

- dans les

- des mots

- Activités principales

- de travail

- vos contrats

- world

- an

- années

- Youtube