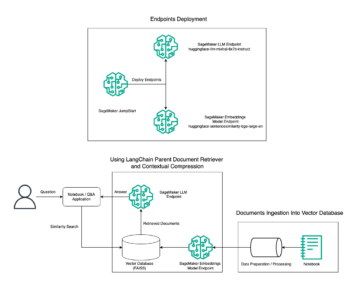

Aujourd'hui, nous sommes ravis d'annoncer que les modèles de fondation Mistral 7B, développés par Mistral AI, sont disponibles pour les clients via Amazon SageMaker JumpStart à déployer en un clic pour exécuter l'inférence. Avec 7 milliards de paramètres, Mistral 7B peut être facilement personnalisé et déployé rapidement. Vous pouvez essayer ce modèle avec SageMaker JumpStart, un hub d'apprentissage automatique (ML) qui donne accès à des algorithmes et des modèles afin que vous puissiez rapidement démarrer avec le ML. Dans cet article, nous expliquons comment découvrir et déployer le modèle Mistral 7B.

Qu'est-ce que Mistral 7B

Mistral 7B est un modèle de base développé par Mistral AI, prenant en charge les capacités de génération de texte et de code en anglais. Il prend en charge une variété de cas d'utilisation, tels que le résumé de texte, la classification, la complétion de texte et la complétion de code. Pour démontrer la facilité de personnalisation du modèle, Mistral AI a également publié un modèle Mistral 7B Instruct pour les cas d'utilisation du chat, affiné à l'aide d'une variété d'ensembles de données de conversation accessibles au public.

Mistral 7B est un modèle de transformateur et utilise l'attention des requêtes groupées et l'attention de la fenêtre coulissante pour obtenir une inférence plus rapide (faible latence) et gérer des séquences plus longues. L'attention des requêtes de groupe est une architecture qui combine l'attention multi-requêtes et multi-têtes pour obtenir une qualité de sortie proche de l'attention multi-têtes et une vitesse comparable à l'attention multi-requêtes. L'attention par fenêtre coulissante utilise les couches empilées d'un transformateur pour s'occuper du passé au-delà de la taille de la fenêtre afin d'augmenter la longueur du contexte. Mistral 7B a une longueur de contexte de 8,000 7 jetons, démontre une faible latence et un débit élevé, et présente de solides performances par rapport aux modèles alternatifs plus grands, offrant de faibles besoins en mémoire pour une taille de modèle XNUMXB. Le modèle est mis à disposition sous licence Licence Apache 2.0, pour une utilisation sans restrictions.

Qu'est-ce que SageMaker JumpStart

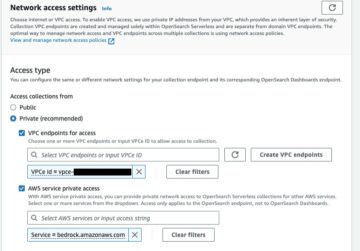

Avec SageMaker JumpStart, les praticiens du ML peuvent choisir parmi une liste croissante de modèles de fondation les plus performants. Les praticiens du ML peuvent déployer des modèles de base sur des sites dédiés. Amazon Sage Maker instances dans un environnement isolé en réseau et personnalisez les modèles à l'aide de SageMaker pour la formation et le déploiement des modèles.

Vous pouvez désormais découvrir et déployer Mistral 7B en quelques clics Amazon SageMakerStudio ou par programmation via le SDK SageMaker Python, vous permettant de dériver les performances du modèle et les contrôles MLOps avec des fonctionnalités SageMaker telles que Pipelines Amazon SageMaker, Débogueur Amazon SageMakerou les journaux de conteneur. Le modèle est déployé dans un environnement sécurisé AWS et sous les contrôles de votre VPC, contribuant ainsi à garantir la sécurité des données.

Découvrez les modèles

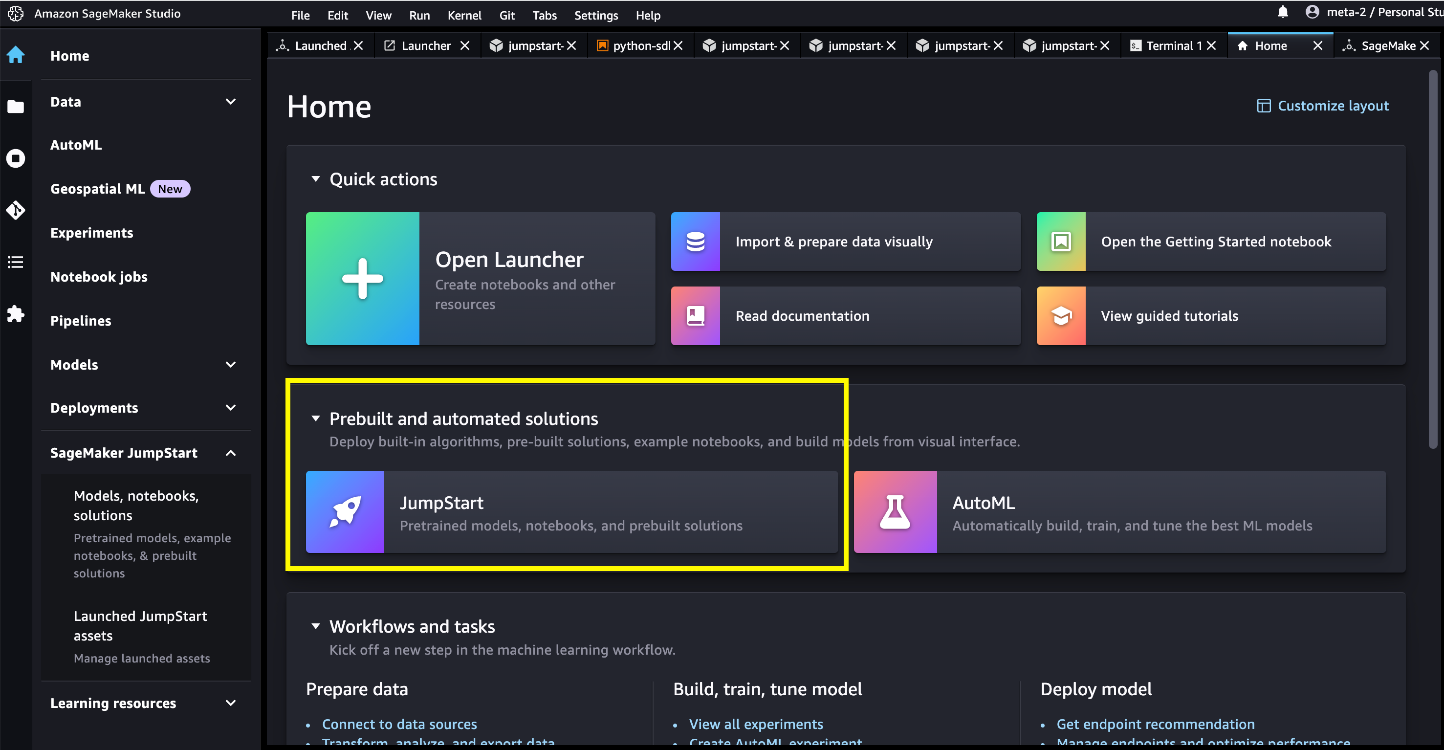

Vous pouvez accéder aux modèles de base Mistral 7B via SageMaker JumpStart dans l'interface utilisateur de SageMaker Studio et le SDK SageMaker Python. Dans cette section, nous expliquons comment découvrir les modèles dans SageMaker Studio.

SageMaker Studio est un environnement de développement intégré (IDE) qui fournit une interface visuelle Web unique où vous pouvez accéder à des outils spécialement conçus pour effectuer toutes les étapes de développement ML, de la préparation des données à la création, la formation et le déploiement de vos modèles ML. Pour plus de détails sur la façon de démarrer et de configurer SageMaker Studio, reportez-vous à Amazon SageMakerStudio.

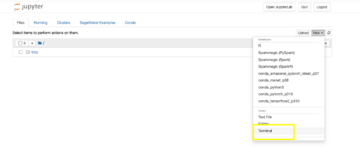

Dans SageMaker Studio, vous pouvez accéder à SageMaker JumpStart, qui contient des modèles, des blocs-notes et des solutions prédéfinis, sous Solutions prédéfinies et automatisées.

À partir de la page d'accueil de SageMaker JumpStart, vous pouvez rechercher des solutions, des modèles, des blocs-notes et d'autres ressources. Vous pouvez trouver Mistral 7B dans le Modèles de base : génération de texte carrousel.

Vous pouvez également trouver d'autres variantes de modèles en choisissant Explorez tous les modèles de texte ou en recherchant « Mistral ».

Vous pouvez choisir la fiche de modèle pour afficher les détails du modèle, tels que la licence, les données utilisées pour l'entraînement et la manière de l'utiliser. Vous trouverez également deux boutons, Déployer et de Cahier ouvert, qui vous aidera à utiliser le modèle (la capture d'écran suivante montre le Déployer option).

Déployer des modèles

Le déploiement commence lorsque vous choisissez Déployer. Vous pouvez également déployer via l'exemple de bloc-notes qui s'affiche lorsque vous choisissez Cahier ouvert. L'exemple de bloc-notes fournit des conseils de bout en bout sur la manière de déployer le modèle pour l'inférence et de nettoyer les ressources.

Pour déployer à l'aide d'un notebook, nous commençons par sélectionner le modèle Mistral 7B, spécifié par le model_id. Vous pouvez déployer n'importe lequel des modèles sélectionnés sur SageMaker avec le code suivant :

Cela déploie le modèle sur SageMaker avec les configurations par défaut, y compris le type d'instance par défaut (ml.g5.2xlarge) et les configurations VPC par défaut. Vous pouvez modifier ces configurations en spécifiant des valeurs autres que celles par défaut dans Modèle JumpStart. Une fois déployé, vous pouvez exécuter une inférence sur le point de terminaison déployé via le prédicteur SageMaker :

Optimisation de la configuration du déploiement

Les modèles Mistral utilisent le service de modèle Text Generation Inference (TGI version 1.1). Lors du déploiement de modèles avec le conteneur d'apprentissage profond (DLC) TGI, vous pouvez configurer une variété de arguments du lanceur via des variables d'environnement lors du déploiement de votre point de terminaison. Pour prendre en charge la longueur de contexte de 8,000 7 jetons des modèles Mistral XNUMXB, SageMaker JumpStart a configuré certains de ces paramètres par défaut : nous définissons MAX_INPUT_LENGTH et de MAX_TOTAL_TOKENS à 8191 et 8192, respectivement. Vous pouvez afficher la liste complète en inspectant votre objet modèle :

Par défaut, SageMaker JumpStart ne bloque pas les utilisateurs simultanés via la variable d'environnement MAX_CONCURRENT_REQUESTS plus petit que la valeur par défaut du TGI, 128. La raison en est que certains utilisateurs peuvent avoir des charges de travail typiques avec de petites longueurs de contexte de charge utile et souhaitent une simultanéité élevée. Notez que le DLC SageMaker TGI prend en charge plusieurs utilisateurs simultanés par lots glissants. Lors du déploiement de votre point de terminaison pour votre application, vous pouvez vous demander si vous devez bloquer MAX_TOTAL_TOKENS or MAX_CONCURRENT_REQUESTS avant le déploiement pour fournir les meilleures performances pour votre charge de travail :

Ici, nous montrons comment les performances du modèle peuvent différer pour votre charge de travail de point de terminaison typique. Dans les tableaux suivants, vous pouvez observer que les requêtes de petite taille (128 mots d'entrée et 128 jetons de sortie) sont assez performantes sous un grand nombre d'utilisateurs simultanés, atteignant un débit de jetons de l'ordre de 1,000 512 jetons par seconde. Cependant, à mesure que le nombre de mots d'entrée augmente jusqu'à 16 mots d'entrée, le point de terminaison sature sa capacité de traitement par lots (le nombre de requêtes simultanées autorisées à être traitées simultanément), ce qui entraîne un plateau de débit et des dégradations de latence significatives à partir d'environ 6,400 utilisateurs simultanés. Enfin, lors de l'interrogation simultanée du point de terminaison avec des contextes d'entrée volumineux (par exemple, 60 XNUMX mots) par plusieurs utilisateurs simultanés, ce plateau de débit se produit relativement rapidement, au point où votre compte SageMaker commencera à rencontrer des délais d'expiration de réponse de XNUMX secondes pour vos requêtes surchargées. .

| . | débit (jetons/s) | ||||||||||

| utilisateurs concurrents | 1 | 2 | 4 | 8 | 16 | 32 | 64 | 128 | |||

| modèle | type d'instance | mots d'entrée | jetons de sortie | . | |||||||

| mistral-7b-instruire | ml.g5.2xlarge | 128 | 128 | 30 | 54 | 89 | 166 | 287 | 499 | 793 | 1030 |

| 512 | 128 | 29 | 50 | 80 | 140 | 210 | 315 | 383 | 458 | ||

| 6400 | 128 | 17 | 25 | 30 | 35 | - | - | - | - | ||

| . | latence p50 (ms/jeton) | ||||||||||

| utilisateurs concurrents | 1 | 2 | 4 | 8 | 16 | 32 | 64 | 128 | |||

| modèle | type d'instance | mots d'entrée | jetons de sortie | . | |||||||

| mistral-7b-instruire | ml.g5.2xlarge | 128 | 128 | 32 | 33 | 34 | 36 | 41 | 46 | 59 | 88 |

| 512 | 128 | 34 | 36 | 39 | 43 | 54 | 71 | 112 | 213 | ||

| 6400 | 128 | 57 | 71 | 98 | 154 | - | - | - | - | ||

Inférences et exemples d'invites

Mistral7B

Vous pouvez interagir avec un modèle de base Mistral 7B comme n'importe quel modèle de génération de texte standard, où le modèle traite une séquence d'entrée et génère les mots suivants prédits dans la séquence. Ce qui suit est un exemple simple avec un apprentissage multi-shot, où le modèle est fourni avec plusieurs exemples et l'exemple de réponse final est généré avec la connaissance contextuelle de ces exemples précédents :

Instruire Mistral 7B

La version optimisée pour les instructions de Mistral accepte les instructions formatées dans lesquelles les rôles de conversation doivent commencer par une invite utilisateur et alterner entre utilisateur et assistant. Une simple invite utilisateur peut ressembler à ce qui suit :

Une invite multi-tours ressemblerait à ce qui suit :

Ce schéma se répète quel que soit le nombre de tours de la conversation.

Dans les sections suivantes, nous explorons quelques exemples utilisant le modèle Mistral 7B Instruct.

Récupération de connaissances

Voici un exemple de récupération de connaissances :

Réponse aux grandes questions contextuelles

Pour montrer comment utiliser ce modèle pour prendre en charge de grandes longueurs de contexte d'entrée, l'exemple suivant intègre un passage intitulé « Rats » de Robert Sullivan (référence), du test MCAS Grade 10 English Language Arts Reading Comprehension dans l'instruction d'invite de saisie et pose au modèle une question dirigée sur le texte :

Mathématiques et raisonnement

Les modèles Mistral font également état de points forts en matière de précision mathématique. Mistral peut fournir une compréhension telle que la logique mathématique suivante :

Codage

Voici un exemple d'invite de codage :

Nettoyer

Une fois que vous avez terminé d'exécuter le bloc-notes, assurez-vous de supprimer toutes les ressources que vous avez créées au cours du processus afin que votre facturation soit arrêtée. Utilisez le code suivant :

Conclusion

Dans cet article, nous vous avons montré comment démarrer avec Mistral 7B dans SageMaker Studio et déployer le modèle pour l'inférence. Étant donné que les modèles de base sont pré-entraînés, ils peuvent contribuer à réduire les coûts de formation et d’infrastructure et permettre une personnalisation adaptée à votre cas d’utilisation. Visite Amazon SageMaker JumpStart maintenant pour commencer.

Resources

À propos des auteurs

Dr Kyle Ulrich est un scientifique appliqué au sein de l'équipe Amazon SageMaker JumpStart. Ses intérêts de recherche comprennent les algorithmes d'apprentissage automatique évolutifs, la vision par ordinateur, les séries chronologiques, les processus bayésiens non paramétriques et gaussiens. Son doctorat est de l'Université Duke et il a publié des articles dans NeurIPS, Cell et Neuron.

Dr Kyle Ulrich est un scientifique appliqué au sein de l'équipe Amazon SageMaker JumpStart. Ses intérêts de recherche comprennent les algorithmes d'apprentissage automatique évolutifs, la vision par ordinateur, les séries chronologiques, les processus bayésiens non paramétriques et gaussiens. Son doctorat est de l'Université Duke et il a publié des articles dans NeurIPS, Cell et Neuron.

Dr Ashish Khetan est un scientifique appliqué senior chez Amazon SageMaker JumpStart et aide à développer des algorithmes d'apprentissage automatique. Il a obtenu son doctorat à l'Université de l'Illinois à Urbana-Champaign. Il est un chercheur actif en apprentissage automatique et en inférence statistique, et a publié de nombreux articles dans les conférences NeurIPS, ICML, ICLR, JMLR, ACL et EMNLP.

Dr Ashish Khetan est un scientifique appliqué senior chez Amazon SageMaker JumpStart et aide à développer des algorithmes d'apprentissage automatique. Il a obtenu son doctorat à l'Université de l'Illinois à Urbana-Champaign. Il est un chercheur actif en apprentissage automatique et en inférence statistique, et a publié de nombreux articles dans les conférences NeurIPS, ICML, ICLR, JMLR, ACL et EMNLP.

Vivek Singh est chef de produit chez Amazon SageMaker JumpStart. Il s'efforce de permettre aux clients d'intégrer SageMaker JumpStart pour simplifier et accélérer leur parcours ML afin de créer des applications d'IA génératives.

Vivek Singh est chef de produit chez Amazon SageMaker JumpStart. Il s'efforce de permettre aux clients d'intégrer SageMaker JumpStart pour simplifier et accélérer leur parcours ML afin de créer des applications d'IA génératives.

Roy Allela est architecte principal de solutions spécialisées en IA/ML chez AWS basé à Munich, en Allemagne. Roy aide les clients AWS, des petites startups aux grandes entreprises, à former et à déployer efficacement de grands modèles de langage sur AWS. Roy est passionné par les problèmes d'optimisation informatique et l'amélioration des performances des charges de travail d'IA.

Roy Allela est architecte principal de solutions spécialisées en IA/ML chez AWS basé à Munich, en Allemagne. Roy aide les clients AWS, des petites startups aux grandes entreprises, à former et à déployer efficacement de grands modèles de langage sur AWS. Roy est passionné par les problèmes d'optimisation informatique et l'amélioration des performances des charges de travail d'IA.

- Contenu propulsé par le référencement et distribution de relations publiques. Soyez amplifié aujourd'hui.

- PlatoData.Network Ai générative verticale. Autonomisez-vous. Accéder ici.

- PlatoAiStream. Intelligence Web3. Connaissance Amplifiée. Accéder ici.

- PlatonESG. Carbone, Technologie propre, Énergie, Environnement, Solaire, La gestion des déchets. Accéder ici.

- PlatoHealth. Veille biotechnologique et essais cliniques. Accéder ici.

- La source: https://aws.amazon.com/blogs/machine-learning/mistral-7b-foundation-models-from-mistral-ai-are-now-available-in-amazon-sagemaker-jumpstart/

- :possède

- :est

- :ne pas

- :où

- $UP

- 000

- 1

- 10

- 100

- 12

- 14

- 150

- 16

- 25

- 26

- 30

- 400

- 50

- 7

- 8

- 9

- a

- capacités

- A Propos

- accélérer

- Accepte

- accès

- Selon

- Compte

- précision

- atteindre

- infection

- ajout

- Adulte

- Après

- à opposer à

- âge

- AI

- AI / ML

- algorithmes

- Tous

- permis

- presque

- le long de

- aux côtés de

- aussi

- des alternatives

- toujours

- Amazon

- Amazon Sage Maker

- Amazon SageMaker JumpStart

- Amazon Web Services

- Amérique

- montant

- quantités

- an

- et de

- et infrastructure

- Angeles

- Annoncer

- Une autre

- répondre

- tous

- chacun.e

- de n'importe où

- A PART

- appartements

- Application

- applications

- appliqué

- d'environ

- architecture

- SONT

- autour

- article

- Les arts

- AS

- Assistante gérante

- associé

- At

- Tentatives

- pour participer

- précaution

- attiré

- attrayant

- auteur

- Automatisation

- disponibles

- moyen

- conscients

- et

- AWS

- RETOUR

- sacs

- base

- basé

- bash

- Batteries

- batterie

- Bayésien

- BE

- car

- était

- before

- derrière

- va

- LES MEILLEURS

- jusqu'à XNUMX fois

- Au-delà

- Projet de loi

- facturation

- Milliards

- Noir

- embarquement

- Volt (Bolt)

- livre

- tous les deux

- acheté

- pauses

- PONT

- Brooklyn

- marron

- construire

- Développement

- bâtiments

- mais

- Achat

- by

- cet ensemble de câbles polyvalent

- appelé

- venu

- CAN

- fournisseur

- carte

- carrousel

- maisons

- cas

- causé

- cellule

- certaines

- Change

- Voies

- Selectionnez

- choose

- Villes

- Ville

- une pince

- classification

- cliquez

- grimper

- Fermer

- Côte

- côtier

- code

- Codage

- Effondrement

- moissonneuses-batteuses

- comment

- Commun

- comparable

- par rapport

- achèvement

- calcul

- ordinateur

- Vision par ordinateur

- concurrent

- conférences

- les configurations

- configurée

- confus

- Considérer

- Contenant

- contient

- contexte

- contextes

- contextuel

- des bactéries

- contrôles

- Conversation

- Cuivre

- coins

- Prix

- Costs

- Pays

- couverture

- couvert

- Crème

- engendrent

- créée

- Courant

- Clients

- personnalisation

- personnaliser

- sont adaptées

- Foncé

- données

- la sécurité des données

- ensembles de données

- journée

- jours

- dévoué

- profond

- l'apprentissage en profondeur

- Cerf

- Réglage par défaut

- démontrer

- démontre

- Nous célebrons le

- déployer

- déployé

- déployer

- déploiement

- déploie

- Dépression

- détails

- développer

- développé

- Développement

- DID

- différer

- différent

- DIG

- dirigé

- répertoires

- saleté

- découvrez

- perturbations

- do

- DOE

- Ne fait pas

- dollars

- fait

- Ne pas

- down

- deux

- Duc

- université de Duke

- chacun

- Terre

- même

- Easy

- manger

- efficacement

- non plus

- urgence climatique.

- mettre en relief

- permettre

- permettant

- rencontrer

- end-to-end

- Endpoint

- de l'Angleterre

- Anglais

- assurer

- Entrer

- Tout

- entrée

- Environment

- équipé

- notamment

- estimation

- Ether (ETH)

- Pourtant, la

- Chaque

- partout

- exemple

- exemples

- excellent

- excité

- à l'exclusion

- Sortie

- expert

- Expliquer

- explorez

- extension

- Yeux

- fait

- plus rapide

- Fonctionnalités:

- alimentation

- Pieds

- few

- Figure

- Fichiers

- finale

- finalement

- Trouvez

- Prénom

- se concentre

- Abonnement

- nourriture

- Pied

- Pour

- forêt

- trouvé

- Fondation

- quatre

- De

- avant

- plein

- gagné

- GAS

- généré

- génération

- génératif

- IA générative

- Allemagne

- obtenez

- Go

- eu

- grade

- gris

- Réservation de groupe

- Croître

- Croissance

- Pousse

- l'orientation

- ait eu

- manipuler

- Vous avez

- he

- front

- aider

- aider

- aide

- d'où

- ici

- Haute

- sa

- Trou

- des trous

- Villa

- Comment

- How To

- Cependant

- HTML

- HTTPS

- Moyeu

- humain

- cent

- i

- VÉLO

- crème glacée

- ICLR

- idéal

- if

- Illinois

- importer

- l'amélioration de

- in

- pouces

- comprendre

- Y compris

- Améliore

- Augmente

- Infrastructure

- contribution

- entrées

- instance

- Des instructions

- des services

- interagir

- intérêts

- Interfaces

- développement

- isolé

- IT

- SES

- mâchoires

- chemin

- jpg

- enfants

- Tuer

- Genre

- spécialisées

- connu

- kyle

- laboratoire

- des lacs

- atterrissage

- page de destination

- langue

- gros

- plus importantes

- Nom

- Latence

- poules pondeuses

- conduire

- conduisant

- fuite

- Fuites

- APPRENTISSAGE

- apprentissage

- Longueur

- laisser

- Licence

- lumière

- légèrement

- foudre

- comme

- Probable

- LIMIT

- limites

- doublé

- LINK

- Liste

- peu

- le travail

- Vit

- ll

- logique

- Location

- plus long

- Style

- ressembler

- les

- Los Angeles

- Faible

- baisser

- click

- machine learning

- LES PLANTES

- a prendre une

- FAIT DU

- manager

- Manuel

- de nombreuses

- Masse

- math

- mathématiques

- Mai..

- mesuré

- Mémoire

- mentionné

- souris

- pourrait

- million

- mineur

- minute

- ML

- MLOps

- modèle

- numériques jumeaux (digital twin models)

- Villas Modernes

- modifié

- de l'argent

- Mois

- PLUS

- (en fait, presque toutes)

- beaucoup

- plusieurs

- Munich

- Musique

- must

- my

- prénom

- noms

- étroit

- Nature

- naturellement

- Près

- négatif

- Nest

- réseau et

- réseaux

- NeuroIPS

- Neutri

- Nouveauté

- New York

- New York City

- Journaux

- next

- nuit

- aucune

- Aucun

- nez

- noter

- cahier

- ordinateurs portables

- maintenant

- nombre

- objet

- observer

- of

- souvent

- Vieux

- on

- Débuter

- une fois

- ONE

- uniquement

- sur

- ouvre

- à mettre en œuvre pour gérer une entreprise rentable. Ce guide est basé sur trois décennies d'expérience

- Option

- or

- de commander

- Origine

- Autre

- autrement

- ande

- sortie

- sorties

- plus de

- page

- payé

- paume

- papiers

- paramètres

- parcs

- partie

- passage

- passionné

- passé

- Patron de Couture

- PAWS

- Personnes

- /

- perçu

- pour cent

- effectuer

- performant

- animal de compagnie

- phd

- Téléphone

- choisi

- tuyaux

- Des endroits

- plantes

- Plastique

- Platon

- Intelligence des données Platon

- PlatonDonnées

- Point

- poison

- pauvres

- positif

- Post

- livre

- livres

- prédit

- Predictor

- en train de préparer

- la parfaite pression

- précédent

- Avant

- d'ouvrabilité

- processus

- traité

- les process

- Produit

- chef de produit

- fournir

- à condition de

- fournit

- aportando

- publiquement

- publié

- purement

- des fins

- Poussé

- mettre

- Python

- qualité

- requêtes

- question

- vite.

- assez

- des rails

- RAT

- Tarif

- atteindre

- en cours

- raison

- reportez-vous

- relativement

- libéré

- rapport

- Rapports

- demandes

- Exigences

- un article

- chercheur

- Resources

- réponse

- Restaurants

- restrictions

- Retraite

- bon

- ROBERT

- Rôle

- rôle

- Roulant

- roy

- Courir

- pour le running

- s

- en toute sécurité

- Sécurité

- sagemaker

- scie

- évolutive

- Scientifique

- scientifiques

- Sdk

- Rechercher

- recherche

- Deuxièmement

- Section

- les sections

- sécurisé

- sécurité

- sembler

- choisi

- la sélection

- supérieur

- sens

- sentiment

- Séquence

- Série

- Services

- service

- set

- sept

- plusieurs

- net

- brille

- Shopping

- devrait

- montrer

- montré

- Spectacles

- côté

- significative

- étapes

- simplifier

- simultanément

- depuis

- unique

- s'asseoir

- Séance

- Taille

- Peau

- petit

- faibles

- Odeur

- Casser

- So

- Soft

- uniquement

- Solutions

- quelques

- parfois

- Du sud

- l'espace

- spécialiste

- spécifié

- vitesse

- propagation

- printemps

- carré

- carrés

- La technique “squeeze”

- empilé

- Standard

- Commencer

- j'ai commencé

- Commencez

- départs

- Startups

- A déclaré

- États

- DÉSINFECTANT

- statistique

- rester

- acier

- Étapes

- Encore

- arrêté

- STORES

- flux

- rue

- forces

- STRONG

- plus efficacement

- structure

- études

- studio

- Étude

- sujet

- Métro

- tel

- Sullivan

- la quantité

- Support

- Appuyer

- Les soutiens

- sûr

- survivre

- combustion propre

- clés

- équipe

- conditions

- tester

- texte

- génération de texte

- que

- qui

- La

- L'Occident

- le monde

- leur

- Les

- se

- puis

- Là.

- donc

- Ces

- l'ont

- Pense

- this

- ceux

- bien que?

- mille

- milliers

- trois

- Avec

- débit

- fiable

- Des séries chronologiques

- titré

- à

- Toilette

- jeton

- Tokens

- les outils

- Total

- ville

- vos titres

- Train

- Formation

- les trains

- transformateur

- pièges

- voyage

- Arbres

- Essai

- tunnel

- se tourne

- Tweet

- vingt

- deux

- type

- débutante

- typiquement

- ui

- sous

- université

- inconnu

- utilisé

- cas d'utilisation

- d'utiliser

- Utilisateur

- utilisateurs

- Usages

- en utilisant

- utilitaire

- Plus-value

- Valeurs

- variable

- les variables

- variété

- divers

- Ve

- véhicule

- Véhicules

- version

- très

- via

- Vidéo

- Voir

- vision

- Visiter

- Attendre

- marcher

- souhaitez

- était

- Déchets

- Eau

- Façon..

- façons

- we

- web

- services Web

- Basé sur le Web

- pèse

- WELL

- ont été

- Ouest

- Quoi

- Qu’est ce qu'

- quand

- que

- qui

- tout en

- blanc

- large

- Sauvage

- sera

- fenêtre

- comprenant

- dans les

- sans

- des mots

- ouvriers

- world

- pourra

- an

- jaune

- york

- you

- Votre

- zéphyrnet