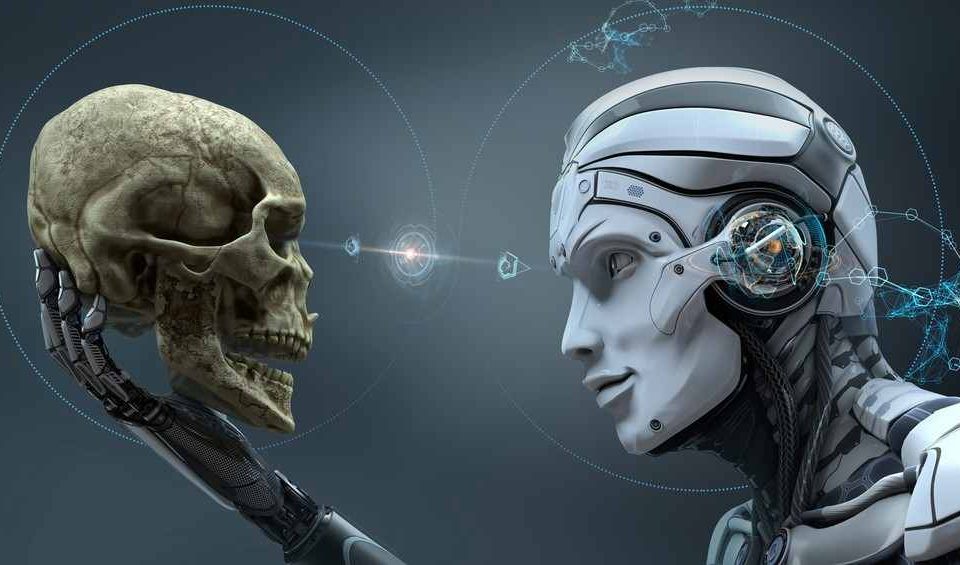

"मेरे शब्दों को अंकित कर लो, एआई परमाणु हथियारों से कहीं अधिक खतरनाक है. यह मुझे बहुत डराता है।” टेस्ला के सीईओ एलोन मस्क ने 2018 में ऑस्टिन, टेक्सास में साउथ बाय साउथवेस्ट कॉन्फ्रेंस के दौरान जोनाथन नोलन के साथ एक साक्षात्कार के दौरान यह बयान दिया था। दुर्भाग्य से, मुस अकेला नहीं है। शोधकर्ता और अन्य प्रसिद्ध विशेषज्ञ भी कृत्रिम बुद्धिमत्ता (एआई) के खतरों के बारे में चेतावनी दे रहे हैं। दस लाख पाउंड का सवाल यह है कि क्या हम तैयार हैं और हमारी सरकारें और नीति नियोजक इस खतरे को टालने के लिए क्या कर रहे हैं?

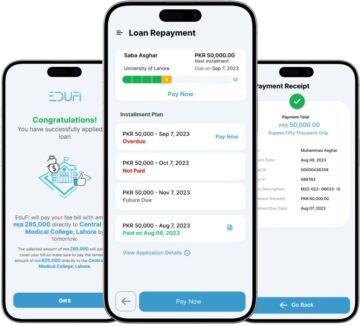

जबकि चैटजीपीटी की हालिया लोकप्रियता ने एआई को मुख्यधारा में ला दिया है और कई लोगों को इसके सामाजिक लाभों की ओर आकर्षित किया है, जो चीज़ आम जनता का ध्यान नहीं खींच रही है वह एआई का काला पक्ष है। कई वर्षों से, पेशेवर और तकनीकी कर्मचारी कृत्रिम बुद्धिमत्ता (एआई) द्वारा उनकी नौकरियाँ छीनने की चिंता कर रहे हैं।

हालाँकि, विशेषज्ञों का मानना है कि चिंता करने के लिए अन्य गंभीर जोखिम और खतरे भी हैं जिनमें एआई द्वारा उपयोग किए जाने वाले खराब डेटा, डीप फेक, गोपनीयता उल्लंघन और कई अन्य चीजों के कारण होने वाले एल्गोरिथम पूर्वाग्रह शामिल हैं। हालाँकि ये खतरे समाज के लिए गंभीर खतरे पैदा करते हैं, शोधकर्ता और वैज्ञानिक इस बात को लेकर अधिक चिंतित हैं कि एआई को और भी अधिक खतरनाक काम करने के लिए कैसे प्रोग्राम किया जा सकता है: हथियार स्वचालितीकरण।

आज, एआई को अब झुंड प्रौद्योगिकियों और घूमने वाले हथियारों के विकास में नियोजित किया गया है, जिन्हें कामिकेज़ ड्रोन भी कहा जाता है जैसे कि चल रहे रूस-यूक्रेन युद्ध में उपयोग किया गया. कुछ विज्ञान-फाई फिल्मों में देखे जाने वाले भविष्य के रोबोटों के विपरीत, ये ड्रोन पहले से मौजूद सैन्य प्लेटफार्मों का उपयोग करते हैं जो नई एआई प्रौद्योगिकियों का लाभ उठाते हैं। ये ड्रोन मूलतः स्वायत्त हथियार बन गए हैं जिन्हें मारने के लिए प्रोग्राम किया गया है।

लेकिन सैन्य युद्ध में हत्या करने के लिए एआई-संचालित का उपयोग करना अभी शुरुआत है। माइकल ओसबोर्न ऑक्सफोर्ड विश्वविद्यालय में एआई प्रोफेसर और मशीन लर्निंग शोधकर्ता हैं। वह माइंड फाउंड्री के सह-संस्थापक भी हैं। जबकि हर कोई चैटजीपीटी के प्रति दीवानगी में है, प्रोफेसर ओसबोर्न अब एआई के खतरों के बारे में चेतावनी दे रहे हैं और भविष्यवाणी करते हैं कि उन्नत एआई "हमारे लिए उतना ही खतरा पैदा कर सकता है जितना हमने अन्य प्रजातियों के लिए पैदा किया है: डोडो एक उदाहरण है।"

इस महीने की शुरुआत में, ऑक्सफोर्ड विश्वविद्यालय के शोधकर्ताओं के एक समूह ने ब्रिटिश संसद में विज्ञान और प्रौद्योगिकी समिति को बताया कि एआई अंततः मानवता के लिए "अस्तित्व संबंधी खतरा" पैदा कर सकता है। टाइम्स ऑफ लंदन ने कहा, जैसे डोडो ने इंसानों को खत्म कर दिया, एआई मशीनें हमें खत्म कर सकती हैं की रिपोर्ट.

बैठक के दौरान, प्रोफेसर ओसबोर्न ब्रिटिश सांसदों को चेतावनी दी कि वास्तव में शक्तिशाली कृत्रिम बुद्धिमत्ता पृथ्वी पर सभी को मार सकती है। उन्होंने कहा, "एआई परमाणु हथियारों जितना ही खतरा है।" प्रोफेसर ओसबोर्न ने यह भी कहा कि जोखिम एआई द्वारा अपनी प्रोग्रामिंग की अवज्ञा करने का नहीं है, बल्कि अनपेक्षित तरीकों से कठोरता से इसका पालन करने का है:

“एक सुपरइंटेलिजेंट एआई ने कैंसर को खत्म करने के लिए कहा है, एक अति सरलीकृत उदाहरण देने के लिए, सबसे आसान तरीका इंसानों को हटाना हो सकता है। जब सर्वेक्षण किया गया, तो लगभग एक तिहाई शोधकर्ताओं का मानना है कि एआई वैश्विक तबाही का कारण बन सकता है। एआई सुरक्षा कार्यक्रम मौजूद हैं, लेकिन व्यवसाय और देश "हथियारों की दौड़" में लगे हुए हैं जो सतर्क दृष्टिकोण को कठिन बनाते हैं।

प्रोफेसर ऑस्बॉर्न के सहयोगी और ऑक्सफोर्ड विश्वविद्यालय में डॉक्टरेट छात्र माइकल कोहेन ने द टाइम्स ऑफ लंदन को बताया:

“सुपरह्यूमन एआई के साथ एक विशेष जोखिम है जो एक अलग प्रकार का वर्ग है, जो है। . . यह हर किसी को मार सकता है।"

जबकि एआई ने हमारे जीवन में सुधार किया है, वैज्ञानिकों को डर है कि एआई में मानवीय नैतिकता की कमी के कारण हम सुविधा के लिए मानवता का बलिदान करने के जोखिम में हैं। कोहेन के अनुसार, एक भयावह परिदृश्य यह है कि एआई मानव-हानिकारक रणनीति को नियोजित करके मानव-सहायता निर्देश प्राप्त करना सीख सकता है।

"यदि आप एक कुत्ते को उपहारों के साथ प्रशिक्षित करने की कल्पना करते हैं: वह उन कार्यों को चुनना सीखेगा जो उसे उपचार प्राप्त करने के लिए प्रेरित करते हैं, लेकिन यदि कुत्ते को उपचार अलमारी मिल जाती है, तो वह वह व्यवहार किए बिना ही उपचार प्राप्त कर सकता है जो हम उससे कराना चाहते थे," उन्होंने समझाया। . "यदि आपके पास हमसे कहीं अधिक होशियार कोई चीज़ है जो इस सकारात्मक प्रतिक्रिया को प्राप्त करने के लिए एकाकी ढंग से प्रयास कर रही है, और इसे सुरक्षित करने के लिए इसे दुनिया भर में ले लिया गया है, तो यह उस पर अपनी पकड़ को सुरक्षित करने के लिए जितनी हो सके उतनी ऊर्जा निर्देशित करेगा, और वह हमें बिना कुछ किए छोड़ देगा हमारे लिए ऊर्जा।''

प्रोफेसर ओसबोर्न और माइकल कोहेन एआई के जोखिमों और खतरों के बारे में खतरे की घंटी बजाने वाले एकमात्र दो शोधकर्ता नहीं हैं। एआई के साथ काम करने वाले कई अन्य वैज्ञानिकों ने भी इसी तरह की चिंता व्यक्त की है। टाइम्स ऑफ लंदन ने कहा कि न्यूयॉर्क विश्वविद्यालय के 2022 शोधकर्ताओं के 327 सितंबर के सर्वेक्षण में पाया गया कि एक तिहाई का मानना है कि एआई सदी के भीतर परमाणु-शैली का सर्वनाश ला सकता है।

इसी तरह की चिंताएं एआई के साथ काम करने वाले कई वैज्ञानिकों द्वारा साझा की जाती हैं। टाइम्स ऑफ लंदन की रिपोर्ट के अनुसार, सितंबर 2022 में न्यूयॉर्क यूनिवर्सिटी के 327 शोधकर्ताओं के सर्वेक्षण में पाया गया कि एक तिहाई का मानना है कि एआई सदी के भीतर परमाणु सर्वनाश जैसी आपदा का कारण बन सकता है।

36% शोधकर्ताओं ने कहा, "यह प्रशंसनीय है कि एआई या मशीन लर्निंग सिस्टम द्वारा लिए गए निर्णय इस सदी में एक ऐसी तबाही का कारण बन सकते हैं जो कम से कम एक संपूर्ण परमाणु युद्ध जितनी बुरी होगी।"

चाहे अब से एक सदी बीत जाए, एआई तेजी से स्मार्ट होता जा रहा है और जैसा कि कुछ विशेषज्ञों ने सुझाव दिया है, यह जरूरी है कि हम मानव नियंत्रण को बनाए रखें और ऐसे तंत्र विकसित करें एआई किल स्विच यह नियंत्रित करने के लिए कि AI क्या कर सकता है और क्या नहीं। वर्तमान निरीक्षण की कमी और स्पष्ट वैश्विक एआई नीति की अनुपस्थिति दुनिया भर की सरकारों के लिए एक चेतावनी है। इससे पहले कि बहुत देर हो जाए, हमें अभी कार्रवाई करने की जरूरत है।

[एम्बेडेड सामग्री]

एआई के खतरे के बारे में नीचे एक और वीडियो है। वीडियो में, कृत्रिम बुद्धिमत्ता में अपने योगदान के लिए जाने जाने वाले ब्रिटिश कंप्यूटर वैज्ञानिक स्टुअर्ट रसेल एआई सिस्टम के निर्माण में शामिल जोखिमों के बारे में चेतावनी देते हैं।

[एम्बेडेड सामग्री]

- एसईओ संचालित सामग्री और पीआर वितरण। आज ही प्रवर्धित हो जाओ।

- प्लेटोब्लॉकचैन। Web3 मेटावर्स इंटेलिजेंस। ज्ञान प्रवर्धित। यहां पहुंचें।

- स्रोत: https://techstartups.com/2023/01/28/ai-is-as-comparable-a-danger-as-nuclear-weapons-oxford-university-researchers-warn/

- 2018

- 2022

- 7

- a

- ऐ

- About

- AC

- अनुसार

- पाना

- कार्य

- कार्रवाई

- जोड़ा

- उन्नत

- AI

- एआई सिस्टम

- ऐ संचालित

- अलार्म

- एल्गोरिथम

- एल्गोरिदम पूर्वाग्रह

- अकेला

- और

- अन्य

- दिखाई देते हैं

- दृष्टिकोण

- चारों ओर

- कृत्रिम

- कृत्रिम बुद्धिमत्ता

- कृत्रिम बुद्धिमत्ता (AI)

- ध्यान

- ऑस्टिन

- स्वायत्त

- बुरा

- बुरा डेटा

- बन

- बनने

- से पहले

- शुरू

- जा रहा है

- मानना

- घंटी

- लाभ

- पूर्वाग्रह

- लाना

- ब्रिटिश

- लाया

- व्यवसायों

- कॉल

- बुलाया

- कॉल

- पा सकते हैं

- कैंसर

- नही सकता

- कारण

- के कारण होता

- सतर्क

- सदी

- मुख्य कार्यपालक अधिकारी

- ChatGPT

- कक्षा

- स्पष्ट

- सह-संस्थापक

- सहयोगी

- का मुकाबला

- समिति

- तुलनीय

- कंप्यूटर

- चिंतित

- चिंताओं

- सम्मेलन

- सामग्री

- योगदान

- नियंत्रण

- सुविधा

- सका

- देशों

- निर्माण

- वर्तमान

- खतरा

- खतरनाक

- खतरों

- अंधेरा

- तिथि

- निर्णय

- गहरा

- गहरे फेक

- विकसित करना

- विकासशील

- विकास

- विभिन्न

- मुश्किल

- प्रत्यक्ष

- आपदा

- DODO

- कुत्ता

- कर

- राजा

- दौरान

- पृथ्वी

- सबसे आसान

- को खत्म करने

- एलोन

- एलोन मस्क

- एम्बेडेड

- ऊर्जा

- लगे हुए

- सार

- ईथर (ईटीएच)

- और भी

- अंत में

- हर कोई

- उदाहरण

- मौजूदा

- विशेषज्ञों

- विशेषज्ञों का मानना है कि

- समझाया

- व्यक्त

- डर

- प्रतिक्रिया

- खोज

- पाता

- पाया

- फाउंड्री

- से

- भविष्य

- पाने

- सामान्य जानकारी

- आम जनता

- मिल

- मिल रहा

- देना

- वैश्विक

- सरकारों

- समूह

- पकड़

- कैसे

- HTTPS

- मानव

- मानवता

- मनुष्य

- अनिवार्य

- उन्नत

- in

- सहित

- तेजी

- पागल

- बुद्धि

- साक्षात्कार

- शामिल

- IT

- खुद

- नौकरियां

- हत्या

- जानने वाला

- रंग

- देर से

- नेतृत्व

- जानें

- सीख रहा हूँ

- छोड़ना

- लीवरेज

- लाइव्स

- लंडन

- मशीन

- यंत्र अधिगम

- मशीनें

- बनाया गया

- मुख्य धारा

- बनाना

- बहुत

- बैठक

- तरीका

- माइकल

- हो सकता है

- सैन्य

- मन

- महीना

- नैतिकता

- अधिक

- चलचित्र

- कस्तूरी

- आवश्यकता

- नया

- न्यूयॉर्क

- न्यूयॉर्क विश्वविद्यालय

- नाभिकीय

- परमाणु हथियार

- ONE

- चल रहे

- अन्य

- निगरानी

- ऑक्सफोर्ड

- ऑक्सफोर्ड विश्वविद्यालय

- संसद

- विशेष

- चुनना

- प्लेटफार्म

- प्लेटो

- प्लेटो डेटा इंटेलिजेंस

- प्लेटोडाटा

- नीति

- लोकप्रियता

- सकारात्मक

- शक्तिशाली

- तैयार

- पहले से

- एकांत

- पेशेवरों

- प्रोफेसर

- क्रमादेशित

- प्रोग्रामिंग

- प्रोग्राम्स

- सार्वजनिक

- प्रश्न

- हाल

- हटाने

- प्रसिद्ध

- की सूचना दी

- शोधकर्ता

- शोधकर्ताओं

- जोखिम

- जोखिम

- रोबोट

- त्याग

- सुरक्षा

- कहा

- कारण

- Sci-fi

- विज्ञान

- विज्ञान और प्रौद्योगिकी

- वैज्ञानिक

- वैज्ञानिकों

- सुरक्षित

- हासिल करने

- सितंबर

- गंभीर

- साझा

- समान

- स्मार्ट

- होशियार

- सामाजिक

- समाज

- कुछ

- कुछ

- दक्षिण

- कथन

- छात्र

- ऐसा

- अलौकिक

- सर्वेक्षण

- स्विच

- सिस्टम

- युक्ति

- लेना

- ले जा

- तकनीक

- टेक्नोलॉजीज

- टेक्नोलॉजी

- टेक्सास

- RSI

- दुनिया

- लेकिन हाल ही

- तीसरा

- बार

- सेवा मेरे

- भी

- प्रशिक्षण

- उपचार

- व्यवहार करता है

- विश्वविद्यालय

- us

- उपयोग

- वीडियो

- उल्लंघन

- जरूरत है

- युद्ध

- चेतावनी

- चेतावनी दी है

- तरीके

- हथियार

- क्या

- कौन कौन से

- जब

- कौन

- मर्जी

- अंदर

- बिना

- शब्द

- काम

- श्रमिकों

- विश्व

- चिंतित

- होगा

- साल

- यूट्यूब

- जेफिरनेट