लेखक द्वारा छवि

हाल ही में हम सभी को एलएलएम क्षेत्र में नवीनतम रिलीज को पकड़ने में बहुत कठिनाई हो रही है। पिछले कुछ हफ्तों में, कई ओपन-सोर्स चैटजीपीटी विकल्प लोकप्रिय हो गए हैं।

और इस आर्टिकल में हम इसके बारे में जानेंगे चैटजीएलएम श्रृंखला और चैटजीएलएम-6बी, एक ओपन-सोर्स और हल्का चैटजीपीटी विकल्प।

चलो जाते रहे!

चीन में सिंघुआ विश्वविद्यालय के शोधकर्ताओं ने चैटजीएलएम श्रृंखला के मॉडल विकसित करने पर काम किया है, जिनका प्रदर्शन जीपीटी-3 और ब्लूम जैसे अन्य मॉडलों से तुलनीय है।

चैटजीएलएम एक द्विभाषी बड़ा भाषा मॉडल है जो चीनी और अंग्रेजी दोनों पर प्रशिक्षित है। वर्तमान में, निम्नलिखित मॉडल उपलब्ध हैं:

- चैटजीएलएम-130बी: एक ओपन-सोर्स एलएलएम

- ChatGLM-100B: ओपन-सोर्स नहीं, बल्कि केवल-आमंत्रण एक्सेस के माध्यम से उपलब्ध है

- ChatGLM-6B: एक हल्का ओपन-सोर्स विकल्प

हालाँकि ये मॉडल बड़े भाषा मॉडलों के जेनरेटिव प्रीट्रेन्ड ट्रांसफार्मर (जीपीटी) समूह के समान लग सकते हैं, सामान्य भाषा मॉडल (जीएलएम) प्रीट्रेनिंग ढांचा यही उन्हें अलग बनाता है। हम इसके बारे में अगले भाग में और जानेंगे।

मशीन लर्निंग में, आप GLM को इस रूप में जानते होंगे सामान्यीकृत रैखिक मॉडल, लेकिन ChatGLM में GLM का मतलब है सामान्य भाषा मॉडल.

जीएलएम प्रीट्रेनिंग फ्रेमवर्क

एलएलएम पूर्व प्रशिक्षण का बड़े पैमाने पर अध्ययन किया गया है और यह अभी भी सक्रिय अनुसंधान का क्षेत्र है। आइए जीएलएम प्रीट्रेनिंग और जीपीटी-शैली मॉडल के बीच मुख्य अंतर को समझने का प्रयास करें।

मॉडलों का GPT-3 परिवार केवल डिकोडर ऑटो रिग्रेसिव भाषा मॉडलिंग का उपयोग करता है। दूसरी ओर, जीएलएम में, उद्देश्य का अनुकूलन एक के रूप में तैयार किया जाता है स्वतः प्रतिगामी रिक्त जानकारी भरने की समस्या.

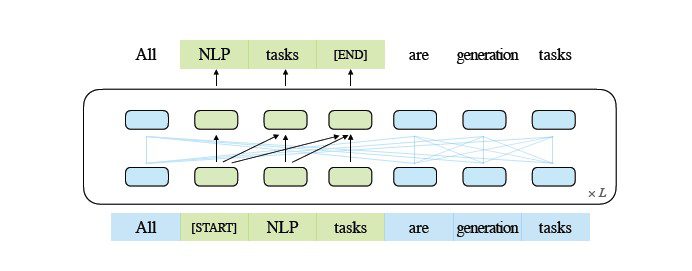

जीएलएम | छवि स्रोत

आसान शब्दों में, स्वतः प्रतिगामी रिक्त जानकारी भरना इसमें पाठ की एक सतत अवधि को खाली करना, और फिर क्रमिक रूप से इस रिक्त स्थान को पाठ का पुनर्निर्माण करना शामिल है। छोटे मास्क के अलावा, एक लंबा मास्क होता है जो वाक्यों के अंत से पाठ के लंबे रिक्त स्थान को बेतरतीब ढंग से हटा देता है। ऐसा इसलिए किया जाता है ताकि मॉडल प्राकृतिक भाषा समझ के साथ-साथ पीढ़ी के कार्यों में भी काफी अच्छा प्रदर्शन करे।

एक और अंतर उपयोग किए जाने वाले ध्यान के प्रकार में है। बड़े भाषा मॉडल का जीपीटी समूह यूनिडायरेक्शनल ध्यान का उपयोग करता है, जबकि एलएलएम का जीएलएम समूह उपयोग करता है द्विदिश ध्यान. उजागर संदर्भों पर द्विदिशात्मक ध्यान का उपयोग निर्भरता को बेहतर ढंग से पकड़ सकता है और प्राकृतिक भाषा समझने के कार्यों पर प्रदर्शन में सुधार कर सकता है।

GELU सक्रियण

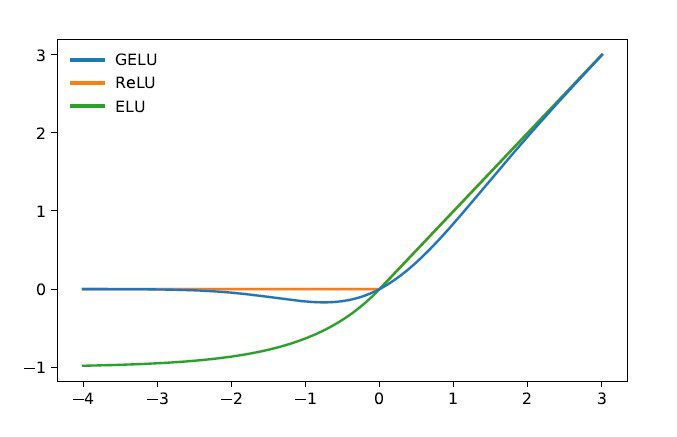

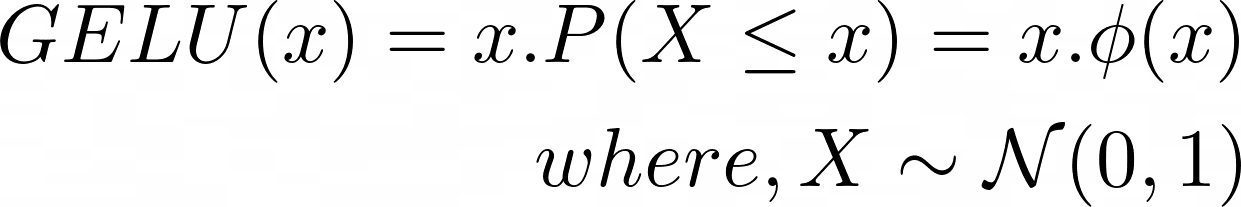

GLM में, ReLU सक्रियण [1] के बजाय GELU (गॉसियन एरर लीनियर यूनिट्स) सक्रियण का उपयोग किया जाता है।

GELU, ReLU, और ELU सक्रियण | छवि स्रोत

GELU सक्रियण में सभी इनपुट के लिए गैर-शून्य मान हैं और इसका निम्न रूप है [3]:

ReLU सक्रियणों की तुलना में GELU सक्रियण प्रदर्शन में सुधार करता पाया गया है, हालाँकि ReLU की तुलना में कम्प्यूटेशनल रूप से अधिक गहन है।

एलएलएम की जीएलएम श्रृंखला में, चैटजीएलएम-130बी जो ओपन-सोर्स है और जीपीटी-3 के दा-विंची मॉडल के समान ही प्रदर्शन करता है। जैसा कि उल्लेख किया गया है, इस लेख को लिखने तक, एक चैटजीएलएम-100बी संस्करण है, जो केवल-आमंत्रण पहुंच तक सीमित है।

चैटजीएलएम-6बी

ChatGLM-6B को अंतिम उपयोगकर्ताओं के लिए अधिक सुलभ बनाने के लिए इसके बारे में निम्नलिखित विवरण:

- इसमें लगभग 6.2 बिलियन पैरामीटर हैं।

- मॉडल को 1 ट्रिलियन टोकन पर पूर्व-प्रशिक्षित किया गया है - समान रूप से अंग्रेजी और चीनी से।

- इसके बाद, मानव प्रतिक्रिया के साथ पर्यवेक्षित फाइन-ट्यूनिंग और सुदृढीकरण सीखने जैसी तकनीकों का उपयोग किया जाता है।

आइए चैटजीएलएम के फायदों और सीमाओं पर चर्चा करके अपनी चर्चा समाप्त करें:

फायदे

एक द्विभाषी मॉडल से लेकर एक ओपन-सोर्स मॉडल जिसे आप स्थानीय रूप से चला सकते हैं, ChatGLM-6B के निम्नलिखित फायदे हैं:

- अधिकांश मुख्यधारा के बड़े भाषा मॉडल अंग्रेजी पाठ के बड़े संग्रह पर प्रशिक्षित होते हैं, और अन्य भाषाओं के लिए बड़े भाषा मॉडल उतने आम नहीं हैं। एलएलएम की चैटजीएलएम श्रृंखला द्विभाषी है और चीनी भाषा के लिए एक बढ़िया विकल्प है। मॉडल का अंग्रेजी और चीनी दोनों में अच्छा प्रदर्शन है।

- ChatGLM-6B उपयोगकर्ता उपकरणों के लिए अनुकूलित है। अंतिम उपयोगकर्ताओं के पास अक्सर अपने उपकरणों पर सीमित कंप्यूटिंग संसाधन होते हैं, इसलिए उच्च-प्रदर्शन वाले जीपीयू तक पहुंच के बिना एलएलएम को स्थानीय रूप से चलाना लगभग असंभव हो जाता है। साथ INT4 परिमाणीकरण, ChatGLM-6B कम से कम 6GB की मामूली मेमोरी आवश्यकता के साथ चल सकता है।

- सारांशीकरण और एकल तथा बहु-क्वेरी चैट सहित विभिन्न प्रकार के कार्यों पर अच्छा प्रदर्शन करता है।

- अन्य मुख्यधारा एलएलएम की तुलना में मापदंडों की काफी कम संख्या के बावजूद, ChatGLM-6B 2048 तक की संदर्भ लंबाई का समर्थन करता है।

सीमाओं

आगे, आइए ChatGLM-6B की कुछ सीमाएँ सूचीबद्ध करें:

- हालाँकि चैटजीएलएम एक द्विभाषी मॉडल है, अंग्रेजी में इसका प्रदर्शन संभवतः इष्टतम से कम है। इसका श्रेय प्रशिक्षण में उपयोग किए जाने वाले निर्देशों को दिया जा सकता है जो अधिकतर चीनी भाषा में होते हैं।

- क्योंकि ChatGLM-6B में काफी हद तक है कम पैरामीटर अन्य एलएलएम जैसे कि ब्लूम, जीपीटी-3 और चैटजीएलएम-130बी की तुलना में, संदर्भ बहुत लंबा होने पर प्रदर्शन खराब हो सकता है। परिणामस्वरूप, ChatGLM-6B बड़ी संख्या में पैरामीटर वाले मॉडल की तुलना में अधिक बार गलत जानकारी दे सकता है।

- छोटे भाषा मॉडल हैं सीमित स्मृति क्षमता. इसलिए, मल्टी-टर्न चैट में, मॉडल का प्रदर्शन थोड़ा ख़राब हो सकता है।

- पूर्वाग्रह, गलत सूचना और विषाक्तता सभी एलएलएम की सीमाएं हैं, और चैटजीएलएम भी इनके प्रति संवेदनशील है।

अगले चरण के रूप में, ChatGLM-6B को स्थानीय रूप से चलाएँ या HuggingFace स्पेस पर डेमो आज़माएँ। यदि आप एलएलएम की कार्यप्रणाली के बारे में गहराई से जानना चाहते हैं, तो यहां एक सूची दी गई है बड़े भाषा मॉडल पर निःशुल्क पाठ्यक्रम.

[1] जेड डू, वाई कियान एट अल।, जीएलएम: ऑटोरेग्रेसिव ब्लैंक इनफिलिंग के साथ सामान्य भाषा मॉडल प्रीट्रेनिंग, एसीएल 2022

[2] ए झेंग, एक्स लियू एट अल।, जीएलएम-130बी - एक खुला द्विभाषी पूर्वप्रशिक्षित मॉडल, आईसीएमएल 2023

[3] डी हेंड्रिक्स, के जिम्पेल, गाऊसी त्रुटि रैखिक इकाइयाँ (GELUs), arXiv, 2016

[4] चैटजीएलएम-6बी: हगिंगफेस स्पेस पर डेमो

[5] गिटहब रेपो

बाला प्रिया सी एक तकनीकी लेखक हैं, जिन्हें लंबी-चौड़ी सामग्री बनाने में मज़ा आता है। उनकी रुचि के क्षेत्रों में गणित, प्रोग्रामिंग और डेटा विज्ञान शामिल हैं। वह डेवलपर समुदाय के साथ ट्यूटोरियल, कैसे-कैसे गाइड, और बहुत कुछ लिखकर अपनी सीख साझा करती है।

- एसईओ संचालित सामग्री और पीआर वितरण। आज ही प्रवर्धित हो जाओ।

- प्लेटोआईस्ट्रीम। Web3 डेटा इंटेलिजेंस। ज्ञान प्रवर्धित। यहां पहुंचें।

- मिंटिंग द फ्यूचर डब्ल्यू एड्रिएन एशले। यहां पहुंचें।

- स्रोत: https://www.kdnuggets.com/2023/04/chatglm6b-lightweight-opensource-chatgpt-alternative.html?utm_source=rss&utm_medium=rss&utm_campaign=chatglm-6b-a-lightweight-open-source-chatgpt-alternative

- :हैस

- :है

- :नहीं

- $यूपी

- 1

- a

- About

- पहुँच

- सुलभ

- सक्रियण

- सक्रियता

- सक्रिय

- इसके अलावा

- फायदे

- AL

- सब

- वैकल्पिक

- विकल्प

- an

- और

- हैं

- क्षेत्र

- क्षेत्रों के बारे में जानकारी का उपयोग करके ट्रेडिंग कर सकते हैं।

- लेख

- AS

- At

- ध्यान

- संलेखन

- स्वत:

- उपलब्ध

- BE

- बन

- हो जाता है

- किया गया

- जा रहा है

- बेहतर

- के बीच

- बिलियन

- फूल का खिलना

- के छात्रों

- लेकिन

- by

- कर सकते हैं

- कब्जा

- ChatGPT

- चीन

- चीनी

- चुनाव

- सामान्य

- समुदाय

- तुलनीय

- तुलना

- कंप्यूटिंग

- सामग्री

- प्रसंग

- संदर्भों

- निरंतर

- पाठ्यक्रमों

- बनाना

- वर्तमान में

- तिथि

- डेटा विज्ञान

- और गहरा

- डेमो

- विवरण

- डेवलपर

- विकासशील

- डिवाइस

- अंतर

- मतभेद

- विभिन्न

- चर्चा

- किया

- ई एंड टी

- समाप्त

- अंग्रेज़ी

- त्रुटि

- परिवार

- प्रतिक्रिया

- कुछ

- कम

- निम्नलिखित

- के लिए

- प्रपत्र

- पाया

- से

- सामान्य जानकारी

- पीढ़ी

- उत्पादक

- मिल

- देना

- जा

- अच्छा

- GPUs

- महान

- समूह

- मार्गदर्शिकाएँ

- हाथ

- कठिन

- है

- होने

- उसे

- यहाँ उत्पन्न करें

- उच्च प्रदर्शन

- एचटीएमएल

- HTTPS

- हगिंग फ़ेस

- मानव

- if

- असंभव

- में सुधार

- in

- ग़लत

- शामिल

- सहित

- करें-

- बजाय

- निर्देश

- ब्याज

- में

- शामिल

- IT

- आईटी इस

- जेपीजी

- केडनगेट्स

- कुंजी

- जानना

- भाषा

- भाषाऐं

- बड़ा

- बड़ा

- पिछली बार

- ताज़ा

- जानें

- सीख रहा हूँ

- लंबाई

- हल्के

- पसंद

- संभावित

- सीमाओं

- सीमित

- लिंक्डइन

- सूची

- स्थानीय स्तर पर

- लंबा

- लंबे समय तक

- निम्न

- मशीन

- यंत्र अधिगम

- मुख्य धारा

- बनाना

- बनाता है

- मुखौटा

- मास्क

- गणित

- मई..

- याद

- उल्लेख किया

- झूठी खबर

- आदर्श

- मोडलिंग

- मॉडल

- अधिक

- प्राकृतिक

- प्राकृतिक भाषा

- प्राकृतिक भाषा को समझना

- अगला

- संख्या

- Nvidia

- उद्देश्य

- of

- अक्सर

- on

- खुला

- खुला स्रोत

- इष्टतमीकरण

- अनुकूलित

- or

- अन्य

- हमारी

- आउट

- के ऊपर

- पैरामीटर

- प्रदर्शन

- प्रदर्शन

- प्लेटो

- प्लेटो डेटा इंटेलिजेंस

- प्लेटोडाटा

- लोकप्रिय

- पूर्व

- प्रोग्रामिंग

- सुदृढीकरण सीखना

- विज्ञप्ति

- आवश्यकता

- अनुसंधान

- उपयुक्त संसाधन चुनें

- प्रतिबंधित

- परिणाम

- रन

- s

- विज्ञान

- अनुभाग

- कई

- कई

- शेयरों

- वह

- समान

- सरल

- एक

- छोटे

- So

- अंतरिक्ष

- रिक्त स्थान

- विस्तार

- खड़ा

- कदम

- फिर भी

- अध्ययन

- ऐसा

- सुपर

- समर्थन करता है

- उपयुक्त

- कार्य

- तकनीकी

- तकनीक

- शर्तों

- से

- कि

- RSI

- लेकिन हाल ही

- उन

- फिर

- वहाँ।

- इसलिये

- इन

- इसका

- यहाँ

- पहर

- सेवा मेरे

- भी

- प्रशिक्षित

- प्रशिक्षण

- खरब

- सिंघुआ

- ट्यूटोरियल

- टाइप

- समझना

- समझ

- इकाइयों

- विश्वविद्यालय

- उपयोग

- प्रयुक्त

- उपयोगकर्ता

- उपयोगकर्ताओं

- का उपयोग

- मान

- विविधता

- संस्करण

- सप्ताह

- कुंआ

- क्या

- कब

- कौन कौन से

- कौन

- साथ में

- काम किया

- काम कर रहे

- बदतर

- लपेटो

- लेखक

- लिख रहे हैं

- X

- इसलिए आप

- जेफिरनेट