यह पोस्ट वीएमवेयर कार्बन ब्लैक में महिमा अग्रवाल, मशीन लर्निंग इंजीनियर, और दीपक मेटेम, सीनियर इंजीनियरिंग मैनेजर के साथ मिलकर लिखी गई है।

VMware कार्बन ब्लैक एक प्रसिद्ध सुरक्षा समाधान है जो आधुनिक साइबर हमलों के पूर्ण स्पेक्ट्रम के विरुद्ध सुरक्षा प्रदान करता है। उत्पाद द्वारा जनरेट किए गए डेटा की टेराबाइट्स के साथ, सुरक्षा विश्लेषण टीम मशीन लर्निंग (एमएल) समाधानों के निर्माण पर ध्यान केंद्रित करती है ताकि महत्वपूर्ण हमलों और शोर से उभरते खतरों को उजागर किया जा सके।

VMware कार्बन ब्लैक टीम के लिए कस्टम एंड-टू-एंड MLOps पाइपलाइन का डिज़ाइन और निर्माण करना महत्वपूर्ण है जो ML जीवनचक्र में वर्कफ़्लो को ऑर्केस्ट्रेट और स्वचालित करता है और मॉडल प्रशिक्षण, मूल्यांकन और परिनियोजन को सक्षम बनाता है।

इस पाइपलाइन के निर्माण के दो मुख्य उद्देश्य हैं: अंतिम चरण के मॉडल के विकास के लिए डेटा वैज्ञानिकों का समर्थन करना, और उच्च मात्रा में और वास्तविक समय के उत्पादन यातायात में मॉडल की सेवा करके उत्पाद में सतह मॉडल की भविष्यवाणी करना। इसलिए, VMware कार्बन ब्लैक और AWS ने कस्टम MLOps पाइपलाइन का उपयोग करके निर्माण करना चुना अमेज़न SageMaker इसके उपयोग में आसानी, बहुमुखी प्रतिभा और पूरी तरह से प्रबंधित बुनियादी ढांचे के लिए। हम अपने एमएल प्रशिक्षण और परिनियोजन पाइपलाइनों का उपयोग करके ऑर्केस्ट्रेट करते हैं Apache Airflow के लिए Amazon प्रबंधित वर्कफ़्लो (अमेज़ॅन MWAA), जो हमें ऑटो स्केलिंग या बुनियादी ढांचे के रखरखाव के बारे में चिंता किए बिना वर्कफ़्लोज़ और पाइपलाइनों को प्रोग्रामेटिक रूप से संलेखित करने पर अधिक ध्यान केंद्रित करने में सक्षम बनाता है।

इस पाइपलाइन के साथ, जो एक बार ज्यूपिटर नोटबुक-संचालित एमएल अनुसंधान था, अब एक स्वचालित प्रक्रिया है जो डेटा वैज्ञानिकों के थोड़े से मैनुअल हस्तक्षेप के साथ उत्पादन के लिए मॉडल को तैनात करती है। पहले, एक मॉडल के प्रशिक्षण, मूल्यांकन और तैनाती की प्रक्रिया में एक दिन लग सकता था; इस कार्यान्वयन के साथ, सब कुछ बस एक ट्रिगर दूर है और समग्र समय को कुछ मिनटों में घटा दिया है।

इस पोस्ट में, VMware कार्बन ब्लैक और AWS आर्किटेक्ट चर्चा करते हैं कि हमने कस्टम ML वर्कफ़्लोज़ का उपयोग करके कैसे बनाया और प्रबंधित किया Gitlab, Amazon MWAA, और SageMaker। हम इस बात पर चर्चा करते हैं कि हमने अभी तक क्या हासिल किया है, पाइपलाइन में और सुधार किए हैं, और इस दौरान सीखे गए पाठों पर चर्चा करते हैं।

समाधान अवलोकन

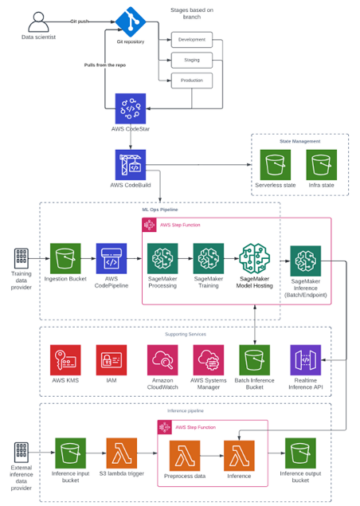

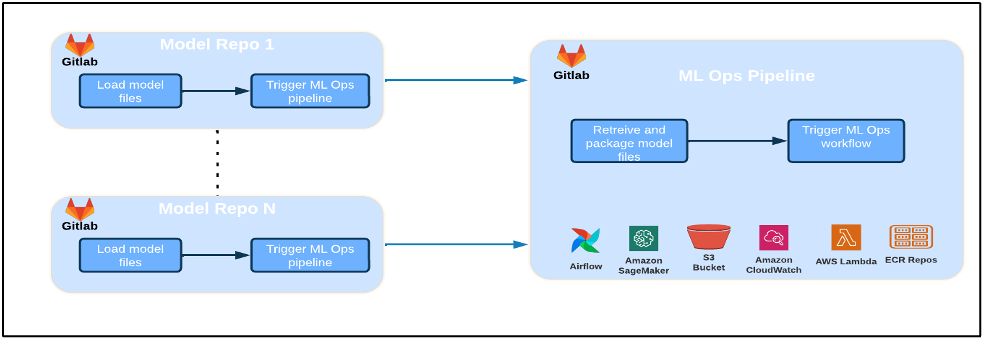

निम्नलिखित आरेख एमएल प्लेटफॉर्म आर्किटेक्चर को दिखाता है।

उच्च स्तरीय समाधान डिजाइन

इस ML प्लेटफ़ॉर्म की कल्पना की गई थी और इसे विभिन्न कोड रिपॉजिटरी में विभिन्न मॉडलों द्वारा उपयोग किए जाने के लिए डिज़ाइन किया गया था। हमारी टीम सभी कोड रिपॉजिटरी को बनाए रखने के लिए GitLab को सोर्स कोड मैनेजमेंट टूल के रूप में उपयोग करती है। मॉडल रिपॉजिटरी सोर्स कोड में कोई भी बदलाव का उपयोग करके लगातार एकीकृत किया जाता है गिटलैब सीआई, जो पाइपलाइन (मॉडल प्रशिक्षण, मूल्यांकन और परिनियोजन) में बाद के वर्कफ़्लोज़ को आमंत्रित करता है।

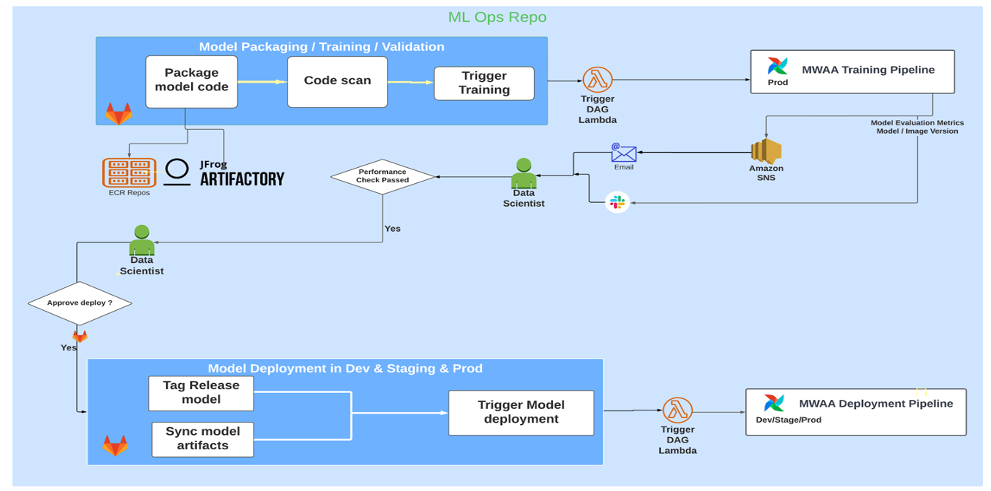

निम्नलिखित आर्किटेक्चर आरेख एंड-टू-एंड वर्कफ़्लो और हमारे MLOps पाइपलाइन में शामिल घटकों को दिखाता है।

एंड-टू-एंड वर्कफ़्लो

एमएल मॉडल प्रशिक्षण, मूल्यांकन और परिनियोजन पाइपलाइनों को अमेज़ॅन MWAA का उपयोग करके ऑर्केस्ट्रेटेड किया जाता है, जिसे एक के रूप में संदर्भित किया जाता है निर्देशित अचक्रीय ग्राफ (डीएजी)। एक डीएजी एक साथ कार्यों का एक संग्रह है, जो निर्भरताओं और संबंधों के साथ व्यवस्थित होता है, यह कहने के लिए कि उन्हें कैसे चलाना चाहिए।

उच्च स्तर पर, समाधान संरचना में तीन मुख्य घटक शामिल होते हैं:

- एमएल पाइपलाइन कोड रिपॉजिटरी

- एमएल मॉडल प्रशिक्षण और मूल्यांकन पाइपलाइन

- एमएल मॉडल परिनियोजन पाइपलाइन

आइए चर्चा करें कि इन विभिन्न घटकों का प्रबंधन कैसे किया जाता है और वे एक दूसरे के साथ कैसे इंटरैक्ट करते हैं।

एमएल पाइपलाइन कोड रिपॉजिटरी

मॉडल रेपो MLOps रेपो को अपनी डाउनस्ट्रीम पाइपलाइन के रूप में एकीकृत करने के बाद, और एक डेटा वैज्ञानिक अपने मॉडल रेपो में कोड करता है, एक GitLab रनर उस रेपो में परिभाषित मानक कोड सत्यापन और परीक्षण करता है और कोड परिवर्तनों के आधार पर MLOps पाइपलाइन को ट्रिगर करता है। हम इस ट्रिगर को अलग-अलग रेपो में सक्षम करने के लिए Gitlab की मल्टी-प्रोजेक्ट पाइपलाइन का उपयोग करते हैं।

MLOps GitLab पाइपलाइन चरणों का एक निश्चित सेट चलाती है। यह पिलिंट का उपयोग करके मूल कोड सत्यापन करता है, मॉडल के प्रशिक्षण और अनुमान कोड को डॉकर छवि के भीतर पैकेज करता है, और कंटेनर छवि को प्रकाशित करता है अमेज़ॅन इलास्टिक कंटेनर रजिस्ट्री (अमेज़न ईसीआर)। अमेज़ॅन ईसीआर उच्च-प्रदर्शन होस्टिंग की पेशकश करने वाली एक पूरी तरह से प्रबंधित कंटेनर रजिस्ट्री है, इसलिए आप कहीं भी एप्लिकेशन छवियों और कलाकृतियों को मज़बूती से तैनात कर सकते हैं।

एमएल मॉडल प्रशिक्षण और मूल्यांकन पाइपलाइन

छवि प्रकाशित होने के बाद, यह प्रशिक्षण और मूल्यांकन को ट्रिगर करता है अपाचे एयरफ्लो पाइपलाइन के माध्यम से AWS लाम्बा समारोह। लैम्ब्डा एक सर्वर रहित, इवेंट-संचालित कंप्यूट सेवा है जो आपको सर्वर के प्रावधान या प्रबंधन के बिना वस्तुतः किसी भी प्रकार के एप्लिकेशन या बैकएंड सेवा के लिए कोड चलाने देती है।

पाइपलाइन सफलतापूर्वक शुरू होने के बाद, यह प्रशिक्षण और मूल्यांकन डीएजी चलाता है, जो बदले में सैजमेकर में मॉडल प्रशिक्षण शुरू करता है। इस प्रशिक्षण पाइपलाइन के अंत में, पहचाने गए उपयोगकर्ता समूह को ईमेल के माध्यम से प्रशिक्षण और मॉडल मूल्यांकन परिणामों के साथ एक सूचना मिलती है अमेज़न सरल अधिसूचना सेवा (अमेज़ॅन एसएनएस) और स्लैक। Amazon SNS A2A और A2P मैसेजिंग के लिए पूरी तरह से प्रबंधित पब/उप सेवा है।

मूल्यांकन परिणामों के गहन विश्लेषण के बाद, डेटा वैज्ञानिक या एमएल इंजीनियर नए मॉडल को तैनात कर सकते हैं यदि नए प्रशिक्षित मॉडल का प्रदर्शन पिछले संस्करण की तुलना में बेहतर है। मॉडल-विशिष्ट मेट्रिक्स (जैसे F1 स्कोर, MSE, या भ्रम मैट्रिक्स) के आधार पर मॉडलों के प्रदर्शन का मूल्यांकन किया जाता है।

एमएल मॉडल परिनियोजन पाइपलाइन

परिनियोजन शुरू करने के लिए, उपयोगकर्ता GitLab कार्य शुरू करता है, जो उसी लैम्ब्डा फ़ंक्शन के माध्यम से परिनियोजन DAG को ट्रिगर करता है। पाइपलाइन के सफलतापूर्वक चलने के बाद, यह नए मॉडल के साथ SageMaker समापन बिंदु को बनाता या अपडेट करता है। यह अमेज़ॅन एसएनएस और स्लैक का उपयोग करके ईमेल पर समापन बिंदु विवरण के साथ एक सूचना भी भेजता है।

किसी भी पाइपलाइन में विफलता की स्थिति में, उपयोगकर्ताओं को उसी संचार चैनल पर सूचित किया जाता है।

SageMaker रीयल-टाइम अनुमान प्रदान करता है जो कम विलंबता और उच्च थ्रूपुट आवश्यकताओं वाले अनुमान वर्कलोड के लिए आदर्श है। ये समापन बिंदु पूरी तरह से प्रबंधित, लोड संतुलित और ऑटो स्केल किए गए हैं, और उच्च उपलब्धता के लिए कई उपलब्धता क्षेत्रों में तैनात किए जा सकते हैं। हमारी पाइपलाइन किसी मॉडल के सफलतापूर्वक चलने के बाद उसके लिए ऐसा समापन बिंदु बनाती है।

निम्नलिखित खंडों में, हम विभिन्न घटकों पर विस्तार करते हैं और विवरण में गोता लगाते हैं।

GitLab: पैकेज मॉडल और ट्रिगर पाइपलाइन

हम GitLab का उपयोग अपने कोड रिपॉजिटरी के रूप में और पाइपलाइन के लिए मॉडल कोड को पैकेज करने और डाउनस्ट्रीम एयरफ्लो DAGs को ट्रिगर करने के लिए करते हैं।

मल्टी-प्रोजेक्ट पाइपलाइन

मल्टी-प्रोजेक्ट गिटलैब पाइपलाइन सुविधा का उपयोग किया जाता है जहां पैरेंट पाइपलाइन (अपस्ट्रीम) एक मॉडल रेपो है और चाइल्ड पाइपलाइन (डाउनस्ट्रीम) MLOps रेपो है। प्रत्येक रेपो एक .gitlab-ci.yml को बनाए रखता है, और अपस्ट्रीम पाइपलाइन में सक्षम निम्न कोड ब्लॉक डाउनस्ट्रीम MLOps पाइपलाइन को ट्रिगर करता है।

अपस्ट्रीम पाइपलाइन मॉडल कोड को डाउनस्ट्रीम पाइपलाइन पर भेजती है जहां पैकेजिंग और प्रकाशन सीआई जॉब ट्रिगर हो जाते हैं। मॉडल कोड को कंटेनरीकृत करने और इसे Amazon ECR पर प्रकाशित करने के लिए MLOps पाइपलाइन द्वारा बनाए रखा और प्रबंधित किया जाता है। यह ACCESS_TOKEN जैसे चर भेजता है (इसके तहत बनाया जा सकता है सेटिंग, पहुँच), JOB_ID (अपस्ट्रीम कलाकृतियों तक पहुँचने के लिए), और $CI_PROJECT_ID (मॉडल रेपो की प्रोजेक्ट आईडी) चर, ताकि MLOps पाइपलाइन मॉडल कोड फ़ाइलों तक पहुँच सके। साथ नौकरी की कलाकृतियाँ Gitlab से सुविधा, डाउनस्ट्रीम रेपो निम्नलिखित कमांड का उपयोग करके दूरस्थ कलाकृतियों तक पहुँचता है:

मॉडल रेपो एक ही रेपो से कई मॉडलों के लिए डाउनस्ट्रीम पाइपलाइनों का उपभोग कर सकता है, जो उस चरण का विस्तार करता है जो इसे उपयोग करके ट्रिगर करता है फैली GitLab से कीवर्ड, जो आपको विभिन्न चरणों में समान कॉन्फ़िगरेशन का पुन: उपयोग करने की अनुमति देता है।

Amazon ECR को मॉडल छवि प्रकाशित करने के बाद, MLOps पाइपलाइन लैम्ब्डा का उपयोग करके Amazon MWAA प्रशिक्षण पाइपलाइन को ट्रिगर करती है। उपयोगकर्ता अनुमोदन के बाद, यह समान लैम्ब्डा फ़ंक्शन का उपयोग करके मॉडल परिनियोजन अमेज़ॅन MWAA पाइपलाइन को ट्रिगर करता है।

सिमेंटिक वर्जनिंग और पासिंग वर्जन डाउनस्ट्रीम

हमने संस्करण ईसीआर छवियों और सैजमेकर मॉडल के लिए कस्टम कोड विकसित किया है। MLOps पाइपलाइन छवियों और मॉडलों के लिए सिमेंटिक वर्जनिंग लॉजिक का प्रबंधन उस चरण के हिस्से के रूप में करती है जहां मॉडल कोड कंटेनरीकृत हो जाता है, और बाद के चरणों में कलाकृतियों के रूप में संस्करणों को पास करता है।

फिर से शिक्षित करना

चूंकि पुनर्प्रशिक्षण एमएल जीवनचक्र का एक महत्वपूर्ण पहलू है, इसलिए हमने अपनी पाइपलाइन के भाग के रूप में पुनर्प्रशिक्षण क्षमताओं को लागू किया है। हम सैजमेकर सूची-मॉडल एपीआई का उपयोग यह पहचानने के लिए करते हैं कि क्या यह मॉडल रीट्रेनिंग संस्करण संख्या और टाइमस्टैम्प के आधार पर फिर से प्रशिक्षित हो रहा है।

हम रिट्रेनिंग पाइपलाइन के दैनिक कार्यक्रम का उपयोग कर प्रबंधन करते हैं GitLab की शेड्यूल पाइपलाइन.

टेराफॉर्म: इंफ्रास्ट्रक्चर सेटअप

Amazon MWAA क्लस्टर, ECR रिपॉजिटरी, लैम्ब्डा फ़ंक्शंस और SNS विषय के अलावा, यह समाधान भी उपयोग करता है AWS पहचान और अभिगम प्रबंधन (आईएएम) भूमिकाएं, उपयोगकर्ता और नीतियां; अमेज़न सरल भंडारण सेवा (अमेज़न S3) बकेट, और a अमेज़ॅन क्लाउडवॉच लॉग फारवर्डर।

हमारी पाइपलाइन में शामिल सेवाओं के लिए बुनियादी ढांचे की स्थापना और रखरखाव को सुव्यवस्थित करने के लिए, हम उपयोग करते हैं terraform कोड के रूप में बुनियादी ढांचे को लागू करने के लिए। जब भी इन्फ्रा अपडेट की आवश्यकता होती है, तो कोड परिवर्तन एक GitLab CI पाइपलाइन को ट्रिगर करता है जिसे हम सेट करते हैं, जो विभिन्न वातावरणों में परिवर्तनों को मान्य और तैनात करता है (उदाहरण के लिए, विकास, मंच और ठेस खातों में IAM नीति के लिए अनुमति जोड़ना)।

Amazon ECR, Amazon S3, और Lambda: पाइपलाइन सुविधा

हम अपनी पाइपलाइन को सुविधाजनक बनाने के लिए निम्नलिखित प्रमुख सेवाओं का उपयोग करते हैं:

- अमेज़न ईसीआर - मॉडल कंटेनर छवियों के सुविधाजनक पुनर्प्राप्ति को बनाए रखने और अनुमति देने के लिए, हम उन्हें सिमेंटिक संस्करणों के साथ टैग करते हैं और उन्हें प्रति ईसीआर रिपॉजिटरी में अपलोड करते हैं

${project_name}/${model_name}टेराफॉर्म के माध्यम से। यह विभिन्न मॉडलों के बीच अलगाव की एक अच्छी परत को सक्षम करता है, और हमें कस्टम एल्गोरिदम का उपयोग करने और वांछित मॉडल प्रकट जानकारी (मॉडल का नाम, संस्करण, प्रशिक्षण डेटा पथ, और इसी तरह) को शामिल करने के लिए अनुमान अनुरोधों और प्रतिक्रियाओं को प्रारूपित करने की अनुमति देता है। - अमेज़न S3 - हम मॉडल प्रशिक्षण डेटा, प्रति मॉडल प्रशिक्षित मॉडल कलाकृतियों, एयरफ्लो डीएजी और पाइपलाइनों द्वारा आवश्यक अन्य अतिरिक्त जानकारी को बनाए रखने के लिए S3 बकेट का उपयोग करते हैं।

- lambda - क्योंकि हमारा एयरफ्लो क्लस्टर सुरक्षा कारणों से एक अलग VPC में तैनात है, DAG को सीधे एक्सेस नहीं किया जा सकता है। इसलिए, हम डीएजी नाम से निर्दिष्ट किसी भी डीएजी को ट्रिगर करने के लिए लैम्ब्डा फ़ंक्शन का उपयोग करते हैं, जिसे टेराफॉर्म के साथ भी बनाए रखा जाता है। उचित IAM सेटअप के साथ, GitLab CI जॉब लैम्ब्डा फ़ंक्शन को ट्रिगर करता है, जो कॉन्फ़िगरेशन से नीचे अनुरोधित प्रशिक्षण या परिनियोजन DAG तक जाता है।

अमेज़न MWAA: प्रशिक्षण और परिनियोजन पाइपलाइन

जैसा कि पहले उल्लेख किया गया है, हम प्रशिक्षण और परिनियोजन पाइपलाइनों को ऑर्केस्ट्रेट करने के लिए Amazon MWAA का उपयोग करते हैं। हम इसमें उपलब्ध SageMaker ऑपरेटरों का उपयोग करते हैं एयरफ्लो के लिए अमेज़न प्रदाता पैकेज सेजमेकर के साथ एकीकृत करने के लिए (जिंजा टेम्प्लेटिंग से बचने के लिए)।

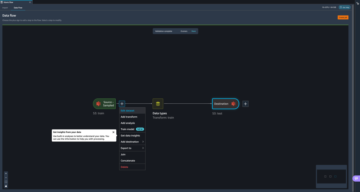

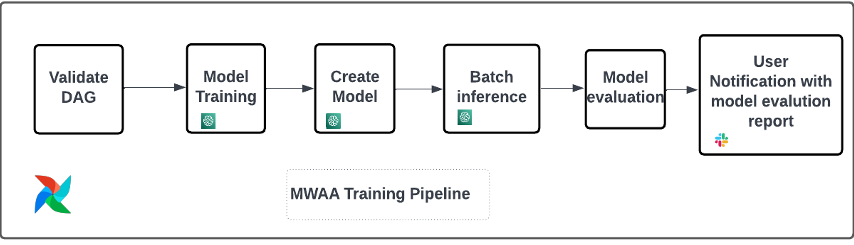

हम इस प्रशिक्षण पाइपलाइन में निम्नलिखित ऑपरेटरों का उपयोग करते हैं (निम्न कार्यप्रवाह आरेख में दिखाया गया है):

MWAA प्रशिक्षण पाइपलाइन

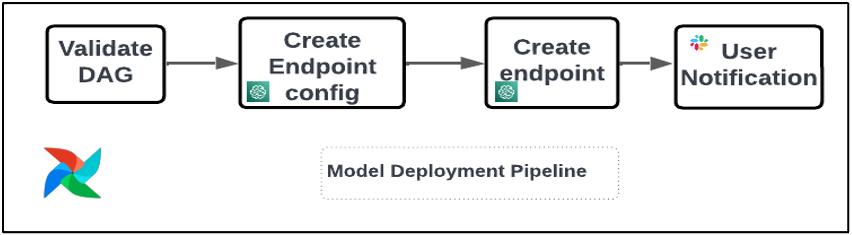

हम परिनियोजन पाइपलाइन में निम्नलिखित ऑपरेटरों का उपयोग करते हैं (निम्न कार्यप्रवाह आरेख में दिखाया गया है):

मॉडल परिनियोजन पाइपलाइन

हम दोनों पाइपलाइनों में त्रुटि/सफलता संदेशों और मूल्यांकन परिणामों को प्रकाशित करने के लिए स्लैक और अमेज़ॅन एसएनएस का उपयोग करते हैं। स्लैक निम्नलिखित सहित संदेशों को अनुकूलित करने के लिए विकल्पों की एक विस्तृत श्रृंखला प्रदान करता है:

- एसएनएसपब्लिशऑपरेटर - हम प्रयोग करते हैं एसएनएसपब्लिशऑपरेटर उपयोगकर्ता ईमेल पर सफलता/विफलता सूचनाएं भेजने के लिए

- सुस्त एपीआई - हमने बनाया इनकमिंग वेबहुक यूआरएल वांछित चैनल के लिए पाइपलाइन सूचनाएं प्राप्त करने के लिए

क्लाउडवॉच और वीएमवेयर वेवफ्रंट: मॉनिटरिंग और लॉगिंग

एंडपॉइंट मॉनिटरिंग और लॉगिंग को कॉन्फ़िगर करने के लिए हम क्लाउडवॉच डैशबोर्ड का उपयोग करते हैं। यह प्रत्येक परियोजना के लिए विशिष्ट विभिन्न परिचालन और मॉडल प्रदर्शन मेट्रिक्स की कल्पना करने और उन पर नज़र रखने में मदद करता है। उनमें से कुछ को ट्रैक करने के लिए सेट की गई ऑटो स्केलिंग नीतियों के शीर्ष पर, हम सीपीयू और मेमोरी उपयोग में परिवर्तन, प्रति सेकंड अनुरोध, प्रतिक्रिया विलंबता और मॉडल मेट्रिक्स की लगातार निगरानी करते हैं।

CloudWatch को VMware Tanzu Wavefront डैशबोर्ड के साथ भी एकीकृत किया गया है ताकि यह प्रोजेक्ट स्तर पर मॉडल एंडपॉइंट्स के साथ-साथ अन्य सेवाओं के लिए मेट्रिक्स की कल्पना कर सके।

व्यावसायिक लाभ और आगे क्या है

एमएल पाइपलाइन एमएल सेवाओं और सुविधाओं के लिए बहुत महत्वपूर्ण हैं। इस पोस्ट में, हमने एडब्ल्यूएस की क्षमताओं का उपयोग करते हुए एंड-टू-एंड एमएल उपयोग मामले पर चर्चा की। हमने SageMaker और Amazon MWAA का उपयोग करके एक कस्टम पाइपलाइन का निर्माण किया, जिसका हम परियोजनाओं और मॉडलों में पुन: उपयोग कर सकते हैं, और ML जीवनचक्र को स्वचालित किया, जिससे मॉडल प्रशिक्षण से लेकर उत्पादन परिनियोजन तक का समय 10 मिनट तक कम हो गया।

एमएल जीवनचक्र के बोझ को सैजमेकर पर स्थानांतरित करने के साथ, इसने मॉडल प्रशिक्षण और परिनियोजन के लिए अनुकूलित और स्केलेबल बुनियादी ढांचा प्रदान किया। सैजमेकर के साथ काम करने वाले मॉडल ने हमें मिलीसेकंड विलंबता और निगरानी क्षमताओं के साथ वास्तविक समय की भविष्यवाणी करने में मदद की। हमने सेटअप में आसानी और बुनियादी ढांचे के प्रबंधन के लिए टेराफॉर्म का इस्तेमाल किया।

इस पाइपलाइन के लिए अगले चरण मॉडल प्रशिक्षण पाइपलाइन को पुनर्प्रशिक्षण क्षमताओं के साथ बढ़ाना होगा, चाहे वह शेड्यूल हो या मॉडल ड्रिफ्ट डिटेक्शन पर आधारित हो, तेज और योग्य मॉडल परिनियोजन के लिए शैडो परिनियोजन या ए/बी परीक्षण, और एमएल वंशावली ट्रैकिंग। हम मूल्यांकन करने की भी योजना बना रहे हैं अमेज़न SageMaker पाइपलाइन क्योंकि GitLab एकीकरण अब समर्थित है।

सबक सीखा

इस समाधान के निर्माण के भाग के रूप में, हमने सीखा है कि आपको जल्दी सामान्यीकरण करना चाहिए, लेकिन अति-सामान्यीकरण नहीं करना चाहिए। जब हमने पहली बार आर्किटेक्चर डिज़ाइन पूरा किया, तो हमने मॉडल कोड के लिए सर्वोत्तम अभ्यास के रूप में कोड टेम्प्लेटिंग बनाने और लागू करने का प्रयास किया। हालाँकि, यह विकास प्रक्रिया में इतनी जल्दी था कि टेम्पलेट या तो बहुत सामान्यीकृत थे या भविष्य के मॉडल के लिए पुन: प्रयोज्य होने के लिए बहुत विस्तृत थे।

पाइपलाइन के माध्यम से पहला मॉडल देने के बाद, हमारे पिछले काम की अंतर्दृष्टि के आधार पर टेम्पलेट स्वाभाविक रूप से सामने आए। एक पाइपलाइन पहले दिन से सब कुछ नहीं कर सकती।

मॉडल प्रयोग और उत्पादनकरण की अक्सर बहुत भिन्न (या कभी-कभी परस्पर विरोधी) आवश्यकताएं होती हैं। एक टीम के रूप में शुरुआत से ही इन आवश्यकताओं को संतुलित करना और तदनुसार प्राथमिकता देना महत्वपूर्ण है।

इसके अतिरिक्त, आपको किसी सेवा की प्रत्येक सुविधा की आवश्यकता नहीं हो सकती है। एक सेवा से आवश्यक सुविधाओं का उपयोग करना और एक मॉड्यूलर डिज़ाइन होना अधिक कुशल विकास और एक लचीली पाइपलाइन की कुंजी है।

निष्कर्ष

इस पोस्ट में, हमने दिखाया कि कैसे हमने SageMaker और Amazon MWAA का उपयोग करके एक MLOps समाधान बनाया, जिसने डेटा वैज्ञानिकों के थोड़े से मानवीय हस्तक्षेप के साथ, उत्पादन के लिए मॉडलों को तैनात करने की प्रक्रिया को स्वचालित कर दिया। हम आपको संपूर्ण MLOps समाधान बनाने के लिए SageMaker, Amazon MWAA, Amazon S3, और Amazon ECR जैसी विभिन्न AWS सेवाओं का मूल्यांकन करने के लिए प्रोत्साहित करते हैं।

*Apache, Apache Airflow, और Airflow या तो पंजीकृत ट्रेडमार्क हैं या इसके ट्रेडमार्क हैं अपाचे सॉफ्टवेयर फाउंडेशन संयुक्त राज्य अमेरिका और/या अन्य देशों में।

लेखक के बारे में

दीपक मेट्टम वीएमवेयर, कार्बन ब्लैक यूनिट में एक वरिष्ठ इंजीनियरिंग प्रबंधक हैं। वह और उनकी टीम स्ट्रीमिंग आधारित एप्लिकेशन और सेवाओं के निर्माण पर काम करते हैं जो वास्तविक समय में ग्राहकों को मशीन लर्निंग आधारित समाधान लाने के लिए अत्यधिक उपलब्ध, स्केलेबल और लचीला हैं। वह और उनकी टीम डेटा वैज्ञानिकों के उत्पादन में उनके एमएल मॉडल के निर्माण, प्रशिक्षण, तैनाती और सत्यापन के लिए आवश्यक उपकरण बनाने के लिए भी जिम्मेदार हैं।

दीपक मेट्टम वीएमवेयर, कार्बन ब्लैक यूनिट में एक वरिष्ठ इंजीनियरिंग प्रबंधक हैं। वह और उनकी टीम स्ट्रीमिंग आधारित एप्लिकेशन और सेवाओं के निर्माण पर काम करते हैं जो वास्तविक समय में ग्राहकों को मशीन लर्निंग आधारित समाधान लाने के लिए अत्यधिक उपलब्ध, स्केलेबल और लचीला हैं। वह और उनकी टीम डेटा वैज्ञानिकों के उत्पादन में उनके एमएल मॉडल के निर्माण, प्रशिक्षण, तैनाती और सत्यापन के लिए आवश्यक उपकरण बनाने के लिए भी जिम्मेदार हैं।

महिमा अग्रवाल वीएमवेयर, कार्बन ब्लैक यूनिट में मशीन लर्निंग इंजीनियर हैं।

महिमा अग्रवाल वीएमवेयर, कार्बन ब्लैक यूनिट में मशीन लर्निंग इंजीनियर हैं।

वह VMware CB SBU के लिए मशीन लर्निंग प्लेटफॉर्म के मुख्य घटकों और आर्किटेक्चर की डिजाइनिंग, निर्माण और विकास पर काम करती है।

वामशी कृष्ण एनबोथला एडब्ल्यूएस में सीनियर एप्लाइड एआई स्पेशलिस्ट आर्किटेक्ट हैं। वह उच्च प्रभाव वाले डेटा, एनालिटिक्स और मशीन लर्निंग पहलों में तेजी लाने के लिए विभिन्न क्षेत्रों के ग्राहकों के साथ काम करता है। वह एआई और एमएल में सिफारिश प्रणाली, एनएलपी और कंप्यूटर विजन क्षेत्रों के बारे में भावुक है। काम के बाहर, वामशी एक आरसी उत्साही है, जो आरसी उपकरण (विमान, कार और ड्रोन) बनाता है, और बागवानी का भी आनंद लेता है।

वामशी कृष्ण एनबोथला एडब्ल्यूएस में सीनियर एप्लाइड एआई स्पेशलिस्ट आर्किटेक्ट हैं। वह उच्च प्रभाव वाले डेटा, एनालिटिक्स और मशीन लर्निंग पहलों में तेजी लाने के लिए विभिन्न क्षेत्रों के ग्राहकों के साथ काम करता है। वह एआई और एमएल में सिफारिश प्रणाली, एनएलपी और कंप्यूटर विजन क्षेत्रों के बारे में भावुक है। काम के बाहर, वामशी एक आरसी उत्साही है, जो आरसी उपकरण (विमान, कार और ड्रोन) बनाता है, और बागवानी का भी आनंद लेता है।

साहिल थापर एक उद्यम समाधान वास्तुकार है। वह ग्राहकों के साथ काम करता है ताकि उन्हें एडब्ल्यूएस क्लाउड पर अत्यधिक उपलब्ध, स्केलेबल और लचीला एप्लिकेशन बनाने में मदद मिल सके। वह वर्तमान में कंटेनरों और मशीन लर्निंग समाधानों पर केंद्रित है।

साहिल थापर एक उद्यम समाधान वास्तुकार है। वह ग्राहकों के साथ काम करता है ताकि उन्हें एडब्ल्यूएस क्लाउड पर अत्यधिक उपलब्ध, स्केलेबल और लचीला एप्लिकेशन बनाने में मदद मिल सके। वह वर्तमान में कंटेनरों और मशीन लर्निंग समाधानों पर केंद्रित है।

- एसईओ संचालित सामग्री और पीआर वितरण। आज ही प्रवर्धित हो जाओ।

- प्लेटोब्लॉकचैन। Web3 मेटावर्स इंटेलिजेंस। ज्ञान प्रवर्धित। यहां पहुंचें।

- स्रोत: https://aws.amazon.com/blogs/machine-learning/how-vmware-built-an-mlops-pipeline-from-scratch-using-gitlab-amazon-mwaa-and-amazon-sagemaker/

- :है

- $यूपी

- 1

- 10

- 100

- 7

- 8

- a

- About

- में तेजी लाने के

- पहुँच

- पहुँचा

- तदनुसार

- अकौन्टस(लेखा)

- हासिल

- के पार

- अचक्रीय

- इसके अलावा

- अतिरिक्त

- अतिरिक्त जानकारी

- बाद

- के खिलाफ

- AI

- एल्गोरिदम

- सब

- की अनुमति देता है

- वीरांगना

- अमेज़न SageMaker

- विश्लेषण

- विश्लेषिकी

- और

- कहीं भी

- अपाचे

- एपीआई

- आवेदन

- अनुप्रयोगों

- लागू

- एप्लाइड ए.आई.

- अनुमोदन

- स्थापत्य

- हैं

- क्षेत्रों के बारे में जानकारी का उपयोग करके ट्रेडिंग कर सकते हैं।

- AS

- पहलू

- At

- आक्रमण

- संलेखन

- स्वत:

- स्वचालित

- ऑटोमेटा

- उपलब्धता

- उपलब्ध

- से बचने

- एडब्ल्यूएस

- बैकएण्ड

- शेष

- आधारित

- बुनियादी

- BE

- क्योंकि

- शुरू

- लाभ

- BEST

- बेहतर

- के बीच

- काली

- खंड

- शाखा

- लाना

- निर्माण

- इमारत

- बनाया गया

- बोझ

- by

- कर सकते हैं

- नही सकता

- क्षमताओं

- कार्बन

- कारों

- मामला

- CB

- कुछ

- परिवर्तन

- चैनलों

- बच्चा

- चुना

- बादल

- समूह

- कोड

- संग्रह

- संचार

- तुलना

- पूरा

- घटकों

- गणना करना

- कंप्यूटर

- Computer Vision

- आयोजित

- विन्यास

- विन्यास

- विरोधी

- भ्रम

- विचार

- उपभोग

- प्रयुक्त

- कंटेनर

- कंटेनरों

- लगातार

- सुविधाजनक

- मूल

- सका

- देशों

- सी पी यू

- बनाना

- बनाया

- बनाता है

- बनाना

- महत्वपूर्ण

- महत्वपूर्ण

- वर्तमान में

- रिवाज

- ग्राहक

- अनुकूलित

- साइबर हमले

- डेग

- दैनिक

- डैशबोर्ड

- तिथि

- आँकड़े वाला वैज्ञानिक

- दिन

- परिभाषित

- पहुंचाने

- तैनात

- तैनात

- तैनाती

- तैनाती

- तैनाती

- तैनात

- डिज़ाइन

- बनाया गया

- डिज़ाइन बनाना

- विस्तृत

- विवरण

- खोज

- देव

- विकसित

- विकासशील

- विकास

- विभिन्न

- सीधे

- चर्चा करना

- चर्चा की

- डाक में काम करनेवाला मज़दूर

- dont

- नीचे

- राजा

- से प्रत्येक

- पूर्व

- शीघ्र

- उपयोग में आसानी

- कुशल

- भी

- ईमेल

- कस्र्न पत्थर

- सक्षम

- सक्षम

- सक्षम बनाता है

- प्रोत्साहित करना

- शुरू से अंत तक

- endpoint

- इंजीनियर

- अभियांत्रिकी

- उद्यम

- उद्यम समाधान

- सरगर्म

- वातावरण

- उपकरण

- आवश्यक

- ईथर (ईटीएच)

- मूल्यांकन करें

- मूल्यांकित

- का मूल्यांकन

- मूल्यांकन

- मूल्यांकन

- और भी

- कार्यक्रम

- प्रत्येक

- सब कुछ

- उदाहरण

- विस्तार

- का विस्तार

- f1

- की सुविधा

- विफलता

- दूर

- और तेज

- Feature

- विशेषताएं

- कुछ

- फ़ाइलें

- प्रथम

- लचीला

- फोकस

- ध्यान केंद्रित

- केंद्रित

- निम्नलिखित

- के लिए

- प्रारूप

- से

- पूर्ण

- पूरा स्पेक्ट्रम

- पूरी तरह से

- समारोह

- कार्यों

- आगे

- भविष्य

- उत्पन्न

- मिल

- अच्छा

- समूह

- है

- होने

- मदद

- मदद की

- मदद करता है

- हाई

- उच्च प्रदर्शन

- अत्यधिक

- होस्टिंग

- कैसे

- तथापि

- एचटीएमएल

- http

- HTTPS

- आई ए एम

- ID

- आदर्श

- पहचान

- पहचान करना

- पहचान

- की छवि

- छवियों

- लागू करने के

- कार्यान्वयन

- कार्यान्वित

- in

- शामिल

- शामिल

- सहित

- करें-

- इंफ्रास्ट्रक्चर

- पहल

- अंतर्दृष्टि

- एकीकृत

- एकीकृत

- एकीकृत

- एकीकरण

- बातचीत

- हस्तक्षेप

- का आह्वान

- शामिल

- अलगाव

- IT

- आईटी इस

- काम

- नौकरियां

- जेपीजी

- रखना

- कुंजी

- Instagram पर

- विलंब

- परत

- सीखा

- सीख रहा हूँ

- पाठ

- सबक सीखा

- चलें

- स्तर

- जीवन चक्र

- पसंद

- थोड़ा

- भार

- निम्न

- मशीन

- यंत्र अधिगम

- मुख्य

- बनाए रखना

- का कहना है

- रखरखाव

- बनाना

- प्रबंधन

- कामयाब

- प्रबंध

- प्रबंधक

- प्रबंधन करता है

- प्रबंध

- गाइड

- मैट्रिक्स

- याद

- उल्लेख किया

- संदेश

- मैसेजिंग

- मेट्रिक्स

- हो सकता है

- मिलीसेकंड

- मिनट

- ML

- एमएलओपीएस

- आदर्श

- मॉडल

- आधुनिक

- मॉनिटर

- निगरानी

- अधिक

- अधिक कुशल

- विभिन्न

- नाम

- प्राकृतिक रूप से

- आवश्यक

- आवश्यकता

- नया

- अगला

- NLP

- शोर

- अधिसूचना

- सूचनाएं

- संख्या

- of

- की पेशकश

- ऑफर

- on

- ONE

- परिचालन

- ऑपरेटरों

- अनुकूलित

- ऑप्शंस

- ऑर्केस्ट्रेटेड

- संगठित

- अन्य

- बाहर

- कुल

- पैकेज

- संकुल

- पैकेजिंग

- भाग

- गुजरता

- पासिंग

- आवेशपूर्ण

- पथ

- प्रदर्शन

- अनुमति

- पाइपलाइन

- योजना

- विमानों

- मंच

- प्लेटो

- प्लेटो डेटा इंटेलिजेंस

- प्लेटोडाटा

- नीतियाँ

- नीति

- पद

- अभ्यास

- भविष्यवाणियों

- पिछला

- प्राथमिकता

- प्रक्रिया

- एस्ट्रो मॉल

- उत्पादन

- परियोजना

- परियोजनाओं

- उचित

- सुरक्षा

- बशर्ते

- प्रदाता

- प्रदान करता है

- प्रकाशित करना

- प्रकाशित

- प्रकाशित करती है

- प्रकाशन

- प्रयोजनों

- योग्य

- रेंज

- वास्तविक समय

- सिफारिश

- घटी

- निर्दिष्ट

- पंजीकृत

- रजिस्ट्री

- रिश्ते

- दूरस्थ

- प्रसिद्ध

- कोष

- का अनुरोध किया

- अनुरोधों

- अपेक्षित

- आवश्यकताएँ

- अनुसंधान

- लचीला

- प्रतिक्रिया

- जिम्मेदार

- परिणाम

- फिर से शिक्षित करना

- पुन: प्रयोज्य

- भूमिकाओं

- रन

- धावक

- sagemaker

- वही

- स्केलेबल

- स्केलिंग

- अनुसूची

- अनुसूचित

- वैज्ञानिक

- वैज्ञानिकों

- दूसरा

- वर्गों

- सेक्टर्स

- सुरक्षा

- वरिष्ठ

- अलग

- serverless

- सर्वर

- सेवा

- सेवाएँ

- सेवारत

- सेट

- व्यवस्था

- छाया

- स्थानांतरण

- चाहिए

- दिखाया

- सरल

- ढीला

- So

- अब तक

- सॉफ्टवेयर

- समाधान

- समाधान ढूंढे

- कुछ

- स्रोत

- स्रोत कोड

- विशेषज्ञ

- विशिष्ट

- विनिर्दिष्ट

- स्पेक्ट्रम

- सुर्ख़ियाँ

- ट्रेनिंग

- चरणों

- मानक

- प्रारंभ

- शुरू होता है

- राज्य

- कदम

- भंडारण

- स्ट्रेटेजी

- स्ट्रीमिंग

- सुवीही

- आगामी

- सफलतापूर्वक

- ऐसा

- समर्थन

- समर्थित

- सतह

- सिस्टम

- टैग

- लेना

- कार्य

- टीम

- टेम्पलेट्स

- terraform

- परीक्षण

- कि

- RSI

- लेकिन हाल ही

- उन

- इसलिये

- इन

- धमकी

- तीन

- यहाँ

- भर

- THROUGHPUT

- पहर

- टाइमस्टैम्प

- सेवा मेरे

- एक साथ

- भी

- साधन

- उपकरण

- ऊपर का

- विषय

- ट्रैक

- ट्रैकिंग

- ट्रेडमार्क

- यातायात

- रेलगाड़ी

- प्रशिक्षित

- प्रशिक्षण

- ट्रिगर

- शुरू हो रहा

- मोड़

- के अंतर्गत

- इकाई

- यूनाइटेड

- संयुक्त राज्य अमेरिका

- अपडेट

- us

- प्रयोग

- उपयोग

- उदाहरण

- उपयोगकर्ता

- उपयोगकर्ताओं

- सत्यापित करें

- सत्यापन

- चर

- विभिन्न

- संस्करण

- वास्तव में

- दृष्टि

- कल्पना

- vmware

- आयतन

- मार्ग..

- कुंआ

- क्या

- या

- कौन कौन से

- चौड़ा

- विस्तृत श्रृंखला

- साथ में

- अंदर

- बिना

- काम

- वर्कफ़्लो

- workflows

- कार्य

- होगा

- जेफिरनेट

- ज़िप

- क्षेत्र