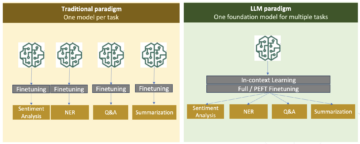

बड़े ध्यान-आधारित ट्रांसफॉर्मर मॉडल ने प्राकृतिक भाषा प्रसंस्करण (एनएलपी) पर भारी लाभ प्राप्त किया है। हालाँकि, इन विशाल नेटवर्क को खरोंच से प्रशिक्षित करने के लिए भारी मात्रा में डेटा और गणना की आवश्यकता होती है। छोटे एनएलपी डेटासेट के लिए, एक सरल लेकिन प्रभावी रणनीति एक पूर्व-प्रशिक्षित ट्रांसफॉर्मर का उपयोग करना है, जिसे आमतौर पर बहुत बड़े डेटासेट पर एक असुरक्षित तरीके से प्रशिक्षित किया जाता है, और इसे रुचि के डेटासेट पर फाइन-ट्यून किया जाता है। गले लगना इन पूर्व-प्रशिक्षित ट्रांसफार्मरों का एक बड़ा मॉडल चिड़ियाघर रखता है और नौसिखिए उपयोगकर्ताओं के लिए भी उन्हें आसानी से सुलभ बनाता है।

हालाँकि, इन मॉडलों को फ़ाइन-ट्यूनिंग के लिए अभी भी विशेषज्ञ ज्ञान की आवश्यकता होती है, क्योंकि वे अपने हाइपरपैरामीटर, जैसे सीखने की दर या बैच आकार के प्रति काफी संवेदनशील होते हैं। इस पोस्ट में, हम दिखाते हैं कि इन हाइपरपैरामीटर को ओपन-सोर्स फ्रेमवर्क के साथ कैसे अनुकूलित किया जाए सिन ट्यून वितरित हाइपरपैरामीटर ऑप्टिमाइज़ेशन (HPO) के लिए। सिन ट्यून हमें एक बेहतर हाइपरपैरामीटर कॉन्फ़िगरेशन खोजने की अनुमति देता है जो लोकप्रिय पर डिफ़ॉल्ट हाइपरपैरामीटर की तुलना में 1-4% के बीच एक सापेक्ष सुधार प्राप्त करता है GLUE बेंचमार्क डेटासेट। पूर्व-प्रशिक्षित मॉडल की पसंद को भी एक हाइपरपैरामीटर माना जा सकता है और इसलिए इसे सिने ट्यून द्वारा स्वचालित रूप से चुना जा सकता है। पाठ वर्गीकरण समस्या पर, यह डिफ़ॉल्ट मॉडल की तुलना में लगभग 5% की सटीकता में अतिरिक्त वृद्धि की ओर जाता है। हालांकि, हम एक उपयोगकर्ता द्वारा किए जाने वाले अधिक निर्णयों को स्वचालित कर सकते हैं; हम इसे हाइपरपैरामीटर के रूप में उदाहरण के प्रकार को भी उजागर करके प्रदर्शित करते हैं जिसका उपयोग हम बाद में मॉडल को परिनियोजित करने के लिए करते हैं। सही इंस्टेंस प्रकार का चयन करके, हम ऐसे कॉन्फ़िगरेशन ढूंढ सकते हैं जो लागत और विलंबता को बेहतर ढंग से व्यापार करते हैं।

सिन ट्यून के परिचय के लिए कृपया देखें Syne Tune के साथ वितरित हाइपरपैरामीटर और तंत्रिका वास्तुकला ट्यूनिंग कार्य चलाएँ.

Syne Tune के साथ हाइपरपैरामीटर अनुकूलन

हम उपयोग करेंगे GLUE बेंचमार्क सूट, जिसमें प्राकृतिक भाषा समझने के कार्यों के लिए नौ डेटासेट होते हैं, जैसे कि टेक्स्टुअल एंटेलमेंट रिकग्निशन या सेंटिमेंट एनालिसिस। उसके लिए, हम हगिंग फेस का अनुकूलन करते हैं run_ग्लू.py प्रशिक्षण स्क्रिप्ट। GLUE डेटासेट लेबल के साथ एक पूर्वनिर्धारित प्रशिक्षण और मूल्यांकन सेट के साथ-साथ बिना लेबल के होल्ड-आउट परीक्षण सेट के साथ आते हैं। इसलिए, हम प्रशिक्षण सेट को प्रशिक्षण और सत्यापन सेट (70%/30% विभाजन) में विभाजित करते हैं और मूल्यांकन सेट को हमारे होल्डआउट परीक्षण डेटासेट के रूप में उपयोग करते हैं। इसके अलावा, हम हगिंग फेस के ट्रेनर एपीआई में एक और कॉलबैक फ़ंक्शन जोड़ते हैं जो प्रत्येक युग के बाद सिन ट्यून पर सत्यापन प्रदर्शन की रिपोर्ट करता है। निम्नलिखित कोड देखें:

हम विशिष्ट प्रशिक्षण हाइपरपैरामीटर के अनुकूलन के साथ शुरू करते हैं: सीखने की दर, सीखने की दर को बढ़ाने के लिए वार्मअप अनुपात, और एक पूर्व-प्रशिक्षित BERT को ठीक करने के लिए बैच का आकार (बर्ट-बेस-केसेड) मॉडल, जो हगिंग फेस उदाहरण में डिफ़ॉल्ट मॉडल है। निम्नलिखित कोड देखें:

हमारी एचपीओ विधि के रूप में, हम उपयोग करते हैं आशा, जो यादृच्छिक रूप से समान रूप से हाइपरपैरामीटर कॉन्फ़िगरेशन का नमूना लेता है और खराब प्रदर्शन करने वाले कॉन्फ़िगरेशन के मूल्यांकन को पुनरावृत्त रूप से रोकता है। यद्यपि अधिक परिष्कृत तरीके उद्देश्य फ़ंक्शन के एक संभाव्य मॉडल का उपयोग करते हैं, जैसे कि BO या MoBster मौजूद है, हम इस पोस्ट के लिए आशा का उपयोग करते हैं क्योंकि यह खोज स्थान पर बिना किसी धारणा के आता है।

निम्नलिखित आंकड़े में, हम हगिंग फेस के डिफ़ॉल्ट हाइपरपैरामीटर कॉन्फ़िगरेशन पर परीक्षण त्रुटि में सापेक्ष सुधार की तुलना करते हैं।

सरलता के लिए, हम तुलना को MRPC, COLA, और STSB तक सीमित करते हैं, लेकिन हम अन्य GLUE डेटासेट के लिए भी इसी तरह के सुधारों को देखते हैं। प्रत्येक डेटासेट के लिए, हम आशा को एक ml.g4dn.xlarge . पर चलाते हैं अमेज़न SageMaker उदाहरण के लिए 1,800 सेकंड के रनटाइम बजट के साथ, जो क्रमशः इन डेटासेट पर लगभग 13, 7, और 9 पूर्ण फ़ंक्शन मूल्यांकन के अनुरूप है। प्रशिक्षण प्रक्रिया की आंतरिक यादृच्छिकता के लिए खाते में, उदाहरण के लिए मिनी-बैच नमूनाकरण के कारण, हम यादृच्छिक संख्या जनरेटर के लिए एक स्वतंत्र बीज के साथ पांच पुनरावृत्तियों के लिए आशा और डिफ़ॉल्ट कॉन्फ़िगरेशन दोनों चलाते हैं और औसत और मानक विचलन की रिपोर्ट करते हैं दोहराव में सापेक्ष सुधार। हम देख सकते हैं कि, सभी डेटासेट में, हम वास्तव में सावधानीपूर्वक चयनित डिफ़ॉल्ट कॉन्फ़िगरेशन के प्रदर्शन के सापेक्ष पूर्वानुमानित प्रदर्शन में 1-3% तक सुधार कर सकते हैं।

पूर्व-प्रशिक्षित मॉडल का चयन स्वचालित करें

हम एचपीओ का उपयोग न केवल हाइपरपैरामीटर खोजने के लिए कर सकते हैं, बल्कि स्वचालित रूप से सही पूर्व-प्रशिक्षित मॉडल का चयन भी कर सकते हैं। हम ऐसा क्यों करना चाहते हैं? चूंकि सभी डेटासेट में कोई भी मॉडल बेहतर प्रदर्शन नहीं करता है, इसलिए हमें किसी विशिष्ट डेटासेट के लिए सही मॉडल का चयन करना होगा। इसे प्रदर्शित करने के लिए, हम हगिंग फेस से लोकप्रिय ट्रांसफॉर्मर मॉडल की एक श्रृंखला का मूल्यांकन करते हैं। प्रत्येक डेटासेट के लिए, हम प्रत्येक मॉडल को उसके परीक्षण प्रदर्शन के आधार पर रैंक करते हैं। डेटासेट में रैंकिंग (निम्न चित्र देखें) बदलती है और एक एकल मॉडल नहीं है जो प्रत्येक डेटासेट पर उच्चतम स्कोर करता है। संदर्भ के रूप में हम निम्नलिखित आंकड़े में प्रत्येक मॉडल और डेटासेट का पूर्ण परीक्षण प्रदर्शन भी दिखाते हैं।

|

|

स्वचालित रूप से सही मॉडल का चयन करने के लिए, हम मॉडल की पसंद को श्रेणीबद्ध मापदंडों के रूप में डाल सकते हैं और इसे अपने हाइपरपैरामीटर खोज स्थान में जोड़ सकते हैं:

हालांकि खोज स्थान अब बड़ा हो गया है, लेकिन इसका मतलब यह नहीं है कि इसे अनुकूलित करना कठिन है। जब हम मूल स्थान (नीली रेखा) में खोज करते हैं (बीईआरटी-आधार-आवरण पूर्व-प्रशिक्षित मॉडल के साथ) समय के साथ आशा के एमआरपीसी डेटासेट पर सर्वोत्तम अवलोकन किए गए कॉन्फ़िगरेशन (सत्यापन त्रुटि के आधार पर) की परीक्षण त्रुटि को निम्न आंकड़ा दिखाता है ) या नए संवर्धित खोज स्थान (नारंगी रेखा) में। उसी बजट को देखते हुए, आशा छोटी जगह की तुलना में विस्तारित खोज स्थान में बेहतर प्रदर्शन करने वाले हाइपरपैरामीटर कॉन्फ़िगरेशन को खोजने में सक्षम है।

इंस्टेंस प्रकार का चयन स्वचालित करें

व्यवहार में, हम केवल भविष्य कहनेवाला प्रदर्शन को अनुकूलित करने की परवाह नहीं कर सकते। हम अन्य उद्देश्यों की भी परवाह कर सकते हैं, जैसे प्रशिक्षण समय, (डॉलर) लागत, विलंबता, या निष्पक्षता मीट्रिक। हमें मॉडल के हाइपरपैरामीटर के अलावा अन्य विकल्प भी बनाने होंगे, उदाहरण के लिए इंस्टेंस प्रकार का चयन करना।

हालांकि इंस्टेंस प्रकार भविष्य कहनेवाला प्रदर्शन को प्रभावित नहीं करता है, यह (डॉलर) लागत, प्रशिक्षण रनटाइम और विलंबता को दृढ़ता से प्रभावित करता है। जब मॉडल तैनात किया जाता है तो उत्तरार्द्ध विशेष रूप से महत्वपूर्ण हो जाता है। हम एचपीओ को एक बहुउद्देश्यीय अनुकूलन समस्या के रूप में परिभाषित कर सकते हैं, जहां हम एक साथ कई उद्देश्यों को अनुकूलित करने का लक्ष्य रखते हैं। हालांकि, कोई भी एकल समाधान एक ही समय में सभी मीट्रिक का अनुकूलन नहीं करता है। इसके बजाय, हमारा लक्ष्य ऐसे विन्यासों का एक सेट खोजना है जो एक उद्देश्य बनाम दूसरे उद्देश्य को बेहतर ढंग से व्यापार करते हैं। इसे कहा जाता है परेतो सेट.

इस सेटिंग का और अधिक विश्लेषण करने के लिए, हम अपने खोज स्थान में एक अतिरिक्त श्रेणीबद्ध हाइपरपैरामीटर के रूप में इंस्टेंस प्रकार की पसंद को जोड़ते हैं:

हम का उपयोग करें मो-आशा, जो गैर-प्रधान छँटाई का उपयोग करके आशा को बहु-उद्देश्यीय परिदृश्य के अनुकूल बनाता है। प्रत्येक पुनरावृत्ति में, MO-ASHA प्रत्येक कॉन्फ़िगरेशन के लिए भी चयन करता है, जिस प्रकार का उदाहरण हम इसका मूल्यांकन करना चाहते हैं। एचपीओ को उदाहरणों के विषम सेट पर चलाने के लिए, सिन ट्यून सेजमेकर बैकएंड प्रदान करता है। इस बैकएंड के साथ, प्रत्येक परीक्षण का मूल्यांकन अपने स्वयं के उदाहरण पर एक स्वतंत्र सेजमेकर प्रशिक्षण कार्य के रूप में किया जाता है। श्रमिकों की संख्या परिभाषित करती है कि हम एक निश्चित समय में कितनी सेजमेकर नौकरियां समानांतर में चलाते हैं। हमारे मामले में ऑप्टिमाइज़र, MO-ASHA, या तो स्थानीय मशीन पर चलता है, एक सेजमेकर नोटबुक या एक अलग सेजमेकर प्रशिक्षण कार्य पर। निम्नलिखित कोड देखें:

निम्नलिखित आंकड़े चार श्रमिकों पर 10,800 सेकंड के लिए चलाने के बाद एमआरपीसी डेटासेट पर एमओ-आशा (हम दृश्यता के लिए अक्ष को सीमित करते हैं) द्वारा नमूना किए गए यादृच्छिक विन्यास के लिए बाईं ओर विलंबता बनाम परीक्षण त्रुटि और विलंबता बनाम लागत दिखाते हैं। रंग उदाहरण प्रकार को इंगित करता है। धराशायी काली रेखा पारेतो सेट का प्रतिनिधित्व करती है, जिसका अर्थ है कि कम से कम एक उद्देश्य में अन्य सभी बिंदुओं पर हावी होने वाले बिंदुओं का समूह।

|

|

हम विलंबता और परीक्षण त्रुटि के बीच एक ट्रेड-ऑफ देख सकते हैं, जिसका अर्थ है कि सबसे कम परीक्षण त्रुटि के साथ सबसे अच्छा कॉन्फ़िगरेशन न्यूनतम विलंबता प्राप्त नहीं करता है। अपनी पसंद के आधार पर, आप एक हाइपरपैरामीटर कॉन्फ़िगरेशन का चयन कर सकते हैं जो परीक्षण प्रदर्शन पर बलिदान देता है लेकिन एक छोटी विलंबता के साथ आता है। हम विलंबता और लागत के बीच व्यापार बंद भी देखते हैं। उदाहरण के लिए, एक छोटे ml.g4dn.xlarge इंस्टेंस का उपयोग करके, हम केवल विलंबता को मामूली रूप से बढ़ाते हैं, लेकिन ml.g4dn.8xबड़े इंस्टेंस की लागत का एक चौथाई भुगतान करते हैं।

निष्कर्ष

इस पोस्ट में, हमने सिने ट्यून पर आधारित हगिंग फेस से पूर्व-प्रशिक्षित ट्रांसफॉर्मर मॉडल को फाइन-ट्यूनिंग के लिए हाइपरपैरामीटर ऑप्टिमाइज़ेशन पर चर्चा की। हमने देखा कि सीखने की दर, बैच आकार और वार्म-अप अनुपात जैसे हाइपरपैरामीटर को अनुकूलित करके, हम सावधानीपूर्वक चुने गए डिफ़ॉल्ट कॉन्फ़िगरेशन में सुधार कर सकते हैं। हम हाइपरपैरामीटर ऑप्टिमाइज़ेशन के माध्यम से पूर्व-प्रशिक्षित मॉडल को स्वचालित रूप से चुनकर भी इसे बढ़ा सकते हैं।

सिने ट्यून के सेजमेकर बैकएंड की मदद से, हम इंस्टेंस प्रकार को हाइपरपैरामीटर के रूप में मान सकते हैं। हालांकि इंस्टेंस प्रकार प्रदर्शन को प्रभावित नहीं करता है, लेकिन विलंबता और लागत पर इसका महत्वपूर्ण प्रभाव पड़ता है। इसलिए, एचपीओ को एक बहु-उद्देश्य अनुकूलन समस्या के रूप में कास्टिंग करके, हम कॉन्फ़िगरेशन का एक सेट ढूंढने में सक्षम हैं जो एक उद्देश्य बनाम दूसरे को बेहतर तरीके से व्यापार करता है। यदि आप इसे स्वयं आज़माना चाहते हैं, तो हमारी जाँच करें उदाहरण नोटबुक.

लेखक के बारे में

आरोन क्लेन एडब्ल्यूएस में एप्लाइड साइंटिस्ट हैं।

आरोन क्लेन एडब्ल्यूएस में एप्लाइड साइंटिस्ट हैं।

मथायस सीगर एडब्ल्यूएस में प्रिंसिपल एप्लाइड साइंटिस्ट हैं।

मथायस सीगर एडब्ल्यूएस में प्रिंसिपल एप्लाइड साइंटिस्ट हैं।

डेविड सेलिनास एडब्ल्यूएस में सीनियर एप्लाइड साइंटिस्ट हैं।

डेविड सेलिनास एडब्ल्यूएस में सीनियर एप्लाइड साइंटिस्ट हैं।

एमिली वेबर सेजमेकर के लॉन्च होने के ठीक बाद एडब्ल्यूएस में शामिल हुआ, और तब से दुनिया को इसके बारे में बताने की कोशिश कर रहा है! ग्राहकों के लिए नए एमएल अनुभवों के निर्माण के अलावा, एमिली को तिब्बती बौद्ध धर्म का ध्यान और अध्ययन करना पसंद है।

एमिली वेबर सेजमेकर के लॉन्च होने के ठीक बाद एडब्ल्यूएस में शामिल हुआ, और तब से दुनिया को इसके बारे में बताने की कोशिश कर रहा है! ग्राहकों के लिए नए एमएल अनुभवों के निर्माण के अलावा, एमिली को तिब्बती बौद्ध धर्म का ध्यान और अध्ययन करना पसंद है।

सेड्रिक आर्कमब्यू एडब्ल्यूएस में प्रिंसिपल एप्लाइड साइंटिस्ट और लर्निंग एंड इंटेलिजेंट सिस्टम के लिए यूरोपीय लैब के फेलो हैं।

सेड्रिक आर्कमब्यू एडब्ल्यूएस में प्रिंसिपल एप्लाइड साइंटिस्ट और लर्निंग एंड इंटेलिजेंट सिस्टम के लिए यूरोपीय लैब के फेलो हैं।

- कॉइनस्मार्ट। यूरोप का सर्वश्रेष्ठ बिटकॉइन और क्रिप्टो एक्सचेंज।

- प्लेटोब्लॉकचैन। Web3 मेटावर्स इंटेलिजेंस। ज्ञान प्रवर्धित। नि: शुल्क प्रवेश।

- क्रिप्टोहॉक। Altcoin रडार। मुफ्त परीक्षण।

- स्रोत: https://aws.amazon.com/blogs/machine-learning/hyperparameter-optimization-for-fine-tuning-pre-trained-transformer-models-from-hugging-face/

- "

- 10

- 100

- 7

- 9

- a

- About

- पूर्ण

- सुलभ

- लेखा

- पाना

- के पार

- अतिरिक्त

- को प्रभावित

- सब

- की अनुमति देता है

- हालांकि

- वीरांगना

- राशि

- विश्लेषण

- विश्लेषण करें

- अन्य

- एपीआई

- लागू

- लगभग

- स्थापत्य

- संवर्धित

- को स्वचालित रूप से

- स्वतः

- औसत

- एडब्ल्यूएस

- अक्ष

- क्योंकि

- बेंचमार्क

- BEST

- बेहतर

- के बीच

- परे

- काली

- पिन

- बढ़ावा

- बजट

- इमारत

- कौन

- मामला

- के कारण होता

- चुनाव

- विकल्प

- करने के लिए चुना

- कक्षा

- वर्गीकरण

- कोड

- कैसे

- तुलना

- गणना करना

- विन्यास

- नियंत्रण

- ग्राहक

- तिथि

- निर्णय

- दिखाना

- तैनात

- तैनात

- वितरित

- नहीं करता है

- डॉलर

- से प्रत्येक

- आसानी

- प्रभावी

- यूरोपीय

- मूल्यांकन करें

- मूल्यांकन

- उदाहरण

- अनुभव

- विशेषज्ञ

- विस्तार

- चेहरा

- फैशन

- आकृति

- निम्नलिखित

- ढांचा

- से

- पूर्ण

- समारोह

- आगे

- और भी

- जनक

- मदद

- यहाँ उत्पन्न करें

- कैसे

- How To

- तथापि

- HTTPS

- प्रभाव

- महत्वपूर्ण

- में सुधार

- सुधार

- बढ़ना

- स्वतंत्र

- प्रभाव

- उदाहरण

- बुद्धिमान

- ब्याज

- IT

- खुद

- काम

- नौकरियां

- में शामिल हो गए

- ज्ञान

- प्रयोगशाला

- लेबल

- भाषा

- बड़ा

- बड़ा

- शुभारंभ

- बिक्रीसूत्र

- सीख रहा हूँ

- सीमा

- लाइन

- स्थानीय

- मशीन

- बनाना

- बनाता है

- विशाल

- अर्थ

- तरीकों

- मेट्रिक्स

- हो सकता है

- ML

- आदर्श

- मॉडल

- अधिक

- विभिन्न

- प्राकृतिक

- अनिवार्य रूप से

- की जरूरत है

- नेटवर्क

- नोटबुक

- संख्या

- उद्देश्य

- प्राप्त

- इष्टतमीकरण

- ऑप्टिमाइज़ करें

- के अनुकूलन के

- मूल

- अन्य

- अपना

- विशेष रूप से

- वेतन

- प्रदर्शन

- प्रदर्शन

- कृप्या अ

- अंक

- लोकप्रिय

- अभ्यास

- प्रिंसिपल

- मुसीबत

- प्रक्रिया

- प्रसंस्करण

- प्रदान करता है

- रेंज

- रैंकिंग

- रिपोर्ट

- रिपोर्टर

- रिपोर्ट

- का प्रतिनिधित्व करता है

- की आवश्यकता होती है

- परिणाम

- रन

- दौड़ना

- वही

- वैज्ञानिक

- Search

- सेकंड

- बीज

- चयनित

- भावुकता

- सेट

- की स्थापना

- दिखाना

- महत्वपूर्ण

- समान

- सरल

- एक

- आकार

- समाधान

- परिष्कृत

- अंतरिक्ष

- विशिष्ट

- विभाजित

- मानक

- प्रारंभ

- राज्य

- फिर भी

- स्ट्रेटेजी

- सिस्टम

- कार्य

- परीक्षण

- RSI

- दुनिया

- इसलिये

- पहर

- व्यापार

- प्रशिक्षण

- उपचार

- भयानक

- परीक्षण

- समझ

- us

- उपयोग

- उपयोगकर्ताओं

- आमतौर पर

- उपयोग

- सत्यापन

- दृश्यता

- विकिपीडिया

- बिना

- श्रमिकों

- विश्व

- आपका