A kép szerzője

Az XAI egy mesterséges intelligencia, amely lehetővé teszi az emberek számára, hogy megértsék a modell vagy rendszer eredményeit és döntéshozatali folyamatait.

A modellezés előtti magyarázhatóság

A megmagyarázható mesterséges intelligencia magyarázható adatokkal és világos, értelmezhető funkciók tervezésével kezdődik.

Modellezés magyarázhatósága

Egy adott probléma modelljének kiválasztásakor általában a legjobb, ha azt a leginkább értelmezhető modellt használjuk, amely még mindig jó prediktív eredményeket ér el.

A modell utáni magyarázhatóság

Ez magában foglalja az olyan technikákat, mint a perturbáció, ahol egyetlen változó megváltoztatásának a modell kimenetére gyakorolt hatását elemzik, például a betanítás utáni SHAP értékeket.

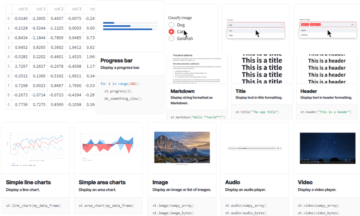

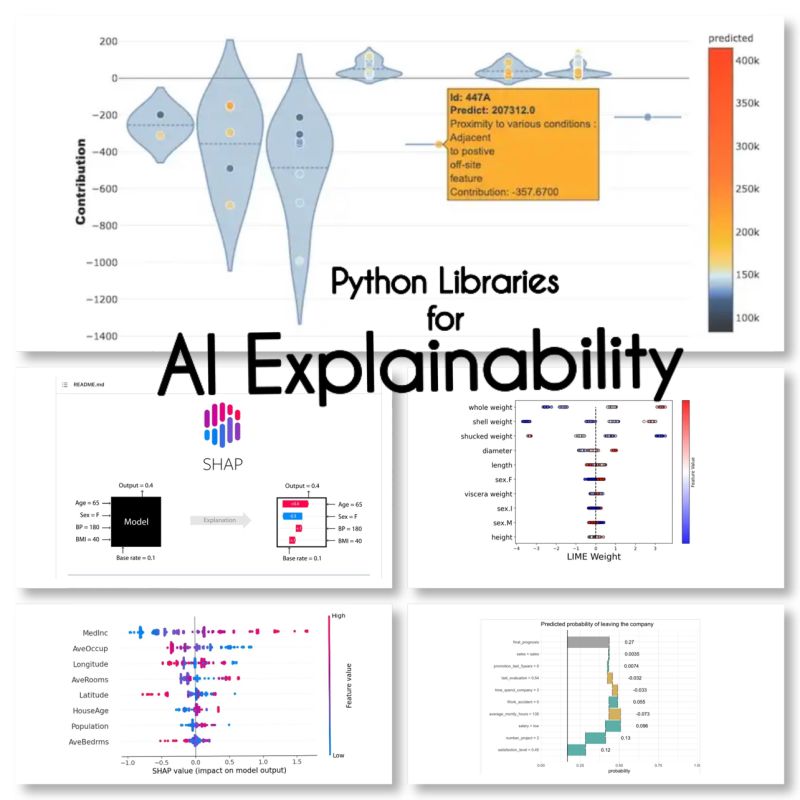

Ezt a 10 Python-könyvtárat találtam az AI magyarázhatósága érdekében:

SHAP (SHapley Additive ExPlanations)

A SHAP egy modell agnosztikus, és úgy működik, hogy lebontja az egyes jellemzők hozzájárulását, és minden egyes funkcióhoz pontszámot rendel.

LIME (helyi értelmezhető modell-agnosztikus magyarázatok)

A LIME egy másik modell-agnosztikus módszer, amely úgy működik, hogy közelíti a modell viselkedését egy adott előrejelzés körül.

ELi5

Az Eli5 egy könyvtár az osztályozók hibakereséséhez és magyarázatához. Funkciók fontossági pontszámait, valamint „okkódokat” biztosít a scikit-learn, Keras, xgboost, LightGBM és CatBoost számára.

Shapash

A Shapash egy Python könyvtár, amelynek célja, hogy a gépi tanulást mindenki számára értelmezhetővé és érthetővé tegye. A Shapash többféle vizualizációt biztosít explicit címkékkel.

Horgonyok

A horgonyok egy olyan ember által értelmezhető szabályok generálására szolgáló módszer, amelyek segítségével megmagyarázhatók a gépi tanulási modell előrejelzései.

XAI (magyarázható AI)

Az XAI egy könyvtár a gépi tanulási modellek előrejelzéseinek magyarázatára és megjelenítésére, beleértve a funkciók fontossági pontszámait.

Bontás

A BreakDown egy olyan eszköz, amely a lineáris modellek előrejelzéseinek magyarázatára használható. Úgy működik, hogy a modell kimenetét az egyes bemeneti jellemzők hozzájárulására bontja.

értelmez-szöveg

Az interpret-text egy könyvtár a természetes nyelvi feldolgozási modellek előrejelzéseinek magyarázatára.

iml (Interpretable Machine Learning)

Az iml jelenleg a Shap projekt felületét és IO kódját tartalmazza, és potenciálisan ugyanezt fogja tenni a Lime projekt esetében is.

aix360 (AI Explainability 360)

Az aix360 algoritmusok átfogó készletét tartalmazza, amelyek különböző dimenziókat fednek le

OmniXAI

Az OmniXAI (az Omni eXplainable AI rövidítése) számos problémát kezel a gépi tanulási modellek által létrehozott ítéletek értelmezésével a gyakorlatban.

Elfelejtettem valamelyik könyvtárat?

Források

Maryam Miradi egy mesterséges intelligencia és adattudományi vezető, a gépi tanulás és a mély tanulás területén szerzett PhD fokozattal, az NLP és a számítógépes látás területén. Több mint 15 éves tapasztalattal rendelkezik sikeres mesterségesintelligencia-megoldások létrehozásában, több mint 40 sikeres projekt megvalósításában. 12 különböző szervezetnél dolgozott különböző iparágakban, beleértve a pénzügyi bűnözés felderítését, az energiát, a banki tevékenységet, a kiskereskedelmet, az e-kereskedelmet és a kormányzatot.

- SEO által támogatott tartalom és PR terjesztés. Erősödjön még ma.

- Platoblockchain. Web3 metaverzum intelligencia. Felerősített tudás. Hozzáférés itt.

- Forrás: https://www.kdnuggets.com/2023/01/explainable-ai-10-python-libraries-demystifying-decisions.html?utm_source=rss&utm_medium=rss&utm_campaign=explainable-ai-10-python-libraries-for-demystifying-your-models-decisions

- 10

- a

- címek

- Után

- AI

- célok

- algoritmusok

- lehetővé teszi, hogy

- és a

- Másik

- körül

- mesterséges

- mesterséges intelligencia

- Banking

- BEST

- Törés

- változó

- választja

- világos

- kód

- átfogó

- számítógép

- Számítógépes látás

- tartalmaz

- hozzájárulás

- terjed

- létrehozása

- Bűncselekmény

- Jelenleg

- dátum

- adat-tudomány

- Döntéshozatal

- határozatok

- mély

- mély tanulás

- átadó

- különböző

- le-

- e-commerce

- minden

- hatás

- energia

- Mérnöki

- mindenki

- tapasztalat

- Magyarázza

- Magyarázatosság

- Megmagyarázható AI

- magyarázó

- Funkció

- pénzügyi

- pénzügyi-bűnözés

- elfelejtett

- talált

- ból ből

- általában

- generáló

- jó

- Kormány

- HTTPS

- Az emberek

- fontosság

- in

- magában foglalja a

- Beleértve

- iparágak

- bemenet

- Intelligencia

- Felület

- IT

- értékelések

- KDnuggets

- keras

- Címkék

- nyelv

- vezet

- tanulás

- könyvtárak

- könyvtár

- Mész

- helyi

- helyileg

- gép

- gépi tanulás

- csinál

- módszer

- modell

- modellek

- a legtöbb

- Természetes

- Természetes nyelv

- Természetes nyelvi feldolgozás

- NLP

- Omni

- szervezetek

- különös

- Plató

- Platón adatintelligencia

- PlatoData

- potenciálisan

- gyakorlat

- előrejelzés

- Tippek

- Probléma

- problémák

- Folyamatok

- feldolgozás

- Készült

- program

- projektek

- biztosít

- Piton

- ok

- rekord

- Eredmények

- kiskereskedelem

- szabályok

- azonos

- Tudomány

- scikit elsajátítható

- készlet

- számos

- rövid

- egyetlen

- Megoldások

- specializált

- különleges

- kezdődik

- Még mindig

- sikeres

- ilyen

- rendszer

- technikák

- A

- nak nek

- szerszám

- vágány

- Képzések

- típusok

- megért

- érthető

- használ

- Értékek

- fajta

- látomás

- megjelenítés

- ami

- lesz

- dolgozott

- művek

- XGBoost

- év

- A te

- zephyrnet