Megjegyzés Idén eddig több mint 250 tömeges lövöldözés történt az Egyesült Államokban, és az AI-védők úgy gondolják, hogy megvan a megoldás. Nem fegyvervezérlés, hanem jobb technológia, nem meglepő módon.

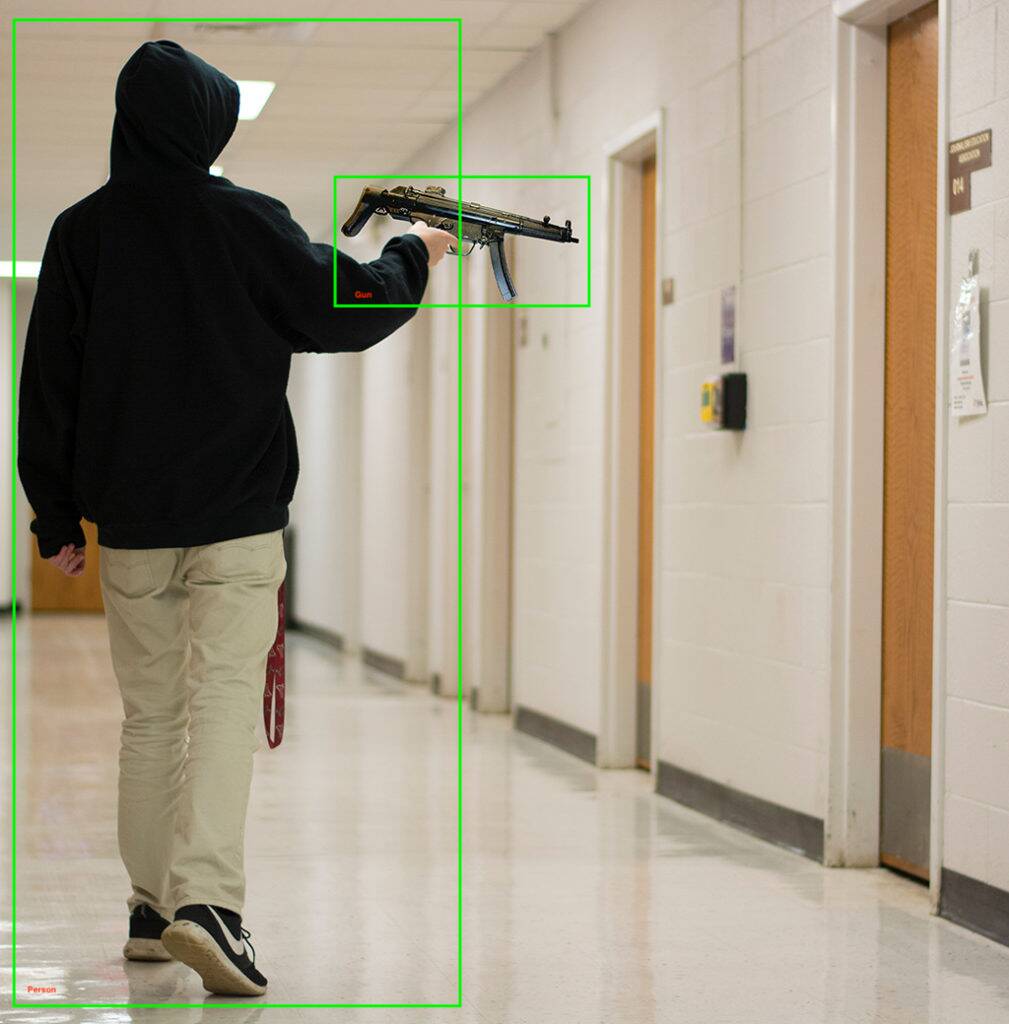

A Kogniz gépi tanulási biznisz kedden bejelentette, hogy beépítésre kész elemet ad hozzá fegyverészlelő modell számítógépes látás platformjára. Úgy tudjuk, a rendszer képes észlelni a biztonsági kamerák által látott fegyvereket, és értesítéseket küldeni a veszélyben lévőknek, értesíti a rendőrséget, bezárja az épületeket és más biztonsági feladatokat lát el.

A lőfegyverek észlelése mellett a Kogniz más számítógépes látásmoduljait is használja a szokatlan viselkedés észlelésére, például a gyerekek száguldozására a folyosókon vagy valaki bemászásra az ablakon, ami aktív lövöldözésre utalhat.

Ha kíváncsi a kód hamis pozitívságára vagy hibaarányára, a Kogniz azt mondja, hogy rendelkezik egy „többmenetes AI-vel” és „egy képzett emberi hitelesítő csapattal”, amely ellenőrzi az észlelőszoftver eredményeit. Vagy üdvözli ezt az extra szintű megerősítést, vagy úgy tekint rá, mint a technológiára, amely éppen akkor esik vissza az emberekre, amikor a számítógépekre a legnagyobb szükség van.

„[A mi megoldásunk] drámai módon megkönnyíti a vállalatok, kormányzati szervek, iskolák és kórházak felkészülését egy aktív lövöldözős eseményre, majd segít csökkenteni az általuk okozott károkat” – mondta Daniel Putterman, a Kogniz vezérigazgatója.

A Kogniz nem az első számítógépes látással foglalkozó cég, amely belevág a fegyverfelismerő játékba – jelentős lista létezik a hasonló technológiát alkalmazó cégekről, és néhányan, például a ZeroEyes-en kívül másra specializálódtak, mint a lőfegyverek észlelésére.

„Azáltal, hogy figyelmüket több ajánlatra osztják, a fejlesztők kevésbé tudják a legjobb fegyverfelderítési szolgáltatást nyújtani” – mondta a ZeroEyes. blogbejegyzés. A ZeroEyes technológiáját 14 állam iskoláiban alkalmazzák, köztük Oxford Középiskola a detroiti metróban, ahol tavaly egy 15 éves lövöldöző négyet megölt és hetet megsebesített.

Más gyártók – például a Defendry, amely rendelkezik egy biztonsági csomaggal, beleértve a pánikgomb-alkalmazást, az audio lövésérzékelőket, az elsőre reagáló drónokat és a fegyverészlelő AI-t; és az Omnilert – ezen a nyomasztóan növekvő piacon vannak. A mesterséges intelligencia-fegyverészlelés területén további cégek az Arcarith, az Athena Securities és a Scylla.

Tényleg van elég idő?

2019-ben az ohiói Daytonban történt tömeges lövöldözésre a rendőrség mindössze 32 másodpercig reagált, ezalatt kilenc ember meghalt. Az Indianapolis FedEx egyik létesítményében 2021-ben lezajlott lövöldözés, amelyben kilenc ember vesztette életét, szintén véget ért, mielőtt a zsaruk megérkezhettek volna, jóllehet percek alatt meg is tették.

Mindkét eset felveti a kérdést, hogy az AI fegyverészlelés képes-e eléggé lecsökkenteni a reakcióidőt ahhoz, hogy életeket mentsen. Különösen akkor, ha a tisztek túlságosan félnek, vagy úgy döntenek, hogy nem válaszolnak, például az uvaldei tömeggyilkosságnál.

Számos más mesterséges intelligencia alapú tömeges lövöldözés megelőzési módszert javasoltak, mint pl okos fegyverek nem fog tüzelni, ha emberi célpontot észlelnek. Mások mesterséges intelligencia képzését javasolták a múltbeli lövöldözések adataira, a helyi fegyvervásárlásokra és a társadalmi-gazdasági adatokra, hogy megtalálják a tervezett lövöldözésre utaló trendeket, valamint a közösségi médiában is keressenek hasonló mutatókat.

Van is AI torzításEgy jól dokumentált probléma hogy akár változatos adathalmazok és kiegyensúlyozott képzés nem lehet megoldani. Vegyük az arc- és fegyverfelismerő technológia 2020-as bevezetését egy New York-i iskolai körzetben: az iskolai körzet és a rendszert telepítő cég közötti e-mailek gyakran aggodalmakra utalnak. téves azonosítás dolgok, például seprűnyél fegyverekhez.

Jay Stanley, az ACLU vezető politikai elemzője a utahi Deseret News kiadványnak nyilatkozott mondott aggodalmát fejezte ki amiatt, hogy a számítógépes látórendszerek egy olyan világhoz vezethetnek, „ahol az emberek nem tesznek olyan egyszerű dolgokat, mint a járdán való kiugrás, mert félnek attól, hogy az anomália érzékelőit működésbe hozza, és a rendőrség kihallgatja őket”.

A mesterséges intelligencia egyik lehetséges felhasználása azonban ígéretesebb lehet: egy 2018 tanulmány A Cincinnati Children's Hospital Medical Center munkatársa azt találta, hogy a terápiás foglalkozások mesterséges intelligencia elemzése az esetek 91 százalékában megegyezett a pszichiáterek és tanácsadók veszélyértékelésével. A demográfiai és társadalmi-gazdasági adatok hozzáadása csak javította az erőszakos cselekmény elkövetésének kockázatának kitett fiatalok azonosítását.

A sok lehetséges komplikáció mellett valóban készen áll a gépi tanulás a tömeggyilkosságok megelőzésére?

A fegyveres erőszak az első számú gyilkos Amerikában átlagosan 12 fiatal életet követelnek, és további 32-t megsebesítenek minden nap. Az AI segíthet, de hiányosságainak kezelése nélkül talán kevesebb technológiai megközelítésre is szükség lenne. Az erősebb, szélesebb körben elérhető mentális egészségügyi ellátás jó kezdet lehet.

A hónap elején Biden elnök hívott többek között a támadófegyver-tilalom, a kiterjesztett háttérellenőrzés és a tárkapacitás korlátozása miatt, amelyeket „racionális, józan ész” intézkedéseknek nevezett. ®

- AI

- ai művészet

- ai art generátor

- van egy robotod

- mesterséges intelligencia

- mesterséges intelligencia tanúsítás

- mesterséges intelligencia a bankszektorban

- mesterséges intelligencia robot

- mesterséges intelligencia robotok

- mesterséges intelligencia szoftver

- blockchain

- blokklánc konferencia ai

- coingenius

- társalgási mesterséges intelligencia

- kriptokonferencia ai

- dall's

- mély tanulás

- google azt

- gépi tanulás

- Plató

- plato ai

- Platón adatintelligencia

- Platón játék

- PlatoData

- platogaming

- skála ai

- szintaxis

- A regisztráció

- zephyrnet