Saat ini, ratusan ribu pelanggan menggunakan data lake untuk analitik dan pembelajaran mesin. Namun, insinyur data harus membersihkan dan menyiapkan data ini sebelum dapat digunakan. Data dasar harus akurat dan terbaru agar pelanggan dapat membuat keputusan bisnis yang meyakinkan. Jika tidak, konsumen data kehilangan kepercayaan pada data dan membuat keputusan yang kurang optimal atau salah. Merupakan tugas umum bagi para insinyur data untuk mengevaluasi apakah data tersebut akurat dan terkini atau tidak. Saat ini ada berbagai alat kualitas data. Namun, alat kualitas data umum biasanya memerlukan proses manual untuk memantau kualitas data.

Kualitas Data AWS Glue adalah fitur pratinjau dari Lem AWS yang mengukur dan memantau kualitas data Layanan Penyimpanan Sederhana Amazon (Amazon S3) data lake dan di AWS Glue mengekstrak, mengubah, dan memuat (ETL) tugas. Ini adalah fitur pratinjau terbuka sehingga sudah diaktifkan di akun Anda di Wilayah yang tersedia. Anda dapat dengan mudah menentukan dan mengukur pemeriksaan kualitas data di konsol AWS Glue Studio tanpa menulis kode. Ini menyederhanakan pengalaman Anda dalam mengelola kualitas data.

Postingan ini adalah Bagian 2 dari rangkaian empat postingan untuk menjelaskan cara kerja Kualitas Data AWS Glue. Lihat posting sebelumnya di seri ini:

Dalam postingan ini, kami menunjukkan cara membuat tugas AWS Glue yang mengukur dan memantau kualitas data dari pipa data. Kami juga menunjukkan cara mengambil tindakan berdasarkan hasil kualitas data.

Ikhtisar solusi

Mari pertimbangkan contoh kasus penggunaan di mana seorang insinyur data perlu membangun pipa data untuk menyerap data dari zona mentah ke zona yang dikurasi di data lake. Sebagai seorang insinyur data, salah satu tanggung jawab utama Anda—selain mengekstraksi, mengubah, dan memuat data—adalah memvalidasi kualitas data. Mengidentifikasi masalah kualitas data di awal membantu Anda mencegah penempatan data yang buruk di zona pilihan dan menghindari insiden kerusakan data yang berat.

Dalam posting ini, Anda akan belajar cara mengatur dengan mudah built-in dan adat pemeriksaan validasi data dalam pekerjaan AWS Glue Anda untuk mencegah data buruk merusak data berkualitas tinggi hilir.

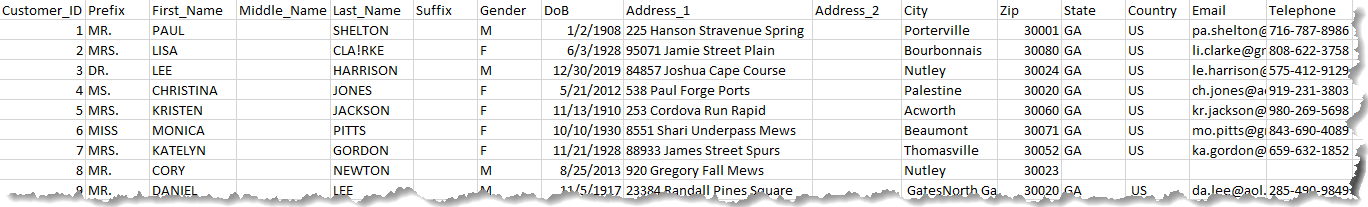

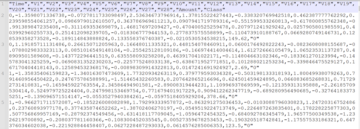

Kumpulan data yang digunakan untuk posting ini dihasilkan secara sintetis; tangkapan layar berikut menunjukkan contoh data.

Siapkan sumber daya dengan AWS CloudFormation

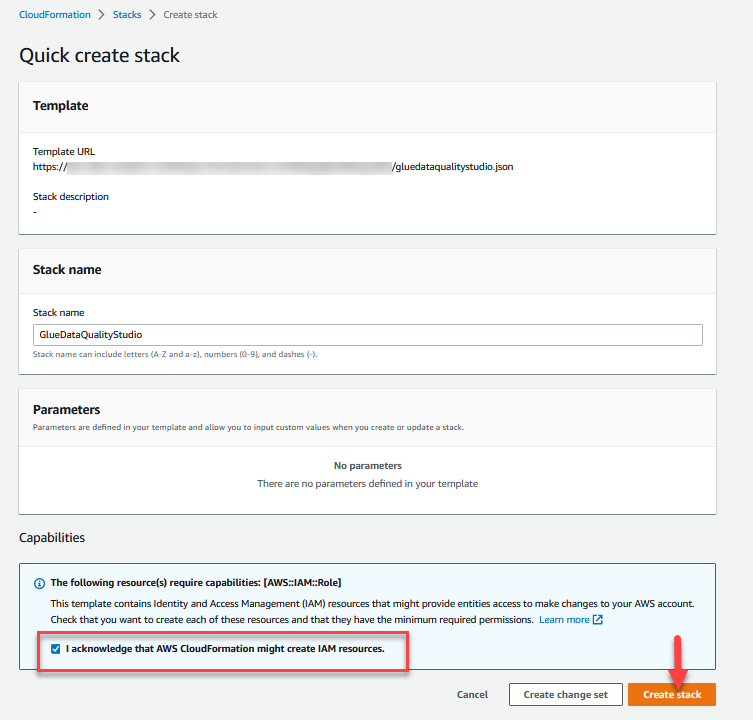

Postingan ini berisi sebuah Formasi AWS Cloud template untuk pengaturan cepat. Anda dapat meninjau dan menyesuaikannya sesuai dengan kebutuhan Anda.

Template CloudFormation menghasilkan sumber daya berikut:

- Bucket Amazon Simple Storage Service (Amazon S3) (

gluedataqualitystudio-*). - Prefiks dan objek berikut dalam bucket S3:

datalake/raw/customer/customer.csvdatalake/curated/customer/scripts/sparkHistoryLogs/temporary/

- Identitas AWS dan Manajemen Akses (IAM) pengguna, peran, dan kebijakan. Peran IAM (

GlueDataQualityStudio-*) memiliki izin untuk membaca dan menulis dari bucket S3. - AWS Lambda fungsi dan kebijakan IAM yang diperlukan oleh fungsi tersebut untuk membuat dan menghapus tumpukan ini.

Untuk membuat sumber daya Anda, selesaikan langkah-langkah berikut:

- Masuk ke Konsol AWS CloudFormation dalam

us-east-1Wilayah. - Pilih Luncurkan Stack:

- Pilih Saya mengakui bahwa AWS CloudFormation dapat menciptakan sumber daya IAM.

- Pilih Buat tumpukan dan tunggu langkah pembuatan tumpukan selesai.

Terapkan solusinya

Untuk mulai mengonfigurasi solusi Anda, selesaikan langkah-langkah berikut:

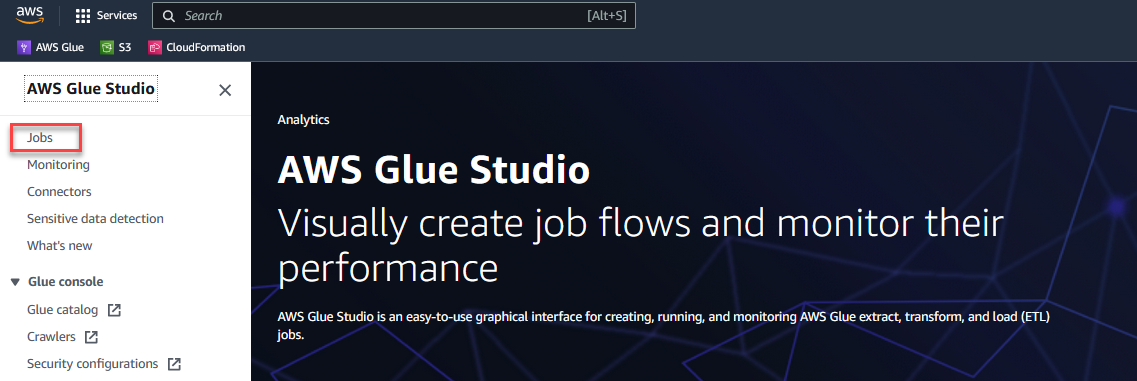

- pada Konsol AWS Glue Studio, pilih Jobs di panel navigasi.

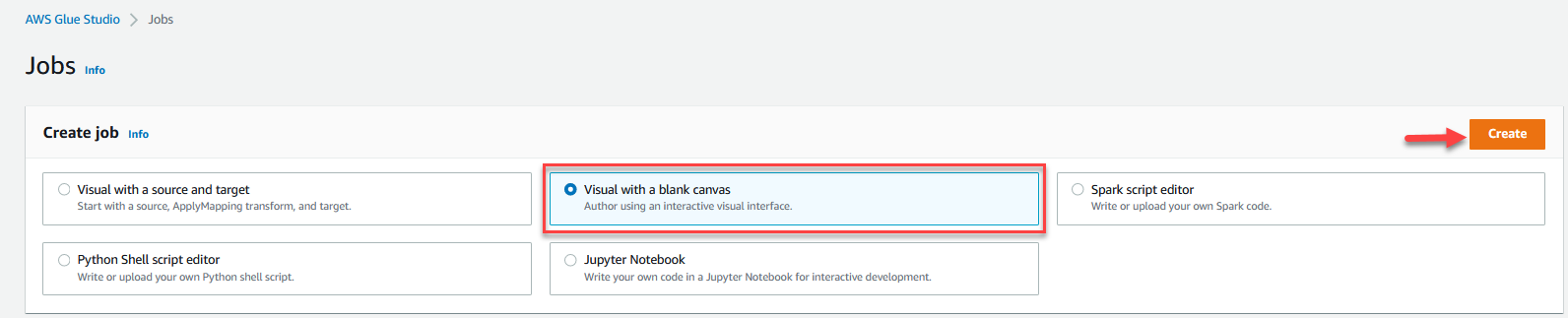

- Pilih Visual dengan kanvas kosong Dan pilihlah membuat.

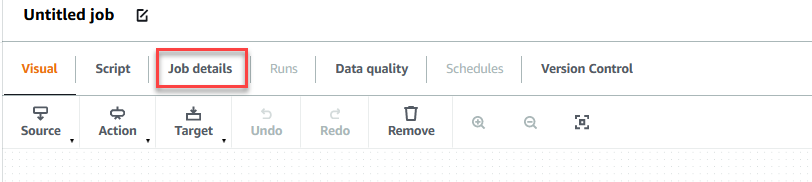

- Pilih rincian pekerjaan tab untuk mengonfigurasi pekerjaan.

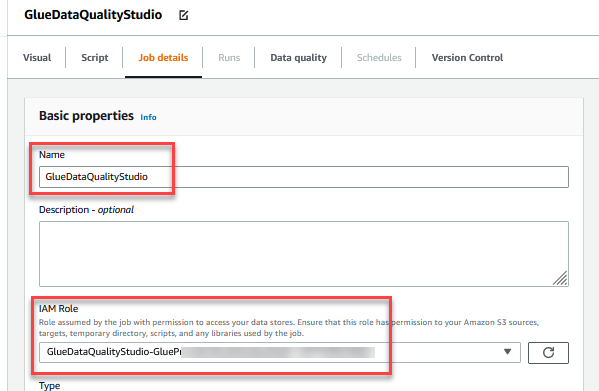

- Untuk Nama, Masuk

GlueDataQualityStudio. - Untuk Peran IAM, pilih peran yang dimulai dengan

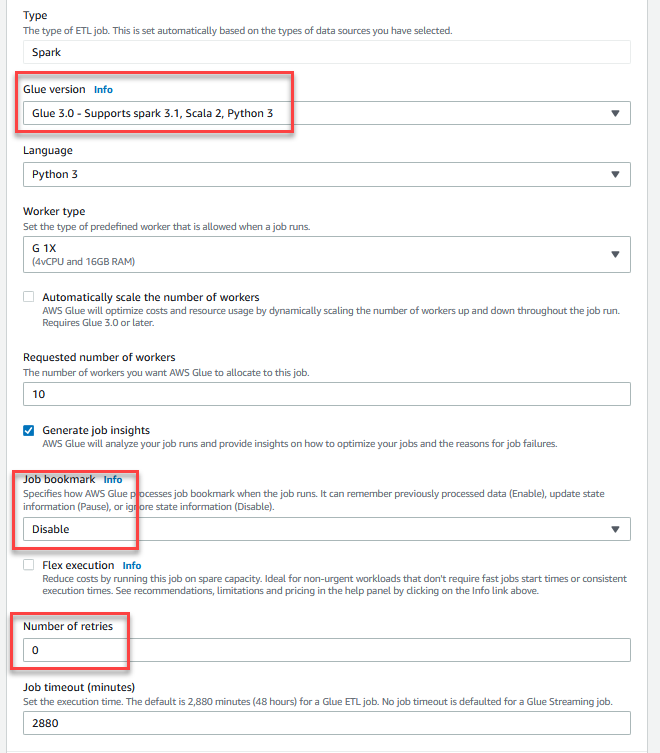

GlueDataQualityStudio-*. - Untuk Versi lem, pilih Lem 3.0.

- Untuk Penanda pekerjaan, pilih Disable. Ini memungkinkan Anda menjalankan tugas ini beberapa kali dengan kumpulan data masukan yang sama.

- Untuk Jumlah percobaan ulang, Masuk

0.

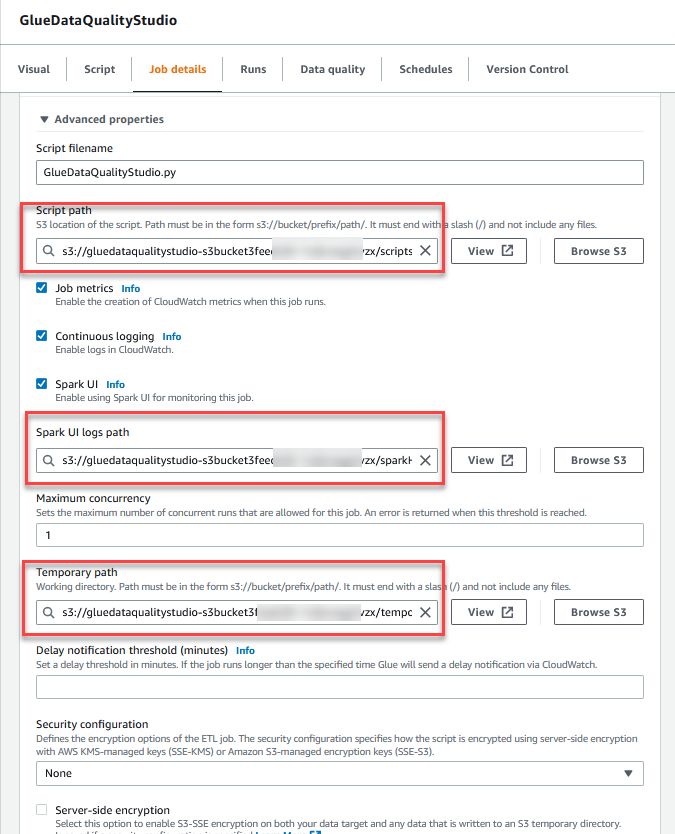

- Dalam majalah Sifat lanjutan bagian, berikan bucket S3 yang dibuat oleh template CloudFormation (dimulai dengan

gluedataqualitystudio-*).

- Pilih Save.

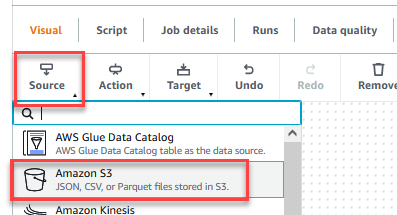

- Setelah pekerjaan disimpan, pilih visual tab dan di sumber menu, pilih Amazon S3.

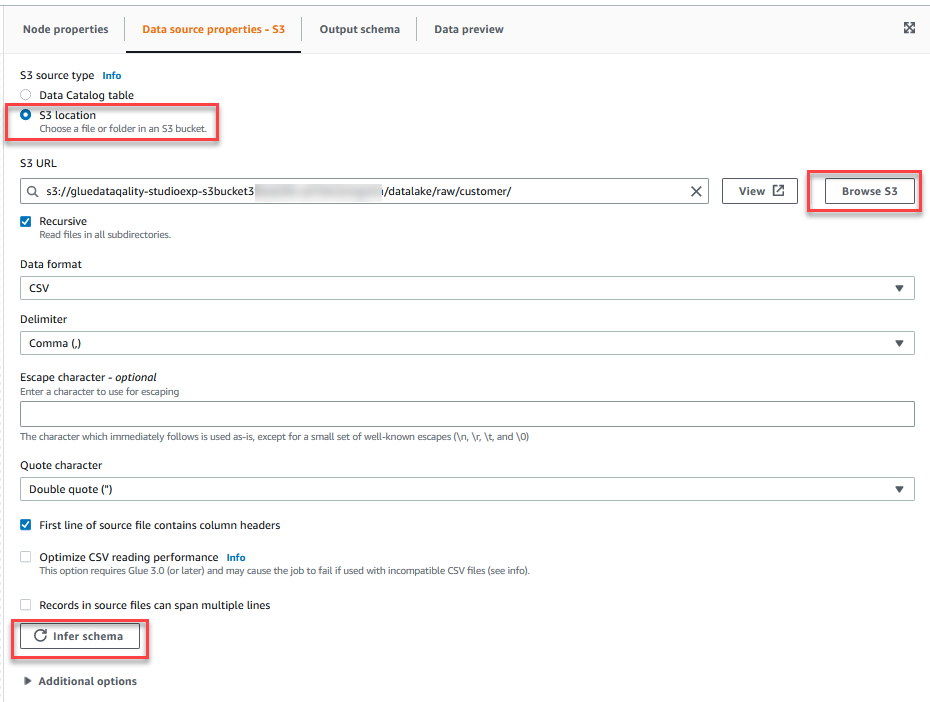

- pada Properti sumber data - S3 tab, untuk jenis sumber S3, pilih Lokasi S3.

- Pilih Jelajahi S3 dan arahkan ke awalan

/datalake/raw/customer/dalam ember S3 dimulai dengangluedataqualitystudio-*. - Pilih Menyimpulkan skema.

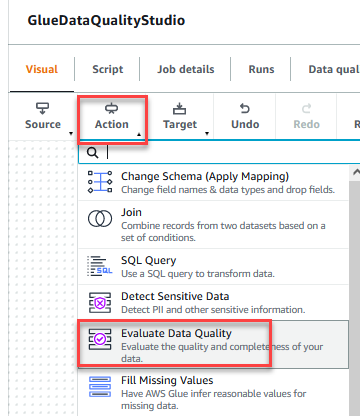

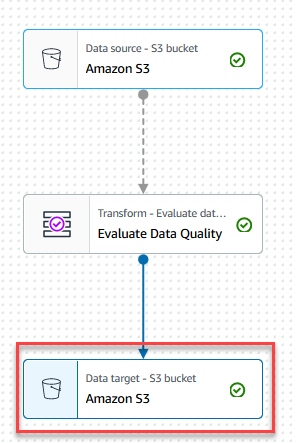

- pada Tindakan menu, pilih Evaluasi Kualitas Data.

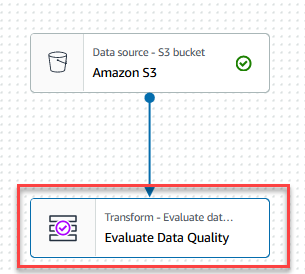

- Pilih Evaluasi Kualitas Data simpul.

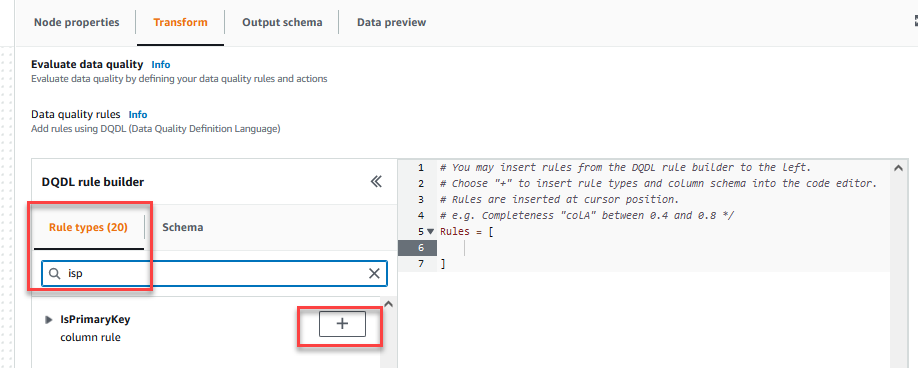

pada Mengubah tab, Anda sekarang dapat mulai membuat aturan kualitas data. Aturan pertama yang Anda buat adalah memeriksa apakahCustomer_IDunik dan bukan nol menggunakanisPrimaryKeyaturan. - pada Jenis aturan tab dari Pembuat aturan DQDL, pencarian untuk

isprimarykeydan pilih tanda tambah.

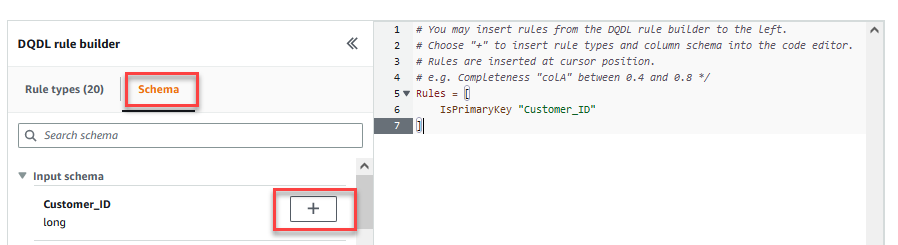

- pada Skema tab dari Pembuat aturan DQDL, pilih tanda plus di sebelah

Customer_ID. - Di editor aturan, hapus

id.

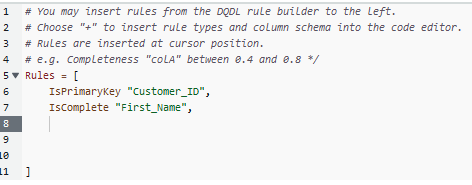

Aturan berikutnya kita menambahkan cek bahwaFirst_Namenilai kolom hadir untuk semua baris. - Anda juga dapat memasukkan aturan kualitas data secara langsung di editor aturan. Tambahkan koma (,) dan enter

IsComplete "First_Name",setelah aturan pertama.

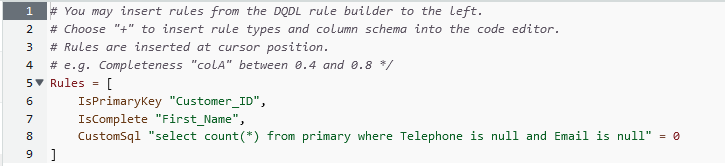

Selanjutnya, Anda menambahkan aturan khusus untuk memvalidasi bahwa tidak ada baris yang tidak adaTelephoneorEmail. - Masukkan aturan khusus berikut di editor aturan:

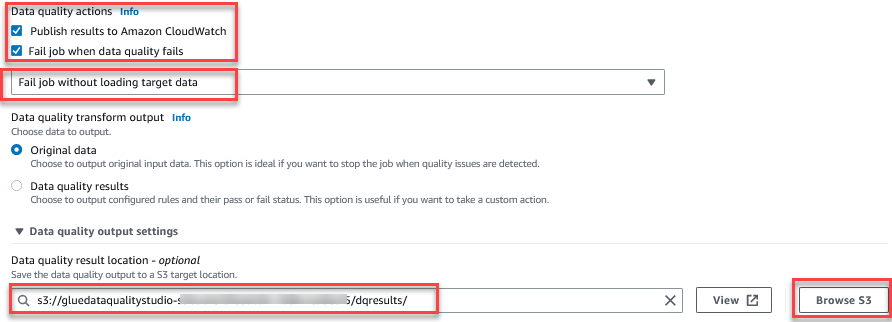

Fitur Evaluasi Kualitas Data menyediakan tindakan untuk mengelola hasil pekerjaan berdasarkan hasil kualitas pekerjaan. - Untuk posting ini, pilih Gagal pekerjaan saat kualitas data gagal Dan pilihlah Pekerjaan gagal tanpa memuat target data tindakan. Dalam Pengaturan keluaran kualitas data bagian, pilih Jelajahi S3 dan arahkan ke awalan

dqresultsdalam ember S3 dimulai dengangluedataqualitystudio-*.

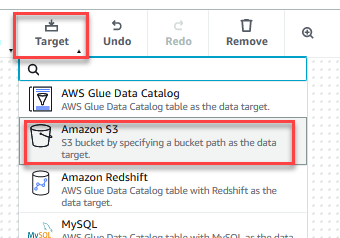

- pada target menu, pilih Amazon S3.

- Pilih Target data – ember S3 simpul.

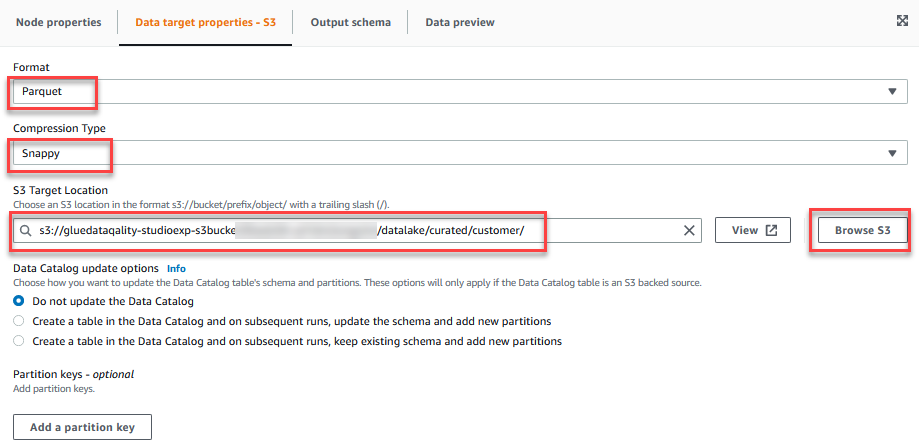

- pada Properti target data - S3 tab, untuk dibentuk, pilih Parket, Dan untuk Jenis Kompresi, pilih Tajam.

- Untuk Lokasi Sasaran S3, pilih Jelajahi S3 dan arahkan ke awalan

/datalake/curated/customer/dalam ember S3 dimulai dengangluedataqualitystudio-*.

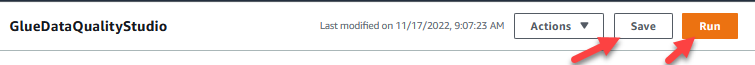

- Pilih Save, Lalu pilih Run.

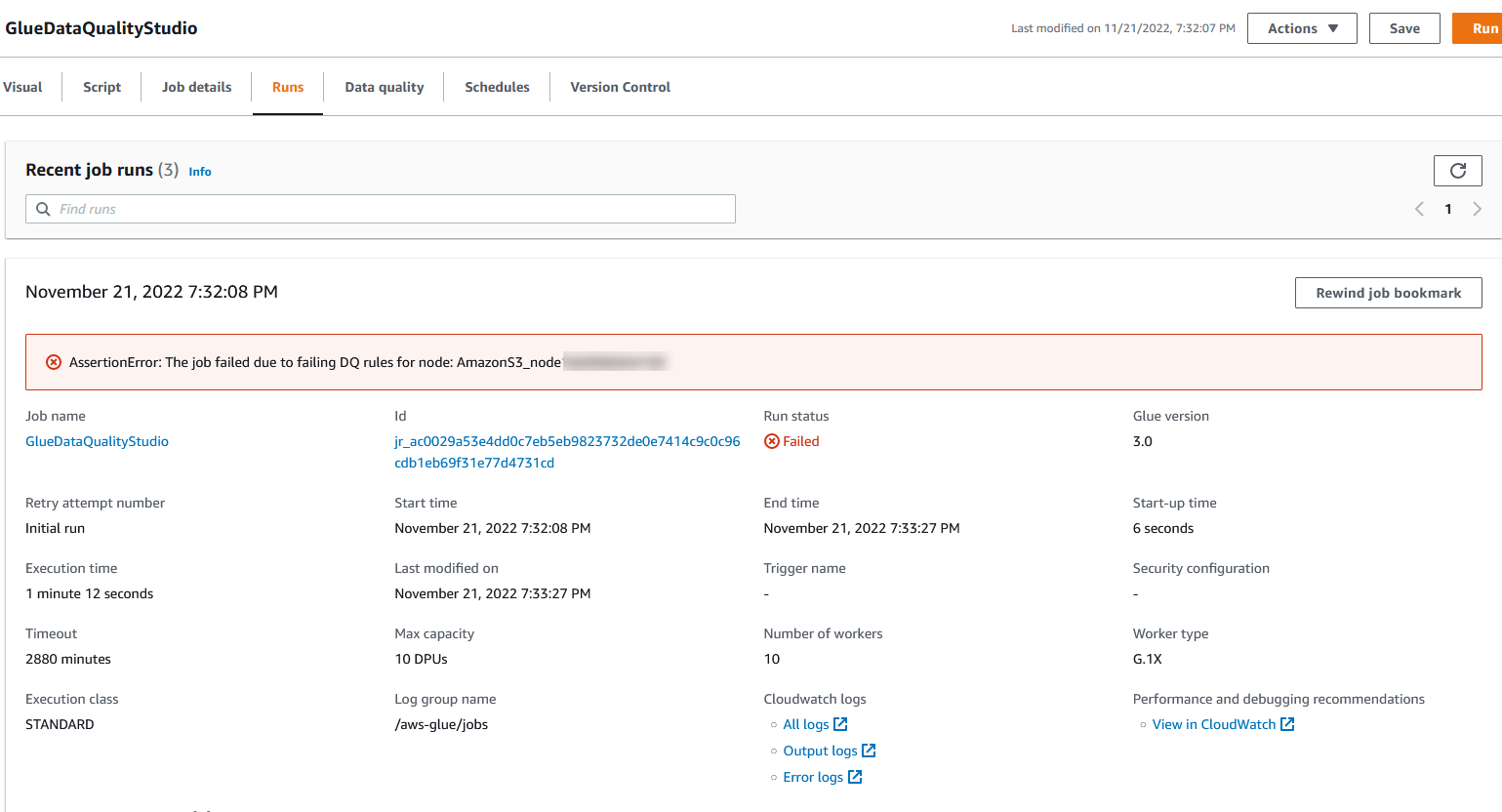

Anda dapat melihat detail pelaksanaan pekerjaan di tab Proses. Dalam contoh kami, pekerjaan gagal dengan pesan kesalahan “AssertionError: Pekerjaan gagal karena gagal aturan DQ untuk node: .”

Anda dapat melihat detail pelaksanaan pekerjaan di tab Proses. Dalam contoh kami, pekerjaan gagal dengan pesan kesalahan “AssertionError: Pekerjaan gagal karena gagal aturan DQ untuk node: .” Anda dapat meninjau hasil kualitas data di tab Kualitas data. Dalam contoh kami, validasi kualitas data kustom gagal karena salah satu baris dalam kumpulan data tidak memiliki

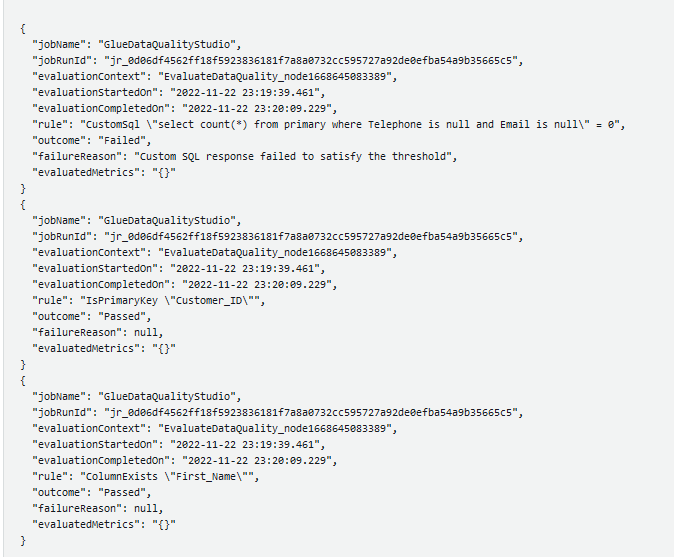

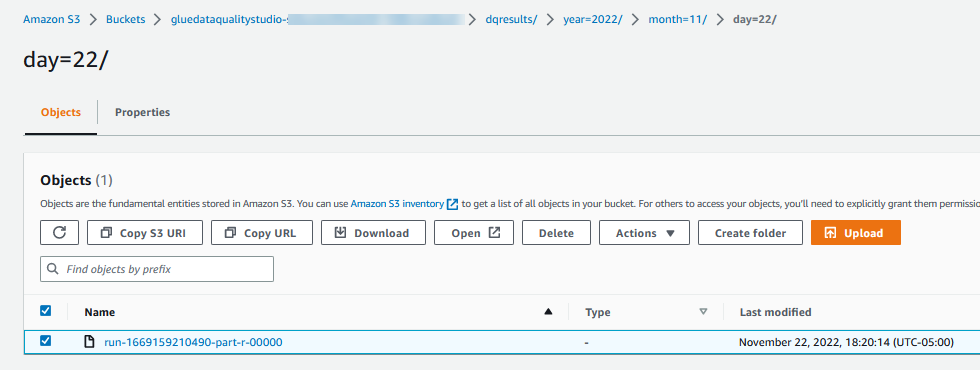

Anda dapat meninjau hasil kualitas data di tab Kualitas data. Dalam contoh kami, validasi kualitas data kustom gagal karena salah satu baris dalam kumpulan data tidak memiliki TelephoneorEmailnilai. Hasil Evaluasi Kualitas Data juga ditulis ke bucket S3 dalam format JSON berdasarkan parameter lokasi hasil kualitas data node.

Hasil Evaluasi Kualitas Data juga ditulis ke bucket S3 dalam format JSON berdasarkan parameter lokasi hasil kualitas data node. - Navigasi ke

dqresultsawalan di bawah ember S3 dimulaigluedataqualitystudio-*. Anda akan melihat bahwa hasil kualitas data dipartisi berdasarkan tanggal.

Berikut ini adalah output dari file JSON. Anda dapat menggunakan keluaran file ini untuk membuat dasbor visualisasi kualitas data khusus.

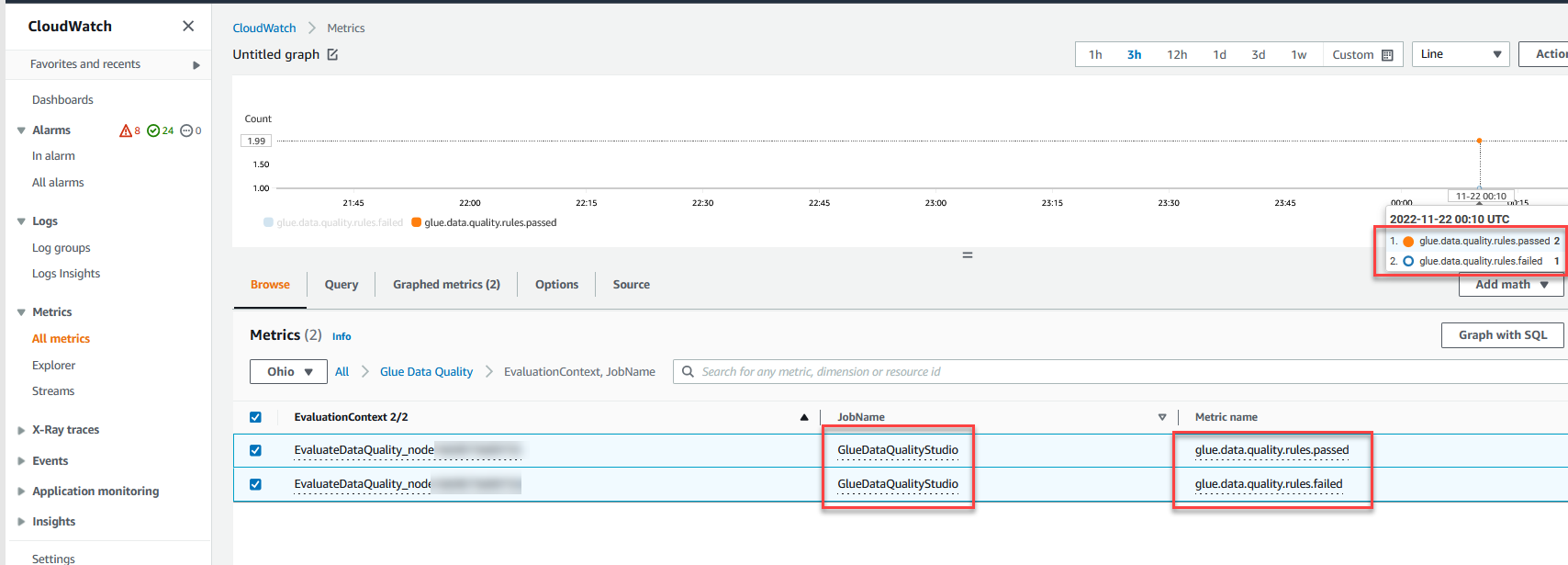

Anda juga dapat memantau Evaluasi Kualitas Data simpul melalui amazoncloudwatch metrik dan atur alarm untuk mengirim pemberitahuan tentang hasil kualitas data. Untuk mempelajari lebih lanjut tentang cara mengatur alarm CloudWatch, lihat Menggunakan alarm Amazon CloudWatch.

Membersihkan

Untuk menghindari timbulnya tagihan di masa mendatang dan untuk membersihkan peran dan kebijakan yang tidak digunakan, hapus sumber daya yang Anda buat:

- Hapus

GlueDataQualityStudiopekerjaan yang Anda buat sebagai bagian dari posting ini. - Di konsol AWS CloudFormation, hapus

GlueDataQualityStudiotumpukan.

Kesimpulan

Kualitas Data AWS Glue menawarkan cara mudah untuk mengukur dan memantau kualitas data pipeline ETL Anda. Dalam postingan ini, Anda mempelajari cara mengambil tindakan yang diperlukan berdasarkan hasil kualitas data, yang membantu Anda mempertahankan standar data yang tinggi dan membuat keputusan bisnis yang meyakinkan.

Untuk mempelajari lebih lanjut tentang Kualitas Data AWS Glue, lihat dokumentasinya:

Tentang Penulis

Deenbandhu Prasad adalah Spesialis Analitik Senior di AWS, yang berspesialisasi dalam layanan big data. Dia bersemangat membantu pelanggan membangun arsitektur data modern di AWS Cloud. Dia telah membantu pelanggan dari semua ukuran menerapkan manajemen data, gudang data, dan solusi danau data.

Deenbandhu Prasad adalah Spesialis Analitik Senior di AWS, yang berspesialisasi dalam layanan big data. Dia bersemangat membantu pelanggan membangun arsitektur data modern di AWS Cloud. Dia telah membantu pelanggan dari semua ukuran menerapkan manajemen data, gudang data, dan solusi danau data.

Yannis Mentekidis adalah Insinyur Pengembangan Perangkat Lunak Senior di tim AWS Glue.

Yannis Mentekidis adalah Insinyur Pengembangan Perangkat Lunak Senior di tim AWS Glue.

- Konten Bertenaga SEO & Distribusi PR. Dapatkan Amplifikasi Hari Ini.

- Platoblockchain. Intelijen Metaverse Web3. Pengetahuan Diperkuat. Akses Di Sini.

- Sumber: https://aws.amazon.com/blogs/big-data/getting-started-with-aws-glue-data-quality-for-etl-pipelines/

- 1

- 100

- 7

- a

- Tentang Kami

- mengakses

- Akun

- tepat

- mengakui

- Tindakan

- tindakan

- Setelah

- Semua

- memungkinkan

- sudah

- Amazon

- analisis

- dan

- arsitektur

- AWS

- Formasi AWS Cloud

- Lem AWS

- Buruk

- data buruk

- berdasarkan

- karena

- sebelum

- Besar

- Big data

- membangun

- Bangunan

- bisnis

- kasus

- beban

- memeriksa

- Cek

- Pilih

- awan

- Kolom

- Umum

- lengkap

- yakin

- Mempertimbangkan

- konsul

- Konsumen

- Korupsi

- membuat

- dibuat

- penciptaan

- dikuratori

- adat

- pelanggan

- pelanggan

- menyesuaikan

- data

- Danau Data

- manajemen data

- Tanggal

- keputusan

- rincian

- Pengembangan

- langsung

- dokumentasi

- mudah

- editor

- insinyur

- Insinyur

- Enter

- kesalahan

- Eter (ETH)

- mengevaluasi

- contoh

- ada

- pengalaman

- Menjelaskan

- ekstrak

- Gagal

- gagal

- Fitur

- File

- Pertama

- berikut

- format

- dari

- fungsi

- masa depan

- dihasilkan

- menghasilkan

- mendapatkan

- membantu

- membantu

- membantu

- High

- berkualitas tinggi

- Seterpercayaapakah Olymp Trade? Kesimpulan

- How To

- Namun

- HTML

- HTTPS

- Ratusan

- mengidentifikasi

- identitas

- melaksanakan

- in

- termasuk

- memasukkan

- masalah

- IT

- Pekerjaan

- Jobs

- json

- kunci

- danau

- BELAJAR

- belajar

- pengetahuan

- memuat

- pemuatan

- tempat

- kehilangan

- mesin

- Mesin belajar

- memelihara

- membuat

- mengelola

- pengelolaan

- pelaksana

- panduan

- mengukur

- ukuran

- menu

- pesan

- Metrik

- mungkin

- modern

- Memantau

- monitor

- lebih

- beberapa

- Arahkan

- Navigasi

- perlu

- kebutuhan

- berikutnya

- simpul

- pemberitahuan

- objek

- Penawaran

- ONE

- Buka

- jika tidak

- pane

- parameter

- bagian

- bergairah

- izin

- pipa saluran

- penempatan

- plato

- Kecerdasan Data Plato

- Data Plato

- plus

- Kebijakan

- Pos

- Mempersiapkan

- menyajikan

- mencegah

- Preview

- sebelumnya

- primer

- proses

- properties

- memberikan

- menyediakan

- kualitas

- Cepat

- Mentah

- Baca

- baru

- wilayah

- membutuhkan

- wajib

- Sumber

- mengakibatkan

- Hasil

- ulasan

- Peran

- peran

- BARIS

- Aturan

- aturan

- Run

- sama

- Pencarian

- Bagian

- Seri

- layanan

- Layanan

- set

- pengaturan

- penyiapan

- Menunjukkan

- Pertunjukkan

- menandatangani

- Sederhana

- ukuran

- So

- Perangkat lunak

- pengembangan perangkat lunak

- larutan

- Solusi

- sumber

- spesialis

- mengkhususkan diri

- tumpukan

- standar

- awal

- mulai

- Mulai

- Langkah

- Tangga

- penyimpanan

- studio

- setelan

- secara sintetis

- Mengambil

- target

- tugas

- tim

- Template

- Grafik

- ribuan

- Melalui

- kali

- untuk

- hari ini

- alat

- Mengubah

- mengubah

- Kepercayaan

- bawah

- pokok

- unik

- terpakai

- menggunakan

- gunakan case

- Pengguna

- biasanya

- MENGESAHKAN

- pengesahan

- nilai

- berbagai

- View

- visualisasi

- menunggu

- apakah

- yang

- akan

- tanpa

- bekerja

- menulis

- penulisan

- tertulis

- Anda

- zephyrnet.dll