Ini adalah posting tamu yang ditulis bersama dengan Raghu Boppanna dari Vanguard.

At Pelopor, lini bisnis Enterprise Advice meningkatkan hasil investor melalui akses digital ke nasihat keuangan yang unggul, dipersonalisasi, dan terjangkau. Mereka memungkinkan, sebagian, dengan mendorong skala ekonomi di seluruh dunia bagi investor dengan platform teknis yang sangat tangguh dan efisien. Vanguard memilih arsitektur multi-Wilayah untuk beban kerja ini guna membantu melindungi dari gangguan layanan Regional. Untuk tujuan ketersediaan tinggi, data yang digunakan oleh beban kerja harus tersedia tidak hanya di Wilayah primer, tetapi juga di Wilayah sekunder dengan jeda replikasi minimal. Jika terjadi gangguan layanan di Wilayah primer, solusi harus dapat dialihkan ke Wilayah sekunder dengan kehilangan data sesedikit mungkin dan kemampuan untuk melanjutkan penyerapan data.

Vanguard Cloud Technology Office dan AWS bermitra untuk membangun solusi infrastruktur di AWS yang memenuhi persyaratan ketahanan mereka. Solusi multi-Wilayah memungkinkan mekanisme fail-over yang kuat, dengan kemampuan observasi dan pemulihan bawaan. Solusinya juga mendukung streaming data dari berbagai sumber ke aliran data Kinesis yang berbeda. Solusi tersebut saat ini sedang diluncurkan ke berbagai lini tim bisnis untuk meningkatkan postur ketahanan beban kerja mereka.

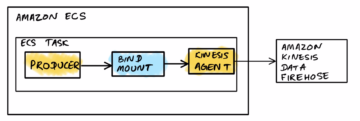

Kasus penggunaan yang dibahas di sini memerlukan Change Data Capture (CDC) untuk mengalirkan data dari sumber data jarak jauh (mainframe DB2) ke Aliran Data Amazon Kinesis, karena kemampuan bisnis bergantung pada data ini. Kinesis Data Streams adalah layanan streaming yang terkelola sepenuhnya, dapat diskalakan secara besar-besaran, tahan lama, dan berbiaya rendah yang dapat terus menangkap dan mengalirkan data dalam jumlah besar dari berbagai sumber, dan membuat data tersedia untuk dikonsumsi dalam milidetik. Layanan ini dibuat agar sangat tangguh dan menggunakan beberapa Availability Zone untuk memproses dan menyimpan data.

Solusi yang dibahas dalam postingan ini menjelaskan bagaimana AWS dan Vanguard berinovasi untuk membangun arsitektur yang tangguh guna memenuhi sasaran ketersediaan tinggi mereka.

Ikhtisar solusi

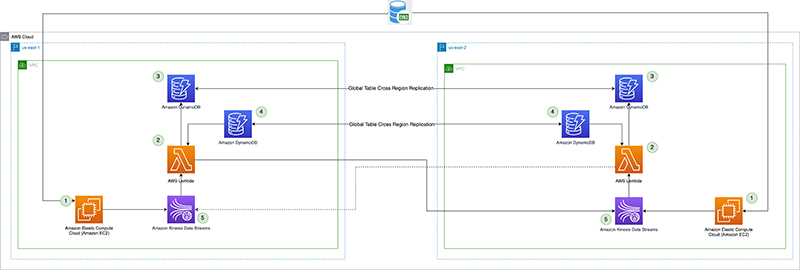

Solusinya menggunakan AWS Lambda untuk mereplikasi data dari aliran data Kinesis di Wilayah primer ke Wilayah sekunder. Jika terjadi penurunan layanan yang berdampak pada pipa CDC, proses failover akan mempromosikan Wilayah sekunder menjadi primer untuk produsen dan konsumen. Kita gunakan Tabel global Amazon DynamoDB untuk titik pemeriksaan replikasi yang memungkinkan untuk melanjutkan streaming data dari titik pemeriksaan dan juga mempertahankan bendera konfigurasi Wilayah utama yang mencegah putaran replikasi tak terbatas dari data yang sama bolak-balik.

Solusi ini juga memberikan fleksibilitas bagi konsumen Kinesis Data Streams untuk menggunakan Wilayah primer atau sekunder mana pun dalam akun AWS yang sama.

Diagram berikut mengilustrasikan arsitektur referensi.

Mari kita lihat setiap komponen secara detail:

- Prosesor CDC (produsen) – Dalam arsitektur referensi ini, produser dikerahkan Cloud komputasi elastis Amazon (Amazon EC2) di Wilayah primer dan sekunder, dan aktif di Wilayah primer dan dalam mode siaga di Wilayah sekunder. Ini menangkap data CDC dari sumber data eksternal (seperti database DB2 seperti yang ditunjukkan pada arsitektur di atas), dan mengalirkannya ke Kinesis Data Streams di Wilayah utama. Pelopor menggunakan 3rd alat pesta Qlik Replicate sebagai Prosesor CDC mereka. Ini menghasilkan payload yang terbentuk dengan baik termasuk stempel waktu komit DB2 ke aliran data Kinesis, selain data baris aktual dari sumber data jarak jauh. (

example-stream-1dalam contoh ini). Kode berikut adalah contoh muatan yang hanya berisi kunci utama dari catatan yang diubah dan stempel waktu komit (untuk penyederhanaan, data baris tabel lainnya tidak ditampilkan di bawah):{ "eventSource": "aws:kinesis", "kinesis": { "ApproximateArrivalTimestamp": "Mon July 18 20:00:00 UTC 2022", "SequenceNumber": "49544985256907370027570885864065577703022652638596431874", "PartitionKey": "12349999", "KinesisSchemaVersion": "1.0", "Data": "eyJLZXkiOiAxMjM0OTk5OSwiQ29tbWl0VGltZXN0YW1wIjogIjIwMjItMDctMThUMjA6MDA6MDAifQ==" }, "eventId": "shardId-000000000000:49629136582982516722891309362785181370337771525377097730", "invokeIdentityArn": "arn:aws:iam::6243876582:role/kds-crr-LambdaRole-1GZWP67437SD", "eventName": "aws:kinesis:record", "eventVersion": "1.0", "eventSourceARN": "arn:aws:kinesis:us-east-1:6243876582:stream/kds-stream-1/consumer/kds-crr:6243876582", "awsRegion": "us-east-1" }Nilai dekode Base64 dari

Dataadalah sebagai berikut. Catatan Kinesis yang sebenarnya akan berisi seluruh data baris dari baris tabel yang berubah, selain kunci utama dan stempel waktu komit.{"Key": 12349999,"CommitTimestamp": "2022-07-18T20:00:00"}Grafik

CommitTimestampdalamDatafield digunakan di pos pemeriksaan replikasi dan sangat penting untuk secara akurat melacak berapa banyak aliran data yang telah direplikasi ke Wilayah sekunder. Pos pemeriksaan kemudian dapat digunakan untuk memfasilitasi failover prosesor CDC (produser) dan secara akurat melanjutkan produksi data dari stempel waktu pos pemeriksaan replikasi dan seterusnya.Alternatif untuk menggunakan sumber data jarak jauh

CommitTimestamp(jika tidak tersedia) adalah dengan menggunakanApproximateArrivalTimestamp(yang merupakan stempel waktu saat rekaman benar-benar ditulis ke aliran data). - Replikasi Lintas Wilayah Fungsi Lambda – Fungsi ini digunakan untuk Wilayah primer dan sekunder. Itu diatur dengan pemetaan sumber peristiwa ke aliran data yang berisi data CDC. Fungsi yang sama dapat digunakan untuk mereplikasi data dari beberapa aliran. Ini dipanggil dengan sekumpulan catatan dari Kinesis Data Streams dan mereplikasi kumpulan tersebut ke Wilayah replikasi target (yang disediakan melalui lingkungan konfigurasi Lambda). Untuk pertimbangan biaya, jika data CDC diproduksi secara aktif ke Wilayah primer saja, konkurensi fungsi yang dicadangkan di Wilayah sekunder dapat diatur ke nol, dan diubah selama failover regional. Fungsi memiliki Identitas AWS dan Manajemen Akses (IAM) izin peran untuk melakukan hal berikut:

- Baca dan tulis ke tabel global DynamoDB yang digunakan dalam solusi ini, dalam akun yang sama.

- Baca dan tulis ke Kinesis Data Streams di kedua Wilayah dalam akun yang sama.

- Publikasikan metrik khusus ke amazoncloudwatch di kedua Wilayah dalam akun yang sama.

- Pos pemeriksaan replikasi – Pos pemeriksaan replikasi menggunakan tabel global DynamoDB di Wilayah primer dan sekunder. Ini digunakan oleh fungsi Lambda replikasi lintas Wilayah untuk mempertahankan stempel waktu komit dari rekaman replikasi terakhir sebagai pos pemeriksaan replikasi untuk setiap aliran yang dikonfigurasi untuk replikasi. Untuk posting ini, kami membuat dan menggunakan tabel global bernama

kdsReplicationCheckpoint. - Konfigurasi Wilayah Aktif – Wilayah aktif menggunakan tabel global DynamoDB di Wilayah primer dan sekunder. Ia menggunakan kemampuan replikasi lintas Wilayah asli dari tabel global untuk mereplikasi konfigurasi. Itu diisi sebelumnya dengan data tentang Wilayah utama untuk aliran, untuk mencegah replikasi kembali ke Wilayah utama oleh fungsi Lambda di Wilayah siaga. Konfigurasi ini mungkin tidak diperlukan jika fungsi Lambda di Wilayah siaga memiliki konkurensi cadangan yang disetel ke nol, tetapi dapat berfungsi sebagai pemeriksaan keamanan untuk menghindari loop replikasi data yang tak terbatas. Untuk posting ini, kami membuat tabel global bernama

kdsActiveRegionConfigdan letakkan item dengan data berikut:{ "stream-name": "example-stream-1", "active-region" : "us-east-1" } - Aliran Data Kinesis – Aliran di mana prosesor CDC menghasilkan data. Untuk posting ini, kami menggunakan aliran yang disebut

example-stream-1di kedua Wilayah, dengan konfigurasi shard dan kebijakan akses yang sama.

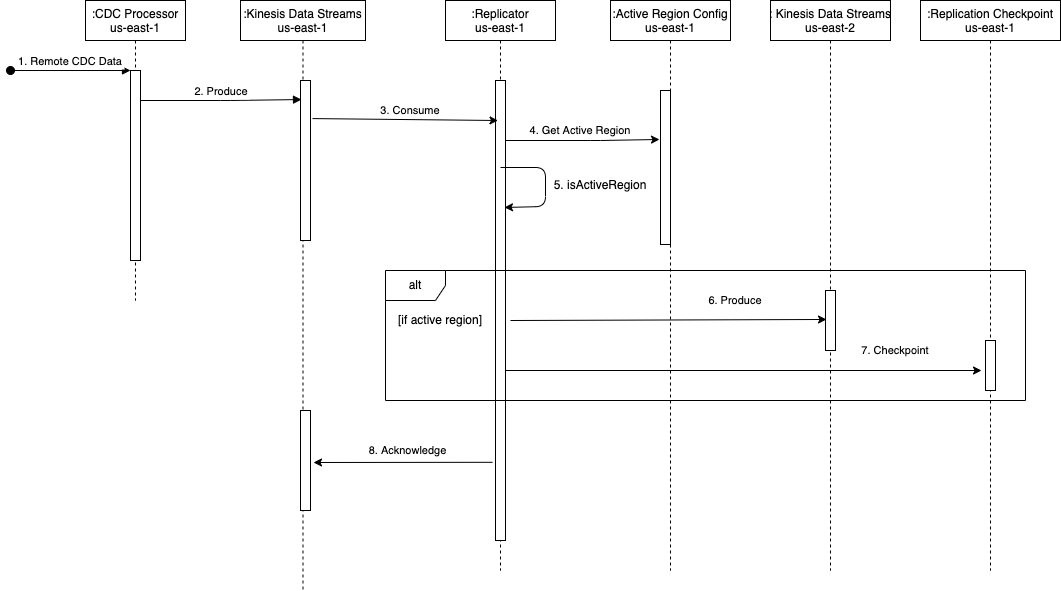

Urutan langkah-langkah dalam replikasi lintas Wilayah

Mari kita lihat secara singkat bagaimana arsitektur dijalankan menggunakan diagram urutan berikut.

Urutannya terdiri dari langkah-langkah berikut:

- Prosesor CDC (dalam

us-east-1) membaca data CDC dari sumber data jarak jauh. - Prosesor CDC (dalam

us-east-1) mengalirkan data CDC ke Kinesis Data Streams (inus-east-1). - Fungsi Lambda replikasi lintas Wilayah (di us-east-1) menggunakan data dari aliran data (di

us-east-1). Pola fan-out yang disempurnakan direkomendasikan untuk throughput khusus dan yang ditingkatkan untuk replikasi lintas Wilayah. - Fungsi replikator Lambda (dalam

us-east-1) memvalidasi Wilayahnya saat ini dengan konfigurasi Wilayah aktif untuk aliran yang digunakan, dengan bantuankdsActiveRegionConfigTabel global DynamoDBKode contoh berikut (dalam Java) dapat membantu mengilustrasikan kondisi yang sedang dievaluasi:// Fetch the current AWS Region from the Lambda function’s environment String currentAWSRegion = System.getenv(“AWS_REGION”); // Read the stream name from the first Kinesis Record once for the entire batch being processed. This is done because we are reusing the same Lambda function for replicating multiple streams. String currentStreamNameConsumed = kinesisRecord.getEventSourceARN().split(“:”)[5].split(“/”)[1]; // Build the DynamoDB query condition using the stream name Map<String, Condition> keyConditions = singletonMap(“streamName”, Condition.builder().comparisonOperator(EQ).attributeValueList(AttributeValue.builder().s(currentStreamNameConsumed).build()).build()); // Query the DynamoDB Global Table QueryResponse queryResponse = ddbClient.query(QueryRequest.builder().tableName("kdsActiveRegionConfig").keyConditions(keyConditions).attributesToGet(“ActiveRegion”).build()); - Fungsi mengevaluasi respons dari DynamoDB dengan kode berikut:

// Evaluate the response if (queryResponse.hasItems()) { AttributeValue activeRegionForStream = queryResponse.items().get(0).get(“ActiveRegion”); return currentAWSRegion.equalsIgnoreCase(activeRegionForStream.s()); } - Bergantung pada responsnya, fungsi mengambil tindakan berikut:

- Jika responnya adalah

true, fungsi replikator menghasilkan rekaman ke Kinesis Data Streams dius-east-2secara berurutan.- Jika ada kegagalan, nomor urut record dilacak dan iterasinya rusak. Fungsi mengembalikan daftar nomor urut yang gagal. Dengan mengembalikan nomor urut yang gagal, solusinya menggunakan fitur dari Pos pemeriksaan Lambda untuk dapat melanjutkan pemrosesan kumpulan catatan dengan kegagalan sebagian. Ini berguna saat menangani gangguan layanan apa pun, di mana fungsi mencoba mereplikasi data di seluruh Wilayah untuk memastikan paritas aliran dan tidak ada kehilangan data.

- Jika tidak ada kegagalan, daftar kosong akan dikembalikan, yang menunjukkan kumpulan berhasil.

- Jika responnya adalah

false, fungsi replikator kembali tanpa melakukan replikasi apa pun. Untuk mengurangi biaya pemanggilan Lambda, Anda dapat menyetel konkurensi fungsi yang dicadangkan di Wilayah DR (us-east-2) ke nol. Ini akan mencegah fungsi dipanggil. Saat Anda melakukan failover, Anda dapat memperbarui nilai ini ke angka yang sesuai berdasarkan throughput CDC dan menyetel konkurensi fungsi yang dicadangkan dius-east-1ke nol untuk mencegah eksekusi yang tidak perlu.

- Jika responnya adalah

- Setelah semua rekaman diproduksi ke Kinesis Data Streams di

us-east-2, pos pemeriksaan fungsi replikator kekdsReplicationCheckpointTabel global DynamoDB (dalamus-east-1) dengan data berikut:{ "streamName": "example-stream-1", "lastReplicatedTimestamp": "2022-07-18T20:00:00" } - Fungsi kembali setelah berhasil memproses kumpulan catatan.

Pertimbangan kinerja

Harapan kinerja solusi harus dipahami sehubungan dengan faktor-faktor berikut:

- Pemilihan wilayah – Latensi replikasi berbanding lurus dengan jarak yang ditempuh oleh data, jadi pahami pemilihan Wilayah Anda

- Kecepatan – Kecepatan data yang masuk atau volume data yang direplikasi

- Ukuran muatan – Ukuran muatan yang direplikasi

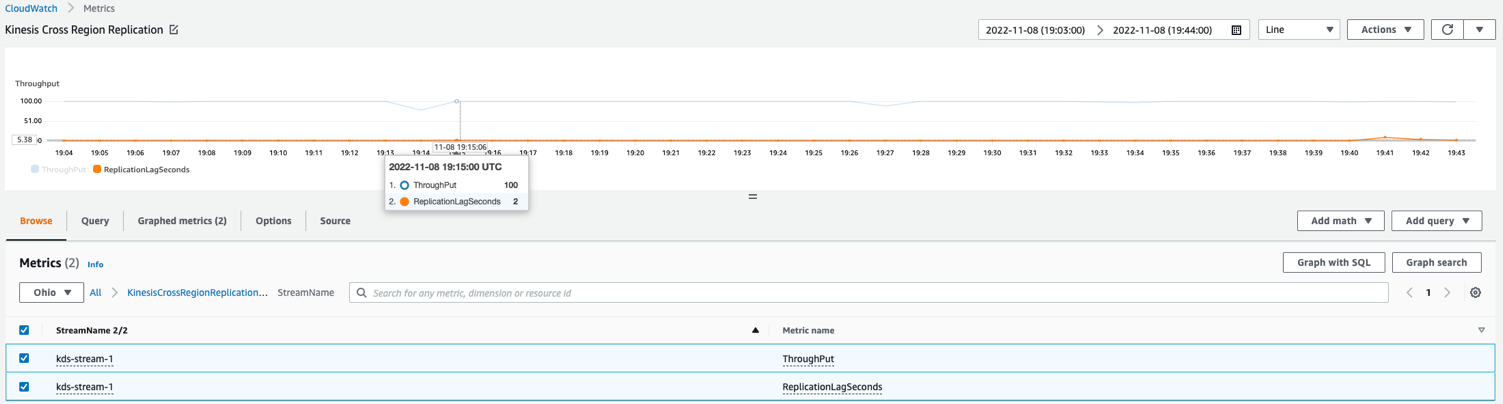

Pantau replikasi Lintas Wilayah

Disarankan untuk melacak dan mengamati replikasi saat itu terjadi. Anda dapat menyesuaikan fungsi Lambda untuk memublikasikan metrik khusus ke CloudWatch dengan metrik berikut di akhir setiap pemanggilan. Menerbitkan metrik ini ke Wilayah primer dan sekunder membantu melindungi diri Anda dari gangguan yang memengaruhi kemampuan observasi di Wilayah primer.

- Throughput – Ukuran batch pemanggilan Lambda saat ini

- ReplikasiLagSeconds – Perbedaan antara stempel waktu saat ini (setelah memproses semua catatan) dan

ApproximateArrivalTimestampdari catatan terakhir yang direplikasi

Contoh grafik metrik CloudWatch berikut menunjukkan jeda replikasi rata-rata adalah 2 detik dengan throughput 100 rekaman yang direplikasi dari us-east-1 untuk us-east-2.

Strategi failover umum

Selama gangguan apa pun yang berdampak pada jalur pipa CDC di Wilayah utama, kelangsungan bisnis atau kebutuhan pemulihan bencana dapat menyebabkan kegagalan jalur pipa ke Wilayah sekunder (siaga). Ini berarti beberapa hal perlu dilakukan sebagai bagian dari proses failover ini:

- Jika memungkinkan, hentikan semua tugas CDC di alat prosesor CDC

us-east-1. - Prosesor CDC harus dialihkan ke Wilayah sekunder, sehingga dapat membaca data CDC dari sumber data jarak jauh saat beroperasi di luar Wilayah siaga.

- Grafik

kdsActiveRegionConfigTabel global DynamoDB perlu diperbarui. Misalnya, untuk aliranexample-stream-1digunakan dalam contoh kami, Wilayah aktif diubah menjadius-east-2:

{ "stream-name": "example-stream-1", "active-Region" : "us-east-2"

}- Semua pos pemeriksaan aliran perlu dibaca dari

kdsReplicationCheckpointTabel global DynamoDB (dalamus-east-2), dan stempel waktu dari setiap pos pemeriksaan digunakan untuk memulai tugas CDC di alat produser dius-east-2Wilayah. Ini meminimalkan kemungkinan kehilangan data dan secara akurat melanjutkan streaming data CDC dari sumber data jarak jauh dari stempel waktu pos pemeriksaan dan seterusnya. - Jika menggunakan konkurensi yang dicadangkan untuk mengontrol pemanggilan Lambda, setel nilai ke nol di Wilayah utama(

us-east-1) dan ke nilai bukan nol yang sesuai di Wilayah sekunder (us-east-2).

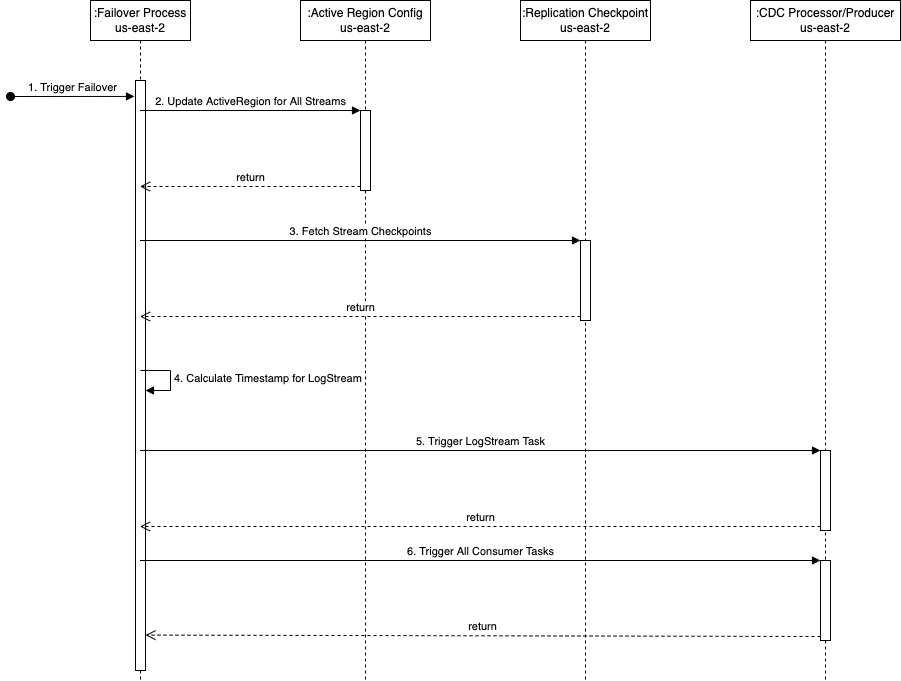

Strategi failover multi-langkah Vanguard

Beberapa alat pihak ketiga yang digunakan Vanguard memiliki proses CDC dua langkah untuk mengalirkan data dari sumber data jarak jauh ke tujuan. Alat pilihan Vanguard untuk prosesor CDC mereka mengikuti pendekatan dua langkah ini:

- Langkah pertama melibatkan pengaturan tugas aliran log yang membaca data dari sumber data jarak jauh dan bertahan di lokasi pementasan.

- Langkah kedua melibatkan penyiapan tugas konsumen individual yang membaca data dari lokasi pementasan—yang mungkin aktif Sistem File Amazon Elastis (Amazon EFS) atau AmazonFSx, misalnya—dan mengalirkannya ke tujuan. Fleksibilitasnya di sini adalah bahwa setiap tugas konsumen ini dapat dipicu untuk melakukan streaming dari stempel waktu komit yang berbeda. Tugas aliran log biasanya mulai membaca data dari minimum semua stempel waktu komit yang digunakan oleh tugas konsumen.

Mari kita lihat contoh untuk menjelaskan skenarionya:

- Tugas konsumen A adalah streaming data dari stempel waktu komit 2022-07-19T20:00:00 dan seterusnya ke

example-stream-1. - Tugas konsumen B adalah streaming data dari stempel waktu komit 2022-07-19T21:00:00 dan seterusnya ke

example-stream-2. - Dalam situasi ini, aliran log harus membaca data dari sumber data jarak jauh dari stempel waktu minimum yang digunakan oleh tugas konsumen, yaitu 2022-07-19T20:00:00.

Diagram urutan berikut menunjukkan langkah-langkah yang tepat untuk dijalankan selama failover us-east-2 (Wilayah Siaga).

Langkah-langkahnya adalah sebagai berikut:

- Proses failover dipicu di Wilayah siaga (

us-east-2dalam contoh ini) bila diperlukan. Perhatikan bahwa pemicu dapat diotomatiskan menggunakan pemeriksaan kesehatan yang komprehensif dari pipeline di Wilayah utama. - Proses failover memperbarui tabel global kdsActiveRegionConfig DynamoDB dengan nilai baru untuk Wilayah sebagai

us-east-2untuk semua nama aliran. - Langkah selanjutnya adalah mengambil semua pos pemeriksaan aliran dari

kdsReplicationCheckpointTabel global DynamoDB (dalamus-east-2). - Setelah informasi checkpoint dibaca, proses failover menemukan nilai minimum dari semua

lastReplicatedTimestamp. - Tugas aliran log di alat pemroses CDC dimulai

us-east-2dengan stempel waktu yang ditemukan di Langkah 4. Ini mulai membaca data CDC dari sumber data jarak jauh dari stempel waktu ini dan seterusnya dan mempertahankannya di lokasi pementasan di AWS. - Langkah selanjutnya adalah memulai semua tugas konsumen untuk membaca data dari lokasi pementasan dan streaming ke aliran data tujuan. Di sinilah setiap tugas konsumen diberikan stempel waktu yang sesuai dari

kdsReplicationCheckpointtabel sesuai denganstreamNametempat tugas mengalirkan data.

Setelah semua tugas konsumen dimulai, data dihasilkan ke aliran data Kinesis di us-east-2. Sejak saat itu, proses replikasi lintas Wilayah sama seperti yang dijelaskan sebelumnya – fungsi replikasi Lambda di us-east-2 mulai mereplikasi data ke aliran data di us-east-1.

Aplikasi konsumen membaca data dari aliran diharapkan idempoten untuk dapat menangani duplikat. Duplikat dapat diperkenalkan di aliran karena berbagai alasan, beberapa di antaranya disebutkan di bawah ini.

- Produser atau Pemroses CDC memasukkan duplikat ke dalam aliran sambil memutar ulang data CDC selama failover

- Tabel Global DynamoDB menggunakan replikasi data asinkron di seluruh Wilayah dan jika

kdsReplicationCheckpointdata tabel memiliki kelambatan replikasi, proses failover berpotensi menggunakan stempel waktu pos pemeriksaan yang lebih lama untuk memutar ulang data CDC.

Selain itu, aplikasi konsumen harus memeriksa CommitTimestamp dari catatan terakhir yang digunakan. Ini untuk memfasilitasi pemantauan dan pemulihan yang lebih baik.

Jalur menuju kedewasaan: Pemulihan otomatis

Kondisi yang ideal adalah mengotomatiskan sepenuhnya proses failover, mengurangi waktu pemulihan, dan memenuhi Tujuan Tingkat Layanan (SLO) ketahanan. Namun, di sebagian besar organisasi, keputusan untuk gagal, gagal kembali, dan memicu kegagalan membutuhkan intervensi manual dalam menilai situasi dan memutuskan hasilnya. Membuat otomatisasi skrip untuk melakukan failover yang dapat dijalankan oleh manusia adalah tempat yang baik untuk memulai.

Vanguard telah mengotomatiskan semua langkah failover, tetapi manusia masih membuat keputusan kapan harus memintanya. Anda dapat menyesuaikan solusi untuk memenuhi kebutuhan Anda dan bergantung pada alat prosesor CDC yang Anda gunakan di lingkungan Anda.

Kesimpulan

Dalam postingan ini, kami menjelaskan bagaimana Vanguard berinovasi dan membuat solusi untuk mereplikasi data di seluruh Wilayah di Kinesis Data Streams agar data selalu tersedia. Kami juga mendemonstrasikan strategi pos pemeriksaan yang kuat untuk memfasilitasi failover Regional dari proses replikasi bila diperlukan. Solusinya juga mengilustrasikan cara menggunakan tabel global DynamoDB untuk melacak titik pemeriksaan dan konfigurasi replikasi. Dengan arsitektur ini, Vanguard dapat menerapkan beban kerja yang bergantung pada data CDC ke beberapa Wilayah untuk memenuhi kebutuhan bisnis dengan ketersediaan tinggi dalam menghadapi gangguan layanan yang berdampak pada jalur pipa CDC di Wilayah utama.

Jika Anda memiliki umpan balik, silakan tinggalkan komentar di bagian Komentar di bawah.

Tentang penulis

Raghu Boppanna bekerja sebagai Arsitek Perusahaan di Kantor Teknologi Utama Vanguard. Raghu berspesialisasi dalam Analisis Data, Migrasi/Replikasi Data, termasuk Saluran Pipa CDC, Pemulihan Bencana, dan Basis Data. Dia telah mendapatkan beberapa Sertifikasi AWS termasuk AWS Certified Security – Specialty & AWS Certified Data Analytics – Specialty.

Raghu Boppanna bekerja sebagai Arsitek Perusahaan di Kantor Teknologi Utama Vanguard. Raghu berspesialisasi dalam Analisis Data, Migrasi/Replikasi Data, termasuk Saluran Pipa CDC, Pemulihan Bencana, dan Basis Data. Dia telah mendapatkan beberapa Sertifikasi AWS termasuk AWS Certified Security – Specialty & AWS Certified Data Analytics – Specialty.

Parameswaran V Vaidyanathan adalah Arsitek Ketahanan Cloud Senior dengan Amazon Web Services. Dia membantu perusahaan besar mencapai sasaran bisnis dengan merancang dan membangun solusi yang dapat diskalakan dan tangguh di AWS Cloud.

Parameswaran V Vaidyanathan adalah Arsitek Ketahanan Cloud Senior dengan Amazon Web Services. Dia membantu perusahaan besar mencapai sasaran bisnis dengan merancang dan membangun solusi yang dapat diskalakan dan tangguh di AWS Cloud.

Richa Kaulu adalah Pemimpin Senior dalam Solusi Pelanggan yang melayani pelanggan Jasa Keuangan. Dia berbasis di New York. Dia memiliki pengalaman luas dalam transformasi cloud skala besar, keunggulan karyawan, dan solusi digital generasi berikutnya. Dia dan timnya fokus pada pengoptimalan nilai cloud dengan membangun solusi yang berkinerja, tangguh, dan gesit. Richa menikmati multi olahraga seperti triathlon, musik, dan belajar tentang teknologi baru.

Richa Kaulu adalah Pemimpin Senior dalam Solusi Pelanggan yang melayani pelanggan Jasa Keuangan. Dia berbasis di New York. Dia memiliki pengalaman luas dalam transformasi cloud skala besar, keunggulan karyawan, dan solusi digital generasi berikutnya. Dia dan timnya fokus pada pengoptimalan nilai cloud dengan membangun solusi yang berkinerja, tangguh, dan gesit. Richa menikmati multi olahraga seperti triathlon, musik, dan belajar tentang teknologi baru.

Mithil Prasad adalah Manajer Solusi Pelanggan Utama dengan Amazon Web Services. Dalam perannya, Mithil bekerja dengan Pelanggan untuk mendorong realisasi nilai cloud, memberikan kepemimpinan pemikiran untuk membantu bisnis mencapai kecepatan, ketangkasan, dan inovasi.

Mithil Prasad adalah Manajer Solusi Pelanggan Utama dengan Amazon Web Services. Dalam perannya, Mithil bekerja dengan Pelanggan untuk mendorong realisasi nilai cloud, memberikan kepemimpinan pemikiran untuk membantu bisnis mencapai kecepatan, ketangkasan, dan inovasi.

- Konten Bertenaga SEO & Distribusi PR. Dapatkan Amplifikasi Hari Ini.

- Platoblockchain. Intelijen Metaverse Web3. Pengetahuan Diperkuat. Akses Di Sini.

- Sumber: https://aws.amazon.com/blogs/big-data/how-vanguard-made-their-technology-platform-resilient-and-efficient-by-building-cross-region-replication-for-amazon-kinesis-data-streams/

- 1

- 100

- 2022

- 28

- a

- kemampuan

- Sanggup

- Tentang Kami

- atas

- mengakses

- Menurut

- Akun

- akurat

- Mencapai

- di seluruh

- tindakan

- aktif

- aktif

- sebenarnya

- tambahan

- nasihat

- mempengaruhi

- terjangkau

- Setelah

- terhadap

- tangkas

- Semua

- memungkinkan

- alternatif

- Amazon

- Amazon EC2

- Amazon Kinesis

- Amazon Web Services

- jumlah

- analisis

- dan

- aplikasi

- pendekatan

- sesuai

- arsitektur

- mengotomatisasikan

- Otomatis

- Otomatisasi

- tersedianya

- tersedia

- rata-rata

- menghindari

- AWS

- Tersertifikasi AWS

- kembali

- berdasarkan

- karena

- makhluk

- di bawah

- Lebih baik

- antara

- secara singkat

- Rusak

- membangun

- Bangunan

- dibangun di

- built-in

- bisnis

- keberlangsungan bisnis

- bisnis

- bernama

- menangkap

- menangkap

- kasus

- CDC

- sertifikasi

- Tersertifikasi

- kesempatan

- perubahan

- memeriksa

- Cek

- kepala

- pilihan

- awan

- TEKNOLOGI AWAN

- kode

- komentar

- komentar

- melakukan

- komponen

- luas

- menghitung

- kondisi

- konfigurasi

- pertimbangan

- dikonsumsi

- konsumen

- Konsumen

- konsumsi

- terus menerus

- kontrol

- Biaya

- bisa

- sepasang

- membuat

- membuat

- kritis

- terbaru

- Sekarang

- adat

- pelanggan

- Solusi Pelanggan

- pelanggan

- menyesuaikan

- data

- Data Analytics

- kehilangan data

- Basis Data

- database

- Memutuskan

- keputusan

- dedicated

- menunjukkan

- menunjukkan

- Tergantung

- tergantung

- menyebarkan

- dikerahkan

- dijelaskan

- tujuan

- rinci

- perbedaan

- berbeda

- digital

- langsung

- bencana

- dibahas

- jarak

- mendorong

- penggerak

- duplikat

- selama

- setiap

- Terdahulu

- memperoleh

- ekonomi

- Skala ekonomi

- efisien

- Karyawan

- memungkinkan

- ditingkatkan

- memastikan

- Enterprise

- perusahaan

- Seluruh

- Lingkungan Hidup

- Eter (ETH)

- mengevaluasi

- dievaluasi

- Acara

- Setiap

- contoh

- Keunggulan

- mengeksekusi

- harapan

- diharapkan

- pengalaman

- Menjelaskan

- Menjelaskan

- luas

- luar

- Menghadapi

- memudahkan

- faktor

- GAGAL

- Gagal

- Kegagalan

- Fitur

- umpan balik

- bidang

- File

- keuangan

- jasa keuangan

- menemukan

- Pertama

- keluwesan

- Fokus

- berikut

- berikut

- Untuk Investor

- ditemukan

- dari

- sepenuhnya

- fungsi

- generasi

- Aksi

- bumi

- Anda

- baik

- grafik

- Tamu

- tamu Post

- menangani

- Penanganan

- Terjadi

- Kesehatan

- membantu

- membantu

- di sini

- High

- sangat

- Seterpercayaapakah Olymp Trade? Kesimpulan

- How To

- Namun

- HTTPS

- manusia

- Manusia

- IAM

- ideal

- identitas

- pelemahan

- memperbaiki

- meningkatkan

- in

- Termasuk

- masuk

- Pada meningkat

- menunjukkan

- sendiri-sendiri

- informasi

- Infrastruktur

- Innovation

- contoh

- intervensi

- diperkenalkan

- Memperkenalkan

- investor

- Investor

- melibatkan

- IT

- perulangan

- Jawa

- Juli

- kunci

- Aliran Data Kinesis

- besar

- Terakhir

- Latensi

- pemimpin

- Kepemimpinan

- pengetahuan

- Meninggalkan

- Tingkat

- baris

- baris

- Daftar

- sedikit

- tempat

- melihat

- lepas

- terbuat

- mempertahankan

- membuat

- MEMBUAT

- berhasil

- manajer

- cara

- panduan

- banyak

- pemetaan

- secara besar-besaran

- kematangan

- cara

- mekanisme

- Pelajari

- pertemuan

- metrik

- Metrik

- minimal

- minimum

- mode

- dimodifikasi

- pemantauan

- paling

- multi-

- beberapa

- musik

- nama

- nama

- asli

- Perlu

- dibutuhkan

- kebutuhan

- New

- Teknologi baru

- NY

- berikutnya

- jumlah

- nomor

- tujuan

- mengamati

- Office

- operasi

- mengoptimalkan

- organisasi

- Hasil

- keseimbangan

- bagian

- bermitra

- pihak

- pola

- melakukan

- prestasi

- melakukan

- Izin

- terus berlanjut

- Personalized

- pipa saluran

- Tempat

- Platform

- plato

- Kecerdasan Data Plato

- Data Plato

- silahkan

- Kebijakan

- mungkin

- Pos

- berpotensi

- mencegah

- primer

- Utama

- proses

- pengolahan

- Prosesor

- Diproduksi

- produsen

- Produsen

- mempromosikan

- melindungi

- memberikan

- disediakan

- menyediakan

- menerbitkan

- Penerbitan

- tujuan

- menempatkan

- Baca

- Bacaan

- realisasi

- alasan

- direkomendasikan

- catatan

- arsip

- Memulihkan

- pemulihan

- menurunkan

- mengurangi

- wilayah

- daerah

- daerah

- terpencil

- direplikasi

- ulangan

- replikasi

- wajib

- Persyaratan

- membutuhkan

- dilindungi

- ketahanan

- tabah

- tanggapan

- ISTIRAHAT

- lanjut

- kembali

- kembali

- Pengembalian

- kuat

- Peran

- Terguling

- BARIS

- Run

- Safety/keselamatan

- sama

- terukur

- Skala

- skenario

- Kedua

- sekunder

- detik

- Bagian

- keamanan

- senior

- Urutan

- melayani

- layanan

- Layanan

- porsi

- set

- pengaturan

- beberapa

- harus

- ditunjukkan

- Pertunjukkan

- kesederhanaan

- situasi

- Ukuran

- So

- larutan

- Solusi

- beberapa

- sumber

- sumber

- spesialisasi

- Khusus

- kecepatan

- Olahraga

- pementasan

- awal

- mulai

- dimulai

- Negara

- Langkah

- Tangga

- Masih

- berhenti

- menyimpan

- Penyelarasan

- aliran

- Streaming

- Layanan streaming

- stream

- sukses

- berhasil

- cocok

- unggul

- dipasok

- Mendukung

- sistem

- tabel

- Dibutuhkan

- target

- tugas

- tugas

- tim

- tim

- Teknis

- Teknologi

- Teknologi

- Grafik

- mereka

- hal

- pihak ketiga

- pikir

- pemikiran kepemimpinan

- Melalui

- keluaran

- waktu

- timestamp

- untuk

- alat

- alat

- jalur

- Pelacakan

- Transformasi

- bepergian

- memicu

- dipicu

- memahami

- dipahami

- tidak perlu

- Memperbarui

- diperbarui

- Pembaruan

- menggunakan

- gunakan case

- biasanya

- UTC

- nilai

- Pelopor

- Kecepatan

- melalui

- volume

- jaringan

- layanan web

- yang

- sementara

- akan

- dalam

- tanpa

- bekerja

- akan

- menulis

- tertulis

- Anda

- diri

- zephyrnet.dll

- nol

- zona