Pesan Lebih dari 250 penembakan massal telah terjadi di AS sepanjang tahun ini, dan pendukung AI berpikir mereka memiliki solusinya. Bukan kontrol senjata, tetapi teknologi yang lebih baik, tidak mengejutkan.

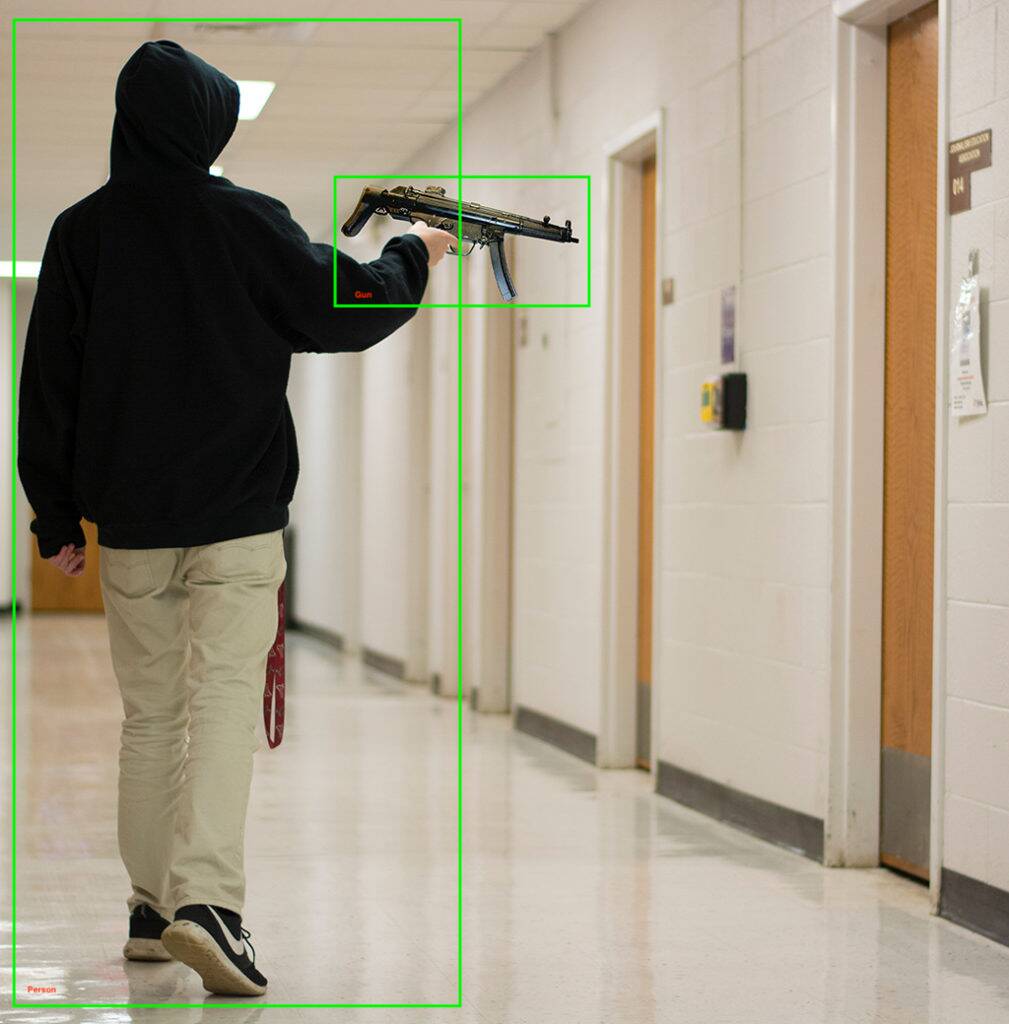

Bisnis pembelajaran mesin Kogniz mengumumkan pada hari Selasa bahwa mereka menambahkan aplikasi siap pakai model deteksi senjata ke platform visi komputernya. Sistem, kami diberitahu, dapat mendeteksi senjata yang terlihat oleh kamera keamanan dan mengirim pemberitahuan kepada mereka yang berisiko, memberi tahu polisi, mengunci gedung, dan melakukan tugas keamanan lainnya.

Selain melihat senjata api, Kogniz menggunakan modul penglihatan komputer lainnya untuk melihat perilaku yang tidak biasa, seperti anak-anak yang berlari di lorong atau seseorang yang memanjat melalui jendela, yang dapat mengindikasikan penembak aktif.

Jika Anda bertanya-tanya tentang tingkat kesalahan positif atau kesalahan kode, Kogniz mengatakan ia memiliki "AI multi-pass" dan "tim pemeriksa manusia terlatih" yang memeriksa hasil perangkat lunak pendeteksinya. Entah Anda menyambut tingkat konfirmasi ekstra itu, atau melihatnya sebagai teknologi yang berpotensi jatuh kembali pada manusia tepat saat komputer paling dibutuhkan.

“[Solusi kami] membuat secara dramatis lebih mudah bagi perusahaan, lembaga pemerintah, sekolah, dan rumah sakit untuk bersiap dan kemudian membantu mengurangi bahaya yang ditimbulkan oleh peristiwa penembak aktif,” kata CEO Kogniz Daniel Putterman.

Kogniz bukanlah perusahaan visi komputer pertama yang masuk ke dalam game pengenalan senjata – ada banyak sekali perusahaan yang menerapkan teknologi serupa dan beberapa, seperti ZeroEyes, hanya mengkhususkan diri pada pendeteksian senjata api.

“Dengan menyebarkan perhatian mereka ke berbagai penawaran, pengembang kurang mampu memberikan layanan terbaik dalam pendeteksian senjata,” kata ZeroEyes dalam sebuah posting blog. Teknologi ZeroEyes telah diterapkan di sekolah-sekolah di 14 negara bagian, termasuk SMA Oxford di metro Detroit, di mana seorang penembak berusia 15 tahun menewaskan empat orang dan melukai tujuh tahun lalu.

Vendor lain – seperti Defendry, yang memiliki rangkaian keamanan termasuk aplikasi tombol panik, sensor suara tembakan, drone penanggap pertama, dan AI pendeteksi senjata; dan Omnilert – berada di pasar pertumbuhan yang menyedihkan ini. Perusahaan tambahan di bidang deteksi senjata AI termasuk Arcarith, Athena Securities, dan Scylla.

Apakah sebenarnya ada cukup waktu?

Pada 2019, respons polisi terhadap penembakan massal di Dayton, Ohio, hanya berlangsung 32 detik, dan sembilan orang tewas. Penembakan tahun 2021 di fasilitas FedEx Indianapolis yang menewaskan sembilan orang juga berakhir sebelum polisi tiba, meskipun mereka melakukannya hanya dalam beberapa menit.

Kedua kasus tersebut menimbulkan pertanyaan apakah deteksi senjata AI dapat mengurangi waktu respons yang cukup untuk menyelamatkan nyawa. Apalagi jika petugas terlalu takut atau memilih untuk tidak menanggapi, seperti dalam pembunuhan massal di Uvalde.

Beberapa metode pencegahan penembakan massal berbasis AI lainnya telah diusulkan, seperti senjata pintar yang tidak akan menyala jika mereka mendeteksi target manusia. Yang lain telah mengusulkan pelatihan AI tentang data dari penembakan di masa lalu, pembelian senjata lokal, dan data sosial-ekonomi untuk menemukan tren indikasi penembakan yang direncanakan, serta memindai media sosial untuk indikator serupa.

Ada juga Bias AI, Sebuah masalah yang terdokumentasi dengan baik bahkan kumpulan data yang beragam dan pelatihan yang seimbang sepertinya tidak bisa memecahkan. Ambil penerapan teknologi pengenalan wajah dan senjata tahun 2020 di distrik sekolah New York: email antara distrik sekolah dan perusahaan yang menerapkan sistem menunjukkan kekhawatiran akan hal itu secara umum salah mengidentifikasi hal-hal, seperti gagang sapu untuk senjata.

Berbicara kepada publikasi Utah Deseret News, analis kebijakan senior ACLU Jay Stanley tersebut dia khawatir bahwa sistem visi komputer dapat mengarah ke dunia "di mana orang menghindari melakukan sesuatu yang sederhana seperti melompat-lompat di trotoar karena takut memicu detektor anomali dan diinterogasi oleh polisi."

Namun, satu kemungkinan penggunaan AI mungkin lebih menjanjikan: a 2018 belajar dari Pusat Medis Rumah Sakit Anak Cincinnati menemukan bahwa analisis AI sesi terapi setuju dengan penilaian bahaya psikiater dan konselor 91 persen dari waktu. Penambahan data demografi dan sosial ekonomi hanya meningkatkan hasil dalam mengidentifikasi remaja yang berisiko melakukan tindakan kekerasan.

Dengan begitu banyak potensi komplikasi, apakah pembelajaran mesin benar-benar siap untuk mencegah pembunuhan massal?

Kekerasan senjata adalah pembunuh nomor satu anak-anak dan remaja di Amerika, mengambil rata-rata 12 nyawa muda, dan melukai 32 lainnya, setiap hari. AI dapat membantu, tetapi tanpa mengatasi kekurangannya, pendekatan teknologi yang lebih sedikit mungkin juga diperlukan. Perawatan kesehatan mental yang lebih kuat dan tersedia secara luas mungkin merupakan awal yang baik.

Awal bulan ini, Presiden Biden bernama untuk, antara lain, larangan senjata serbu, pemeriksaan latar belakang yang diperluas, dan batasan kapasitas magasin, yang dia sebut sebagai "tindakan yang masuk akal dan rasional." ®

- AI

- ai seni

- generator seni ai

- punya robot

- kecerdasan buatan

- sertifikasi kecerdasan buatan

- kecerdasan buatan dalam perbankan

- robot kecerdasan buatan

- robot kecerdasan buatan

- perangkat lunak kecerdasan buatan

- blockchain

- konferensi blockchain

- kecerdasan

- kecerdasan buatan percakapan

- konferensi kripto

- dall's

- belajar mendalam

- google itu

- Mesin belajar

- plato

- plato ai

- Kecerdasan Data Plato

- Permainan Plato

- Data Plato

- permainan plato

- skala ai

- sintaksis

- Pendaftaran

- zephyrnet.dll