L'elaborazione intelligente dei documenti (IDP) è una tecnologia che automatizza l'elaborazione di grandi volumi di dati non strutturati, inclusi testo, immagini e video. IDP offre un miglioramento significativo rispetto ai metodi manuali e ai sistemi di riconoscimento ottico dei caratteri (OCR) legacy affrontando sfide come costi, errori, bassa precisione e scalabilità limitata, portando in ultima analisi a risultati migliori per organizzazioni e parti interessate.

L'elaborazione del linguaggio naturale (NLP) è uno dei recenti sviluppi in IDP che ha migliorato la precisione e l'esperienza dell'utente. Tuttavia, nonostante questi progressi, ci sono ancora sfide da superare. Ad esempio, molti sistemi IDP non sono facili da usare o abbastanza intuitivi per essere facilmente adottati dagli utenti. Inoltre, diverse soluzioni esistenti non sono in grado di adattarsi ai cambiamenti nelle origini dati, alle normative e ai requisiti degli utenti attraverso miglioramenti e aggiornamenti continui.

Migliorare gli sfollati attraverso il dialogo implica incorporare capacità di dialogo nei sistemi di sfollati. Consentendo agli utenti di interagire con i sistemi IDP in modo più naturale e intuitivo, attraverso un dialogo a più fasi, regolando informazioni imprecise o aggiungendo informazioni mancanti con l'ausilio dell'automazione delle attività, questi sistemi possono diventare più efficienti, accurati e di facile utilizzo.

In questo post, esploriamo un approccio innovativo all'IDP che utilizza una soluzione di query guidata dal dialogo utilizzando Modelli della Fondazione Amazon ed SageMaker JumpStart.

Panoramica della soluzione

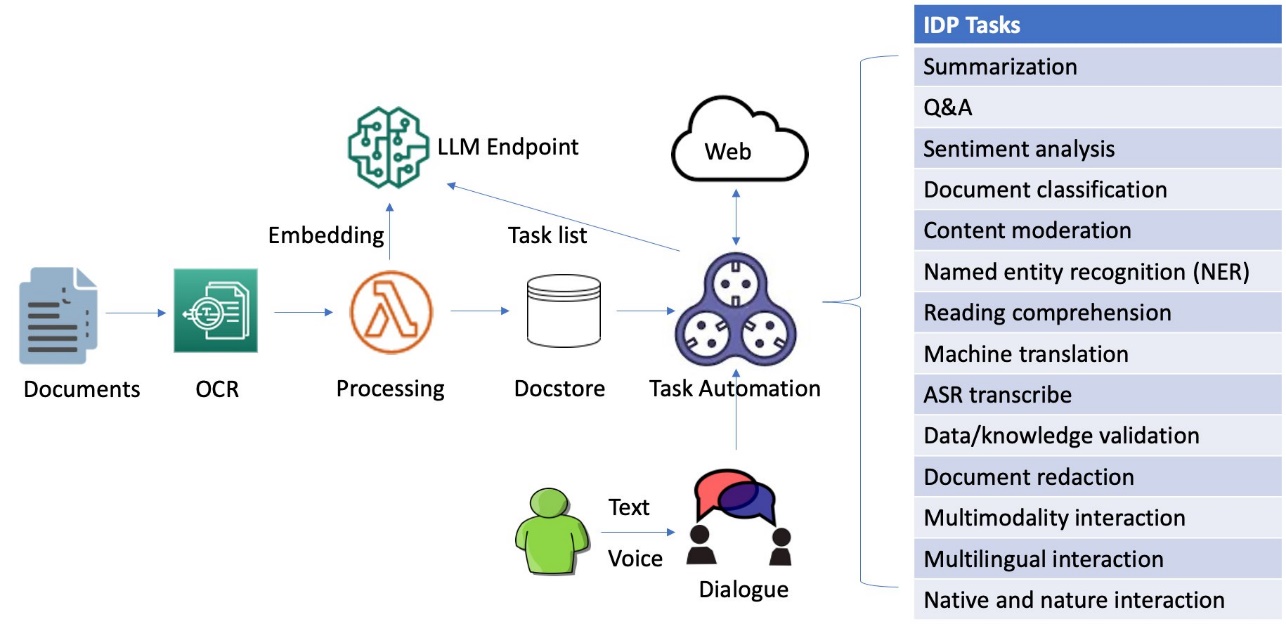

Questa soluzione innovativa combina l'OCR per l'estrazione delle informazioni, un modello LLM (Large Language Model) distribuito localmente per il dialogo e l'attività autonoma, VectorDB per l'incorporamento di attività secondarie e l'automazione delle attività basata su LangChain per l'integrazione con fonti di dati esterne per trasformare il modo in cui le aziende elaborano e analizzano i documenti contesti. Sfruttando le tecnologie di intelligenza artificiale generativa, le organizzazioni possono semplificare i flussi di lavoro IDP, migliorare l'esperienza utente e aumentare l'efficienza complessiva.

Il seguente video mette in evidenza il sistema IDP guidato dal dialogo mediante l'elaborazione un articolo scritto dal Consiglio dei governatori della Federal Reserve, che parla del crollo della Silicon Valley Bank nel marzo 2023.

Il sistema è in grado di elaborare immagini, PDF di grandi dimensioni e documenti in altri formati e di rispondere a domande derivate dal contenuto tramite testo interattivo o input vocali. Se un utente ha bisogno di indagare oltre il contesto del documento, l'IDP guidato dal dialogo può creare una catena di attività dal prompt di testo e quindi fare riferimento a fonti di dati esterne e aggiornate per le risposte pertinenti. Inoltre, supporta conversazioni multi-round e ospita scambi multilingue, tutti gestiti attraverso il dialogo.

Distribuisci il tuo LLM utilizzando i modelli di base di Amazon

Uno degli sviluppi più promettenti nell'IA generativa è l'integrazione di LLM nei sistemi di dialogo, aprendo nuove strade per scambi più intuitivi e significativi. Un LLM è un tipo di modello AI progettato per comprendere e generare testo simile a quello umano. Questi modelli vengono addestrati su enormi quantità di dati e sono costituiti da miliardi di parametri, consentendo loro di eseguire varie attività relative alla lingua con elevata precisione. Questo approccio trasformativo facilita un'interazione più naturale e produttiva, colmando il divario tra l'intuizione umana e l'intelligenza artificiale. Un vantaggio chiave dell'implementazione LLM locale risiede nella sua capacità di migliorare la sicurezza dei dati senza inviare dati all'esterno ad API di terze parti. Inoltre, puoi perfezionare il tuo LLM scelto con dati specifici del dominio, ottenendo un'esperienza di comprensione del linguaggio più accurata, consapevole del contesto e naturale.

La serie Jurassic-2 di AI21 Labs, che si basa sul Jurassic-178 LLM da 1 miliardi di parametri ottimizzato per le istruzioni, è parte integrante dei modelli di base di Amazon disponibili tramite Roccia Amazzonica. L'istruzione Jurassic-2 è stata appositamente addestrata per gestire i prompt che sono solo istruzioni, noti come colpo zero, senza bisogno di esempi, o pochi colpi. Questo metodo fornisce l'interazione più intuitiva con gli LLM ed è l'approccio migliore per comprendere l'output ideale per la tua attività senza richiedere esempi. Puoi distribuire in modo efficiente J2-jumbo-instruct preaddestrato o altri modelli Jurassic-2 disponibili su AWS Marketplace nel tuo cloud privato virtuale (VPC) utilizzando Amazon Sage Maker. Vedi il seguente codice:

import ai21, sagemaker # Define endpoint name

endpoint_name = "sagemaker-soln-j2-jumbo-instruct"

# Define real-time inference instance type. You can also choose g5.48xlarge or p4de.24xlarge instance types

# Please request P instance quota increase via <a href="https://console.aws.amazon.com/servicequotas/home" target="_blank" rel="noopener">Service Quotas console</a> or your account manager

real_time_inference_instance_type = ("ml.p4d.24xlarge") # Create a Sgaemkaer endpoint then deploy a pre-trained J2-jumbo-instruct-v1 model from AWS Market Place.

model_package_arn = "arn:aws:sagemaker:us-east-1:865070037744:model-package/j2-jumbo-instruct-v1-0-20-8b2be365d1883a15b7d78da7217cdeab"

model = ModelPackage(

role=sagemaker.get_execution_role(),

model_package_arn=model_package_arn,

sagemaker_session=sagemaker.Session()

) # Deploy the model

predictor = model.deploy(1, real_time_inference_instance_type,

endpoint_name=endpoint_name,

model_data_download_timeout=3600,

container_startup_health_check_timeout=600,

)Dopo che l'endpoint è stato distribuito correttamente all'interno del tuo VPC, puoi avviare un'attività di inferenza per verificare che l'LLM distribuito funzioni come previsto:

response_jumbo_instruct = ai21.Completion.execute(

sm_endpoint=endpoint_name,

prompt="Explain deep learning algorithms to 8th graders",

numResults=1,

maxTokens=100,

temperature=0.01 #subject to reduce “hallucination” by using common words.

)Elaborazione, incorporamento e indicizzazione dei documenti

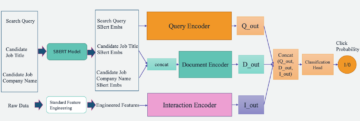

Approfondiamo il processo di costruzione di un indice di ricerca efficiente ed efficace, che costituisce la base per dialoghi intelligenti e reattivi per guidare l'elaborazione dei documenti. Per iniziare, convertiamo documenti da vari formati in contenuto di testo utilizzando OCR e Testo Amazon. Quindi leggiamo questo contenuto e lo frammentiamo in pezzi più piccoli, idealmente delle dimensioni di una frase ciascuno. Questo approccio granulare consente risultati di ricerca più precisi e pertinenti, poiché consente una migliore corrispondenza delle query rispetto ai singoli segmenti di una pagina piuttosto che all'intero documento. Per migliorare ulteriormente il processo, utilizziamo incorporamenti come il libreria di trasformatori di frasi da Hugging Face, che genera rappresentazioni vettoriali (codifica) di ciascuna frase. Questi vettori fungono da rappresentazione compatta e significativa del testo originale, consentendo una funzionalità di corrispondenza semantica efficiente e accurata. Infine, memorizziamo questi vettori in un database vettoriale per la ricerca di similarità. Questa combinazione di tecniche pone le basi per un nuovo framework di elaborazione dei documenti che fornisce risultati accurati e intuitivi per gli utenti. Il diagramma seguente illustra questo flusso di lavoro.

L'OCR funge da elemento cruciale nella soluzione, consentendo il recupero di testo da documenti o immagini scansionati. Possiamo utilizzare Amazon Textract per estrarre testo da file PDF o immagine. Questo servizio OCR gestito è in grado di identificare ed esaminare il testo in documenti multipagina, inclusi quelli in formato PDF, JPEG o TIFF, come fatture e ricevute. L'elaborazione di documenti multipagina avviene in modo asincrono, rendendola vantaggiosa per la gestione di documenti estesi e multipagina. Vedere il seguente codice:

def pdf_2_text(input_pdf_file, history):

history = history or []

key = 'input-pdf-files/{}'.format(os.path.basename(input_pdf_file.name))

try:

response = s3_client.upload_file(input_pdf_file.name, default_bucket_name, key)

except ClientError as e:

print("Error uploading file to S3:", e)

s3_object = {'Bucket': default_bucket_name, 'Name': key}

response = textract_client.start_document_analysis(

DocumentLocation={'S3Object': s3_object},

FeatureTypes=['TABLES', 'FORMS']

)

job_id = response['JobId']

while True:

response = textract_client.get_document_analysis(JobId=job_id)

status = response['JobStatus']

if status in ['SUCCEEDED', 'FAILED']:

break

time.sleep(5) if status == 'SUCCEEDED':

with open(output_file, 'w') as output_file_io:

for block in response['Blocks']:

if block['BlockType'] in ['LINE', 'WORD']:

output_file_io.write(block['Text'] + 'n')

with open(output_file, "r") as file:

first_512_chars = file.read(512).replace("n", "").replace("r", "").replace("[", "").replace("]", "") + " [...]"

history.append(("Document conversion", first_512_chars))

return history, historyQuando si ha a che fare con documenti di grandi dimensioni, è fondamentale suddividerli in parti più gestibili per un'elaborazione più semplice. Nel caso di LangChain, ciò significa dividere ogni documento in segmenti più piccoli, ad esempio 1,000 token per blocco con una sovrapposizione di 100 token. Per raggiungere questo obiettivo senza problemi, LangChain utilizza splitter specializzati progettati appositamente per questo scopo:

from langchain.text_splitter import CharacterTextSplitter

from langchain.document_loaders import TextLoader

separator = 'n'

overlap_count = 100. # overlap count between the splits

chunk_size = 1000 # Use a fixed split unit size

loader = TextLoader(output_file)

documents = loader.load()

text_splitter = CharacterTextSplitter(separator=separator, chunk_overlap=overlap_count, chunk_size=chunk_size, length_function=len)

texts = text_splitter.split_documents(documents)La durata necessaria per l'incorporamento può variare in base alle dimensioni del documento; ad esempio, potrebbero essere necessari circa 10 minuti per terminare. Anche se questo lasso di tempo potrebbe non essere sostanziale quando si ha a che fare con un singolo documento, le ramificazioni diventano più notevoli quando si indicizzano centinaia di gigabyte anziché solo centinaia di megabyte. Per accelerare il processo di incorporamento, puoi implementare lo sharding, che abilita la parallelizzazione e di conseguenza migliora l'efficienza:

from langchain.document_loaders import ReadTheDocsLoader

from langchain.text_splitter import RecursiveCharacterTextSplitter

from sentence_transformers import SentenceTransformer

import numpy as np

import ray

from embeddings import LocalHuggingFaceEmbeddings # Define number of splits

db_shards = 10 loader = TextLoader(output_file)

text_splitter = RecursiveCharacterTextSplitter(

chunk_size = 1000,

chunk_overlap = 100,

length_function = len,

) @ray.remote()

def process_shard(shard):

embeddings = LocalHuggingFaceEmbeddings('multi-qa-mpnet-base-dot-v1')

result = Chroma.from_documents(shard, embeddings)

return result # Read the doc content and split them into chunks.

chunks = text_splitter.create_documents([doc.page_content for doc in documents], metadatas=[doc.metadata for doc in documents])

# Embed the doc chunks into vectors.

shards = np.array_split(chunks, db_shards)

futures = [process_shard.remote(shards[i]) for i in range(db_shards)]

texts = ray.get(futures)Ora che abbiamo ottenuto i segmenti più piccoli, possiamo continuare a rappresentarli come vettori tramite incorporamenti. Gli incorporamenti, una tecnica in PNL, generano rappresentazioni vettoriali di prompt testuali. La classe Embedding funge da interfaccia unificata per l'interazione con vari provider di incorporamento, ad esempio SageMaker, avere coesione, Abbracciare il visoe OpenAI, che semplifica il processo su diverse piattaforme. Questi incorporamenti sono rappresentazioni numeriche di idee trasformate in sequenze numeriche, consentendo ai computer di comprendere senza sforzo le connessioni tra queste idee. Vedere il seguente codice:

# Choose a SageMaker deployed local LLM endpoint for embedding

llm_embeddings = SagemakerEndpointEmbeddings(

endpoint_name=<endpoint_name>,

region_name=<region>,

content_handler=content_handler

)Dopo aver creato gli incorporamenti, dobbiamo utilizzare un vectorstore per memorizzare i vettori. Vettoriali negozi come Chroma sono appositamente progettati per costruire indici per ricerche rapide in spazi ad alta dimensione in seguito, rendendoli perfettamente adatti ai nostri obiettivi. In alternativa, puoi usare FAISS, una soluzione di clustering vettoriale open source per l'archiviazione di vettori. Vedere il seguente codice:

from langchain.vectorstores import Chroma

# Store vectors in Chroma vectorDB

docsearch_chroma = Chroma.from_documents(texts, llm_embeddings)

# Alternatively you can choose FAISS vectorstore

from langchain.vectorstores import FAISS

docsearch_faiss = FAISS.from_documents(texts, llm_embeddings)È inoltre possibile utilizzare Amazon Kendra per indicizzare i contenuti aziendali e produrre risposte precise. Come servizio completamente gestito, Amazon Kendra offre funzioni di ricerca semantica pronte all'uso per la classificazione avanzata di documenti e passaggi. Con la ricerca ad alta precisione in Amazon Kendra, puoi ottenere i contenuti e i documenti più pertinenti per ottimizzare la qualità del tuo payload. Ciò si traduce in risposte LLM superiori rispetto ai metodi di ricerca tradizionali o incentrati sulle parole chiave. Per ulteriori informazioni, fare riferimento a Crea rapidamente applicazioni di intelligenza artificiale generativa ad alta precisione sui dati aziendali utilizzando Amazon Kendra, LangChain e modelli di linguaggio di grandi dimensioni.

Input vocale multilingue interattivo

L'incorporazione dell'input vocale interattivo nella ricerca di documenti offre una miriade di vantaggi che migliorano l'esperienza dell'utente. Consentendo agli utenti di articolare verbalmente i termini di ricerca, la ricerca dei documenti diventa più naturale e intuitiva, rendendo più semplice e veloce per gli utenti trovare le informazioni di cui hanno bisogno. L'input vocale può rafforzare la precisione dei risultati di ricerca, poiché i termini di ricerca pronunciati sono meno soggetti a errori di ortografia o grammaticali. L'input vocale interattivo rende la ricerca di documenti più inclusiva, adatta a uno spettro più ampio di utenti con lingue diverse e background culturale.

I SDK per lo streaming di Amazon Transcribe consente di eseguire il riconoscimento audio-vocale integrandosi direttamente con Amazon Transcribe semplicemente con un flusso di byte audio e un gestore di base. In alternativa, puoi distribuire il file grande sussurro modella localmente da Hugging Face utilizzando SageMaker, che offre una maggiore sicurezza dei dati e migliori prestazioni. Per i dettagli, consultare il taccuino di esempio pubblicato sul repository GitHub.

# Choose ASR using a locally deployed Whisper-large model from Hugging Face

image = sagemaker.image_uris.retrieve(

framework='pytorch',

region=region,

image_scope='inference',

version='1.12',

instance_type='ml.g4dn.xlarge',

) model_name = f'sagemaker-soln-whisper-model-{int(time.time())}'

whisper_model_sm = sagemaker.model.Model(

model_data=model_uri,

image_uri=image,

role=sagemaker.get_execution_role(),

entry_point="inference.py",

source_dir='src',

name=model_name,

) # Audio transcribe

transcribe = whisper_endpoint.predict(audio.numpy())Il video dimostrativo di cui sopra mostra come i comandi vocali, in combinazione con l'immissione di testo, possono facilitare l'attività di riepilogo del documento attraverso una conversazione interattiva.

Guidare le attività di PNL attraverso conversazioni a più turni

La memoria nei modelli linguistici mantiene un concetto di stato durante le interazioni di un utente. Ciò comporta l'elaborazione di una sequenza di messaggi di chat per estrarre e trasformare la conoscenza. I tipi di memoria variano, ma ognuno può essere compreso utilizzando funzioni autonome e all'interno di una catena. La memoria può restituire più punti dati, come messaggi recenti o riepiloghi di messaggi, sotto forma di stringhe o elenchi. Questo post si concentra sulla forma di memoria più semplice, la memoria buffer, che memorizza tutti i messaggi precedenti e ne dimostra l'utilizzo con funzioni e catene di utilità modulari.

Il LangChain ChatMessageCronologia class è un'utilità cruciale per i moduli di memoria, che fornisce metodi convenienti per salvare e recuperare messaggi umani e AI ricordando tutte le precedenti interazioni di chat. È ideale per gestire la memoria esternamente da una catena. Il codice seguente è un esempio di applicazione di un concetto semplice in una catena introducendo Memoria buffer di conversazione, un involucro per ChatMessageHistory. Questo wrapper estrae i messaggi in una variabile, consentendo loro di essere rappresentati come una stringa:

from langchain.memory import ConversationBufferMemory

memory = ConversationBufferMemory(return_messages=True)LangChain collabora con molti famosi fornitori di LLM come AI21 Labs, OpenAI, Cohere, Hugging Face e altri. Per questo esempio, utilizziamo un wrapper LLM Jurassic-21 di AI2 Labs distribuito localmente utilizzando SageMaker. AI21 Studio fornisce anche l'accesso API agli LLM Jurassic-2.

from langchain import PromptTemplate, SagemakerEndpoint

from langchain.llms.sagemaker_endpoint import ContentHandlerBase

from langchain.chains.question_answering import load_qa_chain prompt= PromptTemplate(

template=prompt_template, input_variables=["context", "question"]

) class ContentHandler(ContentHandlerBase):

content_type = "application/json"

accepts = "application/json"

def transform_input(self, prompt: str, model_kwargs: Dict) -- bytes:

input_str = json.dumps({prompt: prompt, **model_kwargs})

return input_str.encode('utf-8') def transform_output(self, output: bytes) -- str:

response_json = json.loads(output.read().decode("utf-8"))

return response_json[0]["generated_text"]

content_handler = ContentHandler()

llm_ai21=SagemakerEndpoint(

endpoint_name=endpoint_name,

credentials_profile_name=f'aws-credentials-profile-name',

region_name="us-east-1",

model_kwargs={"temperature":0},

content_handler=content_handler) qa_chain = VectorDBQA.from_chain_type(

llm=llm_ai21,

chain_type='stuff',

vectorstore=docsearch,

verbose=True,

memory=ConversationBufferMemory(return_messages=True)

) response = qa_chain(

{'query': query_input},

return_only_outputs=True

)Nel caso in cui il processo non sia in grado di individuare una risposta appropriata dai documenti originali in risposta alla richiesta di un utente, l'integrazione di un URL di terze parti o, idealmente, di un agente autonomo guidato da attività con fonti di dati esterne migliora significativamente la capacità del sistema di accedere a una vasta gamma di informazioni, migliorando in ultima analisi il contesto e fornendo risultati più accurati e attuali.

Con il metodo di esecuzione Summarize preconfigurato di AI21, una query può accedere a un URL predeterminato, condensarne il contenuto e quindi eseguire attività di domande e risposte in base alle informazioni riepilogate:

# Call AI21 API to query the context of a specific URL for Q&A

ai21.api_key = "<YOUR_API_KEY>"

url_external_source = "<your_source_url>"

response_url = ai21.Summarize.execute(

source=url_external_source,

sourceType="URL" )

context = "<concate_document_and_response_url>"

question = "<query>"

response = ai21.Answer.execute(

context=context,

question=question,

sm_endpoint=endpoint_name,

maxTokens=100,

)Per ulteriori dettagli ed esempi di codice, fare riferimento a Documento di integrazione LangChain LLM nonché documenti API specifici dell'attività forniti da AI21.

Automazione delle attività utilizzando BabyAGI

Il meccanismo di automazione delle attività consente al sistema di elaborare query complesse e generare risposte pertinenti, il che migliora notevolmente la validità e l'autenticità dell'elaborazione dei documenti. BabyAGI di LangCain è un potente sistema di gestione delle attività basato sull'intelligenza artificiale in grado di creare, stabilire le priorità ed eseguire autonomamente le attività. Una delle caratteristiche principali è la sua capacità di interfacciarsi con fonti di informazioni esterne, come il Web, i database e le API. Un modo per utilizzare questa funzione è integrare BabyAGI con Serpappi, un'API del motore di ricerca che fornisce l'accesso ai motori di ricerca. Questa integrazione consente a BabyAGI di cercare nel Web informazioni relative alle attività, consentendo a BabyAGI di accedere a una vasta gamma di informazioni oltre ai documenti di input.

La capacità di tasking autonomo di BabyAGI è alimentata da un LLM, un database di ricerca vettoriale, un wrapper API per collegamenti esterni e il framework LangChain, che gli consente di eseguire un'ampia gamma di attività in vari domini. Ciò consente al sistema di eseguire in modo proattivo attività basate sulle interazioni dell'utente, semplificando la pipeline di elaborazione dei documenti che incorpora fonti esterne e creando un'esperienza più efficiente e fluida. Il diagramma seguente illustra il processo di automazione delle attività.

Questo processo include i seguenti componenti:

- Memorie – La memoria memorizza tutte le informazioni di cui BabyAGI ha bisogno per completare i suoi compiti. Ciò include l'attività stessa, nonché eventuali risultati o dati intermedi generati da BabyAGI.

- Agente di esecuzione – L'agente di esecuzione è responsabile dell'esecuzione delle attività archiviate nella memoria. Lo fa accedendo alla memoria, recuperando le informazioni rilevanti e quindi adottando i passaggi necessari per completare l'attività.

- Agente di creazione di attività – L'agente di creazione delle attività è responsabile della generazione di nuove attività da completare per BabyAGI. Lo fa analizzando lo stato attuale della memoria e identificando eventuali lacune nella conoscenza o nella comprensione. Quando viene individuata una lacuna, l'agente di creazione dell'attività genera una nuova attività che aiuterà BabyAGI a colmare tale lacuna.

- Coda di attività – La coda delle attività è un elenco di tutte le attività assegnate a BabyAGI. Le attività vengono aggiunte alla coda nell'ordine in cui sono state ricevute.

- Agente di prioritizzazione delle attività – L'agente di prioritizzazione delle attività è responsabile della determinazione dell'ordine in cui BabyAGI deve completare le proprie attività. Lo fa analizzando le attività in coda e identificando quelle più importanti o urgenti. Le attività più importanti sono posizionate in cima alla coda e le attività meno importanti sono posizionate in fondo alla coda.

Vedi il seguente codice:

from babyagi import BabyAGI

from langchain.docstore import InMemoryDocstore

import faiss

# Set temperatur=0 to generate the most frequent words, instead of more “poetically free” behavior.

new_query = """

What happened to the First Republic Bank? Will the FED take the same action as it did on SVB's failure? """

# Enable verbose logging and use a fixed embedding size.

verbose = True

embedding_size = 1536 # Using FAISS vector cluster for vectore store

index = faiss.IndexFlatL2(embedding_size)

vectorstore = FAISS(llm_embeddings.embed_query, index, InMemoryDocstore({}), {}) # Choose 1 iteration for demo and 1>N>10 for real. If None, it will loop indefinitely

max_iterations: Optional[int] = 2 # Call bayagi class for task automation

baby_agi = BabyAGI.from_llm(

llm=llm_embedding, vectorstore=vectorstore, verbose=verbose, max_iterations=max_iterations<br />) response = baby_agi({"objective": new_query})Esaminiamo le attività raccolte ei relativi risultati da una singola iterazione, utilizzata a scopo dimostrativo, per raggiungere l'obiettivo in risposta alla richiesta dell'utente. BabyAGI opera attraverso un ciclo continuo delle seguenti fasi:

- Un agente di creazione di attività formula una nuova attività.

- La nuova attività viene incorporata nella coda delle attività.

- L'agente di prioritizzazione delle attività stabilisce la sequenza in cui le attività devono essere affrontate.

- L'agente di esecuzione esegue l'attività.

- L'esito dell'attività viene salvato nella memoria.

- Il ciclo si ripete.

Questo processo iterativo consente a BabyAGI di apprendere e svilupparsi nel tempo. Man mano che completa con successo un numero crescente di compiti, la conoscenza e la comprensione del mondo di BabyAGI si espandono. Di conseguenza, può generare ed eseguire in modo efficiente attività più complesse e avanzate. Aumentando il conteggio delle iterazioni, puoi migliorare il risultato attraverso la riorganizzazione dell'elenco delle attività, che si concentra sull'obiettivo e sul risultato delle attività precedenti, ottenendo in definitiva risposte più pertinenti e precise.

Vedere il seguente output di esempio:

*****TASK LIST*****

1: Make a todo list

*****NEXT TASK*****

1: Make a todo list

> Entering new AgentExecutor chain...

Thought: I need to research the First Republic Bank and the FED's action

Action: Search

Action Input: What happened to the First Republic Bank? Will the FED take the same action as it did on SVB's failure?

Observation: First Republic's failure was due to a run on deposits following the collapse of Silicon Valley Bank and Signature Bank. JPMorgan Chase acquired

First Republic Bank on May 1, 2023. If you had insured or uninsured money in First Republic accounts, your funds are safe and now managed by JPMorgan Chase.

Thought: I need to research the FED's action on SVB's failure

Action: Search

Action Input: What action did the FED take on SVB's failure?

Observation: The Hutchins Center explains how the Federal Reserve has responded to the March 2023 failures of Silicon Valley Bank and Signature Bank.

Thought: I now know the final answer

Final Answer: The FED responded to the March 2023 failures of Silicon Valley Bank and <br />Signature Bank by providing liquidity to the banking system. JPMorgan Chase acquired First Republic Bank on May 1, 2023, and if you had insured or uninsured money in First Republic accounts, your funds are safe and now managed by JPMorgan Chase.

> Finished chain.

*****TASK RESULT*****

The Federal Reserve responded to the March 2023 failures of Silicon Valley Bank and Signature Bank by providing liquidity to the banking system. It is unclear what action the FED will take in response to the failure of First Republic Bank. ***TASK LIST*** 2: Research the timeline of First Republic Bank's failure.

3: Analyze the Federal Reserve's response to the failure of Silicon Valley Bank and Signature Bank.

4: Compare the Federal Reserve's response to the failure of Silicon Valley Bank and Signature Bank to the Federal Reserve's response to the failure of First Republic Bank.

5: Investigate the potential implications of the Federal Reserve's response to the failure of First Republic Bank.

6: Identify any potential risks associated with the Federal Reserve's response to the failure of First Republic Bank.<br />*****NEXT TASK***** 2: Research the timeline of First Republic Bank's failure. > Entering new AgentExecutor chain...

Will the FED take the same action as it did on SVB's failure?

Thought: I should search for information about the timeline of First Republic Bank's failure and the FED's action on SVB's failure.

Action: Search

Action Input: Timeline of First Republic Bank's failure and FED's action on SVB's failure

Observation: March 20: The FDIC decides to break up SVB and hold two separate auctions for its traditional deposits unit and its private bank after failing ...

Thought: I should look for more information about the FED's action on SVB's failure.

Action: Search

Action Input: FED's action on SVB's failure

Observation: The Fed blamed failures on mismanagement and supervisory missteps, compounded by a dose of social media frenzy.

Thought: I now know the final answer.

Final Answer: The FED is likely to take similar action on First Republic Bank's failure as it did on SVB's failure, which was to break up the bank and hold two separate auctions for its traditional deposits unit and its private bank.</p><p>> Finished chain. *****TASK RESULT*****

The FED responded to the March 2023 failures of ilicon Valley Bank and Signature Bank by providing liquidity to the banking system. JPMorgan Chase acquired First Republic Bank on May 1, 2023, and if you had insured or uninsured money in First Republic accounts, your funds are safe and now managed by JPMorgan Chase.*****TASK ENDING*****Con BabyAGI per l'automazione delle attività, il sistema IDP guidato dal dialogo ha mostrato la sua efficacia andando oltre il contesto del documento originale per rispondere alla domanda dell'utente sulle potenziali azioni della Federal Reserve riguardanti il fallimento della First Republic Bank, avvenuto alla fine di aprile 2023, 1 mese dopo la pubblicazione di esempio, rispetto al fallimento di SVB. Per raggiungere questo obiettivo, il sistema ha generato un elenco di cose da fare e ha completato le attività in sequenza. Ha indagato sulle circostanze del fallimento della First Republic Bank, ha individuato i potenziali rischi legati alla risposta della Federal Reserve e l'ha confrontata con la risposta al fallimento di SVB.

Sebbene BabyAGI rimanga un work in progress, porta con sé la promessa di rivoluzionare le interazioni tra macchine, il pensiero inventivo e la risoluzione dei problemi. Man mano che l'apprendimento e il miglioramento di BabyAGI persistono, sarà in grado di produrre risposte più precise, perspicaci e creative. Consentendo alle macchine di apprendere ed evolversi autonomamente, BabyAGI potrebbe facilitare la loro assistenza in un ampio spettro di attività, che vanno dalle faccende banali alla risoluzione di problemi complessi.

Vincoli e limitazioni

L'IDP guidato dal dialogo offre un approccio promettente per migliorare l'efficienza e l'efficacia dell'analisi e dell'estrazione dei documenti. Tuttavia, dobbiamo riconoscere i suoi attuali vincoli e limiti, come la necessità di evitare il pregiudizio dei dati, la mitigazione delle allucinazioni, la sfida di gestire un linguaggio complesso e ambiguo e le difficoltà nella comprensione del contesto o nel mantenere la coerenza nelle conversazioni più lunghe.

Inoltre, è importante considerare le confabulazioni e le allucinazioni nelle risposte generate dall'intelligenza artificiale, che possono portare alla creazione di informazioni imprecise o fabbricate. Per affrontare queste sfide, gli sviluppi in corso si stanno concentrando sul perfezionamento di LLM con migliori capacità di comprensione del linguaggio naturale, incorporando conoscenze specifiche del dominio e sviluppando modelli più solidi sensibili al contesto. Costruire un LLM da zero può essere costoso e richiedere molto tempo; tuttavia, puoi utilizzare diverse strategie per migliorare i modelli esistenti:

- Messa a punto di un LLM pre-addestrato su domini specifici per risultati più accurati e pertinenti

- Integrazione di fonti di dati esterne note per essere sicure durante l'inferenza per una migliore comprensione contestuale

- Progettare prompt migliori per ottenere risposte più precise dal modello

- Utilizzo di modelli di ensemble per combinare gli output di più LLM, calcolando la media degli errori e riducendo al minimo le possibilità di allucinazioni

- Costruire guardrail per impedire ai modelli di deviare verso aree indesiderate, garantendo al tempo stesso che le app rispondano con informazioni accurate e appropriate

- Conduzione di una messa a punto supervisionata con feedback umano, perfezionamento iterativo del modello per una maggiore precisione e una riduzione delle allucinazioni.

Adottando questi approcci, le risposte generate dall'IA possono essere rese più affidabili e preziose.

L'agente autonomo guidato dalle attività offre un potenziale significativo in varie applicazioni, ma è fondamentale considerare i rischi principali prima di adottare la tecnologia. Questi rischi includono:

- Privacy dei dati e violazioni della sicurezza dovute alla dipendenza dal provider LLM selezionato e da vectorDB

- Preoccupazioni etiche derivanti dalla generazione di contenuti distorti o dannosi

- Dipendenza dall'accuratezza del modello, che può portare a un completamento dell'attività inefficace o a risultati indesiderati

- Sovraccarico del sistema e problemi di scalabilità se la generazione delle attività supera il completamento, richiedendo una corretta sequenza delle attività e una gestione parallela

- Interpretazione errata della definizione delle priorità delle attività basata sulla comprensione dell'importanza delle attività da parte del LLM

- L'autenticità dei dati ricevuti dal web

Affrontare questi rischi è fondamentale per un'applicazione responsabile e di successo, consentendoci di massimizzare i vantaggi dei modelli linguistici basati sull'intelligenza artificiale riducendo al minimo i potenziali rischi.

Conclusioni

La soluzione guidata dal dialogo per IDP presenta un approccio rivoluzionario all'elaborazione dei documenti integrando OCR, riconoscimento vocale automatico, LLM, automazione delle attività e fonti di dati esterne. Questa soluzione completa consente alle aziende di semplificare i flussi di lavoro di elaborazione dei documenti, rendendoli più efficienti e intuitivi. Incorporando queste tecnologie all'avanguardia, le organizzazioni possono non solo rivoluzionare i propri processi di gestione dei documenti, ma anche rafforzare le capacità decisionali e aumentare notevolmente la produttività complessiva. La soluzione offre alle aziende un mezzo innovativo e trasformativo per sbloccare il pieno potenziale dei loro flussi di lavoro documentali, guidando in ultima analisi la crescita e il successo nell'era dell'IA generativa. Fare riferimento a SageMaker Jumpstart per altre soluzioni e Roccia Amazzonica per ulteriori modelli di intelligenza artificiale generativa.

Gli autori desiderano esprimere sinceramente il loro apprezzamento a Ryan Kilpatrick, Ashish Lal e Kristine Pearce per i loro preziosi input e contributi a questo lavoro. Riconoscono anche Clay Elmore per l'esempio di codice fornito su Github.

Circa gli autori

Alfred Shen è Senior AI/ML Specialist presso AWS. Ha lavorato nella Silicon Valley, ricoprendo posizioni tecniche e manageriali in diversi settori tra cui sanità, finanza e high-tech. È un ricercatore dedicato all'AI/ML applicato, che si concentra su CV, PNL e multimodalità. Il suo lavoro è stato presentato in pubblicazioni come EMNLP, ICLR e Public Health.

Alfred Shen è Senior AI/ML Specialist presso AWS. Ha lavorato nella Silicon Valley, ricoprendo posizioni tecniche e manageriali in diversi settori tra cui sanità, finanza e high-tech. È un ricercatore dedicato all'AI/ML applicato, che si concentra su CV, PNL e multimodalità. Il suo lavoro è stato presentato in pubblicazioni come EMNLP, ICLR e Public Health.

Dott. Vivek Madan è uno scienziato applicato con il team Amazon SageMaker JumpStart. Ha conseguito il dottorato di ricerca presso l'Università dell'Illinois a Urbana-Champaign ed è stato ricercatore post-dottorato presso la Georgia Tech. È un ricercatore attivo nell'apprendimento automatico e nella progettazione di algoritmi e ha pubblicato articoli in conferenze EMNLP, ICLR, COLT, FOCS e SODA.

Dott. Vivek Madan è uno scienziato applicato con il team Amazon SageMaker JumpStart. Ha conseguito il dottorato di ricerca presso l'Università dell'Illinois a Urbana-Champaign ed è stato ricercatore post-dottorato presso la Georgia Tech. È un ricercatore attivo nell'apprendimento automatico e nella progettazione di algoritmi e ha pubblicato articoli in conferenze EMNLP, ICLR, COLT, FOCS e SODA.

Dott. Li Zhang è un Principal Product Manager-Technical for JumpStart di Amazon SageMaker ed Algoritmi integrati di Amazon SageMaker, un servizio che aiuta i data scientist e i professionisti dell'apprendimento automatico a iniziare a formare e distribuire i propri modelli e utilizza insegnamento rafforzativo con Amazon SageMaker. Il suo lavoro passato come membro principale dello staff di ricerca e inventore principale presso IBM Research ha vinto il prova del premio carta del tempo presso IEEE INFOCOM.

Dott. Li Zhang è un Principal Product Manager-Technical for JumpStart di Amazon SageMaker ed Algoritmi integrati di Amazon SageMaker, un servizio che aiuta i data scientist e i professionisti dell'apprendimento automatico a iniziare a formare e distribuire i propri modelli e utilizza insegnamento rafforzativo con Amazon SageMaker. Il suo lavoro passato come membro principale dello staff di ricerca e inventore principale presso IBM Research ha vinto il prova del premio carta del tempo presso IEEE INFOCOM.

Il dottor Changsha Ma è uno specialista AI/ML presso AWS. È una tecnologa con un dottorato in informatica, un master in psicologia dell'educazione e anni di esperienza nella scienza dei dati e nella consulenza indipendente in AI/ML. È appassionata di ricercare approcci metodologici per la macchina e l'intelligenza umana. Al di fuori del lavoro, ama fare escursioni, cucinare, andare a caccia di cibo, fare da mentore agli studenti universitari per l'imprenditorialità e passare il tempo con amici e famiglie.

Il dottor Changsha Ma è uno specialista AI/ML presso AWS. È una tecnologa con un dottorato in informatica, un master in psicologia dell'educazione e anni di esperienza nella scienza dei dati e nella consulenza indipendente in AI/ML. È appassionata di ricercare approcci metodologici per la macchina e l'intelligenza umana. Al di fuori del lavoro, ama fare escursioni, cucinare, andare a caccia di cibo, fare da mentore agli studenti universitari per l'imprenditorialità e passare il tempo con amici e famiglie.

- Distribuzione di contenuti basati su SEO e PR. Ricevi amplificazione oggi.

- PlatoAiStream. Intelligenza dei dati Web3. Conoscenza amplificata. Accedi qui.

- Coniare il futuro con Adryenn Ashley. Accedi qui.

- Acquista e vendi azioni in società PRE-IPO con PREIPO®. Accedi qui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/dialogue-guided-intelligent-document-processing-with-foundation-models-on-amazon-sagemaker-jumpstart/

- :ha

- :È

- :non

- ][P

- $ SU

- 000

- 1

- 10

- 100

- 12

- 20

- 2023

- 8°

- a

- capacità

- Chi siamo

- sopra

- accetta

- accesso

- Accedendo

- realizzare

- Il mio account

- conti

- precisione

- preciso

- Raggiungere

- riconoscere

- acquisito

- operanti in

- Action

- azioni

- attivo

- adattare

- aggiunto

- l'aggiunta di

- aggiuntivo

- Inoltre

- indirizzo

- indirizzamento

- Adottando

- Adozione

- Avanzate

- avanzamenti

- Vantaggio

- vantaggioso

- vantaggi

- Dopo shavasana, sedersi in silenzio; saluti;

- contro

- Agente

- AI

- AI-alimentato

- AI / ML

- algoritmo

- Algoritmi

- Tutti

- Consentire

- consente

- anche

- alternativa

- Sebbene il

- Amazon

- Amazon Kendra

- Amazon Sage Maker

- JumpStart di Amazon SageMaker

- Testo Amazon

- Amazon Transcribe

- Amazon Web Services

- importi

- an

- .

- analizzare

- l'analisi

- ed

- rispondere

- risposte

- Anticipato

- in qualsiasi

- api

- Accesso API

- API

- Applicazioni

- applicazioni

- applicato

- AMMISSIONE

- apprezzamento

- approccio

- approcci

- opportuno

- applicazioni

- Aprile

- SONO

- aree

- in giro

- Italia

- AS

- addetto

- Assistenza

- associato

- At

- Aste

- Audio

- autenticità

- gli autori

- automatizza

- Automatico

- Automazione

- autonomo

- autonomamente

- disponibile

- media

- AWS

- Mercato AWS

- precedente

- sfondo

- Banca

- Settore bancario

- sistema bancario

- basato

- basic

- BE

- perché

- diventare

- diventa

- stato

- prima

- iniziare

- vantaggi

- MIGLIORE

- Meglio

- fra

- Al di là di

- pregiudizio

- parziale

- miliardi

- Bloccare

- Blocchi

- tavola

- sostenere

- Incremento

- violazioni

- Rompere

- bridging

- ampio

- più ampia

- bufferizzare

- costruire

- Costruzione

- incassato

- aziende

- ma

- by

- chiamata

- Materiale

- funzionalità

- capace

- Ultra-Grande

- trasportare

- trasporto

- Custodie

- centro

- catena

- Catene

- Challenge

- sfide

- Modifiche

- carattere

- riconoscimento del personaggio

- inseguimento

- Scegli

- scelto

- condizioni

- classe

- Cloud

- Cluster

- il clustering

- codice

- Crollo

- College

- combinazione

- combinare

- combina

- Uncommon

- confrontare

- rispetto

- confronto

- completamento di una

- Completato

- Completa

- completamento

- complesso

- componenti

- comprendere

- globale

- computer

- Informatica

- computer

- concetto

- preoccupazioni

- conferenze

- Connessioni

- conseguentemente

- Prendere in considerazione

- considerevolmente

- vincoli

- costruire

- consulting

- contenuto

- contesto

- contesti

- contestuale

- continua

- continuo

- contributi

- Comodo

- Conversazione

- Conversazioni

- Conversione

- convertire

- cucina

- Costo

- costoso

- potuto

- creare

- Creazione

- creazione

- cruciale

- Cultura

- Corrente

- Stato attuale

- bordo tagliente

- Tecnologie all'avanguardia

- ciclo

- dati

- distorsione dei dati

- punti dati

- scienza dei dati

- la sicurezza dei dati

- Banca Dati

- banche dati

- trattare

- Decision Making

- dedicato

- deep

- apprendimento profondo

- Laurea

- fornisce un monitoraggio

- Dimo

- dimostra

- schierare

- schierato

- distribuzione

- deployment

- depositi

- derivato

- Design

- progettato

- Nonostante

- dettagli

- determinazione

- sviluppare

- in via di sviluppo

- sviluppi

- Dialogo

- DITT

- DID

- diverso

- le difficoltà

- direttamente

- discutere

- paesaggio differenziato

- documento

- gestione documenti

- documenti

- effettua

- domini

- giù

- guida

- dovuto

- durata

- durante

- e

- ogni

- più facile

- facile

- Istruzione

- Efficace

- efficacia

- efficienza

- efficiente

- in modo efficiente

- elemento

- incastrare

- incorporamento

- che abilita

- enable

- Abilita

- consentendo

- endpoint

- motore

- Motori

- accrescere

- migliorata

- Migliora

- migliorando

- abbastanza

- assicurando

- entrare

- Impresa

- Intero

- l'imprenditorialità

- epoca

- errore

- errori

- stabilisce

- Etere (ETH)

- Evento

- evolvere

- esaminare

- esaminando

- esempio

- Esempi

- Tranne

- Cambi Merce

- esecuzione

- esistente

- Espandere

- esperienza

- Spiegare

- Spiega

- esplora

- esprimere

- estensivo

- esterno

- esternamente

- estratto

- estrazione

- estratti

- Faccia

- facilitare

- facilita

- fallito

- in mancanza di

- Fallimento

- famiglie

- FDIC

- caratteristica

- Caratteristiche

- Federale

- Federale

- Federal Reserve

- Riserva federale

- feedback

- Compila il

- File

- riempire

- finale

- Infine

- finanziare

- Trovare

- finire

- Nome

- fisso

- fluttuare

- si concentra

- messa a fuoco

- i seguenti

- cibo

- Nel

- modulo

- formato

- forme

- Fondazione

- TELAIO

- Contesto

- frenesia

- frequente

- amici

- da

- anteriore

- alimentato

- pieno

- completamente

- funzionalità

- funzionamento

- funzioni

- fondi

- ulteriormente

- Futures

- divario

- lacune

- raccolto

- generare

- generato

- genera

- la generazione di

- ELETTRICA

- generativo

- AI generativa

- Georgia

- ottenere

- GitHub

- scopo

- andando

- molto

- innovativo

- basi

- Crescita

- guida

- ha avuto

- Manovrabilità

- successo

- dannoso

- Sfruttamento

- Avere

- he

- Salute e benessere

- assistenza sanitaria

- Aiuto

- aiuta

- Alta

- evidenzia

- escursionismo

- il suo

- storia

- tenere

- possesso

- Come

- Tuttavia

- HTML

- HTTPS

- umano

- intelligenza umana

- centinaia

- Caccia

- i

- IBM

- ICLR

- ideale

- idee

- identificato

- identificare

- identificazione

- IEEE

- if

- Illinois

- illustra

- Immagine

- immagini

- realizzare

- implicazioni

- importare

- importante

- competenze

- migliorata

- miglioramento

- migliora

- miglioramento

- in

- In altre

- impreciso

- includere

- inclusi

- Compreso

- Inclusivo

- Incorporated

- incorpora

- incorporando

- Aumento

- è aumentato

- crescente

- studente indipendente

- Index

- indici

- individuale

- informazioni

- estrazione di informazioni

- avviare

- creativi e originali

- ingresso

- Ingressi

- chiedere informazioni

- inchiesta

- esempio

- invece

- istruzioni

- integrale

- integrare

- Integrazione

- integrazione

- Intelligence

- Intelligente

- Elaborazione intelligente dei documenti

- interagire

- si interagisce

- interazione

- interazioni

- interattivo

- Interfaccia

- Intermedio

- ai miglioramenti

- l'introduzione di

- intuizione

- intuitivo

- indagare

- comporta

- sicurezza

- IT

- iterazione

- SUO

- stessa

- jpg

- JPMorgan

- jpmorgan chase

- json

- ad appena

- Le

- Sapere

- conoscenze

- conosciuto

- Labs

- Dipingere

- Lingua

- grandi

- In ritardo

- dopo

- Lays

- portare

- principale

- IMPARARE

- apprendimento

- meno

- Eredità

- meno

- li

- Biblioteca

- si trova

- piace

- probabile

- limiti

- Limitato

- linea

- Collegamento

- Liquidità

- Lista

- elenchi

- caricatore

- locale

- a livello locale

- registrazione

- più a lungo

- Guarda

- ama

- Basso

- macchina

- machine learning

- macchine

- fatto

- mantiene

- make

- Fare

- gestire

- gestito

- gestione

- sistema di gestione

- direttore

- manageriale

- gestione

- Manuale

- molti

- Marzo

- Rappresentanza

- mercato

- massiccio

- Mastercard

- master

- corrispondenza

- Massimizzare

- Maggio..

- significativo

- si intende

- meccanismo

- Media

- membro

- Memorie

- mentoring

- messaggio

- messaggi

- Metadati

- metodo

- metodi

- minimizzando

- verbale

- cattiva gestione

- mancante

- attenuazione

- ML

- modello

- modelli

- componibile

- moduli

- soldi

- Mese

- Scopri di più

- più efficiente

- Inoltre

- maggior parte

- multiplo

- devono obbligatoriamente:

- Nome

- Naturale

- Linguaggio naturale

- Comprensione del linguaggio naturale

- necessaria

- Bisogno

- di applicazione

- esigenze

- New

- nlp

- notevole

- romanzo

- adesso

- numero

- numpy

- obiettivo

- Obiettivi d'Esame

- ottenere

- ottenuto

- si è verificato

- OCR

- of

- MENO

- Offerte

- on

- ONE

- quelli

- in corso

- esclusivamente

- open source

- OpenAI

- apertura

- opera

- opposto

- ottico

- riconoscimento ottico dei caratteri

- OTTIMIZZA

- or

- minimo

- organizzazioni

- i

- OS

- Altro

- nostro

- su

- Risultato

- risultati

- produzione

- al di fuori

- ancora

- complessivo

- Superare

- proprio

- pagina

- Carta

- documenti

- Parallel

- parametri

- Ricambi

- appassionato

- passato

- sentiero

- eseguire

- performance

- Immagini

- pezzi

- conduttura

- posto

- Piattaforme

- Platone

- Platone Data Intelligence

- PlatoneDati

- per favore

- punti

- Popolare

- posizioni

- Post

- potenziale

- potente

- bisogno

- Precisione

- Predictor

- regali

- prevenire

- precedente

- Direttore

- Precedente

- prioritizzazione

- Dare priorità

- Privacy

- Privacy e sicurezza

- un bagno

- Problema

- problem-solving

- processi

- i processi

- lavorazione

- produrre

- Prodotto

- produttivo

- della produttività

- Progressi

- PROMETTIAMO

- promettente

- corretto

- purché

- fornitore

- fornitori

- fornisce

- fornitura

- Psicologia

- la percezione

- sanità pubblica

- pubblicazioni

- pubblicato

- scopo

- fini

- pytorch

- Domande e risposte

- qualità

- query

- domanda

- Domande

- Presto

- più veloce

- che vanno

- Posizione

- piuttosto

- RAY

- Leggi

- di rose

- tempo reale

- ricevute

- ricevuto

- recente

- riconoscimento

- ridurre

- Ridotto

- raffinazione

- normativa

- relazionato

- pertinente

- affidabile

- fiducia

- resti

- ricordando

- rende

- riorganizzazione

- rappresentare

- rappresentazione

- rappresentato

- Repubblica

- richiesta

- Requisiti

- riparazioni

- ricercatore

- Prenotare

- riserve

- Risoluzione

- Rispondere

- risposta

- risposte

- responsabile

- di risposta

- colpevole

- risultante

- Risultati

- ritorno

- rivoluzionare

- rivoluzionando

- rischi

- robusto

- approssimativamente

- Correre

- Ryan

- s

- sicura

- sagemaker

- stesso

- Risparmi

- Scalabilità

- Scienze

- Scienziato

- scienziati

- graffiare

- Cerca

- motore di ricerca

- Motori di ricerca

- Settori

- problemi di

- violazioni della sicurezza

- vedere

- segmenti

- selezionato

- AUTO

- anziano

- condanna

- separato

- Sequenza

- sequenziamento

- Serie

- servire

- serve

- servizio

- Servizi

- set

- alcuni

- sharding

- lei

- dovrebbero

- in mostra

- Spettacoli

- firma

- significativa

- significativamente

- Silicio

- Silicon Valley

- silicio banca valle

- simile

- Un'espansione

- semplicemente

- singolo

- Taglia

- inferiore

- liscio

- Social

- Social Media

- soluzione

- Soluzioni

- fonti

- spazi

- Altoparlanti

- specialista

- specializzata

- appositamente

- specifico

- in particolare

- Spettro

- discorso

- Riconoscimento vocale

- Spendere

- dividere

- Si divide

- STAFF

- stakeholder

- standalone

- iniziato

- Regione / Stato

- Stato dei servizi

- Passi

- Ancora

- Tornare al suo account

- memorizzati

- negozi

- strategie

- ruscello

- Streaming

- snellire

- razionalizzazione

- Corda

- Gli studenti

- studio

- sostanziale

- il successo

- di successo

- Con successo

- tale

- riassumere

- superiore

- supporti

- Circostante

- adatto

- SVB

- sistema

- SISTEMI DI TRATTAMENTO

- Fai

- presa

- Task

- task

- team

- Tech

- Consulenza

- tecniche

- Tecnologie

- tecnologo

- Tecnologia

- condizioni

- di

- che

- I

- la Fed

- le informazioni

- il mondo

- loro

- Li

- poi

- Là.

- Strumenti Bowman per analizzare le seguenti finiture:

- di

- Pensiero

- di parti terze standard

- questo

- quelli

- pensiero

- Attraverso

- per tutto

- Legato

- tempo

- richiede tempo

- time line

- a

- Tokens

- tradizionale

- allenato

- Training

- Trasformare

- trasformativa

- trasformato

- trasformatori

- vero

- prova

- seconda

- Digitare

- Tipi di

- in definitiva

- incapace

- capire

- e una comprensione reciproca

- inteso

- unificato

- unità

- Università

- sbloccare

- up-to-date

- Aggiornamenti

- Caricamento

- urgente

- URL

- us

- Impiego

- uso

- utilizzato

- Utente

- Esperienza da Utente

- user-friendly

- utenti

- utilizzando

- utilità

- utilizzare

- utilizza

- validità

- Valle

- Prezioso

- vario

- Fisso

- verificare

- via

- Video

- Video

- virtuale

- importantissima

- Voce

- comandi vocali

- volumi

- W

- Prima

- Modo..

- we

- Ricchezza

- sito web

- servizi web

- WELL

- sono stati

- Che

- quando

- quale

- while

- volere

- con

- entro

- senza

- Ha vinto

- Word

- parole

- Lavora

- flusso di lavoro

- flussi di lavoro

- lavoro

- lavori

- mondo

- sarebbe

- anni

- cedevole

- Tu

- Trasferimento da aeroporto a Sharm

- zefiro