Questo post è stato scritto in collaborazione con Hernan Figueroa, Sr. Manager Data Science presso Marubeni Power International.

Marubeni Power International Inc (MPII) possiede e investe in piattaforme di business dell'energia nelle Americhe. Un importante verticale per MPII è la gestione delle risorse per le energie rinnovabili e le risorse di stoccaggio dell'energia, che sono fondamentali per ridurre l'intensità di carbonio della nostra infrastruttura energetica. Lavorare con risorse di energia rinnovabile richiede soluzioni digitali predittive e reattive, perché la generazione di energia rinnovabile e le condizioni del mercato dell'elettricità sono in continua evoluzione. MPII utilizza un motore di ottimizzazione delle offerte di machine learning (ML) per informare i processi decisionali a monte nella gestione e nel trading di risorse energetiche. Questa soluzione aiuta gli analisti di mercato a progettare ed eseguire strategie di offerta basate sui dati ottimizzate per la redditività degli asset energetici.

In questo post imparerai come Marubeni sta ottimizzando le decisioni di mercato utilizzando l'ampia gamma di servizi di analisi e ML di AWS, per creare una soluzione di Power Bid Optimization solida ed economica.

Panoramica della soluzione

I mercati dell'energia elettrica consentono di scambiare potenza ed energia per bilanciare l'offerta e la domanda di energia nella rete elettrica e per soddisfare le diverse esigenze di affidabilità della rete elettrica. I partecipanti al mercato, come gli operatori di asset MPII, offrono costantemente quantità di potenza ed energia in questi mercati dell'elettricità per ottenere profitti dai loro asset di energia. Un partecipante al mercato può presentare offerte a diversi mercati contemporaneamente per aumentare la redditività di un'attività, ma deve considerare i limiti di potenza dell'attività e la velocità di risposta, nonché altri vincoli operativi dell'attività e l'interoperabilità di tali mercati.

La soluzione del motore di ottimizzazione delle offerte di MPII utilizza modelli ML per generare offerte ottimali per la partecipazione a diversi mercati. Le offerte più comuni sono le offerte per l'energia del giorno prima, che devono essere presentate 1 giorno prima del giorno di negoziazione effettivo, e le offerte per l'energia in tempo reale, che devono essere presentate 75 minuti prima dell'orario di negoziazione. La soluzione orchestra l'offerta dinamica e il funzionamento di un asset potente e richiede l'utilizzo di funzionalità di ottimizzazione e predittive disponibili nei suoi modelli ML.

La soluzione Power Bid Optimization include più componenti che svolgono ruoli specifici. Esaminiamo i componenti coinvolti e la loro rispettiva funzione aziendale.

Raccolta e ingestione di dati

Il livello di raccolta e importazione dei dati si connette a tutte le origini dati upstream e carica i dati nel data lake. Le offerte del mercato elettrico richiedono almeno quattro tipi di input:

- Previsioni della domanda di energia elettrica

- Previsioni meteo

- Cronologia dei prezzi di mercato

- Previsioni sui prezzi dell'energia

Queste origini dati sono accessibili esclusivamente tramite API. Pertanto, i componenti di importazione devono essere in grado di gestire l'autenticazione, l'origine dei dati in modalità pull, la pre-elaborazione dei dati e l'archiviazione dei dati. Poiché i dati vengono recuperati ogni ora, è necessario anche un meccanismo per orchestrare e pianificare i processi di acquisizione.

Preparazione dei dati

Come con la maggior parte dei casi d'uso ML, la preparazione dei dati gioca un ruolo fondamentale. I dati provengono da fonti disparate in una serie di formati. Prima che sia pronto per essere utilizzato per l'addestramento del modello ML, deve eseguire alcuni dei seguenti passaggi:

- Consolida i set di dati orari in base all'ora di arrivo. Un set di dati completo deve includere tutte le fonti.

- Migliora la qualità dei dati utilizzando tecniche come la standardizzazione, la normalizzazione o l'interpolazione.

Alla fine di questo processo, i dati curati vengono messi in scena e resi disponibili per un ulteriore consumo.

Formazione e implementazione del modello

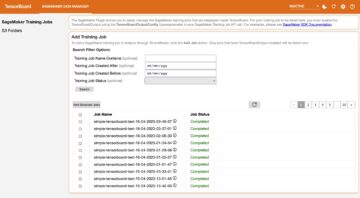

Il passaggio successivo consiste nell'addestrare e implementare un modello in grado di prevedere offerte di mercato ottimali per l'acquisto e la vendita di energia. Per ridurre al minimo il rischio di sottoperformance, Marubeni ha utilizzato la tecnica di modellazione dell'insieme. La modellazione dell'ensemble consiste nella combinazione di più modelli ML per migliorare le prestazioni di previsione. Marubeni riunisce i risultati dei modelli di previsione esterni e interni con una media ponderata per sfruttare la forza di tutti i modelli. I modelli interni di Marubeni si basano su architetture Long Short-Term Memory (LSTM), che sono ben documentate e facili da implementare e personalizzare in TensorFlow. Amazon Sage Maker supporta le distribuzioni TensorFlow e molti altri ambienti ML. Il modello esterno è proprietario e la sua descrizione non può essere inclusa in questo post.

Nel caso d'uso di Marubeni, i modelli di offerta eseguono l'ottimizzazione numerica per massimizzare le entrate utilizzando una versione modificata delle funzioni obiettivo utilizzate nella pubblicazione Opportunità per lo stoccaggio di energia in CAISO.

SageMaker consente a Marubeni di eseguire ML e algoritmi di ottimizzazione numerica in un unico ambiente. Questo è fondamentale, perché durante l'addestramento del modello interno, l'output dell'ottimizzazione numerica viene utilizzato come parte della funzione di perdita di previsione. Per ulteriori informazioni su come affrontare i casi d'uso di ottimizzazione numerica, fare riferimento a Risoluzione di problemi di ottimizzazione numerica come pianificazione, instradamento e allocazione con Amazon SageMaker Processing.

Quindi distribuiamo questi modelli tramite endpoint di inferenza. Poiché i nuovi dati vengono acquisiti periodicamente, i modelli devono essere riaddestrati perché diventano obsoleti nel tempo. La sezione sull'architettura più avanti in questo post fornisce maggiori dettagli sul ciclo di vita dei modelli.

Generazione di dati di offerta di potere

Su base oraria, la soluzione prevede le quantità e i prezzi ottimali ai quali l'energia dovrebbe essere offerta sul mercato, chiamato anche offerte. Le quantità sono misurate in MW ei prezzi sono misurati in $/MW. Le offerte vengono generate per molteplici combinazioni di condizioni di mercato previste e percepite. La tabella seguente mostra un esempio della finale curva di offerta uscita per l'ora operativa 17 presso un nodo commerciale illustrativo vicino all'ufficio di Los Angeles di Marubeni.

| Data | ora | Rappresentanza | Dove | MW | Prezzo |

| 11/7/2022 | 17 | RT Energia | LCIENEGA_6_N001 | 0 | $0 |

| 11/7/2022 | 17 | RT Energia | LCIENEGA_6_N001 | 1.65 | $80.79 |

| 11/7/2022 | 17 | RT Energia | LCIENEGA_6_N001 | 5.15 | $105.34 |

| 11/7/2022 | 17 | RT Energia | LCIENEGA_6_N001 | 8 | $230.15 |

Questo esempio rappresenta la nostra disponibilità a offrire 1.65 MW di potenza se il prezzo dell'energia è di almeno $ 80.79, 5.15 MW se il prezzo dell'energia è di almeno $ 105.34 e 8 MW se il prezzo dell'energia è di almeno $ 230.15.

Gli operatori di sistema indipendenti (ISO) supervisionano i mercati dell'elettricità negli Stati Uniti e sono responsabili dell'aggiudicazione e del rifiuto delle offerte per mantenere l'affidabilità della rete elettrica nel modo più economico. California Independent System Operator (CAISO) gestisce i mercati dell'elettricità in California e pubblica i risultati del mercato ogni ora prima della successiva finestra di offerta. Incrociando le attuali condizioni di mercato con il loro equivalente sulla curva, gli analisti sono in grado di dedurre entrate ottimali. La soluzione Power Bid Optimization aggiorna le offerte future utilizzando nuove informazioni di mercato in arrivo e nuovi output predittivi del modello

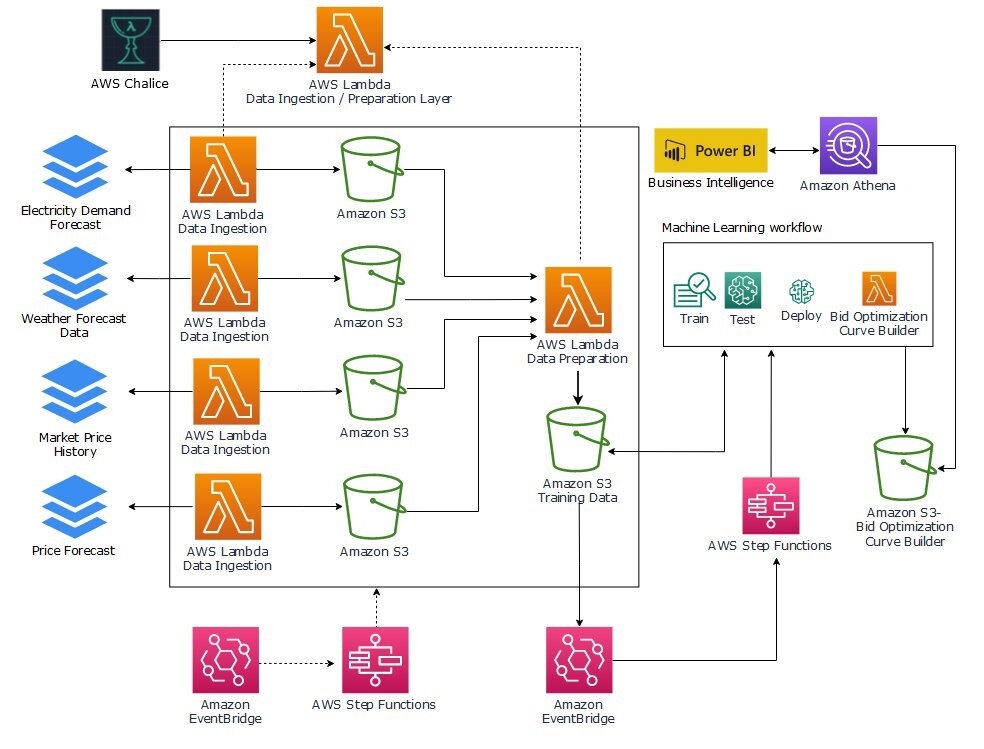

Panoramica dell'architettura AWS

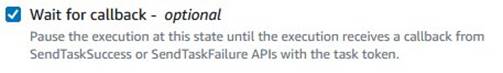

L'architettura della soluzione illustrata nella figura seguente implementa tutti i livelli presentati in precedenza. Utilizza i seguenti servizi AWS come parte della soluzione:

- Servizio di archiviazione semplice Amazon (Amazon S3) per memorizzare i seguenti dati:

- Dati su prezzi, meteo e previsioni di carico provenienti da varie fonti.

- Dati consolidati e aumentati pronti per essere utilizzati per l'addestramento del modello.

- Curve di offerta di output aggiornate ogni ora.

- Amazon Sage Maker per addestrare, testare e distribuire modelli per offrire offerte ottimizzate tramite endpoint di inferenza.

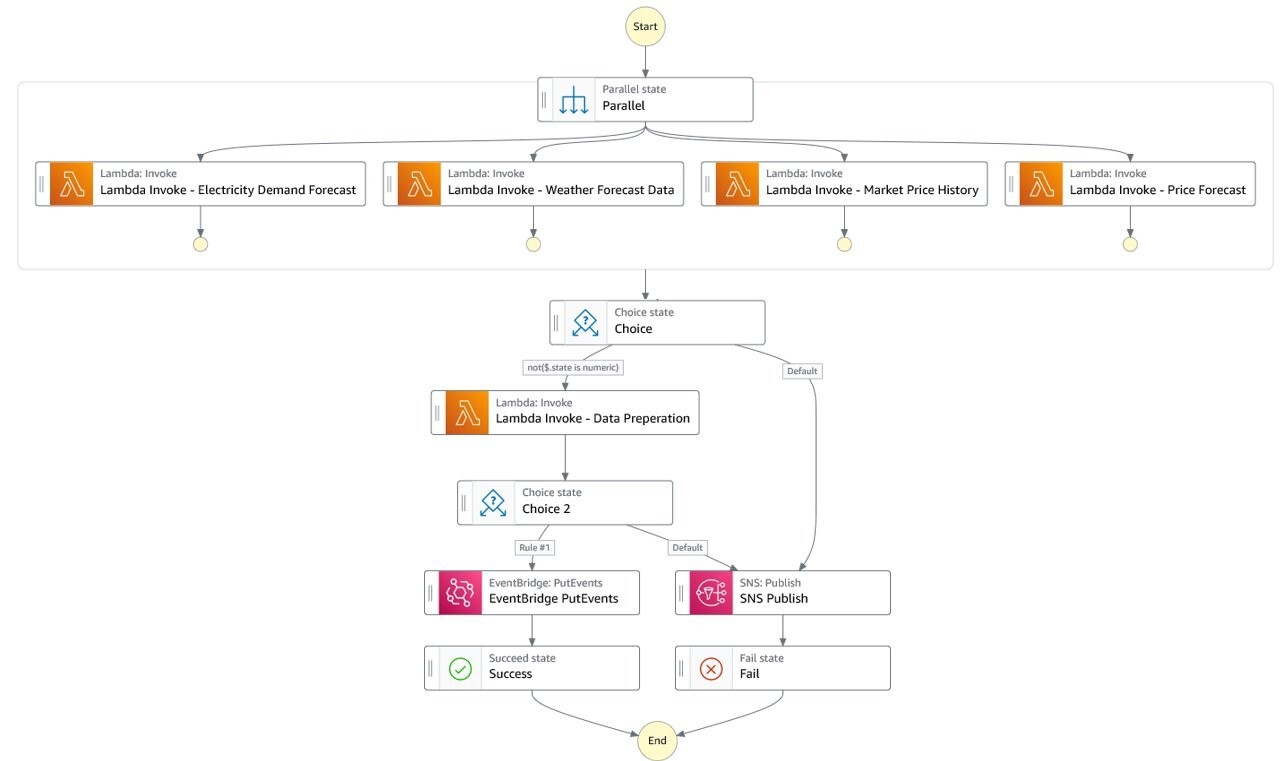

- Funzioni AWS Step per orchestrare sia i dati che le pipeline ML. Usiamo due macchine a stati:

- Una macchina a stati per orchestrare la raccolta dei dati e garantire che tutte le origini siano state acquisite.

- Una macchina a stati per orchestrare la pipeline ML e il flusso di lavoro di generazione delle offerte ottimizzato.

- AWS Lambda per implementare funzionalità di importazione, pre-elaborazione e post-elaborazione:

- Tre funzioni per importare feed di dati di input, con una funzione per origine.

- Una funzione per consolidare e preparare i dati per l'addestramento.

- Una funzione che genera la previsione dei prezzi chiamando l'endpoint del modello distribuito all'interno di SageMaker.

- Amazzone Atena fornire agli sviluppatori e agli analisti aziendali l'accesso SQL ai dati generati per l'analisi e la risoluzione dei problemi.

- Amazon EventBridge per attivare l'inserimento dei dati e la pipeline ML in base a una pianificazione e in risposta agli eventi.

Nelle sezioni seguenti, discuteremo il flusso di lavoro in modo più dettagliato.

Raccolta e preparazione dei dati

Ogni ora viene richiamata la macchina a stati Step Functions per la preparazione dei dati. Chiama ciascuna delle funzioni Lambda di inserimento dei dati in parallelo e attende il completamento di tutte e quattro. Le funzioni di raccolta dati chiamano la rispettiva API di origine e recuperano i dati dell'ultima ora. Ogni funzione memorizza quindi i dati ricevuti nel rispettivo bucket S3.

Queste funzioni condividono una linea di base di implementazione comune che fornisce elementi costitutivi per la manipolazione dei dati standard come la normalizzazione o l'indicizzazione. Per raggiungere questo obiettivo, utilizziamo i livelli Lambda e Calice AWS, come descritto in Utilizzo dei livelli AWS Lambda con AWS Chalice. Ciò garantisce che tutti gli sviluppatori utilizzino le stesse librerie di base per creare nuove logiche di preparazione dei dati e velocizza l'implementazione.

Dopo che tutte e quattro le origini sono state acquisite e archiviate, la macchina a stati attiva la funzione Lambda di preparazione dei dati. I dati relativi a prezzo energetico, meteo e previsioni di carico vengono ricevuti in file JSON e delimitati da caratteri. Ogni parte di record di ogni file contiene un timestamp che viene utilizzato per consolidare i feed di dati in un set di dati che copre un intervallo di tempo di 1 ora.

Questo costrutto fornisce un flusso di lavoro completamente basato sugli eventi. La preparazione dei dati di addestramento viene avviata non appena vengono inseriti tutti i dati previsti.

Pipeline ML

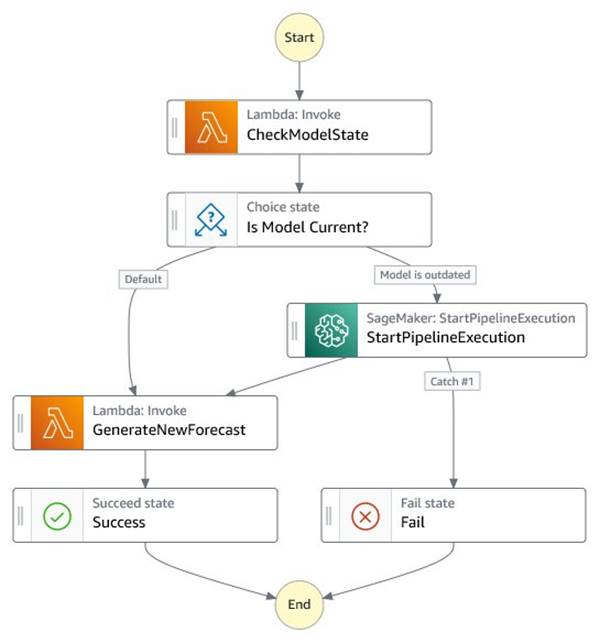

Dopo la preparazione dei dati, i nuovi set di dati vengono archiviati in Amazon S3. Una regola EventBridge attiva la pipeline ML tramite una macchina a stati Step Functions. La macchina a stati guida due processi:

- Controlla se il modello di generazione della curva di offerta è aggiornato

- Attiva automaticamente il riaddestramento del modello quando le prestazioni peggiorano o i modelli sono più vecchi di un certo numero di giorni

Se l'età del modello attualmente distribuito è precedente all'ultimo set di dati di una certa soglia, ad esempio 7 giorni, la macchina a stati Step Functions avvia la pipeline SageMaker che addestra, testa e distribuisce un nuovo endpoint di inferenza. Se i modelli sono ancora aggiornati, il flusso di lavoro salta la pipeline ML e passa alla fase di generazione dell'offerta. Indipendentemente dallo stato del modello, una nuova curva di offerta viene generata alla consegna di un nuovo set di dati orario. Il diagramma seguente illustra questo flusso di lavoro. Per impostazione predefinita, il StartPipelineExecution l'azione è asincrona. Possiamo fare in modo che la macchina a stati attenda la fine della pipeline prima di richiamare la fase di generazione delle offerte utilizzando il metodo 'Attendi la richiamata' opzione.

Per ridurre i costi e il tempo di immissione sul mercato nella creazione di una soluzione pilota, Marubeni ha utilizzato Inferenza serverless di Amazon SageMaker. Ciò garantisce che l'infrastruttura sottostante utilizzata per la formazione e l'implementazione venga addebitata solo quando necessario. Ciò semplifica anche il processo di costruzione della pipeline perché gli sviluppatori non devono più gestire l'infrastruttura. Questa è un'ottima opzione per i carichi di lavoro che hanno periodi di inattività tra gli scatti di traffico. Man mano che la soluzione matura e passa alla produzione, Marubeni rivedrà il proprio design e adotterà una configurazione più adatta per un utilizzo prevedibile e costante.

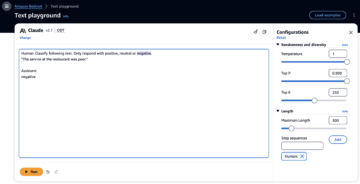

Generazione delle offerte e interrogazione dei dati

La funzione Lambda di generazione delle offerte richiama periodicamente l'endpoint di inferenza per generare previsioni orarie e archivia l'output in Amazon S3.

Gli sviluppatori e gli analisti aziendali possono quindi esplorare i dati utilizzando Athena e Microsoft Power BI per la visualizzazione. I dati possono anche essere resi disponibili tramite API alle applicazioni aziendali a valle. Nella fase pilota, gli operatori consultano visivamente la curva di offerta per supportare le loro attività di transazione di potenza sui mercati. Tuttavia, Marubeni sta valutando la possibilità di automatizzare questo processo in futuro e questa soluzione fornisce le basi necessarie per farlo.

Conclusione

Questa soluzione ha consentito a Marubeni di automatizzare completamente le pipeline di elaborazione e acquisizione dei dati, nonché di ridurre il tempo di implementazione dei modelli di previsione e ottimizzazione da ore a minuti. Le curve di offerta vengono ora generate automaticamente e mantenute aggiornate al variare delle condizioni di mercato. Hanno anche ottenuto una riduzione dei costi dell'80% passando da un endpoint di inferenza con provisioning a un endpoint serverless.

La soluzione di previsione di MPII è una delle recenti iniziative di trasformazione digitale che Marubeni Corporation sta lanciando nel settore energetico. MPII prevede di creare soluzioni digitali aggiuntive per supportare nuove piattaforme di business dell'energia. MPII può fare affidamento sui servizi AWS per supportare la propria strategia di trasformazione digitale in molti casi d'uso.

"Possiamo concentrarci sulla gestione della catena del valore per le nuove piattaforme di business, sapendo che AWS gestisce l'infrastruttura digitale alla base delle nostre soluzioni."

– Hernan Figueroa, Sr. Manager Data Science presso Marubeni Power International.

Per ulteriori informazioni su come AWS aiuta le organizzazioni energetiche nelle loro iniziative di trasformazione digitale e sostenibilità, fare riferimento a AWS Energia.

![]() Marubeni Power International è una filiale di Marubeni Corporation. Marubeni Corporation è un importante conglomerato giapponese di attività commerciali e di investimento. La missione di Marubeni Power International è sviluppare nuove piattaforme di business, valutare nuove tendenze e tecnologie energetiche e gestire il portafoglio energetico di Marubeni nelle Americhe. Se vuoi saperne di più su Marubeni Power, dai un'occhiata https://www.marubeni-power.com/.

Marubeni Power International è una filiale di Marubeni Corporation. Marubeni Corporation è un importante conglomerato giapponese di attività commerciali e di investimento. La missione di Marubeni Power International è sviluppare nuove piattaforme di business, valutare nuove tendenze e tecnologie energetiche e gestire il portafoglio energetico di Marubeni nelle Americhe. Se vuoi saperne di più su Marubeni Power, dai un'occhiata https://www.marubeni-power.com/.

Informazioni sugli autori

Hernan Figueroa guida le iniziative di trasformazione digitale di Marubeni Power International. Il suo team applica data science e tecnologie digitali per supportare le strategie di crescita di Marubeni Power. Prima di entrare in Marubeni, Hernan è stato Data Scientist alla Columbia University. Ha conseguito un dottorato di ricerca. in ingegneria elettrica e una laurea in ingegneria informatica.

Hernan Figueroa guida le iniziative di trasformazione digitale di Marubeni Power International. Il suo team applica data science e tecnologie digitali per supportare le strategie di crescita di Marubeni Power. Prima di entrare in Marubeni, Hernan è stato Data Scientist alla Columbia University. Ha conseguito un dottorato di ricerca. in ingegneria elettrica e una laurea in ingegneria informatica.

LinoBrescia è un Principal Account Executive con sede a New York. Ha oltre 25 anni di esperienza tecnologica ed è entrato in AWS nel 2018. Gestisce i clienti aziendali globali mentre trasformano la loro attività con i servizi cloud AWS ed eseguono migrazioni su larga scala.

LinoBrescia è un Principal Account Executive con sede a New York. Ha oltre 25 anni di esperienza tecnologica ed è entrato in AWS nel 2018. Gestisce i clienti aziendali globali mentre trasformano la loro attività con i servizi cloud AWS ed eseguono migrazioni su larga scala.

Narcisse Zekpa è un Sr. Solutions Architect con sede a Boston. Aiuta i clienti nel nord-est degli Stati Uniti ad accelerare la loro trasformazione aziendale attraverso soluzioni innovative e scalabili su AWS Cloud. Quando Narcisse non sta costruendo, gli piace passare il tempo con la sua famiglia, viaggiare, cucinare, giocare a basket e correre.

Narcisse Zekpa è un Sr. Solutions Architect con sede a Boston. Aiuta i clienti nel nord-est degli Stati Uniti ad accelerare la loro trasformazione aziendale attraverso soluzioni innovative e scalabili su AWS Cloud. Quando Narcisse non sta costruendo, gli piace passare il tempo con la sua famiglia, viaggiare, cucinare, giocare a basket e correre.

Pedram Jahangiri è un Enterprise Solution Architect con AWS, con un dottorato in ingegneria elettrica. Ha oltre 10 anni di esperienza nel settore dell'energia e dell'IT. Pedram ha molti anni di esperienza pratica in tutti gli aspetti dell'analisi avanzata per la creazione di soluzioni quantitative e su larga scala per le imprese sfruttando le tecnologie cloud.

Pedram Jahangiri è un Enterprise Solution Architect con AWS, con un dottorato in ingegneria elettrica. Ha oltre 10 anni di esperienza nel settore dell'energia e dell'IT. Pedram ha molti anni di esperienza pratica in tutti gli aspetti dell'analisi avanzata per la creazione di soluzioni quantitative e su larga scala per le imprese sfruttando le tecnologie cloud.

Sarah Childers è un Account Manager con sede a Washington DC. È un'ex insegnante di scienze diventata appassionata di cloud e focalizzata sull'assistenza ai clienti durante il loro viaggio nel cloud. A Sarah piace lavorare a fianco di un team motivato che incoraggia idee diversificate per fornire al meglio ai clienti le soluzioni più innovative e complete.

Sarah Childers è un Account Manager con sede a Washington DC. È un'ex insegnante di scienze diventata appassionata di cloud e focalizzata sull'assistenza ai clienti durante il loro viaggio nel cloud. A Sarah piace lavorare a fianco di un team motivato che incoraggia idee diversificate per fornire al meglio ai clienti le soluzioni più innovative e complete.

- Distribuzione di contenuti basati su SEO e PR. Ricevi amplificazione oggi.

- Platoblockchain. Web3 Metaverse Intelligence. Conoscenza amplificata. Accedi qui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/how-marubeni-is-optimizing-market-decisions-using-aws-machine-learning-and-analytics/

- :È

- $ SU

- 1

- 10

- 100

- 2018

- 7

- 8

- a

- capace

- Chi siamo

- accelerare

- accesso

- accessibile

- Il mio account

- Raggiungere

- operanti in

- Action

- attività

- aggiuntivo

- indirizzo

- adottare

- avanzare

- Avanzate

- Vantaggio

- Algoritmi

- Tutti

- assegnazione

- a fianco di

- Amazon

- Amazon Sage Maker

- Americas

- quantità

- .

- Gli analisti

- analitica

- ed

- Angeles

- api

- API

- applicazioni

- architettura

- SONO

- arrivo

- AS

- aspetti

- attività

- gestione delle risorse

- Attività

- At

- aumentata

- Autenticazione

- automatizzare

- automaticamente

- Automatizzare

- disponibile

- media

- AWS

- AWS Lambda

- Apprendimento automatico di AWS

- Equilibrio

- base

- basato

- Linea di base

- base

- Pallacanestro

- BE

- perché

- diventare

- prima

- essendo

- MIGLIORE

- fra

- offerta

- Blocchi

- Boston

- ampio

- costruire

- Costruzione

- affari

- Applicazioni aziendali

- Trasformazione aziendale

- Acquisto

- by

- California

- chiamata

- detto

- chiamata

- Bandi

- Materiale

- non può

- funzionalità

- capace

- carbonio

- Custodie

- casi

- certo

- catena

- il cambiamento

- cambiando

- carattere

- oneri

- dai un'occhiata

- Cloud

- servizi cloud

- collezione

- Columbia

- combinazioni

- combinando

- Uncommon

- completamento di una

- componenti

- globale

- computer

- Ingegneria Informatica

- condizioni

- Configurazione

- conglomerato

- collega

- Prendere in considerazione

- considerando

- consolidare

- costantemente

- vincoli

- costruire

- consumato

- consumo

- continuamente

- cucina

- SOCIETÀ

- Costo

- riduzione dei costi

- costo effettivo

- coprire

- copertura

- critico

- rimandi

- a cura

- Corrente

- Attualmente

- curva

- Clienti

- personalizzare

- dati

- Lago di dati

- Preparazione dei dati

- elaborazione dati

- scienza dei dati

- scienziato di dati

- memorizzazione dei dati

- data-driven

- dataset

- Data

- giorno

- dc

- Decision Making

- decisioni

- Predefinito

- consegna

- Richiesta

- schierare

- schierato

- distribuzione

- deployment

- implementazioni

- Distribuisce

- descritta

- descrizione

- Design

- dettaglio

- dettagli

- sviluppare

- sviluppatori

- diverso

- digitale

- DIGITAL TRANSFORMATION

- discutere

- disparato

- variegato

- durante

- dinamico

- ogni

- In precedenza

- più facile

- facile

- Elettrico

- Ingegneria Elettrica

- elettricità

- enable

- abilitato

- Abilita

- incoraggia

- endpoint

- energia

- motore

- Ingegneria

- garantire

- assicura

- Impresa

- clienti aziendali

- aziende

- appassionato

- Ambiente

- ambienti

- Equivalente

- Etere (ETH)

- eventi

- Ogni

- esempio

- esclusivamente

- esecutivo

- previsto

- esperienza

- esplora

- esterno

- famiglia

- Recuperato

- figura

- Compila il

- File

- finale

- Focus

- concentrato

- i seguenti

- Nel

- Previsione

- Ex

- Fondazioni

- TELAIO

- fresco

- da

- completamente

- function

- funzionalità

- funzioni

- ulteriormente

- futuro

- generare

- generato

- genera

- ELETTRICA

- globali

- Go

- grande

- Griglia

- Crescita

- mani su

- Avere

- aiutare

- aiuta

- detiene

- ORE

- Come

- Tutorial

- Tuttavia

- HTML

- HTTPS

- idee

- Idle

- realizzare

- implementazione

- attrezzi

- importante

- in

- includere

- incluso

- inclusi

- In arrivo

- Aumento

- studente indipendente

- industria

- informazioni

- Infrastruttura

- iniziative

- creativi e originali

- ingresso

- interno

- Internazionale

- Interoperabilità

- investimento

- investe

- invoca

- coinvolto

- IT

- Settore IT

- SUO

- Giapponese

- Offerte di lavoro

- congiunto

- accoppiamento

- viaggio

- jpg

- json

- Kicks

- Sapere

- Conoscere

- lago

- larga scala

- con i più recenti

- lancio

- strato

- galline ovaiole

- Leads

- IMPARARE

- apprendimento

- leveraging

- biblioteche

- ciclo di vita

- piace

- limiti

- caricare

- carichi

- Lunghi

- più a lungo

- dei

- Los Angeles

- spento

- macchina

- machine learning

- macchine

- fatto

- mantenere

- maggiore

- FA

- gestire

- gestione

- direttore

- gestisce

- gestione

- Manipolazione

- molti

- Rappresentanza

- le condizioni di mercato

- Mercati

- matura

- Massimizzare

- meccanismo

- Memorie

- Microsoft

- ridurre al minimo

- verbale

- Missione

- ML

- Moda

- modello

- modellismo

- modelli

- modificato

- Scopri di più

- maggior parte

- motivato

- si muove

- multiplo

- Vicino

- necessaria

- Bisogno

- di applicazione

- esigenze

- New

- GENERAZIONE

- nodo

- numero

- NYC

- obiettivo

- ottenere

- of

- offerto

- Office

- on

- ONE

- opera

- operativo

- operazione

- operativa

- operatore

- Operatori

- ottimale

- ottimizzazione

- ottimizzati

- ottimizzazione

- Opzione

- organizzazioni

- Altro

- produzione

- possiede

- Parallel

- parte

- partecipanti

- partecipazione

- passato

- percepito

- eseguire

- performance

- periodi

- fase

- pilota

- conduttura

- piani

- Piattaforme

- Platone

- Platone Data Intelligence

- PlatoneDati

- Giocare

- gioco

- lavori

- Post

- energia

- Power BI

- Alimentazione di laboratorio

- Prevedibile

- previsto

- previsione

- predizione

- Previsioni

- predice

- Preparare

- presentata

- prezzo

- previsione dei prezzi

- Prezzi

- Direttore

- Precedente

- problemi

- processi

- i processi

- lavorazione

- Produzione

- redditività

- profitti

- proprio

- fornire

- fornisce

- Pubblicazione

- Pubblica

- qualità

- quantitativo

- pronto

- tempo reale

- realizzato

- ricevuto

- recente

- record

- ridurre

- Indipendentemente

- problemi di

- fare affidamento

- Rinnovabile

- energia rinnovabile

- rappresenta

- necessario

- richiede

- quelli

- risposta

- responsabile

- di risposta

- Risultati

- riqualificazione

- Le vendite

- recensioni

- Rischio

- robusto

- Ruolo

- ruoli

- Regola

- Correre

- running

- s

- sagemaker

- stesso

- scalabile

- programma

- Scienze

- Scienziato

- Sezione

- sezioni

- settore

- Vendita

- servire

- serverless

- Servizi

- set

- Condividi

- a breve scadenza

- dovrebbero

- Spettacoli

- Un'espansione

- contemporaneamente

- singolo

- So

- soluzione

- Soluzioni

- alcuni

- Arrivo

- Fonte

- fonti

- Reperimento

- specifico

- velocità

- Spendere

- SQL

- Standard

- Regione / Stato

- costante

- step

- Passi

- Ancora

- conservazione

- Tornare al suo account

- memorizzati

- negozi

- strategie

- Strategia

- forza

- inviare

- presentata

- filiale

- tale

- fornire

- Domanda e offerta

- supporto

- Supporto

- supporti

- Sostenibilità

- sistema

- tavolo

- Fai

- team

- tecniche

- Tecnologie

- Tecnologia

- tensorflow

- test

- test

- che

- I

- Il futuro

- Lo Stato

- loro

- perciò

- Strumenti Bowman per analizzare le seguenti finiture:

- Attraverso

- tempo

- timestamp

- a

- Trading

- traffico

- Treni

- Training

- forma

- delle transazioni

- Trasformare

- Trasformazione

- Strategia di trasformazione

- transizioni

- Di viaggio

- tendenze

- innescare

- Turned

- Tipi di

- noi

- sottostante

- Università

- Aggiornamenti

- Dati a monte

- us

- Impiego

- uso

- caso d'uso

- APPREZZIAMO

- vario

- versione

- via

- visualizzazione

- aspettare

- Washington

- Washington DC

- Modo..

- Tempo

- WELL

- quale

- volere

- Buona volontà

- con

- entro

- flusso di lavoro

- lavoro

- sarebbe

- anni

- zefiro