このエピソードでは、Vijay Pande が、Inceptive の共同設立者兼 CEO である Jakob Uszkoreit と対談します。 一緒に、彼らはすべての AI について話し合います。

合わせて読みたい場合に備えて、トランスクリプトの全文を以下に公開します。

***

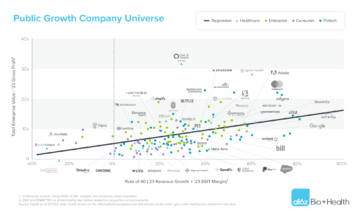

オリビア・ウェッブ: こんにちは。バイオ、ヘルスケア、テクノロジーが交差するポッドキャスト、Bio Eats World へようこそ。 a16z で Bio + Health の編集主任を務める Olivia Webb です。 このエピソードでは、元 Google Brain の Jakob Uszkoreit と Inceptive の共同設立者に話を聞きました。 Jakob は、重要な AI 研究論文 Attention is All You Need の著者の 16 人でもあります。 ヤコブは、aXNUMXz Bio + Health の創設パートナーであるビジェイ パンデと対談し、AI に関するすべてについて話しました。Google ブレインでの彼の時代から、人間とコンピューターが言語を処理する方法、RNA の可能性に対するインセプティブの信念、そしてヤコブが私たちをどのように信じているかまで。 AI で変曲点の領域に入りつつあります。

見逃したくないエピソードですが、AI に関する大学院レベルの議論でもあるため、エピソードと一緒にトランスクリプトを公開します。 始めましょう。

該当するアルゴリズム

ビジェイ・パンデ: ヤコブ、Bio Eats World にご参加いただきありがとうございます。 あなたがいるのは素晴らしいことです。

ヤコブ・ウスコライト: ここにいるのは素晴らしいことです。 呼んでくれてありがとう。

ビジェイ・パンデ: 特に、あなたはコンピューター科学者、起業家、創業者として魅力的な経歴をお持ちなので、あなたのキャリア ジャーニーを、好きなところから始めて教えていただきたいと思いますが、Google Brain にたどり着いた理由から始めるのがよいでしょう。 .

ヤコブ・ウスコライト: 私は、機械学習の問題、おそらく最も広い意味での言語理解の問題、より具体的には家族の問題として遭遇したことを、ある程度覚えています。 私の父はコンピューター科学者であり計算言語学者であり、チューリングマシンのようなものを育てることは、かなり早い段階で完全に異質な概念であるとは限りませんでした。

ビジェイ・パンデ: ええ、実際、それは夕食の席での会話だったようです。

ヤコブ・ウスコライト: 彼らは夕食の席での会話でした。 そして、特に有限オートマトンと、それらが実際に自動販売機とどのように関係しているかは、よくある話題でした。 年をとるにつれて、実際に何か違うことをするようになりたいと思うようになりました。 それで、私はそこで純粋な数学とそれに関連する分野をかなり調べることになりました。 [私は] 最適化、最適化アルゴリズム、アルゴリズム全体、より広範な複雑性理論にかなり焦点を当てていましたが、おそらくそれが最も実用的なものではなく、最も適用可能なものではないことに気づきました。私のキャリアを通して、ちょっとした赤い糸。 そして、文字通り 2005 年に Google のインターンシップに出くわしました。

どんな種類の研究プロジェクトに参加するかについて、いくつかの選択肢が与えられました。その中には、さまざまなコンピューター ビジョンの取り組みだけでなく、基本的に Google 翻訳になった機械翻訳プロジェクトも含まれていました。 ちょうどその頃、またはその少し前に、[Translate] は、開発された Google の内部システムを実際に活用した最初の製品を発売しました。その時、最も興味深い大規模なアルゴリズムの問題がありました。

当時、実際に見るのは本当に興味深いことでした。なぜなら、博士号を取得することをやめて、実際にそのインターンシップの後に実際に Google に戻るようになったのは、実際にそこにいる間に、何かに取り組みたい場合は機械学習は興味深いだけでなく、知的にも科学的にも刺激的でやりがいがあり、刺激的だっただけでなく、業界や製品にすぐに変化をもたらす可能性が非常に高かったのです。 当時、世界にはそれほど多くの場所はありませんでした。 そして、それらは確かに当時の学術研究所ではなく、Google のような場所でした。 Google は当時、実際にこの分野の最前線にいました。 当時、初めて大規模なクラスタリング アルゴリズムを XNUMX 台のマシンで実行できたのはすごいことだと思っていました。

ビジェイ・パンデ: 私たちの先輩たちと話すと、ベル研究所の全盛期のロマンチシズムがたくさんあります。私は、Google Brain が今日のより近い変種の XNUMX つになるのではないかといつも思っていました。 どんな環境でしたか?

ヤコブ・ウスコライト: ですから、その時から約 XNUMX 年後に Google Brain が実際に開始されるまでの間に、大きな変化があったと感じています。 Brain and Translate が始まる前は、Bell Labs がそうであったと私が信じているよりも、真に変化をもたらす製品によって推進されていました。 もちろん、私たちの中にはかなりの数のベル研究所の卒業生がいましたが、それは直接適用できることがはるかに動機でした。

文字通り、機械翻訳がパーティーでの笑い声に良いものに変わった様子を目の当たりにして、私は本当に驚きました。 彼らがあなたに尋ねたら、あなたはどこで働いていますか? そして、あなたは言った、グーグル。 そして彼らは言った、あなたはそこで何をしますか? そして、彼らは最初に感銘を受けました。 そして、あなたは言った、ああ、私はGoogle翻訳に取り組んでいます。 そして彼らは笑って尋ねました、これはうまくいくでしょうか? 私はそうは思わない。 しかし同時に、機械学習の波、つまりディープラーニング以前の機械学習のルネッサンスの波が頭打ちになり始めたと言えます。 ご存知のように、ディープ ラーニングは私が以前学校で行ったもので、気に入っていましたが、当時は実際に適用できるものではありませんでした。

ビジェイ・パンデ: ええ、特に、学界には必要な計算を行うための規模がなかったからです.

ヤコブ・ウスコライト: 確かに学界ではなく、Google でさえ。 当時、Translate の最も興味深い際立った機能は、結局のところ、データの絶対的な力を本当に信じていたということです。

そのため、より複雑で洗練されたアルゴリズムを作成するのではなく、可能な限り単純化してスケーリングし、より多くのデータでトレーニングできるようにしようとしていました。 しかし、私たちはそこで天井にぶつかっただけです。 当時の Google の規模に合わせて規模を拡大するために必要だった単純化は、まさに私たちの目標でした。 しかしその後、これはある種の振り子の動きの XNUMX つであり、学界から引き返し、多数の GPU を持った多くの人々が戻ってきました。ディープ ラーニングは、ある意味で復讐をもって復活しました。 そして突然、環境が順応しました。なぜなら、大規模な本番環境への直接的な道筋が不明だったからです。

そのため、環境全体がアプリケーションや製品指向から、少なくともかなりの数年間、より学術的なものへと変化しました。 より多くの GPU を購入する余裕があるため、アカデミック ラボとはまだ少し異なりますが、ある意味では、出版物によって推進され、ステップではなく飛躍によって推進されるというこの考えに沿っています。 [それは] 非常に生産的で、本当に驚くべきものになりましたが、より自由な [環境] になりました。

注意はあなたが必要とするすべてです

ビジェイ・パンデ: 出版物について言えば、あなたとチームが Attention is All You Need を出版したときを考えるのが自然です。 そして、ご存知のように、この論文は、Transformer アルゴリズムが最初に発表されたときから、生成 AI の多くにとって非常に重要な論文でした。

ヤコブ・ウスコライト: その論文を発表する 2 年前に、私たちは、機械翻訳のような問題に対して当時最先端であったもの、または最先端として出現しつつあるもの、つまり LSTM または RNN ベースのものに気付きました。 、SeqXNUMXSeq は全体として、トレーニング パラダイムおよびセットアップとしてだけでなく、ネットワーク アーキテクチャとしても使用されていましたが、当時の最新の GPU でも、データのスケーリングに関しては信じられないほどの問題がありました。

たとえば、Google が立ち上げた最初のニューラル機械翻訳システムである GNMT は、私の知る限り、フレーズベースの統計システムのために以前にマイニングした、利用可能なすべてのトレーニング データで実際にトレーニングされたことはありませんでした。 それは、アルゴリズムがデータ量の点でうまくスケーリングできなかったからです。 つまり、簡単に言えば、当時、私たちは機械翻訳ではなく、Google 社内でさらに大量のトレーニング データを利用できる問題に注目していました。 つまり、これらは検索から生じた問題であり、基本的にさらに XNUMX 桁または XNUMX 桁の桁数があります。 ご存知のように、今では何十億もの単語ではなく、簡単に何兆もの単語があり、突然、単純なフィードフォワード ネットワークがこのパターンに遭遇しました。単純なフィードフォワード ネットワークは、単語の袋にすぎない、バイグラムの袋にすぎないなど、ばかげた単純化の仮定を行っていたにもかかわらずです。 、そしてそれらを平均化し、大きなMNLPを介して送信すると、少なくともより多くのデータでトレーニングした場合、実際にはRNNとLSTMよりも優れていました.

[そして彼らは] n 倍、簡単に 10 倍、20 倍速くトレーニングできました。 そのため、より多くのデータでトレーニングできます。 場合によっては、トレーニングが XNUMX 倍速くなりました。 そのため、私たちは一貫して、より単純であり、言語で確実に一般的であることがわかっている特定の現象を表現またはキャプチャできないモデルに実際に行き着き続けました.

それでも、要するに、彼らはトレーニングにかかる費用が安く、パフォーマンスも優れていました。

ビジェイ・パンデ: よく知らない人のために例を挙げましょう。 では、一言で言えば、イタリアン以外の近くのレストランをすべて見せてくださいと言ったら、すべてのイタリアンレストランが表示されますよね?

ヤコブ・ウスコライト: 丁度。 実際、あなたが言ったことはおそらく並べ替えて、近くを除くすべてのイタリアン レストランを表示することができます。 それは単なる言葉のスープであり、間違いなく別の意味を持つものに並べ替えることができます.

ビジェイ・パンデ: はい。

ヤコブ・ウスコライト: 次に、バイグラムを挿入することで、構造を近似し、よりグローバルな現象を取得します。 つまり、基本的には連続する XNUMX つの単語のグループなどです。 しかし、確かに、基本的に動詞を文の最後に置くことができるドイツ語のような言語では…

ビジェイ・パンデ: そして、それは全体の意味を変えますよね?

ヤコブ・ウスコライト: はい、すべての意味を変更します。 n-gram (または小さな単語グループ) のサイズに関係なく、最終的に成功することはありません。 そして、RNN の長さの繰り返し、または単語やピクセルのシーケンスの繰り返しを必要としない別の方法が必要であることが明らかになりましたが、実際には入力と出力をより並列に処理し、実際に最終的には、最新のアクセラレータ ハードウェアの強みに対応します。

ビジェイ・パンデ: 考えてみてください。単語の袋はランダムな順序の単語です。 LSTM、または長短期記憶は、おそらく過去を少し見る[能力]を与えてくれますよね? しかし、トランスフォーマーは根本的に異なることをします。 トランスフォーマーはそれをどのように次のレベルに引き上げますか?

ヤコブ・ウスコライト: これを見るには常にXNUMXつの方法があります。 XNUMX つは効率のレンズを通してですが、もう XNUMX つの方法は、おそらくもう少し直感的に、どれだけのコンテキストを維持できるかという観点から見ることです。 そして、あなたが言ったように、LSTM、または一般的な再帰型ニューラル ネットワークは、大まかに言えば、入力を段階的に移動しますが、理論的には、入力 (過去) への任意の長いコンテキスト ウィンドウを維持することができます。実際に起こるのは、言葉やピクセルなどの過去の非常に遠い過去の出来事で、一日の終わりに意味に実際に影響を与えるものを特定するのは、実際には非常に難しいということです。 近くにあるものに集中する傾向があります。

一方、トランスフォーマーは、基本的にそれをひっくり返して、すべてのステップで、入力を介して移動していないと言います。 すべてのステップで、入力または出力の全体を見ています。基本的には、入力空間ではなく基本的に移動するため、ビデオのすべての単語、すべてのピクセル、すべてのパッチ、またはすべてのフレームの表現を段階的に修正しています。 、しかし表現空間にあります。

ビジェイ・パンデ: はい。

ヤコブ・ウスコライト: このアイデアには、最新のハードウェアにどのように適合させるかという点でいくつかの欠点がありましたが、リカレント ニューラル ネットワークと比較すると、主に利点がありました。これは、表現を逐語的に計算する必要がなくなったためです。 あなたが縛られていたのは、本当に、彼らがどれほど良いものであるべきかということです? すべての単語のすべてのペアまたは画像パッチのすべてのペアがすぐに相互作用できるすべての位置のこの種の並列処理のレイヤーはいくつありますか? これらの表現を実際に「余裕を持って」修正できるのは何回ですか?

ビジェイ・パンデ: 非常に興味深いのは、インスピレーションが自然言語であることは明らかですが、DNA配列のように、単に逐次的に研究したくない場合に入力したい構造がたくさんあるということです。生物学に取り掛かります。すぐに、全体のモデルが必要になります。

言語的におかしいです。 私が話しているとき、またはあなたの話を聞いているとき、私は各単語を処理していますが、最終的には、単語を個々の意味にトークン化するだけでなく、この表現を開発する必要があります. はい? トランスフォーマーのようにできたらいいのに。 おそらくそれがトリックであり、LSTM は私たち人間が行う方法により近く、トランスフォーマーはおそらく私たちが行うべき方法である、または私はそれを行うことができればよいのにと思います。

ヤコブ・ウスコライト: 表面的には、それは真実だと思いますが、結局のところ、このような内省的な議論は巧妙でトリッキーです。

だから、私たちの多くは、にぎやかな通りの向こう側で何かを伝えようとしている誰かと叫んだり怒鳴ったりするこの現象を知っていると思います. そして、彼らの言うことを聞きますが、それは短い言葉の羅列ではなく、基本的に何も理解できませんでした。 しかし、その XNUMX 秒後、あなたは突然文全体を理解しました。 それは、時間の矢のせいで、言語を順番に書き、発声することを余儀なくされている一方で、私たちのより深い理解が実際にその順番で行われるかどうかはそれほど明確ではないという事実を示唆しています。

チームを組む

ビジェイ・パンデ: Attention is All You Need ペーパーや変圧器のしくみだけでも研究している場合は、多くの部分があります。 そして、それはおそらく、XNUMX 人の人間が短期間で効果的にその作業を行うことができるレベルを超えたように思われます。

ヤコブ・ウスコライト: 絶対に。

ビジェイ・パンデ: したがって、これらの種類のことを行うには、人々のチームが本当に必要です。 その社会学は? そのようなことはどのように起こりますか?

ヤコブ・ウスコライト: この特定の事例は、私が個人的に感じていることですが、科学研究に対するより産業的なアプローチに非常によく適合する、非常に素晴らしい例です。 あなたがまさに正しいからです。 これは、すべてを引き立たせるイマジネーションとクリエイティビティの唯一の大きな火花ではありませんでした。

最終的に必要だったのは、本当にたくさんの貢献でした。 実際に実装を含む環境、ライブラリ (後に Tensor2Tensor の名前でオープン ソース化されたライブラリ) を持つこと。 そして、単なる実装ではなく、非常に優れた実装、あらゆる種類の深層学習のトリックの高速な実装です。

しかし、以前に発表された分解可能な注意モデルのように、以前の出版物から生まれたこれらの注意メカニズムに至るまで、実際には改善と革新、オプティマイザーに関する発明と組み合わされました。 これらすべてについて同時に世界をリードする専門家であり、これらすべての側面に同じように情熱を注いでいる人はいないと思います。

ビジェイ・パンデ: 特に、最初のアイデア、実装、スケーリングがあります。 大企業以外の場所でそのような規模に到達することは、現在のところ、コストの理由だけでおそらく実行可能ではありません.

ヤコブ・ウスコライト: 実際、大企業の側面はそれほど重要ではないと思います。

ビジェイ・パンデ: うん?

ヤコブ・ウスコライト: 会社の側面は、私がより高く評価するものです。 何千ものTPUやGPU、またはあなたが持っているものが必要な場合、大企業は確かに害はありません. 深いポケットは、この種のものに害を及ぼすことはありません。 しかし同時に、産業界におけるこの種の探索的研究に関するインセンティブ構造は、この種のプロジェクトにより適していると私は信じています。 そして、それは実際に私たちが見ているものであり、ジェネレーティブ AI プロジェクトを全面的に見ていると思います。

ビジェイ・パンデ: うん。 そして、あなたの言いたいことは、それはスタートアップかもしれないということです。

ヤコブ・ウスコライト: それは間違いなくスタートアップかもしれません。 そして、アクセラレータ ハードウェアの使用が少なくとも手頃な価格になりつつあることがわかっていると思います。 また、画像生成やテキスト生成を対象としたジェネレーティブ AI に関しては、非常に競争しているスタートアップがあります。

生命科学へのジャンプ

ビジェイ・パンデ: あなたが今していることに移行したいと思います。 あなたは、RNA 治療のために AI を RNA 生物学に適用する会社、Inceptive の CEO です。 ライフサイエンスに転向したきっかけは? 表面的には、夕食[テーブル]の周りで言語モデルについて話し、次にGoogleカフェテリアの周りで話している…それは次世代の治療法へのジャンプのように思える. それはどのようにして起こったのですか?

ヤコブ・ウスコライト: 私はこれ以上同意できませんでした。 私にとっては、素晴らしい学習体験です。 かなり長い間、生物学は、伝統的な生物学をバックボーンとする医薬品開発や直接設計に関して、私たちがどこまで行くことができるかということは考えられないように思われるような問題として私を襲いました。未来の薬の設計、または設計方法の発見に取り組みます。

ディープ ラーニング、特に大規模な学習は、さまざまな理由から、ここで本当に適切なツールになる可能性があるようです。 これらの理由の XNUMX つは、必ずしも利点として請求されないことが多いことです。これは、何かを投げることができるのはこの大きなブラック ボックスであるという事実です。 そして、あなたがそれを投げることができるというのは真実ではありません。 それはあなたがそれを投げる方法を知らなければならないものです.

ビジェイ・パンデ: そして、それは正確に黒でもありません。 それについては後で議論できます。

ヤコブ・ウスコライト: はい、正確に。 丁度。 しかし、結局のところ、言語への類推に戻ると、その意味で、言語を完全に理解して概念化することができたわけではありません。言語の背後にあるこの理論を理解すると、その後、それを「理解する」アルゴリズムを実装できるようになります。 その点に到達したことはありません。 代わりに、私たちは中止して一歩後退しなければならず、私の意見では、それが最も現実的なアプローチではなかった可能性があることをある程度認めなければなりませんでした. 代わりに、そのレベルの概念理解を必要としないアプローチを試す必要があります。 そして、生物学の一部についても同じことが言えると思います。

AI を使用してバイオをさらに進化させる

ビジェイ・パンデ: 興味深いことに、私たちは以前にこのようなことについて話しました。 物理学と微積分学の世紀であった前世紀について考えてみてください。 アインシュタインの場の方程式のように非常に複雑な言語で書かれた非常に単純な方程式を XNUMX つの方程式で非常にエレガントに単純化できる方法があるという特定の考え方があります。 物理学の社会学とほとんど同じように、ファインマンのアプローチが、ここ生物学には当てはまらないかもしれないという話をしましたよね?

ヤコブ・ウスコライト: 少なくとも現時点でわかる XNUMX つの理由から、当てはまらない可能性があります。 XNUMXつ目は、関与するプレーヤーが多すぎることです。 そして、すべてをシュレディンガーの方程式に還元して解くことができるかもしれないというのは事実ですが、たまたま、計算が難しいだけでなく、これらすべての異なるプレーヤーについて知る必要があり、現在はわかっていません。 . 程遠い。 それは一つの側面です。

XNUMX つ目は、基本的には計算上の扱いにくさです。ある意味での削減は行き過ぎており、すべてを XNUMX つのものに戻しますが、私たちの計算アプローチは基本的に使用するため、役に立ちません。予測を行うためのこれらの基礎は、生命にとって本当に重要なほど大きなシステムの予測を行うには遅すぎます。

ビジェイ・パンデ: うん。 つまり、n 体の方程式ではありませんが、まだ形式主義の感覚があります。おそらく、よりデータ駆動型の形式主義か、よりベイジアン形式主義です。 それはあなたがやりたいことにどのように影響しますか? それは、AI やその他の種類の新しいアルゴリズムの適用にどのように影響しますか?

ヤコブ・ウスコライト: いくつかの異なる側面があると思います。 結局のところ、ジェネレーティブ AI で現在見られていることから得られる大きなポイントの XNUMX つは、完全にクリーンであるだけでなく、正確にドメインからのデータでトレーニングする必要がなくなったことです。そして、後で取り組みたいタスクの種類から。 しかし、その代わりに、実際にはより有益であるかもしれませんし、遠く離れた関連性さえあるすべてのものを実際に訓練しようとすることがこれまでに発見された唯一の方法でさえあるかもしれません. そして、これらのデータから収集された情報を効果的に使用して、いわゆる基盤モデルを完成させます。これにより、はるかに小さく扱いやすい量のよりクリーンなデータを使用して、あらゆる種類の特定のタスクに微調整できます。

私たちは、現象全体について知るべきことを少し過小評価していると思います。 非常に優れた大規模な言語モデルを構築するには、インターネットと呼ばれるものがあり、そこには多くのテキストがあることを理解する必要があります。 実際には、このテキストを見つける方法、テキストではないものなどについてかなり理解する必要があります。これは、基本的にそこからトレーニング データを抽出して使用するためです。

生物学に関しては、非常に直接的に類似した課題があると思います。 大きな問題は、生命を十分な規模で、ほぼ十分な忠実度で観察できるようにスケールできる実験とは何かということです。基本的に、これらの基礎モデルの構築を開始するために必要なデータをそこから取得し、それを使用して微調整し、特別に設計して、取り組みたい問題に実際にアプローチします.

データ生成部分は確かにそのXNUMXつです。 アーキテクチャと、たとえば基礎となる物理学について私たちが知っていることを模倣するモデルとネットワーク アーキテクチャを効果的に持つことは、実際に計算を節約し、これらのモデルが持つ必要のある膨大な量のデータの需要を削減するための非常に強力な方法であり続けるでしょう。 、実現可能なレベルまで。 そして、私が実際に興味深いと思うことの XNUMX つは、トランスフォーマーなどのモデルの現在の多くのアプリケーションが、他のモダリティ、他のドメイン、言語、ビジョン、画像生成、など、そしてそれらを生物学に適用することは、基本的に、時間のようなものが存在することを知っているという事実と、物理法則は、少なくとも私たちの知る限りでは変化しないように見えるという事実を無視しています。時間とともに。

タンパク質の折り畳みのプロセスは、シャペロンなどの非常に多くのプレーヤーが存在するという事実を無視して、実際には、ある意味で、タンパク質動態の残りの部分からかなり恣意的に分離された問題です. それは、その分子の残りの動力学、またはそのタンパク質の残りの寿命と同じくらいの動力学です. では、なぜ一方のモデルに特化してモデルをトレーニングし、少なくとももう一方のデータを無視しようとするのでしょうか? この場合、より具体的に言えば、今日私たちが持っているタンパク質構造予測モデルのいくつかは、時間の存在をゆっくりと受け入れ始めているという事実のために、暗黙のうちに速度論について何かをすでに学んでいますか?

新しいアーキテクチャの開発

ビジェイ・パンデ: あなたが今立っている場所について私が考える興味深いことの XNUMX つは、いくつかのまれな例外を除いて、ほとんどのディープ ニューラル ネットワークや生物学における他のタイプの AI は、どこかで発明されたものを引き継いでいるように感じることです。 画像に畳み込みニューラル ネットを使用するように。 おそらく小分子の場合…スタンフォード大学の私の研究室では、グラフ ニューラル ネットワークといくつかの畳み込みニューラル ネットワークを使用しました。 しかし、生物学的問題に対して明示的にアルゴリズムを実際に開発することは非常にまれです。 そして私はいつも、生物学の分野とコンピュータ サイエンスの分野で強力なチームのスキルセットを持つのが難しいからだと思っていました。 しかし、私はあなたの考えを知りたいです。 それとも、そもそも新しいアーキテクチャを開発することはめったにないのでしょうか?

ヤコブ・ウスコライト: 結局のところ、私たちが見ているのは、新しいアーキテクチャは、特定の問題に動機付けられていても、本当に違いを生むのであれば、他の場所にも適用できる傾向があるということです. 一方で、それは、そこに向かう途中で、動機となるアプリケーションとドメインが何であるかを慎重に選択しても、大きな違いがないことを意味するものではありません. そして、それは確かにそうだと思います。

ここでの重要な課題の XNUMX つは、私たちがまだ生物学の領域に大量のデータを保持している状態にまだ達していないことだと思います。 しかし、私たちはまだ、それが Web に相当するものに留まっているような体制にはなっておらず、少しフィルタリングしてダウンロードすれば完了です。 むしろ、かなりの規模で作成する必要があると思います。 そして、それはディープラーニングの専門家、少なくともほとんどの専門家によって行われることはありません。

そして、それは、そのデータの特性を本当に理解することと足並みをそろえて行わなければならないと思いますよね? そこで遭遇するノイズの種類。 これらが実際には非常に大規模なプール、高スループットの実験で作成されているという事実ですが、それでも、異なる実験者によって異なる日に実行される実験などがあります。 そして、より深い学習のバックグラウンドを持つ人々が生物学のバックグラウンドを持つ人々と十分に緊密に連携し、根本的な現象について私たちが知っていることを十分に学ぶと、[彼らは]基本的に興味深い新しいアプローチを試すように促されます.

ビジェイ・パンデ: ええと、あなたが「Attention is All You Need」論文の例について、情熱が互いにかなり直交しているこの多様な人々のグループをどのように獲得したいかについて話したとき、私は気に入りました。 ある意味では、これを生物学で行っているとき、特に Inceptive で行っていることについては、このすべての作業をデータの生成にも費やす必要があります。 そして、データを生成するということは、非常に明確に言えば、生物学的実験を大規模に実行することを意味します。 入力部分自体は非常に高価で非常に技術的であり、あなたが言ったように、うまくいかない方法がたくさんあります。 しかし、あなたは以前に行った文化の上に構築しているように聞こえますが、今では、類似した方法で調整するさまざまな情熱を持つより多くの専門家になっています.

ヤコブ・ウスコライト: 私は本当に必要です [そして] 人々はそれを必要としています. これは、私が知る限り、最も有望な方法です。 [それは] ある意味で、人生の根底にある側面について、私たちの最善の知識を考慮して、それらが作成された研究室の特定のデータがあるパイプライン モデルを目指していません。 そして、その上で既存の深層学習アプローチを実行し、微調整を開始します。 しかし、実際には、ある意味で、現在まだあまり有名ではない分野で実際に働いている最初の人々の中にいるかもしれない人々を実際に持つことです.

おそらく、最も一般的ではない分母は、あなたが知っていること、以前に学んだこと、そしておそらく最も多くの時間を費やしたことを超えた好奇心です. 他の非常に多くの分野と同じように、私たちが本当に求めているのは、非常に多様なバックグラウンドを持ちながらも好奇心を共有する一連の人々です。

AIはどこへ向かうのか?

ビジェイ・パンデ: 医薬品の設計やヘルスケアなどの難しい問題に対して、AI は現在どこにいると思いますか? 何をしなければなりませんか? いつそこに着きますか?

ヤコブ・ウスコライト: 将来について予測することは常に非常に危険ですが、今後 XNUMX 年以内に現実の世界への影響に関して [変曲点] が実際に発生し始めないとしたら、私は非常に驚くでしょう。機械学習、医薬品開発における大規模深層学習、医薬品設計。 もちろん、正確にはどこで最初になるかというと、その多くは RNA、RNA 治療薬、ワクチンの周りで起こると私は信じています。 これによって影響を受けるのは確かにそれだけではありませんが、私たちは間違いなく変曲点の領域に向かっていると思います.

ビジェイ・パンデ: あなたは興味深い点を指摘しました。 RNAとの違いは何ですか? 特に興味深いと思うのは、あなたが Google Brain から生物学に進んだだけでなく、具体的には RNA に進んだことです。 特に AI や ML の観点から、RNA に惹かれる理由は何ですか?

ヤコブ・ウスコライト: RNA の興味深い点の 20 つは、これまで見てきたように、単一の適応症という意味ではまだ狭いものの、非常に幅広い適用範囲の組み合わせです。適用範囲が非常に広く、構造的に単純な問題と相まって (これは少しあいまいですが) あることは明らかです。 そして構造的に単純なのは、RNA の構造予測が単純であるという文ではなく、XNUMX つの異なる塩基を持つ生体高分子であるという意味で構造的に単純です。 XNUMX以上のアミノ酸について話しているわけではありません. かなり効率よく生産できるものです。

そこにはいくつかの課題がありますが、合成はスケーリングできるものであり、急速にスケーリングしています。これらが実際に組み合わさって、この急速なフィードバックループを可能にします。これはよく言及されると思いますが、少なくとも私が知っている限りでは、実際に実装されることはほとんどありません。そして一日の終わりに実装可能です。

ビジェイ・パンデ: ええ、間違いなくおそらく、特にあなたがそれを追い求める方法については、より迅速なフィードバックループです.

ヤコブ・ウスコライト: はい。 そして、私たちが訓練しているモデルを訓練するための大部分のデータを作成する必要があると私が信じていることを考えると、私たちは実際にそのようなデータを大規模に作成するために Inceptive に投資しています. そして、構造の単純さだけでなく、合成とこの実験のスケーラビリティに関しても、RNA が最高の組み合わせであるように思われることを考えると、比較的かなり大規模であると言えます。 ここには、これまで開拓されていなかった大きな可能性があります。

ビジェイ・パンデ: ええ、特に可能性としては、これらの急速なサイクルを持つ能力があると思います。これは、前臨床のようなものであり、したがって、より速くクリニックに到着し、[より短い期間]クリニックにいることができます.

ヤコブ・ウスコライト: 絶対。 それがまさに私たちが望んでいることです。 また、それが事実である可能性があり、もちろん、本当に、本当に興奮していることを示す初期のヒントも見ています.

ビジェイ・パンデ: 10 年から現在までの 2012 年間を考えると、驚くべきものでした。 次の10年はどうなると思いますか? 10 年後の AI はどこにあると思いますか? 広く、または特にバイオのために?

ヤコブ・ウスコライト: 私たちがこの変曲点の領域に入っているということが本当に本当なら、今から10年後を振り返ると、それは少なくとも、私たちが過去に見たと私たちが考えているものと同じくらい大きく、広大な革命のように見えるでしょう.過去10年間。 少なくとも。 今は決定的な違いがあると思います それは、過去10年間に私たちが目撃してきた革命が 人々の生活にどの程度影響を与えているか 正確には明らかではないということです特定の分野、検索エンジン、補助ライティングなどでは明らかですが、この革命がどれほど広く適用できるかは明らかではありません。 その通りだと思いますが、まだ見えていません。 今後 10 年間に特にバイオ関連で見られる革命、または今から 10 年後に振り返る革命は、私たちのすべての生活に与える深刻な影響という点で、まったく異なるものになると思います。 .

創薬の設計と発見のアプリケーションはさておき、科学的発見とその周辺には驚くべきアプリケーションがあり、Web インターフェイスを使用して、特定の生物で非常に高い確率で分子を設計することができると想像できます。特定の質問に答えて、以前に取得できたものよりも信頼性の高い読み取り値を生成します。 したがって、これが最終的に患者やすべての人にどのように影響するかという複雑さをすべて除外したとしても、これらのツールが生物学のような分野を急速に加速させることは明らかだと思います.

ビジェイ・パンデ: それはそれを終わらせるのに最適な場所のようです。 ヤコブ、Bio Eats World に参加してくれてありがとう。

ヤコブ・ウスコライト: どうもありがとうございました。

オリビア・ウェッブ: バイオイーツワールドにご入会いただき、誠にありがとうございます。 Bio Eats World は、a16z の Bio + Health チームの助けを借りて、私 Olivia Webb によってホストおよび制作され、Phil Hegseth によって編集されています。 Bio Eats World は、a16z ポッドキャスト ネットワークの一部です。

エピソードについて質問がある場合、または今後のエピソードのトピックを提案したい場合は、メールでお問い合わせください [メール保護] 最後になりましたが、Bio Eats World を楽しんでいる場合は、ポッドキャストを聴いているところに評価とレビューを残してください。

ここに記載されている内容は情報提供のみを目的としており、法律、ビジネス、税務、または投資のアドバイスとして解釈したり、投資や証券の評価に使用したりしてはならず、a16z ファンドの投資家または潜在的な投資家を対象としたものではないことに注意してください。 . 詳細については、a16z.com/disclosures を参照してください。

***

ここに示されている見解は、引用された個々のAH Capital Management、LLC(「a16z」)の担当者の見解であり、a16zまたはその関連会社の見解ではありません。 ここに含まれる特定の情報は、a16zが管理するファンドのポートフォリオ企業を含むサードパーティの情報源から入手したものです。 a16zは、信頼できると思われる情報源から取得したものですが、そのような情報を独自に検証しておらず、情報の永続的な正確性や特定の状況に対するその適切性について表明していません。 さらに、このコンテンツにはサードパーティの広告が含まれる場合があります。 a16zはそのような広告をレビューしておらず、そこに含まれる広告コンテンツを推奨していません。

このコンテンツは情報提供のみを目的として提供されており、法律、ビジネス、投資、または税務に関するアドバイスとして信頼されるべきではありません。 これらの問題については、ご自身のアドバイザーにご相談ください。 証券またはデジタル資産への言及は、説明のみを目的としたものであり、投資の推奨または投資顧問サービスの提供を構成するものではありません。 さらに、このコンテンツは、投資家または将来の投資家による使用を目的としたものではなく、a16zが管理するファンドへの投資を決定する際にいかなる状況においても信頼されない場合があります。 (a16zファンドへの投資の申し出は、私募覚書、サブスクリプション契約、およびそのようなファンドの他の関連文書によってのみ行われ、その全体を読む必要があります。)言及、参照、または記載されているのは、a16zが管理する車両へのすべての投資を代表するものではなく、投資が有益である、または将来行われる他の投資が同様の特性または結果をもたらすという保証はありません。 アンドリーセンホロウィッツが管理するファンドが行った投資のリスト(発行者がa16zに公開を許可していない投資、および公開されているデジタル資産への未発表の投資を除く)は、https://a16z.com/investmentsで入手できます。 /。

記載されているチャートおよびグラフは、情報提供のみを目的としており、投資を決定する際に信頼することはできません。 過去の実績は将来の結果を示すものではありません。 内容は、示された日付の時点でのみ話されています。 これらの資料に記載されている予測、推定、予測、目標、見通し、および/または意見は、予告なしに変更される場合があり、他の人が表明した意見と異なる場合があります。 その他の重要な情報については、https://a16z.com/disclosuresを参照してください。

- SEO を活用したコンテンツと PR 配信。 今日増幅されます。

- Platoblockchain。 Web3メタバースインテリジェンス。 知識の増幅。 こちらからアクセスしてください。

- 情報源: https://a16z.com/2023/01/11/bio-eats-world-using-ai-to-take-bio-farther/

- 10

- 2012

- a

- a16z

- 能力

- できる

- 私たちについて

- それについて

- 絶対の

- 絶対に

- アカデミー

- アカデミック

- 加速する

- 加速器

- 精度

- 越えて

- 実際に

- 適合しました

- 添加

- NEW

- 認める

- 利点

- 利点

- 広告運用

- アドバイス

- アドバイザリー

- 助言サービス

- 影響を及ぼす

- アフィリエイト

- 手頃な価格の

- 後

- 契約

- AI

- 愛の研究

- アルゴリズム

- アルゴリズム

- すべて

- 並んで

- 既に

- しかし

- 常に

- 驚くべき

- 間で

- 私たちの間で

- 量

- 金額

- &

- アンドレッセン

- アンドレッセン・ホロウィッツ

- 別の

- 回答

- 誰も

- どこにでも

- 食欲

- 適用可能な

- 申し込み

- 申し込む

- 適用

- アプローチ

- アプローチ

- 承認

- APT

- AREA

- エリア

- 主張する

- 引数

- 周りに

- 側面

- 側面

- 資産

- 想定される

- 保証

- 注意

- 魅力

- 著者

- 利用できます

- 大通り

- 平均

- バック

- バックボーン

- 背景

- 背景

- バッグ

- 言葉の袋

- 基本的に

- ベイジアン

- なぜなら

- になる

- になる

- 背後に

- さ

- 信念

- 信じる

- 信じて

- と考えています

- ベル

- 以下

- 有益な

- BEST

- より良いです

- の間に

- 越えて

- ビッグ

- 億

- バイオ+健康

- 生物学

- ビット

- ブラック

- ボード

- ボトム

- 結合した

- ボックス

- 脳

- もたらす

- 広い

- 広く

- ビルド

- 建物

- 束

- ビジネス

- 呼ばれます

- 資本

- キャプチャー

- キャリア

- 慎重に

- 携帯

- 場合

- 例

- 天井

- 世紀

- 最高経営責任者(CEO)

- 一定

- 確かに

- 課題

- 挑戦

- 変化する

- 変更

- 特性

- 安い

- 選択する

- 状況

- クレーム

- クリア

- クリニック

- 閉じる

- 密接に

- クローザー

- クラスタリング

- 共同 - 創設者

- 同僚

- 組み合わせ

- 組み合わせた

- 来ます

- 到来

- コマンドと

- 伝える

- 企業

- 会社

- 比較的

- 比べ

- 競合します

- 複雑な

- 複雑さ

- 複雑な

- 計算

- 計算

- コンピュータ

- コンピュータサイエンス

- Computer Vision

- コンピューター

- コンセプト

- 概念の

- 連続した

- 構成します

- コンテンツ

- コンテキスト

- 逆に

- 貢献

- 会話

- 会話

- 調整する

- 費用

- 可能性

- カップル

- 結合しました

- ここから

- 作ります

- 作成した

- 作成

- 創造性

- 重大な

- 文化

- 好奇心

- 興味深い

- 電流プローブ

- 現在

- サイクル

- パパ

- 危険な

- データ

- データ駆動型の

- 日付

- 中

- 日

- 決定

- 深いです

- 深い学習

- ディープニューラルネットワーク

- より深い

- 絶対に

- 記載された

- 設計

- 設計

- 細部

- 開発する

- 発展した

- 開発

- DID

- 異なる

- 違い

- 異なります

- 難しい

- デジタル

- デジタル資産

- 夕食

- 直接

- 直接に

- 開示する

- 発見する

- 発見

- 話し合います

- 議論

- 遠い

- 異なる

- DNA

- ドキュメント

- そうではありません

- すること

- ドメイン

- ドメイン

- ドント

- ダウン

- ダウンロード

- 欠点

- ドリブン

- 薬

- 創薬

- 薬物

- 各

- 早い

- 簡単に

- 社説

- 効果的に

- 効果

- 効率

- 努力

- どちら

- 他の場所で

- 受け入れる

- 新興の

- enable

- 出会い

- 遭遇

- 裏書きする

- 我慢する

- エンジン

- 巨大な

- 十分な

- 確保

- 全体

- 完全に

- 全体

- 起業家

- 環境

- 方程式

- 同等の

- 特に

- 見積もり

- 等

- 評価する

- さらに

- イベント

- 最終的に

- EVER

- 誰も

- すべてのもの

- 正確に

- 例

- 除く

- 興奮した

- エキサイティング

- 除外

- 既存の

- 広大な

- 高価な

- 体験

- 専門家

- 表現します

- 表現

- かなり

- おなじみの

- 家族

- 魅惑的な

- スピーディー

- 速いです

- 実行可能な

- 特徴

- フィードバック

- 少数の

- フィールド

- フィールズ

- filter

- もう完成させ、ワークスペースに掲示しましたか?

- 終わり

- 名

- フィット

- フォーカス

- 焦点を当て

- 最前線

- 外国の

- 以前は

- 発見

- Foundation

- AIとMoku

- 創業

- FRAME

- から

- フル

- 完全に

- ファンド

- 基礎

- 資金

- おかしいです

- さらに

- 未来

- 生成

- 世代

- 生々しい

- 生成AI

- ドイツ語

- 取得する

- 受け

- 与える

- 与えられた

- 与える

- グローバル

- Go

- 行く

- 良い

- でログイン

- グーグル翻訳

- Googleの

- GPU

- 卒業生

- グラフ

- グラフニューラルネットワーク

- グラフ

- 素晴らしい

- グループ

- グループの

- 成長

- 半分

- 起こる

- 起こります

- ハード

- Hardware

- 持って

- 向かって

- 健康

- ヘルスケア

- 助けます

- こちら

- ハイ

- より高い

- ヒント

- ヒット

- 期待している

- 期待して

- ホロウィッツ

- 主催

- 認定条件

- How To

- HTTPS

- 巨大な

- 人間

- 傷つける

- アイデア

- 識別する

- 画像

- 画像生成

- 画像

- 想像力

- 影響

- 実装する

- 実装

- 実装

- 重要

- 不可能

- 感銘を受けて

- 改善

- in

- その他の

- 誘因

- include

- 含まれました

- 含めて

- 信じられない

- 信じられないほど

- 単独で

- 個人

- インダストリアル

- 産業を変えます

- 変曲点

- 情報

- 情報

- 初期

- イノベーション

- ひらめき

- インスピレーションある

- を取得する必要がある者

- 対話

- 興味深い

- インタフェース

- 内部

- インターネット

- 交差点

- 直観的な

- 発明された

- 発明

- 投資する

- 投資

- 投資

- インベストメント

- 主要株主

- 関係する

- 問題

- 発行者

- 問題

- IT

- イタリア語

- 自体

- join

- 参加

- 旅

- ジャンプ

- 保管

- キー

- 種類

- 知っている

- 知識

- ラボ

- ラボ

- 言語

- ESL, ビジネスESL <br> 中国語/フランス語、その他

- 大

- 大規模

- より大きい

- 姓

- 打ち上げ

- 法制

- 層

- つながる

- 主要な

- 飛躍

- LEARN

- 学んだ

- 学習

- コメントを残す

- 残す

- リーガルポリシー

- 長さ

- レンズ

- させる

- レベル

- 生活

- 生命科学

- LINE

- LINK

- リスト

- 耳を傾ける

- 少し

- 命

- 長い

- 見て

- 探して

- LOOKS

- たくさん

- 愛

- 愛され

- 機械

- 機械学習

- 機械翻訳

- マシン

- 製

- 維持する

- make

- 作る

- 作成

- マネージド

- 管理

- 方法

- 多くの

- 大規模な

- 材料

- math

- 問題

- 事態

- 意味

- 手段

- 草の根データベース

- メモリ

- 言及した

- メソッド

- かもしれない

- マインド

- 採掘された

- ML

- モデル

- モダン

- 分子

- 他には?

- 最も

- やる気

- 動作

- 移動する

- 名

- すなわち

- ナチュラル

- 自然言語

- 必ずしも

- 必要

- 必要

- ネッツ

- ネットワーク

- ネットワーク

- ニューラル

- ニューラルネットワーク

- 新作

- 次の

- ノイズ

- ノート

- 数

- 観察する

- 得

- 提供

- 提供すること

- ONE

- 開いた

- 意見

- 意見

- 最適化

- オプション

- 注文

- 受注

- その他

- その他

- 全体

- 自分の

- 足

- 紙素材

- パラダイム

- 並列シミュレーションの設定

- 部

- 特定の

- 特に

- パートナー

- 部品

- パーティー

- 情熱的な

- 過去

- パッチ

- パッチ

- path

- 患者

- パターン

- のワークプ

- パフォーマンス

- 期間

- 許可

- 人

- 個人的に

- Personnel

- 現象

- PHIL

- 物理学

- パイプライン

- ピクセル

- 場所

- 場所

- プラトン

- プラトンデータインテリジェンス

- プラトデータ

- プレーヤー

- お願いします

- 便利なポケット付。

- ポッドキャスト

- ポッドキャスト

- ポイント

- 視点

- プール

- ポートフォリオ

- ポジション

- 可能

- 潜在的な

- :

- 電力

- パワード

- 強力な

- 実用的

- 練習

- 現実的

- 正確に

- 予測

- 予測

- かなり

- 前

- 前に

- 主に

- 事前の

- プライベート

- 多分

- 問題

- 問題

- プロセス

- ラボレーション

- 処理

- 生産された

- プロダクト

- 生産

- 製品

- 有益な

- プロジェクト

- 予測

- プロジェクト(実績作品)

- 約束

- 有望

- 見込み客

- 保護された

- タンパク質

- 提供します

- 提供

- 出版物

- 公然と

- 公表

- 出版

- 目的

- 置きます

- パッティング

- 質問

- 質問

- 根本的に

- ランダム

- 急速な

- 急速に

- 珍しい

- 評価

- リーチ

- 読む

- 読んで

- リアル

- 現実の世界

- 実現

- 実現

- 理由は

- おすすめ

- 再発

- レッド

- 減らします

- 縮小

- リファレンス

- 言及

- 政権

- 関連する

- 関連した

- 信頼性のある

- 残る

- 覚えています

- 復元力

- 表現

- 代表者

- 必要とする

- 研究

- レストラン

- 結果

- レビュー

- 日

- リビジョン

- 革命

- RNAを

- ラン

- ランニング

- 前記

- 同じ

- 節約

- スケーラビリティ

- 規模

- スケーリング

- 学校

- 科学

- 科学

- 科学研究

- 科学者

- を検索

- 検索エンジン

- 二番

- 有価証券

- セキュリティ

- 見ること

- と思われる

- シニア

- センス

- 文

- シーケンス

- サービス

- セッションに

- セット

- いくつかの

- シェアする

- シフト

- ショート

- 短期

- すべき

- 表示する

- 重要

- 同様の

- 同様に

- 簡単な拡張で

- 単純

- 簡素化する

- 単純化

- 同時に

- から

- 座っている

- 状況

- サイズ

- 遅く

- ゆっくり

- 小さい

- より小さい

- So

- これまでのところ

- 解決する

- 一部

- 誰か

- 何か

- 幾分

- どこか

- すぐに

- 洗練された

- ソース

- スペース

- スパーク

- 話す

- スピークス

- 特定の

- 特に

- 特異性

- 費やした

- スタンド

- スタンフォード

- start

- 開始

- 起動

- スタートアップ

- スタートアップ

- 最先端の

- 統計的

- 手順

- ステップ

- まだ

- ストーリー

- ストリート

- 強い

- 構造の

- 構造

- 研究

- 勉強

- 蹉跌

- テーマ

- 購読

- 成功する

- そのような

- 十分な

- 驚きました

- システム

- テーブル

- 取る

- まとめ

- 取得

- Talk

- 会話

- 対象となります

- ターゲット

- タスク

- 税金

- チーム

- テク

- 技術的

- 条件

- テキスト生成

- 未来

- 情報

- 世界

- アプリ環境に合わせて

- 自分自身

- 治療薬

- そこ。

- したがって、

- その中に

- もの

- 物事

- 考え

- サードパーティ

- 考え

- 数千

- 三

- 介して

- 全体

- スループット

- 時間

- <font style="vertical-align: inherit;">回数</font>

- 〜へ

- 今日

- 一緒に

- トークン化する

- トーン

- あまりに

- ツール

- 豊富なツール群

- トピック

- 取引

- 伝統的な

- トレーニング

- 訓練された

- トレーニング

- 成績証明書(トランスクリプト)

- トランスフォーマー

- 遷移

- 翻訳する

- インタビュー

- 数兆

- true

- チューリング

- オン

- 最終的に

- 下

- 根本的な

- わかる

- 理解する

- 理解された

- 未開発

- us

- つかいます

- ワクチン

- 値

- 車

- 自動販売機

- 検証

- 非常に多様

- ビデオ

- 詳しく見る

- ビュー

- ビジョン

- wanted

- ウェーブ

- 方法

- ウェブ

- 歓迎

- この試験は

- 何ですか

- かどうか

- which

- while

- 誰

- 意志

- ウィンドウズ

- 以内

- 無し

- 目撃者

- 目撃

- 素晴らしい

- Word

- 言葉

- 仕事

- ワーキング

- 作品

- 世界

- 世界の

- でしょう

- 書きます

- 書き込み

- 間違った

- 年

- あなたの

- ゼファーネット