著者による画像

最近、私たちは皆、LLM 分野の最新リリースに追いつくのに非常に苦労しています。 ここ数週間で、オープンソースの ChatGPT の代替手段がいくつか普及してきました。

この記事では、 チャットGLM シリーズと チャットGLM-6B、オープンソースで軽量な ChatGPT の代替品。

さあ行こう!

中国の清華大学の研究者は、GPT-3 や BLOOM などの他のモデルと同等の性能を持つ ChatGLM シリーズ モデルの開発に取り組んできました。

ChatGLM は、中国語と英語の両方でトレーニングされたバイリンガル大規模言語モデルです。 現在、次のモデルが利用可能です。

- ChatGLM-130B: オープンソース LLM

- ChatGLM-100B: オープンソースではありませんが、招待のみのアクセスを通じて利用可能です

- ChatGLM-6B: 軽量のオープンソース代替品

これらのモデルは、大規模な言語モデルの Generative Pretrained Transformer (GPT) グループに似ているように見えるかもしれませんが、 一般言語モデル (GLM) 事前トレーニング フレームワーク それが彼らの違いです。 これについては次のセクションで詳しく説明します。

機械学習では、GLM を次のように認識します。 一般化線形モデル、ただし、ChatGLM の GLM は 一般的な言語モデル.

GLM 事前トレーニング フレームワーク

LLM の事前トレーニングは広範囲に研究されており、現在も活発に研究されている分野です。 GLM 事前トレーニングと GPT スタイルのモデルの主な違いを理解してみましょう。

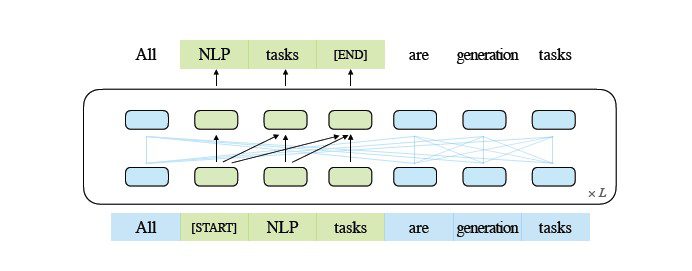

GPT-3 ファミリのモデルは、デコーダ専用の自動回帰言語モデリングを使用します。 一方、GLM では、目的の最適化は次のように定式化されます。 自動回帰空白埋め問題.

GLM | 画像ソース

簡単に言えば、 自動回帰による空白埋め これには、連続するテキストをブランクアウトし、このブランク化されたテキストを順次再構築することが含まれます。 短いマスクに加えて、文末からテキストの長い空白をランダムに削除する長いマスクもあります。 これは、モデルが自然言語理解および生成タスクにおいて適切にパフォーマンスを発揮できるようにするために行われます。

もう XNUMX つの違いは、使用される注意の種類です。 大規模言語モデルの GPT グループは一方向の注意を使用しますが、LLM の GLM グループは 双方向の注意。 マスクされていないコンテキストに対して双方向のアテンションを使用すると、依存関係をより適切に捕捉でき、自然言語理解タスクのパフォーマンスを向上させることができます。

GELUの活性化

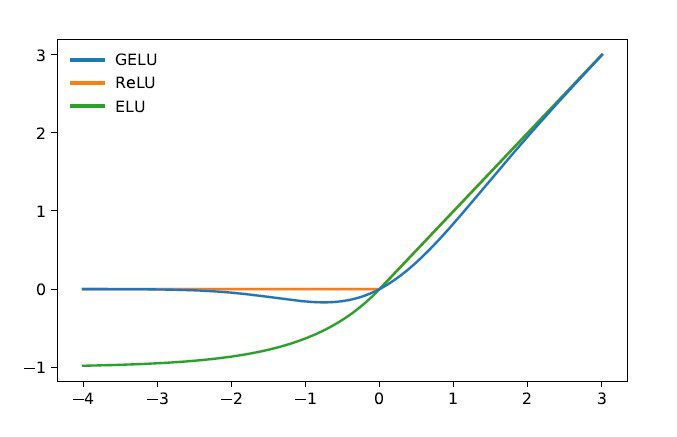

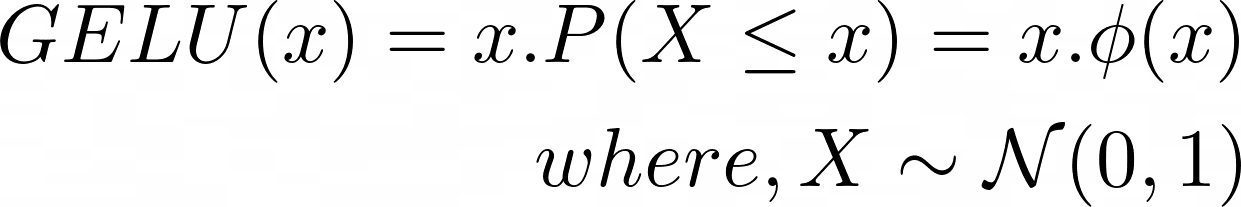

GLM では、ReLU アクティベーションの代わりに GELU (Gaussian Error Linear Units) アクティベーションが使用されます [1]。

GELU、ReLU、ELU のアクティベーション | 画像ソース

GELU のアクティブ化は、すべての入力に対してゼロ以外の値を持ち、次の形式になります [3]。

GELU アクティベーションは、ReLU アクティベーションと比較してパフォーマンスが向上することがわかっていますが、ReLU よりも計算量が多くなります。

LLM の GLM シリーズでは、ChatGLM-130B がオープンソースであり、GPT-3 の Da-Vinci モデルと同等のパフォーマンスを発揮します。 前述したように、この記事の執筆時点では、招待のみのアクセスに制限されている ChatGLM-100B バージョンがあります。

チャットGLM-6B

ChatGLM-6B をエンド ユーザーがアクセスしやすくするために、ChatGLM-XNUMXB について次の詳細を説明します。

- 約6.2億のパラメータを持ちます。

- このモデルは、英語と中国語の合計 1 兆個のトークンで事前トレーニングされています。

- その後、教師あり微調整や人間のフィードバックによる強化学習などの手法が使用されます。

ChatGLM の利点と制限について説明して、議論を締めくくりましょう。

Advantages

バイリンガル モデルからローカルで実行できるオープンソース モデルまで、ChatGLM-6B には次の利点があります。

- 主流の大規模言語モデルのほとんどは、英語テキストの大規模なコーパスでトレーニングされており、他の言語の大規模言語モデルはそれほど一般的ではありません。 LLM の ChatGLM シリーズはバイリンガルであり、中国語にとって最適な選択肢です。 このモデルは英語と中国語の両方で優れたパフォーマンスを発揮します。

- ChatGLM-6B はユーザーのデバイスに最適化されています。 多くの場合、エンド ユーザーのデバイス上のコンピューティング リソースは限られているため、高性能 GPU にアクセスせずに LLM をローカルで実行することはほぼ不可能になります。 と INT4量子化, ChatGLM-6B は、6GB という控えめなメモリ要件で実行できます。

- 要約や単一および複数のクエリのチャットなど、さまざまなタスクで優れたパフォーマンスを発揮します。

- 他の主流の LLM と比較してパラメータの数が大幅に少ないにもかかわらず、ChatGLM-6B は最大 2048 のコンテキスト長をサポートします。

制限事項

次に、ChatGLM-6B の制限をいくつか挙げてみましょう。

- ChatGLM はバイリンガル モデルですが、英語でのパフォーマンスは最適ではない可能性があります。 これは、トレーニングで使用される指示のほとんどが中国語であることに起因すると考えられます。

- ChatGLM-6B は大幅な機能を備えているため、 パラメータが少ない BLOOM、GPT-3、ChatGLM-130B などの他の LLM と比較して、コンテキストが長すぎるとパフォーマンスが低下する可能性があります。 その結果、ChatGLM-6B は、より多くのパラメータを持つモデルよりも不正確な情報を与える可能性が高くなります。

- 小さな言語モデルには、 限られたメモリ容量。 したがって、複数ターンのチャットでは、モデルのパフォーマンスがわずかに低下する可能性があります。

- 偏見、誤った情報、有害性はすべての LLM の制限であり、ChatGLM もこれらの影響を受けやすいです。

次のステップとして、ChatGLM-6B をローカルで実行するか、HuggingFace スペースでデモを試してください。 LLM の働きをさらに詳しく知りたい場合は、次のリストを参照してください。 大規模な言語モデルに関する無料コース.

[1] Z Du、Y Qian 他、 GLM: 自己回帰的空白埋め込みによる一般言語モデルの事前トレーニング、ACL 2022

[2] A Zheng、X Liu 他、 GLM-130B – オープンなバイリンガル事前トレーニング済みモデル、ICML 2023

[3] D ヘンドリクス、K ギンペル、 ガウス誤差線形単位 (GELU)、arXiv、2016

【4] ChatGLM-6B: HuggingFace Spaces のデモ

【5] GitHubリポジトリ

バラ プリヤ C は、長編コンテンツの作成を楽しむテクニカル ライターです。 彼女の関心のある分野には、数学、プログラミング、データ サイエンスが含まれます。 彼女は、チュートリアルやハウツー ガイドなどを作成することで、学んだことを開発者コミュニティと共有しています。

- SEO を活用したコンテンツと PR 配信。 今日増幅されます。

- プラトアイストリーム。 Web3 データ インテリジェンス。 知識増幅。 こちらからアクセスしてください。

- 未来を鋳造する w エイドリエン・アシュリー。 こちらからアクセスしてください。

- 情報源: https://www.kdnuggets.com/2023/04/chatglm6b-lightweight-opensource-chatgpt-alternative.html?utm_source=rss&utm_medium=rss&utm_campaign=chatglm-6b-a-lightweight-open-source-chatgpt-alternative

- :持っている

- :は

- :not

- $UP

- 1

- a

- 私たちについて

- アクセス

- アクセス可能な

- アクティベーション

- アクティベーション

- アクティブ

- 添加

- 利点

- AL

- すべて

- 代替案

- 選択肢

- an

- &

- です

- AREA

- エリア

- 記事

- AS

- At

- 注意

- オーサリング

- オート

- 利用できます

- BE

- になる

- になる

- き

- さ

- より良いです

- の間に

- 10億

- ブルーム

- 両言語で

- 焙煎が極度に未発達や過発達のコーヒーにて、クロロゲン酸の味わいへの影響は強くなり、金属を思わせる味わいと乾いたマウスフィールを感じさせます。

- by

- 缶

- キャプチャー

- AI言語モデルを活用してコードのデバッグからデータの異常検出まで、

- 中国

- 中国語

- 選択

- コマンドと

- コミュニティ

- 匹敵します

- 比べ

- コンピューティング

- コンテンツ

- コンテキスト

- 文脈

- 連続的な

- コース

- 作成

- 現在

- データ

- データサイエンス

- より深い

- デモ

- 細部

- Developer

- 開発

- Devices

- 違い

- の違い

- 異なります

- 議論

- 行われ

- E&T

- end

- 英語

- エラー

- 家族

- フィードバック

- 少数の

- より少ない

- フォロー中

- フォーム

- 発見

- から

- 世代

- 生々しい

- 取得する

- 与える

- 行く

- 良い

- GPU

- 素晴らしい

- グループ

- ガイド

- ハンド

- ハード

- 持ってる

- 持って

- 彼女の

- こちら

- ハイパフォーマンス

- HTML

- HTTPS

- 抱き合う顔

- 人間

- if

- 不可能

- 改善します

- in

- 不正確

- include

- 含めて

- 情報

- を取得する必要がある者

- 説明書

- 関心

- に

- 関与

- IT

- ITS

- JPG

- KDナゲット

- キー

- 知っている

- 言語

- ESL, ビジネスESL <br> 中国語/フランス語、その他

- 大

- より大きい

- 姓

- 最新の

- LEARN

- 学習

- 長さ

- 軽量

- ような

- 可能性が高い

- 制限

- 限定的

- リスト

- 局部的に

- 長い

- より長いです

- ロー

- 機械

- 機械学習

- 主流

- make

- 作る

- mask

- マスク

- math

- 五月..

- メモリ

- 言及した

- 誤報

- モデリング

- モデル

- 他には?

- ナチュラル

- 自然言語

- 自然言語理解

- 次の

- 数

- Nvidia

- 客観

- of

- 頻繁に

- on

- 開いた

- オープンソース

- 最適化

- 最適化

- or

- その他

- 私たちの

- でる

- が

- パラメータ

- パフォーマンス

- 実行する

- プラトン

- プラトンデータインテリジェンス

- プラトデータ

- 人気

- プレ

- プログラミング

- 強化学習

- リリース

- 要件

- 研究

- リソース

- 制限されました

- 結果

- ラン

- s

- 科学

- セクション

- シリーズ

- いくつかの

- 株式

- 彼女

- 同様の

- 簡単な拡張で

- より小さい

- So

- スペース

- スペース

- スパン

- スタンド

- 手順

- まだ

- 研究

- そのような

- スーパー

- サポート

- がち

- タスク

- 技術的

- テクニック

- 条件

- より

- それ

- アプリ環境に合わせて

- それら

- その後

- そこ。

- したがって、

- ボーマン

- この

- 介して

- 時間

- 〜へ

- あまりに

- 訓練された

- トレーニング

- 1兆

- 清華

- チュートリアル

- type

- わかる

- 理解する

- ユニット

- 大学

- つかいます

- 中古

- ユーザー

- users

- 価値観

- 多様

- バージョン

- ウィークス

- WELL

- この試験は

- いつ

- which

- 誰

- 働いていました

- ワーキング

- もっと悪い

- ラップ

- 作家

- 書き込み

- X

- 貴社

- ゼファーネット