작성자 별 이미지

XAI는 인간이 모델이나 시스템의 결과와 의사결정 과정을 이해할 수 있도록 해주는 인공지능이다.

사전 모델링 설명 가능성

Explainable AI는 설명 가능한 데이터와 명확하고 해석 가능한 기능 엔지니어링으로 시작합니다.

모델링 설명 가능성

특정 문제에 대한 모델을 선택할 때 일반적으로 여전히 좋은 예측 결과를 달성하는 가장 해석 가능한 모델을 사용하는 것이 가장 좋습니다.

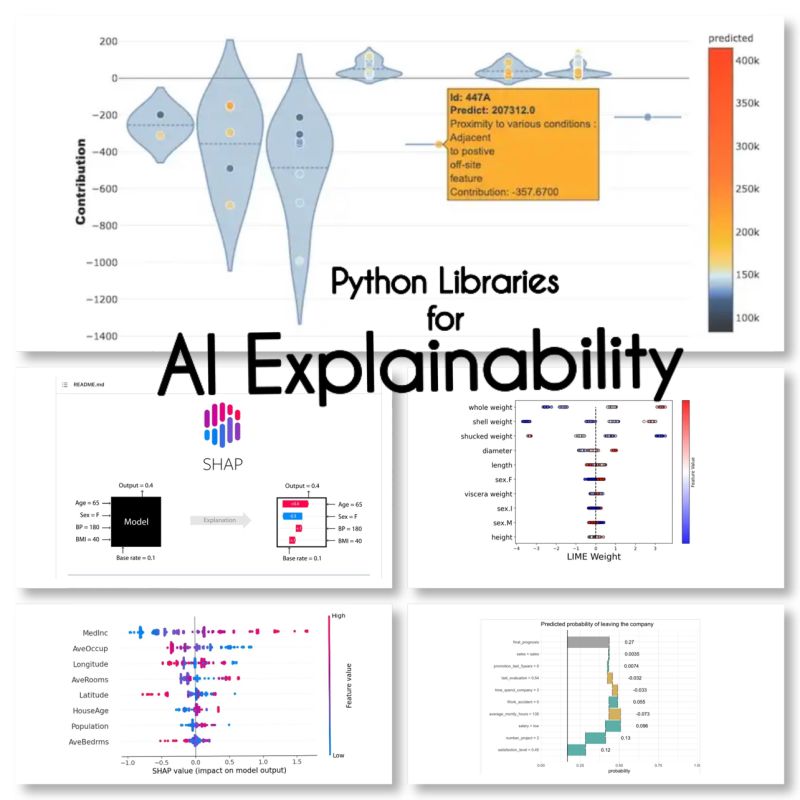

사후 모델 설명 가능성

여기에는 섭동(perturbation)과 같은 기술이 포함되며, 여기에서 모델의 출력에 대한 단일 변수 변경 효과가 교육 후의 SHAP 값과 같이 분석됩니다.

AI 설명 가능성을 위한 10개의 Python 라이브러리를 찾았습니다.

SHAP(SHapley 첨가제 설명)

SHAP는 모델에 구애받지 않으며 각 기능의 기여도를 분석하고 각 기능에 점수를 부여하는 방식으로 작동합니다.

LIME(로컬 해석 가능 모델 불가지론적 설명)

LIME은 특정 예측을 중심으로 로컬에서 모델의 동작을 근사화하여 작동하는 또 다른 모델 불가지론적 방법입니다.

ELi5

Eli5는 분류기를 디버깅하고 설명하기 위한 라이브러리입니다. 기능 중요도 점수와 scikit-learn, Keras, xgboost, LightGBM, CatBoost에 대한 "이유 코드"를 제공합니다.

샤파시

Shapash는 기계 학습을 모든 사람이 해석하고 이해할 수 있도록 만드는 것을 목표로 하는 Python 라이브러리입니다. Shapash는 명시적 레이블을 사용하여 여러 유형의 시각화를 제공합니다.

앵커

앵커는 기계 학습 모델의 예측을 설명하는 데 사용할 수 있는 사람이 해석할 수 있는 규칙을 생성하는 방법입니다.

XAI(설명할 수 있는 AI)

XAI는 특징 중요도 점수를 포함한 기계 학습 모델의 예측을 설명하고 시각화하기 위한 라이브러리입니다.

고장

BreakDown은 선형 모델의 예측을 설명하는 데 사용할 수 있는 도구입니다. 모델의 출력을 각 입력 기능의 기여로 분해하여 작동합니다.

해석 텍스트

interpret-text는 자연어 처리 모델의 예측을 설명하기 위한 라이브러리입니다.

iml(해석 가능한 기계 학습)

iml은 현재 Shap 프로젝트의 인터페이스와 IO 코드를 포함하고 있으며 잠재적으로 Lime 프로젝트에서도 동일한 작업을 수행할 것입니다.

aix360(AI 설명 가능성 360)

aix360에는 다양한 차원을 포괄하는 포괄적인 알고리즘 세트가 포함되어 있습니다.

옴니XAI

OmniXAI(Omni eXplainable AI의 줄임말)는 실제로 기계 학습 모델에서 생성된 판단을 해석하는 것과 관련된 몇 가지 문제를 해결합니다.

라이브러리를 잊어버렸나요?

지우면 좋을거같음 . SM

마리암 미라디 NLP 및 컴퓨터 비전을 전문으로 하는 기계 학습 및 딥 러닝 박사 학위를 보유한 AI 및 데이터 과학 책임자입니다. 그녀는 15개 이상의 성공적인 프로젝트를 제공한 실적과 함께 성공적인 AI 솔루션을 만드는 데 40년 이상의 경험을 가지고 있습니다. 그녀는 금융 범죄 탐지, 에너지, 은행, 소매, 전자 상거래 및 정부를 포함하여 다양한 산업 분야의 12개 조직에서 근무했습니다.

- SEO 기반 콘텐츠 및 PR 배포. 오늘 증폭하십시오.

- 플라토 블록체인. Web3 메타버스 인텔리전스. 지식 증폭. 여기에서 액세스하십시오.

- 출처: https://www.kdnuggets.com/2023/01/explainable-ai-10-python-libraries-demystifying-decisions.html?utm_source=rss&utm_medium=rss&utm_campaign=explainable-ai-10-python-libraries-for-demystifying-your-models-decisions

- 10

- a

- 구애

- 후

- AI

- 목표

- 알고리즘

- 수

- 및

- 다른

- 약

- 인조의

- 인공 지능

- 은행

- BEST

- 파괴

- 변화

- 선택

- 선명한

- 암호

- 포괄적 인

- 컴퓨터

- 컴퓨터 비전

- 이 포함되어 있습니다

- 기부

- 엄호

- 만들기

- 범죄

- 현재

- 데이터

- 데이터 과학

- 의사 결정

- 결정

- 깊은

- 깊은 학습

- 배달

- 다른

- 아래 (down)

- 전자 상거래

- 마다

- 효과

- 에너지

- 엔지니어링

- 사람

- 경험

- 설명

- 설명 가능성

- 설명 가능한 AI

- 설명

- 특색

- 금융

- 금융 범죄

- 잊어

- 발견

- 에

- 일반적으로

- 생성

- 좋은

- Government

- HTTPS

- 인간

- 중요성

- in

- 포함

- 포함

- 산업

- 입력

- 인텔리전스

- 인터페이스

- IT

- 판단

- 너 겟츠

- 케 라스

- 레이블

- 언어

- 리드

- 배우기

- 도서관

- 도서관

- 라임

- 링크드인

- 지방의

- 장소 상에서

- 기계

- 기계 학습

- 확인

- 방법

- 모델

- 모델

- 가장

- 자연의

- 자연어

- 자연 언어 처리

- nlp

- 옴니

- 조직

- 특별한

- 플라톤

- 플라톤 데이터 인텔리전스

- 플라토데이터

- 잠재적으로

- 연습

- 예측

- 예측

- 문제

- 문제

- 프로세스

- 처리

- 생산

- 프로젝트

- 프로젝트

- 제공

- Python

- 이유

- 기록

- 결과

- 소매

- 규칙

- 같은

- 과학

- 사이 킷 학습

- 세트

- 몇몇의

- 짧은

- 단일

- 솔루션

- 전문화 된

- 구체적인

- 시작

- 아직도

- 성공한

- 이러한

- 체계

- 기법

- XNUMXD덴탈의

- 에

- 수단

- 선로

- 트레이닝

- 유형

- 이해

- 이해할 수있는

- 사용

- 마케팅은:

- 종류

- 시력

- 심상

- 어느

- 의지

- 일

- 일

- XGBoost

- 년

- 너의

- 제퍼 넷