대규모 주의 기반 변환기 모델은 자연어 처리(NLP)에서 엄청난 이점을 얻었습니다. 그러나 이러한 거대한 네트워크를 처음부터 훈련하려면 엄청난 양의 데이터와 계산이 필요합니다. 더 작은 NLP 데이터 세트의 경우 간단하지만 효과적인 전략은 사전 훈련된 변환기를 사용하는 것입니다. 일반적으로 매우 큰 데이터 세트에서 감독되지 않은 방식으로 훈련되고 관심 데이터 세트에서 미세 조정됩니다. 포옹하는 얼굴 는 이러한 사전 훈련된 변압기의 대규모 모델 동물원을 유지 관리하고 초보자도 쉽게 액세스할 수 있도록 합니다.

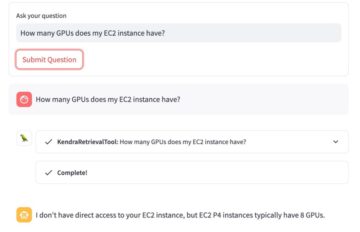

그러나 이러한 모델을 미세 조정하려면 학습률이나 배치 크기와 같은 하이퍼파라미터에 매우 민감하기 때문에 여전히 전문 지식이 필요합니다. 이 게시물에서는 오픈 소스 프레임워크로 이러한 하이퍼파라미터를 최적화하는 방법을 보여줍니다. 사인 튠 분산 하이퍼파라미터 최적화(HPO)용. Syne Tune을 사용하면 인기 있는 기본 하이퍼파라미터와 비교하여 1-4% 사이의 상대적 개선을 달성하는 더 나은 하이퍼파라미터 구성을 찾을 수 있습니다. GLUE 벤치마크 데이터 세트. 사전 훈련된 모델 자체의 선택도 하이퍼파라미터로 간주될 수 있으므로 Syne Tune에 의해 자동으로 선택됩니다. 텍스트 분류 문제에서 기본 모델에 비해 정확도가 약 5% 추가로 향상됩니다. 그러나 사용자가 내려야 하는 더 많은 결정을 자동화할 수 있습니다. 인스턴스 유형을 나중에 모델을 배포하는 데 사용하는 하이퍼파라미터로 노출하여 이를 보여줍니다. 올바른 인스턴스 유형을 선택하면 비용과 지연 시간을 최적으로 절충하는 구성을 찾을 수 있습니다.

Syne Tune에 대한 소개는 다음을 참조하십시오. Syne Tune으로 분산 하이퍼파라미터 및 신경 아키텍처 튜닝 작업 실행.

Syne Tune을 통한 초매개변수 최적화

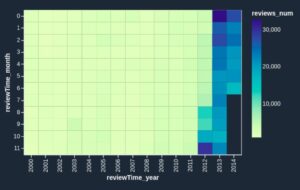

우리는을 사용합니다 GLUE 텍스트 함축 인식 또는 감정 분석과 같은 자연어 이해 작업을 위한 XNUMX개의 데이터세트로 구성된 벤치마크 제품군. 이를 위해 우리는 Hugging Face의 run_glue.py 훈련 스크립트. GLUE 데이터 세트에는 레이블이 있는 사전 정의된 훈련 및 평가 세트와 레이블이 없는 홀드아웃 테스트 세트가 함께 제공됩니다. 따라서 훈련 세트를 훈련 세트와 검증 세트(70%/30% 분할)로 분할하고 평가 세트를 홀드아웃 테스트 데이터 세트로 사용합니다. 또한 Hugging Face의 Trainer API에 다른 콜백 함수를 추가하여 각 에포크 후 유효성 검사 성능을 다시 Syne Tune에 보고합니다. 다음 코드를 참조하십시오.

학습 속도, 학습 속도를 높이기 위한 준비 비율, 사전 훈련된 BERT(버트 베이스 케이스) 모델은 포옹 얼굴 예제의 기본 모델입니다. 다음 코드를 참조하십시오.

HPO 방법으로 사용 ASHA, 무작위로 균일하게 초매개변수 구성을 샘플링하고 성능이 좋지 않은 구성에 대한 평가를 반복적으로 중지합니다. BO나 MoBster와 같은 더 정교한 방법이 목적 함수의 확률적 모델을 사용하지만 검색 공간에 대한 가정 없이 제공되기 때문에 이 게시물에서는 ASHA를 사용합니다.

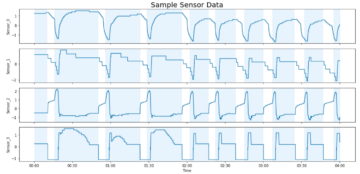

다음 그림에서는 Hugging Faces의 기본 하이퍼파라미터 구성에 대한 테스트 오류의 상대적 개선을 비교합니다.

간단하게 하기 위해 비교를 MRPC, COLA 및 STSB로 제한하지만 다른 GLUE 데이터 세트에서도 유사한 개선 사항을 관찰합니다. 각 데이터 세트에 대해 단일 ml.g4dn.xlarge에서 ASHA를 실행합니다. 아마존 세이지 메이커 런타임 예산이 1,800초인 인스턴스로, 이는 각각 이 데이터 세트에 대한 전체 기능 평가 약 13, 7 및 9에 해당합니다. 예를 들어 미니 배치 샘플링으로 인한 훈련 프로세스의 고유한 무작위성을 설명하기 위해 난수 생성기에 대한 독립적인 시드를 사용하여 1회 반복에 대해 ASHA와 기본 구성을 모두 실행하고 평균 및 표준 편차를 보고합니다. 반복에 걸쳐 상대적인 개선. 모든 데이터 세트에서 실제로 신중하게 선택한 기본 구성의 성능에 비해 예측 성능을 3-XNUMX% 향상시킬 수 있음을 알 수 있습니다.

사전 훈련된 모델 선택 자동화

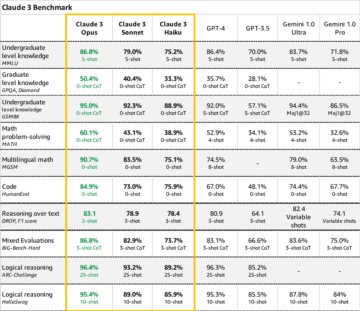

HPO를 사용하여 하이퍼파라미터를 찾을 뿐만 아니라 사전 훈련된 올바른 모델을 자동으로 선택할 수 있습니다. 우리가 이것을 하고 싶은 이유는 무엇입니까? 모든 데이터 세트에서 성능이 우수한 단일 모델은 없기 때문에 특정 데이터 세트에 적합한 모델을 선택해야 합니다. 이를 입증하기 위해 우리는 Hugging Face에서 인기 있는 다양한 변압기 모델을 평가합니다. 각 데이터 세트에 대해 테스트 성능에 따라 각 모델의 순위를 지정합니다. 데이터 세트(다음 그림 참조)의 순위는 모든 데이터 세트에서 가장 높은 점수를 받는 단일 모델이 아니라 변경됩니다. 참고로 다음 그림에는 각 모델 및 데이터 세트의 절대 테스트 성능도 나와 있습니다.

|

|

올바른 모델을 자동으로 선택하기 위해 모델 선택을 범주형 매개변수로 캐스팅하고 이를 하이퍼파라미터 검색 공간에 추가할 수 있습니다.

검색 공간이 이제 더 커졌지만 반드시 최적화하기가 더 어렵다는 의미는 아닙니다. 다음 그림은 원래 공간(파란색 선)에서 검색할 때 시간 경과에 따른 ASHA의 MRPC 데이터 세트에서 가장 잘 관찰된 구성(검증 오류 기반)의 테스트 오류를 보여줍니다(BERT 기반 케이스 사전 훈련된 모델 사용) ) 또는 새로운 증강 검색 공간(주황색 선). 동일한 예산이 주어지면 ASHA는 더 작은 공간보다 확장된 검색 공간에서 훨씬 더 나은 성능의 하이퍼파라미터 구성을 찾을 수 있습니다.

인스턴스 유형 선택 자동화

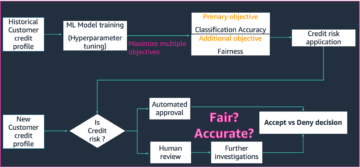

실제로 우리는 예측 성능 최적화에만 관심을 두지 않을 수 있습니다. 또한 교육 시간, (달러) 비용, 대기 시간 또는 공정성 지표와 같은 다른 목표에 대해서도 관심을 가질 수 있습니다. 또한 인스턴스 유형 선택과 같이 모델의 하이퍼파라미터 외에 다른 선택을 해야 합니다.

인스턴스 유형은 예측 성능에 영향을 미치지 않지만 (달러) 비용, 교육 런타임 및 지연 시간에 큰 영향을 미칩니다. 후자는 모델이 배포될 때 특히 중요합니다. HPO는 동시에 여러 목표를 최적화하는 것을 목표로 하는 다중 목표 최적화 문제로 표현할 수 있습니다. 그러나 단일 솔루션은 모든 메트릭을 동시에 최적화할 수 없습니다. 대신, 우리는 하나의 목표와 다른 목표를 최적으로 절충하는 구성 세트를 찾는 것을 목표로 합니다. 이것을 파레토 세트.

이 설정을 더 분석하기 위해 검색 공간에 추가 범주형 하이퍼파라미터로 인스턴스 유형 선택을 추가합니다.

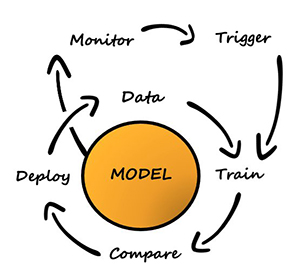

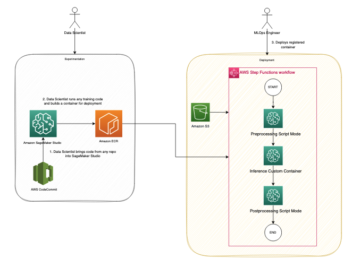

우리는 사용 모아샤, 비지배 정렬을 사용하여 다중 목표 시나리오에 ASHA를 적용합니다. 각 반복에서 MO-ASHA는 각 구성에 대해 평가하려는 인스턴스 유형도 선택합니다. 이기종 인스턴스 세트에서 HPO를 실행하기 위해 Syne Tune은 SageMaker 백엔드를 제공합니다. 이 백엔드에서 각 시도는 자체 인스턴스에서 독립적인 SageMaker 교육 작업으로 평가됩니다. 작업자 수는 주어진 시간에 병렬로 실행하는 SageMaker 작업의 수를 정의합니다. 옵티마이저 자체(이 경우 MO-ASHA)는 로컬 시스템, Sagemaker 노트북 또는 별도의 SageMaker 교육 작업에서 실행됩니다. 다음 코드를 참조하십시오.

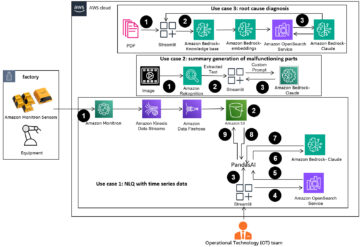

다음 그림은 10,800명의 작업자에서 XNUMX초 동안 실행한 후 MRPC 데이터 세트에서 MO-ASHA(가시성을 위해 축을 제한함)에서 샘플링한 임의 구성에 대한 왼쪽의 대기 시간 대 테스트 오류, 오른쪽의 대기 시간 대 비용을 보여줍니다. 색상은 인스턴스 유형을 나타냅니다. 검은색 점선은 파레토 세트를 나타내며, 이는 하나 이상의 목표에서 다른 모든 포인트를 지배하는 포인트 세트를 의미합니다.

|

|

지연 시간과 테스트 오류 사이의 균형을 관찰할 수 있습니다. 즉, 테스트 오류가 가장 낮은 최상의 구성이 가장 낮은 지연 시간을 달성하지 못한다는 의미입니다. 기본 설정에 따라 테스트 성능을 희생하지만 대기 시간이 더 짧은 하이퍼파라미터 구성을 선택할 수 있습니다. 또한 지연 시간과 비용 간의 균형을 봅니다. 예를 들어 더 작은 ml.g4dn.xlarge 인스턴스를 사용하면 지연 시간이 약간 증가하지만 ml.g4dn.8xlarge 인스턴스 비용의 XNUMX분의 XNUMX을 지불합니다.

결론

이 게시물에서 우리는 Syne Tune을 기반으로 하는 Hugging Face의 사전 훈련된 변압기 모델을 미세 조정하기 위한 하이퍼파라미터 최적화에 대해 논의했습니다. 학습률, 배치 크기 및 준비 비율과 같은 하이퍼파라미터를 최적화하여 신중하게 선택한 기본 구성을 개선할 수 있음을 확인했습니다. 하이퍼파라미터 최적화를 통해 사전 훈련된 모델을 자동으로 선택하여 이를 확장할 수도 있습니다.

Syne Tune의 SageMaker 백엔드의 도움으로 인스턴스 유형을 하이퍼파라미터로 처리할 수 있습니다. 인스턴스 유형은 성능에 영향을 미치지 않지만 지연 시간과 비용에는 상당한 영향을 미칩니다. 따라서 HPO를 다중 목표 최적화 문제로 캐스팅하여 한 목표와 다른 목표를 최적으로 절충하는 구성 집합을 찾을 수 있습니다. 이것을 직접 시도하고 싶다면 우리의 노트북 예.

저자에 관하여

마티아스 시거 AWS의 수석 응용 과학자입니다.

마티아스 시거 AWS의 수석 응용 과학자입니다.

데이비드 살리나스 AWS의 수석 응용 과학자입니다.

데이비드 살리나스 AWS의 수석 응용 과학자입니다.

에밀리 웹버 SageMaker가 출시된 직후 AWS에 합류했으며 그 이후로 전 세계에 알리기 위해 노력해 왔습니다! Emily는 고객을 위한 새로운 ML 경험을 구축하는 것 외에도 티베트 불교 명상과 공부를 즐깁니다.

에밀리 웹버 SageMaker가 출시된 직후 AWS에 합류했으며 그 이후로 전 세계에 알리기 위해 노력해 왔습니다! Emily는 고객을 위한 새로운 ML 경험을 구축하는 것 외에도 티베트 불교 명상과 공부를 즐깁니다.

세드릭 아르샹보 AWS의 수석 응용 과학자이자 학습 및 지능형 시스템을 위한 유럽 연구소의 펠로우입니다.

세드릭 아르샹보 AWS의 수석 응용 과학자이자 학습 및 지능형 시스템을 위한 유럽 연구소의 펠로우입니다.

- "

- 10

- 100

- 7

- 9

- a

- 소개

- 절대

- 얻기 쉬운

- 계정

- 달성

- 가로질러

- 추가

- 영향을

- All

- 수

- 이기는하지만

- 아마존

- 양

- 분석

- 분석하다

- 다른

- API를

- 적용된

- 대략

- 아키텍처

- 증강 된

- 자동화

- 자동적으로

- 평균

- AWS

- 축

- 때문에

- 기준

- BEST

- 더 나은

- 사이에

- 그 너머

- 검정

- 일시: XNUMX년 XNUMX월 XNUMX일 화요일 XNUMX:XNUMXpm - XNUMX:XNUMXpm 장소: 여의도 페어몬트 앰배서더 서울 호텔 XNUMXF 아잘레아스 룸 [약도] 행사 문의: info.korea@rescale.com

- 후원

- 예산

- 건물

- 한

- 케이스

- 발생

- 선택

- 선택

- 선택

- 수업

- 분류

- 암호

- 왔다

- 비교

- 계산

- 구성

- 제어

- 고객

- 데이터

- 결정

- 보여

- 배포

- 배포

- 분산

- 하지 않습니다

- 달러

- 마다

- 용이하게

- 유효한

- 유럽

- 평가

- 평가

- 예

- 체험

- 전문가

- 확장

- 페이스메이크업

- 패션

- 그림

- 수행원

- 뼈대

- 에

- 가득 찬

- 기능

- 추가

- 게다가

- 발전기

- 도움

- 여기에서 지금 확인해 보세요.

- 방법

- How To

- 그러나

- HTTPS

- 영향

- 중대한

- 개선

- 개량

- 증가

- 독립

- 영향

- 예

- 지능형

- 관심

- IT

- 그 자체

- 일

- 작업

- 합류 한

- 지식

- 실험실

- 레이블

- 언어

- 넓은

- 큰

- 시작

- 오퍼

- 배우기

- 제한

- 라인

- 지방의

- 기계

- 확인

- 제작

- 거대한

- 의미

- 방법

- 통계

- 수도

- ML

- 모델

- 모델

- 배우기

- 여러

- 자연의

- 필연적으로

- 요구

- 네트워크

- 수첩

- 번호

- 목표

- 획득

- 최적화

- 최적화

- 최적화

- 실물

- 기타

- 자신의

- 특별히

- 지불

- 성능

- 실행할 수 있는

- 부디

- 전철기

- 인기 문서

- 연습

- 교장

- 문제

- 방법

- 처리

- 제공

- 범위

- 순위

- 신고

- 신고자

- 보고서

- 대표

- 필요

- 결과

- 달리기

- 달리는

- 같은

- 과학자

- 검색

- 초

- 씨

- 선택된

- 감정

- 세트

- 설정

- 표시

- 상당한

- 비슷한

- 단순, 간단, 편리

- 단일

- 크기

- 해결책

- 정교한

- 스페이스 버튼

- 구체적인

- 분열

- 표준

- 스타트

- 주 정부

- 아직도

- 전략

- 시스템은

- 작업

- test

- XNUMXD덴탈의

- 세계

- 따라서

- 시간

- 교환

- 트레이닝

- 치료

- 거대한

- 시도

- 이해

- us

- 사용

- 사용자

- 보통

- 활용

- 확인

- 가시성

- 위키 백과

- 없이

- 근로자

- 세계

- 너의