"Let op mijn woorden, AI is veel gevaarlijker dan kernwapens. Het maakt me doodsbang.' Dat was de uitspraak van Tesla's CEO Elon Musk in 2018 tijdens een interview met Jonathan Nolan tijdens de South by Southwest Conference in Austin, Texas. Mus is helaas niet de enige. Ook onderzoekers en andere gerenommeerde experts waarschuwen voor de gevaren van kunstmatige intelligentie (AI). De vraag van 1 miljoen pond is of we voorbereid zijn en wat onze regeringen en beleidsplanners doen om dit gevaar af te wenden?

Hoewel de recente populariteit van ChatGPT AI mainstream heeft gemaakt en velen naar de maatschappelijke voordelen heeft gelokt, trekt het grote publiek niet de aandacht van de duistere kant van AI. Professionals en technici maken zich al jaren zorgen over het feit dat kunstmatige intelligentie (AI) hun banen wegneemt.

Deskundigen zijn echter van mening dat er andere, meer ernstige risico's en gevaren zijn waarover u zich zorgen moet maken, waaronder algoritmische vooringenomenheid veroorzaakt door slechte gegevens die door AI worden gebruikt, diepe vervalsingen, privacyschendingen en nog veel meer. Hoewel deze gevaren ernstige risico's voor de samenleving vormen, maken onderzoekers en wetenschappers zich meer zorgen over hoe AI kan worden geprogrammeerd om iets nog gevaarlijkers te doen: wapenautomatisering.

Tegenwoordig wordt AI nu gebruikt bij de ontwikkeling van zwermtechnologieën en rondhangende munitie, ook wel kamikaze-drones genoemd, zoals die gebruikt in de aanhoudende oorlog tussen Rusland en Oekraïne. In tegenstelling tot de futuristische robots die je in sommige sciencefictionfilms ziet, gebruiken deze drones eerder bestaande militaire platforms die gebruikmaken van nieuwe AI-technologieën. Deze drones zijn in wezen autonome wapens geworden die geprogrammeerd zijn om te doden.

Maar het gebruik van AI-aangedreven om te doden in milliaire gevechten is nog maar het begin. Michael Osborne is een AI-professor en onderzoeker op het gebied van machine learning aan de Universiteit van Oxford. Hij is ook de mede-oprichter van Mind Foundry. Terwijl iedereen in de ban is van de ChatGPT-rage, waarschuwt professor Osborne nu voor de risico's van AI en voorspelt hij dat geavanceerde AI "net zoveel risico voor ons kan vormen als voor andere soorten: de dodo is een voorbeeld."

Begin deze maand vertelde een groep onderzoekers van de Universiteit van Oxford aan de wetenschaps- en technologiecommissie in het Britse parlement dat AI uiteindelijk een "existentiële bedreiging" voor de mensheid zou kunnen vormen. Net zoals mensen werden weggevaagd door de dodo, kunnen de AI-machines ons elimineren, zeiden ze in de Times Of London gerapporteerd.

Tijdens de vergadering, Professor Osborne waarschuwde Britse parlementariërs dat echt krachtige kunstmatige intelligentie iedereen op aarde zou kunnen doden. "AI is een vergelijkbaar gevaar als kernwapens", zei hij. Professor Osborne voegde er ook aan toe dat het risico niet is dat de AI ongehoorzaam is aan zijn programmering, maar het rigide op onbedoelde manieren gehoorzaamt:

“Een superintelligente AI die wordt verteld om een einde te maken aan kanker, om een te simpel voorbeeld te geven, zou de gemakkelijkste methode vinden om mensen te verwijderen. Volgens een peiling denkt ongeveer een derde van de onderzoekers dat AI tot een wereldwijde catastrofe kan leiden. AI-veiligheidsprogramma's bestaan, maar bedrijven en landen zijn verwikkeld in een "wapenwedloop" die voorzichtige benaderingen bemoeilijkt."

Michael Cohen, de collega van professor Osbborne en een promovendus aan de Universiteit van Oxford, vertelde The Times of London:

“Met bovenmenselijke AI is er een bijzonder risico dat van een ander soort klasse is, namelijk . . . het kan iedereen doden.

Hoewel AI ons leven heeft verbeterd, vrezen wetenschappers dat we het risico lopen de mensheid voor het gemak op te offeren vanwege het gebrek aan menselijke moraliteit van AI. Een angstaanjagend scenario is volgens Cohen dat AI zou kunnen leren om een mens-helpende richtlijn te bereiken door gebruik te maken van mens-beschadigende tactieken.

"Als je je voorstelt een hond te trainen met lekkernijen: hij zal leren acties te kiezen die ertoe leiden dat hij lekkernijen krijgt, maar als de hond de snoepkast vindt, kan hij de lekkernijen zelf krijgen zonder te doen wat we wilden dat hij deed," legde hij uit. . "Als je iets hebt dat veel slimmer is dan wij, monomanisch probeert om deze positieve feedback te krijgen, en het wordt de wereld overgenomen om dat veilig te stellen, dan zou het zoveel mogelijk energie steken in het veiligstellen van zijn greep daarop, en dat zou ons zonder enige energie voor onszelf.”

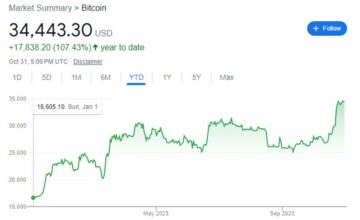

Professor Osborne en Michael Cohen zijn niet de enige twee onderzoekers die aan de alarmbel trekken over de risico's en gevaren van AI. Veel andere wetenschappers die met AI werken, hebben soortgelijke zorgen geuit. Uit een onderzoek in september 2022 onder 327 onderzoekers van de New York University bleek dat een derde gelooft dat AI binnen een eeuw een apocalyps in nucleaire stijl kan veroorzaken, aldus de Times Of London.

Soortgelijke zorgen lijken te worden gedeeld door veel wetenschappers die met AI werken. Uit een onderzoek uit september 2022 onder 327 onderzoekers van de New York University bleek dat een derde gelooft dat AI binnen een eeuw een ramp kan veroorzaken die lijkt op een nucleaire apocalyps, meldde de Times Of London.

"Het is aannemelijk dat beslissingen van AI of machine learning-systemen deze eeuw een catastrofe kunnen veroorzaken die minstens zo erg is als een totale nucleaire oorlog", aldus 36% van de onderzoekers.

Of het nu over een eeuw is, AI wordt in toenemende mate te slim en zoals sommige experts hebben gesuggereerd, is het absoluut noodzakelijk dat we menselijke controle behouden en mechanismen ontwikkelen zoals een AI-kill-schakelaar om te bepalen wat AI wel en niet kan. Het huidige gebrek aan overzicht en het ontbreken van een duidelijk wereldwijd AI-beleid is een wake-up call voor regeringen over de hele wereld. We moeten nu actie ondernemen voordat het te laat is.

[Ingesloten inhoud]

Hieronder nog een video over het gevaar van AI. In de video waarschuwt Stuart Russell, een Britse computerwetenschapper die bekend staat om zijn bijdragen aan kunstmatige intelligentie, voor de risico's van het maken van AI-systemen.

[Ingesloten inhoud]

- Door SEO aangedreven content en PR-distributie. Word vandaag nog versterkt.

- Platoblockchain. Web3 Metaverse Intelligentie. Kennis versterkt. Toegang hier.

- Bron: https://techstartups.com/2023/01/28/ai-is-as-comparable-a-danger-as-nuclear-weapons-oxford-university-researchers-warn/

- 2018

- 2022

- 7

- a

- AI

- Over

- AC

- Volgens

- Bereiken

- Actie

- acties

- toegevoegd

- vergevorderd

- AI

- AI-systemen

- AI-powered

- alarm

- algoritmische

- algoritmische vertekening

- alleen

- en

- Nog een

- verschijnen

- benaderingen

- rond

- kunstmatig

- kunstmatige intelligentie

- Kunstmatige intelligentie (AI)

- aandacht

- austin

- autonoom

- slecht

- slechte gegevens

- worden

- worden

- vaardigheden

- Begin

- wezen

- geloofd wie en wat je bent

- Fietsbel

- betekent

- vooringenomenheid

- brengen

- Brits

- bracht

- ondernemingen

- Bellen

- Dit betekent dat we onszelf en onze geliefden praktisch vergiftigen.

- oproepen

- Kan krijgen

- Kanker

- kan niet

- Veroorzaken

- veroorzaakt

- voorzichtig

- Eeuw

- ceo

- ChatGPT

- klasse

- duidelijk

- Mede-oprichter

- collega

- tegen te gaan

- commissie

- vergelijkbaar

- computer

- betrokken

- Zorgen

- Conferentie

- content

- bijdragen

- onder controle te houden

- gemak

- kon

- landen

- het aanmaken

- Actueel

- GEVAAR

- gevaarlijk

- gevaren

- Donker

- gegevens

- beslissingen

- deep

- Deep Fakes

- ontwikkelen

- het ontwikkelen van

- Ontwikkeling

- anders

- moeilijk

- directe

- ramp

- DODO

- Hond

- doen

- Drones

- gedurende

- aarde

- gemakkelijkste

- elimineren

- Elon

- Elon Musk

- ingebed

- energie-niveau

- bezig

- essentie

- Ether (ETH)

- Zelfs

- uiteindelijk

- iedereen

- voorbeeld

- bestaand

- deskundigen

- experts geloven

- uitgelegd

- uitgedrukt

- angst

- feedback

- VIND DE PLEK DIE PERFECT VOOR JOU IS

- vondsten

- gevonden

- Gieterij

- oppompen van

- futuristische

- met het verkrijgen van

- Algemeen

- grote publiek

- krijgen

- het krijgen van

- Geven

- Globaal

- overheden

- Groep

- houden

- Hoe

- HTTPS

- menselijk

- Mensheid

- Mensen

- gebiedende wijs

- verbeterd

- in

- Inclusief

- in toenemende mate

- KRANKZINNIG

- Intelligentie

- Interview

- betrokken zijn

- IT

- zelf

- Vacatures

- Doden

- bekend

- Gebrek

- Laat

- leiden

- LEARN

- leren

- Verlof

- Hefboomwerking

- Lives

- London

- machine

- machine learning

- Machines

- gemaakt

- Hoofdstroom

- maken

- veel

- vergadering

- methode

- Michael

- macht

- Leger

- denken

- Maand

- zedelijkheid

- meer

- Films

- Muskus

- Noodzaak

- New

- New York

- New York University

- nucleair

- Kernwapens

- EEN

- lopend

- Overige

- Toezicht

- Oxford

- Oxford universiteit

- parlement

- bijzonder

- kiezen

- platforms

- Plato

- Plato gegevensintelligentie

- PlatoData

- beleidsmaatregelen

- populariteit

- positief

- krachtige

- bereid

- die eerder

- privacy

- professionals

- Hoogleraar

- geprogrammeerde

- Programming

- Programma's

- publiek

- vraag

- recent

- het verwijderen van

- Vermaard

- gemeld

- onderzoeker

- onderzoekers

- Risico

- risico's

- robots

- concessies te doen

- Veiligheid

- Zei

- sake

- sci-fi

- Wetenschap

- Wetenschap en Technologie

- Wetenschapper

- wetenschappers

- beveiligen

- beveiligen

- September

- ernstig

- gedeeld

- gelijk

- slim

- slimmer

- maatschappelijk

- Maatschappij

- sommige

- iets

- Zuiden

- Statement

- Student

- dergelijk

- bovenmenselijk

- Enquête

- Stap over voor slechts

- Systems

- tactiek

- Nemen

- het nemen

- tech

- Technologies

- Technologie

- Texas

- De

- de wereld

- hun

- Derde

- keer

- naar

- ook

- Trainingen

- behandelen

- behandelt

- universiteit-

- us

- .

- Video

- Overtredingen

- gezocht

- oorlog

- waarschuwing

- Warns

- manieren

- Wapens

- Wat

- welke

- en

- WIE

- wil

- binnen

- zonder

- woorden

- Mijn werk

- werknemers

- wereld

- bezorgd

- zou

- jaar

- youtube

- zephyrnet