TOKYO, 21 februari 2022 – (JCN Newswire) – Fujitsu heeft vandaag de ontwikkeling aangekondigd van een resource-toolkit die ontwikkelaars richtlijnen biedt voor het evalueren van de ethische impact en risico's van AI-systemen op basis van internationale AI-ethiekrichtlijnen. Fujitsu biedt deze middelen vanaf 21 februari 2022 gratis aan om de veilige inzet van AI-systemen in de samenleving te bevorderen.

|

De toolkit bestaat uit een verscheidenheid aan casestudy's en referentiemateriaal, waaronder een nieuw ontwikkelde methode voor het verduidelijken van ethische vereisten in ethische richtlijnen voor AI die in natuurlijke taal zijn geschreven, en voor het toepassen van ethische vereisten op daadwerkelijke AI-systemen. De bronnen in het Japans kunnen hier worden gedownload, beschikbaarheid in het Engels volgt in de nabije toekomst.

Met deze leidraad wil Fujitsu misverstanden en potentiële risico's voorkomen die worden veroorzaakt door verschillen in de interpretatie van beschrijvingen in richtlijnen, en AI-systeemontwikkelaars en -operators nieuwe tools bieden voor het grondig identificeren en voorkomen van mogelijke ethische problemen vroeg in het ontwikkelingsproces in overeenstemming met internationale best practices .

Dr. Christoph Lutge van de Technische Universiteit van München, een toonaangevende autoriteit op het gebied van onderzoek naar verantwoorde AI en bedrijfsethiek, merkt op: "In Europa is er een groeiend debat over AI-regelgeving en een van de belangrijkste kwesties is hoe de kloof tussen principes en praktijken, of "wat" en "hoe". Ik geloof dat de resultaten van dit onderzoek erg belangrijk zijn omdat ze ons in staat stellen om te oefenen op basis van principes. Ik wil ook mijn diepe waardering uitspreken voor de beslissing om de onderzoeksresultaten openstellen en wereldwijd de discussie stimuleren."

Fujitsu zal in de toekomst actief samenwerken met overheidsinstanties, particuliere bedrijven en vooraanstaande onderzoekers om de nieuw ontwikkelde methodologie verder te verfijnen en te promoten en streeft ernaar in het fiscale jaar 2022 een uitgebreide versie van de resource-toolkit uit te brengen.

Achtergrond

In april 2021 heeft de Europese Commissie een ontwerp uitgebracht voor een regelgevend kader waarin wordt opgeroepen tot een alomvattend ethisch antwoord voor ontwikkelaars, gebruikers en belanghebbenden van AI-systemen als reactie op de toenemende bezorgdheid over algoritmische vooringenomenheid en discriminerende besluitvorming in AI- en machine learning-toepassingen.

Om zich volledig in te zetten voor verantwoord gebruik van technologie en het vertrouwen van de samenleving te winnen in AI-systemen en de bedrijven en organisaties die hierbij betrokken zijn, heeft Fujitsu in 2019 zijn eigen AI-verbintenis geformuleerd, evenals een nieuw AI Ethics and Governance Office om te ontwikkelen en te handhaven robuust beleid voor AI-ethiek, bevordering van ethisch bestuur op het gebied van AI in de organisatie om de effectiviteit ervan te waarborgen. Nu gaat Fujitsu van principe naar praktijk door gestaag best practices in de echte wereld te implementeren om de realisatie van ethische, veilige en transparante AI- en machine learning-technologieën te garanderen.

Op dit moment is het gebruikelijk bij de ontwikkeling van AI-systemen om mogelijke ethische risico's in AI-systemen te identificeren op basis van ethische richtlijnen voor AI die zijn uitgegeven door overheden en bedrijven. Deze richtlijnen zijn echter in natuurlijke taal geschreven en dragen bij aan mogelijke interpretatieverschillen en misverstanden tussen ontwerpers en ontwikkelaars die kunnen leiden tot ongepaste of onvoldoende maatregelen. Bij deze methode is het ook moeilijk te beoordelen of de inhoud van de richtlijnen grondig en adequaat is herzien.

Er blijven echter veel uitdagingen over en een mogelijke verkeerde interpretatie van richtlijnen in de ontwerpfase van nieuwe technologieën kan mogelijk leiden tot onvoldoende of ongepaste maatregelen om risico's tegen te gaan.

Nieuwe evaluatiemethode en middelen om richtlijnen en ethische risico's te verduidelijken

Bij het voorbereiden van deze nieuwe toolkit en begeleiding voor ontwikkelaars heeft Fujitsu analyses uitgevoerd van eerdere AI-gerelateerde incidenten die zijn verzameld in de AI Incident Database van het internationale consortium Partnership on AI (1). Dit proces leidde tot de conclusie dat ethische kwesties met betrekking tot AI-systemen kunnen worden gecontextualiseerd met de uitwisseling van informatie ("interacties") tussen discrete elementen binnen een AI-systeem en tussen een AI-systeem en zijn gebruikers en andere belanghebbenden.

Op basis van deze bevindingen heeft Fujitsu met succes een evaluatiemethode ontwikkeld om systematisch relevante ethische kwesties met betrekking tot AI-systemen te identificeren, waardoor ethische modellen voor AI kunnen worden gecreëerd (2) die de interpretatie van ethische richtlijnen voor AI kunnen verduidelijken.

Fujitsu paste zijn nieuwe evaluatiemethode toe op 15 representatieve gevallen uit het AI-incident

Database (164 wereldwijde gevallen geregistreerd op 21 februari 2022, voorbeelden omvatten gevallen uit gebieden zoals de financiële en human resources-sector). Door de nieuwe methode toe te passen, werden alle ethische problemen die zich voordeden in praktijksituaties vooraf met succes geïdentificeerd als risico's tijdens verificatieproeven, waarvan de resultaten zijn gepubliceerd.

Fujitsu biedt de volgende resource-toolkit aan, bestaande uit een verscheidenheid aan bronnen en richtlijnen voor ontwikkelaars om naar te verwijzen in hun eigen werk:

Downloadsite (in het Japans, Engels beschikbaar op toekomstige datum)

1. Whitepaper: een algemeen overzicht van de methodologie

2. Handleiding AI ethische effectbeoordelingsprocedure: AI-systeemdiagram, voorbereidingsprocedure van AI-ethisch model en uitleg van probleemcorrespondentiemethode

3. AI-ethisch model: een AI-ethisch model gebaseerd op AI-ethische richtlijnen gepubliceerd door de Europese Commissie (gemaakt door Fujitsu)

4. Casestudy's van AI-ethiekanalyse: resultaten van analyse van belangrijke AI-ethiekkwesties uit de AI Incident Database of Partnership on AI (vanaf 21 februari waren er zes gevallen, die achtereenvolgens werden toegevoegd.)

Use Case: risico bij gebruik van AI voor de evaluatie van individuen voor bankleningen, werving

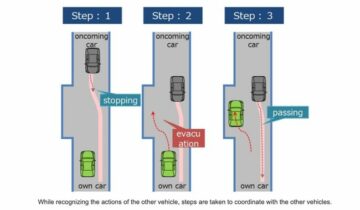

Figuur 1 toont een voorbeeld van een evaluatieproces van een persoon die typisch is voor gebruiksscenario's zoals personeelswerving of de goedkeuring van bankleningen. De correspondentietabel in het AI-ethiekmodel identificeerde de "validiteit van het evaluatieproces" (of de evaluatie op verantwoorde wijze wordt uitgevoerd met verwijzing naar de outputresultaten van het AI-systeem) als een check-item voor de interactie (relatie) tussen de gebruiker van de AI-systeem en de te evalueren doelgroep, terwijl "overmatige afhankelijkheid van AI-resultaten", "selectieve interpretatie en evaluatie van outputresultaten" en "onwetendheid van outputresultaten" als mogelijke risico's worden genoemd.

Binnen dit voorbeeld kunnen AI-systeemontwikkelaars het risico van een "overmatige afhankelijkheid van gebruikers van output van een AI-systeem die vooringenomenheid kan bevatten en kan leiden tot oneerlijke beslissingen" identificeren als een mogelijk risico in een AI-systeem en het systeem op de juiste manier aanpassen om dit risico te voorkomen .

(1) Partnerschap op AI:

Een in 2016 opgerichte non-profitorganisatie die de ethische uitdagingen van AI aanpakt, voor een toekomst waarin AI en mensen samenwerken.

(2) Ethische modellen voor AI:

Ethische modellen van AI bevatten een correspondentietabel met "check-items" en "interacties", een hulpmiddel voor stapsgewijze evaluatie van ethische vereisten voor AI-systemen. AI-ethische modellen worden handmatig gemaakt op basis van een specifieke richtlijn, maar eenmaal gegenereerd kan een model generiek worden gebruikt om verschillende AI-systemen te evalueren. Met behulp van deze methode kunnen ontwikkelaars en operators van AI-systemen automatisch alle relevante controle-items ophalen uit een eerder gemaakt AI-ethisch model voor een systematische en uitgebreide evaluatie van gerelateerde mogelijke risico's op basis van het type interacties binnen een AI-systeem.

Over Fujitsu

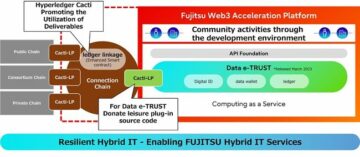

Fujitsu is het toonaangevende Japanse bedrijf op het gebied van informatie- en communicatietechnologie (ICT) dat een volledig assortiment technologische producten, oplossingen en diensten aanbiedt. Ongeveer 126,000 Fujitsu-medewerkers ondersteunen klanten in meer dan 100 landen. We gebruiken onze ervaring en de kracht van ICT om samen met onze klanten de toekomst van de samenleving vorm te geven. Fujitsu Limited (TSE: 6702) rapporteerde een geconsolideerde omzet van 3.6 biljoen yen (US $ 34 miljard) voor het fiscale jaar dat eindigde op 31 maart 2021. Zie voor meer informatie www.fujitsu.com.

Copyright 2022 JCN Newswire. Alle rechten voorbehouden. www.jcnnewswire.com Fujitsu heeft vandaag de ontwikkeling aangekondigd van een toolkit met hulpmiddelen die ontwikkelaars richtlijnen biedt voor het evalueren van de ethische impact en risico's van AI-systemen op basis van internationale AI-ethische richtlijnen.

- 000

- 100

- 2016

- 2019

- 2021

- 2022

- Over

- adres

- AI

- algoritmische

- Alles

- Het toestaan

- analyse

- aangekondigd

- toepassingen

- Het toepassen van

- April

- autoriteit

- beschikbaarheid

- Beschikbaar

- Bank

- BEST

- 'best practices'

- Miljard

- bedrijfsdeskundigen

- gevallen

- veroorzaakt

- uitdagingen

- lading

- opmerkingen

- commissie

- verplichting

- Gemeen

- Communicatie

- Bedrijven

- afstand

- inhoud

- auteursrecht

- landen

- Klanten

- Database

- debat

- inzet

- Design

- ontwikkelen

- ontwikkelde

- ontwikkelaars

- Ontwikkeling

- Vroeg

- Engels

- gevestigd

- ethiek

- Europa

- Nederlands

- Europese Commissie

- voorbeeld

- uitwisseling

- ervaring

- financieel

- volgen

- volgend

- Naar voren

- Achtergrond

- Gratis

- vol

- toekomst

- kloof

- Algemeen

- Globaal

- bestuur

- Overheid

- Groeiend

- richtlijnen

- hulp

- hier

- Hoe

- How To

- HTTPS

- Personeelszaken

- Mensen

- identificeren

- Impact

- inclusief

- Inclusief

- individueel

- informatie

- wisselwerking

- Internationale

- betrokken zijn

- problemen

- IT

- houden

- sleutel

- taal

- leiden

- leidend

- leren

- LED

- Beperkt

- opgesomd

- Leningen

- logo

- machine learning

- groot

- handboek

- Maart

- materieel

- model

- modellen

- beweging

- Nabij

- non-profit

- bieden

- het aanbieden van

- open

- organisatie

- organisaties

- Overige

- partner

- Samenwerking

- Mensen

- Personeel

- fase

- beleidsmaatregelen door te lezen.

- mogelijk

- energie

- presenteren

- het voorkomen van

- privaat

- probleem

- Producten

- promoten

- reeks

- echte wereld

- werving

- geregistreerd

- reglement

- regelgevers

- verwantschap

- Voorwaarden

- onderzoek

- hulpbron

- Resources

- antwoord

- verantwoordelijk

- Resultaten

- Risico

- veilig

- sector

- beveiligen

- Diensten

- aanzienlijke

- ZES

- Maatschappij

- Oplossingen

- Tussenruimte

- studies

- Met goed gevolg

- ondersteuning

- system

- Systems

- doelwit

- Technisch

- Technologies

- Technologie

- vandaag

- samen

- tools

- transparant

- Trust

- universiteit-

- us

- gebruikers

- Verificatie

- of

- whitepaper

- binnen

- Mijn werk

- wereld

- wereldwijd

- jaar

- Yen