Bilde av forfatter

I det siste har vi alle hatt det veldig vanskelig å få med oss de siste utgivelsene i LLM-området. I løpet av de siste ukene har flere åpen kildekode ChatGPT-alternativer blitt populære.

Og i denne artikkelen vil vi lære om ChatGLM serier og ChatGLM-6B, et åpen kildekode og lett ChatGPT-alternativ.

La oss komme igang!

Forskere ved Tsinghua University i Kina har jobbet med å utvikle ChatGLM-serien med modeller som har sammenlignbar ytelse med andre modeller som GPT-3 og BLOOM.

ChatGLM er en tospråklig storspråklig modell trent på både kinesisk og engelsk. For øyeblikket er følgende modeller tilgjengelige:

- ChatGLM-130B: en åpen kildekode LLM

- ChatGLM-100B: ikke åpen kildekode, men tilgjengelig via kun invitasjonstilgang

- ChatGLM-6B: et lett alternativ med åpen kildekode

Selv om disse modellene kan virke lik den Generative Pretrained Transformer (GPT)-gruppen av store språkmodeller, Generell språkmodell (GLM) foropplæringsrammeverk er det som gjør dem forskjellige. Vi lærer mer om dette i neste avsnitt.

I maskinlæring kjenner du GLM-er som generaliserte lineære modeller, men GLM i ChatGLM står for Generell språkmodell.

GLM Pretraining Framework

LLM-foropplæring har blitt grundig studert og er fortsatt et område for aktiv forskning. La oss prøve å forstå de viktigste forskjellene mellom GLM-fortrening og GPT-modeller.

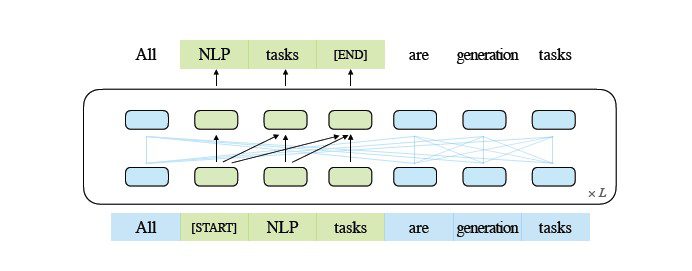

GPT-3-familien av modeller bruker autoregressiv språkmodellering kun med dekoder. I GLM, derimot, er optimalisering av målsetningen formulert som en automatisk regressiv tomfyllingsproblem.

GLM | Image Source

For å si det enkelt, automatisk regressiv tomfylling innebærer å blanke ut et kontinuerlig spenn med tekst, og deretter sekvensielt rekonstruere teksten denne blankingen. I tillegg til kortere masker, er det en lengre maske som tilfeldig fjerner lange tomme tekster fra slutten av setninger. Dette er gjort for at modellen skal yte rimelig godt i naturlig språkforståelse samt generasjonsoppgaver.

En annen forskjell er i typen oppmerksomhet som brukes. GPT-gruppen av store språkmodeller bruker ensrettet oppmerksomhet, mens GLM-gruppen av LLM-er bruker toveis oppmerksomhet. Bruk av toveis oppmerksomhet over demaskerte kontekster kan fange avhengigheter bedre og kan forbedre ytelsen på oppgaver med naturlig språkforståelse.

GELU-aktivering

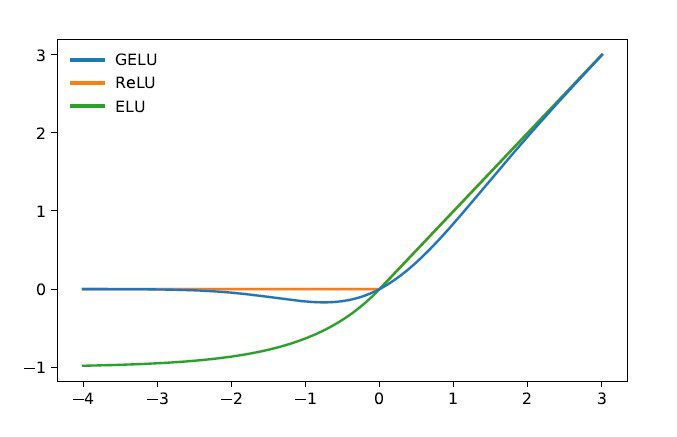

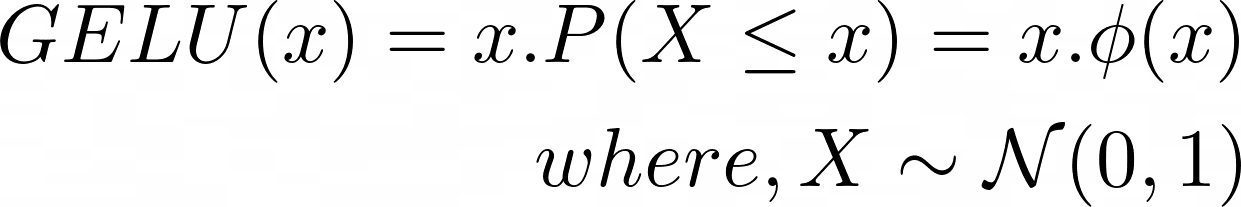

I GLM brukes GELU-aktivering (Gaussian Error Linear Units) i stedet for ReLU-aktivering [1].

GELU-, ReLU- og ELU-aktiveringer | Image Source

GELU-aktiveringen og har ikke-nullverdier for alle innganger og har følgende form [3]:

GELU-aktiveringen viser seg å forbedre ytelsen sammenlignet med ReLU-aktiveringer, men beregningsmessig mer intensiv enn ReLU.

I GLM-serien av LLM-er, ChatGLM-130B som er åpen kildekode og yter like bra som GPT-3s Da-Vinci-modell. Som nevnt, når du skriver denne artikkelen, er det en ChatGLM-100B-versjon, som er begrenset til kun for invitasjoner.

ChatGLM-6B

Følgende detaljer om ChatGLM-6B for å gjøre den mer tilgjengelig for sluttbrukere:

- Har omtrent 6.2 milliarder parametere.

- Modellen er forhåndstrent på 1 billion tokens – like fra engelsk og kinesisk.

- Deretter brukes teknikker som overvåket finjustering og forsterkningslæring med menneskelig tilbakemelding.

La oss avslutte diskusjonen vår ved å gå gjennom ChatGLMs fordeler og begrensninger:

Fordeler

Fra å være en tospråklig modell til en åpen kildekode-modell som du kan kjøre lokalt, har ChatGLM-6B følgende fordeler:

- De fleste vanlige store språkmodeller er trent på store korpus av engelsk tekst, og store språkmodeller for andre språk er ikke like vanlige. ChatGLM-serien med LLM-er er tospråklige og et godt valg for kinesisk. Modellen har god ytelse på både engelsk og kinesisk.

- ChatGLM-6B er optimalisert for brukerenheter. Sluttbrukere har ofte begrensede dataressurser på enhetene sine, så det blir nesten umulig å kjøre LLM-er lokalt – uten tilgang til høyytelses GPU-er. Med INT4 kvantisering, ChatGLM-6B kan kjøres med et beskjedent minnebehov på så lavt som 6GB.

- Yter godt på en rekke oppgaver, inkludert oppsummering og enkelt- og flerspørringschatter.

- Til tross for det vesentlig mindre antallet parametere sammenlignet med andre vanlige LLM-er, støtter ChatGLM-6B kontekstlengde på opptil 2048.

Begrensninger

La oss deretter liste noen begrensninger for ChatGLM-6B:

- Selv om ChatGLM er en tospråklig modell, er ytelsen på engelsk sannsynligvis suboptimal. Dette kan tilskrives at instruksjonene som brukes i trening for det meste er på kinesisk.

- Fordi ChatGLM-6B har vesentlig færre parametere sammenlignet med andre LLM-er som BLOOM, GPT-3 og ChatGLM-130B, kan ytelsen bli dårligere når konteksten er for lang. Som et resultat kan ChatGLM-6B gi unøyaktig informasjon oftere enn modeller med et større antall parametere.

- Små språkmodeller har begrenset minnekapasitet. Derfor, i multi-sving-chatter, kan ytelsen til modellen forringes noe.

- Bias, feilinformasjon og toksisitet er begrensninger for alle LLM-er, og ChatGLM er også utsatt for disse.

Som et neste trinn, kjør ChatGLM-6B lokalt eller prøv demoen på HuggingFace-rom. Hvis du ønsker å fordype deg dypere i arbeidet med LLM-er, her er en liste over gratis kurs om store språkmodeller.

[1] Z Du, Y Qian et al., GLM: General Language Model Pretraining med Autoregressive Blank Infilling, ACL 2022

[2] A Zheng, X Liu et al., GLM-130B – En åpen tospråklig forhåndstrent modell, ICML 2023

[3] D Hendriks, K Gimpel, Gaussiske feil lineære enheter (GELUs), arXiv, 2016

[4] ChatGLM-6B: Demo på HuggingFace Spaces

[5] GitHub Repo

Bala Priya C er en teknisk skribent som liker å lage innhold i lang form. Hennes interesseområder inkluderer matematikk, programmering og datavitenskap. Hun deler læringen sin med utviklerfellesskapet ved å skrive veiledninger, veiledninger og mer.

- SEO-drevet innhold og PR-distribusjon. Bli forsterket i dag.

- PlatoAiStream. Web3 Data Intelligence. Kunnskap forsterket. Tilgang her.

- Minting the Future med Adryenn Ashley. Tilgang her.

- kilde: https://www.kdnuggets.com/2023/04/chatglm6b-lightweight-opensource-chatgpt-alternative.html?utm_source=rss&utm_medium=rss&utm_campaign=chatglm-6b-a-lightweight-open-source-chatgpt-alternative

- : har

- :er

- :ikke

- $OPP

- 1

- a

- Om oss

- adgang

- tilgjengelig

- Aktivering

- aktiveringer

- aktiv

- tillegg

- fordeler

- AL

- Alle

- alternativ

- alternativer

- an

- og

- ER

- AREA

- områder

- Artikkel

- AS

- At

- oppmerksomhet

- forfatter

- auto

- tilgjengelig

- BE

- bli

- blir

- vært

- være

- Bedre

- mellom

- Milliarder

- Bloom

- både

- men

- by

- CAN

- fangst

- ChatGPT

- Kina

- Kinesisk

- valg

- Felles

- samfunnet

- sammenlign

- sammenlignet

- databehandling

- innhold

- kontekst

- sammenhenger

- kontinuerlig

- kurs

- Opprette

- I dag

- dato

- datavitenskap

- dypere

- Demo

- detaljer

- Utvikler

- utvikle

- Enheter

- forskjell

- forskjeller

- forskjellig

- diskusjon

- gjort

- E&T

- slutt

- Engelsk

- feil

- familie

- tilbakemelding

- Noen få

- færre

- etter

- Til

- skjema

- funnet

- fra

- general

- generasjonen

- generative

- få

- Gi

- skal

- god

- GPU

- flott

- Gruppe

- Guider

- hånd

- Hard

- Ha

- å ha

- her

- her.

- høy ytelse

- HTML

- HTTPS

- Klem ansikt

- menneskelig

- if

- umulig

- forbedre

- in

- unøyaktig

- inkludere

- Inkludert

- informasjon

- i stedet

- instruksjoner

- interesse

- inn

- innebærer

- IT

- DET ER

- jpg

- KDnuggets

- nøkkel

- Vet

- Språk

- språk

- stor

- større

- Siste

- siste

- LÆRE

- læring

- Lengde

- lettvekt

- i likhet med

- Sannsynlig

- begrensninger

- Begrenset

- Liste

- lokalt

- Lang

- lenger

- Lav

- maskin

- maskinlæring

- Mainstream

- gjøre

- GJØR AT

- maske

- masker

- math

- Kan..

- Minne

- nevnt

- feil~~POS=TRUNC

- modell

- modellering

- modeller

- mer

- Naturlig

- Naturlig språk

- Naturlig språkforståelse

- neste

- Antall

- Nvidia

- Målet

- of

- ofte

- on

- åpen

- åpen kildekode

- optimalisering

- optimalisert

- or

- Annen

- vår

- ut

- enn

- parametere

- ytelse

- utfører

- plato

- Platon Data Intelligence

- PlatonData

- Populær

- pre

- Programmering

- forsterkning læring

- Utgivelser

- behov

- forskning

- Ressurser

- begrenset

- resultere

- Kjør

- s

- Vitenskap

- Seksjon

- Serien

- flere

- Aksjer

- hun

- lignende

- Enkelt

- enkelt

- mindre

- So

- Rom

- mellomrom

- span

- står

- Trinn

- Still

- studert

- slik

- Super

- Støtter

- utsatt

- oppgaver

- Teknisk

- teknikker

- vilkår

- enn

- Det

- De

- deres

- Dem

- deretter

- Der.

- derfor

- Disse

- denne

- Gjennom

- tid

- til

- også

- trent

- Kurs

- Trillion

- Tsinghua

- tutorials

- typen

- forstå

- forståelse

- lomper

- universitet

- bruke

- brukt

- Bruker

- Brukere

- ved hjelp av

- Verdier

- variasjon

- versjon

- uker

- VI VIL

- Hva

- når

- hvilken

- HVEM

- med

- arbeidet

- arbeid

- verre

- vikle

- forfatter

- skriving

- X

- du

- zephyrnet