Kommentar Mer enn 250 masseskyting har skjedd i USA så langt i år, og AI-forkjempere tror de har løsningen. Ikke våpenkontroll, men bedre teknologi, ikke overraskende.

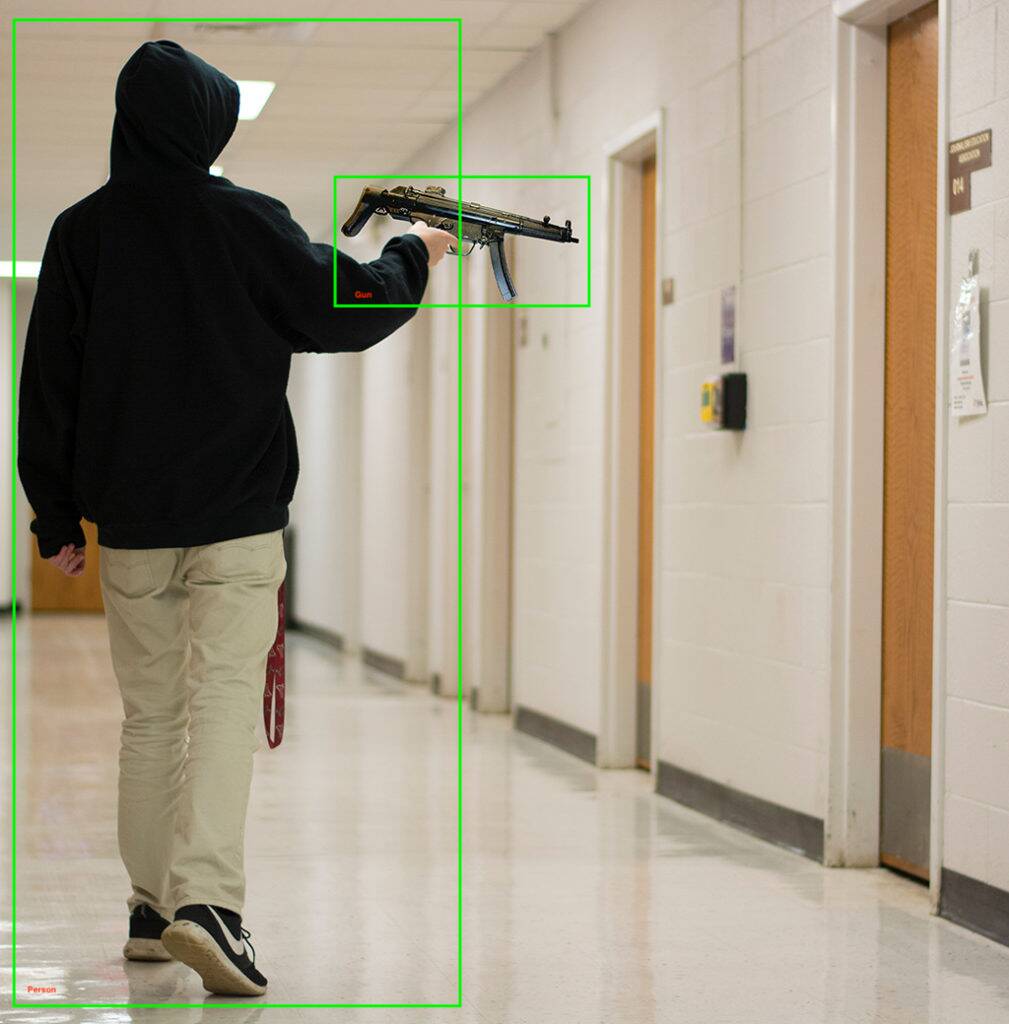

Machine-learning biz Kogniz kunngjorde tirsdag at den legger til en klar til distribusjon våpendeteksjonsmodell til sin datasynsplattform. Systemet, blir vi fortalt, kan oppdage våpen sett av sikkerhetskameraer og sende varsler til de som er i fare, varsle politiet, låse bygninger og utføre andre sikkerhetsoppgaver.

I tillegg til å oppdage skytevåpen, bruker Kogniz sine andre datasynsmoduler for å legge merke til uvanlig oppførsel, for eksempel barn som spurter ned gangene eller noen som klatrer inn gjennom et vindu, noe som kan indikere en aktiv skytter.

Hvis du lurer på kodens falske positive eller feilrate, sier Kogniz at den har en "multi-pass AI" og "et trent team av menneskelige verifikatorer" som sjekker resultatene av deteksjonsprogramvaren. Enten ønsker du det ekstra bekreftelsesnivået velkommen, eller ser det som at teknologi potensielt faller tilbake på mennesker akkurat når datamaskinene er mest nødvendig.

"[Vår løsning er] å gjøre det dramatisk enklere for selskaper, offentlige etater, skoler og sykehus å forberede seg på og deretter bidra til å redusere skaden forårsaket av et aktivt skytespill," sa Kogniz-sjef Daniel Putterman.

Kogniz er ikke det første datasynsselskapet som kommer inn i våpengjenkjenningsspillet – det er en betydelig liste over selskaper som bruker lignende teknologi, og noen, som ZeroEyes, spesialiserer seg på ikke annet enn skytevåpendeteksjon.

"Ved å spre oppmerksomheten deres over flere tilbud, er utviklere mindre i stand til å gi den aller beste tjenesten innen våpendeteksjon," sa ZeroEyes i en blogginnlegg. ZeroEyes' teknologi har blitt distribuert på skoler i 14 stater, inkludert Oxford videregående skole i metrostasjonen Detroit, der en 15 år gammel skytter drepte fire og skadet syv i fjor.

Andre leverandører – som Defendry, som har en sikkerhetspakke som inkluderer en panikkknapp-app, lydpistolskuddsensorer, førsteresponderdroner og AI for våpendeteksjon; og Omnilert – er i dette deprimerende vekstmarkedet. Ytterligere selskaper innen AI-våpendeteksjonsfeltet inkluderer Arcarith, Athena Securities og Scylla.

Er det egentlig nok tid?

I 2019 var politiets reaksjon på en masseskyting i Dayton, Ohio, bare 32 sekunder, i løpet av denne tiden døde ni mennesker. En skyting i 2021 på et FedEx-anlegg i Indianapolis som drepte ni mennesker var også over før politiet kunne ankomme, selv om de gjorde det på få minutter.

Begge disse tilfellene reiser spørsmålet om AI-våpendeteksjon kan redusere responstidene nok til å redde liv. Spesielt hvis offiserer er for redde eller velger å ikke svare, for eksempel ved massemordet på Uvalde.

Flere andre AI-baserte masseskytingsforebyggende metoder er foreslått, som f.eks smarte våpen som ikke vil skyte hvis de oppdager et menneskelig mål. Andre har foreslått opplæring av AI-er på data fra tidligere skyting, lokale våpenkjøp og sosioøkonomiske data for å finne trender som indikerer en planlagt skyting, i tillegg til å skanne sosiale medier for lignende indikatorer.

Det er også AI skjevheten godt dokumentert problem at selv diverse datasett og balansert trening ser ikke ut til å løse. Ta en utplassering av ansikts- og våpengjenkjenningsteknologi i 2020 i et skoledistrikt i New York: e-poster mellom skoledistriktet og selskapet som implementerte systemet viser ofte bekymring for det feilidentifisering ting, som kosteskaft til våpen.

Snakker til Utah-publikasjonen Deseret News, ACLU senior policy analytiker Jay Stanley sa han var bekymret for at datasynssystemer kunne føre til en verden "der folk unngår å gjøre noe så enkelt som å hoppe nedover et fortau i frykt for å sette i gang anomalidetektorer og bli avhørt av politiet."

En mulig bruk av AI kan imidlertid ha mer løfte: en 2018 studere fra Cincinnati Children’s Hospital Medical Center fant at AI-analyse av terapisesjoner stemte overens med farevurderingene til psykiatere og rådgivere 91 prosent av tiden. Tillegget av demografiske og sosioøkonomiske data forbedret bare resultatene for å identifisere unge mennesker som var i faresonen for å begå en voldelig handling.

Med så mange potensielle komplikasjoner, er maskinlæring virkelig klar til å forhindre massemord?

Våpenvold er det morder nummer én av barn og tenåringer i Amerika, tar i gjennomsnitt 12 unge liv og skader 32 flere hver dag. AI kan hjelpe, men uten å ta tak i dens mangler, er det kanskje også nødvendig med mindre teknologiske tilnærminger. Sterkere, mer allment tilgjengelig psykisk helsehjelp kan være en god start.

Tidligere denne måneden, president Biden som heter for blant annet et angrepsvåpenforbud, utvidede bakgrunnssjekker og begrensninger på magasinkapasitet, som han kalte «rasjonelle, sunne tiltak». ®

- AI

- ai kunst

- ai art generator

- du har en robot

- kunstig intelligens

- sertifisering av kunstig intelligens

- kunstig intelligens i bankvirksomhet

- kunstig intelligens robot

- kunstig intelligens roboter

- programvare for kunstig intelligens

- blockchain

- blockchain konferanse ai

- coingenius

- samtale kunstig intelligens

- kryptokonferanse ai

- dall sin

- dyp læring

- google det

- maskinlæring

- plato

- plato ai

- Platon Data Intelligence

- Platon spill

- PlatonData

- platogaming

- skala ai

- syntaks

- Registeret

- zephyrnet