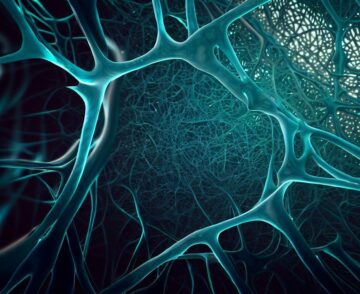

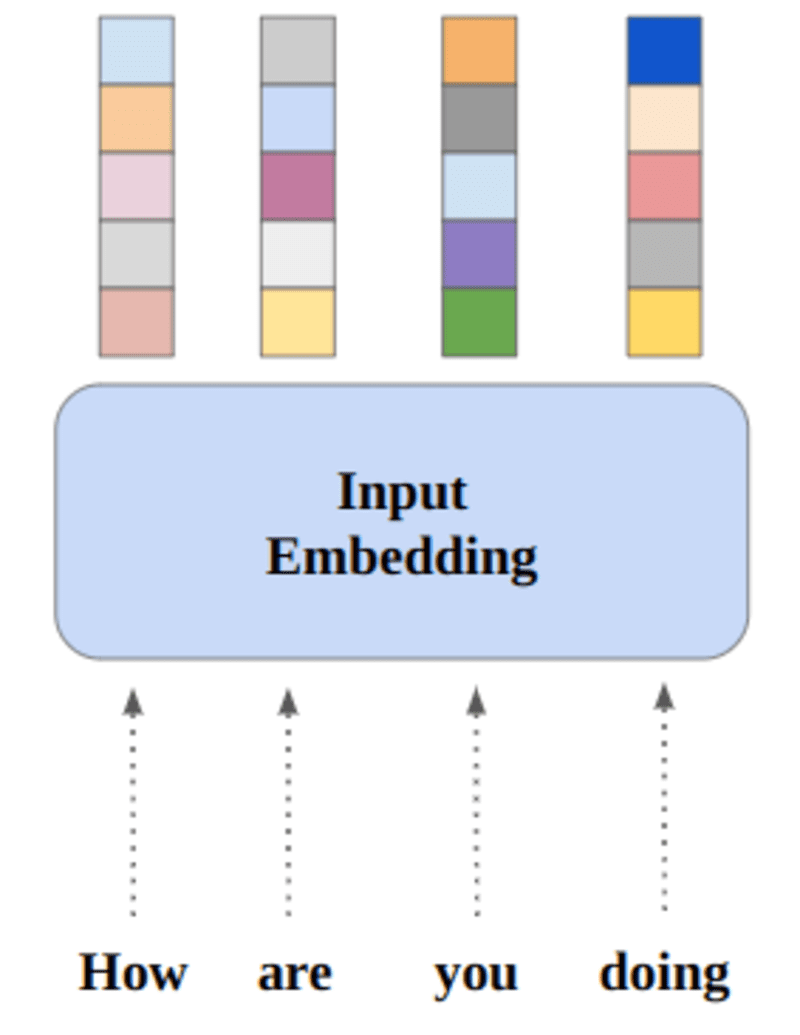

Sieci neuronowe uczą się poprzez liczby, więc każde słowo zostanie odwzorowane na wektory reprezentujące określone słowo. Warstwa osadzania może być traktowana jako tabela przeglądowa, która przechowuje osadzone słowa i pobiera je za pomocą indeksów.

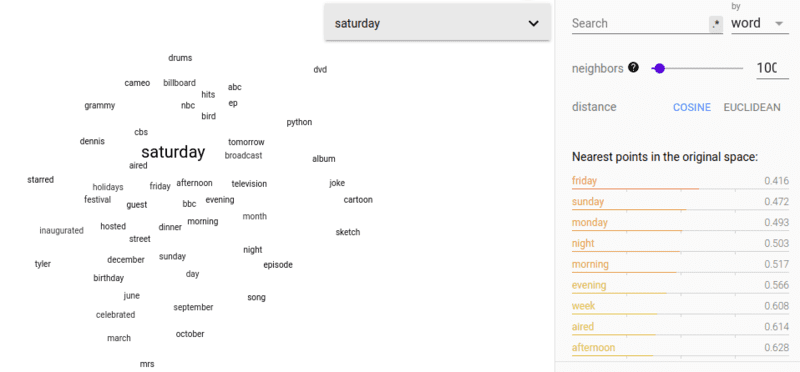

Słowa, które mają to samo znaczenie, będą zbliżone pod względem odległości euklidesowej/podobieństwa cosinusowego. na przykład w poniższej reprezentacji słownej „sobota”, „niedziela” i „poniedziałek” są powiązane z tym samym pojęciem, więc możemy zobaczyć, że słowa są podobne.

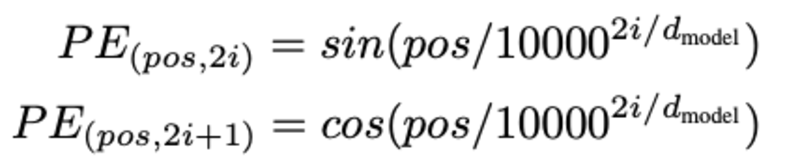

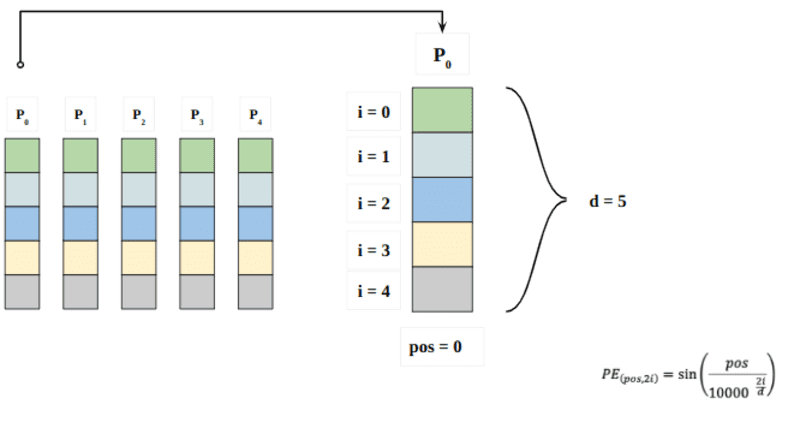

Określenie pozycji słowa, Dlaczego musimy określić pozycję słowa? ponieważ enkoder transformatora nie ma powtarzalności, jak powtarzające się sieci neuronowe, musimy dodać pewne informacje o pozycjach do osadzania danych wejściowych. Odbywa się to za pomocą kodowania pozycyjnego. Autorzy artykułu wykorzystali następujące funkcje do modelowania pozycji słowa.

Spróbujemy wyjaśnić kodowanie pozycyjne.

Tutaj „pos” odnosi się do pozycji „słowa” w sekwencji. P0 odnosi się do osadzania pozycji pierwszego słowa; „d” oznacza rozmiar osadzania słowa/tokena. W tym przykładzie d=5. Wreszcie „i” odnosi się do każdego z 5 indywidualnych wymiarów osadzania (tj. 0, 1,2,3,4)

jeśli „i” zmienia się w powyższym równaniu, otrzymasz kilka krzywych o różnych częstotliwościach. Odczytywanie wartości osadzania pozycji względem różnych częstotliwości, dając różne wartości przy różnych wymiarach osadzania dla P0 i P4.

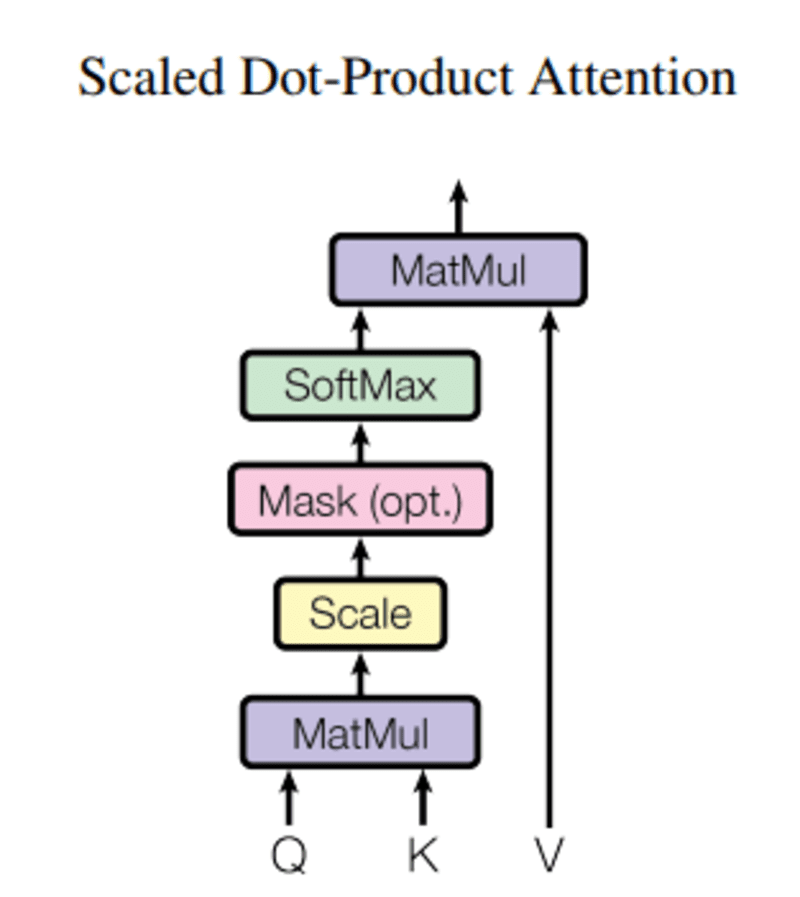

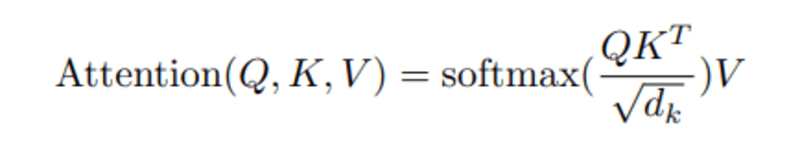

W tym zapytanie, q reprezentuje słowo wektorowe, the klucze k to wszystkie inne słowa w zdaniu i wartość V reprezentuje wektor słowa.

Celem uwagi jest obliczenie ważności kluczowego terminu w porównaniu z terminem zapytania odnoszącym się do tej samej osoby/rzeczy lub pojęcia.

W naszym przypadku V jest równe Q.

Mechanizm uwagi informuje nas o znaczeniu słowa w zdaniu.

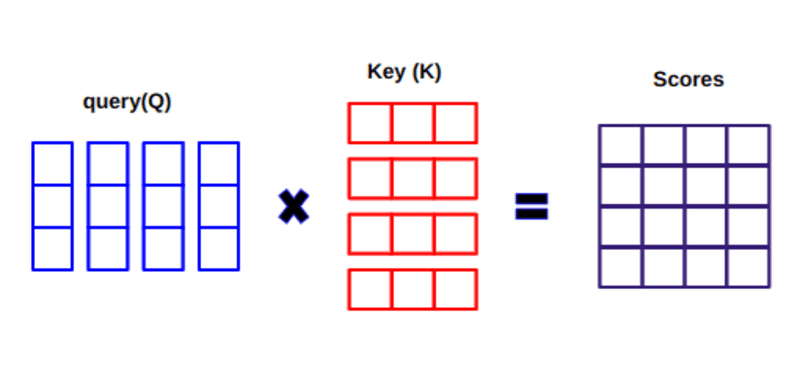

Kiedy obliczamy znormalizowany iloczyn skalarny między zapytaniem a kluczami, otrzymujemy tensor, który reprezentuje względną ważność każdego innego słowa w zapytaniu.

Podczas obliczania iloczynu skalarnego między Q i KT próbujemy oszacować, w jaki sposób wektory (tj. słowa między zapytaniem a kluczami) są wyrównane i zwracamy wagę dla każdego słowa w zdaniu.

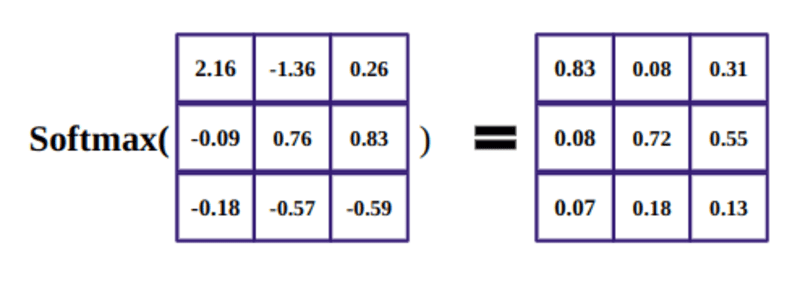

Następnie normalizujemy wynik do kwadratu z d_k i Funkcja softmax reguluje terminy i przeskalowuje je między 0 a 1.

Na koniec mnożymy wynik (tj. wagi) przez wartość (tj. wszystkie słowa), aby zmniejszyć znaczenie nieistotnych słów i skupić się tylko na najważniejszych słowach.

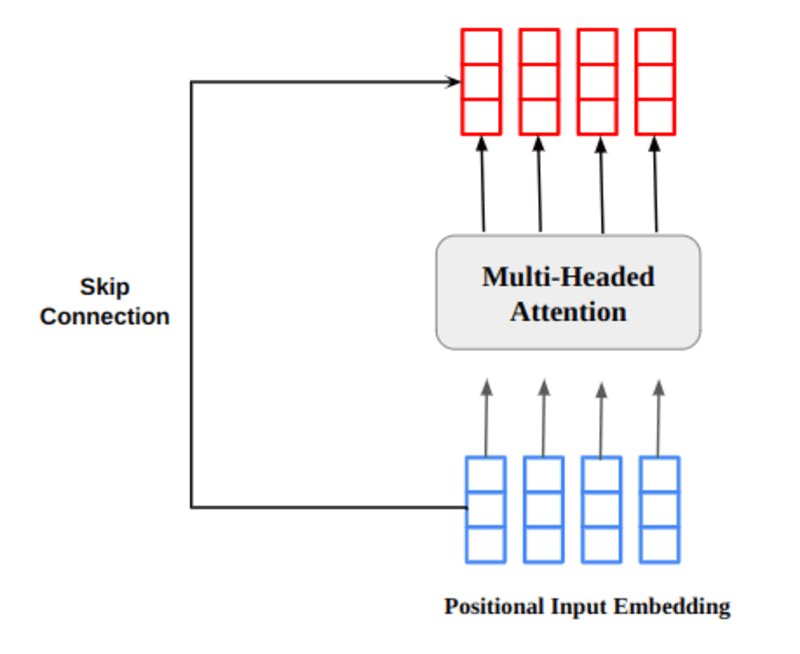

Wielogłowy wektor wyjściowy uwagi jest dodawany do oryginalnego osadzania danych pozycyjnych. Nazywa się to połączeniem szczątkowym/pominięciem połączenia. Dane wyjściowe połączenia resztkowego przechodzą przez normalizację warstwy. Znormalizowana resztkowa moc wyjściowa jest przepuszczana przez punktową sieć sprzężenia zwrotnego do dalszego przetwarzania.

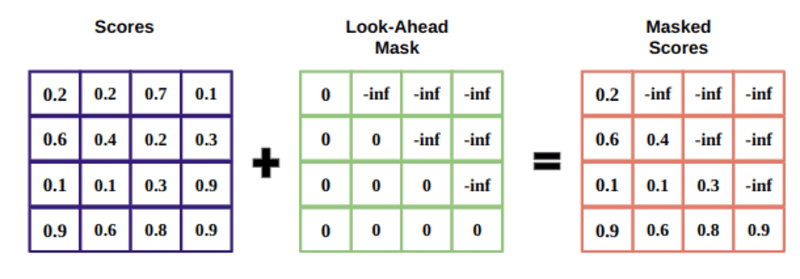

Maska to macierz o takim samym rozmiarze jak wyniki uwagi, wypełniona wartościami zer i ujemnymi nieskończonościami.

Powodem maski jest to, że gdy weźmiesz softmax zamaskowanych wyników, ujemne nieskończoności osiągną zero, pozostawiając zero punktów uwagi dla przyszłych tokenów.

To mówi modelowi, aby nie skupiał się na tych słowach.

Celem funkcji softmax jest pobranie liczb rzeczywistych (dodatnich i ujemnych) i przekształcenie ich w liczby dodatnie, których suma wynosi 1.

Ravikumar Naduvin jest zajęty budowaniem i rozumieniem zadań NLP przy użyciu PyTorch.

Oryginalny. Przesłane za zgodą.

- Dystrybucja treści i PR oparta na SEO. Uzyskaj wzmocnienie już dziś.

- Platoblockchain. Web3 Inteligencja Metaverse. Wzmocniona wiedza. Dostęp tutaj.

- Źródło: https://www.kdnuggets.com/2023/01/concepts-know-getting-transformer.html?utm_source=rss&utm_medium=rss&utm_campaign=concepts-you-should-know-before-getting-into-transformer

- 1

- a

- O nas

- powyżej

- w dodatku

- przed

- wyrównany

- Wszystkie kategorie

- i

- powiązany

- Uwaga

- Autorzy

- bo

- zanim

- poniżej

- pomiędzy

- Budowanie

- Pęczek

- nazywa

- walizka

- Zamknij

- w porównaniu

- obliczać

- computing

- pojęcie

- Koncepcje

- połączenie

- Ustalać

- określaniu

- różne

- Wymiary

- DOT

- każdy

- oszacowanie

- przykład

- Wyjaśniać

- wypełniony

- W końcu

- i terminów, a

- Skupiać

- następujący

- funkcjonować

- Funkcje

- dalej

- przyszłość

- otrzymać

- miejsce

- GitHub

- daje

- Dający

- Goes

- chwycić

- W jaki sposób

- HTTPS

- znaczenie

- ważny

- in

- Indeksy

- indywidualny

- Informacja

- wkład

- Knuggety

- Klawisz

- Klawisze

- Wiedzieć

- warstwa

- UCZYĆ SIĘ

- pozostawiając

- wyszukiwania

- maska

- Matrix

- znaczenie

- znaczy

- mechanizm

- model

- większość

- Potrzebować

- ujemny

- sieć

- sieci

- Nerwowy

- sieci neuronowe

- nlp

- z naszej

- oryginalny

- Inne

- Papier

- szczególny

- minęło

- pozwolenie

- plato

- Analiza danych Platona

- PlatoDane

- position

- Pozycje

- pozytywny

- przetwarzanie

- Produkt

- cel

- położyć

- płomień

- Czytający

- real

- powód

- nawrót

- zmniejszyć

- odnosi

- związane z

- reprezentować

- reprezentacja

- reprezentuje

- dalsze

- wynikły

- powrót

- taki sam

- wyrok

- Sekwencja

- powinien

- podobny

- Rozmiar

- So

- kilka

- Do kwadratu

- sklep

- stół

- Brać

- zadania

- mówi

- REGULAMIN

- Połączenia

- myśl

- Przez

- do

- Żetony

- Transformatory

- SKRĘCAĆ

- zrozumienie

- us

- wartość

- Wartości

- waga

- który

- będzie

- słowo

- słowa

- zefirnet

- zero