Autopilot Amazon SageMaker to zautomatyzowane rozwiązanie do uczenia maszynowego (AutoML), które wykonuje wszystkie zadania potrzebne do ukończenia kompleksowego przepływu pracy uczenia maszynowego (ML). Eksploruje i przygotowuje dane, stosuje różne algorytmy do generowania modelu oraz w przejrzysty sposób dostarcza wgląd w model i raporty wyjaśniające, które pomagają zinterpretować wyniki. Autopilot może również tworzyć punkt końcowy w czasie rzeczywistym do wnioskowania online. Możesz uzyskać dostęp do funkcji Autopilota jednym kliknięciem w Studio Amazon SageMaker lub przy użyciu AWS SDK dla Pythona (Boto3) lub SageMaker Python SDK.

W tym poście pokazujemy, jak tworzyć prognozy wsadowe na nieoznakowanym zestawie danych przy użyciu modelu wytrenowanego w trybie autopilota. Używamy syntetycznie wygenerowanego zbioru danych, który wskazuje na typy funkcji, które zazwyczaj widzisz podczas przewidywania rezygnacji klientów.

Omówienie rozwiązania

Partia wnioskowanie, lub nieaktywny wnioskowanie, to proces generowania prognoz na partii obserwacji. Wnioskowanie wsadowe zakłada, że nie potrzebujesz natychmiastowej odpowiedzi na żądanie prognozowania modelu, tak jak w przypadku korzystania z internetowego punktu końcowego modelu w czasie rzeczywistym. Prognozy offline są odpowiednie dla większych zbiorów danych oraz w przypadkach, w których możesz sobie pozwolić na oczekiwanie kilku minut lub godzin na odpowiedź. W przeciwieństwie, Online wnioskowanie generuje prognozy ML w czasie rzeczywistym i jest trafnie określane jako w czasie rzeczywistym wnioskowanie lub dynamiczny wnioskowanie. Zazwyczaj te prognozy są generowane na podstawie pojedynczej obserwacji danych w czasie wykonywania.

Utrata klientów jest kosztowna dla każdej firmy. Wczesne rozpoznanie niezadowolonych klientów daje szansę na zaoferowanie im zachęty do pozostania. Operatorzy komórkowi posiadają historyczne dane klientów pokazujące tych, którzy zrezygnowali i tych, którzy utrzymali usługę. Możemy wykorzystać te historyczne informacje do skonstruowania modelu do przewidywania, czy klient odejdzie za pomocą ML.

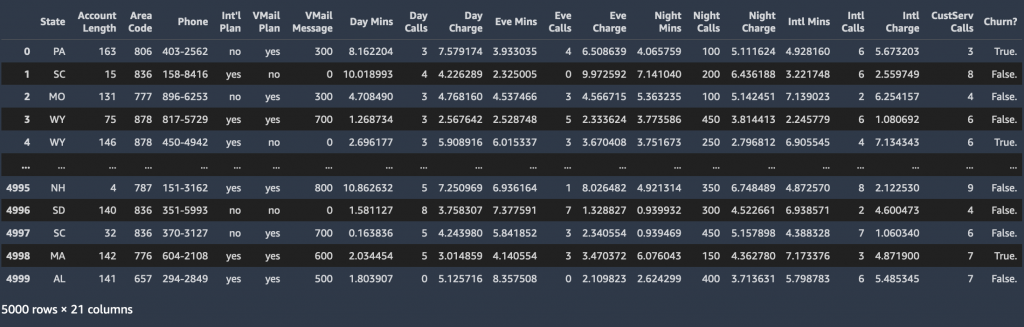

Po wytrenowaniu modelu ML możemy przekazać informacje o profilu dowolnego klienta (te same informacje o profilu, których użyliśmy do trenowania) do modelu i pozwolić modelowi przewidzieć, czy klient odejdzie, czy nie. Zestaw danych użyty w tym poście znajduje się w folderze sagemaker-sample-files w Usługa Amazon Simple Storage (Amazon S3) publiczny wiadro, który możesz pobrać. Składa się z 5,000 rekordów, z których każdy wykorzystuje 21 atrybutów do opisania profilu klienta nieznanego amerykańskiego operatora telefonii komórkowej. Atrybuty są następujące:

- Stan – stan USA, w którym zamieszkuje klient, wskazany dwuliterowym skrótem; na przykład TX lub CA

- Długość konta – Liczba dni, przez które to konto było aktywne

- Numer kierunkowy – Trzycyfrowy numer kierunkowy odpowiedniego numeru telefonu klienta

- Telefon – Pozostały siedmiocyfrowy numer telefonu

- Plan międzynarodowy – Ma międzynarodowy plan taryfowy: Tak/Nie

- Plan VMmail – Posiada funkcję poczty głosowej: Tak/Nie

- Wiadomość VMmail – Średnia liczba wiadomości głosowych na miesiąc

- Minuty dnia – Całkowita liczba minut rozmów wykorzystanych w ciągu dnia

- Połączenia dzienne – Całkowita liczba połączeń wykonanych w ciągu dnia

- Opłata dzienna – Rozliczany koszt połączeń w ciągu dnia

- Eve Mins, Eve wzywa, Eve Charge – Naliczany koszt połączeń wykonywanych w godzinach wieczornych

- Minuty nocne, połączenia nocne, opłata nocna – Naliczany koszt połączeń wykonywanych w nocy

- Minuty międzynarodowe, połączenia międzynarodowe, opłaty międzynarodowe – Naliczany koszt połączeń międzynarodowych

- Połączenia CustServ – Liczba połączeń do Biura Obsługi Klienta

- Maselnica? – Klient opuścił usługę: Prawda/Fałsz

Ostatni atrybut, Churn?, jest atrybutem docelowym, który ma przewidywać model ML. Ponieważ atrybut target jest binarny, nasz model wykonuje predykcję binarną, znaną również jako klasyfikacja binarna.

Wymagania wstępne

Pobierz zestaw danych do lokalnego środowiska programistycznego i eksploruj go, uruchamiając następujące polecenie kopiowania S3 z Interfejs wiersza poleceń AWS (CLI AWS):

Następnie możesz skopiować zestaw danych do zasobnika S3 na swoim własnym koncie AWS. To jest lokalizacja wejścia dla Autopilota. Możesz skopiować zbiór danych do Amazon S3, ręcznie przesyłając je do swojego zasobnika lub uruchamiając następujące polecenie za pomocą interfejsu AWS CLI:

Utwórz eksperyment autopilota

Gdy zestaw danych jest gotowy, możesz zainicjować eksperyment autopilota w SageMaker Studio. Aby uzyskać pełne instrukcje, zobacz Utwórz eksperyment Amazon SageMaker Autopilot.

Pod Podstawowe ustawienia, możesz łatwo utworzyć eksperyment autopilota, podając nazwę eksperymentu, lokalizacje danych wejściowych i wyjściowych oraz określając dane docelowe do przewidzenia. Opcjonalnie możesz określić typ problemu ML, który chcesz rozwiązać. W przeciwnym razie użyj Samochody ustawienie, a Autopilot automatycznie określa model na podstawie dostarczonych danych.

Możesz również uruchomić eksperyment autopilota z kodem przy użyciu zestawu AWS SDK dla języka Python (Boto3) lub zestawu SDK języka SageMaker w języku Python. Poniższy fragment kodu demonstruje, jak zainicjować eksperyment autopilota przy użyciu zestawu SDK SageMaker Python. Używamy Klasa AutoML z pakietu SageMaker Python SDK.

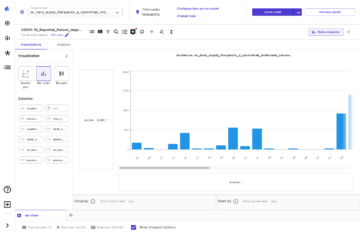

Gdy Autopilot rozpocznie eksperyment, usługa automatycznie sprawdza nieprzetworzone dane wejściowe, stosuje procesory funkcji i wybiera najlepszy zestaw algorytmów. Po wybraniu algorytmu Autopilot optymalizuje swoją wydajność, wykorzystując proces wyszukiwania optymalizacji hiperparametrów. Często nazywa się to trenowaniem i dostrajaniem modelu. To ostatecznie pomaga stworzyć model, który może dokładnie przewidywać dane, których nigdy nie widział. Autopilot automatycznie śledzi wydajność modelu, a następnie klasyfikuje ostateczne modele na podstawie metryk opisujących dokładność i precyzję modelu.

Masz również możliwość wdrożenia dowolnego z modeli rankingowych, wybierając model (kliknij prawym przyciskiem myszy) i wybierając Wdróż modellub wybierając model z listy rankingowej i wybierając Wdróż model.

Twórz prognozy wsadowe za pomocą modelu z Autopilota

Po zakończeniu eksperymentu autopilota możesz użyć wytrenowanego modelu, aby uruchomić prognozy wsadowe w zestawie danych testowych lub wstrzymanych do oceny. Następnie możesz porównać przewidywane etykiety z oczekiwanymi etykietami, jeśli zestaw danych testowych lub wstrzymanych jest wstępnie oznaczony. Jest to zasadniczo sposób na porównanie przewidywań modelu z prawdą. Jeśli więcej prognoz modelu pasuje do prawdziwych etykiet, możemy ogólnie zaklasyfikować model jako dobrze działający. Możesz także uruchomić prognozy wsadowe, aby oznaczyć dane nieoznakowane etykietami. Możesz łatwo osiągnąć to samo, używając wysokopoziomowego zestawu SDK SageMaker Python z kilkoma linijkami kodu.

Opisz poprzednio uruchomiony eksperyment autopilota

Najpierw musimy wydobyć informacje z wcześniej zakończonego eksperymentu autopilota. Możemy użyć klasy AutoML z pakietu SageMaker Python SDK, aby utworzyć obiekt automl, który zawiera informacje z poprzedniego eksperymentu autopilota. Możesz użyć nazwy eksperymentu zdefiniowanej podczas inicjowania eksperymentu autopilota. Zobacz następujący kod:

Dzięki obiektowi automl możemy łatwo opisać i odtworzyć najlepiej wytrenowany model, jak pokazano w następujących fragmentach:

W niektórych przypadkach możesz chcieć użyć modelu innego niż najlepszy według rankingu autopilota. Aby znaleźć taki kandydujący model, możesz użyć obiektu automl i przejrzeć listę wszystkich lub N najlepszych kandydujących modeli i wybrać model, który chcesz odtworzyć. W tym poście używamy prostej pętli For w języku Python, aby przejść przez listę kandydatów do modeli:

Dostosuj odpowiedź wnioskowania

Podczas odtwarzania najlepszego lub dowolnego innego wytrenowanego modelu Autopilota możemy dostosować odpowiedź wnioskowania dla modelu, dodając dodatkowy parametr inference_response_keys, jak pokazano w poprzednim przykładzie. Możesz użyć tego parametru w przypadku problemów z klasyfikacją binarną lub wieloklasową:

- przewidywana_etykieta – Przewidywana klasa.

- prawdopodobieństwo – W klasyfikacji binarnej prawdopodobieństwo, że wynik jest przewidziany jako druga klasa lub prawda w kolumnie docelowej. W klasyfikacji wieloklasowej prawdopodobieństwo wygranej klasy.

- Etykiety – Lista wszystkich możliwych klas.

- prawdopodobieństwa – Lista wszystkich prawdopodobieństw dla wszystkich klas (kolejność odpowiada etykietom).

Ponieważ problemem, którym zajmujemy się w tym poście, jest klasyfikacja binarna, w poprzednich fragmentach ustawiamy ten parametr w następujący sposób podczas tworzenia modeli:

Utwórz transformator i uruchom prognozy wsadowe

Na koniec, po odtworzeniu modeli kandydujących, możemy utworzyć transformator, aby uruchomić zadanie prognozowania wsadowego, jak pokazano w poniższych dwóch fragmentach kodu. Tworząc transformator, definiujemy specyfikacje klastra do uruchomienia zadania wsadowego, takie jak liczba i typ instancji. Dane wejściowe i wyjściowe partii to lokalizacje Amazon S3, w których przechowywane są nasze dane wejściowe i wyjściowe. Zadanie przewidywania partii jest obsługiwane przez Transformacja wsadowa SageMaker.

Po zakończeniu zadania możemy odczytać dane wyjściowe wsadowe i wykonać oceny oraz inne dalsze działania.

Podsumowanie

W tym poście pokazaliśmy, jak szybko i łatwo tworzyć prognozy wsadowe przy użyciu modeli przeszkolonych przez autopilota do oceny po szkoleniu. Wykorzystaliśmy SageMaker Studio do zainicjowania eksperymentu Autopilot, aby stworzyć model do przewidywania rezygnacji klientów. Następnie odwołaliśmy się do najlepszego modelu Autopilota, aby uruchomić prognozy wsadowe przy użyciu klasy automl z pakietem SageMaker Python SDK. Wykorzystaliśmy również SDK do wykonywania prognoz wsadowych z innymi kandydatami do modeli. Dzięki Autopilotowi automatycznie zbadaliśmy i wstępnie przetworzyliśmy nasze dane, a następnie jednym kliknięciem stworzyliśmy kilka modeli ML, pozwalając SageMakerowi zająć się zarządzaniem infrastrukturą niezbędną do trenowania i dostrajania naszych modeli. Na koniec użyliśmy transformacji wsadowej, aby prognozować za pomocą naszego modelu przy użyciu minimalnego kodu.

Więcej informacji na temat autopilota i jego zaawansowanych funkcji można znaleźć w Zautomatyzuj tworzenie modeli za pomocą Amazon SageMaker Autopilot. Aby uzyskać szczegółowy opis przykładu w poście, spójrz na poniższe przykładowy notatnik.

O autorach

Arunprasath Shankar jest specjalistą ds. rozwiązań w zakresie sztucznej inteligencji i uczenia maszynowego (AI / ML) w AWS, pomagając globalnym klientom skutecznie i wydajnie skalować rozwiązania AI w chmurze. W wolnym czasie Arun lubi oglądać filmy science fiction i słuchać muzyki klasycznej.

Arunprasath Shankar jest specjalistą ds. rozwiązań w zakresie sztucznej inteligencji i uczenia maszynowego (AI / ML) w AWS, pomagając globalnym klientom skutecznie i wydajnie skalować rozwiązania AI w chmurze. W wolnym czasie Arun lubi oglądać filmy science fiction i słuchać muzyki klasycznej.

Piotr Chung jest architektem rozwiązań dla AWS i pasjonuje się pomaganiem klientom w odkrywaniu wniosków z ich danych. Tworzył rozwiązania pomagające organizacjom w podejmowaniu decyzji opartych na danych zarówno w sektorze publicznym, jak i prywatnym. Posiada wszystkie certyfikaty AWS oraz dwa certyfikaty GCP. Lubi kawę, gotować, być aktywnym i spędzać czas z rodziną.

Piotr Chung jest architektem rozwiązań dla AWS i pasjonuje się pomaganiem klientom w odkrywaniu wniosków z ich danych. Tworzył rozwiązania pomagające organizacjom w podejmowaniu decyzji opartych na danych zarówno w sektorze publicznym, jak i prywatnym. Posiada wszystkie certyfikaty AWS oraz dwa certyfikaty GCP. Lubi kawę, gotować, być aktywnym i spędzać czas z rodziną.

- Coinsmart. Najlepsza w Europie giełda bitcoinów i kryptowalut.

- Platoblockchain. Web3 Inteligencja Metaverse. Wzmocniona wiedza. DARMOWY DOSTĘP.

- CryptoJastrząb. Radar Altcoin. Bezpłatna wersja próbna.

- Źródło: https://aws.amazon.com/blogs/machine-learning/make-batch-predictions-with-amazon-sagemaker-autopilot/

- "

- 000

- 100

- O nas

- dostęp

- Konto

- działania

- aktywny

- zaawansowany

- AI

- algorytm

- Algorytmy

- Wszystkie kategorie

- Amazonka

- POWIERZCHNIA

- sztuczny

- sztuczna inteligencja

- Sztuczna inteligencja i uczenie maszynowe

- zautomatyzowane

- średni

- AWS

- BEST

- granica

- Budowanie

- biznes

- który

- Etui

- klasyfikacja

- Chmura

- kod

- Kawa

- Kolumna

- Tworzenie

- Klientów

- dane

- rozwijać

- oprogramowania

- różne

- Wcześnie

- z łatwością

- Punkt końcowy

- Środowisko

- przykład

- egzekucja

- spodziewany

- eksperyment

- członków Twojej rodziny

- Cecha

- Korzyści

- i terminów, a

- następujący

- pełny

- Generować

- Globalne

- pomoc

- pomaga

- historyczny

- posiada

- W jaki sposób

- How To

- HTTPS

- Natychmiastowy

- Informacja

- Infrastruktura

- spostrzeżenia

- Inteligencja

- na świecie

- IT

- Praca

- Oferty pracy

- znany

- Etykiety

- większe

- nauka

- Linia

- Lista

- Słuchanie

- miejscowy

- lokalizacja

- lokalizacji

- maszyna

- uczenie maszynowe

- zarządzający

- ręcznie

- Mecz

- Metryka

- ML

- Aplikacje mobilne

- model

- modele

- Kino

- Muzyka

- numer

- oferta

- Online

- optymalizacja

- Option

- zamówienie

- organizacji

- Inne

- Inaczej

- jest gwarancją najlepszej jakości, które mogą dostarczyć Ci Twoje monitory,

- możliwy

- przepowiednia

- Przewidywania

- prywatny

- Problem

- wygląda tak

- produkować

- Profil

- zapewniać

- zapewnia

- publiczny

- szybko

- Surowy

- w czasie rzeczywistym

- rekord

- dokumentacja

- Raporty

- odpowiedź

- Efekt

- run

- bieganie

- Skala

- Sdk

- Szukaj

- Sektory

- usługa

- zestaw

- ustawienie

- Prosty

- Rozwiązania

- ROZWIĄZANIA

- Spędzanie

- początek

- Stan

- pobyt

- przechowywanie

- studio

- cel

- zadania

- test

- Przez

- czas

- Top

- Trening

- Przekształcać

- TX

- odkryć

- us

- posługiwać się

- Głos

- czekać

- czy

- KIM

- w ciągu