Esta postagem é de coautoria com Hernan Figueroa, gerente sênior de ciência de dados da Marubeni Power International.

Marubeni Power International Inc. (MPII) possui e investe em plataformas de negócios de energia nas Américas. Uma vertical importante para o MPII é o gerenciamento de ativos para energia renovável e ativos de armazenamento de energia, que são essenciais para reduzir a intensidade de carbono de nossa infraestrutura de energia. Trabalhar com ativos de energia renovável requer soluções digitais preditivas e responsivas, porque a geração de energia renovável e as condições do mercado de eletricidade estão mudando continuamente. O MPII está usando um mecanismo de otimização de lances de aprendizado de máquina (ML) para informar os processos de tomada de decisão upstream no gerenciamento e negociação de ativos de energia. Essa solução ajuda os analistas de mercado a projetar e executar estratégias de lances baseadas em dados otimizadas para aumentar a lucratividade dos ativos.

Nesta postagem, você aprenderá como a Marubeni está otimizando as decisões de mercado usando o amplo conjunto de análises da AWS e serviços de ML para criar uma solução robusta e econômica de otimização de lances de energia.

Visão geral da solução

Os mercados de eletricidade permitem a comercialização de energia para equilibrar a oferta e a demanda de energia na rede elétrica e para cobrir diferentes necessidades de confiabilidade da rede elétrica. Os participantes do mercado, como os operadores de ativos MPII, estão constantemente oferecendo quantidades de energia e energia nesses mercados de eletricidade para obter lucros de seus ativos de energia. Um participante do mercado pode enviar ofertas para diferentes mercados simultaneamente para aumentar a lucratividade de um ativo, mas precisa considerar os limites de poder do ativo e as velocidades de resposta, bem como outras restrições operacionais do ativo e a interoperabilidade desses mercados.

A solução de mecanismo de otimização de lances da MPII usa modelos de ML para gerar lances ideais para participação em diferentes mercados. Os lances mais comuns são os lances de energia do dia seguinte, que devem ser enviados 1 dia antes do dia de negociação real, e os lances de energia em tempo real, que devem ser enviados 75 minutos antes do horário de negociação. A solução orquestra a oferta dinâmica e a operação de um ativo de energia e requer o uso de recursos preditivos e de otimização disponíveis em seus modelos de ML.

A solução Power Bid Optimization inclui vários componentes que desempenham funções específicas. Vamos examinar os componentes envolvidos e suas respectivas funções de negócios.

Coleta e ingestão de dados

A camada de coleta e ingestão de dados se conecta a todas as fontes de dados upstream e carrega os dados no data lake. A licitação do mercado de eletricidade requer pelo menos quatro tipos de entrada:

- Previsões de demanda de eletricidade

- Previsão do tempo

- Histórico de preços de mercado

- Previsões de preços de energia

Essas fontes de dados são acessadas exclusivamente por meio de APIs. Portanto, os componentes de ingestão precisam ser capazes de gerenciar autenticação, fornecimento de dados no modo pull, pré-processamento e armazenamento de dados. Como os dados estão sendo buscados a cada hora, também é necessário um mecanismo para orquestrar e agendar trabalhos de ingestão.

Preparação de dados

Como na maioria dos casos de uso de ML, a preparação de dados desempenha um papel crítico. Os dados vêm de fontes diferentes em vários formatos. Antes de estar pronto para ser consumido para o treinamento do modelo de ML, ele deve passar por algumas das seguintes etapas:

- Consolide conjuntos de dados por hora com base na hora de chegada. Um conjunto de dados completo deve incluir todas as fontes.

- Aumente a qualidade dos dados usando técnicas como padronização, normalização ou interpolação.

Ao final desse processo, os dados curados são preparados e disponibilizados para consumo posterior.

Treinamento e implantação de modelo

A próxima etapa consiste em treinar e implantar um modelo capaz de prever lances ótimos de mercado para compra e venda de energia. Para minimizar o risco de baixo desempenho, Marubeni usou a técnica de modelagem de conjunto. A modelagem de conjunto consiste na combinação de vários modelos de ML para aprimorar o desempenho da previsão. Marubeni combina as saídas de modelos de previsão externos e internos com uma média ponderada para aproveitar a força de todos os modelos. Os modelos internos da Marubeni são baseados em arquiteturas Long Short-Term Memory (LSTM), que são bem documentadas e fáceis de implementar e personalizar no TensorFlow. Amazon Sage Maker oferece suporte a implantações do TensorFlow e muitos outros ambientes de ML. O modelo externo é proprietário e sua descrição não pode ser incluída neste post.

No caso de uso de Marubeni, os modelos de licitação realizam otimização numérica para maximizar a receita usando uma versão modificada das funções objetivo usadas na publicação Oportunidades para Armazenamento de Energia na CAISO.

O SageMaker permite que a Marubeni execute algoritmos de ML e otimização numérica em um único ambiente. Isso é crítico, porque durante o treinamento do modelo interno, a saída da otimização numérica é usada como parte da função de perda de previsão. Para obter mais informações sobre como lidar com casos de uso de otimização numérica, consulte Resolvendo problemas de otimização numérica, como programação, roteamento e alocação com o Amazon SageMaker Processing.

Em seguida, implantamos esses modelos por meio de endpoints de inferência. Como novos dados são ingeridos periodicamente, os modelos precisam ser treinados novamente porque eles se tornam obsoletos com o tempo. A seção de arquitetura mais adiante neste post fornece mais detalhes sobre o ciclo de vida dos modelos.

Geração de dados de lance avançado

De hora em hora, a solução prevê as quantidades e preços ótimos pelos quais a energia deve ser oferecida no mercado, também chamada de licitações. As quantidades são medidas em MW e os preços são medidos em $/MW. Os lances são gerados para várias combinações de condições de mercado previstas e percebidas. A tabela a seguir mostra um exemplo da finalização curva de oferta saída para a hora de operação 17 em um nó comercial ilustrativo perto do escritório da Marubeni em Los Angeles.

| Data | hora | mercado | Localização | MW | Preço |

| 11/7/2022 | 17 | Energia RT | LCIENEGA_6_N001 | 0 | $0 |

| 11/7/2022 | 17 | Energia RT | LCIENEGA_6_N001 | 1.65 | $80.79 |

| 11/7/2022 | 17 | Energia RT | LCIENEGA_6_N001 | 5.15 | $105.34 |

| 11/7/2022 | 17 | Energia RT | LCIENEGA_6_N001 | 8 | $230.15 |

Este exemplo representa nossa disposição de licitar 1.65 MW de energia se o preço da energia for de pelo menos US$ 80.79, 5.15 MW se o preço da energia for de pelo menos US$ 105.34 e 8 MW se o preço da energia for de pelo menos US$ 230.15.

Operadores de sistema independentes (ISOs) supervisionam os mercados de eletricidade nos EUA e são responsáveis por conceder e rejeitar propostas para manter a confiabilidade da rede elétrica da maneira mais econômica. O California Independent System Operator (CAISO) opera os mercados de eletricidade na Califórnia e publica os resultados do mercado a cada hora antes da próxima janela de licitação. Ao cruzar as condições atuais do mercado com seus equivalentes na curva, os analistas são capazes de inferir a receita ideal. A solução Power Bid Optimization atualiza ofertas futuras usando novas informações de mercado recebidas e novas saídas preditivas de modelo

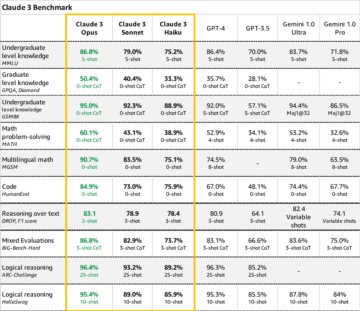

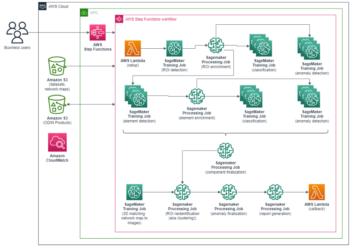

Visão geral da arquitetura da AWS

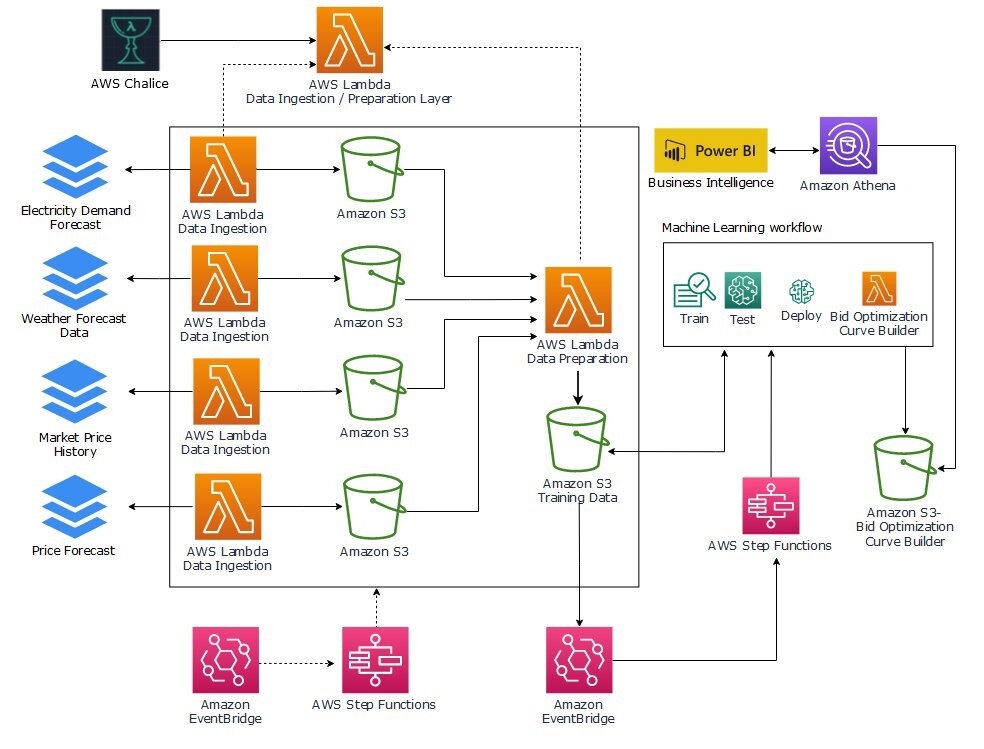

A arquitetura da solução ilustrada na figura a seguir implementa todas as camadas apresentadas anteriormente. Ele usa os seguintes serviços da AWS como parte da solução:

- Serviço de armazenamento simples da Amazon (Amazon S3) para armazenar os seguintes dados:

- Dados de previsão de preço, clima e carga de várias fontes.

- Dados consolidados e aumentados prontos para serem usados no treinamento do modelo.

- Curvas de lance de saída atualizadas a cada hora.

- Amazon Sage Maker para treinar, testar e implantar modelos para atender lances otimizados por meio de endpoints de inferência.

- Funções de etapa da AWS para orquestrar os pipelines de dados e ML. Usamos duas máquinas de estado:

- Uma máquina de estado para orquestrar a coleta de dados e garantir que todas as fontes tenham sido ingeridas.

- Uma máquina de estado para orquestrar o pipeline de ML, bem como o fluxo de trabalho otimizado de geração de lances.

- AWS Lambda para implementar a funcionalidade de ingestão, pré-processamento e pós-processamento:

- Três funções para ingerir feeds de dados de entrada, com uma função por fonte.

- Uma função para consolidar e preparar os dados para treinamento.

- Uma função que gera a previsão de preço chamando o endpoint do modelo implantado no SageMaker.

- Amazona atena para fornecer aos desenvolvedores e analistas de negócios acesso SQL aos dados gerados para análise e solução de problemas.

- Amazon Event Bridge para acionar a ingestão de dados e o pipeline de ML em uma programação e em resposta a eventos.

Nas seções a seguir, discutimos o fluxo de trabalho com mais detalhes.

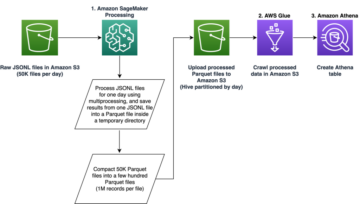

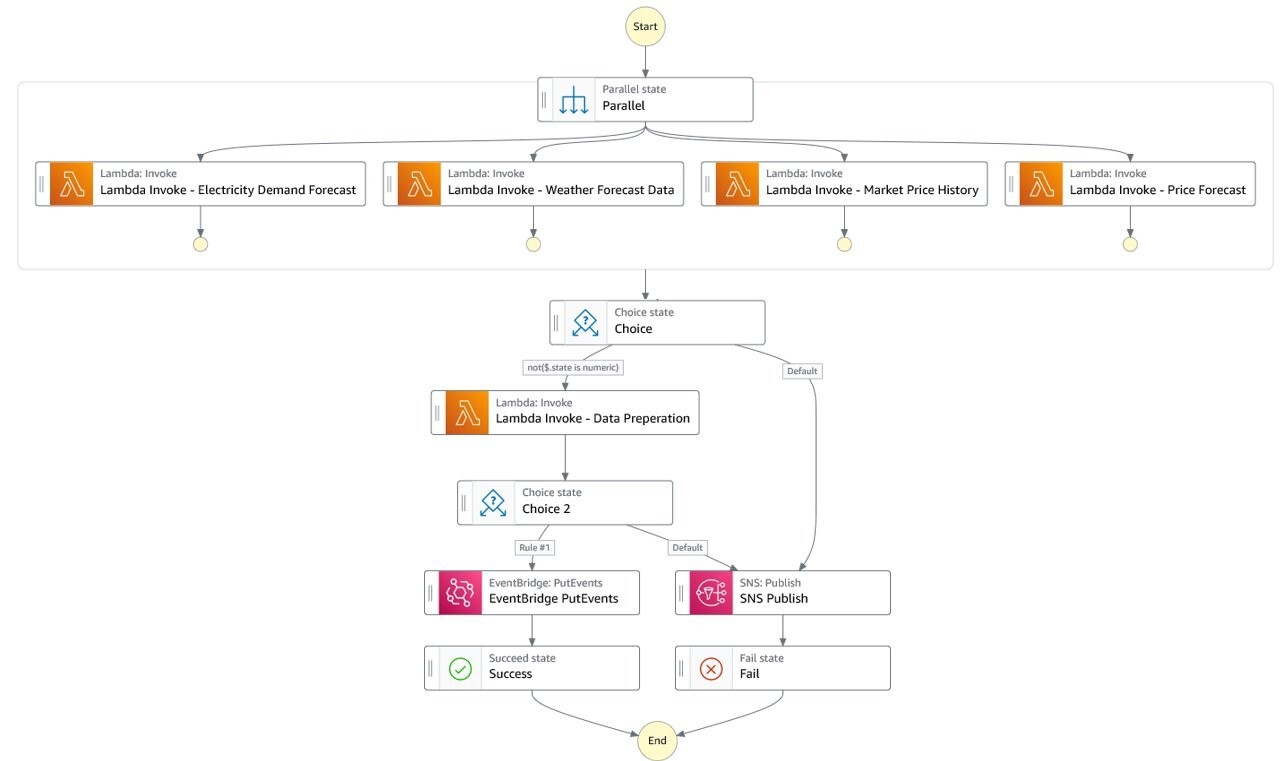

Coleta e preparação de dados

A cada hora, a máquina de estado Step Functions de preparação de dados é invocada. Ele chama cada uma das funções do Lambda de ingestão de dados em paralelo e aguarda a conclusão de todas as quatro. As funções de coleta de dados chamam suas respectivas APIs de origem e recuperam dados da última hora. Cada função então armazena os dados recebidos em seu respectivo bucket S3.

Essas funções compartilham uma linha de base de implementação comum que fornece blocos de construção para manipulação de dados padrão, como normalização ou indexação. Para conseguir isso, usamos camadas Lambda e Cálice AWS, conforme descrito em Usando camadas AWS Lambda com AWS Chalice. Isso garante que todos os desenvolvedores usem as mesmas bibliotecas básicas para criar novas lógicas de preparação de dados e acelerar a implementação.

Depois que todas as quatro fontes tiverem sido ingeridas e armazenadas, a máquina de estado acionará a função Lambda de preparação de dados. Preço de energia, clima e dados de previsão de carga são recebidos em arquivos JSON e delimitados por caracteres. Cada parte de registro de cada arquivo carrega um carimbo de data/hora que é usado para consolidar feeds de dados em um conjunto de dados que cobre um período de 1 hora.

Essa construção fornece um fluxo de trabalho totalmente orientado a eventos. A preparação dos dados de treinamento é iniciada assim que todos os dados esperados são ingeridos.

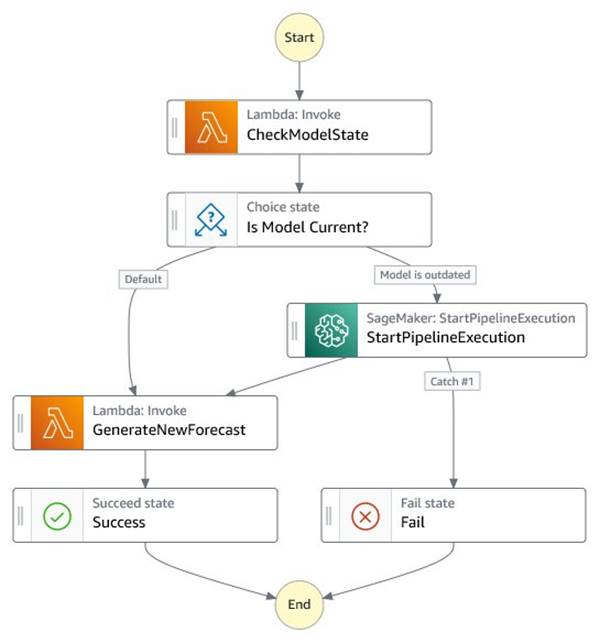

Pipeline de ML

Após a preparação dos dados, os novos conjuntos de dados são armazenados no Amazon S3. Uma regra EventBridge aciona o pipeline de ML por meio de uma máquina de estado do Step Functions. A máquina de estado conduz dois processos:

- Verifique se o modelo de geração da curva de lances está atualizado

- Acione automaticamente o retreinamento do modelo quando o desempenho diminuir ou os modelos forem mais antigos do que uma determinada quantidade de dias

Se a idade do modelo atualmente implantado for mais antiga do que o conjunto de dados mais recente em um determinado limite, digamos 7 dias, a máquina de estado do Step Functions inicia o pipeline do SageMaker que treina, testa e implanta um novo endpoint de inferência. Se os modelos ainda estiverem atualizados, o fluxo de trabalho pula o pipeline de ML e segue para a etapa de geração de lances. Independentemente do estado do modelo, uma nova curva de lance é gerada após a entrega de um novo conjunto de dados por hora. O diagrama a seguir ilustra esse fluxo de trabalho. Por padrão, o StartPipelineExecution ação é assíncrona. Podemos fazer com que a máquina de estado aguarde o final do pipeline antes de invocar a etapa de geração de lances usando o 'Aguardar retorno de chamada'opção.

Para reduzir o custo e o tempo de lançamento no mercado na criação de uma solução piloto, a Marubeni usou Inferência sem servidor do Amazon SageMaker. Isso garante que a infraestrutura subjacente usada para treinamento e implantação seja cobrada apenas quando necessário. Isso também facilita o processo de construção do pipeline porque os desenvolvedores não precisam mais gerenciar a infraestrutura. Essa é uma ótima opção para cargas de trabalho que possuem períodos ociosos entre surtos de tráfego. À medida que a solução amadurece e passa para a produção, a Marubeni revisará seu design e adotará uma configuração mais adequada para uso previsível e estável.

Geração de lances e consulta de dados

A função do Lambda de geração de lances chama periodicamente o endpoint de inferência para gerar previsões por hora e armazena a saída no Amazon S3.

Os desenvolvedores e analistas de negócios podem explorar os dados usando o Athena e o Microsoft Power BI para visualização. Os dados também podem ser disponibilizados via API para aplicativos de negócios downstream. Na fase piloto, as operadoras consultam visualmente a curva de oferta para apoiar suas atividades de transação de energia nos mercados. No entanto, a Marubeni está pensando em automatizar esse processo no futuro, e esta solução fornece as bases necessárias para isso.

Conclusão

Essa solução permitiu que a Marubeni automatizasse totalmente o processamento de dados e os pipelines de ingestão, bem como reduzisse o tempo de implantação dos modelos preditivos e de otimização de horas para minutos. As curvas de lances agora são geradas automaticamente e mantidas atualizadas à medida que as condições do mercado mudam. Eles também perceberam uma redução de custo de 80% ao mudar de um endpoint de inferência provisionado para um endpoint sem servidor.

A solução de previsão da MPII é uma das recentes iniciativas de transformação digital que a Marubeni Corporation está lançando no setor de energia. A MPII planeja criar soluções digitais adicionais para dar suporte a novas plataformas de negócios de energia. A MPII pode contar com os serviços da AWS para dar suporte à sua estratégia de transformação digital em muitos casos de uso.

"Podemos nos concentrar no gerenciamento da cadeia de valor para novas plataformas de negócios, sabendo que a AWS está gerenciando a infraestrutura digital subjacente de nossas soluções."

– Hernan Figueroa, gerente sênior de ciência de dados da Marubeni Power International.

Para obter mais informações sobre como a AWS está ajudando organizações de energia em suas iniciativas de transformação digital e sustentabilidade, consulte Energia AWS.

![]() A Marubeni Power International é uma subsidiária da Marubeni Corporation. A Marubeni Corporation é um importante conglomerado japonês de comércio e investimentos. A missão da Marubeni Power International é desenvolver novas plataformas de negócios, avaliar novas tendências e tecnologias de energia e gerenciar o portfólio de energia da Marubeni nas Américas. Se você gostaria de saber mais sobre Marubeni Power, confira https://www.marubeni-power.com/.

A Marubeni Power International é uma subsidiária da Marubeni Corporation. A Marubeni Corporation é um importante conglomerado japonês de comércio e investimentos. A missão da Marubeni Power International é desenvolver novas plataformas de negócios, avaliar novas tendências e tecnologias de energia e gerenciar o portfólio de energia da Marubeni nas Américas. Se você gostaria de saber mais sobre Marubeni Power, confira https://www.marubeni-power.com/.

Sobre os autores

Hernán Figueroa lidera as iniciativas de transformação digital na Marubeni Power International. Sua equipe aplica ciência de dados e tecnologias digitais para apoiar as estratégias de crescimento da Marubeni Power. Antes de ingressar na Marubeni, Hernan era Cientista de Dados na Universidade de Columbia. Ele possui um Ph.D. em Engenharia Elétrica e Bacharel em Engenharia da Computação.

Hernán Figueroa lidera as iniciativas de transformação digital na Marubeni Power International. Sua equipe aplica ciência de dados e tecnologias digitais para apoiar as estratégias de crescimento da Marubeni Power. Antes de ingressar na Marubeni, Hernan era Cientista de Dados na Universidade de Columbia. Ele possui um Ph.D. em Engenharia Elétrica e Bacharel em Engenharia da Computação.

Lino Bréscia é um executivo de contas principal baseado em NYC. Ele tem mais de 25 anos de experiência em tecnologia e ingressou na AWS em 2018. Ele gerencia clientes corporativos globais conforme eles transformam seus negócios com os serviços de nuvem da AWS e realizam migrações em grande escala.

Lino Bréscia é um executivo de contas principal baseado em NYC. Ele tem mais de 25 anos de experiência em tecnologia e ingressou na AWS em 2018. Ele gerencia clientes corporativos globais conforme eles transformam seus negócios com os serviços de nuvem da AWS e realizam migrações em grande escala.

Narcisse Zekpa é Arquiteto de Soluções Sênior baseado em Boston. Ele ajuda os clientes no nordeste dos EUA a acelerar a transformação de seus negócios por meio de soluções inovadoras e escaláveis na Nuvem AWS. Quando Narcisse não está construindo, ele gosta de passar o tempo com sua família, viajar, cozinhar, jogar basquete e correr.

Narcisse Zekpa é Arquiteto de Soluções Sênior baseado em Boston. Ele ajuda os clientes no nordeste dos EUA a acelerar a transformação de seus negócios por meio de soluções inovadoras e escaláveis na Nuvem AWS. Quando Narcisse não está construindo, ele gosta de passar o tempo com sua família, viajar, cozinhar, jogar basquete e correr.

Pedram Jahangiri é arquiteto de soluções corporativas da AWS, com doutorado em engenharia elétrica. Ele tem mais de 10 anos de experiência na indústria de energia e TI. Pedram tem muitos anos de experiência prática em todos os aspectos da análise avançada para criar soluções quantitativas e de grande escala para empresas, aproveitando as tecnologias de nuvem.

Pedram Jahangiri é arquiteto de soluções corporativas da AWS, com doutorado em engenharia elétrica. Ele tem mais de 10 anos de experiência na indústria de energia e TI. Pedram tem muitos anos de experiência prática em todos os aspectos da análise avançada para criar soluções quantitativas e de grande escala para empresas, aproveitando as tecnologias de nuvem.

Sarah Childers é um gerente de contas baseado em Washington DC. Ela é uma ex-educadora de ciências que se tornou entusiasta da nuvem, focada em oferecer suporte aos clientes em sua jornada na nuvem. Sarah gosta de trabalhar ao lado de uma equipe motivada que incentiva ideias diversificadas para melhor equipar os clientes com as soluções mais inovadoras e abrangentes.

Sarah Childers é um gerente de contas baseado em Washington DC. Ela é uma ex-educadora de ciências que se tornou entusiasta da nuvem, focada em oferecer suporte aos clientes em sua jornada na nuvem. Sarah gosta de trabalhar ao lado de uma equipe motivada que incentiva ideias diversificadas para melhor equipar os clientes com as soluções mais inovadoras e abrangentes.

- Conteúdo com tecnologia de SEO e distribuição de relações públicas. Seja amplificado hoje.

- Platoblockchain. Inteligência Metaverso Web3. Conhecimento Ampliado. Acesse aqui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/how-marubeni-is-optimizing-market-decisions-using-aws-machine-learning-and-analytics/

- :é

- $UP

- 1

- 10

- 100

- 2018

- 7

- 8

- a

- Capaz

- Sobre

- acelerar

- Acesso

- acessadas

- Conta

- Alcançar

- em

- Açao Social

- atividades

- Adicional

- endereço

- adotar

- avançar

- avançado

- Vantagem

- algoritmos

- Todos os Produtos

- alocação

- ao lado de

- Amazon

- Amazon Sage Maker

- Américas

- quantidade

- análise

- Analistas

- analítica

- e

- Angeles

- api

- APIs

- aplicações

- arquitetura

- SOMOS

- chegada

- AS

- aspectos

- ativo

- gestão de activos

- Ativos

- At

- aumentado

- Autenticação

- automatizar

- automaticamente

- automatizando

- disponível

- média

- AWS

- AWS Lambda

- Aprendizado de máquina da AWS

- Equilíbrio

- base

- baseado

- Linha de Base

- base

- Basquetebol

- BE

- Porque

- tornam-se

- antes

- ser

- MELHOR

- entre

- oferta

- Blocos

- Boston

- amplo

- construir

- Prédio

- negócio

- Aplicações de Negócio

- Transformação de negócios

- Comprar

- by

- Califórnia

- chamada

- chamado

- chamada

- chamadas

- CAN

- não podes

- capacidades

- capaz

- carbono

- casas

- casos

- certo

- cadeia

- alterar

- mudança

- personagem

- acusações

- verificar

- Na nuvem

- serviços na nuvem

- coleção

- Columbia

- combinações

- combinando

- comum

- completar

- componentes

- compreensivo

- computador

- Engenharia computacional

- condições

- Configuração

- conglomerado

- conecta

- Considerar

- considerando

- consolidar

- constantemente

- restrições

- construir

- consumida

- consumo

- continuamente

- cozinha

- CORPORAÇÃO

- Custo

- redução de custos

- relação custo-benefício

- cobrir

- cobertura

- crítico

- referência cruzada

- comissariada

- Atual

- Atualmente

- curva

- Clientes

- personalizar

- dados,

- lago data

- Preparação de dados

- informática

- ciência de dados

- cientista de dados

- armazenamento de dados

- orientado por dados

- conjuntos de dados

- Data

- dia

- dc

- Tomada de Decisão

- decisões

- Padrão

- Entrega

- Demanda

- implantar

- implantado

- Implantação

- desenvolvimento

- Implantações

- implanta

- descrito

- descrição

- Design

- detalhe

- detalhes

- desenvolver

- desenvolvedores

- diferente

- digital

- Transformação Digital

- discutir

- díspar

- diversificado

- durante

- dinâmico

- cada

- Mais cedo

- mais fácil

- fácil

- Elétrico

- Engenharia elétrica

- eletricidade

- permitir

- habilitado

- permite

- encorajar

- Ponto final

- energia

- Motor

- Engenharia

- garantir

- garante

- Empreendimento

- clientes corporativos

- empresas

- entusiasta

- Meio Ambiente

- ambientes

- Equivalente

- Éter (ETH)

- eventos

- Cada

- exemplo

- exclusivamente

- executivo

- esperado

- vasta experiência

- explorar

- externo

- família

- Buscou

- Figura

- Envie o

- Arquivos

- final

- Foco

- focado

- seguinte

- Escolha

- Previsão

- Antigo

- Fundações

- QUADRO

- recentes

- da

- totalmente

- função

- funcionalidade

- funções

- mais distante

- futuro

- gerar

- gerado

- gera

- geração

- Global

- Go

- ótimo

- Grade

- Growth

- mãos em

- Ter

- ajuda

- ajuda

- detém

- HORÁRIO

- Como funciona o dobrador de carta de canal

- Como Negociar

- Contudo

- HTML

- HTTPS

- idéias

- inativo

- executar

- implementação

- implementa

- importante

- in

- incluir

- incluído

- inclui

- Entrada

- Crescimento

- de treinadores em Entrevista Motivacional

- indústria

- INFORMAÇÕES

- Infraestrutura

- iniciativas

- inovadores

- entrada

- interno

- Internacionais

- Interoperabilidade

- investimento

- Investe

- invoca

- envolvido

- IT

- Setor de TI

- ESTÁ

- Japonês

- Empregos

- ingressou

- juntando

- viagem

- jpg

- json

- Kicks

- Saber

- Conhecimento

- lago

- em grande escala

- mais recente

- de lançamento

- camada

- camadas

- Leads

- APRENDER

- aprendizagem

- aproveitando

- bibliotecas

- wifecycwe

- como

- limites

- carregar

- cargas

- longo

- mais

- os

- Los Angeles

- fora

- máquina

- aprendizado de máquina

- máquinas

- moldadas

- a manter

- principal

- FAZ

- gerencia

- de grupos

- Gerente

- gestão

- gestão

- Manipulação

- muitos

- mercado

- condições de mercado

- Mercados

- amadurece

- Maximizar

- mecanismo

- Memória

- Microsoft

- minimizar

- minutos

- Missão

- ML

- Moda

- modelo

- modelagem

- modelos

- modificada

- mais

- a maioria

- motivados

- movimentos

- múltiplo

- Perto

- necessário

- você merece...

- necessário

- Cria

- Novo

- Próximo

- nó

- número

- NYC

- objetivo

- obter

- of

- oferecido

- Office

- on

- ONE

- opera

- operando

- operação

- operacional

- operador

- operadores

- ideal

- otimização

- otimizado

- otimizando

- Opção

- organizações

- Outros

- saída

- possui

- Paralelo

- parte

- participantes

- participação

- passado

- percebido

- realizar

- atuação

- períodos

- fase

- piloto

- oleoduto

- planos

- Plataformas

- platão

- Inteligência de Dados Platão

- PlatãoData

- Jogar

- jogar

- pasta

- Publique

- poder

- Power BI

- Fonte de alimentação do laboratório

- Previsível

- previsto

- prevendo

- predição

- Previsões

- Previsões

- Preparar

- apresentado

- preço

- previsão de preço

- Valores

- Diretor

- Prévio

- problemas

- processo

- processos

- em processamento

- Produção

- rentabilidade

- lucros

- proprietário

- fornecer

- fornece

- Publicação

- Publica

- qualidade

- quantitativo

- pronto

- em tempo real

- realizado

- recebido

- recentemente

- registro

- reduzir

- Independentemente

- confiabilidade

- depender

- Renováveis

- energia renovável

- representa

- requeridos

- exige

- aqueles

- resposta

- responsável

- responsivo

- Resultados

- reciclagem

- receita

- rever

- Risco

- uma conta de despesas robusta

- Tipo

- papéis

- Regra

- Execute

- corrida

- s

- sábio

- mesmo

- escalável

- cronograma

- Ciência

- Cientista

- Seção

- seções

- setor

- Vender

- servir

- Serverless

- Serviços

- conjunto

- Partilhar

- assistência técnica de curto e longo prazo

- rede de apoio social

- Shows

- simples

- simultaneamente

- solteiro

- So

- solução

- Soluções

- alguns

- Em breve

- fonte

- Fontes

- Origem

- específico

- velocidades

- Passar

- SQL

- padrão

- Estado

- estável

- Passo

- Passos

- Ainda

- armazenamento

- loja

- armazenadas

- lojas

- estratégias

- Estratégia

- força

- enviar

- apresentado

- subsidiário

- tal

- supply

- Oferta e procura

- ajuda

- Apoiar

- suportes

- Sustentabilidade

- .

- mesa

- Tire

- Profissionais

- técnicas

- Tecnologias

- Equipar

- fluxo tensor

- teste

- testes

- que

- A

- O Futuro

- O Estado

- deles

- assim sendo

- Este

- Através da

- tempo

- timestamp

- para

- Trading

- tráfego

- Trem

- Training

- trens

- transação

- Transformar

- Transformação

- Estratégia de Transformação

- transições

- Viagens

- Tendências

- desencadear

- Virado

- tipos

- nos

- subjacente

- universidade

- Atualizações

- Dados Upstream

- us

- Uso

- usar

- caso de uso

- valor

- vário

- versão

- via

- visualização

- esperar

- Washington

- Washington DC

- Caminho..

- Clima

- BEM

- qual

- precisarão

- Boa vontade

- com

- dentro

- de gestão de documentos

- trabalhar

- seria

- anos

- zefirnet