Este post foi coescrito por Ramdev Wudali e Kiran Mantripragada da Thomson Reuters.

Em 1992, Thomson Reuters (TR) lançou seu primeiro serviço de pesquisa legal de IA, WIN (Westlaw Is Natural), uma inovação na época, já que a maioria dos mecanismos de pesquisa suportava apenas termos e conectores booleanos. Desde então, a TR alcançou muitos outros marcos, pois seus produtos e serviços de IA estão crescendo continuamente em número e variedade, apoiando profissionais jurídicos, tributários, contábeis, de conformidade e de serviços de notícias em todo o mundo, com bilhões de insights de aprendizado de máquina (ML) gerados todos os anos .

Com esse tremendo aumento de serviços de IA, o próximo marco para a TR foi simplificar a inovação e facilitar a colaboração. Padronize a criação e a reutilização de soluções de IA nas funções de negócios e nas personas dos profissionais de IA, garantindo a adesão às práticas recomendadas da empresa:

- Automatize e padronize o esforço repetitivo e indiferenciado de engenharia

- Garanta o isolamento e o controle necessários de dados confidenciais de acordo com padrões comuns de governança

- Forneça acesso fácil a recursos de computação escaláveis

Para atender a esses requisitos, a TR construiu a plataforma Enterprise AI em torno dos cinco pilares a seguir: serviço de dados, espaço de trabalho de experimentação, registro de modelo central, serviço de implantação de modelo e monitoramento de modelo.

Nesta postagem, discutimos como a TR e a AWS colaboraram para desenvolver a primeira Enterprise AI Platform da TR, uma ferramenta baseada na Web que forneceria recursos que variam de experimentação de ML, treinamento, registro de modelo central, implantação de modelo e monitoramento de modelo. Todos esses recursos são criados para atender aos padrões de segurança em constante evolução da TR e fornecer serviços simples, seguros e compatíveis aos usuários finais. Também compartilhamos como o TR habilitou o monitoramento e a governança para modelos de ML criados em diferentes unidades de negócios com um único painel de controle.

Os desafios

Historicamente, na TR, o ML tem sido um recurso para equipes com engenheiros e cientistas de dados avançados. As equipes com recursos altamente qualificados foram capazes de implementar processos complexos de ML de acordo com suas necessidades, mas rapidamente ficaram muito isoladas. Abordagens isoladas não forneciam nenhuma visibilidade para fornecer governança em previsões de tomada de decisão extremamente críticas.

As equipes de negócios da TR possuem vasto conhecimento de domínio; no entanto, as habilidades técnicas e o esforço pesado de engenharia exigidos no ML dificultam o uso de sua profunda experiência para resolver problemas de negócios com o poder do ML. A TR quer democratizar as competências, tornando-as acessíveis a mais pessoas dentro da organização.

Diferentes equipes em TR seguem suas próprias práticas e metodologias. A TR deseja desenvolver os recursos que abrangem o ciclo de vida do ML para seus usuários para acelerar a entrega de projetos de ML, permitindo que as equipes se concentrem nas metas de negócios e não no esforço repetitivo e indiferenciado de engenharia.

Além disso, os regulamentos sobre dados e IA ética continuam a evoluir, exigindo padrões de governança comuns nas soluções de IA da TR.

Visão geral da solução

A Enterprise AI Platform da TR foi concebida para fornecer serviços simples e padronizados para diferentes personas, oferecendo recursos para cada estágio do ciclo de vida do ML. A TR identificou cinco categorias principais que modularizam todos os requisitos da TR:

- Serviço de dados – Para permitir acesso fácil e seguro aos ativos de dados corporativos

- Espaço de trabalho de experimentação – Para fornecer recursos para experimentar e treinar modelos de ML

- Registro de modelo central – Um catálogo corporativo para modelos criados em diferentes unidades de negócios

- Serviço de implantação de modelo – Para fornecer várias opções de implantação de inferência seguindo as práticas corporativas de CI/CD da TR

- Serviços de monitoramento de modelo – Para fornecer recursos para monitorar dados e viés e desvios de modelo

Conforme mostrado no diagrama a seguir, esses microsserviços são criados com alguns princípios-chave em mente:

- Remova o esforço indiferenciado de engenharia dos usuários

- Forneça os recursos necessários com o clique de um botão

- Proteja e controle todos os recursos de acordo com os padrões corporativos da TR

- Traga um único painel de vidro para atividades de ML

Os microsserviços AI Platform da TR são construídos com Amazon Sage Maker como o mecanismo principal, componentes sem servidor da AWS para fluxos de trabalho e serviços AWS DevOps para práticas de CI/CD. Estúdio SageMaker é usado para experimentação e treinamento, e o registro de modelo do SageMaker é usado para registrar modelos. O registro de modelo central é composto pelo registro de modelo do SageMaker e por um Amazon DynamoDB tabela. Serviços de alojamento SageMaker são usados para implantar modelos, enquanto Monitor de modelo SageMaker e SageMaker Esclarecer são usados para monitorar modelos de desvio, viés, calculadoras de métricas personalizadas e explicabilidade.

As seções a seguir descrevem esses serviços em detalhes.

Serviço de dados

Um ciclo de vida de projeto de ML tradicional começa com a localização de dados. Em geral, os cientistas de dados gastam 60% ou mais de seu tempo para encontrar os dados certos quando precisam. Assim como toda organização, o TR possui vários armazenamentos de dados que servem como um único ponto de verdade para diferentes domínios de dados. A TR identificou dois principais armazenamentos de dados corporativos que fornecem dados para a maioria de seus casos de uso de ML: um armazenamento de objeto e um armazenamento de dados relacional. A TR criou um serviço de dados AI Platform para fornecer acesso contínuo a ambos os armazenamentos de dados dos espaços de trabalho de experimentação dos usuários e remover o fardo dos usuários de navegar por processos complexos para adquirir dados por conta própria. A AI Platform da TR segue todas as conformidades e melhores práticas definidas pela equipe de Data and Model Governance. Isso inclui uma avaliação de impacto de dados obrigatória que ajuda os profissionais de ML a entender e seguir o uso ético e apropriado de dados, com processos formais de aprovação para garantir o acesso apropriado aos dados. O cerne deste serviço, assim como de todos os serviços da plataforma, é a segurança e conformidade de acordo com as melhores práticas determinadas pela TR e pela indústria.

Serviço de armazenamento simples da Amazon (Amazon S3) o armazenamento de objetos atua como um data lake de conteúdo. A TR criou processos para acessar com segurança os dados do data lake de conteúdo para os espaços de trabalho de experimentação dos usuários, mantendo a autorização e auditabilidade necessárias. O Snowflake é usado como o armazenamento de dados primário relacional da empresa. Mediante solicitação do usuário e com base na aprovação do proprietário dos dados, o serviço de dados AI Platform fornece um instantâneo dos dados para o usuário prontamente disponível em seu espaço de trabalho de experimentação.

Acessar dados de várias fontes é um problema técnico que pode ser facilmente resolvido. Mas a complexidade que o TR resolveu é criar fluxos de trabalho de aprovação que automatizam a identificação do proprietário dos dados, enviando uma solicitação de acesso, certificando-se de que o proprietário dos dados seja notificado de que possui uma solicitação de acesso pendente e, com base no status de aprovação, tome medidas para fornecer dados para o solicitante. Todos os eventos ao longo deste processo são rastreados e registrados para auditabilidade e conformidade.

Como mostrado no diagrama a seguir, TR usa Funções de etapa da AWS para orquestrar o fluxo de trabalho e AWS Lambda para executar a funcionalidade. Gateway de API da Amazon é usado para expor a funcionalidade com um endpoint de API a ser consumido em seu portal da web.

Experimentação e desenvolvimento de modelos

Um recurso essencial para padronizar o ciclo de vida de ML é um ambiente que permite aos cientistas de dados experimentar diferentes estruturas e tamanhos de dados de ML. Habilitar um ambiente tão seguro e compatível na nuvem em poucos minutos alivia os cientistas de dados do fardo de lidar com infraestrutura de nuvem, requisitos de rede e medidas de padrões de segurança, para se concentrar no problema da ciência de dados.

TR constrói um espaço de trabalho de experimentação que oferece acesso a serviços como Cola AWS, Amazon EMR, e o SageMaker Studio para habilitar o processamento de dados e recursos de ML aderindo aos padrões de segurança da nuvem corporativa e isolamento de conta exigido para cada unidade de negócios. A TR encontrou os seguintes desafios durante a implementação da solução:

- A orquestração inicial não era totalmente automatizada e envolvia várias etapas manuais. Rastrear onde os problemas estavam ocorrendo não foi fácil. O TR superou esse erro orquestrando os fluxos de trabalho usando o Step Functions. Com o uso do Step Functions, criar fluxos de trabalho complexos, gerenciar estados e lidar com erros ficou muito mais fácil.

- Adequado Gerenciamento de acesso e identidade da AWS A definição de função (IAM) para o espaço de trabalho de experimentação era difícil de definir. Para cumprir os padrões de segurança interna e o modelo de privilégio mínimo da TR, originalmente, a função do espaço de trabalho foi definida com políticas em linha. Consequentemente, a política em linha cresceu com o tempo e tornou-se detalhada, excedendo o limite de tamanho da política permitido para a função IAM. Para mitigar isso, a TR passou a usar mais políticas gerenciadas pelo cliente e a fazer referência a elas na definição da função do espaço de trabalho.

- TR ocasionalmente atingiu os limites de recursos padrão aplicados no nível da conta da AWS. Isso causava falhas ocasionais ao iniciar trabalhos do SageMaker (por exemplo, trabalhos de treinamento) devido ao limite de tipo de recurso desejado atingido. A TR trabalhou em estreita colaboração com a equipe de serviço da SageMaker nessa questão. Esse problema foi resolvido depois que a equipe da AWS lançou o SageMaker como um serviço compatível em Cotas de serviço em junho 2022.

Hoje, os cientistas de dados da TR podem iniciar um projeto de ML criando um espaço de trabalho independente e adicionando os membros da equipe necessários para colaborar. A escala ilimitada oferecida pelo SageMaker está ao seu alcance, fornecendo imagens de kernel personalizadas com tamanhos variados. O SageMaker Studio rapidamente se tornou um componente crucial na AI Platform da TR e mudou o comportamento do usuário de usar aplicativos de desktop restritos para mecanismos escaláveis e efêmeros criados para fins específicos. O diagrama a seguir ilustra essa arquitetura.

Registro de modelo central

O registro de modelo fornece um repositório central para todos os modelos de aprendizado de máquina da TR, permite o gerenciamento de risco e integridade de maneira padronizada em todas as funções de negócios e simplifica a possível reutilização de modelos. Portanto, o serviço precisava fazer o seguinte:

- Forneça a capacidade de registrar modelos novos e legados, desenvolvidos dentro ou fora do SageMaker

- Implemente fluxos de trabalho de governança, permitindo que cientistas de dados, desenvolvedores e partes interessadas visualizem e gerenciem coletivamente o ciclo de vida dos modelos

- Aumente a transparência e a colaboração criando uma visão centralizada de todos os modelos em TR juntamente com metadados e métricas de integridade

TR iniciou o projeto apenas com o registro de modelo do SageMaker, mas um dos principais requisitos do TR é fornecer a capacidade de registrar modelos criados fora do SageMaker. TR avaliou diferentes bancos de dados relacionais, mas acabou escolhendo o DynamoDB porque o esquema de metadados para modelos provenientes de fontes legadas será muito diferente. A TR também não queria impor nenhum trabalho adicional aos usuários, então eles implementaram uma sincronização automática perfeita entre os registros do SageMaker do espaço de trabalho AI Platform para o registro central do SageMaker usando Amazon Event Bridge regras e funções do IAM necessárias. A TR aprimorou o registro central com o DynamoDB para estender os recursos de registro de modelos herdados que foram criados nos desktops dos usuários.

O registro de modelo central AI Platform da TR está integrado ao portal AI Platform e fornece uma interface visual para pesquisar modelos, atualizar metadados de modelo e entender as métricas de linha de base do modelo e métricas de monitoramento personalizado periódicas. O diagrama a seguir ilustra essa arquitetura.

Implantação de modelo

A TR identificou dois padrões principais para automatizar a implantação:

- Modelos desenvolvidos usando SageMaker por meio de trabalhos de transformação em lote do SageMaker para obter inferências em um cronograma preferido

- Modelos desenvolvidos fora do SageMaker em desktops locais usando bibliotecas de código aberto, por meio da abordagem traga seu próprio contêiner usando trabalhos de processamento do SageMaker para executar código de inferência personalizado, como uma maneira eficiente de migrar esses modelos sem refatorar o código

Com o serviço de implantação AI Platform, os usuários TR (cientistas de dados e engenheiros de ML) podem identificar um modelo do catálogo e implantar um trabalho de inferência em sua conta da AWS escolhida, fornecendo os parâmetros necessários por meio de um fluxo de trabalho orientado à interface do usuário.

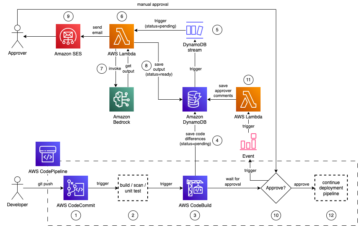

TR automatizou esta implantação usando serviços AWS DevOps como AWS Code Pipeline e AWS CodeBuild. O TR usa o Step Functions para orquestrar o fluxo de trabalho de leitura e pré-processamento de dados para criar trabalhos de inferência do SageMaker. TR implanta os componentes necessários como código usando Formação da Nuvem AWS modelos. O diagrama a seguir ilustra essa arquitetura.

Monitoramento de modelo

O ciclo de vida do ML não está completo sem a capacidade de monitorar os modelos. A equipe de governança corporativa da TR também exige e incentiva as equipes de negócios a monitorar o desempenho de seu modelo ao longo do tempo para enfrentar quaisquer desafios regulatórios. O TR começou com modelos de monitoramento e dados para deriva. A TR usou o SageMaker Model Monitor para fornecer uma linha de base de dados e informações básicas de inferência para monitorar periodicamente como os dados e as inferências da TR estão se desviando. Juntamente com as métricas de monitoramento do modelo SageMaker, a TR aprimorou a capacidade de monitoramento desenvolvendo métricas personalizadas específicas para seus modelos. Isso ajudará os cientistas de dados da TR a entender quando treinar novamente seu modelo.

Juntamente com o monitoramento de desvios, o TR também quer entender o viés nos modelos. Os recursos prontos para uso do SageMaker Clarify são usados para criar o serviço de viés do TR. A TR monitora o viés de dados e modelos e disponibiliza essas métricas para seus usuários por meio do portal AI Platform.

Para ajudar todas as equipes a adotar esses padrões corporativos, a TR tornou esses serviços independentes e prontamente disponíveis por meio do portal AI Platform. As equipes de negócios da TR podem entrar no portal e implantar um trabalho de monitoramento de modelo ou um trabalho de monitoramento de polarização por conta própria e executá-los em seu cronograma preferido. Eles são notificados sobre o status do trabalho e as métricas de cada execução.

A TR usou os serviços da AWS para implantação de CI/CD, orquestração de fluxo de trabalho, estruturas sem servidor e endpoints de API para criar microsserviços que podem ser acionados independentemente, conforme mostrado na arquitetura a seguir.

Resultados e melhorias futuras

A AI Platform da TR foi lançada no terceiro trimestre de 3 com todos os cinco componentes principais: um serviço de dados, espaço de trabalho de experimentação, registro de modelo central, implantação de modelo e monitoramento de modelo. A TR realizou sessões internas de treinamento para suas unidades de negócios para integrar a plataforma e ofereceu-lhes vídeos de treinamento autoguiados.

A AI Platform forneceu recursos para as equipes da TR que nunca existiram antes; ele abriu uma ampla gama de possibilidades para a equipe de governança corporativa da TR aprimorar os padrões de conformidade e centralizar o registro, fornecendo um painel único de visualização de todos os modelos de ML dentro da TR.

TR reconhece que nenhum produto está no seu melhor no lançamento inicial. Todos os componentes da TR estão em diferentes níveis de maturidade, e a equipe Enterprise AI Platform da TR está em uma fase de aprimoramento contínuo para melhorar iterativamente os recursos do produto. O pipeline de avanço atual do TR inclui a adição de opções adicionais de inferência do SageMaker, como terminais em tempo real, assíncronos e multimodelos. A TR também está planejando adicionar a explicabilidade do modelo como um recurso ao seu serviço de monitoramento de modelos. A TR planeja usar os recursos de explicabilidade do SageMaker Clarify para desenvolver seu serviço interno de explicabilidade.

Conclusão

A TR agora pode processar grandes quantidades de dados com segurança e usar recursos avançados da AWS para levar um projeto de ML da concepção à produção em poucas semanas, em comparação com os meses anteriores. Com os recursos prontos para uso dos serviços da AWS, as equipes da TR podem registrar e monitorar modelos de ML pela primeira vez, obtendo conformidade com seus padrões de governança de modelo em evolução. A TR capacitou cientistas de dados e equipes de produtos para liberar efetivamente sua criatividade para resolver os problemas mais complexos.

Para saber mais sobre a Enterprise AI Platform da TR na AWS, confira o Sessão AWS re:Invent 2022. Se você quiser saber como o TR acelerou o uso do aprendizado de máquina usando o Laboratório de dados da AWS programa, consulte o estudo de caso.

Sobre os autores

Ramdev Wudali é arquiteto de dados, ajudando a arquitetar e construir a plataforma AI/ML para permitir que cientistas e pesquisadores de dados desenvolvam soluções de aprendizado de máquina com foco na ciência de dados e não nas necessidades de infraestrutura. Nas horas vagas, adora dobrar papel para criar mosaicos de origami e usar camisetas irreverentes.

Ramdev Wudali é arquiteto de dados, ajudando a arquitetar e construir a plataforma AI/ML para permitir que cientistas e pesquisadores de dados desenvolvam soluções de aprendizado de máquina com foco na ciência de dados e não nas necessidades de infraestrutura. Nas horas vagas, adora dobrar papel para criar mosaicos de origami e usar camisetas irreverentes.

Kiran Mantripragada é o diretor sênior de AI Platform da Thomson Reuters. A equipe AI Platform é responsável por habilitar aplicativos de software de IA de nível de produção e permitir o trabalho de cientistas de dados e pesquisadores de aprendizado de máquina. Apaixonado por ciência, IA e engenharia, Kiran gosta de preencher a lacuna entre pesquisa e produção para levar a inovação real da IA aos consumidores finais.

Kiran Mantripragada é o diretor sênior de AI Platform da Thomson Reuters. A equipe AI Platform é responsável por habilitar aplicativos de software de IA de nível de produção e permitir o trabalho de cientistas de dados e pesquisadores de aprendizado de máquina. Apaixonado por ciência, IA e engenharia, Kiran gosta de preencher a lacuna entre pesquisa e produção para levar a inovação real da IA aos consumidores finais.

Bhavana Chirumamilla é arquiteto residente sênior da AWS. Ela é apaixonada por operações de dados e ML e traz muito entusiasmo para ajudar as empresas a criar estratégias de dados e ML. Em seu tempo livre, ela gosta de viajar com sua família, fazer caminhadas, cuidar do jardim e assistir a documentários.

Bhavana Chirumamilla é arquiteto residente sênior da AWS. Ela é apaixonada por operações de dados e ML e traz muito entusiasmo para ajudar as empresas a criar estratégias de dados e ML. Em seu tempo livre, ela gosta de viajar com sua família, fazer caminhadas, cuidar do jardim e assistir a documentários.

Srinivasa Shaik é Arquiteto de Soluções da AWS com sede em Boston. Ele ajuda os clientes corporativos a acelerar sua jornada para a nuvem. Ele é apaixonado por contêineres e tecnologias de aprendizado de máquina. Nas horas vagas, gosta de passar o tempo com a família, cozinhar e viajar.

Srinivasa Shaik é Arquiteto de Soluções da AWS com sede em Boston. Ele ajuda os clientes corporativos a acelerar sua jornada para a nuvem. Ele é apaixonado por contêineres e tecnologias de aprendizado de máquina. Nas horas vagas, gosta de passar o tempo com a família, cozinhar e viajar.

Qingwei Li é especialista em aprendizado de máquina na Amazon Web Services. Ele recebeu seu PhD em Pesquisa Operacional depois de quebrar a conta de bolsa de pesquisa de seu orientador e não entregar o Prêmio Nobel que prometeu. Atualmente, ele ajuda os clientes do setor de seguros e serviços financeiros a criar soluções de aprendizado de máquina na AWS. Nas horas vagas, gosta de ler e ensinar.

Qingwei Li é especialista em aprendizado de máquina na Amazon Web Services. Ele recebeu seu PhD em Pesquisa Operacional depois de quebrar a conta de bolsa de pesquisa de seu orientador e não entregar o Prêmio Nobel que prometeu. Atualmente, ele ajuda os clientes do setor de seguros e serviços financeiros a criar soluções de aprendizado de máquina na AWS. Nas horas vagas, gosta de ler e ensinar.

- Conteúdo com tecnologia de SEO e distribuição de relações públicas. Seja amplificado hoje.

- Platoblockchain. Inteligência Metaverso Web3. Conhecimento Ampliado. Acesse aqui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/how-thomson-reuters-built-an-ai-platform-using-amazon-sagemaker-to-accelerate-delivery-of-ml-projects/

- 100

- 2022

- a

- Capaz

- Sobre

- acelerar

- acelerado

- Acesso

- acessível

- Segundo

- Conta

- Contabilidade

- alcançado

- adquirir

- em

- Açao Social

- atos

- Adicional

- endereço

- adotar

- avançado

- Depois de

- AI

- Plataforma de IA

- Serviços de IA

- AI / ML

- Todos os Produtos

- permite

- ao lado de

- Amazon

- Amazon Sage Maker

- Amazon Web Services

- quantidades

- e

- api

- aplicações

- aplicado

- abordagem

- se aproxima

- aprovação

- arquitetura

- por aí

- autorização

- automatizar

- Automatizado

- Automático

- disponível

- AWS

- baseado

- Linha de Base

- Porque

- antes

- ser

- MELHOR

- melhores práticas

- entre

- viés

- bilhões

- Boston

- PONTE

- trazer

- Traz

- Quebrou

- construir

- Prédio

- Constrói

- construído

- carga

- negócio

- funções empresariais

- capacidades

- casos

- catálogo

- Categorias

- causado

- central

- centralizada

- desafios

- verificar

- escolha

- escolhido

- de perto

- Na nuvem

- infraestrutura de nuvem

- Cloud Security

- código

- colaborar

- colaborou

- colaboração

- coletivamente

- vinda

- comum

- comparado

- completar

- integrações

- complexidade

- compliance

- compatível

- componente

- componentes

- Composto

- computação

- consumida

- Consumidores

- Recipiente

- Containers

- conteúdo

- continuar

- contínuo

- ao controle

- cozinha

- núcleo

- crio

- criado

- Criar

- criatividade

- crítico

- crucial

- Atual

- Atualmente

- personalizadas

- Clientes

- dados,

- lago data

- informática

- ciência de dados

- bases de dados

- Tomada de Decisão

- profundo

- profundo conhecimento

- Padrão

- entregar

- Entrega

- democratizar

- implantar

- desenvolvimento

- implanta

- descreve

- Design

- área de trabalho

- detalhe

- determinado

- desenvolver

- desenvolvido

- desenvolvedores

- em desenvolvimento

- Desenvolvimento

- DevOps

- diferente

- difícil

- Diretor

- discutir

- documentários

- domínio

- domínios

- down

- Cedo

- mais fácil

- facilmente

- efetivamente

- eficiente

- esforço

- habilitada

- permitir

- habilitado

- permite

- permitindo

- encorajar

- Ponto final

- Motor

- Engenharia

- Engenheiros

- Motores

- aprimorada

- garantir

- assegurando

- Empreendimento

- clientes corporativos

- empresas

- entusiasmo

- Meio Ambiente

- erro

- essencial

- Éter (ETH)

- considerações éticas

- avaliadas

- eventos

- SEMPRE

- evolui

- evolução

- exemplo

- experimentar

- experiência

- Explicação

- estender

- extremamente

- facilitar

- fracassado

- família

- Característica

- Funcionalidades

- poucos

- final

- financeiro

- Serviços financeiros

- Encontre

- descoberta

- Primeiro nome

- primeira vez

- Foco

- focando

- seguir

- seguinte

- segue

- formal

- enquadramentos

- da

- Cumprir

- totalmente

- funcionalidade

- funções

- futuro

- lacuna

- Geral

- gerado

- ter

- vidro

- Go

- Objetivos

- governo

- conceder

- Solo

- Crescente

- Manipulação

- Queijos duros

- Saúde

- ajudar

- ajuda

- ajuda

- altamente

- caminhadas

- hospedagem

- Como funciona o dobrador de carta de canal

- Contudo

- HTML

- HTTPS

- IAM

- identificado

- identificar

- identificar

- Dados de identificação:

- imagens

- Impacto

- executar

- implementado

- implementação

- impor

- melhorar

- in

- inclui

- Crescimento

- de treinadores em Entrevista Motivacional

- independentemente

- indústria

- Infraestrutura

- do estado inicial,

- Inovação

- insights

- em vez disso

- com seguro

- indústria de seguro

- integrado

- Interface

- interno

- envolvido

- isolamento

- emitem

- IT

- Trabalho

- Empregos

- viagem

- Chave

- Saber

- Conhecimento

- lago

- lançamento

- lançado

- de lançamento

- APRENDER

- aprendizagem

- Legado

- Legal

- Nível

- níveis

- bibliotecas

- LIMITE

- limites

- viver

- local

- máquina

- aprendizado de máquina

- moldadas

- principal

- FAZ

- Fazendo

- gerencia

- de grupos

- gestão

- mandatos

- maneira

- manual

- muitos

- maturidade

- medidas

- Membros

- metadados

- metodologias

- métrico

- Métrica

- microsserviços

- migrado

- marco miliário

- Milestones

- mente

- minutos

- Mitigar

- ML

- modelo

- modelos

- Monitore

- monitoração

- monitores

- mês

- mais

- a maioria

- múltiplo

- natural

- Navegar

- você merece...

- necessário

- Cria

- networking

- Novo

- notícias

- Próximo

- premio Nobel

- número

- objeto

- Armazenamento de objetos

- ocasional

- oferecido

- oferecendo treinamento para distância

- Oferece

- A bordo

- ONE

- open source

- aberto

- Operações

- Opções

- orquestração

- organização

- originalmente

- lado de fora

- próprio

- proprietário

- pão

- Papel

- parâmetros

- paixão

- apaixonado

- padrões

- Pessoas

- atuação

- periodicamente

- fase

- oleoduto

- planejamento

- planos

- plataforma

- platão

- Inteligência de Dados Platão

- PlatãoData

- ponto

- políticas

- Privacidade

- Portal

- possibilidades

- Publique

- potencial

- poder

- práticas

- Previsões

- preferido

- primário

- princípios

- prêmio

- Problema

- problemas

- processo

- processos

- em processamento

- Produto

- Produção

- Produtos

- Produtos e Serviços

- Agenda

- projeto

- projetos

- prometido

- fornecer

- fornecido

- fornece

- fornecendo

- Q3

- q3 2022

- rapidamente

- alcance

- variando

- RE

- alcançado

- Leitura

- reais

- em tempo real

- recebido

- cadastre-se

- registro

- regulamentos

- reguladores

- liberar

- liberado

- remover

- repositório

- solicitar

- requeridos

- Requisitos

- pesquisa

- pesquisadores

- recurso

- Recursos

- responsável

- Reuters

- Risco

- Tipo

- papéis

- regras

- Execute

- sábio

- Inferência do SageMaker

- escalável

- Escala

- cronograma

- Ciência

- cientistas

- desatado

- sem problemas

- Pesquisar

- Mecanismos de busca

- seções

- seguro

- Secured

- firmemente

- segurança

- envio

- senior

- sensível

- servir

- Serverless

- serviço

- Serviços

- sessões

- vários

- Partilhar

- mostrando

- simples

- desde

- solteiro

- Tamanho

- tamanhos

- hábil

- Habilidades

- Instantâneo

- So

- Software

- solução

- Soluções

- RESOLVER

- Fontes

- especialista

- específico

- gastar

- Passar

- Etapa

- partes interessadas

- padronização

- padrões

- começado

- começa

- Unidos

- Status

- Passo

- Passos

- armazenamento

- loja

- lojas

- estratégias

- simplificar

- estudo

- tal

- Suportado

- Apoiar

- comutado

- Sincronização

- mesa

- Tire

- imposto

- Ensino

- Profissionais

- equipes

- Dados Técnicos:

- habilidades técnicas

- Tecnologias

- modelos

- condições

- A

- deles

- assim sendo

- Thomson Reuters

- Através da

- todo

- tempo

- para

- ferramenta

- Rastreamento

- tradicional

- Trem

- Training

- Transformar

- Transparência

- Viagens

- tremendo

- desencadeado

- compreender

- unidade

- unidades

- soltar

- ilimitado

- Atualizar

- usar

- Utilizador

- usuários

- variedade

- vário

- Grande

- via

- VÍDEOS

- Ver

- visibilidade

- assistindo

- web

- serviços web

- Web-Based

- semanas

- se

- enquanto

- Largo

- Ampla variedade

- precisarão

- ganhar

- dentro

- sem

- Atividades:

- trabalhou

- de gestão de documentos

- fluxos de trabalho

- no mundo todo

- seria

- ano

- investimentos

- zefirnet