Imagem por pch.vetor on Freepik

Machine Learning é um grande campo com novas pesquisas sendo lançadas com frequência. É um campo quente onde a academia e a indústria continuam experimentando coisas novas para melhorar nossas vidas diárias.

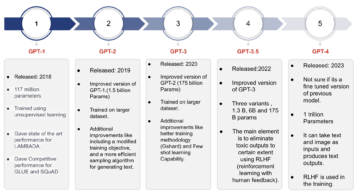

Nos últimos anos, a IA generativa vem mudando o mundo devido à aplicação do aprendizado de máquina. Por exemplo, ChatGPT e difusão estável. Mesmo com 2023 dominado pela IA generativa, devemos estar cientes de muitos outros avanços do aprendizado de máquina.

Aqui estão os principais artigos sobre aprendizado de máquina para ler em 2023, para que você não perca as próximas tendências.

1) Aprendendo a beleza das canções: embelezador de voz para canto neural

O embelezamento da voz cantada (SVB) é uma nova tarefa em IA generativa que visa melhorar a voz cantada amadora em uma bela. É exatamente o objetivo da pesquisa Liu et al. (2022) quando eles propuseram um novo modelo generativo chamado Neural Singing Voice Beautifier (NSVB).

O NSVB é um modelo de aprendizado semi-supervisionado que usa um algoritmo de mapeamento latente que atua como um corretor de pitch e melhora o tom vocal. O trabalho promete melhorar a indústria musical e vale a pena conferir.

2) Descoberta Simbólica de Algoritmos de Otimização

Os modelos de redes neurais profundas tornaram-se maiores do que nunca e muitas pesquisas foram realizadas para simplificar o processo de treinamento. Pesquisa recente da equipe do Google (Chen et ai. (2023)) propôs uma nova otimização para a Rede Neural chamada Lion (EvoLved Sign Momentum). O método mostra que o algoritmo é mais eficiente em termos de memória e requer uma taxa de aprendizado menor do que Adam. É uma ótima pesquisa que mostra muitas promessas que você não deve perder.

3) TimesNet: Modelagem de Variação 2D Temporal para Análise Geral de Séries Temporais

A análise de série temporal é um caso de uso comum em muitos negócios; Por exemplo, previsão de preços, detecção de anomalias, etc. No entanto, existem muitos desafios para analisar dados temporais apenas com base nos dados atuais (dados 1D). Por isso Wu et ai. (2023) propõem um novo método chamado TimesNet para transformar os dados 1D em dados 2D, que consegue um ótimo desempenho no experimento. Você deve ler o artigo para entender melhor esse novo método, pois ele ajudará muito na análise futura de séries temporais.

4) OPT: modelos de linguagem de transformador pré-treinados abertos

Atualmente, estamos em uma era de IA generativa, onde muitos grandes modelos de linguagem foram desenvolvidos intensivamente por empresas. Principalmente esse tipo de pesquisa não liberaria seu modelo ou estaria apenas disponível comercialmente. No entanto, o grupo de pesquisa Meta AI (Zhang et al. (2022)) tenta fazer o oposto lançando publicamente o modelo Open Pre-trained Transformers (OPT) que pode ser comparável ao GPT-3. O artigo é um ótimo começo para entender o modelo OPT e os detalhes da pesquisa, pois o grupo registra todos os detalhes no artigo.

5) REaLTabFormer: Gerando dados relacionais e tabulares realistas usando Transformers

O modelo generativo não se limita apenas a gerar texto ou imagens, mas também dados tabulares. Esses dados gerados geralmente são chamados de dados sintéticos. Muitos modelos foram desenvolvidos para gerar dados tabulares sintéticos, mas quase nenhum modelo para gerar dados sintéticos tabulares relacionais. Este é exatamente o objetivo Solatório e Dupriez (2023) pesquisar; criando um modelo chamado REaLTabFormer para dados relacionais sintéticos. O experimento mostrou que o resultado é exatamente próximo ao modelo sintético existente, que pode ser estendido para muitas aplicações.

6) O aprendizado por reforço (não) é para processamento de linguagem natural?: benchmarks, linhas de base e blocos de construção para otimização de políticas de linguagem natural

O Aprendizado por Reforço conceitualmente é uma excelente escolha para a tarefa de Processamento de Linguagem Natural, mas é verdade? Esta é uma pergunta que Ramamurthy et ai. (2022) tente responder. O pesquisador apresenta várias bibliotecas e algoritmos que mostram onde as técnicas de Aprendizagem por Reforço têm uma vantagem em comparação com o método supervisionado nas tarefas de PNL. É um papel recomendado para ler se você quiser uma alternativa para o seu conjunto de habilidades.

7) Tune-A-Video: Ajuste One-Shot de Modelos de Difusão de Imagem para Geração de Texto para Vídeo

A geração de texto para imagem foi grande em 2022 e 2023 seria projetada na capacidade de texto para vídeo (T2V). Pesquisa por Wu et ai. (2022) mostra como o T2V pode ser estendido em muitas abordagens. A pesquisa propõe um novo método Tune-a-Video que suporta tarefas T2V, como mudança de assunto e objeto, transferência de estilo, edição de atributos, etc. É um ótimo artigo para ler se você estiver interessado em pesquisa de texto para vídeo.

8) PyGlove: troca eficiente de ideias de ML como código

A colaboração eficiente é a chave para o sucesso de qualquer equipe, especialmente com a crescente complexidade nos campos de aprendizado de máquina. Para nutrir a eficiência, Peng et ai. (2023) apresente uma biblioteca PyGlove para compartilhar ideias de ML facilmente. O conceito PyGlove é capturar o processo de pesquisa de ML por meio de uma lista de regras de correção. A lista pode então ser reutilizada em qualquer cena de experimentos, o que melhora a eficiência da equipe. É uma pesquisa que tenta resolver um problema de aprendizado de máquina que muitos ainda não fizeram, então vale a pena ler.

8) Quão próximo está o ChatGPT de especialistas humanos? Corpus de Comparação, Avaliação e Detecção

O ChatGPT mudou muito o mundo. É seguro dizer que a tendência aumentaria a partir daqui, pois o público já é a favor do uso do ChatGPT. No entanto, como é o resultado atual do ChatGPT em comparação com os especialistas humanos? É exatamente uma pergunta que Guo et al. (2023) tente responder. A equipe tentou coletar dados de especialistas e resultados imediatos do ChatGPT, que eles compararam. O resultado mostra que existiam diferenças implícitas entre o ChatGPT e os especialistas. A pesquisa é algo que eu acho que seria questionado no futuro, pois o modelo generativo de IA continuaria crescendo com o tempo, então vale a pena ler.

2023 é um ótimo ano para pesquisa de aprendizado de máquina mostrado pela tendência atual, especialmente IA generativa, como ChatGPT e Stable Diffusion. Há muitas pesquisas promissoras que eu acho que não devemos perder, porque mostraram resultados promissores que podem mudar o padrão atual. Neste artigo, mostrei a você os 9 principais artigos de ML para ler, desde o modelo generativo, modelo de série temporal até a eficiência do fluxo de trabalho. Espero que ajude.

Cornélio Yudha Wijaya é gerente assistente de ciência de dados e redator de dados. Enquanto trabalhava em período integral na Allianz Indonésia, ele adora compartilhar dicas sobre Python e dados nas mídias sociais e na mídia escrita.

- Conteúdo com tecnologia de SEO e distribuição de relações públicas. Seja amplificado hoje.

- Platoblockchain. Inteligência Metaverso Web3. Conhecimento Ampliado. Acesse aqui.

- Fonte: https://www.kdnuggets.com/2023/03/top-machine-learning-papers-read-2023.html?utm_source=rss&utm_medium=rss&utm_campaign=top-machine-learning-papers-to-read-in-2023

- :é

- 2022

- 2023

- 2D

- 9

- a

- Academia

- exatamente

- Alcança

- atos

- Adam

- AI

- ai pesquisa

- visa

- AL

- algoritmo

- Todos os Produtos

- Allianz

- já

- alternativa

- amador

- análise

- análise

- e

- detecção de anomalia

- responder

- Aplicação

- aplicações

- se aproxima

- SOMOS

- artigo

- AS

- Assistente

- At

- disponível

- baseado

- BE

- bonita

- Beleza

- Porque

- tornam-se

- benchmarks

- Melhor

- entre

- Grande

- maior

- Blocos

- avanços

- Prédio

- negócios

- by

- chamado

- CAN

- capturar

- casas

- desafios

- alterar

- mudança

- ChatGPT

- a verificação

- escolha

- Fechar

- colaboração

- coletar

- vinda

- comercialmente

- comum

- Empresas

- comparável

- comparado

- comparação

- complexidade

- conceito

- Conceitualmente

- conduzido

- poderia

- Criar

- Atual

- diariamente

- dados,

- ciência de dados

- detalhe

- Detecção

- desenvolvido

- diferenças

- Distribuição

- descoberta

- facilmente

- borda

- eficiência

- eficientemente

- Era

- especialmente

- etc.

- avaliação

- Mesmo

- SEMPRE

- evoluiu

- exatamente

- exemplo

- excelente

- trocando

- existente

- experimentar

- especialistas

- favorecer

- campo

- Campos

- Escolha

- freqüentemente

- da

- futuro

- Geral

- gerar

- gerado

- gerando

- geração

- generativo

- IA generativa

- modelo generativo

- Go

- ótimo

- Grupo

- Crescente

- Ter

- ajudar

- ajuda

- SUA PARTICIPAÇÃO FAZ A DIFERENÇA

- esperança

- HOT

- Como funciona o dobrador de carta de canal

- Contudo

- HTTPS

- humano

- i

- idéias

- imagem

- melhorar

- melhora

- in

- aumentando

- Indonésia

- indústria

- interessado

- Introduz

- IT

- jpg

- KDnuggetsGenericName

- Guarda

- Chave

- Tipo

- língua

- grande

- aprendizagem

- Biblioteca

- Limitado

- leão

- Lista

- Vidas

- máquina

- aprendizado de máquina

- Gerente

- muitos

- Mídia

- Meta

- método

- poder

- ML

- modelo

- modelagem

- modelos

- Ímpeto

- mais

- musical

- natural

- Linguagem Natural

- Processamento de linguagem natural

- rede

- Neural

- rede neural

- Novo

- PNL

- romance

- objeto

- of

- on

- ONE

- aberto

- oposto

- otimização

- Papel

- papéis

- Patching

- atuação

- FOTOS

- Passo

- platão

- Inteligência de Dados Platão

- PlatãoData

- Privacidade

- presente

- preço

- Problema

- processo

- em processamento

- projetado

- promessas

- promissor

- oferece

- proposto

- propõe

- público

- publicamente

- Python

- questão

- variando

- Taxa

- Leia

- Leitura

- realista

- recentemente

- Recomenda

- aprendizagem de reforço

- liberar

- exige

- pesquisa

- grupo de pesquisa

- investigador

- resultar

- Resultados

- regras

- s

- seguro

- cena

- Ciência

- Série

- Partilhar

- rede de apoio social

- mostrando

- Shows

- assinar

- simplificar

- conjunto de habilidades

- menor

- So

- Redes Sociais

- meios de comunicação social

- RESOLVER

- algo

- estável

- padrão

- começo

- estilo

- sujeito

- sucesso

- tal

- suportes

- sintético

- dados sintéticos

- Tarefa

- tarefas

- Profissionais

- técnicas

- que

- A

- O Futuro

- o mundo

- deles

- Lá.

- coisas

- Através da

- tempo

- Séries temporais

- dicas

- para

- TOM

- topo

- Training

- transferência

- Transformar

- transformadores

- Trend

- Tendências

- verdadeiro

- compreender

- compreensão

- os próximos

- para cima

- usar

- caso de uso

- vário

- via

- voz

- qual

- enquanto

- precisarão

- com

- dentro

- Atividades:

- de gestão de documentos

- trabalhar

- mundo

- Equivalente há

- seria

- escritor

- escrita

- ano

- anos

- investimentos

- zefirnet