Comentariu Peste 250 de împușcături în masă au avut loc în SUA până acum în acest an, iar susținătorii AI cred că au soluția. Nu controlul armelor, ci tehnologie mai bună, fără a fi surprinzător.

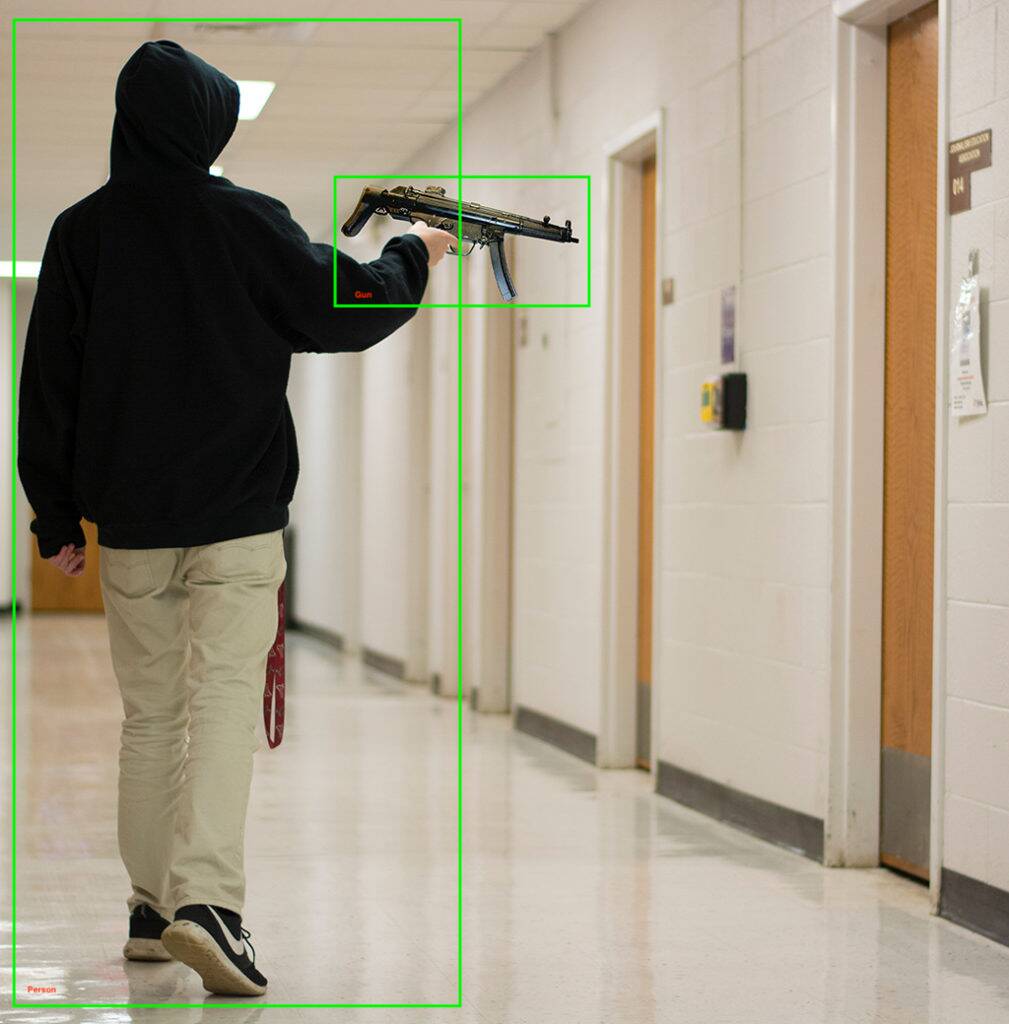

Compania de învățare automată Kogniz a anunțat marți că adaugă un dispozitiv gata de implementare model de detectare a armelor la platforma sa de viziune computerizată. Sistemul, ni s-a spus, poate detecta armele văzute de camerele de securitate și poate trimite notificări celor expuși riscului, anunțând poliția, închidend clădirile și efectuând alte sarcini de securitate.

Pe lângă reperarea armelor de foc, Kogniz folosește celelalte module de viziune computerizată pentru a observa un comportament neobișnuit, cum ar fi copiii care sprintează pe holuri sau cineva care se urcă printr-o fereastră, ceea ce ar putea indica un trăgător activ.

Dacă vă întrebați despre rata de fals pozitive sau erori a codului, Kogniz spune că are o „AI multi-pass” și „o echipă instruită de verificatori umani” care verifică rezultatele software-ului său de detectare. Fie salutați acest nivel suplimentar de confirmare, fie îl vedeți ca o tehnologie care ar putea reveni asupra oamenilor chiar atunci când computerele sunt cele mai necesare.

„[Soluția noastră este] să faciliteze în mod dramatic companiile, agențiile guvernamentale, școlile și spitalele să se pregătească și apoi să contribuie la reducerea daunelor cauzate de un eveniment de împușcături activ”, a spus CEO-ul Kogniz, Daniel Putterman.

Kogniz nu este prima companie de viziune computerizată care a intrat în jocul de recunoaștere a armelor – există o listă considerabilă de companii care folosesc tehnologii similare, iar unele, cum ar fi ZeroEyes, nu sunt specializate decât în detectarea armelor de foc.

„Prin răspândirea atenției pe mai multe oferte, dezvoltatorii sunt mai puțin capabili să ofere cel mai bun serviciu de detectare a armelor”, a spus ZeroEyes într-un blog. Tehnologia ZeroEyes a fost implementată în școli din 14 state, inclusiv Liceul Oxford în metroul Detroit, unde un împușcător de 15 ani a ucis patru și a rănit șapte anul trecut.

Alți furnizori – cum ar fi Defendry, care are o suită de securitate care include o aplicație pentru buton de panică, senzori audio pentru împușcături, drone cu primul răspuns și AI de detectare a armelor; și Omnilert – se află pe această piață în creștere depresivă. Alte companii din domeniul detectării armelor AI includ Arcarith, Athena Securities și Scylla.

Există într-adevăr suficient timp?

În 2019, răspunsul poliției la o împușcătură în masă din Dayton, Ohio, a fost de doar 32 de secunde, timp în care nouă persoane au murit. O împușcătură din 2021 la o unitate FedEx din Indianapolis, care a ucis nouă persoane, s-a încheiat și înainte ca polițiștii să poată sosi, chiar dacă au făcut-o în doar câteva minute.

Ambele cazuri ridică întrebarea dacă detectarea armelor AI poate reduce suficient timpii de răspuns pentru a salva vieți. Mai ales dacă ofițerii sunt prea speriați sau aleg să nu răspundă efectiv, cum ar fi în crima în masă de la Uvalde.

Au fost propuse mai multe alte metode de prevenire a împușcăturii în masă bazate pe inteligență artificială, cum ar fi arme inteligente care nu vor trage dacă detectează o țintă umană. Alții au propus instruirea AI cu privire la datele din împușcăturile anterioare, achizițiile locale de arme și datele socio-economice pentru a găsi tendințe care indică o împușcătură planificată, precum și scanarea rețelelor sociale pentru indicatori similari.

Există, de asemenea AI prejudecată, A problema bine documentata că chiar și seturi de date diverse și antrenament echilibrat nu pare a se rezolva. Luați în considerare o implementare în 2020 a tehnologiei de recunoaștere a feței și a armelor într-un district școlar din New York: e-mailurile între districtul școlar și compania care a implementat sistemul arată în mod obișnuit îngrijorări cu privire la acesta. greșit de identificare lucruri, cum ar fi mânerele măturii pentru arme.

Vorbind cu publicația din Utah Deseret News, analistul senior de politici ACLU, Jay Stanley a spus era îngrijorat de faptul că sistemele de viziune computerizată ar putea duce la o lume „în care oamenii evită să facă ceva la fel de simplu ca să sară pe trotuar de teamă să nu declanșeze detectoare de anomalii și să fie interogați de poliție”.

O posibilă utilizare a inteligenței artificiale ar putea avea totuși mai multe promițături: un 2018 studiu de la Centrul Medical al Spitalului de Copii din Cincinnati a constatat că analiza AI a sesiunilor de terapie a fost de acord cu evaluările de pericol ale psihiatrilor și consilierilor în 91 la sută din timp. Adăugarea datelor demografice și socioeconomice nu a făcut decât să îmbunătățească rezultatele în identificarea tinerilor care erau expuși riscului de a comite un act violent.

Cu atât de multe complicații potențiale, învățarea automată este într-adevăr pregătită pentru a preveni crimele în masă?

Violența cu armele este ucigașul numărul unu a copiilor și adolescenților din America, luând în medie 12 vieți tineri și rănind încă 32, în fiecare zi. Inteligența artificială poate ajuta, dar fără a-și aborda deficiențele, poate că sunt necesare și abordări mai puțin tehnologice. Îngrijirea sănătății mintale mai puternică și disponibilă pe scară largă ar putea fi un început bun.

La începutul acestei luni, președintele Biden denumit pentru, printre altele, interzicerea armelor de asalt, verificări extinse ale antecedentelor și limite ale capacității revistelor, pe care el le-a numit „măsuri raționale, de bun simț”. ®

- AI

- ai art

- ai art generator

- ai robot

- inteligență artificială

- certificare de inteligență artificială

- inteligența artificială în domeniul bancar

- robot cu inteligență artificială

- roboți cu inteligență artificială

- software de inteligență artificială

- blockchain

- conferință blockchain ai

- coingenius

- inteligența artificială conversațională

- criptoconferință ai

- dall-e

- învățare profundă

- google ai

- masina de învățare

- Plato

- platoul ai

- Informații despre date Platon

- Jocul lui Platon

- PlatoData

- platogaming

- scara ai

- sintaxă

- Registrul

- zephyrnet