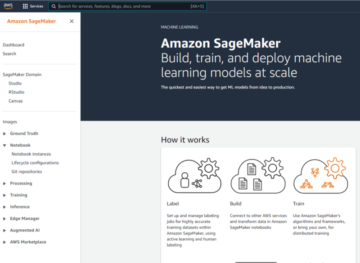

Amazon SageMaker Автопилот помогает завершить сквозной рабочий процесс машинного обучения (ML), автоматизируя этапы разработки функций, обучения, настройки и развертывания модели ML для логического вывода. Вы предоставляете SageMaker Autopilot набор табличных данных и целевой атрибут для прогнозирования. Затем SageMaker Autopilot автоматически исследует ваши данные, обучает, настраивает, ранжирует и находит лучшую модель. Наконец, вы можете развернуть эту модель в рабочей среде для вывода одним щелчком мыши.

Что нового?

Недавно запущенная функция, Отчеты о качестве модели SageMaker Autopilot, теперь сообщает метрики вашей модели, чтобы обеспечить лучшее представление о производительности вашей модели для проблем регрессии и классификации. Вы можете использовать эти показатели, чтобы получить больше информации о лучшей модели в рейтинге моделей.

Эти метрики и отчеты, которые доступны на новой вкладке «Производительность» в разделе «Детали модели» лучшей модели, включают матрицы путаницы, область под кривой рабочих характеристик приемника (AUC-ROC) и область под кривой точности-отзыва. (АУК-ПР). Эти метрики помогают понять ложные срабатывания/ложноотрицательные результаты (FP/FN), компромиссы между истинными положительными (TP) и ложными срабатываниями (FP), а также компромиссы между точностью и полнотой для оценки наилучших характеристик производительности модели.

Запуск эксперимента SageMaker Autopilot

Набор данных

МЫ ИСПОЛЬЗУЕМ Набор маркетинговых данных банка UCI для демонстрации отчетов о качестве модели SageMaker Autopilot. Эти данные содержат атрибуты клиентов, такие как возраст, тип работы, семейное положение и другие, которые мы будем использовать, чтобы предсказать, откроет ли клиент счет в банке. Набор данных относится к этому счету как к срочному депозиту. Это делает наш случай проблемой бинарной классификации — прогноз будет либо «да», либо «нет». SageMaker Autopilot создаст несколько моделей от нашего имени, чтобы лучше прогнозировать потенциальных клиентов. Затем мы рассмотрим отчет о качестве модели для SageMaker Autopilot. лучшая модель.

Предпосылки

Чтобы начать эксперимент SageMaker Autopilot, вы должны сначала поместить свои данные в Простой сервис хранения Amazon (Amazon S3) ведро. Укажите сегмент и префикс, которые вы хотите использовать для обучения. Убедитесь, что ведро находится в том же регионе, что и эксперимент SageMaker Autopilot. Вы также должны убедиться, что у роли Autopilot управления идентификацией и доступом (IAM) есть разрешения на доступ к данным в Amazon S3.

Создание эксперимента

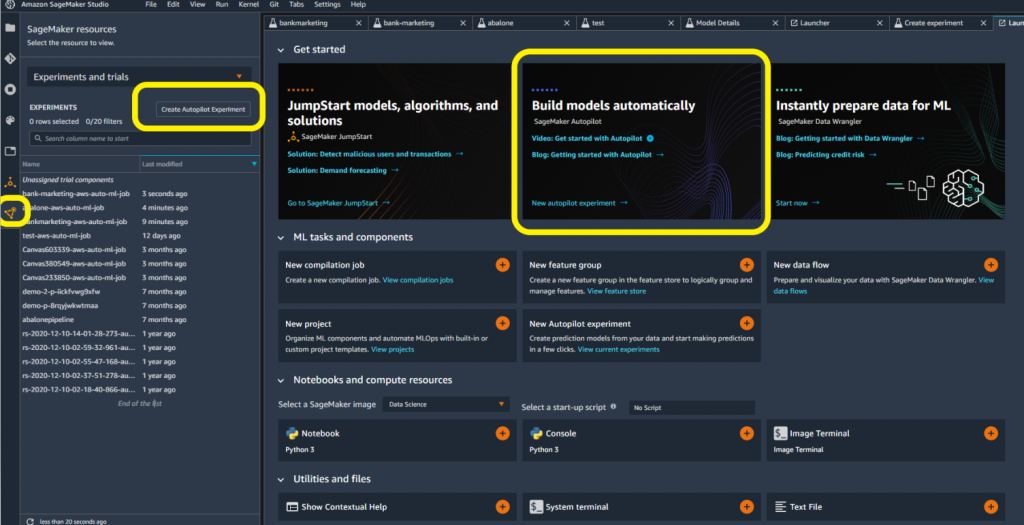

У вас есть несколько вариантов создания эксперимента SageMaker Autopilot в SageMaker Studio. Открыв новую программу запуска, вы можете получить прямой доступ к SageMaker Autopilot. Если нет, то вы можете выбрать значок ресурсов SageMaker слева. Далее вы можете выбрать Эксперименты и испытания в раскрывающемся меню.

- Дайте вашему эксперименту имя.

- Подключитесь к источнику данных, выбрав корзину Amazon S3 и имя файла.

- Выберите расположение выходных данных в Amazon S3.

- Выберите целевой столбец для вашего набора данных. В этом случае мы нацеливаем столбец «y», чтобы указать да/нет.

- При необходимости укажите имя конечной точки, если вы хотите, чтобы SageMaker Autopilot автоматически развернул конечную точку модели.

- Оставьте все остальные дополнительные настройки по умолчанию и выберите Создать эксперимент.

После завершения эксперимента вы сможете увидеть результаты в SageMaker Studio. SageMaker Autopilot представит лучшую модель среди различных моделей, которые он обучает. Вы можете просмотреть сведения и результаты для различных испытаний, но мы будем использовать лучшую модель, чтобы продемонстрировать использование отчетов о качестве модели.

- Выберите модель и щелкните правой кнопкой мыши, чтобы Открыть в деталях модели.

- В деталях модели выберите Перфоманс вкладка Это показывает метрики модели с помощью визуализаций и графиков.

- Под Перфоманс, наведите на Скачать отчеты об эффективности как PDF.

Интерпретация отчета о качестве модели SageMaker Autopilot

В отчете о качестве модели представлены сведения о задании SageMaker Autopilot и модели. Мы сосредоточимся на формате отчета PDF, но вы также можете получить доступ к результатам в формате JSON. Поскольку SageMaker Autopilot определил наш набор данных как проблему бинарной классификации, SageMaker Autopilot стремился максимизировать Метрика качества F1 найти лучшую модель. SageMaker Autopilot выбирает это по умолчанию. Однако существует возможность выбора других объективных показателей, таких как точность и AUC. Оценка нашей модели F1 составляет 0.61. Чтобы интерпретировать оценку F1, полезно сначала понять матрицу путаницы, которая объясняется в отчете о качестве модели в выходном PDF-файле.

Матрица путаницы

Матрица путаницы помогает визуализировать производительность модели, сравнивая различные классы и метки. Эксперимент SageMaker Autopilot создал матрицу путаницы, которая показывает фактические метки в виде строк, а предикативные метки в виде столбцов в отчете о качестве модели. В верхнем левом поле показаны клиенты, которые не открывали счет в банке, который был правильно предсказан моделью как «нет». Эти настоящие негативы (ТН). В нижнем правом поле показаны клиенты, которые открыли счет в банке, который был правильно предсказан моделью как «да». Эти настоящие позитивы (ТП).

В левом нижнем углу указано количество ложные негативы (ФН). Модель предсказывала, что клиент не откроет счет, но клиент это сделал. В правом верхнем углу указано количество ложные срабатывания (ФП). Модель предсказывала, что клиент откроет счет, но клиент это сделал. не на самом деле сделать так.

Показатели отчета о качестве модели

Отчет о качестве модели объясняет, как рассчитать частота ложных срабатываний (FPR) и истинно положительный показатель (TPR).

Отзыв или ложноположительный показатель (FPR) измеряет долю фактических отрицательных результатов, которые были ложно предсказаны как открытие счета (положительные результаты). Диапазон составляет от 0 до 1, и меньшее значение указывает на лучшую точность прогнозирования.

Обратите внимание, что FPR также выражается как 1-специфичность, где специфичность или доля истинно отрицательных результатов (TNR) — это доля TN, правильно идентифицированных как не открывающие учетную запись (отрицательные).

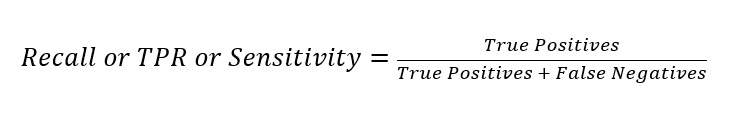

Отзыв/чувствительность/истинный положительный показатель (TPR) измеряет долю фактических положительных результатов, которые были предсказаны как открытие счета. Диапазон также составляет от 0 до 1, и большее значение указывает на лучшую точность прогнозирования. Это также известно как отзыв / чувствительность. Эта мера выражает возможность найти все релевантные экземпляры в наборе данных.

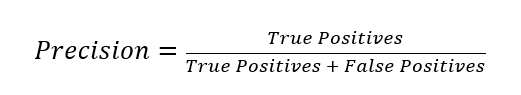

Точность измеряет долю фактических положительных результатов, которые были предсказаны как положительные, от всех тех, которые были предсказаны как положительные. Диапазон составляет от 0 до 1, и большее значение указывает на лучшую точность. Точность выражает долю точек данных, которые наша модель считает релевантными и которые действительно релевантны. Точность является хорошей мерой, особенно когда затраты на FP высоки, например, при обнаружении спама в электронной почте.

Наша модель показывает точность 0.53 и полноту 0.72.

Счет F1 демонстрирует нашу целевую метрику, которая является гармоническим средним значением точности и полноты. Поскольку наш набор данных несбалансирован в пользу многих «нет» прогнозов, F1 принимает во внимание как FP, так и FN, чтобы придать одинаковый вес точности и отзыву.

В отчете объясняется, как интерпретировать эти показатели. Это может помочь, если вы не знакомы с этими терминами. В нашем примере точность и полнота являются важными показателями для задачи бинарной классификации, поскольку они используются для расчета оценки F1. В отчете поясняется, что оценка F1 может варьироваться от 0 до 1. Наилучшая возможная производительность будет равна 1, а 0 будет означать худшую. Помните, что показатель F1 нашей модели равен 0.61.

Оценка Fβ является взвешенным гармоническим средним значением точности и полноты. Кроме того, оценка F1 такая же, как Fβ с β=1. В отчете представлена оценка Fβ классификатора, где β принимает значения 0.5, 1 и 2.

Таблица показателей

В зависимости от проблемы вы можете обнаружить, что SageMaker Autopilot максимизирует другую метрику, например точность, для задачи классификации нескольких классов. Независимо от типа проблемы отчеты о качестве модели создают таблицу, в которой обобщаются метрики вашей модели, доступные как во встроенном отчете, так и в отчете в формате PDF. Вы можете узнать больше о таблице метрик в документации.

Лучший постоянный классификатор — классификатор, который служит простой базой для сравнения с другими более сложными классификаторами — всегда прогнозирует постоянную метку большинства, которую предоставляет пользователь. В нашем случае «постоянная» модель предсказывает «нет», поскольку это наиболее часто встречающийся класс, который считается негативной меткой. Показатели обученных моделей классификатора (таких как f1, f2 или отзыв) можно сравнить с показателями постоянного классификатора, т. е. базового уровня. Это гарантирует, что обученная модель работает лучше, чем постоянный классификатор. Показатели Fβ (f0_5, f1 и f2, где β принимает значения 0.5, 1 и 2 соответственно) представляют собой средневзвешенное гармоническое значение точности и полноты. Это достигает оптимального значения при 1 и наихудшего значения при 0.

В нашем случае лучший константный классификатор всегда предсказывает «нет». Таким образом, точность высока и составляет 0.89, но показатели полноты, точности и Fβ равны 0. Если бы набор данных был идеально сбалансирован, где нет единого класса большинства или меньшинства, мы бы увидели гораздо более интересные возможности для точности, полноты, и Fβ оценки константного классификатора.

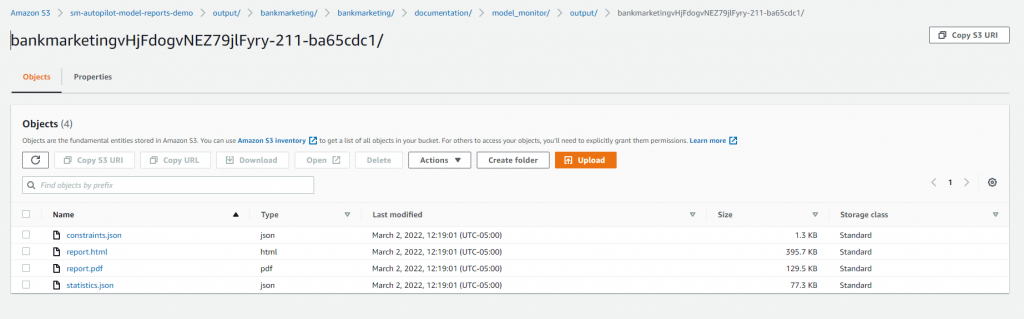

Кроме того, вы можете просмотреть эти результаты в формате JSON, как показано в следующем примере. Вы можете получить доступ к файлам PDF и JSON через пользовательский интерфейс, а также SDK Amazon SageMaker Python используя элемент S3OutputPath в Конфигурация выходных данных структура в СоздатьAutoMLJob/ОписатьAutoMLJob Ответ API.

{ "version" : 0.0, "dataset" : { "item_count" : 9152, "evaluation_time" : "2022-03-16T20:49:18.661Z" }, "binary_classification_metrics" : { "confusion_matrix" : { "no" : { "no" : 7468, "yes" : 648 }, "yes" : { "no" : 295, "yes" : 741 } }, "recall" : { "value" : 0.7152509652509652, "standard_deviation" : 0.00439996600081394 }, "precision" : { "value" : 0.5334773218142549, "standard_deviation" : 0.007335840278445563 }, "accuracy" : { "value" : 0.8969624125874126, "standard_deviation" : 0.0011703516093899595 }, "recall_best_constant_classifier" : { "value" : 0.0, "standard_deviation" : 0.0 }, "precision_best_constant_classifier" : { "value" : 0.0, "standard_deviation" : 0.0 }, "accuracy_best_constant_classifier" : { "value" : 0.8868006993006993, "standard_deviation" : 0.0016707401772078998 }, "true_positive_rate" : { "value" : 0.7152509652509652, "standard_deviation" : 0.00439996600081394 }, "true_negative_rate" : { "value" : 0.9201577131591917, "standard_deviation" : 0.0010233756436643213 }, "false_positive_rate" : { "value" : 0.07984228684080828, "standard_deviation" : 0.0010233756436643403 }, "false_negative_rate" : { "value" : 0.2847490347490348, "standard_deviation" : 0.004399966000813983 },

………………….

ОКР и АУК

В зависимости от типа проблемы у вас могут быть разные пороговые значения того, что приемлемо в качестве FPR. Например, если вы пытаетесь предсказать, откроет ли клиент счет, то для бизнеса может быть более приемлемым иметь более высокий показатель FP. Может быть более рискованно упустить предложения для клиентов, которым было неверно предсказано «нет», в отличие от предложения клиентам, которым неправильно было предсказано «да». Изменение этих пороговых значений для получения разных FPR требует создания новых матриц путаницы.

Алгоритмы классификации возвращают непрерывные значения, известные как вероятности предсказания. Эти вероятности должны быть преобразованы в бинарное значение (для бинарной классификации). В задачах бинарной классификации порог (или порог решения) — это значение, которое разделяет вероятности на простое бинарное решение. Для нормализованных прогнозируемых вероятностей в диапазоне от 0 до 1 пороговое значение по умолчанию равно 0.5.

Для моделей бинарной классификации полезной оценочной метрикой является площадь под кривой рабочих характеристик приемника (ROC). Отчет о качестве модели включает график ROC со скоростью TP по оси Y и FPR по оси X. Область под рабочей характеристикой приемника (AUC-ROC) представляет собой компромисс между TPR и FPR.

Вы создаете кривую ROC, беря предиктор бинарной классификации, который использует пороговое значение, и назначая метки с вероятностями предсказания. Когда вы меняете порог для модели, вы охватываете две крайности. Когда и TPR, и FPR равны 0, это означает, что все помечено как «нет», а когда и TPR, и FPR равны 1, это означает, что все помечено как «да».

Случайный предиктор, который помечает «Да» в половине случаев и «Нет» в другой половине времени, будет иметь ROC, представляющий собой прямую диагональную линию (красная пунктирная линия). Эта линия разрезает единичный квадрат на два равновеликих треугольника. Следовательно, площадь под кривой равна 0.5. Значение AUC-ROC, равное 0.5, будет означать, что ваш предиктор не лучше различает два класса, чем случайным образом угадывает, откроет ли клиент счет или нет. Чем ближе значение AUC-ROC к 1.0, тем лучше его предсказания. Значение ниже 0.5 указывает на то, что мы действительно могли бы заставить нашу модель давать лучшие прогнозы, изменив ответ, который она нам дает. Для нашей лучшей модели AUC составляет 0.93.

Кривая точного отзыва

В отчете о качестве модели также создана кривая полноты точности (PR) для отображения точности (ось Y) и полноты (ось X) для различных пороговых значений — очень похоже на кривую ROC. Кривые PR, часто используемые в информационном поиске, являются альтернативой кривым ROC для задач классификации с большим перекосом в распределении классов.

Для этих наборов данных с несбалансированными классами кривые PR особенно полезны, когда положительный класс меньшинства более интересен, чем отрицательный класс большинства. Помните, что наша модель показывает точность 0.53 и полноту 0.72. Кроме того, помните, что лучший классификатор констант не может различать «да» и «нет». Каждый раз он будет предсказывать случайный класс или постоянный класс.

Кривая для сбалансированного набора данных между «да» и «нет» будет представлять собой горизонтальную линию на уровне 0.5, и, таким образом, площадь под кривой PR (AUPRC) будет равна 0.5. Чтобы создать PRC, мы наносим различные модели на кривую с различными пороговыми значениями так же, как кривую ROC. По нашим данным, AUPRC составляет 0.61.

Вывод отчета о качестве модели

Отчет о качестве модели можно найти в корзине Amazon S3, которую вы указали при назначении выходного пути перед запуском эксперимента SageMaker AutoPilot. Вы найдете отчеты в разделе documentation/model_monitor/output/<autopilot model name>/ prefix сохранен в формате PDF.

Заключение

Отчеты о качестве модели SageMaker Autopilot упрощают просмотр и обмен результатами эксперимента SageMaker Autopilot. Вы можете легко выполнить обучение и настройку модели с помощью SageMaker Autopilot, а затем использовать созданные отчеты для интерпретации результатов. Независимо от того, используете ли вы лучшую модель SageMaker Autopilot или другую модель, эти результаты могут стать полезной отправной точкой для оценки предварительного обучения и настройки модели. Отчеты о качестве моделей SageMaker Autopilot помогают сократить время, необходимое для написания кода, и создавать визуальные эффекты для оценки и сравнения производительности.

Вы можете легко внедрить autoML в свои бизнес-кейсы уже сегодня, не создавая команду специалистов по обработке и анализу данных. SageMaker документации предоставляет многочисленные образцы, которые помогут вам начать работу.

Об авторах

Питер Чунг является архитектором решений для AWS и с энтузиазмом помогает клиентам извлекать из своих данных полезную информацию. Он создает решения, которые помогают организациям принимать решения на основе данных как в государственном, так и в частном секторах. Он имеет все сертификаты AWS, а также два сертификата GCP. Он любит кофе, готовит, остается активным и проводит время с семьей.

Питер Чунг является архитектором решений для AWS и с энтузиазмом помогает клиентам извлекать из своих данных полезную информацию. Он создает решения, которые помогают организациям принимать решения на основе данных как в государственном, так и в частном секторах. Он имеет все сертификаты AWS, а также два сертификата GCP. Он любит кофе, готовит, остается активным и проводит время с семьей.

Арунпрасат Шанкар является специалистом по архитектуре решений в области искусственного интеллекта и машинного обучения (AI / ML) в AWS, помогая клиентам во всем мире эффективно масштабировать свои решения AI в облаке. В свободное время Арун любит смотреть научно-фантастические фильмы и слушать классическую музыку.

Арунпрасат Шанкар является специалистом по архитектуре решений в области искусственного интеллекта и машинного обучения (AI / ML) в AWS, помогая клиентам во всем мире эффективно масштабировать свои решения AI в облаке. В свободное время Арун любит смотреть научно-фантастические фильмы и слушать классическую музыку.

Али Такбири является архитектором решений, специализирующимся на искусственном интеллекте и машинном обучении, и помогает клиентам с помощью машинного обучения решать свои бизнес-задачи в облаке AWS.

Али Такбири является архитектором решений, специализирующимся на искусственном интеллекте и машинном обучении, и помогает клиентам с помощью машинного обучения решать свои бизнес-задачи в облаке AWS.

Прадип Редди является старшим менеджером по продукту в команде SageMaker Low/No Code ML, в которую входят SageMaker Autopilot и SageMaker Automatic Model Tuner. Вне работы Прадип любит читать, бегать и развлекаться с компьютерами размером с ладонь, такими как raspberry pi, и другими технологиями домашней автоматизации.

Прадип Редди является старшим менеджером по продукту в команде SageMaker Low/No Code ML, в которую входят SageMaker Autopilot и SageMaker Automatic Model Tuner. Вне работы Прадип любит читать, бегать и развлекаться с компьютерами размером с ладонь, такими как raspberry pi, и другими технологиями домашней автоматизации.

- Коинсмарт. Лучшая в Европе биржа биткойнов и криптовалют.

- Платоблокчейн. Интеллект метавселенной Web3. Расширение знаний. БЕСПЛАТНЫЙ ДОСТУП.

- КриптоХок. Альткоин Радар. Бесплатная пробная версия.

- Источник: https://aws.amazon.com/blogs/machine-learning/automatically-generate-model-evaluation-metrics-using-sagemaker-autopilot-model-quality-reports/

- "

- 100

- 7

- О нас

- доступ

- Учетная запись

- активный

- продвинутый

- AI

- алгоритмы

- Все

- Amazon

- среди

- Другой

- API

- ПЛОЩАДЬ

- искусственный

- искусственный интеллект

- Искусственный интеллект и машинное обучение

- Атрибуты

- автоматизация

- доступен

- AWS

- Банка

- Базовая линия

- становиться

- ЛУЧШЕЕ

- граница

- Коробка

- строить

- Строительство

- бизнес

- случаев

- проблемы

- Выберите

- класс

- классов

- классификация

- ближе

- облако

- код

- Кофе

- Column

- сравненный

- комплекс

- компьютеры

- замешательство

- содержит

- Расходы

- может

- создали

- Создающий

- кривая

- Клиенты

- данным

- наука о данных

- набор данных

- демонстрировать

- развертывание

- развертывание

- обнаружение

- DID

- различный

- непосредственно

- распределение

- легко

- Конечная точка

- Проект и

- особенно

- многое

- пример

- эксперимент

- семья

- Особенность

- в заключение

- находит

- First

- Трансформируемость

- Фокус

- после

- формат

- порождать

- Глобальный

- хорошо

- имеющий

- помощь

- полезный

- помогает

- High

- высший

- имеет

- Главная

- Home Automation

- Как

- How To

- HTTPS

- ICON

- Личность

- важную

- включают

- информация

- размышления

- Интеллекта

- IT

- работа

- известный

- Этикетки

- большой

- больше

- УЧИТЬСЯ

- изучение

- Кредитное плечо

- линия

- Listening

- расположение

- машина

- обучение с помощью машины

- Большинство

- ДЕЛАЕТ

- управление

- менеджер

- Маркетинг

- матрица

- проводить измерение

- Метрика

- меньшинство

- ML

- модель

- Модели

- БОЛЕЕ

- самых

- Кино

- Музыка

- номер

- многочисленный

- предлагающий

- Предложения

- открытый

- открытие

- операционный

- Опции

- организации

- Другое

- страстный

- производительность

- Точка

- положительный

- возможности,

- возможное

- потенциал

- предсказывать

- прогноз

- Predictions

- представить

- частная

- Проблема

- проблемам

- производит

- Продукт

- Производство

- обеспечивать

- приводит

- что такое варган?

- быстро

- ассортимент

- Reading

- уменьшить

- соответствующие

- отчету

- Отчеты

- представляет

- Полезные ресурсы

- ответ

- Итоги

- Бег

- Шкала

- Наука

- Сектора юридического права

- набор

- Поделиться

- просто

- So

- Решения

- РЕШАТЬ

- спам

- Расходы

- площадь

- и политические лидеры

- Статус:

- диск

- студия

- цель

- команда

- технологии

- Через

- время

- сегодня

- TPR

- Обучение

- поезда

- ui

- открывай

- понимать

- us

- использование

- ценностное

- различный

- Вид

- видимость

- будь то

- КТО

- без

- Работа

- бы