Slika avtorja

XAI je umetna inteligenca, ki ljudem omogoča razumevanje rezultatov in procesov odločanja modela ali sistema.

Razložljivost pred modeliranjem

Razložljiva umetna inteligenca se začne z razložljivimi podatki in jasnim, razložljivim inženiringom funkcij.

Razložljivost modeliranja

Pri izbiri modela za določeno težavo je na splošno najbolje uporabiti model, ki ga je najbolj razlagati in ki še vedno dosega dobre napovedne rezultate.

Razložljivost po modelu

To vključuje tehnike, kot je motnja, kjer se analizira učinek spremembe ene spremenljivke na izhod modela, kot so vrednosti SHAP za po usposabljanju.

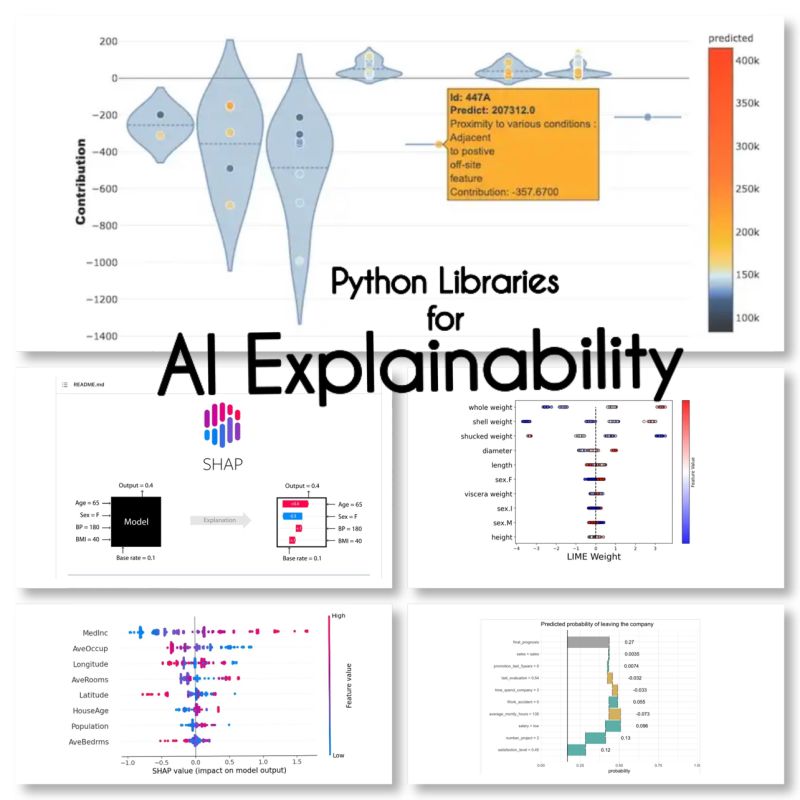

Našel sem teh 10 knjižnic Python za razložljivost AI:

SHAP (SHapley Additive Explanations)

SHAP je agnostik modela in deluje tako, da razčleni prispevek vsake funkcije in vsaki lastnosti pripiše oceno.

LIME (lokalno razlagalne modelsko-agnostične razlage)

LIME je še ena metoda agnostike modela, ki deluje tako, da približa vedenje modela lokalno glede na določeno napoved.

ELi5

Eli5 je knjižnica za odpravljanje napak in razlago klasifikatorjev. Zagotavlja ocene pomembnosti funkcij in "kode vzrokov" za scikit-learn, Keras, xgboost, LightGBM, CatBoost.

Šapaš

Shapash je knjižnica Python, katere cilj je narediti strojno učenje razložljivo in razumljivo vsem. Shapash ponuja več vrst vizualizacij z eksplicitnimi oznakami.

sidra

Sidra so metoda za ustvarjanje pravil, ki jih je mogoče razumeti s človekom in se lahko uporabijo za razlago napovedi modela strojnega učenja.

XAI (razložljiv AI)

XAI je knjižnica za razlago in vizualizacijo napovedi modelov strojnega učenja, vključno z rezultati pomembnosti funkcij.

Zlomiti se

BreakDown je orodje, ki ga je mogoče uporabiti za razlago napovedi linearnih modelov. Deluje tako, da izhod modela razgradi na prispevek vsake vhodne funkcije.

razlaga-besedilo

interpret-text je knjižnica za razlago napovedi modelov obdelave naravnega jezika.

iml (interpretabilno strojno učenje)

iml trenutno vsebuje vmesnik in kodo IO iz projekta Shap in potencialno bo storil enako za projekt Lime.

aix360 (AI Explainability 360)

aix360 vključuje obsežen nabor algoritmov, ki pokrivajo različne dimenzije

OmniXAI

OmniXAI (okrajšava za Omni eXplainable AI) obravnava več težav pri razlagi sodb, ki jih ustvarijo modeli strojnega učenja v praksi.

Sem pozabil kakšno knjižnico?

Viri

Maryam Miradi je vodja umetne inteligence in podatkovne znanosti z doktoratom iz strojnega učenja in globokega učenja, specializiran za NLP in računalniški vid. Ima več kot 15 let izkušenj z ustvarjanjem uspešnih rešitev AI z zgodovino izvajanja več kot 40 uspešnih projektov. Delala je za 12 različnih organizacij v različnih panogah, vključno z odkrivanjem finančnega kriminala, energetiko, bančništvom, maloprodajo, e-trgovino in vlado.

- Distribucija vsebine in PR s pomočjo SEO. Okrepite se še danes.

- Platoblockchain. Web3 Metaverse Intelligence. Razširjeno znanje. Dostopite tukaj.

- vir: https://www.kdnuggets.com/2023/01/explainable-ai-10-python-libraries-demystifying-decisions.html?utm_source=rss&utm_medium=rss&utm_campaign=explainable-ai-10-python-libraries-for-demystifying-your-models-decisions

- 10

- a

- naslovi

- po

- AI

- Cilje

- algoritmi

- omogoča

- in

- Še ena

- okoli

- umetni

- Umetna inteligenca

- Bančništvo

- BEST

- Breaking

- spreminjanje

- izbiri

- jasno

- Koda

- celovito

- računalnik

- Računalniška vizija

- Vsebuje

- Prispevek

- pokrov

- Ustvarjanje

- Kriminal

- Trenutno

- datum

- znanost o podatkih

- Odločanje

- odločitve

- globoko

- globoko učenje

- dostavo

- drugačen

- navzdol

- e-trgovina

- vsak

- učinek

- energija

- Inženiring

- vsi

- izkušnje

- Pojasnite

- Pojasnjevanje

- Razložljiv AI

- pojasnjujejo

- Feature

- finančna

- finančni kriminal

- pozabljen

- je pokazala,

- iz

- splošno

- ustvarjajo

- dobro

- vlada

- HTTPS

- Ljudje

- Pomembnost

- in

- vključuje

- Vključno

- industrij

- vhod

- Intelligence

- vmesnik

- IT

- sodbe

- KDnuggets

- keras

- Oznake

- jezik

- vodi

- učenje

- knjižnice

- Knjižnica

- Lime

- lokalna

- lokalno

- stroj

- strojno učenje

- Znamka

- Metoda

- Model

- modeli

- Najbolj

- naravna

- Naravni jezik

- Obdelava Natural Language

- nlp

- Omni

- Organizacije

- zlasti

- platon

- Platonova podatkovna inteligenca

- PlatoData

- potencialno

- praksa

- napoved

- Napovedi

- problem

- Težave

- Procesi

- obravnavati

- Proizvedeno

- Projekt

- projekti

- zagotavlja

- Python

- Razlog

- zapis

- Rezultati

- Trgovina na drobno

- pravila

- Enako

- Znanost

- scikit-učiti

- nastavite

- več

- Kratke Hlače

- sam

- rešitve

- specializirani

- specifična

- začne

- Še vedno

- uspešno

- taka

- sistem

- tehnike

- O

- do

- orodje

- sledenje

- usposabljanje

- Vrste

- razumeli

- razumljivo

- uporaba

- Vrednote

- raznolikost

- Vizija

- vizualizacija

- ki

- bo

- delal

- deluje

- XGBoost

- let

- Vaša rutina za

- zefirnet