komentar Letos se je v ZDA do zdaj zgodilo več kot 250 množičnih streljanj in zagovorniki umetne inteligence menijo, da imajo rešitev. Ne nadzor orožja, ampak boljša tehnologija, kar ni presenetljivo.

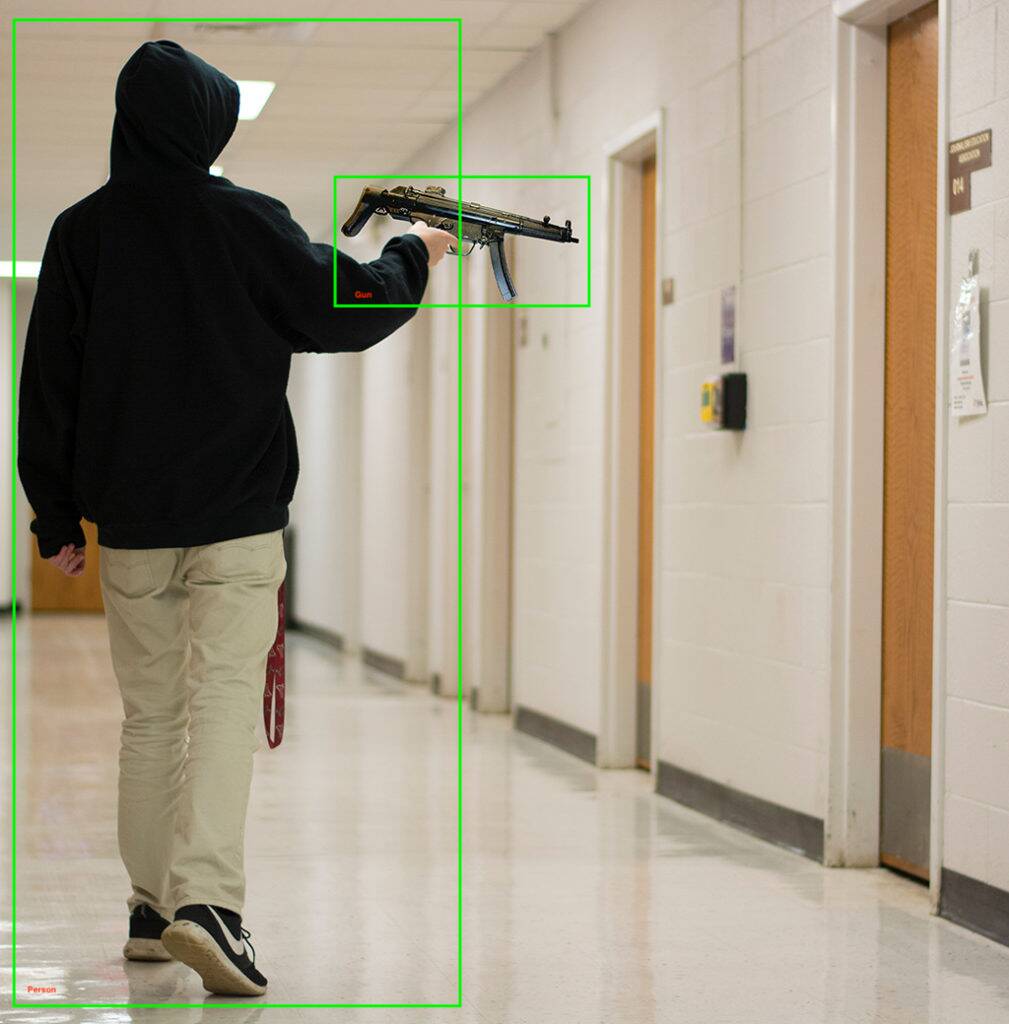

Podjetje za strojno učenje Kogniz je v torek objavilo, da dodaja pripravljeno za uvajanje model zaznavanja orožja na svojo platformo računalniškega vida. Rečeno nam je, da lahko sistem zazna orožje, ki ga vidijo varnostne kamere, in pošlje obvestila ogroženim, obvesti policijo, zaklene zgradbe in izvede druge varnostne naloge.

Poleg odkrivanja strelnega orožja Kogniz uporablja svoje druge module računalniškega vida, da opazi nenavadno vedenje, kot so otroci, ki tečejo po hodnikih ali nekdo, ki pleza skozi okno, kar bi lahko pomenilo aktivnega strelca.

Če se sprašujete o stopnji napačnih pozitivnih rezultatov ali napak kode, Kogniz pravi, da ima "večprehodni AI" in "usposobljeno skupino človeških preverjalcev", ki preverja rezultate njegove programske opreme za zaznavanje. Bodisi pozdravljate to dodatno raven potrditve ali pa nanjo gledate kot na tehnologijo, ki bi lahko padla nazaj na ljudi ravno takrat, ko so računalniki najbolj potrebni.

"[Naša rešitev] podjetjem, vladnim agencijam, šolam in bolnišnicam bistveno olajša pripravo in nato pomoč pri zmanjševanju škode, ki jo povzroča aktivni strelski dogodek," je dejal izvršni direktor Kogniza Daniel Putterman.

Kogniz ni prvo podjetje za računalniški vid, ki se je vključilo v igro prepoznavanja orožja – obstaja precejšen seznam podjetij, ki uporabljajo podobno tehnologijo, nekatera, kot je ZeroEyes, pa so specializirana le za odkrivanje strelnega orožja.

»S širjenjem pozornosti na več ponudb so razvijalci manj sposobni zagotoviti najboljšo storitev pri odkrivanju orožja,« je povedal ZeroEyes v blog post. Tehnologija ZeroEyes je bila uporabljena v šolah v 14 državah, vključno z Srednja šola Oxford v metroju Detroita, kjer je 15-letni strelec lani ubil štiri in ranil sedem.

Drugi prodajalci – kot je Defendry, ki ima varnostni paket, vključno z aplikacijo gumba za paniko, zvočnimi senzorji strelnega orožja, droni za prvi odziv in umetno inteligenco za zaznavanje orožja; in Omnilert – sta na tem depresivno rastočem trgu. Dodatna podjetja na področju odkrivanja orožja z umetno inteligenco vključujejo Arcarith, Athena Securities in Scylla.

Je res dovolj časa?

Leta 2019 je bil odgovor policije na množično streljanje v Daytonu v Ohiu le 32 sekund, v tem času pa je umrlo devet ljudi. Streljanja leta 2021 v obratu FedExa v Indianapolisu, v katerem je bilo ubitih devet ljudi, je bilo prav tako konec, preden so policisti uspeli prispeti, čeprav so to storili v samo nekaj minutah.

Oba primera sprožata vprašanje, ali lahko zaznavanje strelnega orožja z umetno inteligenco dovolj skrajša odzivne čase, da reši življenja. Še posebej, če so policisti preveč prestrašeni ali se odločijo, da se dejansko ne odzovejo, kot na primer pri množičnem umoru v Uvaldeju.

Predlaganih je bilo več drugih metod preprečevanja množičnega streljanja, ki temeljijo na AI, kot npr pametne puške ki ne bodo sprožili, če zaznajo človeško tarčo. Drugi so predlagali usposabljanje umetne inteligence na podlagi podatkov iz preteklih streljanj, lokalnih nakupov orožja in socialno-ekonomskih podatkov za iskanje trendov, ki kažejo na načrtovano streljanje, ter skeniranje družbenih medijev za podobne kazalnike.

Tam je tudi AI pristranskostiA dobro dokumentiran problem da tudi raznoliki nabori podatkov in uravnoteženo usposabljanje ne more rešiti. Vzemimo za primer uvedbo tehnologije za prepoznavanje obraza in orožja leta 2020 v šolskem okrožju v New Yorku: e-poštna sporočila med šolskim okrožjem in podjetjem, ki je uvedlo sistem, pogosto kažejo zaskrbljenost glede tega. napačna identifikacija stvari, kot so ročaji za metle za puške.

V pogovoru za publikacijo Deseret News iz Utaha, višji politični analitik ACLU Jay Stanley je dejal bil je zaskrbljen, da bi lahko sistemi računalniškega vida pripeljali do sveta, »kjer se ljudje izogibajo nečemu tako preprostemu, kot je skakanje po pločniku, ker se bojijo, da bi sprožili detektorje nepravilnosti in da bi jih policija zaslišala«.

Ena možna uporaba umetne inteligence pa morda obeta več: leta 2018 študija iz medicinskega centra otroške bolnišnice Cincinnati je ugotovil, da se je analiza terapevtskih sej z umetno inteligenco v 91 odstotkih primerov strinjala z ocenami nevarnosti psihiatrov in svetovalcev. Dodatek demografskih in socioekonomskih podatkov je le izboljšal rezultate pri prepoznavanju mladih, ki so bili v nevarnosti za storitev nasilja.

Je strojno učenje ob toliko možnih zapletih res pripravljeno preprečiti množične umore?

Nasilje z orožjem je morilec številka ena otrok in najstnikov v Ameriki, vsak dan v povprečju vzame 12 mladih življenj in rani še 32. Umetna inteligenca lahko pomaga, vendar brez odpravljanja njenih pomanjkljivosti so morda potrebni tudi manj tehnološki pristopi. Močnejša, širše dostopna oskrba duševnega zdravja bi lahko bila dober začetek.

V začetku tega meseca je predsednik Biden se imenuje med drugim za prepoved jurišnega orožja, razširjeno preverjanje preteklosti in omejitve zmogljivosti nabojnika, kar je poimenoval "racionalni, zdravorazumski ukrepi." ®

- AI

- ai art

- ai art generator

- imajo robota

- Umetna inteligenca

- certificiranje umetne inteligence

- umetna inteligenca v bančništvu

- robot z umetno inteligenco

- roboti z umetno inteligenco

- programska oprema za umetno inteligenco

- blockchain

- blockchain konferenca ai

- coingenius

- pogovorna umetna inteligenca

- kripto konferenca ai

- dall's

- globoko učenje

- strojno učenje

- platon

- platon ai

- Platonova podatkovna inteligenca

- Igra Platon

- PlatoData

- platogaming

- lestvica ai

- sintaksa

- Register

- zefirnet